1.本发明属于计算机视觉领域,具体涉及一种面向360度全景图像的显著性目标检测方法。

背景技术:

2.基于图像的显著物体检测(sod)的目的是检测和分割捕获人类视觉注意力的物体,这是进行各种视觉任务(例如物体识别,跟踪和图像解析)的重要的第一步。在过去的几十年中,许多基准数据集被构建以驱动sod方法的发展。在这些数据集上,已经提出了许多基于学习的方法来提高sod的性能,并取得了长足的进步。但是,几乎所有现有方法都集中在基于平面图像/视频的sod上,然而,人类感知的是一个三维世界,人类视觉分析的物体在任何时刻都是360

°

全景的场景。随着成像技术和硬件的发展,360

°

内容在流行的图像/视频共享平台上越来越广泛。如何分析360

°

内容是一个新兴问题,对于理解和压缩图像/视频信息以及增强用户体验非常重要。而显著目标检测作为大多数视觉任务的预处理步骤,是进行360

°

图像/视频分析的有力工具。

3.然而,如果直接按传统方法将360

°

场景存储为等矩形图像,然后在常规图像上利用已有的sod算法,预测的显著目标图并不令人满意。显而易见地,360度全景图像与普通平面图像存在一定的差异,相较于平面图像,全景图像具有以下三个特点:一、图像上从中心到两边比例尺逐渐缩小,有全景畸变;二、全景图像畸变导致位于图像中间的物体被明显压缩,而大多显著性目标又分布于图像中部位置,故全景图像数据集中包含许多小尺度,难以识别的目标;三、全景图像的取景范围较一般图像大得多,因此全景图像所含有的图像信息也成倍地增长,一张全景图像往往含有多个显著目标且有大量的干扰信息。而这三个特点正是一般的显著性目标检测模型难以应对的,因此一般的平面图像显著性目标检测模型并不适用于360度全景图像。

技术实现要素:

4.针对现有技术存在的不足,本发明提供了一种面向360度全景图像的显著性目标检测方法。

5.本发明方法包括以下步骤:

6.步骤(1).输入预处理,具体方法如下:

7.利用已有的e2c(equirectangular to cubemap converter)库将数据集(360

‑

sod)中的等距柱状rgb图像,通过计算机自动切割与修复边缘,得到六个方向的等角度立方体贴图,并将原rgb图像与六张立方体贴图进行自然图像正则化。

8.步骤(2).深度特征的提取,具体方法如下:

9.首先构建深度特征提取网络,所述的深度特征提取网络由等距柱状图空间特征提取和等角度立方体贴图空间特征提取双支路组成;所述的等距柱状图空间特征提取分支和所述的和等角度立方体贴图空间特征提取分支基于vgg

‑

19模型构建;所述两个空间特征提

取分支均包括5个卷积块(包含有16个卷积层),卷积核大小设置为3

×

3,步幅大小为1,以及4个最大池化层,池化大小设置为2

×

2,步幅大小为2。不同分支在卷积层中具有不同的权重参数。然后进行深度特征提取网络的输入,所述的等距柱状图空间特征提取分支的输入为等距柱状rgb图像f

r

,所述的等角度立方体贴图空间特征提取分支的输入为对应的六层等角度立方体贴图f

c

,所述的等距柱状图空间特征所述的等角度立方体贴图空间特征贴图空间特征i表示第i个卷积块。

10.步骤(3).双型特征融合,具体方法如下:

11.双型特征融合网络采用了分级融合网络的方式;

[0012]3‑

1.已有的c2e(cubemap to equirectangular converter)相关库将得到的等角度立方体贴图特征投影成等距柱形特征度立方体贴图特征投影成等距柱形特征将和在通道维度拼接得到总特征{f

i

,i=1,2,3,4,5}

[0013]3‑

2.采用注意力模块来对深度特征进行筛选,获得总特征中每一级的深度特征的显著性区域,通道注意力模块产生的深度特征图的定义为:

[0014][0015]

其中,*表示卷积运算,w

s

是卷积滤波器,b

s

表示偏差参数;

[0016]3‑

3.通过softmax操作获得和二者的注意力权重

[0017][0018]

其中,(x,y)表示每个深度特征的空间坐标,(w,h)表示每个深度特征图的纵横比,

[0019]3‑

4.根据注意力权重选择有效的多级注意力深度特征

[0020][0021]

其中,*表示在通道维度上进行hadamard矩阵乘积运算;为注意力模块生成的多级注意力深度特征。所述的多级注意力深度特征包括注意力深度等距柱形特征和注意力等角度立方体贴图特征投影

[0022]3‑

5.将有效的双型特征进行融合:

[0023][0024][0025]

其中d(

·

;

···

;

·

)表示concatenation操作;表示使用速率集r

s

中不同的扩张速率r多次执行op操作并返回所有结果;

[0026]

conv

d

表示不同尺度的空洞卷积;θ

i

是在第i层中学习的参数;

[0027]

步骤(4).多层信息记忆融合,具体方法如下:

[0028]

将得到的五层复合特征信息特征经过信息集成模组后得到并以第五层到第一层的顺序依次输入到门控循环单元,从而将高级语义信息与低级语义信息逐级记忆、筛选、融合,定义如下:

[0029][0030][0031][0032][0033][0034][0035][0036]

其中:

[0037]

是信息集成模组,将各层信息以通道注意力权重进行融合

[0038]

z

i

是更新门,更新激活函数时的逻辑门

[0039]

r

i

是重置门,决定候选隐藏状态时是否放弃以前的隐藏状态

[0040]

是候选隐藏状态,接收

[0041]

h

i

是隐藏状态,是gru的隐层,接收

[0042]

表示hadamard乘积,σ(

·

)表示sigmoid函数

[0043]

步骤(5).显著性预测,具体方法如下:

[0044]

将多层信息融合网络中各层得到的输出经过一个1x1卷积后得到双通道的结果,并和一个softmax层连接,得到最终输出。

[0045]

步骤(6).对深度特征提取网络、双型特征融合网络和多层信息融合记忆网络显著性预测网络以端到端的方式联合训练,具体方法如下:

[0046]

使用adam优化算法对网络模型进行训练,其中动量为0.9,权重衰减率为0.0005,基本学习率为10

‑5。采用vgg

‑

19模型将等距柱状图空间特征提取分支和等角度立方体贴图空间特征提取分支的权重参数初始化;

[0047]

对于具有n个训练样本的数据集其中,表示具有n

p

个像素点的预测图;个像素点的预测图;表示具有n

p

个像素点的二进制真值图;

[0048]

表示显著目标像素,表示背景像素,删除下标n,则损失函数为:

[0049][0050]

其中,w表示卷积核的权重,b表示卷积层的偏置,y

表示显著目标的标签,y

‑

表示背景的标签;β表示显著目标像素在真值图中所占的比率,p(y

j

=1|f;w,b)表示像素属于显著目标的概率。

[0051]

本发明有益效果如下:

[0052]

本发明方法主要优势在于三个方面:等距柱状图空间特征和等角度立方体贴图空间特征相互融合能更好地应对等距柱状投影产生的畸变问题;不同网络层和不同输入模态的深层特征对显著性预测的影响是显著不同的。本发明方法采用注意力模块来对深度特征进行筛选,获得总特征中每一级的深度特征的显著性区域,此处注意力模块相当于权重过滤器用以选择每个深度特征图中最显著的区域或最具代表性的区域;多层信息记忆融合能有效地将高级语义信息与表层空间信息融合,使得网络学习过程中得到的多层空间特征相互影响,最终得到拥有更多特征维度的信息,增强了最终融合特征的上下文信息。本发明方法提供的网络模型可以充分有效地利用等距柱状图空间特征和等角度立方体贴图空间特征来实现对360度全景图像中显著性目标的预测。

附图说明

[0053]

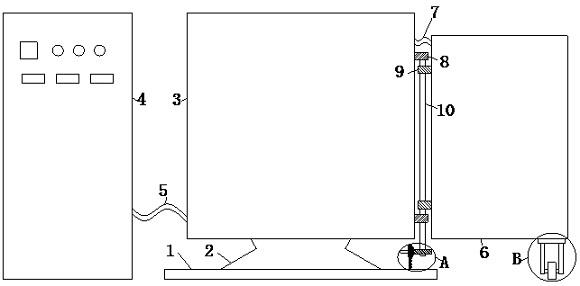

图1为本发明方法的框架图;

[0054]

图2为本发明方法中基于vgg

‑

19模型构建的深度特征提取网络示意图。

具体实施方式

[0055]

下面结合附图对本发明作进一步说明。

[0056]

本发明包括深度特征提取网络、双型特征融合网络、多层信息融合记忆网络。模型的输入是一张等距柱状投影图片,进入模型后会经过预处理得到六张等角度立方体贴图。而后深度特征提取网络将分别提取这两种图片的多级深度空间特征。接着在双型特征融合网络中采用通道注意力机制对其进行特征强化,并利用多尺度空洞卷积模块融合等距柱状投影和等角度立方体贴图的各层深度特征。最后将融合得到的多层复合特征信息依次投入多层信息融合记忆网络,将高级语义信息与低级语义信息逐级记忆、筛选、融合,最后得到模型的输出,既图片的显著性目标预测图。本发明能有效地利用360度全景图像的等角度立方体贴图多角度空间信息来应对等距柱状投影产生的畸变问题,从而更精准地实现对360度全景图片的显著性目标的预测。

[0057]

如图1所示,本发明方法具体如下:

[0058]

步骤(1).输入预处理,具体方法如下:

[0059]

利用已有的e2c(equirectangular to cubemap converter)相关库将数据集(360

‑

sod)中的等距柱状rgb图像,通过计算机自动切割与修复边缘,得到六个方向的等角度立方体贴图,并将原图与六张立方体贴图进行自然图像正则化。

[0060]

步骤(2).深度特征的提取,具体方法如下:

[0061]

首先构建深度特征提取网络,所述的深度特征提取网络由等距柱状图空间特征提取和等角度立方体贴图空间特征提取双支路组成(如图1中rgb1

‑

rgb5,cube1

‑

cube5流程所示);所述的等距柱状图空间特征提取分支和所述的和等角度立方体贴图空间特征提取分支基于vgg

‑

19模型构建(结构如图2所示),所述空间特征提取分支均包括5个卷积块(包含有16个卷积层),卷积核大小设置为3

×

3,步幅大小为1,以及4个最大池化层,池化大小设置为2

×

2,步幅大小为2。不同分支在卷积层中具有不同的权重参数。

[0062]

然后进行深度特征提取网络的输入,所述的等距柱状图空间特征提取分支的输入为等距柱状rgb图f

r

,所述的等角度立方体贴图空间特征提取分支的输入为对应的六层等角度立方体贴图f

c

,所述的等距柱状图空间特征所述的等角度立方体贴图空间特征

[0063]

步骤(3).双型特征融合,具体方法如下:

[0064]

双型特征融合网络采用了分级融合网络的方式;

[0065]3‑

1.已有的c2e(cubemap to equirectangular converter)相关库将得到的等角度立方体贴图特征投影成等距柱形特征度立方体贴图特征投影成等距柱形特征将和在通道维度拼接得到总特征{f

i

,i=1,2,3,4,5}

[0066]3‑

2.采用注意力模块来对深度特征进行筛选,获得总特征中每一级的深度特征的显著性区域,通道注意力模块产生的深度特征图的定义为:

[0067][0068]

其中,*表示卷积运算,w

s

是卷积滤波器,b

s

表示偏差参数;

[0069]3‑

3.通过softmax操作获得和二者的注意力权重

[0070][0071]

其中,(x,y)表示每个深度特征的空间坐标,(w,h)表示每个深度特征图的纵横比,

[0072]3‑

4.根据注意力权重选择有效的多级深度特征

[0073][0074]

其中,*表示在通道维度上进行hadamard矩阵乘积运算;为注意力模块生成的多级注意力深度特征。所述的多级注意力深度特征包括注意力深度等距柱形特征和注意力等角度立方体贴图特征投影

[0075]3‑

5.将有效的双型特征进行融合:

[0076]

[0077][0078]

其中d(

·

;

···

;

·

)表示concatenation操作;表示使用速率集r

s

中不同的扩张速率r多次执行op操作并返回所有结果;

[0079]

conv

d

表示不同尺度的空洞卷积;θ

i

是在第i层中学习的参数;

[0080]

步骤(4).多层信息记忆融合,具体方法如下:

[0081]

将得到的五层复合特征信息特征经过信息集成模组后得到并以第五层到第一层的顺序依次输入到门控循环单元,从而将高级语义信息与低级语义信息逐级记忆、筛选、融合,定义如下:

[0082][0083][0084][0085][0086][0087][0088]

其中:

[0089]

是信息集成模组,将各层信息以通道注意力权重进行融合;

[0090]

z

i

是更新门,更新激活函数时的逻辑门;

[0091]

r

i

是重置门,决定候选隐藏状态时是否放弃以前的隐藏状态;

[0092]

是候选隐藏状态,接收

[0093]

h

i

是隐藏状态,是gru的隐层,接收

[0094]

表示hadamard乘积,σ(

·

)表示sigmoid函数。

[0095]

步骤(5).显著性预测,具体方法如下:

[0096]

将多层信息融合网络中各层得到的输出经过一个1x1卷积后得到双通道的结果,并和一个softmax层连接,得到最终输出。

[0097]

步骤(6).对深度特征提取网络、双型特征融合网络和多层信息融合记忆网络显著性预测网络以端到端的方式联合训练,具体方法如下:

[0098]

使用adam优化算法对网络模型进行训练,其中动量为0.9,权重衰减率为0.0005,基本学习率为10

‑5。采用vgg

‑

19模型将等距柱状图空间特征提取分支和等角度立方体贴图空间特征提取分支的权重参数初始化;

[0099]

对于具有n个训练样本的数据集其中,表示具有n

p

个像素点的预测图;个像素点的预测图;表示具有n

p

个像素点的二进制真值图;

[0100]

表示显著目标像素,表示背景像素,删除下标n,则损失函数为:

[0101][0102]

其中,w表示卷积核的权重,b表示卷积层的偏置,y

表示显著目标的标签,y_表示背景的标签;β表示显著目标像素在真值图中所占的比率,p(y

j

=1|f;w,b)表示像素属于显著目标的概率。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。