一种车辆辅助驾驶系统、车道线时空拟合的系统和方法、fpga芯片

技术领域

1.本发明涉及机器视觉、辅助驾驶这一技术领域,更具体地说,尤其涉及一种车辆辅助驾 驶系统、车道线时空拟合的系统和方法、fpga芯片。

背景技术:

2.车道线是道路中最为常见的路面标识,是车辆行驶路径的主要参考。车道线检测功能对 辅助驾驶和自动驾驶功能,都是必不可少的功能。通常的车道线检测方法,是在传感器(主要 为视觉传感器)采集的图像信息中,对路面上车道线的特征进行识别,拟合出车道线的方向, 作为驾驶系统的决策输入。

3.而采用图像信息中提取车道线特征的方法,常常会发生“由于遮挡或者视角原因而导 致特征不完整”的问题。而当特征不完整时,车道线最终拟合的方向精度会有很大的精度 影响,甚至会导致拟合失败。

4.因此,研究一种提升车道线最终拟合的方向的方法,对于提升辅助驾驶和自动驾驶功 能是一个亟待解决的技术问题。

技术实现要素:

5.本发明的目的在于提供一种车辆辅助驾驶系统、车道线时空拟合的系统和方法、fpga 芯片,其解决了现有技术中的不足之处。

6.一种车道线时空拟合的方法,包括以下步骤:

7.step1,对一段连续时间t1~t

n

时刻内的第1~n张图像(即tx时刻对应的是第x张图像) 的每个图像的车道线进行检测拟合;

8.step2,逐个计算任意前后两张图像,即第f

‑

1张图像,第f张图像之间的[rt]

f

‑

1,f

矩阵:

[0009]

step3,将一段连续时间内的车道线统一到一个坐标系内:

[0010]

step3

‑

1,从t1~t

n

‑1时刻的每张图像,即分别从第1~n张图像中选取车道线的采样点;

[0011]

step3

‑

2,将第1~n张图像中选取的采样点的坐标均统一到第n张图像的坐标系内;

[0012]

step4,进行数据拟合。

[0013]

进一步,step3,还包括:step3

‑

3,计算step3

‑

1中的n张图像选取的采样点的权重;

[0014]

其中,任意时刻下tx中采样点权重l采用下式求解:

[0015][0016]

γ表示参数,取为0.1;

[0017]

u表示调节权重的参数;

[0018]

z为tx时刻下的坐标系下的z值。

[0019]

进一步,step1,具体包括:对于任意一个图像而言,采用以下步骤进行检测拟合:

[0020]

step1

‑

1,提取图像中的纹理边缘信息作为车道线的底层特征;

[0021]

step1

‑

2,将每一条车道线均采用三次曲线来进行拟合,方程表达形式为:

[0022]

x=f(z)=a*z3 b*z2 c*z d;

[0023]

其中,本系统中的坐标系定义为:z向为车辆前进的方向在水平面的投影,y向为竖向 向上的方向,x向为与z方向、y方向垂直的方向;以车辆接触的路面定义为y=0,以双目 相机的中心线为x=0,以车辆的最前端为z=0;

[0024]

其中,a,b,c,d均是拟合出来的参数。

[0025]

进一步,step2,基于惯导单元和车辆时速预测相机姿态变化,即通过车辆的运动速度v 和车辆的角速度w

y

信息,计算任意第f

‑

1图像与第f张图像之间的[rt]矩阵;

[0026]

其中,w

y

表示绕水平面的转动的角速度;

[0027][0028]

其中,δt=t

f

‑

t

f

‑1,v为t

f

‑1时刻的车速,w

y

为t

f

‑1时刻的角速度。

[0029]

进一步,step2,基于前后任意两张图像,即第f

‑

1图像与第f张图像的特征点来计算 [rt]

f

‑

1,f

矩阵:

[0030]

从第f

‑

1张图像中提取v个关键点,其坐标:

[0031][0032]

从第f张图像与第f

‑

1张图像中找到匹配的关键点,其坐标点分别为:

[0033][0034]

则满足以下矩阵:

[0035][0036]

其中,

[0037]

或者:

[0038][0039]

进一步,step2,逐个计算任意前后两张图像,即第f

‑

1张图像,第f张图像之间的[rt]

f

‑

1, f

矩阵,具体包括以下步骤:

[0040]

step2

‑

1,初步确定[rt]

f

‑

1,f,初步

,即利用陀螺仪、轮速信息获取模块201、传感器姿态预 测模块202计算[rt]

f

‑

1,f,初步

[0041]

基于惯导单元和车辆时速预测相机姿态变化,即通过车辆的运动速度v和车辆的角速度 w

y

信息,计算任意第f

‑

1图像与第f张图像之间的[rt]

f

‑

1,f,初步

[0042]

其中,w

y

表示绕水平面的转动的角速度;

[0043][0044]

其中,δt=t

f

‑

t

f

‑1,v为t

f

‑1时刻的车速,w

y

为t

f

‑1时刻的角速度。

[0045]

step2

‑

2,基于前后任意两张图像,即第f

‑

1图像与第f张图像的特征点来计算[rt]

f

‑

1,f

矩阵:

[0046]

从第f

‑

1张图像中提取v个关键点,其坐标:

[0047][0048]

则上述v个关键点在第f张图像中的坐标初步确定为:

[0049][0050]

以上述v个关键点在第f张图像中的坐标初步确定点为圆心,半径为10~30cm(该参数 能够根据实际需要调整),从第f张图像与第f

‑

1张图像中找到匹配的关键点,其坐标点分 别为:

[0051][0052]

则满足以下矩阵:

[0053][0054]

其中,

[0055]

或者:

[0056][0057]

进一步,step3

‑

1,分别从第1~n张图像中选取车道线的采样点,且提取采样点在各图像 自身坐标系下的坐标点,采样点选取时是将每一张图像中拍摄到的车道线进行选取,且间隔 1cm~100cm选取一个采样点;

[0058]

具体包括:

[0059]

首先,从第1张图像中采样车道线的特征点p

1,1

,p

2,1

,

……

p

m1,1

的三维坐标,构建坐标集合 矩阵为:

[0060]

[st1]=[(p

1,1

,1)

t

(p

2,1

,1)

t

……

(p

m1,1

,1)

t

]

[0061]

即,

[0062][0063]

则有:

[0064][0065]

每个特征点的三维坐标的形式均为:p

i,1

=(x

i,1

,0,z

i,1

),其中,z

i,1

通过step1中得到 的第一张图像中的车道线的拟合方程计算而得;

[0066]

然后,从第2张图像中采样车道线的特征点p

1,2

,p

2,2

,

……

p

m2,1

的三维坐标,其坐标集合矩 阵为:

[0067]

[st2]=[(p

1,2

,1)

t

,(p

2,2

,1)

t

……

(p

m2,2

,1)

t

]

[0068]

即:

[0069][0070]

则有:

[0071][0072]

每个特征点的三维坐标的形式均为:p

i,2

=(x

i,2

,0,z

i,2

),其中,z

i,2

通过step1中得到 的第2张图像中的车道线的拟合方程计算而得;

[0073]

……

[0074]

然后,从第n

‑

1张图像中采样车道线的特征点p

1,n

‑1,p

2,n

‑1,

……

p

m n

‑

1,n

‑1的三维坐标,其坐 标集合矩阵为:

[0075]

[st

n

‑1]=[(p

1,n

‑1,1)

t

,(p

2,n

‑1,1)

t

,

……

(p

m n

‑

1,n

‑1,1)

t

]

[0076]

即:

[0077][0078]

则有:

[0079][0080]

每个特征点的三维坐标的形式均为:p

i,n

‑1=(x

i,n

‑1,0,z

i,n

‑1),其中,z

i,n

‑1通过step1 中得到的第n

‑

1张图像中的车道线的拟合方程计算而得;

[0081]

最后,从第n张图像中采样车道线的特征点p

1,n

,p

2,n

,

……

p

m n,,n

的三维坐标;

[0082]

每个特征点的三维坐标的形式均为:p

i,n

=(x

i,n

,0,z

i,n

),其中,x

i,n

通过step1中得到 的第n张图像中的车道线的拟合方程计算而得。

[0083]

进一步,step3

‑

2,将第1~n张图像中选取的采样点的坐标统一到第n张图像的坐标系内:

[0084]

首先,t

n

‑1时刻对齐到t

n

时刻,即第n

‑

1张图像选取的采样点的坐标统一到第n张图像 的坐标系内:

[0085]

[st

n

‑

1,n

]=[rt]

n

‑

1,n

×

[st

n

‑1];[st

n

‑

1,n

]表示坐标集合矩阵[st

n

‑1]转换到第t

n

时刻的坐标系下 的坐标集合矩阵;[rt]

n

‑

1,n

表示从t

n

‑1到t

n

的[rt]矩阵(即第n

‑

1张图像到第n张图像的[rt] 矩阵)。

[0086]

……

[0087]

然后,第t

f

时刻对齐到t

n

时刻:

[0088]

[st

f,n

]=[rt]

f,f 1

×

[rt]

f 1,f 2

……

[rt]

n

‑

2,n

‑1×

[rt]

n

‑

1,n

×

[st

f

];

[0089]

……

[0090]

最后,第t1时刻对齐到t

n

时刻:

[0091]

[st

1,n

]=[rt]

1,2

×

[rt]

2,3

……

[rt]

n

‑

2,n

‑1×

[rt]

n

‑

1,n

×

[st1]。

[0092]

进一步,step4,数据拟合:

[0093]

基于step3

‑

2得到的第1~n张图像的采样点统一到第n张图像的坐标系的坐标集合,采 用三次曲线进行拟合,能够得到车道线方程。

[0094]

进一步,step4,数据拟合:

[0095]

基于step3

‑

2得到的第1~n张图像的采样点统一到第n张图像的坐标系的坐标集合,以 及step3

‑

3得到的各个采样点的权重,采用三次曲线进行加权拟合,能够得到车道线方程。

[0096]

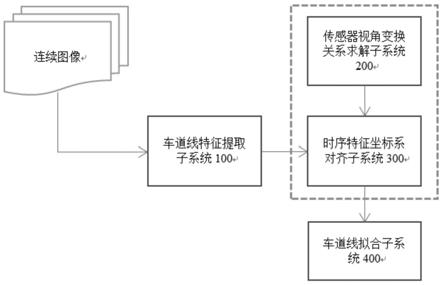

一种车道线时空拟合的系统,包括:车道图像存储系统、车道线特征提取子系统、传感 器视角变换关系求解子系统、时序特征坐标系对齐子系统、车道线拟合子系统;

[0097]

车道线特征提取子系统与车道图像存储系统相互连通;

[0098]

车道线特征提取子系统、传感器视角变换关系求解子系统的输出端分别与时序特征坐标 系对齐子系统的输入端连接,时序特征坐标系对齐子系统的输出端与车道线拟合子系统的输 入端连接;

[0099]

其中,车道线特征提取子系统用于:提取图像中的纹理边缘信息作为车道线的底层特征, 进而检测出每一条车道线信息的方程;用于执行步骤step1;

[0100]

其中,传感器视角变换关系求解子系统包括:陀螺仪、轮速信息获取模块以及传感器姿 态预测模块,和/或相机位姿求解模块;用于执行步骤step2;

[0101]

其中,时序特征坐标系对齐子系统包括:时序特征坐标系变换模块;用于执行步骤step3;

[0102]

其中,车道线拟合子系统,用于执行步骤step4;

[0103]

进一步,时序特征坐标系对齐子系统还包括:时序特征拼接模块,时序特征拼接模块用 于执行步骤step3

‑

3。

[0104]

一种fpga芯片,其存储有所述的执行车道线时空拟合的方法的程序。

[0105]

一种辅助驾驶系统,包括前述的车道线时空拟合系统、显示屏;车道线时空拟合系统利 用车道线拟合子系统得到的车道拟合方程,在显示屏上显示预测的车道线。

[0106]

本发明的有益效果在于:

[0107]

第一,本技术的第一个发明构思在于:

[0108]

车道线特征提取子系统100中通过图像

‑‑

>空间转换为顶视图上拟合方程使用了逆透视变 换(ipm)的技术,将图像空间检测到的车道线通过投影变换,转换到顶视图视角,最终以真实 空间的方程表示:

[0109]

x=f(z)=a*z3 b*z2 c*z d

[0110]

其创造性的思路体现在两点,一个是要将车道线的信息拟合出来,二是采用三次曲线进 行拟合。

[0111]

该思路的目的是要与时序特征坐标系对齐子系统300对应。对于车道线而言,道路上除 了实线以外,还有诸多虚线。发明人发现:对于虚线而言,如果不提取虚线之间的空白处的 特征,最终拟合出来的效果相当差(虚线之间有90cm、60cm、40cm三种规格)。

[0112]

但是,虚线之间的空白处没有车道线,无法直接从图像提取关键点,这就是一个极大的 问题。

[0113]

在经过若干尝试后,发明人团队成员提出了:先将车道线的信息拟合出来,这样就可以 计算虚线空白处的车道线的坐标,进而,时序特征坐标系对齐子系统300在工作时,就能够 提供更多的特征点坐标加入进来。

[0114]

第二,本技术的第二个发明构思在于:实施例二提出前后图像的rt矩阵的计算方式。

[0115]

第三,本技术的第三个发明构思在于,实施例三提出了提升计算实施例二的rt矩阵速 度的方式。

[0116]

第四,本技术的第四个发明构思在于:对齐车道线参数的方式,不是简单的相同权重采 样,而是与视觉的特点结合,进行不同权重的采样,保证对齐的精确性。特别的,如何设计 权重l的方式是发明人方案创新的核心与难点。

[0117]

第五,本技术的底层发明构思在于:本技术的车道线拟合方法是为了提供一种辅

助驾驶 系统,即通过前述的车道线来预测未来的车道线方向,从而方便驾驶人员驾驶。

附图说明

[0118]

下面结合附图中的实施例对本发明作进一步的详细说明,但并不构成对本发明的任何限 制。

[0119]

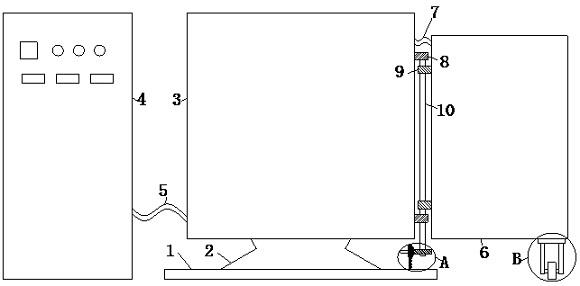

图1是实施例一的一种车道线时空拟合的系统的架构图。

[0120]

图2是实施例一的陀螺仪、轮速信息获取模块201,传感器姿态预测模块202、时序特征 坐标系变换模块301的架构图。

[0121]

图3是本技术的xyz坐标系示意图。

[0122]

图4是实施例二的一种车道线时空拟合的系统的架构图。

[0123]

图5是实施例二的传感器视角变换关系求解子系统、时序特征坐标系对齐子系统的子模 块设计示意图。

[0124]

图6是实施例三的传感器视角变换关系求解子系统、时序特征坐标系对齐子系统的子模 块设计示意图。

[0125]

图7是实施例四的传感器视角变换关系求解子系统、时序特征坐标系对齐子系统的子模 块设计示意图。

[0126]

图8是权重l的示意图。

[0127]

附图标记说明如下:

[0128]

道线特征提取子系统100、传感器视角变换关系求解子系统200、时序特征坐标系对齐子 系统300、车道线拟合子系统400;

[0129]

陀螺仪、轮速信息获取模块201;

[0130]

传感器姿态预测模块202;

[0131]

相机位姿求解模块203;

[0132]

时序特征坐标系变换模块301;

[0133]

对于时序特征拼接模块302。

具体实施方式

[0134]

实施例一:如图1~2所示,一种车道线时空拟合的系统,包括:车道图像存储系统、车 道线特征提取子系统100、传感器视角变换关系求解子系统200、时序特征坐标系对齐子系统 300、车道线拟合子系统400;

[0135]

车道线特征提取子系统100与车道图像存储系统相互连通;

[0136]

车道线特征提取子系统100、传感器视角变换关系求解子系统200的输出端分别与时序 特征坐标系对齐子系统300的输入端连接,时序特征坐标系对齐子系统300的输出端与车道 线拟合子系统400的输入端连接。

[0137]

下面就这四个子系统的功能进行说明。

[0138]

第一,<车道线特征提取子系统100>

[0139]

车道线特征提取子系统100的工作过程如下:

[0140]

x101,提取图像中的纹理边缘信息作为车道线的底层特征;

[0141]

x102,通过聚类和拟合的方式,检测出每一条车道线信息的方程;

[0142]

x103,通过图像

‑‑

>空间转换为顶视图上拟合方程,即完成单一时刻的视角范围内的车道 线检测功能。

[0143]

需要说明的是:步骤x103中,通过图像

‑‑

>空间转换为顶视图上拟合方程使用了逆透视 变换(ipm)的技术,将图像空间检测到的车道线通过投影变换,转换到顶视图视角,最终以真 实空间的方程表示:

[0144]

x=f(z)=a*z3 b*z2 c*z d

[0145]

本系统中的坐标系定义如图3所示,以车辆接触的路面定义为y=0;z向为车辆前进的 方向在水平面的投影,y向为竖向向上的方向,x向为与z方向、y方向垂直的方向(x方 向也是水平面的投影)。

[0146]

其中,a,b,c,d都是拟合出来的参数。

[0147]

第二,<传感器视角变换关系求解子系统200>

[0148]

所述的传感器视角为相机的视角,该子系统是为了获取观测位置(即相机)的方位(即 获取观测位置在时序上的空间变化表达式)。

[0149]

相机在运动过程中,不断的观测,实际上是不断的位姿变化的过程。具体而言,传感器 视角变换关系求解子系统通过相邻的两个时刻,相机坐标系之间发生了旋转和平移的关系, 可通过对观测的图像信息和其他传感器信息进行求解。

[0150]

观察位置的变化可以用旋转和平移矩阵表示为,用齐次矩阵表示

[0151][0152]

上述r

ij

,t

i

是相关参数。

[0153]

具体而言,传感器视角变换关系求解子系统200包括:陀螺仪、轮速信息获取模块201, 传感器姿态预测模块202。

[0154]

对于陀螺仪、轮速信息获取模块201而言,其用于获取陀螺仪(惯导单元)传递而来的3 个方向的加速度a

x

,a

y

,a

z

(即x方向、y方向、z方向的加速度)和3个角速度值ω

x

,ω

y (即水平面内的转动),ω

z

、获取车辆实时速度v(其可以从车身本身获得);

[0155]

对于传感器姿态预测模块202而言,其接受陀螺仪、轮速信息获取模块201传递而来的 信息,用于求解计算[rt]矩阵。

[0156]

本系统中把运动状态简化为顶视图上的2维运动,所以[rt]的计算仅使用速度v和角速 度ω

y

(即水平面的转动)即可计算。

[0157]

具体过程如下:

[0158]

在δt的时间内,在顶视图上的旋转角度的变化为ω

y

*δt,另外2个自由度没有旋转。

[0159]

位移的变化为

[0160]

如果ω

y

为0,那么就是一个直线运动,位移的变化为[0,0,v

×

δt]。在高度的维度上没 有位移。

[0161]

[rt]矩阵可求得:

[0162][0163]

也即,任意一个第f

‑

1张图像到第f张图像:

[0164][0165]

其中,δt=t

f

‑

t

f

‑1,v为t

f

‑1时刻的车速,w

y

为t

f

‑1时刻的角速度。

[0166]

第三,<时序特征坐标系对齐子系统300>

[0167]

时序特征坐标系对齐子系统300,是将一段连续时间内的车道线统一到一个坐标系内。

[0168]

具体而言,时序特征坐标系对齐子系统300包括,时序特征坐标系变换模块301。

[0169]

对于时序特征坐标系变换模块301,其功能在于:将t1~t

n

每个时刻的采样点的坐标对齐 到当前第t

n

时刻的坐标系下,具体的方法是:

[0170]

首先,从t1~t

n

‑1时刻的每张图像中采样车道线的特征点,构建坐标矩阵集合:

[0171][0172]

上式中,p

mn

‑

1,n

‑1表示第n

‑

1张图像中采样车道线的特征点数量,p

mf,f

表示第f张图像中 采样车道线的特征点数量,p

m1,1

表示第1张图像中采样车道线的特征点数量。

[0173]

上式中p

i

=(x

i

,0,z

i

),即表示任意一个特征点的三维坐标;

[0174]

其中,采样时,每隔5cm或者10cm或者其他任意一个距离选择一个特征点;

[0175]

例如:z=0,5,10,15,20

……

,z值依靠车道线特征提取子系统100得到的每张图像中的 拟合方程,可以计算x值。

[0176]

由于车道线在地面上,而地面是我们定义的坐标系高度零点,所以采样点的y

i

=0。

[0177]

时序特征坐标系变换模块301的工作是:

[0178]

首先,t

n

‑1时刻对齐到t

n

时刻,即第n

‑

1张图像选取的采样点的坐标统一到第n张图像的 坐标系内:

[0179]

[st

n

‑

1,n

]=[rt]

n

‑

1,n

×

[st

n

‑1];[st

n

‑

1,n

]表示坐标集合矩阵[st

n

‑1]转换到第t

n

时刻的坐标系下 的坐标集合矩阵;[rt]

n

‑

1,n

表示从t

n

‑1到t

n

的[rt]矩阵(即第n

‑

1张图像到第n张图像的[rt] 矩阵)。

[0180]

……

[0181]

然后,第t

f

时刻对齐到t

n

时刻:

[0182]

[st

f,n

]=[rt]

f,f 1

×

[rt]

f 1,f 2

……

[rt]

n

‑

2,n

‑1×

[rt]

n

‑

1,n

×

[st

f

];[st

f,n

]表示坐标集合矩阵[st

f

] 转换到第t

n

时刻的坐标系下的坐标集合矩阵;[rt]

f,f 1

表示从t

f

到t

f 1

的[rt]矩阵(即第f张 图像到第f 1张图像的[rt]矩阵)

[0183]

……

[0184]

最后,第t1时刻对齐到t

n

时刻:

[0185]

[st

1,n

]=[rt]

1,2

×

[rt]

2,3

……

[rt]

n

‑

2,n

‑1×

[rt]

n

‑

1,n

×

[st1];[st

1,n

]表示坐标集合矩阵[st1]转 换到第t

n

时刻的坐标系下的坐标集合矩阵。

[0186]

基于[st

1,n

],

……

[st

f,n

],

……

[st

n

‑

1,n

],能够直接读取第1张图像,

……

第f张图像,

……

第 n

‑

1张图像选取的采样点在第n张图像的坐标系下的坐标。

[0187]

基于时序特征坐标系变换模块301,可以得到在n张图像中的车道线采样点在当前t

n

时 刻下的坐标系的点集。

[0188]

<车道线拟合子系统400>

[0189]

时序特征坐标系变换模块301得到的n张图像中的车道线采样点在当前t

n

时刻下的坐标 系的点集进行拟合,拟合时仍然采用三次曲线进行拟合:

[0190]

x=f(z)=a*z3 b*z2 c*z d。

[0191]

一种车道线时空拟合的方法,包括以下步骤:

[0192]

step1,对一段连续时间内的n个图像的每个图像的车道线进行检测拟合:

[0193]

对于任意一个图像而言,采用以下步骤进行检测拟合:

[0194]

step1

‑

1,提取图像中的纹理边缘信息作为车道线的底层特征;

[0195]

step1

‑

2,将每一条车道线均采用三次曲线来进行拟合,方程表达形式为:

[0196]

x=f(z)=a*z3 b*z2 c*z d

[0197]

step2,基于惯导单元和车辆时速预测相机姿态变化,即通过车辆的运动速度v和车辆的 角速度w

y

信息,计算车辆下一个时刻的位置和姿态。

[0198]

具体为:

[0199]

f

‑

1张图像中相机视角下的任意一个特征点的坐标点为p1=(x1,y1,z1),第f张图像中相机 视角下与第f

‑

1张图像中匹配的特征点的坐标点为p2=(x2,y2,z2),则有:

[0200][0201]

其中,[rt]

f

‑

1,f

矩阵为:

[0202][0203]

其中,δt表示第f

‑

1张图像与第f张图像之间的时间差。

[0204]

step3,将一段连续时间内的车道线统一到一个坐标系内:

[0205]

step3

‑

1,从第1~n张图像中提取采样点坐标:

[0206]

首先,从第1张图像中采样车道线的特征点p

1,1

,p

2,1

,

……

p

m1,1

的三维坐标,构建坐标集合 矩阵为:

[0207]

[st1]=[(p

1,1

,1)

t

(p

2,1

,1)

t

……

(p

m1,1

,1)

t

]

[0208]

即,

[0209][0210]

则有:

[0211][0212]

每个特征点的三维坐标的形式均为:p

i,1

=(x

i,1

,0,z

i,1

),其中,z

i,1

通过step1中得到 的第一张图像中的车道线的拟合方程计算而得;

[0213]

然后,从第2张图像中采样车道线的特征点p

1,2

,p

2,2

,

……

p

m2,1

的三维坐标,其坐标集合矩 阵为:

[0214]

[st2]=[(p

1,2

,1)

t

,(p

2,2

,1)

t

……

(p

m2,2

,1)

t

]

[0215]

即:

[0216][0217]

则有:

[0218][0219]

每个特征点的三维坐标的形式均为:p

i,2

=(x

i,2

,0,z

i,2

),其中,z

i,2

通过step1中得到 的第2张图像中的车道线的拟合方程计算而得;

[0220]

……

[0221]

然后,从第n

‑

1张图像中采样车道线的特征点p

1,n

‑1,p

2,n

‑1,

……

p

m n

‑

1,n

‑1的三维坐标,其坐 标集合矩阵为:

[0222]

[st

n

‑1]=[(p

1,n

‑1,1)

t

,(p

2,n

‑1,1)

t

,

……

(p

m n

‑

1,n

‑1,1)

t

]

[0223]

即:

[0224][0225]

则有:

[0226][0227]

每个特征点的三维坐标的形式均为:p

i,n

‑1=(x

i,n

‑1,0,z

i,n

‑1),其中,z

i,n

‑1通过step1 中得到的第n

‑

1张图像中的车道线的拟合方程计算而得;

[0228]

最后,从第n张图像中采样车道线的特征点p

1,n

,p

2,n

,

……

p

m n,,n

的三维坐标;

[0229]

每个特征点的三维坐标的形式均为:p

i,n

=(x

i,n

,0,z

i,n

),其中,x

i,n

通过step1中得到 的第n张图像中的车道线的拟合方程计算而得。

[0230]

step3

‑

2,将第1~n张图像中选取的采样点的坐标统一到第n张图像的坐标系内:

[0231]

首先,t

n

‑1时刻对齐到t

n

时刻,即第n

‑

1张图像选取的采样点的坐标统一到第n张图像 的坐标系内:

[0232]

[st

n

‑

1,n

]=[rt]

n

‑

1,n

×

[st

n

‑1];[st

n

‑

1,n

]表示坐标集合矩阵[st

n

‑1]转换到第t

n

时刻的坐标系下 的坐标集合矩阵;[rt]

n

‑

1,n

表示从t

n

‑1到t

n

的[rt]矩阵(即第n

‑

1张图像到第n张

图像的[rt] 矩阵)。

[0233]

……

[0234]

然后,第t

f

时刻对齐到t

n

时刻:

[0235]

[st

f,n

]=[rt]

f,f 1

×

[rt]

f 1,f 2

……

[rt]

n

‑

2,n

‑1×

[rt]

n

‑

1,n

×

[st

f

];

[0236]

……

[0237]

最后,第t1时刻对齐到t

n

时刻:

[0238]

[st

1,n

]=[rt]

1,2

×

[rt]

2,3

……

[rt]

n

‑

2,n

‑1×

[rt]

n

‑

1,n

×

[st1]。

[0239]

step4,进行数据拟合。

[0240]

基于setp3得到的第1~n张图像的采样点统一到第n张图像的坐标系的坐标集合,采用 三次曲线进行拟合,能够得到车道线方程,每条车道线的形式仍然为:

[0241]

x=f(z)=a*z3 b*z2 c*z d。

[0242]

实施例二,实施例一建立了车道线时空拟合的基本方式,但是其效果在某些情况下表现 不佳:

[0243]

第一,第1~n张图像囊括的路程距离不能太长,实施例一的方式在10m左右;

[0244]

第二,拟合精度在距离太长时,精度不够。

[0245]

发明人团队对实施例一的方法进行了逐次分析,发现造成上述问题的核心在于:[rt]

f

‑

1,f

实施例一的方式,只有在

△

t足够小时,精度才能满足,这是其理论本身的瑕疵所在。

[0246]

对此,提出了实施例二的方案。

[0247]

与实施例一相比,区别体现在两方面:

[0248]

(一)如图4

‑

5所示,车道线时空拟合的系统方面,传感器视角变换关系求解子系统200 采用相机位姿求解模块203,不再采用:陀螺仪、轮速信息获取模块201、传感器姿态预测模 块202。

[0249]

同时,车道线特征提取子系统100、传感器视角变换关系求解子系统200均与车道图像 存储系统相互连通。

[0250]

具体而言,一种车道线时空拟合系统,包括:车道图像存储系统、车道线特征提取子系 统100、传感器视角变换关系求解子系统200、时序特征坐标系对齐子系统300、车道线拟合 子系统400;

[0251]

车道线特征提取子系统100、传感器视角变换关系求解子系统200的输出端分别与时序 特征坐标系对齐子系统300的输入端连接,时序特征坐标系对齐子系统300的输出端与车道 线拟合子系统400的输入端连接。

[0252]

对于相机位姿求解模块203而言,其用于通过对比两个时刻的图像信息的关键点,求解 出位姿变换。图像相比较惯导单元传感器,包含更丰富的信息;因此,发明人想到通过对比 两个时刻的图像信息的关键点,求解出位姿变换。

[0253]

对于传感器姿态预测模块203而言,其通过解析相邻前后2帧图像的特征性信息(如角 点),通过优化方法能够求解出相邻前后2帧间相机的位姿变化:

[0254]

设f

‑

1张图像中提取v个关键点的坐标:

[0255][0256]

第f张图像与第f

‑

1张图像中匹配的关键点的坐标点分别为:

[0257][0258]

即,第f

‑

1张图像任意第t个关键点q

t

与第f

‑

1张图像任意第t个关键点q

t

'对应,v≥4 (v取4,5,6,7,8,9,10,11,12,13

……

)

[0259]

将上述第f

‑

1张图像的v个关键点与第f张图像的v个关键点,代入下式:

[0260][0261]

由此可知:

[0262][0263]

设:

[0264]

矩阵:矩阵:

[0265]

则,[rt]

f

‑

1,f

=[q'][q]

‑1[0266]

(二)在拟合方法上,与实施例二的区别仅在于,step2的不同。

[0267]

step2,基于前后任意两张图像,即第f

‑

1图像与第f张图像的特征点来计算[rt]

f

‑

1,f

矩 阵:

[0268]

从第f

‑

1张图像中提取v个关键点,其坐标:

[0269][0270]

从第f张图像与第f

‑

1张图像中找到匹配的关键点,其坐标点分别为:

[0271][0272]

则满足以下矩阵:

[0273][0274]

其中,

[0275]

或者:

[0276][0277]

实施例三,实施例二的运算精度相比较实施例一而言,有了较大的提高。但是,其存在 一个问题,其运行步骤step2而言速度太慢,导致实施例二的运行速度跟不上实际要求。

[0278]

在相机位姿求解模块203中,需要对相邻前后2帧图像的特征信息进行匹配。特征以角 点为例,在没有201获取的外部信息输入的情况下,假设t

f

‑1时刻角点a在图像的坐标位置 为p(x,y,z),而t

f

时刻对应的图像出现的位置为p’(x’,y’,z’)。搜索p

‑‑

>p’是没有任何范围 约束的,即p’可能出现在图像的任意位置,甚至已经不在t时刻图像观测的范围内。

[0279]

这就导致,实施例二的方法在运行时特别慢(寻找p’费时)。

[0280]

实施例三的改变体现在step2上;

[0281]

如图6所示,一种车道线时空拟合系统,包括:车道图像存储系统、车道线特征提取子 系统100、传感器视角变换关系求解子系统200、时序特征坐标系对齐子系统300、车道线

拟 合子系统400;

[0282]

车道线特征提取子系统100、传感器视角变换关系求解子系统200的输出端分别与时序 特征坐标系对齐子系统300的输入端连接,时序特征坐标系对齐子系统300的输出端与车道 线拟合子系统400的输入端连接。

[0283]

传感器视角变换关系求解子系统200,包括:陀螺仪、轮速信息获取模块201,传感器姿 态预测模块202、相机位姿求解模块203。

[0284]

实施例三的拟合方式,相比较与实施例二而言,也是step2进行了改变:

[0285]

step2

‑

1,初步确定[rt]

f

‑

1,f,初步

,即利用陀螺仪、轮速信息获取模块201、传感器姿态预 测模块202计算[rt]

f

‑

1,f,初步

[0286]

基于惯导单元和车辆时速预测相机姿态变化,即通过车辆的运动速度v和车辆的角速度 w

y

信息,计算任意第f

‑

1图像与第f张图像之间的[rt]

f

‑

1,f,初步

[0287]

其中,w

y

表示绕水平面的转动的角速度;

[0288][0289]

其中,δt=t

f

‑

t

f

‑1,v为t

f

‑1时刻的车速,w

y

为t

f

‑1时刻的角速度。

[0290]

step2

‑

2,基于前后任意两张图像,即第f

‑

1图像与第f张图像的特征点来计算[rt]

f

‑

1,f

矩阵:

[0291]

从第f

‑

1张图像中提取v个关键点,其坐标:

[0292][0293]

则上述v个关键点在第f张图像中的坐标初步确定为:

[0294][0295]

以上述v个关键点在第f张图像中的坐标初步确定点为圆心,半径为10cm,从第f张图 像与第f

‑

1张图像中找到匹配的关键点,其坐标点分别为:

[0296][0297]

则满足以下矩阵:

[0298][0299]

其中,

[0300]

或者:

[0301][0302]

实施例三在运行时,有了匹配点的初步范围,其在寻找时效率大增,运行时间大幅节约。

[0303]

实施例四,无论是实施例一、实施例二、实施例三,其技术方案仍然存在一个问题:精 度不足的问题。

[0304]

对此,提出了下列方案:

[0305]

将实施例一、二、三中的:时序特征坐标系对齐子系统300进行了修改。

[0306]

如图7所示,时序特征坐标系对齐子系统300包括,时序特征坐标系变换模块301,时 序特征拼接模块302。

[0307]

对于时序特征坐标系变换模块301而言,其功能并没有改变。

[0308]

增加的“时序特征拼接模块302”,其功能在于:

[0309]

对单帧的检测车道线信息,转到同一个坐标系下。应当是:离摄像头越近,可信度越高, 权重越高;距离当前时刻越近,可信度越高。并且,图像的时间可信度高于图像中距离可信 度(其实质是:t

f

‑1图像的权重区间小于t

f

图像的权重区间)。

[0310]

这是实施例四的核心构思。

[0311]

具体而言,权重l采用下式求解:

[0312]

[0313]

γ表示参数,其大小在[0,1],一般取0.1。

[0314]

u表示调节权重的参数,可取1.0

[0315]

如图8所示,γ=0.1,u=1.0,t1=1s,t

n

=5s。对比了t

x

=1.1s,t

x

=3s,t

x

=5s下的不同z 值下的权重l。

[0316]

特别注意的是,z为tx时刻下的坐标系下的z值,而非在统一坐标系下的结果。

[0317]

将时序特征坐标系变换模块301得到的从t1~t

n

‑1时刻的每张图像中采样车道线的特征点, 构建坐标矩阵集合,计算每个特征点的权重。

[0318]

上述在拟合方法上,增加step3,计算各个采样点的权重。

[0319]

<车道线拟合子系统400>

[0320]

根据“时序特征坐标系变换模块301得到的n张图像中的车道线采样点在当前t

n

时刻下 的坐标系的点集”,“时序特征拼接模块302得到的n张图像的采样点的权重”进行拟合, 拟合时仍然采用三次曲线进行拟合:

[0321]

x=f(z)=a*z3 b*z2 c*z d。

[0322]

加权拟合的数学实现上,可以通过matlab程序实现,或者采用:张永吉.曲线拟合中的 加权处理[j].计算机与应用化学,1994,011(003):238

‑

240来实现。

[0323]

站位到实施例四的方案上看,实施例一、实施例二、实施例三实质上是l=0的一种特别 形式。

[0324]

实施例五,基于实施例一、实施例二、实施例三、实施例四的方法,提出了一种辅助驾 驶系统。

[0325]

一种辅助驾驶系统,包括前述的车道线时空拟合系统,显示屏;车道线时空拟合系统利 用车道线拟合子系统400得到的车道拟合方程,在显示屏上显示预测的车道线。

[0326]

各个方法的对比

[0327][0328]

以上所举实施例为本发明的较佳实施方式,仅用来方便说明本发明,并非对本发明作任 何形式上的限制,任何所属技术领域中具有通常知识者,若在不脱离本发明所提技术特征的 范围内,利用本发明所揭示技术内容所作出局部更动或修饰的等效实施例,并且未脱离本发 明的技术特征内容,均仍属于本发明技术特征的范围内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。