基于神经网络模型的copd诊断信息敏感数据挖掘方法

技术领域

1.本发明涉及数据挖掘技术领域,尤其涉及基于神经网络模型的copd诊断信息敏感数据挖掘方法。

背景技术:

2.数据挖掘技术是指采用统计学、在线分析处理、可视化技术、机器学习、模式识别等诸多方法,从大量的、不完全的、有噪声的、模糊的、随机的实际应用数据中搜索隐藏信息的过程,将数据挖掘技术应用到copd诊断信息数据中,可以明确其中的诊断规则和模式,从而辅助医生进行copd的明确诊断。

3.现有技术中,公开了基于熵权法和主成分分析融合的敏感数据挖掘方法,该方法在敏感数据的基础上确定建模所用的指标,结合主成分分析法和熵权法对敏感数据进行挖掘,该方法没有对敏感数据进行清洗,导致挖掘敏感数据所需的时间较长,存在挖掘效率低的问题;还公开了基于序列格的敏感数据挖掘方法,该方法首先利用最长路径的策略对原始数据库进行截断处理,在此基础上,采用表连接操作生成满足差分隐私的序列格,利用序列格结构本身的特性对敏感数据进行挖掘,该方法获取的数据完整性较差,导致敏感数据的查全率较低;还公开了一种利用主题聚类的敏感数据挖掘方法,该方法采用lda主题模型对数据进行主题聚类,再通过k

‑

means 对以天为单位的数据聚类,最后采用imi挖掘的过程模型自动求解,通过合规性检查对敏感数据进行挖掘,该方法在挖掘到的数据中检测出的错误数据过少,降低了错误数据检测率。

4.鉴于上述问题的存在,本发明人基于从事此类产品工程应用多年丰富的实务经验及专业知识,积极加以研究创新,以期创设基于神经网络模型的copd诊断信息敏感数据挖掘方法,使其更具有实用性。

技术实现要素:

5.本发明所要解决的技术问题是:提供基于神经网络模型的copd诊断信息敏感数据挖掘方法,提高查全率,缩短消耗的时间,提高错误数据的检测率。

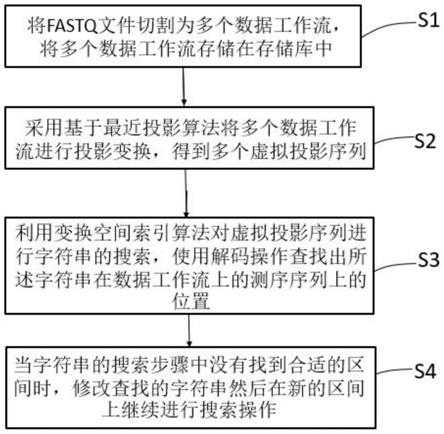

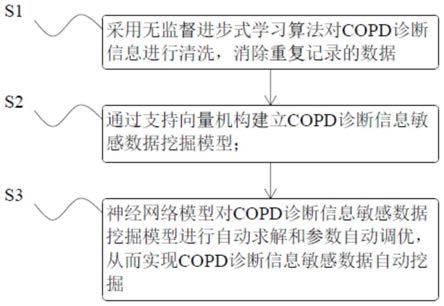

6.为了达到上述目的,本发明所采用的技术方案是:基于神经网络模型的copd诊断信息敏感数据挖掘方法,所述方法包括以下步骤:

7.s1、采用无监督进步式学习算法对copd诊断信息进行清洗,消除重复记录的数据;

8.s2、通过支持向量机构建立copd诊断信息敏感数据挖掘模型;

9.s3、神经网络模型对copd诊断信息敏感数据挖掘模型进行自动求解和参数自动调优,从而实现copd诊断信息敏感数据自动挖掘。

10.进一步地,步骤s1中,对数据的清洗包括以下步骤:

11.得到原始数据后,先对数据集进行预处理,再选择合适的属性;

12.找到合适的聚类算法和分类方法再去分组记录;

13.采用数据挖掘技术进行相似度的计算;

14.采用无监督步进式学习算法对诊断信息中相似的数据进行清理。

15.进一步地,所述无监督进步式学习算法采用竞争学习,所述竞争学习由互相竞争的中性细胞组成,其所述中性细胞的应用规则描述为:

16.e(n)=a/2

‑

φ(w

t

x)

ꢀꢀ

(1)

17.式中,e(.)表示期望值,n描述的是次数;表示遗忘系数,通常情况下大于等于零,表示可微函数,描述的是输入样本向量参数,描述的是权重向量参数,t描述的是向量值;

18.中性细胞的输出为:

19.y=dφ(υ)/dυ=f(υ)

ꢀꢀ

(2)

20.式中:υ=w

t

x表示中性细胞的活性系数,x描述的是输入样本向量参数,w描述的是权重向量参数;t描述的是向量值,在梯度的下降法则基础上得出一种持续学习的规则为:

21.‑

u

ω

e(ω)=dω/dυ

ꢀꢀ

(3)

22.式中:u表示一种学习速度系数,并大于零,ω表示权值,所以梯度为:

[0023][0024]

式中:ω表示(权值);从上述方程函数中可知,中性细胞的学习规则如下:

[0025]

dω/dt=u[yx

‑

aω]

ꢀꢀ

(5)

[0026]

式中:u表示一种学习速度系数,并大于零,a表示遗忘系数,通常情况下大于等于零,x描述的是输入样本向量参数,y描述的是变量值,ω表示权值;

[0027]

离散的学习规则为:

[0028]

ω(t 1)=u[y(t 1)x(t 1)

‑

aω(t)] ω(t)

ꢀꢀ

(6)

[0029]

式中:u表示一种学习速度系数,并大于零,a表示遗忘系数,通常情况下大于等于零,x描述的是输入样本向量参数,y描述的是变量值,t描述的是统计量,ω表示权值;

[0030]

若y是奖惩系数,a等于1,是遗忘系数,i

‑

th中性细胞在被激活情况下的学习规则为:

[0031]

ω

i

(t 1)=uy

i

[x(t 1)

‑

ω

i

(t)] ω

i

(t)

ꢀꢀ

(7)

[0032]

其中:

[0033]

式中:u表示一种学习速度系数,并大于零,x描述的是输入样本向量参数,ω

i

表示权重系数,y

i

表示第i个变量值,d

i

表示i

‑

th中性细胞的相似值,β是惩罚系数,θ代表相似度的门槛,并且:

[0034][0035]

式中:d

p

表示相似值,p表示样本率,ω2表示权值2,y

i

是向量y的i

‑

th元素,ω

i

表示权重系数,y

i

是向量y的i

‑

th元素,x

i

是向量x的i

‑

th元素,i=1,...,l。

[0036]

进一步地,利用所述中性细胞的应用规则对copd诊断信息进行清洗的过程:

[0037]

在加第一个中性细胞ω0前,需要接收第一个copd诊断信息样本向量x,同时,将其初始化;

[0038]

学习若已经结束,则转到第(5)步,学习若未结束,则从copd诊断信息样本空间接收copd诊断信息样本向量,接着代入第(9)步计算相似度的值;

[0039]

找出胜利的中性细胞在竞争力能力的基础上判断,若d

i

大于0,添加一个x作为新的中性细胞,接着返回第(3)步;

[0040]

根据等式(8)计算惩罚系数;

[0041]

在等式(7)中更新权重,然后返回第(3)步;

[0042]

通过上述过程获得copd诊断信息之间的相识度,去除相识度较大的copd诊断信息,实现copd诊断信息的清洗。

[0043]

进一步地,在步骤2中,利用支持向量机建立最优分类函数,实现对数据的初步划分;

[0044]

最优分类函数建立包括以下步骤:

[0045]

设copd诊断信息样本集为(x

i

,y

i

),i=1,

…

,n,,x

i

∈r

d

为选择出的有效特征组合,y

i

∈{ 1,

‑

1}为类别标号,则线性判别函数可写为:

[0046][0047]

式中:b表示系数,表示平均权值,表示样本均值;

[0048]

分类面方程如下:

[0049][0050]

为了使判别函数对两种copd诊断信息样本中的情况全部满足:

[0051][0052]

假设向量集中的向量满足:

[0053]

y

i

(w

·

x b)≥1i=1,

…

,n

ꢀꢀ

(13)

[0054]

式中:y

i

是向量y的i

‑

th元素,w表示权值,x表示样本值,b表示系数,l表示下限,n表示样本数;

[0055]

由于面h1与最优分类面h之间的距离如下:

[0056][0057]

式中:b表示系数,表示平均权值,表示样本均值;

[0058]

根据上述总结出求最优分类面就是求下列的最优化问题:

[0059]

因此最优分类函数表达式:

[0060][0061]

式中:b表示系数,表示平均权值,表示样本均值,s表示样本标准差,t表示检验的统计量;

[0062]

进一步地,构造lagrange函数表达式为:

[0063][0064]

式中:λ代表lagrange系数,b表示回归系数,表示平均权值,表示偏差系数均值,表示样本均值,最优分类函数表达式(15)中,分别对和b求偏导并使其为0,得到如下:

[0065][0066][0067]

如果最优解得到的是则最优分类函数可表示为:

[0068][0069]

式中:sgn()表示符号函数;而当非支持向量的所以仅对支持向量做以上运算即可;求b

*

的值只需将代入上式(18)中即可;对于未知copd诊断信息样本来说,想要判定其分类情况,代入式(19)运算即可。

[0070]

进一步地,当线性不可分和事先不清楚是否线性可分的情况下,部分copd诊断信息样本在不满足式(14)时,引进一个松弛项ζ

i

≥0,引进ζ

i

≥0后得到:

[0071][0072]

当ζ

i

>0划分出现错误时,其最优分类函数表达式如下:

[0073][0074]

式中:c代表可调参数,ζ

i

表示第i个松弛项,b表示回归系数,表示平均权值,表示样本均值,s表示标准层,t表示统计量。

[0075]

进一步地,构造lagrange函数如下:

[0076][0077]

式中:λ

i

、ρ

i

代表lagrange乘子,c代表可调参数,ζ

i

表示第i个松弛项,b表示系数,表示平均权值,表示样本均值;

[0078]

根据kuhn

‑

tucker条件,该优化问题的解满足:

[0079][0080]

由此可知数据自动挖掘问题就是要构建广义最优分类面的问题:

[0081][0082]

式中:λ

i

表示第i个松弛项,λ

j

表示第j个松弛项,b表示系数,表示平均权值,表示样本均值;

[0083]

当c≥λ

i

≥0,ζ

i

=0,想求b的值,只需将满足c≥λ

i

≥0的某λ

i

代入即可。

[0084]

进一步地,步骤3中,神经网络模型在网络的拓扑结构和运行方式的基础上分为前馈多层式网络模型、反馈递归式网络模型和随机型网络模型;所述前馈多层式网络中的bp网络包括输入层、隐含层和输出层,其所述bp网络采用最小均方差的算法,函数自动求解过程如下:

[0085]

bp网络每个处理单元之间的关系为非线性输入输出,当每层都有n个处理单元,则输出函数为:f(x)=1/1 e

‑

x

ꢀꢀ

(25)

[0086]

提取copd诊断信息作为数据训练集,根据症状表现特征将训练集分为h个copd诊断信息样本模式对(x

k

y

k

)(k=1,2...,h),net

pj

记为是对第p个样本单元j的输入总和,o

pj

记为单元的输出,故:

[0087]

net

pj

=∑ω

pj

o

pj

ꢀꢀ

(26)

[0088][0089]

式中:ω

pj

表示第p个样本单元j的输入值;

[0090]

对每个输入模式p来说,如果随意设置初始权值就会导致网络的实际输入与期望输出之间出现误差,网络误差值如下:

[0091]

e

p

=1/2∑(d

pj

‑

o

pj

)2ꢀꢀ

(28)

[0092]

e=∑e

p

ꢀꢀ

(29)

[0093]

在式中,d

pj

代表输出单元j的期望输出,第p个输入模式。

[0094]

基于上述网络误差值,其误差变化率的函数公式如下:

[0095][0096]

在式中δ

pj

代表第p个输入模式对第j个单元的copd诊断信息分类的误差变化率,其中η1代表输出层学习率,η2代表隐含层学习率。

[0097]

进一步地,bp网络的学习过程中可自动修改分类学习因子,实现最优分界函数自动求解,具体步骤如下:当o

pj

为隐单元输出时:

[0098][0099]

将隐单元输出结果作为输入,输入输出层中,自动获得函数的最优解,实现copd诊断信息敏感数据的自动挖掘:

[0100][0101]

本发明的有益效果为:该方法通过无监督进步式的学习算法对copd诊断信息敏感数据进行清洗,以神经网络模型优化支持向量机模型,实现最优分界函数自动求解和参数自动调优,可以自动地记录、处理未标记的、大量的数据记录,更加有效地发挥数据挖掘过程中的潜在价值,提高了查全率,缩短了消耗的时间,提高了错误数据的检测率。

附图说明

[0102]

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明中记载的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

[0103]

图1为本发明实施例中基于神经网络模型的copd诊断信息敏感数据挖掘方法的流程图;

[0104]

图2为本发明实施例中数据清洗框架;

[0105]

图3为本发明实施例中无监督学习的块图表;

[0106]

图4为本发明实施例中svm分类最优分界面示意图;

[0107]

图5为本发明实施例中bp网络结构图;

[0108]

图6为本发明实施例中异常数据集的查全率的对比图表;

[0109]

图7为本发明实施例中时间的消耗的对比图表;

[0110]

图8为本发明实施例中错误数据的检测率的对比图表。

具体实施方式

[0111]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。

[0112]

需要说明的是,当元件被称为“固定于”另一个元件,它可以直接在另一个元件上或者也可以存在居中的元件。当一个元件被认为是“连接”另一个元件,它可以是直接连接到另一个元件或者可能同时存在居中元件。本文所使用的术语“垂直的”、“水平的”、“左”、“右”以及类似的表述只是为了说明的目的,并不表示是唯一的实施方式。

[0113]

除非另有定义,本文所使用的所有的技术和科学术语与属于本发明的技术领域的

技术人员通常理解的含义相同。在本发明的说明书中所使用的术语只是为了描述具体的实施例的目的,不是旨在于限制本发明。本文所使用的术语“及/或”包括一个或多个相关的所列项目的任意的和所有的组合。

[0114]

如图1至图5所示的基于神经网络模型的copd诊断信息敏感数据挖掘方法,方法包括以下步骤:

[0115]

s1、采用无监督进步式学习算法对copd诊断信息进行清洗,消除重复记录的数据;

[0116]

s2、通过支持向量机构建立copd诊断信息敏感数据挖掘模型;

[0117]

s3、神经网络模型对copd诊断信息敏感数据挖掘模型进行自动求解;

[0118]

s4、实现copd诊断信息敏感数据自动挖掘。

[0119]

本发明优选实施例中,步骤s1中对数据的清洗包括以下步骤:得到原始数据后,先对数据集进行预处理,再选择合适的属性;copd诊断信息数据清洗是在敏感数据自动挖掘前的一个重要的对数据集的预处理,预处理是对数据重新整理、分类、校正,将数据中重复的、无用的数据噪声排除,改正错误数据,保证数据的完整性,从而提高数据质量;找到合适的聚类算法和分类方法再去分组记录;采用数据挖掘技术进行相似度的计算;采用无监督步进式学习算法对诊断信息中相似的数据进行清理。

[0120]

如图2所示的数据清洗框架适用于大部分的数据清洗,但其中不包括数据挖掘的算法,在图1中选择合适copd诊断信息的算法框架,可以清除掉数据噪声。

[0121]

由于本发明中的copd诊断信息中存在大量重复记录和不完整的数据噪声,因此需要对copd诊断信息进行清理。而传统方法进行数据清洗时,大多出现了据不完整的问题,为了提高copd诊断信息数据质量,缓解错误数据过多等问题,采用copd诊断信息数据清洗系统框架,改正copd诊断信息数据文件中可识别的错误,为copd诊断信息数据挖掘提供工具,采用无监督步进式算法对copd诊断信息进行清理。对于异常数据与缺失数据,选用相似度最高的数据补替并作出标记。

[0122]

如图3所示无监督步进式学习方法的过程,通常情况下,无监督机器学习包括竞争学习和强化学习两种学习方法,强化学习是在增强外环境的情况下、在评估的基础上提高学习能力,竞争学习是从输入的数据中“学习”得到知识,无监督进步式学习算法采用竞争学习,竞争学习由互相竞争的中性细胞组成,其中性细胞的应用规则描述为:

[0123]

e(n)=a/2

‑

φ(w

t

x)

ꢀꢀ

(1)

[0124]

式中:e(.)表示期望值,n描述的是次数,a表示遗忘系数,通常情况下大于等于零,φ(

·

)表示可微函数,x描述的是输入样本向量参数,w描述的是权重向量参数,t描述的是向量值;

[0125]

中性细胞的输出为:

[0126]

y=dφ(υ)/dυ=f(υ)

ꢀꢀ

(2)

[0127]

式中:υ=w

t

x表示中性细胞的活性系数,x描述的是输入样本向量参数,w描述的是权重向量参数;t描述的是向量值,在梯度的下降法则基础上得出一种持续学习的规则为:

[0128]

‑

u

ω

e(ω)=dω/dυ

ꢀꢀ

(3)

[0129]

式中:u表示一种学习速度系数,并大于零,ω表示权值,所以梯度为:

[0130][0131]

式中:ω表示权值,从上述方程函数中可知,中性细胞的学习规则如下:

[0132]

dω/dt=u[yx

‑

aω]

ꢀꢀ

(5)

[0133]

式中:u表示一种学习速度系数,并大于零,a表示遗忘系数,通常情况下大于等于零,x描述的是输入样本向量参数,y描述的是变量值,ω表示权值;

[0134]

离散的学习规则为:

[0135]

ω(t 1)=u[y(t 1)x(t 1)

‑

aω(t)] ω(t) (6)

[0136]

式中:u表示一种学习速度系数,并大于零,a表示遗忘系数,通常情况下大于等于零,x描述的是输入样本向量参数,y描述的是变量值,t描述的是统计量,ω表示权值;

[0137]

若y是奖惩系数,a等于1,是遗忘系数,i

‑

th中性细胞在被激活情况下的学习规则为:

[0138]

ω

i

(t 1)=uy

i

[x(t 1)

‑

ω

i

(t)] ω

i

(t)

ꢀꢀ

(7)

[0139]

其中:

[0140]

式中:u表示一种学习速度系数,并大于零,x描述的是输入样本向量参数,ω

i

表示权重系数,y

i

表示第i个变量值,d

i

表示i

‑

th中性细胞的相似值,β是惩罚系数,θ代表相似度的门槛,并且:

[0141][0142]

式中:d

p

表示相似值,p表示样本率,ω2表示权值2,y

i

是向量y的i

‑

th元素,x

i

是向量x的i

‑

th元素,i=1,...,l。

[0143]

应用以上表达式,利用中性细胞的应用规则对copd诊断信息进行清洗的过程:

[0144]

在加第一个中性细胞ω0前,需要接收第一个copd诊断信息样本向量x,同时,将其初始化;

[0145]

学习若已经结束,则转到第(5)步,学习若未结束,则从copd诊断信息样本空间接收copd诊断信息样本向量,接着代入第(9)步计算相似度的值;

[0146]

找出胜利的中性细胞在竞争力能力的基础上判断,若d

i

大于0,添加一个x作为新的中性细胞,接着返回第(3)步;

[0147]

根据等式(8)计算惩罚系数;

[0148]

在等式(7)中更新权重,然后返回第(3)步;

[0149]

通过上述过程获得copd诊断信息之间的相识度,去除相识度较大的copd诊断信息,实现copd诊断信息的清洗。

[0150]

在步骤2中,利用支持向量机建立最优分类函数,实现对数据的初步划分;支持向量机是一种新的模式识别方法,它有解决小样本、非线性即高维模式识别问题等优点,采用支持向量机建立copd诊断信息敏感数据挖掘模型。能够保证真实风险最小化。

[0151]

如图3所示,h分类面将左右两侧copd诊断信息样本无错误的分开,h1和h2与h分类面平行且分别通过距离h最近的copd诊断信息样本,h1和h2的距离是两种copd诊断信息样本的分类间隙。算出最优分类面就能保证真实风险最小化,最优分类面就是将两种copd诊

断信息样本无错误分开且分类间隙最大的分类面,确保了识别经验风险最小化和置信范围最小化,进而降低了真实风险。

[0152]

其中,最优分类函数建立包括以下步骤:

[0153]

设copd诊断信息样本集为(x

i

,y

i

),i=1,

…

,n,,x

i

∈r

d

为选择出的有效特征组合,y

i

∈{ 1,

‑

1}为类别标号,则线性判别函数可写为:

[0154][0155]

式中:b表示系数,表示平均权值,表示样本均值;

[0156]

分类面方程如下:

[0157][0158]

为了使判别函数对两种copd诊断信息样本中的情况全部满足:

[0159][0160]

假设向量集中的向量满足:

[0161]

y

i

(w

·

x b)≥1i=1,

…

,n

ꢀꢀ

(13)

[0162]

式中:y

i

是向量y的i

‑

th元素,w表示权值,x表示样本值,b表示系数,l表示下限,n表示样本数;

[0163]

由于面h1与最优分类面h之间的距离如下:

[0164][0165]

因为面h

i

上的支持向量是所以面h1到面h2的分类间隙等于根据图3可知最大化分类间隙相当于最小化所以最优分类面就是满足式(14)的同时使其为最小化。

[0166]

根据上述总结出求最优分类面就是求下列的最优化问题:

[0167]

最优分类函数表达式:

[0168][0169]

式中:b表示系数,表示平均权值,表示样本均值,s表示样本标准差,t表示检验的统计量;

[0170]

构造lagrange函数表达式为:

[0171][0172]

式中:λ代表lagrange系数,b表示回归系数,表示平均权值,表示偏差系数均值,表示样本均值,在式(15)中存在唯一最优解,因为它是一个凸二次规划问题,最优分

类函数表达式(15)中,分别对和b求偏导并使其为0,得到如下:

[0173][0174][0175]

如果最优解得到的是则最优分类函数可表示为:

[0176][0177]

式中:sgn()表示符号函数;而当非支持向量的所以仅对支持向量做以上运算即可;求b

*

的值只需将代入上式(18)中即可;对于未知copd诊断信息样本来说,想要判定其分类情况,代入式(19)运算即可。

[0178]

当线性不可分和事先不清楚是否线性可分的情况下,部分copd诊断信息样本在不满足式(14)时,引进一个松弛项ζ

i

≥0,引进ζ

i

≥0后得到:

[0179][0180]

当ζ

i

>0划分出现错误时,训练集中copd诊断信息样本划分错误的总体情况可以由来反映,在线性不可分的情况下的最优分类面叫做广义最优分类面。所以当划分错误时构建广义最优分类面不仅要将分类间隔尽量变小,还要将错分copd诊断信息样本数尽量减少,其最优分类函数表达式如下:

[0181][0182]

式中:c代表可调参数,ζ

i

表示第i个松弛项,b表示回归系数,表示平均权值,表示样本均值,s表示标准层,t表示统计量。c的作用是控制对错分copd诊断信息样本惩罚的程度。错分的copd诊断信息样本比列和算法复杂度之间的折衷程度可以由c的大小反映出来,故c越小对分类错误的惩罚程度越小,否则反之。

[0183]

此时构造lagrange函数如下:

[0184][0185]

式中:λ

i

、ρ

i

代表lagrange乘子,c代表可调参数,ζ

i

表示第i个松弛项,b表示系数,

表示平均权值,x表示样本均值;根据kuhn

‑

tucker条件,该优化问题的解满足:

[0186][0187]

因为最优化问题的解要满足上述方程,由此可知数据自动挖掘问题就是要构建广义最优分类面的问题:

[0188][0189]

式中:λ

i

表示第i个松弛项,λ

j

表示第j个松弛项,b表示系数,表示平均权值,表示样本均值;

[0190]

当c≥λ

i

≥0,ζ

i

=0,想求b的值,只需将满足c≥λ

i

≥0的某λ

i

代入即可。

[0191]

利用支持向量机建立最优分类函数,实现对数据的初步划分,为后续利用神经网络模型精确分类奠定基础,在一定程度上提高了数据挖掘的精确性。

[0192]

步骤3中,利用神经网络模型自动求解上述最优分类函数,实现copd诊断信息敏感数据的自动挖掘。神经网络模型在网络的拓扑结构和运行方式的基础上分为前馈多层式网络模型、反馈递归式网络模型和随机型网络模型;

[0193]

如图5所示前馈多层式网络中的bp网络包括输入层、隐含层和输出层,它们层与层之间全互连,但层内神经元之间无连接,其bp网络采用最小均方差的算法,是典型的监督学习,是δ学习律的推广和发展,函数自动求解过程如下:

[0194]

函数自动求解过程如下:bp网络每个处理单元之间的关系为非线性输入输出,当每层都有n个处理单元,则输出函数为:

[0195]

f(x)=1/1 e

‑

x

ꢀꢀ

(25)

[0196]

从医疗系统的电子医疗记录中提取copd诊断信息作为数据训练集,根据症状表现特征将训练集分为h个copd诊断信息样本模式对(x

k

y

k

)(k=1,2...,h),net

pj

记为是对第p个样本单元j的输入总和,o

pj

记为单元的输出,故:

[0197]

net

pj

=∑ω

pj

o

pj

ꢀꢀ

(26)

[0198][0199]

式中:ω

pj

表示第p个样本单元j的输入值;

[0200]

对每个输入模式p来说,如果随意设置初始权值就会导致网络的实际输入与期望输出之间出现误差,网络误差值如下:

[0201]

e

p

=1/2∑(d

pj

‑

o

pj

)2ꢀꢀ

(28)

[0202]

e=∑e

p

ꢀꢀ

(29)

[0203]

在式中,d

pj

代表输出单元j的期望输出,第p个输入模式。

[0204]

基于上述网络误差值,δ学习规则的本质是用梯度最速下降法使权值沿着函数的副梯度方向改变,传统方法的学习率通常是固定不变的,使权值和阈值参数的调节幅度较大,本文分开调整输出层学习率η1和隐含层学习率η2,以替代传统的固定学习率。

[0205]

其误差变化率的函数公式如下:

[0206][0207]

在式中δ

pj

代表第p个输入模式对第j个单元的copd诊断信息分类的误差变化率,其中η1代表输出层学习率,η2代表隐含层学习率。

[0208]

在上述实施例基础上,隐含层单元和输出层单元的误差计算是不相同的,在bp网络的学习过程中可自动修改分类学习因子,实现最优分界函数自动求解,步骤如下:

[0209]

当o

pj

为隐单元输出时:

[0210][0211]

将隐单元输出结果作为输入,输入输出层中,自动获得函数的最优解,实现copd诊断信息敏感数据的自动挖掘:

[0212][0213]

为了验证基于神经网络模型的copd诊断信息敏感数据挖掘方法的整体有效性,在explorer上的classify面板中对基于神经网络模型的copd诊断信息敏感数据自动挖掘方法进行测试,分别采用方法一、方法二和方法三进行查全率、时间消耗和错误数据检测率对比测试,其中方法一采用的本发明的数据挖掘方法,方法二和方法三为现有技术中的两种数据挖掘方法。

[0214]

对比不同方法的查全率detecton rate,查全率描述的是正确检测的异常数据占copd诊断信息样本总异常的百分比,计算公式如下:

[0215]

detecton rate=true positive/true positive

[0216]

false negative

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(33)

[0217]

式中:true positive表示真阳率;true negative表示真负类。

[0218]

如图6所示,方法一的异常点查全率均高于方法二和方法三的异常点查全率,而且方法一的查全率高达98%以上,这是因为方法一在copd诊断信息敏感数据自动挖掘前,采用了基于无监督步进式的学习方法对copd诊断信息敏感数据进行了数据清洗,减少了数据库中大量的重复数据,提高了查全率。

[0219]

为了进一步验证方法的整体有效性,采用上述方法进行copd诊断信息敏感数据自动挖掘的测试,对照三种方法在数据量相同情况下的时间消耗;

[0220]

如图7所示,在相同数据量的情况下,方法一的时间消耗要比方法二和方法三的时

间消耗短,这是因为方法一是在数据清洗框架的基础上对copd诊断信息的敏感数据进行清洗,排除了copd诊断数据中的错误数据,缩短了copd诊断信息敏感数据自动挖掘消耗的时间,验证了方法1的效率性。

[0221]

比较以上三种方法的错误数据检测率,错误数据的检测率可通过下式进行计算:

[0222][0223]

式中:tp代表错误数据被判定错误数据,tn代表正确数据被判定正确数据,fp代表正确数据被判定错误,fn代表错误数据被判定正确数据。

[0224]

随着数据量的增大,导致错误数据的检测能力降低,如图8所示,方法一的错误检测率虽会随数据量的增大而降低,但均高于80%以上,因为方法一可以对挖掘到的copd诊断信息敏感数据最优分界函数进行自动求解、记录,处理未标记的、大量的数据记录,将数据中的错误数据全部检测出来,避免了数据中参差其他无用的数据,提高了对错误数据检测的能力。

[0225]

本行业的技术人员应该了解,本发明不受上述实施例的限制,上述实施例和说明书中描述的只是说明本发明的原理,在不脱离本发明精神和范围的前提下,本发明还会有各种变化和改进,这些变化和改进都落入要求保护的本发明范围内。本发明要求保护范围由所附的权利要求书及其等效物界定。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。