1.本发明属于自动驾驶领域技术领域,具体涉及一种基于视觉目标跟踪的车辆驾驶自主决策方法及装置。

背景技术:

2.自动驾驶系统,是近年来工业界研究的热门领域,其依靠机器学习、图像处理、雷达和定位系统等信息采集分析系统协同合作,让系统可以在没有人类主动操作的环境下,自动、安全地操控机动车辆。

3.图像与视频处理、机器学习包含自动驾驶系统完成驾驶任务的关键技术,其中,基于视觉的目标跟踪技术与方法是融合了图像与视频处理领域和机器学习领域成果的跨学科问题,其目的是通过单台或多台摄像机采集汽车周围的环境信息,在对环境图像的目标进行识别、提取后,持续对标记目标进行位置、形态方面的追踪。目标跟踪技术的输入是图像或视频中的标记目标,输出通常是目标在图像时间序列中的连续坐标。通过进一步分析坐标的变化,可以得出目标的类型、距离等自动驾驶系统实现自我决策所必需的关键信息。

4.现有技术在自动驾驶过程中发生突发状况,目标在图像的坐标会产生较大变化,在时间上的相关度降低。因此检测目标准确度随之降低,导致自动驾驶决策方案并不能满足用户需求的准确性以及高效性。

技术实现要素:

5.本发明提供了一种基于视觉目标跟踪的车辆驾驶自主决策方法及装置,以提高车辆驾驶自主决策方法的准确性以及高效性。具体的技术方案如下。

6.第一方面,本发明提供的一种基于视觉目标跟踪的车辆驾驶自主决策方法,包括:

7.获取驾驶车辆的图像数据序列;

8.将所述图像数据序列中的每一帧作为跟踪模型的输入,将当前帧的前一帧作为参考帧,以使所述跟踪模型在当前帧的上一帧中选取目标区域标记周围的一个邻域用作训练区域,在当前帧中截取与所述训练区域相同的坐标区域,将该坐标区域作为跟踪目标概率的第一候选区域;

9.从所述参考帧中获得滤波参数;

10.根据滤波参数,计算所述第一候选区域所对应的期望响应值;

11.在所述期望响应值中确定最大值以及最大值期望值对应的第一候选区域;

12.将所述最大值对应的第一候选区域确定作为目标区域;

13.对所述目标区域进行标记,获得目标对应的区域标记;

14.将每一帧的目标对应的区域标记按照帧序组成目标区域标记序列;

15.将所述目标区域标记序列输入训练后的决策神经网络中,得到驾驶车辆是否减速的输出结果,以使所述驾驶车辆根据输出结果进行相应驾驶操作。

16.可选的,在所述将所述图像数据序列作为跟踪模型的输入,获得目标在图像序列

每一帧中对应的区域标记的步骤之前,所述车辆驾驶自主决策方法还包括:

17.获取训练数据集;

18.其中,所述训练数据包括多个样本,样本包括包含汽车目标标记为1的正样本,以及不包含汽车目标记为0的负样本;

19.根据预设层数,构建神经网络模型;

20.使用所述训练数据集训练所述构建的神经网络模型;

21.将训练完成的神经网路模型确定为跟踪模型。

22.可选的,所述跟踪模型在当前帧的上一帧中选取目标区域标记周围的一个邻域用作训练区域包括:

23.设置初始坐标;

24.在参考帧中从初始坐标开始按照预设的移动步长选择子图区域,跟踪模型,获得每个子图区域对应的输出值;

25.当所述子图区域对应的输出值大于第一阈值时,则将该子图区域加入候选区域集合;

26.在所述候选区域集合中选择输出值最大的第二候选区域用作训练区域。

27.其中,所述第一候选区域尺寸大于目标区域的尺寸,

28.w

s

=(1 β)w

n

29.h

s

=(1 β)h

n

30.其中,w

s

表示第一候选区域的长,h

s

表示第一候选区域的宽,w

n

表示目标区域的长,h

n

表示目标区域的宽,β为大于0的数值。

31.可选的,从所述参考帧中获得滤波参数包括:

32.根据参考帧中的位移图像样本将预设的滤波器中的滤波参数进行线性表达;

33.根据线性表达对所述预设的滤波器求导,获得滤波参数;

34.所述预设的滤波器为min

w

∑

i,j

||s

i,j

·

w

‑

y0(i,j)||2 λ‖w‖2;所述滤波参数的线性表达为:w=∑

i,j

a

i,j

s

i,j

,所述预设的滤波器求导结果为:

35.其中,w为滤波参数,λ为正则系数取值范围为[0,

├

∞)

┤

,y0(i,j)为期望响应值,s

i,j

为循环位移,i表示在水平方向循环移位的距离,j在竖直方向循环移位的距离,表示y0(i,j)的离散傅里叶变换,表示w的离散傅里叶变换,和为复共轭关系,

⊙

为哈达玛乘积,表示第一候选区域。

[0036]

可选的,所述滤波参数,计算所述第一候选区域所对应的期望响应值包括:

[0037]

设置参考帧的循环位移;

[0038]

将所述参考帧的候选区域在当前帧中按照所述循环位移进行移位,确定每个候选区域的循环位移对应的高斯权重系数;

[0039]

将所述高斯权重系数确定为所述候选区域的期望响应值。

[0040]

可选的,所述将所述参考帧的候选区域在当前帧中按照所述循环位移进行移位,确定每个候选区域的循环位移对应的高斯权重系数包括:

[0041]

将所述参考帧的候选区域在当前帧中按照所述循环位移进行移位,使用期望值计

算公式,确定每个候选区域的循环位移对应的高斯权重系数;

[0042]

所述期望值计算公式为:

[0043][0044]

w

s

表示第一候选区域的长,h

s

表示第一候选区域的宽,σ表示高斯函数的标准方差,y0(i,j)表示循环移位s

i,j

所对应的高斯权重系数。

[0045]

可选的,所述训练后的决策神经网络包括一个输入层、六个隐含层以及一个输出层,所述决策神经网络的激励函数为分段函数,所述分段函数为:其中,x表示输入,θ表示激励因子。

[0046]

第二方面,本发明提供的一种基于视觉目标跟踪的车辆驾驶自主决策装置包括:

[0047]

获取模块,用于获取驾驶车辆的图像数据序列;

[0048]

跟踪模块,用于将所述图像数据序列中的每一帧作为跟踪模型的输入,将当前帧的前一帧作为参考帧,以使所述跟踪模型在当前帧的上一帧中选取目标区域标记周围的一个邻域用作训练区域,在当前帧中截取与所述训练区域相同的坐标区域,将该坐标区域作为跟踪目标概率的第一候选区域;

[0049]

参数确定模块,用于从所述参考帧中获得滤波参数;

[0050]

计算模块,用于根据滤波参数,计算所述第一候选区域所对应的期望响应值;

[0051]

区域确定模块,用于在所述期望响应值中确定最大值以及最大值期望值对应的第一候选区域;

[0052]

目标确定模块,用于将所述最大值对应的第一候选区域确定作为目标区域;

[0053]

区域标记模块,用于对所述目标区域进行标记,获得目标对应的区域标记;

[0054]

组成模块,用于将每一帧的目标对应的区域标记按照帧序组成目标区域标记序列;

[0055]

决策模块,用于将所述目标区域标记序列输入训练后的决策神经网络中,得到驾驶车辆是否减速的输出结果,以使所述驾驶车辆根据输出结果进行相应驾驶操作。

[0056]

可选的,所述跟踪模块,具体用于:

[0057]

设置初始坐标;

[0058]

在参考帧中从初始坐标开始按照预设的移动步长选择子图区域,跟踪模型,获得每个子图区域对应的输出值;

[0059]

当所述子图区域对应的输出值大于第一阈值时,则将该子图区域加入候选区域集合;

[0060]

在所述候选区域集合中选择输出值最大的第二候选区域用作训练区域。

[0061]

本发明实施例的创新点包括:

[0062]

1、本发明提供的一种基于视觉目标跟踪的车辆驾驶自主决策方法,通过获取驾驶车辆的图像数据序列作为跟踪模型的输入,采用优化网络结构和激励函数,构建神经网络模型然后进行训练得到跟踪模型,对目标进行跟踪检测,提升检测效率;

[0063]

2、本发明采用从所述参考帧中获得滤波参数;根据滤波参数,计算所述第一候选

区域所对应的期望响应值;在所述期望响应值中确定最大值以及最大值期望值对应的第一候选区域;将所述最大值对应的第一候选区域确定作为目标区域,以此对目标进行持续跟踪可以提高目标检测的准确性;

[0064]

3、本发明优化决策神经网络结构和激励函数构建决策神经网络,然后以目标区域标记序列为输入对车辆是否减速做出决策,因此可以提升决策稳定性。

附图说明

[0065]

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单介绍。显而易见地,下面描述中的附图仅仅是本发明的一些实施例。对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

[0066]

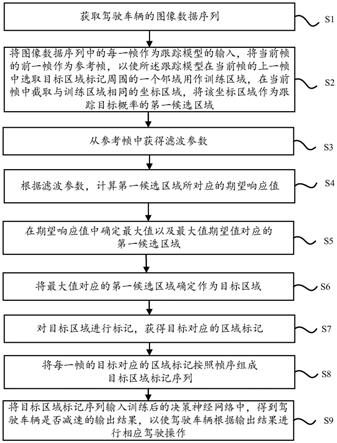

图1为本发明实施例提供的一种基于视觉目标跟踪的车辆驾驶自主决策方法的流程示意图;

[0067]

图2是构建的跟踪模型的结构示意图;

[0068]

图3a是卷积层卷积的映射图;

[0069]

图3b是卷积层连接方式示意图;

[0070]

图4a是重采样层的采样映射图;

[0071]

图4b是重采样层连接方式示意图;

[0072]

图5是驾驶行为决策网络三维矩阵卷积示意图;

[0073]

图6为本发明实施例提供的一种基于视觉目标跟踪的车辆驾驶自主决策装置的结构示意图。

具体实施方式

[0074]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整的描述。显然,所描述的实施例仅仅是本发明的一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有付出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0075]

需要说明的是,本发明实施例及附图中的术语“包括”和“具有”以及它们的任何变形,意图在于覆盖不排他的包含。例如包含的一系列步骤或单元的过程、方法、系统、产品或设备没有限定于已列出的步骤或单元,而是可选地还包括没有列出的步骤或单元,或可选地还包括对于这些过程、方法、产品或设备固有的其他步骤或单元。

[0076]

图1为本发明实施例提供的一种基于视觉目标跟踪的车辆驾驶自主决策方法的流程示意图。该方法应用于自动驾驶车辆。该方法具体包括以下步骤。

[0077]

s1,获取驾驶车辆的图像数据序列;

[0078]

其中,可以从摄像头、行车记录仪或者具备拍摄功能的图像采集装置上获取图像数据序列,该图像序列可以是实时拍摄的,也可以从与拍摄设备相连的后台数据库中获取。

[0079]

其中,图像采集装置可以跟随车辆,安装在车辆上的图像采集装置c采集图像原始数据,从随车辆安装的全球定位装置g采集定位原始数据。原始数据是随时间变化的采样序列,分别形成图像数据序列{i

k

}和定位数据序列{g

k

},两组序列的采样间隔相同,长度相同,

k为从0开始编号的整数。

[0080]

s2,将图像数据序列中的每一帧作为跟踪模型的输入,将当前帧的前一帧作为参考帧,以使跟踪模型在当前帧的上一帧中选取目标区域标记周围的一个邻域用作训练区域,在当前帧中截取与训练区域相同的坐标区域,将该坐标区域作为跟踪目标概率的第一候选区域;

[0081]

其中,获得图像数据序列{i

k

}输入跟踪模型,跟踪模型输出视觉目标在图像序列每一帧中对应的区域标记{t

k

},区域标记t

k

是一个矩形,作为第一候选区域,矩形包含顶点坐标和长宽参数,是一个四维向量。第一候选区域尺寸大于目标区域的尺寸。

[0082]

由于在上一帧i0中(以下称为参照帧),选取目标区域标记t0周围的一个邻域w

s

×

h

s

,用作采样训练区域s,且该区域比目标区域w

n

×

h

n

略大,目的是防止目标在下一帧中发生尺度变大而无法检测到。设β>0,则有:

[0083]

w

s

=(1 β)w

n

[0084]

h

s

=(1 β)h

n

[0085]

其中,w

s

表示第一候选区域的长,h

s

表示第一候选区域的宽,w

n

表示目标区域的长,h

n

表示目标区域的宽,β为大于0的数值。

[0086]

s3,从参考帧中获得滤波参数;

[0087]

将目标跟踪识别问题转化为相关性度量问题。相关性是用来表征两个信号之间的相似度水平,若两个信号来自相同的源则称为自相关,若两个信号来自不同的源则称为互相关。相关滤波是对两个信号进行时域卷积,用卷积值衡量两个信号相关性,卷积值越大则相关性越高。因此可以使用相关性表示图像数据序列之间的关系。

[0088]

s4,根据滤波参数,计算第一候选区域所对应的期望响应值;

[0089]

s5,在期望响应值中确定最大值以及最大值期望值对应的第一候选区域;

[0090]

s6,将最大值对应的第一候选区域确定作为目标区域;

[0091]

在当前帧i1中,截取与参考帧中训练区域s相同的坐标区域,用作跟踪目标出现概率的第一候选区域。假定该区域为z,对应频域表达为基于参考帧中获得的相关滤波器参数w,可以得到与下一帧的候选区域z所对应的期望响应值y:

[0092][0093]

其中,表示参考帧中的目标候选区域,f

‑1表示傅里叶逆变换,y表示时域下的响应图矩阵。通过搜索响应值中y的最大值和其对应的坐标,可以计算在i1中目标的位置t1。

[0094]

s7,对目标区域进行标记,获得目标对应的区域标记;

[0095]

s8,将每一帧的目标对应的区域标记按照帧序组成目标区域标记序列;

[0096]

其中,帧序可以根据时间前后关系分辨出,时间在前的帧排着前,时间在后的排序在后。

[0097]

s9,将目标区域标记序列输入训练后的决策神经网络中,得到驾驶车辆是否减速的输出结果,以使驾驶车辆根据输出结果进行相应驾驶操作。

[0098]

本发明提供的一种基于视觉目标跟踪的车辆驾驶自主决策方法,通过获取驾驶车辆的图像数据序列作为跟踪模型的输入,采用优化网络结构和激励函数,构建神经网络模型然后进行训练得到跟踪模型,对目标进行跟踪检测,提升检测效率;从参考帧中获得滤波

参数;根据滤波参数,计算第一候选区域所对应的期望响应值;在期望响应值中确定最大值以及最大值期望值对应的第一候选区域;将最大值对应的第一候选区域确定作为目标区域,以此对目标进行持续跟踪可以提高目标检测的准确性;优化决策神经网络结构和激励函数构建决策神经网络,然后以目标区域标记序列为输入对车辆是否减速做出决策,因此可以提升决策稳定性。

[0099]

作为本发明一种可选的实施方式,在将图像数据序列作为跟踪模型的输入,获得目标在图像序列每一帧中对应的区域标记的步骤之前,车辆驾驶自主决策方法还包括:

[0100]

步骤a:获取训练数据集;

[0101]

其中,训练数据包括多个样本,样本包括包含汽车目标标记为1的正样本,以及不包含汽车目标记为0的负样本;

[0102]

步骤b:根据预设层数,构建神经网络模型;

[0103]

本发明构建的神经网络模型由输入层、输出层和隐藏层组成,每一层包含若干个节点,称为神经元,神经元、神经元之间的连接组成了神经网络,该网络由激励函数、权重和神经元之间的连接方式所确定,参见图2。

[0104]

步骤c:使用训练数据集训练构建的神经网络模型;

[0105]

图2中,最左侧三个节点x1,x2,1为输入层节点,右侧节点y为输出层节点,h1,h2,h3为隐藏层节点,σ表示激励函数,作用是使神经网络具备非线性分类能力。神经网络的输出与输入之间的关系由下面式子定义:

[0106]

a1=w1‑

11

x1 w1‑

21

x2 b1‑1[0107]

a2=w1‑

12

x1 w1‑

22

x2 b1‑2[0108]

a3=w1‑

13

x1 w1‑

23

x2 b1‑3[0109]

y=σ(w2‑1σ(a1) w2‑2σ(a2) w2‑3σ(a3))

[0110]

图2所示的是一种全连接的神经网络,即隐藏层的每一个节点都与前一层的任一个节点有连接(不考虑激励函数)。本发明在实际应用中,隐藏层可以有多个,每一层的节点数与前一层的连接关系在实现允许的前提下可以自由定义。

[0111]

神经网络的训练过程是在网络连接模型确定的前提下,根据训练数据,即输入层x的值与对应的输出层y的值,求解网络中各节点权值w的过程,其目标是找出一组权值w,使网络对输入x的输出估计值与y的误差最小。

[0112]

本发明的跟踪模型可根据应用自定义层数、节点关系。跟踪模型定义为一个7层隐藏层的网络,其中:

[0113]

参考图3a以及图3b,第一个隐藏层是一个二维卷积层c1,卷积窗口为3x3,即卷积层c1的每一个节点仅与其上一层(即输入图像)对应位置的3x3个节点有连接;将这3x3个连接的权重按行

‑

列的顺序分别定义为w1‑1,w1‑2,

…

,w1‑9,并且每个卷积层c1上的节点在对应位置的权重均相同。

[0114]

第二个隐藏层是一个二维卷积层c2,卷积窗口为5x5,即卷积层c2的每一个节点仅与其上一层(即c1)对应位置的5x5个节点有连接,连接方式与c1层相同,只是数量不同;每个卷积层c2上的节点在对应位置的权重均相同。

[0115]

第三个隐藏层是一个二维卷积层c3,卷积窗口为5x5,与卷积层c2一致。

[0116]

参考图4a以及图4b,第四个隐藏层是重采样层c4,如果卷积层c3尺寸是d

×

d,则重

采样层c4尺寸为重采样层c4的每个节点与其对应的16个节点连接,并且权重固定为对于在重采样层c4的某个节点,假设其坐标在重采样层c4是(i,j),则其在卷积层c3的对应节点是坐标在卷积层c3为(4i,4j)和(4i 3,4j 3)矩形范围内的所有16个节点。

[0117]

第五个隐藏层是一个二维卷积层c5,卷积窗口为3x3,与卷积层c1相同。

[0118]

第六个隐藏层是一个全连接层c6,节点数等于卷积层c5输出的特征的维度。

[0119]

第七个隐藏层是一个全连接层c7,节点数与c6相同,等于卷积层c5输出的特征的维度。

[0120]

第七层c7后连接输出层,输出层是一个标量。输出为0,表示图像不含有目标;输出为1,表示图像中含有目标。

[0121]

神经网络的激励函数定义为:

[0122]

σ(x)=max(αarctanx,x),x∈r,α>0

[0123]

α是一个正数,用于控制激励函数在负数区间的斜率取值在0.005

‑

0.01之间。

[0124]

步骤d:将训练完成的神经网路模型确定为跟踪模型。

[0125]

作为本发明一种可选的实施方式,跟踪模型在当前帧的上一帧中选取目标区域标记周围的一个邻域用作训练区域包括:

[0126]

步骤a:设置初始坐标;

[0127]

步骤b:在参考帧中从初始坐标开始按照预设的移动步长选择子图区域,跟踪模型,获得每个子图区域对应的输出值;

[0128]

步骤c:当子图区域对应的输出值大于第一阈值时,则将该子图区域加入候选区域集合;

[0129]

步骤d:在候选区域集合中选择输出值最大的第二候选区域用作训练区域。

[0130]

可以理解,视觉目标跟踪过程需要从初始的第一帧t0开始持续获得目标的区域标记,由于初始帧没有先验信息,需要设置初始坐标,以从参考帧中选择初始坐标开始移动,选择子图区域。

[0131]

将初始帧t0输入跟踪模型n

d

,找到初始帧中的跟踪目标。设图像数据序列{i

k

}的尺寸为w

i

×

h

i

,神经网络n

d

输入图像的尺寸为,w

n

×

h

n

,且w

n

<<w

i

,h

n

<<h

i

。设初始坐标为(0,0),在初始帧中选择一幅子图[(0,0),(w

n

,h

n

)],输入神经网络n

d

,获得一个输出值,如果输出值y>0.5,则将该区域加入候选队列q。按照步长s移动子图区域至[(s,0),(w

n

,h

n

)],[(2s,0),(w

n

,h

n

)],

……

,[(0,s),(w

n

,h

n

)],[(s,s),(w

n

,h

n

)],[(2s,s),(w

n

,h

n

)],

……

,并在每一步用神经网络模型n

d

检测子图区域输出,并将符合y>0.5条件的子图区域加入候选队列q。遍历完成初始帧,如果队列q不为空,在队列q中选取y值最大的一个区域,作为目标区域标记,输出为t0;否则,输出检测不到目标。根据初始帧检测到的目标区域标记t0,完成后续帧跟踪。从初始帧i0开始,根据上一帧目标区域t0求解下一帧目标的区域标记t1,得到图像序列的训练区域。

[0132]

其中,训练后的决策神经网络包括一个输入层、六个隐含层以及一个输出层,决策神经网络的激励函数为分段函数。

[0133]

参考图5,图5为决策神经网络的三维矩阵卷积示意图。决策神经网络输入为一个k

×

k维向量,其组成是目标区域标记序列{t

k

}的最近k个元素的循环移位,如下式:

[0134][0135]

每个元素是一个四维向量(对应于目标区域的矩形框),因此输入维度是k

×

k

×

4。所定义的结构作为驾驶行为决策神经网络的输入。

[0136]

驾驶行为的决策神经网络的组成包括6个隐藏层,分别是:

[0137]

第一个隐藏层是一个二维卷积层d1,卷积窗口为3x3x4,前两个维度与步骤2.1

‑

2中类似,每3x3个输入节点与一个输出(隐藏层)节点有连接,对应于9条连接权重w1

‑

1、w1

‑

9;在最后一个维度上,四层分别对应四组3x3连接,即w2

‑

1、

…

、w2

‑

9,w3

‑

1、

…

、w3

‑

9,w4

‑

1、

…

、w4

‑

9。因此,卷积层d1的参数量为3x3x4=36个。

[0138]

第二个隐藏层是一个二维卷积层d2,卷积窗口为3x3x4,即与d1层相同,连接方式也与d1层相同。

[0139]

第三个隐藏层是重采样层d3,在第三维上分别对四层中的每一层进行重采样。对于维度是d

×

d

×

4的数据,则重采样层d3尺寸为权重固定为

[0140]

第四个隐藏层是一个二维卷积层d4,卷积窗口为5x5x4,结构与连接方式与d1层类似,只是单层卷积窗口为5x5。

[0141]

第五个隐藏层是一个全连接层d5,节点数等于卷积层d4输出的特征的维度。

[0142]

第六个隐藏层是一个全连接层d6,节点数与d5相同。

[0143]

第六层后连接输出层,输出层是一个标量。输出为0,表示决策为车辆不应减速;输出为1,表示车辆应当减速。

[0144]

分段函数为:其中,x表示输入,θ表示激励因子。

[0145]

作为本发明一种可选的实施方式,从参考帧中获得滤波参数包括:

[0146]

步骤a:根据参考帧中的位移图像样本将预设的滤波器中的滤波参数进行线性表达;

[0147]

步骤b:根据线性表达对预设的滤波器求导,获得滤波参数;

[0148]

预设的滤波器为min

w

∑

i,j

||s

i,j

·

w

‑

y0(i,j)||2 λ‖w‖2;滤波参数的线性表达为:w=∑

i,j

a

i,j

s

i,j

,预设的滤波器求导结果为:

[0149]

其中,w为滤波参数,λ为正则系数取值范围为[0,

├

∞)

┤

,y0(i,j)为期望响应值,s

i,j

为循环位移,i表示在水平方向循环移位的距离,j在竖直方向循环移位的距离,表示y0(i,j)的离散傅里叶变换,表示w的离散傅里叶变换,和为复共轭关系,

⊙

为哈达玛乘积,表示第一候选区域。

[0150]

其中,另定义图像样本s的循环移位s

i,j

,i,j分别表示在水平和竖直方向循环移位的距离,并定义s的循环移位s

i,j

所对应的高斯权重系数y0(i,j),将参考帧的候选区域在当前帧中按照循环位移进行移位,使用期望值计算公式,确定每个候选区域的循环位移对应的高斯权重系数;

[0151]

期望值计算公式为:

[0152][0153]

w

s

表示第一候选区域的长,h

s

表示第一候选区域的宽,σ表示高斯函数的标准方差,控制高斯函数的宽度。y0(i,j)表示循环移位s

i,j

所对应的高斯权重系数。

[0154]

可见,图像样本没有移位时,有最大的期望响应值;随着图像样本移位距离中心越来越远,期望响应值逐渐降低。

[0155]

定义相关滤波器为:

[0156][0157]

其中,w为相关滤波器参数,λ为正则系数取值范围为[0, ∞)。

[0158]

根据参照帧中的移位图像样本求解式滤波器参数是一个凸函数,因此在频域下存在解析解。将参数w分解为移位样本的线性表达:

[0159][0160]

求导可解得:

[0161][0162]

其中和为y0(i,j)和a的离散傅里叶变换。和为复共轭关系。

⊙

为哈达玛乘积。

[0163]

作为本发明一种可选的实施方式,滤波参数,计算第一候选区域所对应的期望响应值包括:

[0164]

步骤a:设置参考帧的循环位移;

[0165]

步骤b:将参考帧的候选区域在当前帧中按照循环位移进行移位,确定每个候选区域的循环位移对应的高斯权重系数;

[0166]

步骤c:将高斯权重系数确定为候选区域的期望响应值。

[0167]

如图6所示,本发明提供的一种基于视觉目标跟踪的车辆驾驶自主决策装置包括:

[0168]

获取模块61,用于获取驾驶车辆的图像数据序列;

[0169]

跟踪模块62,用于将图像数据序列中的每一帧作为跟踪模型的输入,将当前帧的前一帧作为参考帧,以使跟踪模型在当前帧的上一帧中选取目标区域标记周围的一个邻域用作训练区域,在当前帧中截取与训练区域相同的坐标区域,将该坐标区域作为跟踪目标概率的第一候选区域;

[0170]

参数确定模块63,用于从参考帧中获得滤波参数;

[0171]

计算模块64,用于根据滤波参数,计算第一候选区域所对应的期望响应值;

[0172]

区域确定模块65,用于在期望响应值中确定最大值以及最大值期望值对应的第一候选区域;

[0173]

目标确定模块66,用于将最大值对应的第一候选区域确定作为目标区域;

[0174]

区域标记模块67,用于对目标区域进行标记,获得目标对应的区域标记;

[0175]

组成模块68,用于将每一帧的目标对应的区域标记按照帧序组成目标区域标记序列;

[0176]

决策模块69,用于将目标区域标记序列输入训练后的决策神经网络中,得到驾驶车辆是否减速的输出结果,以使驾驶车辆根据输出结果进行相应驾驶操作。

[0177]

作为本发明一种可选的实施方式,跟踪模块,具体用于:

[0178]

设置初始坐标;

[0179]

在参考帧中从初始坐标开始按照预设的移动步长选择子图区域,跟踪模型,获得每个子图区域对应的输出值;

[0180]

当子图区域对应的输出值大于第一阈值时,则将该子图区域加入候选区域集合;

[0181]

在候选区域集合中选择输出值最大的第二候选区域用作训练区域。

[0182]

上述装置实施例与方法实施例相对应,与该方法实施例具有同样的技术效果,具体说明参见方法实施例。装置实施例是基于方法实施例得到的,具体的说明可以参见方法实施例部分,此处不再赘述。

[0183]

本领域普通技术人员可以理解:附图只是一个实施例的示意图,附图中的模块或流程并不一定是实施本发明所必须的。

[0184]

本领域普通技术人员可以理解:实施例中的装置中的模块可以按照实施例描述分布于实施例的装置中,也可以进行相应变化位于不同于本实施例的一个或多个装置中。上述实施例的模块可以合并为一个模块,也可以进一步拆分成多个子模块。

[0185]

最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明实施例技术方案的精神和范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。