基于ftl损失函数和注意力的u

‑

net图像分割方法

技术领域

1.本发明提供一种基于ftl损失函数和注意力的u

‑

net图像分割 方法。

背景技术:

2.在医学图像分析领域,通过对全局图像的小部分病灶区域进行 检测和分割是一项普遍的任务。由于图像病灶区域的不平衡性,使 得建立生成和辨别框架具有不稳定性。近年来,卷积神经网络( cnns)已经成功地应用到2d和3d医学图像的自动分割中。大多数 现有的深度学习方法都源于全卷积神经网络结构(fcn),使用全卷 积层替代之前的全连接层。u

‑

net作为fcn的变形,因其独特的跳 跃连接和编码

‑

解码结构,成为医学图像分割的主要网络框架。

3.解决类别不平衡问题是医学图像分割领域一个主要的研究方向 。focal loss损失函数结合调节指数,重构了交叉熵损失函数,从 而对良好分类的样本进行了降权运算。focal loss通过阻止大量的 容易分割的负样本主导梯度从而改善了类别不平衡问题。然而,在 实际问题中,由于医学图像的病灶区域不明显这一普遍现象,这种 方法在平衡准确率和召回率上具有很大的困难。调查研究显示例如 注意力机制的方法可以使辨别模型更专注于小的感兴趣的分割区域 。

技术实现要素:

4.在医学图像处理领域,为了解决数据不平衡以及模型性能的问 题,本发明对u

‑

net模型进行了重新设计,在其基础上结合focaltversky loss和attention注意力机制,提出了一种基于ftl损失 函数和注意力的u

‑

net图像分割方法,改进了准确率和召回率的不 平衡问题,并且对于多尺度输入的图像有更好的输出特征表示。

5.为实现上述目的,本发明提供了如下方案:

6.基于ftl损失函数和注意力的u

‑

net图像分割方法,所述方法 包括以下步骤:

7.步骤1、图像预处理:

[0008]1‑

1、采用公共数据集isic 2018皮肤病灶数据集。对图像集进 行数据增强操作处理,方法包括对图像进行旋转、平移、重构尺寸 、正则化、随机亮度对比以及高斯模糊等。通过这一手段,增大了 数据量,防止了过拟合,使模型达到更好的训练效果。

[0009]1‑

2、将数据集划分为训练集、验证集和测试集,所占比例分别 为80%,10%和10%;

[0010]

步骤2、构建损失函数:focal tversky loss(ftl)损失函数 用来评价分割结果,是在dice系数的基础上进行构建的:

[0011][0012]

如公式(1)所述,其中g

ic

∈{0,1}和p

ic

∈[0,1]分别表示真实 标签和预测标签,c表示预测类别,n表示一张图像中像素的总量,∈ 是数值常量来防止分母除零。dsc系数在

医学图像分割领域中是被 广泛使用的交叉指数评估指标;

[0013][0014]

如公式(2)所述,dice loss表示预测值与真实值重叠的最 小值。

[0015]

dice loss的缺点是它对假正例(fp)和假负例(fn)赋予同 样的权重,其中fp表示预测为真,实际为假的样本,fn表示预测 为假,实际为真的样本。这在实际情况中将导致分割特征结果输出 高准确率但是低召回率的结果。

[0016]

准确率:

[0017][0018]

召回率:

[0019][0020]

如公式(3)、(4)所述,tp表示预测为真正例,即正确预 测为病灶的区域,fn表示假负例,即错误预测为非病灶区域,fp表 示假正例,即错误预测为病灶区域;

[0021]

对于例如皮肤病灶此类数据集高度不平衡且病灶区域不明显的 图像,fn需要比fp赋予更高的权重,来达到提高召回率的目的;

[0022][0023]

如公式(5)所述,tversky相似指数(ti)是dice系数的泛 化,提供了平衡fp和fn的灵活性。其中p

ic

表示像素i预测为病灶类 别c的概率,表示像素i预测为非病灶类别的概率。依此类推,g

ic

和表示真实标签。超参数α和β可以在大量类别不平衡的情况下, 通过微调改变权重来改进召回率。当α和β都等于0.5时,tvesky指 数便简化为dice指数;

[0024][0025]

如公式6所述,表示tvesky损失(tl);

[0026]

在深度学习中,常见的问题是不明显的病灶区域对损失函数没 有贡献。

[0027][0028]

如公式(7)所述,为本发明提出的focal tversky loss(ftl )。其中γ在[1,3]范围内取值。在实际应用中,如果一个高tversky 指数的像素被错误分类,那么ftl将不受影响。相反,如果 tversky指数低并且像素被错分,那么ftl损失函数将明显下降。 当γ>1时,损失函数更专注于被错误分类的不正确预测。针对不 同的数据集和模型,γ需要根据试验进行调整,否则将出现损失函数 的过度抑制。

[0029]

步骤3、构建注意力机制:在模型的上采样过程中加入 attention注意力模块,使得模型在输出高水平特征图时不会丢失 空间细节信息。

[0030][0031]

如公式(8)所述,表示线性注意力系数,通过逐元素相 加和1

×

1线性变换运

算,并由w

x

,w

g

和b

g

参数化。表示在第l 层的像素i,它是从较粗躁的尺度而不是输入序列信号上获取的。g 表示注意力门信号,用来决定每个像素i需要关注的区域。σ1为relu 激活函数;

[0032][0033]

如公式(9)所述,表示注意力系数,σ2表示sigmoid激活 函数,通过改变低级序列信号的大小,最终只获取激活的特征图 。这些经过裁剪的特征和解码阶段的每一尺度的上采样输出图像进 行连结。接下来,在每一个解码模块进行1

×1×

1的卷积和 sigmoid激活操作。

[0034]

步骤4、训练网络模型:将划分好的数据集输入到搭建好的网 络模型中,通过训练集和验证集完成训练后,将测试集输入到网络 模型中,得到分割结果。

[0035]

本发明提出的基于ftl损失函数和注意力的u

‑

net图像分割方 法的主要创新在:

[0036]

a.引入focal tversky loss(ftl)损失函数:对于数据不平 衡且病灶区域不明显的图像,会导致输出准确率和召回率的不平衡 。本发明提出的ftl损失函数通过在dice loss的基础上加入了超 参数α和β,并加入指数参数γ,通过控制容易区分的背景和不容易 区分的病灶分割区域,权衡了准确率和召回率之间的关系,是模型 在病灶不明显的数据集上有更好的输出结果;

[0037]

b.引入attention注意力机制:在编码阶段的深层阶段,网络 模型拥有最丰富的特征表达。然而,由于串联的网络和非线性结构 ,是的在高级输出特征时往往会丢失空间细节信息。将attention 注意力机制引入到解码阶段,减小了对不明显目标的错误检测概率 ,使得模型更专注于前景信息,拥有更好的鉴别低级特征图空间信 息的能力;

附图说明

[0038]

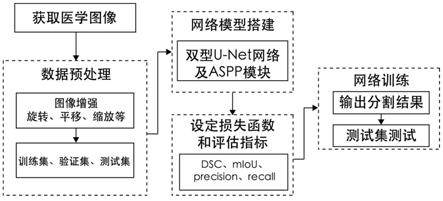

图1为本发明方案的流程示意图;

[0039]

图2为本发明方案的网络结构示意图;

[0040]

图3为本发明方案的attention注意力机制结构示意图。

具体实施方式

[0041]

如图1所示,一种基于ftl损失函数和注意力的u

‑

net的图像 分割方法,具体实现如下:

[0042]

步骤1、图像预处理:

[0043]1‑

1、采用公共数据集isic 2018皮肤病灶数据集。对图像集进 行数据增强操作处理,方法包括对图像进行旋转、平移、重构尺寸 、正则化、随机亮度对比以及高斯模糊等。通过这一手段,增大了 数据量,防止了果泥和,使模型达到更好的训练效果。

[0044]1‑

2、将数据集划分为训练集、验证集和测试集,所占比例分别 为80%,10%和10%;

[0045]

步骤2、构建损失函数:

[0046]

用focal tversky loss(ftl)损失函数用来评价分割结果, 该损失函数在dice系

数的基础上进行构建的,具体实现如下:

[0047][0048]

如公式(1)所述,其中g

ic

∈{0,1}和p

ic

∈[0,1]分别表示真实标 签和预测标签,c表示预测类别,n表示一张图像中像素的总量,∈是 数值常量来防止分母除零。dsc在医学图像分割领域中是被广泛使 用的交叉指数评估指标;

[0049][0050]

如公式(2)所述,dice loss表示预测值与真实值重叠的最小 值。

[0051]

dice loss的缺点是它对假正例(fp)和假负例(fn)赋予同 样的权重,其中fp表示预测为真,实际为假的样本,fn表示预测 为假,实际为真的样本。这在实际情况中将导致分割特征结果输出 高准确率但是低召回率。

[0052]

准确率:

[0053][0054]

召回率:

[0055][0056]

如公式(3)、(4)所述,tp表示预测为真正例,即正确预测 为病灶的区域,fn表示假负例,即错误预测为非病灶区域,fp表示 假正例,即错误预测为病灶区域;

[0057]

对于例如皮肤病灶此类数据集高度不平衡且病灶区域不明显的 图像,fn需要比fp赋予更高的权重,来达到提高召回率的目的;

[0058][0059]

如公式(5)所述,tversky相似指数(ti)是dice系数的泛 化,提供了平衡fp和fn的灵活性。其中p

ic

表示像素i预测为病灶类 别c的概率,表示像素i预测为非病灶类别的概率。依此类推,g

ic

和表示真实标签。超参数α和β可以在大量类别不平衡的情况下, 通过微调改变权重来改进召回率。当α和β都等于0.5时,tvesky指 数便简化为dice指数;

[0060][0061]

如公式6所述,表示tvesky损失(tl);

[0062]

在深度学习中,常见的问题是不明显的病灶区域对损失函数没 有贡献。

[0063][0064]

如公式(7)所述,为本发明提出的focal tvesky loss(ftl )。其中γ在[1,3]范围内取值。在实际应用中,如果一个高tversky 指数的像素被错误分类,那么ftl将不受影响。相反,如果 tversky指数低并且像素被错分,那么ftl损失函数将明显下降。 当γ>1时,损失函数更专注于被错误分类的不正确预测。针对不 同的数据集和模型,γ需要根据试验进行调整,否则将出现损失函数 的过度抑制。

[0065]

步骤3、构建注意力机制:

[0066]

在模型的上采样过程中加入attention注意力模块,使得模型 在输出高水平特征图时不会丢失空间细节信息。

[0067][0068]

如公式(8)所述,表示线性注意力系数,通过逐元素相加 和1

×

1线性变换运算,并由w

x

、w

g

和b

g

参数化。表示在第l层 的像素i,它是从较粗躁的尺度而不是输入序列信号上获取的。g表 示注意力门信号,用来决定每个像素i需要关注的区域。σ1为relu 激活函数;

[0069][0070]

如公式(9)所述,表示注意力系数,σ2表示sigmoid激活函 数,通过改变的大小,最终只获取激活的特征图。这些经过裁剪 的特征和解码阶段的每一尺度的上采样输出图像进行连结。接下来 ,在每一个解码模块进行1

×1×

1的卷积和sigmoid激活操作。

[0071]

步骤4、训练网络模型:将划分好的数据集输入到搭建好的网 络模型中,通过训练集和验证集完成训练后,将测试集输入到网络 模型中,得到分割结果。

[0072]

如图2所示,本发明所提供方案的网络模型结构示意图:

[0073]

其中,输入多尺度的图像有利于增加网络的泛化能力,也进一 步证明了模型的可行性;

[0074]

模型基于u

‑

net结构,在上采样(解码)阶段加入attention 注意力机制,并在每一个上采样模块加入ftl损失函数监督,除了 最后一个模块,来防止过度抑制;

[0075]

多尺度的跳跃连接,将上采样阶段的空间语义信息映射到对应 的下采样阶段,是模型输出更高分辨率的特征图,并提升模型的输 出效果。

[0076]

如图3所示,本发明方案所提供的attention注意力模块示意 图:

[0077]

其中,g表示注意力信号,x

i

表示输入特征序列信号,2up表示 两次上采样操作,意思是在每个注意力操作后再进行两次上采样操 作。g和经过两次上采样的x

i

进行相加操作之后,再经过1

×1×

1 卷积、relu激活、1

×1×

1卷积、sigmoid激活和两次上采样操作 。最终和输入序列作相乘操作得到最终的输出特征图。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。