1.本发明涉及业务流程监控领域,尤其涉及一种数据驱动下基于人工智能的活动时序在线预测方法。

背景技术:

2.业务流程是为达到特定的价值目标而由不同的人分别完成的一系列活动。业务流程挖掘作为数据挖掘在业务流程管理上的应用,旨在通过分析业务流程的事件日志,实现对业务流程的发现、建模、监控和改进。近年来,业务流程挖掘的重点不再局限于提供事件日志的脱机分析,而转向为业务流程优化提供在线支持,即实现预测性业务流程监控(predictive process monitoring,ppm)。

3.准确预测正在执行的流程实例的剩余活动时序是ppm研究中最直观的一种问题,有利于及时发现流程执行中的违规行为。lakshmanan等人在2013年提出一种特定于实例的概率过程模型,通过学习每个节点的决策树来计算模型中各个边的单步转移概率并将模型映射为空间马尔科夫链,实现对未来执行任务的预测,该方法思路新颖,但其预测仅基于当前状态而与前面状态无关,并不符合业务流程的实际。lee等人提出了一种将推荐系统的矩阵分解技术与bpm结合的预测模型,以学习潜在特征之间的交互作用,用于正在执行实例的下一事件预测,但该模型整体复杂,泛用性不高。随着神经网络技术的发展,evermann等人结合词嵌入模型,首次提出用递归神经网络实现对正在执行的流程实例未来活动的预测,该模型同时考虑了当前状态和前面状态,但未开展与其他深度学习技术的对比。类似地,tax等人将神经网络中的lstm方法应用于业务流程中预测监控问题中,通过构建双层lstm模型来分别预测执行的下一活动和时间相关属性,最终通过循环迭代来实现对实例未来执行序列及最终所需时间的预测,该方法的主要问题在于如果事件日志中记录了大量循环结构,则在迭代预测时很有可能陷入事件循环。mehdiyev等人提出了一种多阶段的深度学习方法,在第一阶段采用特征散列和堆叠自动编码器对原始输入数据进行编码,之后将编码结果输入深度前馈神经网络进行预测。此外,为丰富预测的活动信息,pravilovic等人提出了一种预测未来活动及其属性的方法,如执行该活动的资源等。

4.综上,目前活动时序在线预测研究不多,现有的大多数研究基于迭代进行下一活动预测进而实现序列预测,而中间预测偏差会导致整条序列与真实序列不相符。因此研究一种高相似度且符合业务流程实际执行情况的活动时序在线预测方法意义重大。

技术实现要素:

5.为了克服上述现有技术的不足,本发明提供一种数据驱动下基于人工智能的活动时序在线预测方法,可有效解决上述问题。本发明具体采用的技术方案如下:

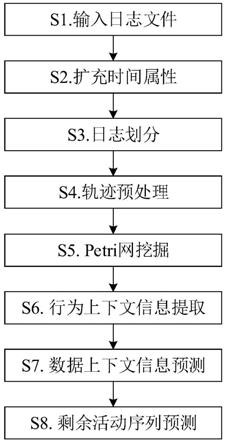

6.一种数据驱动下基于人工智能的活动时序在线预测方法,其包括以下步骤:

7.s1.输入原始日志文件其中由条流程轨迹σ=<e1,e2,e3,

…

,e

|σ|

>组成,每条流程轨迹σ由|σ|个事件e=(caseid,activity,resource,

starttime,completetime,attr1,attr2,

…

attr

n

)组成,其中caseid代表事件所属的实例,activity代表事件执行的活动,resource代表事件执行所需的资源,starttime和completetime分别代表该事件的开始时间和结束时间,attr1,attr2,

…

attr

n

代表该事件的其余n个属性,日志的活动集合被记为a;

8.s2.扩充日志中事件的时间属性;

9.s3.根据completetime对中的流程轨迹排序后得到训练数据;

10.s4.将训练数据中的流程轨迹拆分为前缀轨迹和对应的后缀轨迹,前缀轨迹pt=<e1,e2,

…

,e

k

>为轨迹σ的前k个事件,而其对应的后缀轨迹st为轨迹σ的后|σ|

‑

k个事件;

11.s5.使用过程挖掘算法从训练数据中挖掘petri网pn;

12.s6.使用重演技术将训练数据中的每个前缀轨迹pt在s5挖掘得到的petri网上进行重演,并获取其行为上下文信息behavcontext(pt);

13.s7.使用lstm模型挖掘已执行信息与未来执行信息之间的关系,进而预测训练数据中每个前缀轨迹pt的数据上下文信息datacontext(pt),具体包括以下子步骤:

14.s71.将训练数据中的前缀轨迹与其后缀轨迹进行特征编码,得到前缀编码矩阵与后缀编码矩阵;

15.s72.将前缀编码矩阵与后缀编码矩阵统一扩充至维度l*m,即对前缀编码矩阵采用后向零填充法,对后缀编码矩阵采用前向零填充法,其中l表示日志中最长轨迹的事件数,m表示编码之后的属性维度,将扩充后的前缀编码矩阵记为em(pt),将扩充后的后缀编码矩阵记为em(st);

16.s73.使用降维技术对后缀编码矩阵进行降维处理,经过降维之后后缀轨迹st的编码矩阵被记为em

′

(st);

17.s74.将训练数据中的前缀编码矩阵em(pt)与经过降维之后的后缀编码矩阵em

′

(st)分别作为lstm模型的输入与输出进行参数学习,训练得到预测模型

18.s75.将待预测轨迹进行编码之后输入s74训练得到的模型输出后缀编码矩阵作为其数据上下文pt为待预测轨迹;

19.s8.将训练数据中的轨迹视为历史轨迹,通过双重计算相似度实现对待预测轨迹的剩余活动时序预测,具体包含以下子步骤:

20.s81.利用s6中的重演技术获取待预测轨迹pt

′

的行为上下文behavcontext(pt

′

),计算其与训练数据中所有前缀轨迹的行为相似度tbs(σ1,σ2),然后从中选取tbs(σ1,σ2)最大的候选前缀轨迹集合s

pt

′

,其计算公式如下所示:

[0021][0022][0023]

其中,eq

ij

表示两条轨迹σ1,σ2在执行第i个活动之后在第j个库所的托肯数量的等价性,behavcontext(σ1)

ij

表示σ1在执行第i个活动之后在第j个库所的托肯数量,behavcontext(σ1)

ij

表示σ2在执行第i个活动之后在第j个库所的托肯数量,|σ1|和|σ2|分别

代表轨迹σ1和σ2的事件数,|p|代表petri网中库所的数量;

[0024]

s82.根据步骤s7为待预测轨迹的前缀轨迹pt得到其数据上下文datacontext(pt

′

),计算其与步骤s81中得到的候选前缀轨迹集合s

pt,

中所有前缀轨迹的欧式距离,从中筛选出欧式距离最小的前缀轨迹记为pt

sim

,其计算公式如下:

[0025]

pt

sim

=argmin ed(pt,pt

i

),pt

i

∈s

pt

[0026]

其中,ed()表示求解两条轨迹间的欧式距离的函数;

[0027]

s83.将pt

sim

的剩余活动时序赋给待预测序列pt

′

作为其预测的剩余活动时序。

[0028]

作为优选,所述s2中,扩充日志中事件的时间属性时,为事件添加year、month、day、hour、weekday和duration六个属性,分别代表事件发生的年、月、日、小时、工作日以及持续时间信息。

[0029]

作为优选,s2中所述的扩充日志中事件的时间属性时,将当前事件的duration定义为当前事件的completetime与其上一事件的completetime之间的间隔。

[0030]

作为优选,s5中所述使用过程挖掘算法从训练数据中挖掘petri网pn的具体方法为inductive miner算法,其挖掘得到的petri网表达式如下:

[0031]

pn=(p,t,f,a,π,m)

[0032]

其中p={p0,p1,

…

,p

|p|

‑1}为petri网中的库所集合,|p|表示petri网中库所的数量,每个库所持有非负数量的托肯,库所p

i

持有的托肯数目被记为β(p

i

);t={t0,t1,

…

,t

|t|

‑1}为petri网中的变迁集合,|t|表示petri网中变迁的数量;f=(p

×

t)∪(t

×

p)是连接库所和变迁的有向弧集合;a为日志的活动集合;π是一个映射函数,用于将变迁t

i

∈t与a中的活动或者不可观察活动相关联,其中与不可观察活动相关联的变迁为隐藏变迁;m=[β(p0),β(p1),

…

,β(p

|p|

‑1)]是pet ri网中托肯的分布情况,m的初始状态记为m

init

。

[0033]

作为优选,s6具体包含以下步骤:

[0034]

s61.对于前缀轨迹pt,首先将其执行上下文信息behavcontext(pt)初始化为一个空矩阵;然后将petri网的初始托肯分布即m

init

拼接至behavcontext(pt);

[0035]

s62.按序遍历pt的每个事件,根据π映射函数获取对应的变迁t,并判断t是否满足使能条件,即其输入集合

°

t中的每个库所是否持有托肯,如果满足则执行步骤s621,否则,执行步骤s622;

[0036]

s621.触发变迁t,即将变迁t的输入集合中

°

t每个库所的托肯数目减一,其输出集合t

°

中每个库所的托肯数目加一,并更新petri网的托肯分布m,然后执行s63,其更新计算步骤如下:

[0037][0038]

m=[β(p0),β(p1),

…

,β(p

|p|

‑1)]

[0039]

s622.获取

°

t中未持有托肯的库所集合,记为p

tokenmissing

;获取除

°

t中库所之外,当前持有托肯的库所集合,记为p

token

;对于p

tokenmissing

中的每个库所p

i

,判断是否存在库所p

j

∈p

token

与其存在由隐藏变迁组成的最短路径,如果存在则触发该条路径上的隐藏变迁,即p

j

中的托肯数目减一,p

i

中的托肯数目加一,使得p

i

满足托肯要求;如果还存在未满足托肯要求的库所,则将其托肯数目额外加一;最后执行步骤s621;

[0040]

s63.将当前petri网的托肯分布m拼接至behavcontext(pt);

[0041]

作为优选,所述的s71中进行特征编码时,对类别属性采用one

‑

hot编码,对数值属性进行标准归一化处理。

[0042]

作为优选,所述的s73中降维技术采用uniform manifold approximation and projection即umap技术。

[0043]

作为优选,所述的降维处理选择将维度降至1*l。

[0044]

相比于传统的活动时序预测,本发明具有如下收益:1、融合了过程挖掘技术与轨迹重演技术,模拟轨迹在真实环境中的执行,从而提取并表征了其行为上下文信息,为剩余活动时序预测提供了基础;2、使用lstm模型捕获流程实例的历史执行与未来执行之间的关联,其训练结果被用于预测在线流程实例的未来执行,即数据上下文信息,为活动时序预测提供了基础;3、融合挖掘得到的行为上下文信息和数据上下文信息,实现基于人工智能的活动时序在线预测。

附图说明

[0045]

图1为本发明一种数据驱动下基于人工智能的活动时序在线预测方法的步骤图;

具体实施方式

[0046]

为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行详细说明。

[0047]

相反,本发明涵盖任何由权利要求定义的在本发明的精髓和范围上做的替代、修改、等效方法以及方案。进一步,为了使公众对本发明有更好的了解,在下文对本发明的细节描述中,详尽描述了一些特定的细节部分。对本领域技术人员来说没有这些细节部分的描述也可以完全理解本发明。

[0048]

如图1所示,本发明的一种数据驱动下基于人工智能的活动时序在线预测方法,包括以下步骤:

[0049]

s1.输入原始日志文件其中由条流程轨迹σ=<e1,e2,e3,

…

,e

|σ|

>组成,每条流程轨迹σ由|σ|个事件e=(caseid,activity,resource,starttime,completetime,attr1,attr2,

…

attr

n

)组成,其中caseid代表事件所属的实例,activity代表事件执行的活动,resource代表事件执行所需的资源,starttime和gompletetime分别代表该事件的开始时间和结束时间,attr1,attr2,

…

attr

n

代表该事件的其余n个属性,日志的活动集合被记为a;σ

i

表示第i条流程轨,e

j

表示第j个事件。

[0050]

s2.扩充日志中事件的时间属性。

[0051]

在本实施例中,扩充日志中事件的时间属性时,为事件添加year、month、day、hour、weekday和duration六个属性,分别代表事件发生的年、月、日、小时、工作日以及持续时间信息。其中,本实施例将当前事件的duration定义为当前事件的completetime与其上一事件的completetime之间的间隔。

[0052]

s3.根据completetime按照结束时间从早到晚对中的流程轨迹排序后得到训练数据。

[0053]

s4.将训练数据中的流程轨迹拆分为前缀轨迹和对应的后缀轨迹,前缀轨迹pt=<

e1,e2,

…

,e

k

>为轨迹σ的前k个事件,而其对应的后缀轨迹st为轨迹σ的后|σ|

‑

k个事件。

[0054]

s5.使用过程挖掘算法从训练数据中挖掘petri网pn。

[0055]

本实施例中,具体使用的过程挖掘算法为inductive miner算法,其挖掘得到的petri网表达式如下:

[0056]

pn=(p,t,f,a,π,m)

[0057]

其中p={p0,p1,

…

,p

|p|

‑1}为petri网中的库所集合,|p|表示petri网中库所的数量,每个库所持有非负数量的托肯,库所p

i

持有的托肯数目被记为β(p

i

);t={t0,t1,

…

,t

|t|

‑1}为petri网中的变迁集合,|t|表示petri网中变迁的数量;f=(p

×

t)∪(t

×

p)是连接库所和变迁的有向弧集合;a为日志的活动集合;π是一个映射函数,用于将变迁t

i

∈t与a中的活动或者不可观察活动相关联,其中与不可观察活动相关联的变迁为隐藏变迁;m=[β(p0),β(p1),

…

,β(p

|p|

‑1)]是pet ri网中托肯的分布情况,也被称为petri网的标识,m的初始状态记为m

init

。

[0058]

s6.使用重演技术将训练数据中的每个前缀轨迹pt在s5挖掘得到的petri网上进行重演,并获取其行为上下文信息behavcontext(pt);。

[0059]

本实施例中,该s6步骤具体包含以下子步骤s61、s62和s63:

[0060]

s61.对于前缀轨迹pt,首先将其执行上下文信息behavcontext(pt)初始化为一个空矩阵;然后将petri网的初始托肯分布即m

init

拼接至behavcontext(pt);

[0061]

s62.按序遍历pt的每个事件,根据π映射函数获取对应的变迁t,并判断t是否满足使能条件,即其输入集合

°

t中的每个库所是否持有托肯,如果满足则执行步骤s621,否则,执行步骤s622;

[0062]

s621.触发变迁t,即将变迁t的输入集合中

°

t每个库所的托肯数目减一,其输出集合t

°

中每个库所的托肯数目加一,并更新petri网的托肯分布m,然后执行s63,其更新计算步骤如下:

[0063][0064]

m=[β(p0),β(p1),

…

,β(p

|p|

‑1)]

[0065]

s622.获取

°

t中未持有托肯的库所集合,记为p

tokenmissing

;获取除

°

t中库所之外,当前持有托肯的库所集合,记为p

token

;对于p

tokenmissing

中的每个库所p

i

,判断是否存在库所p

j

∈p

token

与其存在由隐藏变迁组成的最短路径,如果存在则触发该条路径上的隐藏变迁,即p

j

中的托肯数目减一,p

i

中的托肯数目加一,使得p

i

满足托肯要求;如果还存在未满足托肯要求的库所,则将其托肯数目额外加一;最后也执行步骤s621(相当于先对所有库所进行处理使其满足托肯要求,再执行s621);

[0066]

s63.将当前petri网的托肯分布m拼接至behavcontext(pt);

[0067]

s7.使用lstm模型挖掘已执行信息与未来执行信息之间的关系,进而预测训练数据中每个前缀轨迹pt的数据上下文信息datacontext(pt),具体包括以下子步骤:

[0068]

s71.将训练数据中的前缀轨迹与其后缀轨迹进行特征编码,得到前缀编码矩阵与后缀编码矩阵。本实施例中,进行特征编码时,对类别属性采用one

‑

hot编码,对数值属性进行标准归一化处理。

[0069]

s72.将前缀编码矩阵与后缀编码矩阵统一扩充至维度l*m,即对前缀编码矩阵采用后向零填充法,对后缀编码矩阵采用前向零填充法,其中l表示日志中最长轨迹的事件数,m表示编码之后的属性维度,将扩充后的前缀编码矩阵记为em(pt),将扩充后的后缀编码矩阵记为em(st)。

[0070]

s73.使用降维技术对后缀编码矩阵进行降维处理,经过降维之后后缀轨迹st的编码矩阵被记为em

′

(st)。本实施例中,降维技术采用uniform manifold approximation and projection即umap技术,降维处理选择将维度降至1*l。

[0071]

s74.将训练数据中的前缀编码矩阵em(pt)与经过降维之后的后缀编码矩阵em

′

(st)分别作为lstm模型的输入与输出进行参数学习,训练得到预测模型

[0072]

s75.将待预测轨迹进行编码之后输入s74训练得到的模型输出后缀编码矩阵作为其数据上下文pt为待预测轨迹;

[0073]

s8.将训练数据中的轨迹视为历史轨迹,通过双重计算相似度实现对待预测轨迹的剩余活动时序预测,具体包含以下子步骤:

[0074]

s81.利用s6中的重演技术获取待预测轨迹pt

′

的行为上下文behavcontext(pt

′

),计算其与训练数据中所有前缀轨迹的行为相似度tbs(σ1,σ2),然后从中选取tbs(σ1,σ2)最大的候选前缀轨迹集合s

pt,

,其计算公式如下所示:

[0075][0076][0077]

其中,eq

ij

表示两条轨迹σ1,σ2在执行第i个活动之后在第j个库所的托肯数量的等价性,behavcontext(σ1)

ij

表示σ1在执行第t个活动之后在第j个库所的托肯数量,behavcontext(σ2)

ij

表示σ2在执行第i个活动之后在第j个库所的托肯数量,|σ1|和|σ2|分别代表轨迹σ1和σ2的事件数,|p|代表petri网中库所的数量;

[0078]

s82.根据步骤s7为待预测轨迹的前缀轨迹pt得到其数据上下文datacontext(pt

′

),计算其与步骤s81中得到的候选前缀轨迹集合s

pt

′

中所有前缀轨迹的欧式距离,从中筛选出欧式距离最小的前缀轨迹记为pt

sim

,其计算公式如下:

[0079]

pt

sim

=argmin ed(pt,pt

i

),pt

i

∈s

pt

[0080]

其中,ed()表示求解两条轨迹间的欧式距离的函数;

[0081]

s83.将pt

sim

的剩余活动时序赋给待预测序列pt

′

作为其预测的剩余活动时序。

[0082]

下面基于上述s1~s8的方法流程,通过实施例进一步展示其技术效果。

[0083]

实施例

[0084]

本实施例步骤与具体实施方式前述步骤相同,在此不再进行赘述。下面就部分实施过程和实施结果进行展示:

[0085]

本实施例所用的原始日志文件是从4tu研究数据中心获得的四个真实业务流程产生的日志:helpdesk,sepsis,bpic2013incidents,bpic2012w,bpic2012o和bpic2012w去重。其中helpdesk日志涉及意大利软件公司的帮助台的票务管理过程,共有4580条实例数

据,包含21349个事件和14个活动,其中最长实例事件数为15个,最短实例事件数为1个。sepsis日志通过医院的erp系统记录了败血症病例的事件,该日志有大约1000条实例,事件数为15000个左右,活动数为16个。bpic2013数据集是来自volvo it belgium的事件日志,包含来自名为vinst的事件和问题管理系统的事件,bpic2013incidents主要由处理事件的实例组成。bpic2012o和bpic2012w日志为bpic2012的子日志,bpic2012日志取自荷兰金融学院,表示的过程是全球融资组织中个人贷款或者透支的申请过程。bpic2012o有5015条实例和31244个事件,活动数为7个。bpic2012w有9658条实例和72413个事件,活动数为6个。bpic2012w去重滤除了bpic2012w中冗余的自循环,即如果同个活动在一条实例中连续发生多次,则保留第一个活动而删除冗余的活动。bpic2012w去重的实例数与bpic2012w相同,事件数为29410。

[0086]

为了验证本发明技术方案的技术效果,本实施例主要选取demerau

‑

levinstain(dl)距离相似度对预测结果进行衡量,dl距离用于衡量两条序列之间转换所需的单字符操作次数(插入、删除、替换和交换),dl距离相似度计算公式如下:

[0087][0088]

其中actseq1和actseq2代表两条活动序列,dl_dist(actseq1,actseq2)表示它们的dl距离,l1和l2分别代表它们的长度。

[0089]

为验证本发明的有效性,我们与其他文献进行了对比,对比情况如表1所示。我们仅使用helpdesk、bpic2012w和bpic2012w去重三个数据集与其他方法进行对比,因为这些数据集的预测结果在其他文献有提供。此外,由于一些文献仅提供了滤除一些前缀轨迹之后的结果,因此,我们依据他们提供的结果进行统计并对比。由表可知,我们达到的平均dl距离相似度在helpdesk全部数据集上相较tax等人、lin等人和taymouri等人分别提高了9.16%、1.74%和2.06%;在bpic2012w数据集上相较evermann等人和taymouri等人分别提高了0.44%和2.74%。然而,tax等人的方法在该数据集上比本方法高出5.97%。但是在该数据集经过去重之后,tax等人达到的结果相较未去重前仅提高4.04%,而我们则提高了16.39%,具有明显改进。此外,我们在bpic2012w去重数据集中达到的平均dl距离相似度相较tax等人以也具有一定优势,提高了6.38%。综上,本发明提出的一种面向活动的预测性业务流程监控方法相较其余方法有一定的优越性。

[0090]

以上所述的实施例只是本发明的一种较佳的方案,然其并非用以限制本发明。有关技术领域的普通技术人员,在不脱离本发明的精神和范围的情况下,还可以做出各种变化和变型。因此凡采取等同替换或等效变换的方式所获得的技术方案,均落在本发明的保护范围内。

[0091]

表1为本发明实验结果与其他文献的对比情况

[0092][0093]

表1中对比的其他业活动时序预测方法具体参考如下文献:

[0094]

[1]tax n,verenich i,la rosa m,et al.predictive business process monitoring with lstm neural networks[c]//international conference on advanced information systems engineering.springer,cham,2017:477

‑

492.

[0095]

[2]evermann j,rehse j r,fettke p.predicting process behaviour using deep learning[j].decision support systems,2017,100:129

‑

140.

[0096]

[3]lin l,wen l,wang j.mm

‑

pred:a deep predictive model for multi

‑

attribute event sequence[c]//proceedings of the 2019siam international conference on data mining.society for industrial and applied mathematics,2019:118

‑

126.

[0097]

[4]taymouri f,la rosa m.encoder

‑

decoder generative adversarial nets for suffix generation and remaining time predication of business process models[j].arxiv preprint arxiv:2007.16030,2020.

[0098]

以上所述的实施例只是本发明的一种较佳的方案,然其并非用以限制本发明。有关技术领域的普通技术人员,在不脱离本发明的精神和范围的情况下,还可以做出各种变化和变型。因此凡采取等同替换或等效变换的方式所获得的技术方案,均落在本发明的保护范围内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。