1.本发明涉及降噪方法技术领域,具体为一种基于深度神经网络的语音环境降噪方法。

背景技术:

2.近年来,人类老龄化的问题越来越突出,老年人听力障碍问题也受到广泛关注,助听器的研究和发展开始受到普遍的重视,作为听障者与外界信息交互的重要媒介,为了能让听障者听到高清晰的音频信息,提高听觉质量,而噪音的去除对于听障者而言显得尤为重要,。

3.目前,针对助听器的噪声有两种,一种是瞬时噪声,另一种是非瞬时噪声,对于瞬时噪声的抑制(transientnoise suppression,tns)方法研究有两种,一种是基于最优修改的对数谱幅度估计(opt imally modified

‑

log spectral ampli tude,0m

‑

lsa)算法,通过考虑先验信噪比和语音信号中噪声存在的不确定性,利用最小值约束递归平均算法(minima control led recursiveaveraging,mcra)进行噪声谱估计,推导计算得出频谱最优增益函数,进一步在频域上找到纯净语音信号的最优对数谱估计,通过ifft得到将瞬时噪声抑制后的语音;另一种是基于时域的递归指数加权最小二乘法(exponentialweighted least square,ewls),对带噪声的语音信号进行检测和修复。

4.语音去噪有着广泛的应用,寻求一种有效的算法对带噪语音信号进行处理,以达到较好的抗噪效果,具有重要的研究意义。目前的语音去噪算法主要有参数方法、非参数方法(如谐减法)、统计方法(如最小均方误差估计)以及其他方法(如小波变换

‑

3]、hilbert

‑

huang']、人工神经网络[5=门])。其中,现有的bp神经网络在适应性、训练算法有效性、网络资源的利用率以及逼近能力等方面性能的较差。

技术实现要素:

[0005]

本发明要解决的技术问题是克服现有的缺陷,提供一种基于深度神经网络的语音环境降噪方法,以解决上述技术背景中bp神经网络在适应性、训练算法有效性、网络资源的利用率以及逼近能力等方面性能较差的缺点。

[0006]

为实现上述目的,本发明提供如下技术方案:一种基于深度神经网络的语音环境降噪方法,包括如下步骤:

[0007]

步骤1:对语音信号进行预处理,其中语音信号包括训练语音信号和待降噪的语音信号;

[0008]

步骤2:设计rbf神经网络去噪模型;

[0009]

步骤3:获取所述步骤1中的训练语音信号,对步骤1建立的rbf神经网络降噪模型进行训练;

[0010]

步骤4:将步骤1中待降噪的语音信号发送至步骤3内训练完成的rbf神经网络降噪模型内进行降噪,并增强降噪后的语音信号且输出降噪增强后的语音信号。

[0011]

2.根据权利要求1所述的一种基于深度神经网络的语音环境降噪方法,其特征在于:所述步骤1中,所述预处理通过wavread读取格式为wav的语言信号,再通过enframe和hamming进行加窗分帧处理;所述分帧处理采用汉明窗对语音信号进行处理,且帧长为200个样本点。

[0012]

3.根据权利要求1所述的一种基于深度神经网络的语音环境降噪方法,其特征在于:所述步骤2中,所述rbf神经网络包括输入层、隐含层和输出层,所述rbf神经网络通过径向基函数作为隐单元的“基”,构成隐含层空间,隐含层对输入矢量进行变换,将低维的模式输入数据变换到高维空间内,使低维空间内线性不分的问题在高维空间内线性可分。

[0013]

4.根据权利要求3所述的一种基于深度神经网络的语音环境降噪方法,其特征在于:所述rbf神经网络降噪模型的设计包括结构设计和参数设计,所述结构设计用于确定网络隐节点;所述参数设计通过各基函数的数据核中心、扩展常数和输出层节点的权值进行确定,其中数据核中心和扩展常数采用k均值聚类算法调整,权值采用lms方法调整。

[0014]

5.根据权利要求1所述的一种基于深度神经网络的语音环境降噪方法,其特征在于:所述步骤3中,利用matlab函数生成幅值为[

‑

0.5,0.5]的高斯白噪音,与纯净的训练语音信号进行叠加生成加噪信号,并对纯净训练语音信号和加噪训练语音信号进行预处理和加窗分帧处理,同时分别选取纯净训练语音信号功率谱的200个样本点作为神经网络的预期输入,纯净训练语音信号功率谱的200个样品点作为神经网络的期望输出值,对rbf神经网络进行训练,并该两次训练在时域上对语音信号进行处理分别记为network1和network2,将分帧加噪语音信号的功率谱作为训练好的network1的输入,完成频域去噪处理,得到n1out;将分帧加噪语音信号在时域上的采样点作为训练号的network2的输入,完成时域去噪处理,得到n2out。

[0015]

6.根据权利要求5所述的一种基于深度神经网络的语音环境降噪方法,其特征在于:将除噪处理后得到帧长为200的输出数据矩阵进行排序重建及得到完整的wav文件;所述n1out首先通过ifft并重叠相加,再除去汉明窗的增益,并将该数向量转换成wav文件;所述n2out直接进行排列重建处理,得到文件。

[0016]

7.根据权利要求1所述的一种基于深度神经网络的语音环境降噪方法,其特征在于:所述降噪后的语音信号还需要通过维纳滤波器得到增强后的降噪增强语音信号。

[0017]

与现有技术相比,本发明提供了一种基于深度神经网络的语音环境降噪方法,具备以下有益效果:

[0018]

本发明中rbf神经网络通过在频域对有噪语音信号进行去噪后与bp神经网络相比较为更接近原语音信号,更好的消除噪声以及保持原始信号的特性便于保证语音信号的质量,在适应性、训练算法有效性、网络资源的利用率以及逼近能力等方面性能相比于bp神经网络更好。

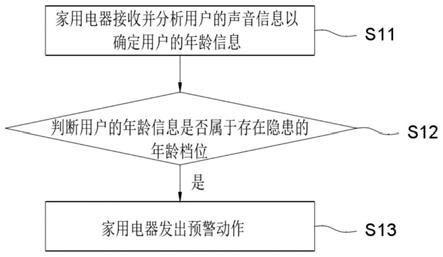

附图说明

[0019]

附图用来提供对本发明的进一步理解,并且构成说明书的一部分,与本发明的实施例一起用于解释本发明,并不构成对本发明的限制,在附图中:

[0020]

图1为本发明提出的基于深度神经网络的语音环境降噪方法简易结构示意图。

具体实施方式

[0021]

为了使本发明实现的技术手段、创作特征、达成目的与功效易于明白了解,下面结合具体实施例和附图,进一步阐述本发明,但下述实施例仅为本发明的优选实施例,并非全部。基于实施方式中的实施例,本领域技术人员在没有做出创造性劳动的前提下所获得其它实施例,都属于本发明的保护范围。

[0022]

请参阅图1,一种基于深度神经网络的语音环境降噪方法,包括如下步骤:

[0023]

步骤1:对语音信号进行预处理,其中语音信号包括训练语音信号和待降噪的语音信号;预处理通过wavread读取格式为wav的语言信号,再通过enframe和hamming进行加窗分帧处理;分帧处理采用汉明窗对语音信号进行处理,且帧长为200个样本点;待降噪的语音信号发送至步骤3内训练完成的rbf神经网络降噪模型内进行降噪,并增强降噪后的语音信号且输出降噪增强后的语音信号;降噪后的语音信号还需要通过维纳滤波器得到增强后的降噪增强语音信号。

[0024]

步骤2:设计rbf神经网络去噪模型;rbf神经网络包括输入层、隐含层和输出层,rbf神经网络通过径向基函数作为隐单元的“基”,构成隐含层空间,隐含层对输入矢量进行变换,将低维的模式输入数据变换到高维空间内,使低维空间内线性不分的问题在高维空间内线性可分;rbf神经网络降噪模型的设计包括结构设计和参数设计,结构设计用于确定网络隐节点;参数设计通过各基函数的数据核中心、扩展常数和输出层节点的权值进行确定,其中数据核中心和扩展常数采用k均值聚类算法调整,权值采用lms方法调整。

[0025]

步骤3:获取步骤1中的训练语音信号,对步骤1建立的rbf神经网络降噪模型进行训练;利用matlab函数生成幅值为[

‑

0.5,0.5]的高斯白噪音,与纯净的训练语音信号进行叠加生成加噪信号,并对纯净训练语音信号和加噪训练语音信号进行预处理和加窗分帧处理,同时分别选取纯净训练语音信号功率谱的200个样本点作为神经网络的预期输入,纯净训练语音信号功率谱的200个样品点作为神经网络的期望输出值,对rbf神经网络进行训练,并该两次训练在时域上对语音信号进行处理分别记为network1和network2,将分帧加噪语音信号的功率谱作为训练好的network1的输入,完成频域去噪处理,得到n1out;将分帧加噪语音信号在时域上的采样点作为训练号的network2的输入,完成时域去噪处理,得到n2out;将除噪处理后得到帧长为200的输出数据矩阵进行排序重建及得到完整的wav文件;n1out首先通过ifft并重叠相加,再除去汉明窗的增益,并将该数向量转换成wav文件;n2out直接进行排列重建处理,得到文件,

[0026]

步骤4:将步骤1中待降噪的语音信号发送至步骤3内训练完成的rbf神经网络降噪模型内进行降噪,并增强降噪后的语音信号且输出降噪增强后的语音信号,相比bp神经网络在适应性、训练算法有效性、网络资源的利用率以及逼近能力等方面性能较好。

[0027]

以上显示和描述了本发明的基本原理、主要特征和本发明的优点。本行业的技术人员应该了解,本发明不受上述实施例的限制,上述实施例和说明书中描述的仅为本发明的优选例,并不用来限制本发明,在不脱离本发明精神和范围的前提下,本发明还会有各种变化和改进,这些变化和改进都落入要求保护的本发明范围内。本发明要求保护范围由所附的权利要求书及其等效物界定。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。