1.本发明涉及人工智能技术领域,具体涉及一种人工智能阅读显示器及显示方法。

背景技术:

2.迄今为止,会议、教授、播音等场景中,演讲者主要利用纸作为记录讲话内容的媒介。在演讲过程中,经常需要低头翻看纸件,会影响演讲者的演讲效果,给观众留下不好的印象,而且演讲者在抬头与观众进行视线交流之后,再次观看演讲稿时,会出现寻找后续演讲内容困难的问题。为克服该问题,有人将演讲内容记载在电子显示终端上,但是,将演讲内容记载在电子显示终端上,也需要手动翻页或滚屏,如此,演讲者翻看记录的内容还是很不方便,难以快速寻找到后续演讲内容的问题也依然存在。

技术实现要素:

3.因此,本发明实施例要解决的技术问题在于克服现有技术中演讲者在演讲过程中需要手动翻稿以及难以迅速在演讲稿中定位当前演讲的内容的缺陷,从而提供一种人工智能阅读显示器及显示方法。

4.为此,本发明提供一种人工智能阅读显示器,包括:声电转换模块、人工智能模块、检索模块、控制模块和显示模块;

5.所述显示模块,用于显示文稿;

6.所述声电转换模块,用于将采集到的读稿者的声音转换为电信息;

7.所述人工智能模块,用于将所述声电转换模块提供的电信息转换的声音信息识别成文字信息;

8.所述检索模块,用于根据所述文字信息从所述文稿的文档数据中检索读稿者当前阅读的内容所在的文稿位置;

9.所述控制模块,用于根据读稿者当前阅读的内容所在的文稿位置,控制所述显示模块在显示器的设定区域显示读稿者当前阅读和即将阅读的文稿内容。

10.可选的,所述设定区域具有边框或所述设定区域显示的文稿内容具有醒目标识。

11.可选的,所述人工智能模块包括划分单元、特征提取单元和深度学习单元,所述划分单元用于识别所述声音信息中停顿点,并根据所述停顿点将所述声音信息划分为多个声音片段,所述特征提取单元用于提取所述声音片段的特征信息,所述深度学习单元用于识别提取的所述特征信息得到所述文字信息。

12.可选的,所述深度学习单元用于对所述声音片段中进行划分得到声音单元,识别所述声音单元的第一拼音,将识别到的所述第一拼音与预设识别库中的拼音列表进行匹配,根据所述拼音列表中与所述第一拼音匹配的第二拼音对应的候选字词集合确定所述声音单元对应的文字信息;

13.其中,所述第一拼音包括字的拼音、词的拼音或字和词的组合拼音;所述拼音列表包括字的拼音和词的拼音,且所述拼音列表中所包括的字和词的拼音为所述文稿中所有字

和词的拼音,所述拼音列表中所有拼音对应的候选字词集合为所述文稿中所有字词集合。

14.可选的,所述人工智能模块还包括第一修正单元和/或第二修正单元,所述第一修正单元用于根据所述声音片段识别出的文字信息中第一文字相邻的一个或多个文字对所述第一文字进行修正,所述第二修正单元用于根据前一个或多个声音片段识别出的且经过修正的文字信息对所述文字信息进行修正。

15.可选的,所述检索模块包括匹配单元,所述匹配单元用于将所述文字信息与所述文稿中的第一文稿内容进行匹配,所述第一文稿内容为所述文稿中上一次匹配到的文稿内容之后的部分文稿内容。

16.可选的,所述匹配单元用于将所述第一文稿内容分割为多个待匹配内容,每个所述待匹配内容中的字符数比所述文字信息中的字符数多a个,相邻的所述待匹配内容之间重叠的字符数为b个,a和b均为正整数;

17.所述匹配单元还用于计算所述文字信息与每一所述待匹配内容之间的字符匹配度、语义匹配度和拼音匹配度,并对所述字符匹配度、所述语义匹配度和所述拼音匹配度进行加权求和得到总匹配度;

18.所述匹配单元,还用于将所述第一文稿内容中所述总匹配度最大且大于预设匹配度阈值的所述待匹配内容作为读稿者当前阅读的内容所在的文稿位置。

19.可选的,所述语义匹配度采用模糊神经网络模型分析得到,所述模糊神经网络模型包括并列的两个模糊神经网络以及根据两个所述模糊神经网络的输出值进行语义匹配度计算的匹配度计算网络,两个所述模糊神经网络的输入分别为所述文字信息的语义特征向量和所述待匹配内容的语义特征向量,每一所述模糊神经网络包括依次连接的输入层、模糊化层、模糊推理层和反模糊化层;

20.所述输入层用于将所述语义特征向量直接传输至所述模糊化层;

21.所述模糊化层,用于利用模糊度隶属函数计算所述输入层输出的语义特征向量所对应的模糊变量的隶属度;

22.所述模糊推理层,用于利用每个所述模糊变量的隶属度得到对应模糊规则的匹配程度;

23.所述反模糊化层,用于进行去模糊化处理。

24.本发明还提供一种人工智能阅读显示方法,包括以下步骤:

25.将读稿者阅读时采集到的声音信息识别成文字信息;

26.根据所述文字信息从文稿的文档数据中检索读稿者当前阅读的内容所在的文稿位置;

27.根据读稿者当前阅读的内容所在的文稿位置,控制显示器的设定区域显示读稿者当前阅读和即将阅读的文稿内容。

28.可选的,所述将读稿者阅读时采集到的声音信息识别成文字信息,包括:

29.识别所述声音信息中停顿点,并根据所述停顿点将所述声音信息划分为多个声音片段;

30.提取所述声音片段的特征信息;

31.识别提取的所述特征信息得到所述文字信息。

32.本发明实施例的技术方案,具有如下优点:

33.本发明提供的人工智能阅读显示器及显示方法中,文稿在显示器上的移动速度匹配于读稿者的讲话速度,从而读稿者在演讲过程中不需要手动翻页或滚屏,而且通过将读稿者当前阅读和即将阅读的文稿内容显示在设定区域内,使得演讲者在演讲过程中可以快速找到当前阅读的文稿内容和即将阅读的文稿内容,避免因长时间查找当前阅读的文稿内容和即将阅读的文稿内容导致演讲中断,保证演讲的流畅性,提升演讲效果。

附图说明

34.为了更清楚地说明本发明具体实施方式或现有技术中的技术方案,下面将对具体实施方式或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本发明的一些实施方式,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

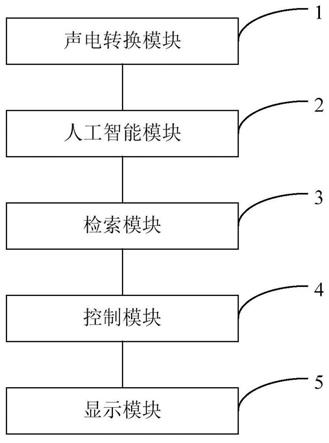

35.图1为本发明实施例1中人工智能阅读显示器的一个具体示例的结构框图;

36.图2为本发明实施例1中人工智能模块的一个具体示例的结构框图;

37.图3为本发明实施例2中人工智能阅读显示方法的一个具体示例的流程图;

38.图4为本发明实施例2中声音识别成文字的方法的一个具体示例的流程图。

具体实施方式

39.下面将结合附图对本发明的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

40.在本发明的描述中,需要说明的是,本文所用的术语仅用于描述特定实施例的目的,而并非旨在限制本发明。除非上下文明确指出,否则如本文中所使用的单数形式“一”、“一个”和“该”等意图也包括复数形式。使用“包括”和/或“包含”等术语时,是意图说明存在该特征、整数、步骤、操作、元素和/或组件,而不排除一个或多个其他特征、整数、步骤、操作、元素、组件、和/或其他组合的存在或增加。术语“第一”、“第二”、“第三”仅用于描述目的,而不能理解为指示或暗示相对重要性。术语“安装”、“相连”、“连接”应做广义理解,例如,可以是固定连接,也可以是可拆卸连接,或一体地连接;可以是机械连接,也可以是电连接;可以是直接相连,也可以通过中间媒介间接相连,还可以是两个元件内部的连通;可以是无线连接,也可以是有线连接。对于本领域的普通技术人员而言,可以具体情况理解上述术语在本发明中的具体含义。

41.此外,下面所描述的本发明不同实施方式中所涉及的技术特征只要彼此之间未构成冲突就可以相互结合。

42.实施例1

43.本施例提供一种人工智能阅读显示器,如图1所示,包括:声电转换模块1、人工智能模块2、检索模块3、控制模块4和显示模块5;

44.所述显示模块5,用于显示文稿;该文稿为读稿者正在使用的文稿;

45.所述声电转换模块1,用于将采集到的读稿者的声音转换为电信息;

46.读稿者,一般为演讲者。

47.所述人工智能模块2,用于将所述声电转换模块1提供的电信息转换的声音信息识

别成文字信息;

48.所述检索模块3,用于根据所述文字信息从所述文稿的文档数据中检索读稿者当前阅读的内容所在的文稿位置;

49.所述控制模块4,用于根据读稿者当前阅读的内容所在的文稿位置,控制所述显示模块5在显示器的设定区域显示读稿者当前阅读和即将阅读的文稿内容。

50.具体的,所述控制模块4根据读稿者当前阅读的内容所在的文稿位置生成当前阅读的文稿内容的图像和即将阅读的文稿内容的图像并控制显示器在设定区域显示生成的图像。

51.本实施例中,文稿在显示器上的移动速度匹配于读稿者的讲话速度,从而读稿者在演讲过程中不需要手动翻页或滚屏,而且通过将读稿者当前阅读和即将阅读的文稿内容显示在设定区域内,使得演讲者在演讲过程中可以快速找到当前阅读的文稿内容和即将阅读的文稿内容,避免因长时间查找当前阅读的文稿内容和即将阅读的文稿内容导致演讲中断,保证演讲的流畅性,提升演讲效果。

52.可选的,所述设定区域具有边框或所述设定区域显示的文稿内容具有醒目标识。

53.本实施例中,能够使得所述设定区域显示的读稿者当前阅读和即将阅读的文稿内容比所述显示器上其他区域显示的文稿内容醒目。

54.进一步可选的,所述醒目标识包括边框、下划线、文字加粗、改变的文字颜色中的一种或几种的组合。

55.所述醒目标识在显示器上的显示位置固定。

56.所述醒目标识与所述文稿内容分层显示。

57.本实施例中,所述人工智能模块2在将所述声电转换模块1提供的电信息转换的声音信息识别为文字信息之前,还对所述声音信息进行过滤处理,所述过滤处理用于将所述声音信息中不属于所述读稿者的部分去除掉。从而可以提高声音识别成文字的准确性,尤其可以避免阅读停顿时其他声音(例如在阅读过程中被其他人的说话或问话打断)的干扰。

58.可选的,在对所述声音信息进行过滤处理之前,可以根据所述声电转换模块1最初提供的一部分电信息转换的声音信息(可以称为第一声音信息)确定所述读稿者的声纹信息,然后在进行过滤处理时根据所述读稿者的声纹信息去除所述声音信息中不属于所述读稿者的部分声音信息。

59.在根据第一声音信息确定读稿者的声纹信息时,首先将所述第一声音信息均分为多段,并计算每一段的短时绝对值和,从中选取短时绝对值和均大于预设阈值且连续的多段声音信息作为第二声音信息,从中选取短时绝对值和并非均大于所述预设阈值但连续的多段声音信息作为第三声音信息,所述第三声音信息中短时绝对值和不大于所述预设阈值的段占比大于预设比例。所述第二声音信息和所述第三声音信息的时长均大于一定值,例如3秒,5秒。然后,根据所述第三声音信息确定包括过零率阈值和/或短时能量阈值的环境自适应参数。最后,利用所述环境自适应参数对所述第二声音信息进行有效语音端点检测得到有效的语音段(例如第二声音信息中连续多段的过零率大于所述过零率阈值且短时能量大于所述短时能量阈值时认为该连续的多段声音信息为有效的语音段,每一段的长度可根据平均语速确定,例如至少为在平均语速情况下读两个字所需的时间),并利用检测到的有效语音段提取所述读稿者的声纹信息。例如,可以提取所述有效语音段的梅尔倒谱系数

声学特征向量、伽马通(gammatone)频率倒谱系数声学特征向量和更高频的常数q变换倒谱系数声学特征向量,并进行合成得到所述声纹信息。

60.可选的,如图2所示,所述人工智能模块2包括划分单元21、特征提取单元22和深度学习单元23,所述划分单元21用于识别所述声音信息中停顿点,并根据所述停顿点将所述声音信息划分为多个声音片段,所述特征提取单元22用于提取所述声音片段的特征信息,所述深度学习单元23用于识别提取的所述特征信息得到所述文字信息。

61.具体的,在识别所述声音信息中的停顿点时可以将所述声音信息划分成多个较小的分段,各分段之间可以存在重叠的部分,然后计算各分段的过零率和/或短时能量,并与上述的过零率阈值和/或短时能量阈值进行比较,若不大于对应的阈值,则认为是停顿点。

62.所述特提取单元22在提取所述声音片段的特征信息,所述深度学习单元23识别得到文字信息时,可以将所述声音片段进行分帧加窗处理得到声音帧(例如下述的声音单元),帧移可以为帧长的1/3~1/2,然后基于声音帧进行特征提取和文字识别。

63.具体的,所述特征提取单元提取的特征信息包括能量、基音频率、基频的周期、共振峰值、短时过零率、梅尔倒谱系数和/或线性预测倒谱系数。其中,梅尔倒谱系数的获取过程为:

64.对所述声音信息(具体可以是声音片段或声音帧)进行归一化处理,得到矩阵形式的数据;对矩阵形式的数据进行fft变换,得到短时能量谱x

n

(k),构建滤波器对所述短时能量谱x

n

(k)进行滤波处理,得到系数m(i):

[0065][0066]

其中,i=1,2,

…

,p,p为滤波器个数,h

i

(k)为第i个滤波器,

[0067][0068]

f(i)是第i个滤波器的中心频率,满足每个滤波器的起始频率与邻近滤波器的中心频率相同;

[0069]

对滤波器的输出求对数能量,最后进行dct变换,得到所述梅尔倒谱系数c

mfcc

(j):

[0070][0071]

基频的周期这一特征信息的提取过程为:

[0072]

利用yin算法对所述声音信息(具体可以是声音片段或声音帧)进行处理,得到其中的极小值点,判断是否存在小于预设阈值的极小值点,若存在,则获取所有小于所述预设阈值的极小值点,并将极小值的相对绝对差值小于预设误差的极小值点归入同一极小值点序列,获得多个极小值点序列,根据每个极小值点序列中极小值点的数据,求取该极小值点

序列的权重,获取权重值最大的极小值点序列中最小的极小值点,将该最小极小值点与所述预设阈值的偏移量作为基谱的周期;若不存在,则将其中最小的极小值点与所述预设阈值的偏移量作为基谱的周期。

[0073]

可选的,所述深度学习单元用于对所述声音片段中进行划分得到声音单元,识别所述声音单元的第一拼音,将识别到的所述第一拼音与预设识别库中的拼音列表进行匹配,根据所述拼音列表中与所述第一拼音匹配的第二拼音对应的候选字词集合确定所述声音单元对应的文字信息;

[0074]

其中,所述第一拼音包括字的拼音、词的拼音或字和词的组合拼音;所述拼音列表包括字的拼音和词的拼音,且所述拼音列表中所包括的字和词的拼音为所述文稿中所有字和词的拼音,所述拼音列表中所有拼音对应的候选字词集合为所述文稿中所有字词集合。

[0075]

所述第二拼音与所述第一拼音匹配是指所述第一拼音与所述第二拼音的匹配度大于预设匹配阈值,具体来说可以相同也可以近似。

[0076]

所述预设识别库是预先根据所述文稿建立得到,在建立所述预设识别库时,可以将文稿中所有字的拼音提取出来并将所有词的拼音提取出来生成所述拼音列表,再统计文稿中每个拼音对应的字或词的出现的次数,按照出现的次数对每个拼音对应的字或词进行排序得到所述候选字词集。

[0077]

具体的,所述深度学习单元在识别所述声音单元的第一拼音时,可以使用识别模型进行识别。所述识别模型包括双向递归神经网络和对抗神经网络,其中所述双向递归神经网络用于捕捉声音单元的上下文信息,所述对抗神经网络的建立过程为:建立生成模型和判别模型,对所述生成模型和所述判别模型的参数进行调整,获取拼音识别标签,根据参数调整后的生成模型和判别模型以及所述拼音识别标签,建立所述对抗神经网络模型。

[0078]

可选的,所述人工智能模块2还包括第一修正单元和/或第二修正单元,所述第一修正单元用于根据所述声音片段识别出的文字信息中第一文字相邻的一个或多个文字对所述第一文字进行修正,所述第二修正单元用于根据前一个或多个声音片段识别出的且经过修正的文字信息对所述文字信息进行修正。

[0079]

本实施例中,通过根据上下文进行对识别的文字进行修正,可以降低同音字、发音不标准、口误等对文字识别的影响,提高文字识别准确度。

[0080]

另外,在对识别出的文字信息进行修正时可以仅限在所述候选字词集中选择作为替换的字或词,从而提高修正的正确概率。进一步可选的,可以优先在所述第二拼音对应的候选字词集中选择作为替换的字或词。

[0081]

可选的,所述检索模块3包括匹配单元,所述匹配单元用于将所述文字信息与所述文稿中的第一文稿内容进行匹配,所述第一文稿内容为所述文稿中上一次匹配到的文稿内容之后的部分文稿内容。

[0082]

本实施例中,在识别到读稿者当前的声音对应的文字信息后,将识别到的文字信息与上一次匹配到的文稿内容之后的部分文稿内容进行匹配,缩小了匹配范围,从而降低了匹配的计算量、减少匹配所用的时间,而且也可以进一步降低匹配的准确度。

[0083]

可选的,所述匹配单元用于将所述第一文稿内容分割为多个待匹配内容,每个所述待匹配内容中的字符数比所述文字信息中的字符数多a个,相邻的所述待匹配内容之间重叠的字符数为b个,a和b均为正整数;

[0084]

所述匹配单元还用于计算所述文字信息与每一所述待匹配内容之间的字符匹配度、语义匹配度和拼音匹配度,并对所述字符匹配度、所述语义匹配度和所述拼音匹配度进行加权求和得到总匹配度;

[0085]

所述匹配单元,还用于将所述第一文稿内容中所述总匹配度最大且大于预设匹配度阈值的所述待匹配内容作为读稿者当前阅读的内容所在的文稿位置。

[0086]

可选的,所述语义匹配度采用模糊神经网络模型分析得到,所述模糊神经网络模型包括并列的两个模糊神经网络以及根据两个所述模糊神经网络的输出值进行语义匹配度计算的匹配度计算网络,两个所述模糊神经网络的输入分别为所述文字信息的语义特征向量和所述待匹配内容的语义特征向量,每一所述模糊神经网络包括依次连接的输入层、模糊化层、模糊推理层和反模糊化层;

[0087]

所述输入层用于将所述语义特征向量直接传输至所述模糊化层;

[0088]

所述模糊化层,用于利用模糊度隶属函数计算所述输入层输出的语义特征向量所对应的模糊变量的隶属度;

[0089]

所述模糊推理层,用于利用每个所述模糊变量的隶属度得到对应模糊规则的匹配程度;

[0090]

所述反模糊化层,用于进行去模糊化处理。

[0091]

具体的,将所述待匹配内容和所述文字信息分别转为词向量表示,采用transformer的编码器对所述词向量进行编码提取出每个词的抽象特征,得到所述待匹配内容和所述文字信息的由词特征组成的语义特征向量。所述隶属度函数可以是三角型隶属度函数、类z型隶属度函数、类s型隶属度函数、高斯隶属度函数等。所述模糊化层用于对输入层输出的语义特征向量进行模糊化处理,模糊化处理后的信息输入至所述模糊推理层后,根据模糊规则库中的规则,通过对隶属度的匹配判断,推导模糊规则库中的规则的适用度,选择适用的模糊规则。所述反模糊化层将模糊变量变换为精确量输出。

[0092]

所述字符匹配度和所述拼音匹配度通过编辑距离确定,下面具体说明根据编辑距离确定所述拼音匹配度的方法,字符匹配度的计算方法类似,不再详述。

[0093]

首先,初始化编辑距离矩阵l:

[0094][0095]

其中,m为所述待匹配内容的拼音个数(即字符的个数),n为所述文字信息的拼音个数(即字符的个数),0≤n≤n 1,0≤m≤m 1,n、m、n和m均为整数。

[0096]

然后,按照以下公式对所述编辑距离矩阵的各元素进行赋值:

[0097]

l

0,0

=0,l

m,0

=m,l

0,n

=n

[0098][0099]

其中,sim(m,n)为所述待匹配内容中的第m个字符的拼音和所述文字信息中的第n个字符的拼音组成的匹配对的相似度值。将l

m 1,n 1

的值确定为所述待匹配内容和所述文字信息的拼音之间的编辑距离。所述待匹配内容和所述文字信息的拼音之间的匹配度与所述编辑距离成反比。

[0100]

在计算拼音组成的匹配对的相似度值sim(m,n)时,可以声母、韵母和音调,分别计算相似度,然后加权求和。

[0101]

另外,所述显示器还可以包括用户输入模块,接收用户的输入,根据所述输入确定读稿者当前阅读的文稿内容或即将阅读的文稿内容,所述输入可以是在其他文稿内容的显示区域的划线输入或画圈输入,该其他文稿内容的显示区域是除所述当前阅读和即将阅读的文稿内容的显示区域以外的其他显示区域。或者,所述输入可以是用户将第二文稿内容调整至用于显示当前阅读的文稿内容的设定区域的输入,例如滚屏输入。本实施例中,若语音识别错误导致当前阅读的文稿内容识别错误,则用户可以手动进行调整,或者用户准备跳过文稿的一些内容时,可以手动调整当前阅读的文稿内容或即将阅读的文稿内容的显示,避免后续的自动识别错误,使得文稿的显示与阅读进度保持一致。

[0102]

实施例2

[0103]

本实施例提供一种人工智能阅读显示方法,如图3所示,包括以下步骤:

[0104]

s1:将读稿者阅读时采集到的声音信息识别成文字信息;

[0105]

s2:根据所述文字信息从文稿的文档数据中检索读稿者当前阅读的内容所在的文稿位置;

[0106]

s3:根据读稿者当前阅读的内容所在的文稿位置,控制显示器的设定区域显示读稿者当前阅读和即将阅读的文稿内容。

[0107]

本实施例中,文稿在显示器上的移动速度匹配于读稿者的讲话速度,从而读稿者在演讲过程中不需要手动翻页或滚屏,而且通过将读稿者当前阅读和即将阅读的文稿内容显示在设定区域内,使得演讲者在演讲过程中可以快速找到当前阅读的文稿内容和即将阅读的文稿内容,避免因长时间查找当前阅读的文稿内容和即将阅读的文稿内容导致演讲中断,保证演讲的流畅性,提升演讲效果。

[0108]

可选的,请参阅图4,上述步骤s1,即所述将读稿者阅读时采集到的声音信息识别成文字信息,包括:

[0109]

s11:识别所述声音信息中停顿点,并根据所述停顿点将所述声音信息划分为多个声音片段;

[0110]

s12:提取所述声音片段的特征信息;

[0111]

s13:识别提取的所述特征信息得到所述文字信息。

[0112]

其他的相关技术请参阅上述实施例1,此处不再赘述。

[0113]

显然,上述实施例仅仅是为清楚地说明所作的举例,而并非对实施方式的限定。对于所属领域的普通技术人员来说,在上述说明的基础上还可以做出其它不同形式的变化或变动。这里无需也无法对所有的实施方式予以穷举。而由此所引伸出的显而易见的变化或

变动仍处于本发明创造的保护范围之中。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。