1.本技术涉及语音处理技术领域,尤其涉及一种说话人分离方法及其相关设备。

背景技术:

2.说话人分离技术可以按照不同的说话人对语音数据中各帧音频数据进行分类整理,以将属于同一个说话人的多帧音频数据合并成一个语音片段,如此能够得到至少一个语音片段,以使各个语音片段的说话人不同,以便后续能够在各个语音片段上分别标记出说话人信息。

3.目前,随着说话人分离技术的发展,说话人分离技术的应用场景越来越多。例如,说话人分离技术可以应用于会议内容整理、语音转写等应用场景。

4.然而,因相关说话人分离技术存在缺陷,使得该相关说话人分离技术无法针对一些复杂语音数据(如,存在多个说话人同时说话的语音数据)进行说话人分离,如此导致该相关说话人分离技术的说话人分离准确性较低。

技术实现要素:

5.本技术实施例的主要目的在于提供一种说话人分离方法及其相关设备,能够提高说话人分离准确性。

6.本技术实施例提供了一种说话人分离方法,所述方法包括:获取待分离语音数据;其中,所述待分离语音数据包括至少一个说话人的语音信息;将所述待分离语音数据输入预先构建的语音分离模型,得到所述语音分离模型输出的至少一个语音分离数据,以使各个语音分离数据所携带语音信息的说话人不同;根据所述至少一个语音分离数据,确定所述待分离语音数据的说话人分离结果。

7.本技术实施例还提供了一种说话人分离装置,包括:语音获取单元,用于获取待分离语音数据;其中,所述待分离语音数据包括至少一个说话人的语音信息;语音分离单元,用于将所述待分离语音数据输入预先构建的语音分离模型,得到所述语音分离模型输出的至少一个语音分离数据,以使各个语音分离数据所携带语音信息的说话人不同;说话人分离单元,用于根据所述至少一个语音分离数据,确定所述待分离语音数据的说话人分离结果。

8.本技术实施例还提供了一种设备,所述设备包括:处理器、存储器、系统总线;

9.所述处理器以及所述存储器通过所述系统总线相连;

10.所述存储器用于存储一个或多个程序,所述一个或多个程序包括指令,所述指令当被所述处理器执行时使所述处理器执行本技术实施例提供的说话人分离方法的任一实施方式。

11.本技术实施例还提供了一种计算机可读存储介质,所述计算机可读存储介质中存储有指令,当所述指令在终端设备上运行时,使得所述终端设备执行本技术实施例提供的说话人分离方法的任一实施方式。

12.本技术实施例还提供了一种计算机程序产品,所述计算机程序产品在终端设备上运行时,使得所述终端设备执行本技术实施例提供的说话人分离方法的任一实施方式。

13.基于上述技术方案,本技术具有以下有益效果:

14.本技术提供的技术方案中,在获取到包括至少一个说话人的语音信息的待分离语音数据之后,可以先将该待分离语音数据输入预先构建的语音分离模型,得到该语音分离模型输出的至少一个语音分离数据,以使各个语音分离数据所携带语音信息的说话人不同(也就是,不同语音分离数据用于记录不同说话人的语音信息);再根据该至少一个语音分离数据,确定该待分离语音数据的说话人分离结果,以使该说话人分离结果能够准确地表示出该待分离语音数据中每一个说话人对应的语音片段。

15.其中,因语音分离模型能够准确地按照说话人进行语音分离,使得由该语音分离模型针对待分离语音数据输出的各个语音分离数据分别能够准确且全面地表示出各个说话人的语音信息,从而使得基于该各个语音分离数据确定的说话人分离结果能够准确且全面地表示该待分离语音数据中每一个说话人对应的语音片段,如此能够有效地避免因无法准确地识别出重叠音频数据对应的多个说话人而导致的不良影响,从而能够有效地提高说话人分离准确性。

附图说明

16.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

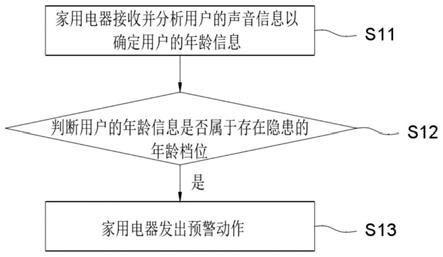

17.图1为本技术实施例提供的一种说话人分离方法的流程图;

18.图2为本技术实施例提供的一种语音分离模型的结构示意图;

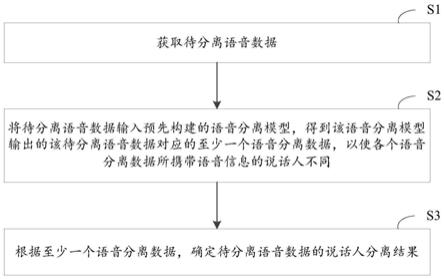

19.图3为本技术实施例提供的一种说话人分离的流程示意图;

20.图4为本技术实施例提供的一种说话人分离装置的结构示意图。

具体实施方式

21.发明人针对说话人分离技术的研究中发现,对于上述“相关说话人分离技术”来说,在获取到待分离语音数据之后,可以依次通过语音切片

→

声纹提取

→

声纹聚类等过程来确定该待分离语音数据的说话人分离结果。另外,因声纹性能能够严重地影响上述“相关说话人分离技术”的说话人分离性能结果,故为了保证每个语音切片的声纹性能,上述“相关说话人分离技术”是基于每个语音切片中仅存在1个说话人的语音信息的假设进行设计的,使得基于上述“相关说话人分离技术”所确定的说话人分离结果表示该待分离语音数据中每个语音片段的说话人只有一个(也就是,该待分离语音数据中每帧音频数据的说话人只有一个),从而使得基于上述“相关说话人分离技术”无法针对重叠音频数据(也就是,在多个说话人同时说话时所产生的音频数据)进行说话人分离,如此导致该相关说话人分离技术的说话人分离准确性较低。

22.基于上述发现,为了解决背景技术部分的技术问题,本技术实施例提供了一种说话人分离方法,该方法包括:在获取到包括至少一个说话人的语音信息的待分离语音数据

之后,可以先将该待分离语音数据输入预先构建的语音分离模型,得到该语音分离模型输出的至少一个语音分离数据,以使各个语音分离数据所携带语音信息的说话人不同(也就是,不同语音分离数据用于记录不同说话人的语音信息);再根据该至少一个语音分离数据,确定该待分离语音数据的说话人分离结果,以使该说话人分离结果能够准确地表示出该待分离语音数据中每一个说话人对应的语音片段。

23.其中,因语音分离模型能够准确地按照说话人进行语音分离,使得由该语音分离模型针对待分离语音数据输出的各个语音分离数据分别能够准确且全面地表示出各个说话人的语音信息,从而使得基于该各个语音分离数据确定的说话人分离结果能够准确且全面地表示该待分离语音数据中每一个说话人对应的语音片段,如此能够有效地避免因无法准确地识别出重叠音频数据对应的多个说话人而导致的不良影响,从而能够有效地提高说话人分离准确性。

24.另外,本技术实施例不限定说话人分离方法的执行主体,例如,本技术实施例提供的说话人分离方法可以应用于终端设备或服务器等数据处理设备。其中,终端设备可以为智能手机、计算机、个人数字助理(personal digital assitant,pda)或平板电脑等。服务器可以为独立服务器、集群服务器或云服务器。

25.为使本技术实施例的目的、技术方案和优点更加清楚,下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。

26.方法实施例一

27.参见图1,该图为本技术实施例提供的一种说话人分离方法的流程图。

28.本技术实施例提供的说话人分离方法,包括s1

‑

s3:

29.s1:获取待分离语音数据。

30.其中,待分离语音数据是指需要进行说话人分离处理的语音数据;而且该待分离语音数据包括至少一个说话人的语音信息。例如,待分离语音数据可以包括n个说话人的语音信息。其中,n为正整数。

31.另外,本技术实施例不限定待分离语音数据,例如,待分离语音数据可以包括至少一段重叠音频数据。其中,“重叠音频数据”是指由多个说话人同时说话所产生的音频数据。

32.此外,为了提高说话人分离的实时性,待分离语音数据可以是指由拾音器实时采集的语音数据。

33.s2:将待分离语音数据输入预先构建的语音分离模型,得到该语音分离模型输出的该待分离语音数据对应的至少一个语音分离数据,以使各个语音分离数据所携带语音信息的说话人不同。

34.其中,待分离语音数据对应的至少一个语音分离数据是指由语音分离模型针对该待分离语音数据进行语音分离(尤其是按照说话人进行语音分离)得到的。

35.另外,本技术实施例不限定语音分离数据的个数,例如,若待分离语音数据包括n个说话人的语音信息,则语音分离数据的个数可以是n。其中,n为正整数。

36.此外,待分离语音数据对应的第n个语音分离数据所携带语音信息的说话人不同于该待分离语音数据对应的n个语音分离数据中除了该第n个语音分离数据以外的其他任

一语音分离数据所携带语音信息的说话人;其中,n为正整数,n≤n,n为正整数。为了便于理解,下面结合示例进行说明。

37.例如,若待分离语音数据对应的第1个语音分离数据携带有第1个说话人的说话内容,第2个语音分离数据携带有第2个说话人的说话内容,

……

(以此类推),且第n个语音分离数据携带有第n个说话人的说话内容,则该第1个语音分离数据所携带语音信息的说话人为第1个说话人,该第2个语音分离数据所携带语音信息的说话人为第2个说话人,

……

(以此类推),该第n个语音分离数据所携带语音信息的说话人为第n个说话人。

38.语音分离模型用于针对该语音分离模型的输入数据进行语音分离(尤其是按照说话人进行语音分离)。

39.另外,本技术实施例不限定语音分离模型的模型结构,例如,在一种可能的实施方式下,如图2所示,该语音分离模型200包括编码层201、分离层202、融合层203和解码层204。其中,分离层202的输入数据包括编码层201的输出数据;融合层203的输入数据包括编码层201的输出数据和分离层202的输出数据;解码层204的输入数据包括融合层203的输出数据。

40.为了便于理解语音分离模型200的工作原理,下面以待分离语音数据的语音分离过程为例进行说明。

41.作为示例,若语音分离数据的个数为n,则利用语音分离模型200针对该待分离语音数据进行语音分离的过程,具体可以包括步骤11

‑

步骤14:

42.步骤11:将待分离语音数据输入编码层201,得到该编码层201输出的该待分离语音数据的编码特征。

43.其中,编码层201用于针对该编码层201的输入数据进行编码处理;而且本技术实施例不限定编码层201,可以采用现有的或者未来出现的任一种能够针对待分离语音数据进行编码处理的实施方式(如,编码器)进行实施。

44.待分离语音数据的编码特征用于表示该待分离语音数据携带的语音信息;而且本技术实施例不限定待分离语音数据的编码特征,例如,若待分离语音数据包括e帧音频数据,则该待分离语音数据的编码特征可以包括该待分离语音数据中第1帧音频数据的编码特征至该待分离语音数据中第e帧音频数据的编码特征。

45.步骤12:将待分离语音数据的编码特征输入分离层202,得到该分离层202输出的该待分离语音数据对应的n个说话人归属特征。其中,n为正整数。

46.其中,分离层202用于针对该分离层202的输入数据进行说话人识别;而且本技术实施例不限定分离层202,可以采用现有的或者未来出现的任一种能够针对待分离语音数据的编码特征进行说话人识别的实施方式进行实施。

47.待分离语音数据对应的第n个说话人归属特征用于表示该待分离语音数据携带的第n个说话人的语音信息在该待分离语音数据中所处位置。其中,n为正整数,n≤n。

48.另外,本技术实施例不限定待分离语音数据对应的第n个说话人归属特征,例如,若待分离语音数据包括e帧音频数据,则该待分离语音数据对应的第n个说话人归属特征可以包括e个数据,而且该第n个说话人归属特征中第e个数据用于表示该待分离语音数据中第e帧音频数据的说话人是否为第n个说话人。其中,e为正整数,e≤e,e为正整数。

49.步骤13:将待分离语音数据的编码特征和该待分离语音数据对应的第n个说话人

归属特征输入融合层203,得到该融合层203输出的该待分离语音数据对应的第n个融合特征。其中,n为正整数,n≤n。

50.其中,融合层203用于针对该融合层203的输入数据进行特征融合(如,进行特征相乘)。

51.待分离语音数据对应的第n个融合特征用于表示该待分离语音数据携带的第n个说话人的语音信息的编码特征。

52.另外,本技术实施例不限定待分离语音数据对应的第n个融合特征,例如,若待分离语音数据包括e帧音频数据,则该待分离语音数据对应的第n个融合特征包括e个特征数据,而且该第n个融合特征中第e个特征数据是由该待分离语音数据中第1帧音频数据的编码特征与该待分离语音数据对应的第n个说话人归属特征中第e个数据进行融合(如,进行相乘)得到的。其中,e为正整数,e≤e,e为正整数。

53.步骤14:将待分离语音数据对应的第n个融合特征输入解码层204,得到该解码层204输出的该待分离语音数据对应的第n个语音分离数据。其中,n为正整数,n≤n,n为正整数。

54.其中,解码层204用于针对该解码层204输入数据进行解码处理;而且本技术实施例不限定解码层204,可以采用现有的或者未来出现的任一种能够针对融合特征进行解码处理的实施方式(如,解码器)进行实施。

55.基于上述步骤11至步骤14的相关内容可知,对于图2所示的语音分离模型200来说,在将待分离语音数据输入该语音分离模型200之后,可以由该语音分离模型200针对该待分离语音数据进行语音分离处理,得到并输出该待分离语音数据对应的n个语音分离数据,以使该待分离语音数据对应的n个语音分离数据能够分别表示出n个说话人的语音信息。

56.另外,本技术实施例不限定语音分离模型的构建过程,例如,在一种可能的是实施方式下,该语音分离模型的构建过程,可以包括步骤21

‑

步骤26:

57.步骤21:获取样本语音和该样本语音对应的至少一个实际语音分离数据。

58.其中,样本语音是指包括重叠音频数据的语音数据。另外,本技术实施例不限定样本语音的个数,例如,样本语音的个数可以为g。其中,g为正整数。

59.样本语音对应的至少一个实际语音分离数据分别用于表示由该样本语音携带的至少一个说话人的实际语音信息。例如,若样本语音携带有k个说话人的语音信息,则该样本语音对应的第k个实际语音分离数据用于表示由该样本语音携带的第k个说话人的实际语音信息。其中,k为正整数,k≤k,k为正整数。

60.需要说明的是,本技术实施例不限定k与上文n之间的关系,例如,k可以与n相等。又如,k可以大于上文n。

61.另外,本技术实施例不限定步骤21的实施方式,例如,在一种可能的实施方式中,若样本语音的个数为g,则步骤21具体可以包括步骤31

‑

步骤32:

62.步骤31:获取第g个重叠系数和该第g个重叠系数对应的k个单人语音数据。其中,g为正整数,g≤g,g为正整数。

63.其中,第g个重叠系数是指对该第g个重叠系数对应的k个单人语音数据进行混合重叠时所需参考的语音数据重叠比例。例如,若k为2,且第g个重叠系数为80%,则可以将该

第g个重叠系数对应的第1个单人语音数据和该第g个重叠系数对应的第2个单人语音数据按照80%进行混合重叠,得到第g个样本语音,以使在该第g个样本语音中该第1个单人语音数据的80%在时间维度上与该第2个单人语音数据的80%处于重叠状态。

64.另外,本技术实施例不限定第g个重叠系数,例如,该第g个重叠系数可以预先设定。

65.第g个重叠系数对应的k个单人语音数据是指生成第g个样本语音时所需使用的单人语音数据。其中,上述“单人语音数据”只携带有一个说话人的语音信息,例如,第g个重叠系数对应的第k个单人语音数据只携带有该第g个重叠系数对应的第k个说话人的语音信息。其中,k为正整数,k≤k,k为正整数。

66.步骤32:按照第g个重叠系数,将该第g个重叠系数对应的k个单人语音数据进行混合叠加,得到第g个样本语音。其中,g为正整数,g≤g,g为正整数。

67.本技术实施例中,在获取到第g个重叠系数及其对应的k个单人语音数据之后,可以按照该第g个重叠系数将该k个单人语音数据进行混合叠加,得到第g个样本语音,以使该第g个样本语音包括该k个说话人的语音信息。其中,g为正整数,g≤g,g为正整数。

68.另外,为了提高语音分离模型的鲁棒性,步骤32具体可以包括:先按照第g个重叠系数,将该第g个重叠系数对应的k个单人语音数据进行混合叠加,得到该第g个重叠系数对应的混合语音;再按照第g个重叠系数对应的信噪比,将第g个重叠系数对应的混合语音与噪声进行混合,得到第g个样本语音。其中,第g个重叠系数对应的信噪比可以预先设定。

69.步骤33:将第g个重叠系数对应的第k个单人语音数据,确定为该第g个样本语音对应的第k个实际语音分离数据。其中,k为正整数,k≤k,k为正整数。

70.本技术实施例中,因第g个样本语音是由第g个重叠系数对应的k个单人语音数据混合得到的,故在获取到该k个单人语音数据之后,可以直接将第g个重叠系数对应的第k个单人语音数据,确定为该第g个样本语音对应的第k个实际语音分离数据,以使该第k个实际语音分离数据能够准确地表示出该第g个样本语音中第k个说话人的实际语音信息,以便后续能够利用该第k个实际语音分离数据指导待训练模型的训练过程。

71.基于上述步骤21的相关内容可知,为了能够更好地构建语音分离模型,可以利用一些预先收集的单人语音数据,生成g个样本语音和该g个样本语音对应的至少一个实际语音分离数据,以便后续能够基于这些数据针对待训练模型进行训练。

72.步骤22:将样本语音输入待训练模型,得到该待训练模型输出的该样本语音对应的至少一个预测语音分离数据。

73.其中,待训练模型用于针对该语音分离模型的输入数据进行语音分离(尤其是按照说话人进行语音分离)。

74.另外,本技术实施例不限定待训练模型的模型结构,例如,该待训练模型的模型结构可以采用上文“语音分离模型的模型结构”的任一实施方式进行实施,只需将上文“语音分离模型的模型结构”的任一实施方式中“语音分离模型”替换为“待训练模型”即可。

75.样本语音对应的至少一个预测语音分离数据用于表示该样本语音携带的至少一个说话人的预测语音信息。例如,若样本语音携带有k个说话人的语音信息,则该样本语音对应的第k个预测语音分离数据是指由该样本语音携带的第k个说话人的预测语音信息。其中,k为正整数,k≤k,k为正整数。

76.步骤23:根据样本语音对应的至少一个预测语音分离数据和该样本语音对应的至少一个实际语音分离数据,确定待训练模型的预测损失值。

77.其中,待训练模型的预测损失值用于表示该待训练模型的语音分离性能。

78.另外,本技术实施例不限定步骤23的实施方式,例如,在一种可能的实施方式中,步骤23具体可以包括步骤231

‑

步骤232:

79.步骤231:根据第g个样本语音对应的至少一个预测语音分离数据和该第g个样本语音对应的至少一个实际语音分离数据,确定该第g个样本语音对应的预测损失。其中,g为正整数,g≤g,g为正整数。

80.其中,第g个样本语音对应的预测损失用于表示待训练模型针对该第g个样本语音的语音分离性能。

81.另外,本技术实施例不限定步骤231的实施方式,例如,因上述“至少一个预测语音分离数据”与上述“至少一个实际语音分离数据”之间的对应关系是不知的,导致两者之间的差异性确定是比较困难的,故为了解决上述问题,本技术实施例还提供了步骤231的一种可能的实施方式,其具体可以包括步骤2311

‑

步骤2314:

82.步骤2311:确定第g个样本语音对应的t个候选数据对应关系。

83.其中,第g个样本语音对应的第t个候选数据对应关系用于描述第g个样本语音对应的k个实际语音分离数据与第g个样本语音对应的k个预测语音分离数据之间的对应关系;而且该第t个候选数据对应关系不同于该第g个样本语音对应的t个候选数据对应关系中除了该第t个候选数据对应关系以外的其他任一候选数据对应关系。t为正整数,t≤t,t为正整数。

84.另外,本技术实施例不限定t,例如,该t可以根据第g个样本语音对应的k个预测语音分离数据的排列组合个数(或者,第g个样本语音对应的k个实际语音分离数据的排列组合个数)确定。

85.此外,本技术实施例不限定步骤2311的实施方式,为了便于理解,下面结合两个示例进行说明。

86.示例1,步骤2311具体可以包括步骤41

‑

步骤42:

87.步骤41:对第g个样本语音对应的k个预测语音分离数据进行排列组合,得到该k个预测语音分离数据对应的t个排列组合顺序。

88.步骤42:按照上述k个预测语音分离数据对应的第t个排列组合顺序,分别将该k个预测语音分离数据与按照第一顺序排列的第g个样本语音对应的k个实际语音分离数据之间建立对应关系,得到该第g个样本语音对应的第t个候选数据对应关系(如公式(1)所示)。其中,“第一顺序”可以预先设定;t为正整数,t≤t,t为正整数。

[0089][0090]

式中,表示第g个样本语音对应的第t个候选数据对应关系;表示在上述k个预测语音分离数据对应的第t个排列组合顺序中位于第k个排列位置的预测语音分离数据,且表示在第一顺序排列中位于第k个排列位置的实际语音分离数据,k可以为1,2,3,

……

,k;表示与之间存在对应关系(也就是,与对应);表示

上述k个预测语音分离数据对应的第t个排列组合顺序中位于第k个排列位置。

[0091]

基于上述示例1的相关内容可知,在保持第g个样本语音对应的k个实际语音分离数据的排列顺序保持不变的情况下,可以将该第g个样本语音对应的k个预测语音分离数据按照不同排列组合顺序与该k个实际语音分离数据进行对应,得到第g个样本语音对应的t个候选数据对应关系,以使该t个候选数据对应关系能够覆盖该k个预测语音分离数据与该k个实际语音分离数据之间所可能存在的对应关系。

[0092]

示例2,步骤2311具体可以包括步骤51

‑

步骤52:

[0093]

步骤51:对第g个样本语音对应的k个实际语音分离数据进行排列组合,得到该k个实际语音分离数据对应的t个排列组合顺序。

[0094]

步骤52:按照上述k个实际语音分离数据对应的第t个排列组合顺序,将该k个实际语音分离数据与按照第二顺序排列的第g个样本语音对应的k个预测语音分离数据分别建立对应关系,得到该第g个样本语音对应的第t个候选数据对应关系(如公式(2)所示)。其中,“第二顺序”可以预先设定;t为正整数,t≤t,t为正整数。

[0095][0096]

式中,表示第g个样本语音对应的第t个候选数据对应关系;表示在上述k个实际语音分离数据对应的第t个排列组合顺序中位于第k个排列位置的实际语音分离数据,且表示在第二顺序排列中位于第k个排列位置的预测语音分离数据,k可以为1,2,3,

……

,k;表示与之间存在对应关系(也就是,与对应);表示上述k个实际语音分离数据对应的第t个排列组合顺序中位于第k个排列位置。

[0097]

基于上述示例2的相关内容可知,在保持第g个样本语音对应的k个预测语音分离数据的排列顺序保持不变的情况下,可以按照该第g个样本语音对应的k个实际语音分离数据按照不同排列组合顺序与该k个预测语音分离数据进行对应,得到第g个样本语音对应的t个候选数据对应关系,以使该t个候选数据对应关系能够覆盖该k个实际语音分离数据与该k个预测语音分离数据之间所可能存在的对应关系。

[0098]

基于上述步骤2311的相关内容可知,在获取到第g个样本语音对应的k个预测语音分离数据之后,可以遍历该k个预测语音分离数据与该第g个样本语音对应的k个实际语音分离数据之间的对应关系,得到该第g个样本语音对应的t个候选数据对应关系,以使该t个候选数据对应关系能够全面覆盖该k个预测语音分离数据与该k个实际语音分离数据之间所可能存在的对应关系,从而使得后续能够基于该t个候选数据对应关系,确定出在不同对应关系下该k个预测语音分离数据与该k个实际语音分离数据之间的差异性。

[0099]

步骤2312:根据第g个样本语音对应的第t个候选数据对应关系、该第g个样本语音对应的k个预测语音分离数据和该第g个样本语音对应的k个实际语音分离数据,确定该第g个样本语音对应的第t个数据匹配对集合。其中,t为正整数,t≤t。

[0100]

其中,第g个样本语音对应的第t个数据匹配对集合是指将该第g个样本语音对应的k个预测语音分离数据和该第g个样本语音对应的k个实际语音分离数据,按照该第g个样本语音对应的第t个候选数据对应关系进行数据对匹配得到的数据对集合。

[0101]

第g个样本语音对应的第t个数据匹配对集合包括k个数据匹配对。另外,本技术实施例不限定第g个样本语音对应的第t个数据匹配对集合的表示方式,例如,可以采用公式(3)进行表示。

[0102][0103]

式中,表示第g个样本语音对应的第t个数据匹配对集合;表示第g个样本语音对应的第t个数据匹配对集合中第k个数据匹配对;表示第g个样本语音对应的第t个候选数据对应关系中第k个对应关系所涉及的预测语音分离数据,且表示第g个样本语音对应的第t个候选数据对应关系中第k个对应关系所涉及的实际语音分离数据,k可以为1,2,3,

……

,k;表示第g个样本语音对应的第t个候选数据对应关系中第k个对应关系(例如,或者

[0104]

步骤2313:根据第g个样本语音对应的第t个数据匹配对集合中第1个数据匹配对之间的损失距离至第k个数据匹配对之间的损失距离,确定该第g个样本语音对应的第t个候选损失。其中,t为正整数,t≤t。

[0105]

其中,第g个样本语音对应的第t个候选损失用于描述按照该第g个样本语音对应的第t个候选数据对应关系计算得到的待训练模型针对该第g个样本语音的语音分离性能。

[0106]

另外,本技术实施例不限定步骤2313的实施方式,例如,其可以采用公式(4)进行实施。

[0107][0108]

式中,表示第g个样本语音对应的第t个候选损失;表示第g个样本语音对应的第t个数据匹配对集合中第k个数据匹配对之间的损失距离;表示第g个样本语音对应的第t个数据匹配对集合中第k个数据匹配对;表示该第k个数据匹配对中的预测语音分离数据,且表示该第k个数据匹配对中的实际语音分离数据,k可以为1,2,3,

……

,k。

[0109]

此外,本技术实施例不限定上文“损失距离”的计算过程,例如,可采用幅度不变信噪比(如公式(5)所示)进行实施。

[0110][0111]

式中,表示第g个样本语音对应的第t个数据匹配对集合中第k个数据匹配对之间的损失距离;表示该第k个数据匹配对中的预测语音分离数据,且

表示该第k个数据匹配对中的实际语音分离数据,k可以为1,2,3,

……

,k。

[0112]

步骤2314:将第g个样本语音对应的第1个候选损失至该第g个样本语音对应的第t个候选损失中最小值,确定为第g个样本语音对应的预测损失。

[0113]

本技术实施例中,在获取到第g个样本语音对应的第1个候选损失至该第g个样本语音对应的第t个候选损失之后,可以将该t个候选损失中最小值确定为该第g个样本语音对应的预测损失(如公式(6)所示)。

[0114][0115]

式中,loss

g

表示第g个样本语音对应的预测损失;表示第g个样本语音对应的第t个候选损失,t=1,2,3,

……

,t。

[0116]

基于上述步骤231的相关内容可知,在获取到第g个样本语音对应的至少一个预测语音分离数据之后,可以依据该至少一个预测语音分离数据与该第g个样本语音对应的至少一个实际语音分离数据之间的差异性,确定该第g个样本语音对应的预测损失,以使该预测损失能够准确地表示出待训练模型针对该第g个样本语音的语音分离性能,以便后续能够基于该第g个样本语音对应的预测损失,确定该待训练模型的预测损失值。其中,g为正整数,g≤g,g为正整数。

[0117]

步骤232:根据g个样本语音对应的预测损失之间的和值,确定待训练模型的预测损失值。

[0118]

本技术实施例中,在获取到第1个样本语音对应的预测损失至第g个样本语音对应的预测损失之后,可以参考该g个样本语音对应的预测损失之间的和值,确定待训练模型的预测损失值(例如,可以采用公式(7)确定该待训练模型的预测损失值)。

[0119][0120]

式中,loss

model

表示待训练模型的预测损失值;loss

g

表示第g个样本语音对应的预测损失。

[0121]

基于上述步骤23的相关内容可知,在获取到各个样本语音对应的至少一个预测语音分离数据之后,可以依据各个样本语音对应的至少一个预测语音分离数据与各个样本语音对应的至少一个实际语音分离数据之间的差异性,确定待训练模型的预测损失值,以使该预测损失值能够准确地表示出该待训练模型针对各个样本语音的语音分离性能,从而使得该预测损失值能够准确地表示出该待训练模型所达到的语音分离性能。

[0122]

步骤24:判断是否达到预设停止条件,若是,则执行步骤26;若否,则执行步骤25。

[0123]

其中,预设停止条件可以预先设定;而且本技术实施例不限定预设停止条件,例如,该预设停止条件可以为待训练模型的预测损失值低于预设损失阈值,也可以为该待训练模型的预测损失值的变化率低于预设变化率阈值(也就是,该待训练模型的语音分离性能达到收敛),还可以为该待训练模型的更新次数达到预设次数阈值。

[0124]

步骤25:根据待训练模型的预测损失值,更新待训练模型,并返回执行步骤22。

[0125]

本技术实施例中,在确定当前轮的待训练模型仍未达到预设停止条件之后,可以确定当前轮的待训练模型仍然具有较差的语音分离性能,故可以参考该待训练模型的预测损失值对该待训练模型进行更新,以使更新后的待训练模型具有更好的语音分离性能,并

利用更新后的待训练模型继续执行步骤22及其后续步骤。

[0126]

步骤26:根据待训练模型,确定语音分离模型。

[0127]

本技术实施例中,在确定当前轮的待训练模型达到预设停止条件之后,可以确定当前轮的待训练模型具有较好的语音分离性能,故可以根据当前轮的待训练模型确定语音分离模型(例如,可以直接将当前轮的待训练模型确定为语音分离模型。又如,可以根据当前轮的待训练模型的模型结构以及模型参数,确定语音分离模型的模型结构以及模型参数,以使该语音分离模型的模型结构以及模型参数分别与当前轮的待训练模型的模型结构以及模型参数保持一致),如此使得该语音分离模型的语音分离性能与当前轮的待训练模型的语音分离性能保持一致,从而使得该语音分离模型也具有较好的语音分离性能,以便后能够利用该语音分离模型针对该语音分离模型的输入数据进行较好地语音分离处理。

[0128]

基于上述语音分离模型的相关内容可知,预先构建好的语音分离模型具有较好的语音分离性能,使得该语音分离模型能够针对该语音分离模型的输入数据进行较好地语音分离处理,从而使得在将待分离语音数据输入该语音分离模型之后,该语音分离模型能够针对该待分离语音数据进行较好地语音分离处理,得到并输出该待分离语音数据对应的至少一个语音分离数据,以使该各个语音分离数据能够比较准确地表示出各个说话人的语音信息。

[0129]

基于上述s2的相关内容可知,若待分离语音数据包括n个说话人的语音信息,则在获取到该待分离语音数据之后,可以将该待分离语音数据输入已经构建好的语音分离模型,以使该语音分离模型针对该待分离语音数据进行语音分离,得到并输出该待分离语音数据对应的n个语音分离数据,以使该待分离语音数据对应的第n个语音分离数据能够准确地表示出由该待分离语音数据携带的第n个说话人的语音信息。其中,n为正整数,n≤n,n为正整数。

[0130]

s3:根据待分离语音数据对应的至少一个语音分离数据,确定该待分离语音数据的说话人分离结果。

[0131]

其中,待分离语音数据的说话人分离结果用于表示包括各个说话人的语音信息的语音片段。例如,若待分离语音数据可以包括n个说话人的语音信息,则该待分离语音数据的说话人分离结果可以包括用于记录第1个说话人的语音信息的语音片段、用于记录第2个说话人的语音信息的语音片段、

……

、用于记录第n个说话人的语音信息的语音片段。

[0132]

另外,本技术实施例不限定待分离语音数据的说话人分离结果的表示方式,例如,其可以采用图3所示的表示方式进行实施。

[0133]

此外,本技术实施例不限定s3的实施方式,例如,在一种可能的实施方式下,s3具体可以包括s31

‑

s33:

[0134]

s31:根据待分离语音数据对应的至少一个语音分离数据和预先训练好的语音活性检测模型,确定该至少一个语音分离数据的语音边界信息。

[0135]

其中,语音活性检测(voice activity detection,vad)模型用于针对该语音活性检测模型的输入数据进行语音边界识别(也就是,进行静音期识别)。

[0136]

另外,本技术实施例不限定语音活性检测模型,可以采用现有的或者未来出现的任一种语音活性检测模型进行实施。

[0137]

第n个语音分离数据的语音边界信息用于描述第n个说话人的语音信息在该第n个

语音分离数据中所处位置。其中,n为正整数,n≤n,n为正整数,n表示语音分离数据的个数。

[0138]

另外,本技术实施例不限定第n个语音分离数据的语音边界信息的确定过程,例如,在一种可能的实施方式中,其具体可以包括步骤61

‑

步骤63:

[0139]

步骤61:对第n个语音分离数据进行频谱特征提取,得到该第n个语音分离数据的频谱特征和该第n个语音分离数据对应的映射关系。其中,n为正整数,n≤n,n为正整数。

[0140]

本技术实施例不限定步骤61中“频谱特征提取”的实施方式,例如,可以采用傅里叶变换进行实施。

[0141]

第n个语音分离数据的频谱特征用于表示该第n个语音分离数据携带的语音信息。

[0142]

第n个语音分离数据对应的映射关系用于描述第n个语音分离数据中各帧音频数据与该第n个语音分离数据的频谱特征中各个数据特征之间的对应关系。例如,若第n个语音分离数据的频谱特征中第j个特征是由该第n个语音分离数据中第α

×

(j

‑

1) 1帧音频数据至第α

×

j帧音频数据进行傅里叶变换得到的,使得该第n个语音分离数据的频谱特征中第j个数据特征分别与该第n个语音分离数据中第α

×

(j

‑

1) 1帧音频数据至第α

×

j帧音频数据之间均具有对应关系。其中,α表示傅里叶变换时所使用的滑动窗口大小。

[0143]

步骤62:将第n个语音分离数据的频谱特征输入语音活性检测模型,得到该语音活性检测模型输出的该第n个语音分离数据对应的语音边界检测结果。

[0144]

其中,第n个语音分离数据对应的语音边界检测结果用于表示该第n个说话人的语音信息在该第n个语音分离数据的频谱特征中所处位置。

[0145]

可见,在获取到第n个语音分离数据的频谱特征之后,可以将该第n个语音分离数据的频谱特征输入语音活性检测模型,以使该语音活性检测模型能够针对该第n个语音分离数据的频谱特征进行语音边界识别(也就是,进行静音期识别),得到并输出该第n个语音分离数据对应的语音边界检测结果,以使该语音边界检测结果能够准确地表示该第n个说话人的语音信息在该第n个语音分离数据的频谱特征中所处位置,以便后续能够基于该语音边界检测结果确定该第n个语音分离数据的语音边界信息。

[0146]

步骤63:根据第n个语音分离数据对应的语音边界检测结果和该第n个语音分离数据对应的映射关,确定该第n个语音分离数据的语音边界信息。

[0147]

本技术实施例中,在获取到第n个语音分离数据对应的语音边界检测结果之后,可以将该第n个语音分离数据对应的语音边界检测结果按照该第n个语音分离数据对应的映射关映射回第n个语音分离数据,得到该第n个语音分离数据的语音边界信息,以使该语音边界信息能够准确地表示出该第n个说话人的语音信息在第n个语音分离数据中所处位置。

[0148]

基于上述s31的相关内容可知,若语音分离数据的个数为n,则在获取到待分离语音数据对应的第n个语音分离数据之后,可以借助语音活性检测模型确定该第n个语音分离数据的语音边界信息,以使该语音边界信息能够准确地表示出该第n个说话人的语音信息在该第n个语音分离数据中所处位置。其中,n为正整数,n≤n,n为正整数。

[0149]

s32:分别按照各个语音分离数据的语音边界信息对各个语音分离数据进行说话人标注,得到各个语音分离数据的说话人标注结果。

[0150]

其中,第n个语音分离数据的说话人标注结果用于表示该第n个语音分离数据中各帧音频数据是否包括第n个说话人的语音信息。其中,n为正整数,n≤n,n为正整数,n表示语音分离数据的个数。

[0151]

另外,本技术实施例不限定第n个语音分离数据的说话人标注结果的确定过程,例如,在一种可能的实施方式中,其具体可以包括步骤71

‑

步骤73:

[0152]

步骤71:按照第n个语音分离数据的语音边界信息,对该第n个语音分离数据进行语音边界标注,得到该第n个语音分离数据的语音边界标注结果。

[0153]

其中,第n个语音分离数据的语音边界标注结果用于表示该第n个语音分离数据中各帧音频数据是否携带有语音信息。

[0154]

另外,本技术实施例不限定第n个语音分离数据的语音边界标注结果,例如,若第n个语音分离数据包括m帧音频数据,则该第n个语音分离数据的语音边界标注结果可以包括该第n个语音分离数据中第1帧音频数据的语音边界标注结果、该第n个语音分离数据中第2帧音频数据的语音边界标注结果、

……

、和该第n个语音分离数据中第m帧音频数据的语音边界标注结果。其中,m为正整数。

[0155]

此外,本技术实施例不限定第n个语音分离数据中第m帧音频数据的语音边界标注结果的确定过程,例如,在一种可能的实施方式下,其具体可以包括步骤81

‑

步骤82:

[0156]

步骤81:若第n个语音分离数据的语音边界信息表示该第n个语音分离数据中第m帧音频数据携带有语音信息,则可以将该第n个语音分离数据中第m帧音频数据的语音边界标注结果确定为第一标识(如,1)。其中,m为正整数,m≤m。

[0157]

步骤82:若第n个语音分离数据的语音边界信息表示该第n个语音分离数据中第m帧音频数据没携带语音信息,则可以将该第n个语音分离数据中第m帧音频数据的语音边界标注结果确定为第二标识(如,0)。其中,m为正整数,m≤m。

[0158]

基于上述步骤71的相关内容可知,在获取到第n个语音分离数据的语音边界信息之后,可以根据该语音边界信息中所记录的第n个说话人的语音信息在该第n个语音分离数据中所处位置,判断该第n个语音分离数据中各帧音频数据是否携带有语音信息;并基于这些判断结果生成该第n个语音分离数据的语音边界标注结果,以使该语音边界标注结果准确地表示出该第n个语音分离数据中各帧音频数据是否携带有语音信息。

[0159]

步骤72:确定第n个语音分离数据对应的说话人标识,以使该第n个语音分离数据对应的说话人标识不同于n个语音分离数据中除了该第n个语音分离数据以外其他任一语音分离数据对应的说话人标识。

[0160]

其中,第n个语音分离数据对应的说话人标识用于唯一标识该第n个语音分离数据所携带语音信息的说话人(例如,第n个说话人)。

[0161]

步骤73:根据第n个语音分离数据的语音边界标注结果和该第n个语音分离数据的对应的说话人标识,确定该第n个语音分离数据的说话人标注结果。

[0162]

本技术实施例不限定第n个语音分离数据的说话人标注结果,例如,若第n个语音分离数据包括m帧音频数据,则该第n个语音分离数据的说话人标注结果可以包括该第n个语音分离数据中第1帧音频数据的说话人标注结果至该第n个语音分离数据中第m帧音频数据的说话人标注结果。其中,m为正整数。

[0163]

另外,本技术实施例不限定第n个语音分离数据中第m帧音频数据的说话人标注结果的确定过程,例如,其具体可以包括步骤91

‑

步骤92:

[0164]

步骤91:若第n个语音分离数据中第m帧音频数据的语音边界标注结果满足预设标注条件,则将该第n个语音分离数据的对应的说话人标识,确定为该第n个语音分离数据中

第m帧音频数据的说话人标注结果。其中,m为正整数,m≤m。

[0165]

其中,预设标注条件可以预先设定,例如,若“第一标识”用于表示携带有语音信息,且“第二标识”用于表示没有携带有语音信息,则该预设标注条件可以为属于“第一标识”。

[0166]

可见,若第n个语音分离数据中第m帧音频数据的语音边界标注结果为“第一标识”,则可以确定该第m帧音频数据的语音边界标注结果满足预设标注条件;若该第m帧音频数据的语音边界标注结果为“第二标识”,则可以确定该第m帧音频数据的语音边界标注结果不满足预设标注条件。

[0167]

步骤92:若第n个语音分离数据中第m帧音频数据的语音边界标注结果不满足预设标注条件,则将该第n个语音分离数据中第m帧音频数据的语音边界标注结果,确定为该第n个语音分离数据中第m帧音频数据的说话人标注结果。其中,m为正整数,m≤m。

[0168]

基于上述步骤91至步骤92的相关内容可知,在获取到第n个语音分离数据中第m帧音频数据的语音边界标注结果之后,可以判断该语音边界标注结果是否满足预设标注条件,若确定满足预设标注条件,则可以确定该第m帧音频数据携带有语音信息(如,第n个说话人的语音信息),故可以利用该第n个语音分离数据的对应的说话人标识(例如,第n个说话人的标识),设定该第m帧音频数据的说话人标注结果,以使该说话人标注结果能够表示出该第n个语音分离数据中第m帧音频数据所携带的语音信息的说话人为第n个说话人;若确定不满足预设标注条件,则可以确定该第n个语音分离数据中第m帧音频数据没有携带语音信息,故可以利用该第m帧音频数据的语音边界标注结果,设定该第n个语音分离数据中第m帧音频数据的说话人标注结果,以使该说话人标注结果能够表示出该第n个语音分离数据中第m帧音频数据没有携带语音信息(尤其是,没有携带第n个说话人的语音信息)。

[0169]

基于上述s32的相关内容可知,若语音分离数据的个数为n,则在获取到第n个语音分离数据的语音边界信息之后,可以对该第n个语音分离数据的语音边界信息进行说话人标注,得到该第n个语音分离数据的说话人标注结果,以使该说话人标注结果能够准确地表示出该第n个语音分离数据中各帧音频数据是否包括第n个说话人的语音信息,以便后续能够基于该说话人标注结果确定出该用于表示该第n个说话人的语音信息的语音片段。

[0170]

s33:根据至少一个语音分离数据的说话人标注结果,确定待分离语音数据的说话人分离结果。

[0171]

作为示例,若语音分离数据的个数为n,则s33的相关内容可以包括:将n个语音分离数据的说话人标注结果按照预设合并方式(例如,可以采用图3所示的时间对齐方式)进行合并,得到待分离语音数据的说话人分离结果。

[0172]

基于上述s1至s3的相关内容可知,对于本技术实施例提供的说话人分离方法来说,在获取到包括至少一个说话人的语音信息的待分离语音数据之后,可以先将该待分离语音数据输入预先构建的语音分离模型,得到该语音分离模型输出的至少一个语音分离数据,以使各个语音分离数据所携带语音信息的说话人不同(也就是,不同语音分离数据用于记录不同说话人的语音信息);再根据该至少一个语音分离数据,确定该待分离语音数据的说话人分离结果,以使该说话人分离结果能够准确地表示出该待分离语音数据中每一个说话人对应的语音片段。

[0173]

其中,因语音分离模型能够准确地按照说话人进行语音分离,使得由该语音分离

模型针对待分离语音数据输出的各个语音分离数据分别能够准确且全面地表示出各个说话人的语音信息,从而使得基于该各个语音分离数据确定的说话人分离结果能够准确且全面地表示该待分离语音数据中每一个说话人对应的语音片段,如此能够有效地避免因无法准确地识别出重叠音频数据对应的多个说话人而导致的不良影响,从而能够有效地提高说话人分离准确性。

[0174]

方法实施例二

[0175]

另外,为了进一步提高说话人分离准确性,本技术实施例还提供了说话人分离方法的另一种可能的实施方式,在该实施方式中,该说话人分离方法除了包括上述s1

‑

s2以外,还包括s4

‑

s7:

[0176]

s4:对待分离语音数据进行频谱特征提取,得到该待分离语音数据的频谱特征。

[0177]

其中,待分离语音数据的频谱特征用于表示该待分离语音数据携带的语音信息。

[0178]

另外,本技术实施例不限定s4的实施方式,例如,其可以采用上文“第n个语音分离数据的频谱特征”的确定过程的任一实施方式进行实施,只需将上文“第n个语音分离数据的频谱特征”的确定过程的任一实施方式中“第n个语音分离数据”替换为“待分离语音数据”即可。

[0179]

s5:根据待分离语音数据的频谱特征和预先训练好的语音活性检测模型,确定待分离语音数据对应的至少一个频谱特征切片。

[0180]

其中,待分离语音数据对应的各个频谱特征切片均用于表示持续语音信息,以使该待分离语音数据对应的各个频谱特征切片均不包括该待分离语音数据中静音期的频谱特征。

[0181]

另外,本技术实施例不限定s5的实施方式,例如,在一种可能的实施方式中,s5具体可以包括s51

‑

s52:

[0182]

s51:将待分离语音数据的频谱特征输入语音活性检测模型,得到该语音活性检测模型输出的该待分离语音数据的语音边界检测结果。

[0183]

其中,待分离语音数据的语音边界检测结果用于表示该待分离语音数据所携带的语音信息在该待分离语音数据的频谱特征中所处位置。

[0184]

另外,本技术实施例不限定s51的实施方式,例如,其可以采用上文步骤62的任一实施方式进行实施,只需将上文步骤62的任一实施方式中“第n个语音分离数据”替换为“待分离语音数据”即可。

[0185]

s52:根据待分离语音数据的语音边界检测结果,对该待分离语音数据的频谱特征进行切分,得到该待分离语音数据对应的至少一个频谱特征切片。

[0186]

本技术实施例中,在获取到待分离语音数据的语音边界检测结果之后,可以按照该语音边界检测结果所表示的语音信息在该待分离语音数据的频谱特征中所处位置,对该待分离语音数据的频谱特征进行切分,得到该待分离语音数据对应的至少一个频谱特征切片,以使各个频谱特征切片分别能够表示出该待分离语音数据中各段持续语音信息。

[0187]

基于上述s5的相关内容可知,在获取到待分离语音数据的频谱特征之后,可以依次通过语音边界检测处理和语音特征切片处理,得到该待分离语音数据对应的至少一个频谱特征切片,以使各个频谱特征切片分别能够表示出该待分离语音数据中各段持续语音信息。

[0188]

s6:根据待分离语音数据对应的至少一个频谱特征切片,确定该待分离语音数据对应的说话人分离参考结果。

[0189]

其中,待分离语音数据对应的说话人分离参考结果用于表示包括各个说话人的语音信息的语音片段。

[0190]

另外,本技术实施例不限定s6,例如,在一种可能的实施方式中,s6具体可以包括s61

‑

s65:

[0191]

s61:将待分离语音数据对应的至少一个频谱特征切片输入预先训练好的声纹模型,得到该声纹模型输出该待分离语音数据对应的至少一个声纹特征。

[0192]

其中,声纹模型用于针对该声纹模型的输入数据进行声纹特征提取;而且本技术实施例不限定声纹模型,可以采用现有的或者未来出现的任一种声纹模型(如,基于生成式模型的i

‑

vector模型、基于神经网络有监督训练的声纹模型、x

‑

vector模型等)进行实施。

[0193]

待分离语音数据对应的第y个声纹特征是由声纹模型针对该待分离语音数据对应的第y个频谱特征切片进行声纹特征提取得到的,以使该第y个声纹特征能够准确地表示出该第y个频谱特征切片所携带的声纹信息。其中,y为正整数,y≤y,y为正整数,y表示声纹特征的个数(也就是,频谱特征切片的个数)。

[0194]

s62:将待分离语音数据对应的至少一个声纹特征进行聚类处理,得到该待分离语音数据对应的至少一个声纹特征的类别标签。

[0195]

本技术实施例中,若声纹特征个数为y,则在获取到待分离语音数据对应的第1个声纹特征至该待分离语音数据对应的第y个声纹特征之后,针对该y个声纹特征进行聚类处理,得到各个声纹特征的类别标签(也就是,待分离语音数据对应的第1个声纹特征的类别标签至该待分离语音数据对应的第y个声纹特征的类别标签)。其中,y为正整数,y≤y,y为正整数。

[0196]

需要说明的是,本技术实施例不限定s62中“聚类处理”的实施方式,可以采用现有的或者未来出现的任一种聚类算法(如,层次聚类算法等)进行实施。

[0197]

s64:根据待分离语音数据对应的至少一个声纹特征的频谱位置信息和该待分离语音数据对应的至少一个声纹特征的类别标签,确定该待分离语音数据的频谱特征对应的类别标签序列。

[0198]

其中,待分离语音数据对应的第y个声纹特征的频谱位置信息用于描述该待分离语音数据对应的第y个频谱特征切片在该待分离语音数据的频谱特征中所处位置。其中,y为正整数,y≤y,y为正整数,y表示声纹特征的个数。

[0199]

待分离语音数据的频谱特征对应的类别标签序列用于描述该待分离语音数据的频谱特征中各个特征的类别标签。

[0200]

基于上述s64的相关内容可知,在获取到待分离语音数据对应的y个声纹特征的类别标签之后,可以按照该待分离语音数据对应的第1个声纹特征的频谱位置信息,将该待分离语音数据对应的第1个声纹特征的类别标签添加至该待分离语音数据的频谱特征上;按照该待分离语音数据对应的第2个声纹特征的频谱位置信息,将该待分离语音数据对应的第2个声纹特征的类别标签添加至该待分离语音数据的频谱特征上;

……

(以此类推);按照该待分离语音数据对应的第y个声纹特征的频谱位置信息,将该待分离语音数据对应的第y个声纹特征的类别标签添加至该待分离语音数据的频谱特征上,如此能够得到该待分离语

音数据的频谱特征对应的类别标签序列,以使该类别标签序列能够准确地表示出该待分离语音数据的频谱特征中各个特征的类别标签。

[0201]

s65:根据待分离语音数据的频谱特征对应的类别标签序列、以及该待分离语音数据对应的映射关系,确定该待分离语音数据对应的说话人标注序列。

[0202]

其中,待分离语音数据对应的映射关系用于描述该待分离语音数据中每帧音频数据与该待分离语音数据的频谱特征中各个数据特征之间的对应关系。

[0203]

需要说明的是,待分离语音数据对应的映射关系类似于上文“第n个语音分离数据对应的映射关系”,详情请参见上文。

[0204]

待分离语音数据对应的说话人标注序列用于表示该待分离语音数据中每帧音频数据的类别标签。

[0205]

基于上述s65的相关内容可知,在获取到待分离语音数据的频谱特征对应的类别标签序列之后,可以将该类别标签序列按照待分离语音数据对应的映射关系映射回该待分离语音数据,得到该待分离语音数据对应的说话人标注序列,以使该说话人标注序列能够准确地表示出待分离语音数据中每帧音频数据的类别标签。

[0206]

s66:按照待分离语音数据对应的说话人标注序列,确定该待分离语音数据对应的说话人分离参考结果。

[0207]

本技术实施例中,在获取到待分离语音数据对应的说话人标注序列之后,可以根据该说话人标注序列确定该待分离语音数据对应的说话人分离参考结果(例如,将具有第q个类别标签的所有帧音频数据进行组合,得到第q个说话人的语音片段,以使该第q个说话人的语音片段只包括第q个说话人的语音信息;q为正整数,q≤q,q为正整数,q表示类别标签种类数(也就是,聚类结果中类别个数)),以使该说话人分离参考结果能够准确地表示出包括各个说话人的语音信息的语音片段(如,第1个说话人的语音片段、第2个说话人的语音片段、

……

、第q个说话人的语音片段)。

[0208]

基于上述s6的相关内容可知,在获取到待分离语音数据对应的至少一个频谱特征切片之后,可以参考这些频谱特征切片确定待分离语音数据对应的说话人分离参考结果,以使该说话人分离参考结果能够表示出包括各个说话人的语音信息的语音片段。

[0209]

s7:根据待分离语音数据对应的至少一个语音分离数据和该待分离语音数据对应的说话人分离参考结果,确定该待分离语音数据的说话人分离结果。

[0210]

作为示例,s7具体可以包括s71

‑

s74:

[0211]

s71:根据待分离语音数据对应的至少一个语音分离数据,确定该待分离语音数据对应的说话人分离候选结果。

[0212]

其中,待分离语音数据对应的说话人分离候选结果于表示包括各个说话人的语音信息的语音片段。

[0213]

另外,本技术实施例不限定s71的实施方式,例如,可以采用上文s3的任一实施方式进行实施,只需将上文s3的任一实施方式中“待分离语音数据的说话人分离结果”替换为“待分离语音数据对应的说话人分离候选结果”即可。

[0214]

s72:根据待分离语音数据对应的说话人分离候选结果和该待分离语音数据对应的说话人分离参考结果,确定该说话人分离候选结果的分离错误表征值。

[0215]

其中,“说话人分离候选结果的分离错误表征值”用于表示该待分离语音数据对应

的说话人分离候选结果发生错误的可能性(也就是,不可信程度或者不被使用的可能性)。

[0216]

另外,本技术实施例不限定s72的实施方式,例如,因上述“说话人分离候选结果”与上述“说话人分离参考结果”之间的对应关系是不知的,导致两者之间的差异性确定是比较困难的,故为了解决上述问题,本技术实施例还提供了s72的一种可能的实施方式,其具体可以包括s721

‑

s724:

[0217]

s721:确定待分离语音数据对应的h个候选标识对应关系。

[0218]

其中,待分离语音数据对应的第h个候选标识对应关系用于描述该待分离语音数据对应的说话人分离候选结果中至少一个说话人标识与该待分离语音数据对应的说话人分离参考结果中至少一个说话人标识之间的对应关系;而且该第h个候选标识对应关系不同于该待分离语音数据对应的h个候选标识对应关系中除了该第h个候选标识对应关系以外的其他任一候选标识对应关系。h为正整数,h≤h,h为正整数。

[0219]

另外,本技术实施例不限定h,例如,该h可以根据待分离语音数据对应的说话人分离候选结果中至少一个说话人标识的排列组合个数(或者,待分离语音数据对应的说话人分离参考结果中至少一个说话人标识的排列组合个数)确定。

[0220]

此外,本技术实施例不限定步骤s721的实施方式,为了便于理解,下面结合两个示例进行说明。

[0221]

示例1,若待分离语音数据对应的说话人分离候选结果所涉及的说话人标识的个数为v,且待分离语音数据对应的说话人分离参考结果所涉及的说话人标识的个数为v,则步骤s721具体可以包括步骤101

‑

步骤102:

[0222]

步骤101:对待分离语音数据对应的说话人分离候选结果所涉及的v个说话人标识进行排列组合,得到该说话人分离候选结果对应的h个排列组合顺序。

[0223]

步骤102:按照上述说话人分离候选结果对应的第h个排列组合顺序,分别将待分离语音数据对应的说话人分离候选结果所涉及的v个说话人标识与按照第三顺序排列的该待分离语音数据对应的说话人分离参考结果所涉及的v个说话人标识之间建立对应关系,得到该待分离语音数据对应的第h个候选标识对应关系。其中,“第三顺序”可以预先设定;h为正整数,h≤h,h为正整数。

[0224]

需要说明的是,步骤102的实施方式类似于上文步骤42的实施方式。

[0225]

基于上述示例1的相关内容可知,在保持说话人分离参考结果所涉及的v个说话人标识的排列顺序保持不变的情况下,可以将说话人分离候选结果所涉及的v个说话人标识按照不同排列组合顺序与该说话人分离参考结果所涉及的v个说话人标识进行对应,得到该待分离语音数据对应的h个候选标识对应关系,以使该h个候选标识对应关系能够覆盖该说话人分离候选结果所涉及的v个说话人标识与该说话人分离参考结果所涉及的v个说话人标识之间所可能存在的对应关系。

[0226]

示例2,若待分离语音数据对应的说话人分离候选结果所涉及的说话人标识的个数为v,且待分离语音数据对应的说话人分离参考结果所涉及的说话人标识的个数为v,则步骤s721具体可以包括步骤103

‑

步骤104:

[0227]

步骤103:对待分离语音数据对应的说话人分离参考结果所涉及的v个说话人标识进行排列组合,得到该说话人分离参考结果对应的h个排列组合顺序。

[0228]

步骤104:按照上述说话人分离参考结果对应的第h个排列组合顺序,分别将待分

离语音数据对应的说话人分离参考结果所涉及的v个说话人标识与按照第四顺序排列的该待分离语音数据对应的说话人分离候选结果所涉及的v个说话人标识之间建立对应关系,得到该待分离语音数据对应的第h个候选标识对应关系。其中,“第四顺序”可以预先设定;h为正整数,h≤h,h为正整数。

[0229]

需要说明的是,步骤104的实施方式类似于上文步骤42的实施方式。

[0230]

基于上述示例2的相关内容可知,在保持说话人分离候选结果所涉及的v个说话人标识的排列顺序保持不变的情况下,可以将说话人分离参考结果所涉及的v个说话人标识按照不同排列组合顺序与该说话人分离候选结果所涉及的v个说话人标识进行对应,得到该待分离语音数据对应的h个候选标识对应关系,以使该h个候选标识对应关系能够覆盖该说话人分离参考结果所涉及的v个说话人标识与该说话人分离候选结果所涉及的v个说话人标识之间所可能存在的对应关系。

[0231]

基于上述s721的相关内容可知,在获取到说话人分离候选结果以及说话人分离参考结果之后,可以遍历该该说话人分离参考结果所涉及的v个说话人标识与该说话人分离候选结果所涉及的v个说话人标识之间所可能存在的对应关系,得到该待分离语音数据对应的h个候选标识对应关系,以便后续能够基于该h个候选标识对应关系分析该说话人分离候选结果以及该说话人分离参考结果之间的差异性。

[0232]

s722:根据待分离语音数据对应的第h个候选标识对应关系、该待分离语音数据对应的说话人分离候选结果和该待分离语音数据对应的说话人分离参考结果,确定待分离语音数据对应的第h个匹配语音段集合。其中,h为正整数,h≤h。

[0233]

其中,待分离语音数据对应的第h个匹配语音段集合是指将说话人分离候选结果和说话人分离参考结果按照上述第h个候选标识对应关系进行音频数据匹配得到的。

[0234]

另外,本技术实施例不限定“待分离语音数据对应的第h个匹配语音段集合”,例如,若该第h个匹配语音段集合包括f个匹配语音段,则该第h个匹配语音段集合中第f个匹配语音段中各帧音频数据在上述“说话人分离候选结果”中具有相同的说话人标识,且该第h个匹配语音段集合中第f个匹配语音段中各帧音频数据在上述“说话人分离参考结果”中也具有相同的说话人标识,且该第h个匹配语音段集合中第f个匹配语音段在上述“说话人分离候选结果”中所涉及的至少一个说话人标识与该第h个匹配语音段集合中第f个匹配语音段在上述“说话人分离参考结果”中所涉及的说话人标识之间满足上述第h个候选标识对应关系中所记录的说话人标识对应关系。

[0235]

s723:根据待分离语音数据对应的第h个匹配语音段集合,确定该待分离语音数据对应的第h个候选错误表征值。其中,h为正整数,h≤h。

[0236]

其中,待分离语音数据对应的第h个候选错误表征值用于描述按照该上述第h个候选标识对应关系计算得到的该待分离语音数据对应的说话人分离候选结果发生错误的可能性(也就是,不可信程度或者不被使用的可能性)。

[0237]

另外,本技术实施例不限定s723的实施方式,例如,在一种可能的实施方式中,s723具体可以包括s7231

‑

s7232:

[0238]

s7231:根据待分离语音数据对应的第h个语音段集合中第f个匹配语音段、该待分离语音数据对应的说话人分离候选结果、该待分离语音数据对应的说话人分离参考结果、和该待分离语音数据对应的第h个候选标识对应关系,确定该第h个语音段集合中第f个匹

配语音段对应的错误表征值。其中,f为正整数,f≤f,f为正整数。

[0239]

其中,“第h个语音段集合中第f个匹配语音段对应的错误表征值”用于表示说话人分离候选结果针对该第h个语音段集合中第f个匹配语音段发生错误的可能性。

[0240]

另外,本技术实施例不限定s7231的实施方式,例如,在一种可能的实施方式中,s7231具体可以包括步骤111

‑

步骤114:

[0241]

步骤111:根据待分离语音数据对应的说话人分离候选结果,确定第h个语音段集合中第f个匹配语音段对应的第一说话人标识和该第h个语音段集合中第f个匹配语音段对应的第一说话人个数。

[0242]

其中,“第h个语音段集合中第f个匹配语音段对应的第一说话人标识”是指该第f个匹配语音段中各帧音频数据在上述“说话人分离候选结果”中所具有的相同说话人标识。

[0243]“第h个语音段集合中第f个匹配语音段对应的第一说话人个数”是指该第f个匹配语音段中各帧音频数据在上述“说话人分离候选结果”中所具有的相同说话人标识的个数;而且,本技术实施例不限定“第h个语音段集合中第f个匹配语音段对应的第一说话人个数”,例如,其具体可以为1,2,

……

,或者n。

[0244]

步骤112:根据待分离语音数据对应的说话人分离参考结果,确定第h个语音段集合中第f个匹配语音段对应的第二说话人标识和该第h个语音段集合中第f个匹配语音段对应的第二说话人个数。

[0245]

其中,“第h个语音段集合中第f个匹配语音段对应的第二说话人标识”是指该第f个匹配语音段中各帧音频数据在上述“说话人分离参考结果”中所具有的相同说话人标识。

[0246]“第h个语音段集合中第f个匹配语音段对应的第二说话人个数”是指该第f个匹配语音段中各帧音频数据在上述“说话人分离参考结果”中所具有的相同说话人标识的个数;而且,本技术实施例不限定“第h个语音段集合中第f个匹配语音段对应的第二说话人个数”,例如,其具体可以为1。

[0247]

步骤113:根据待分离语音数据对应的第h个候选标识对应关系、第h个语音段集合中第f个匹配语音段对应的第一说话人标识、和该第h个语音段集合中第f个匹配语音段对应的第二说话人标识,确定该第h个语音段集合中第f个匹配语音段对应的说话人匹配个数。

[0248]

其中,“第h个语音段集合中第f个匹配语音段对应的说话人匹配个数”是指“第h个语音段集合中第f个匹配语音段对应的第一说话人标识”与“第h个语音段集合中第f个匹配语音段对应的第二说话人标识”之间满足上述“第h个候选标识对应关系”的说话人标识对个数。

[0249]

例如,若“第h个语音段集合中第f个匹配语音段对应的第一说话人标识”包括标识a和标识b,“第h个语音段集合中第f个匹配语音段对应的第二说话人标识”包括标识c,且上述“第h个候选标识对应关系”包括标识a与标识c之间的对应关系,则该“第h个语音段集合中第f个匹配语音段对应的说话人匹配个数”为1。

[0250]

步骤114:根据第h个语音段集合中第f个匹配语音段对应的第一说话人个数、该第h个语音段集合中第f个匹配语音段对应的第二说话人个数、该第h个语音段集合中第f个匹配语音段对应的说话人匹配个数、和该第h个语音段集合中第f个匹配语音段的时长,确定该第h个语音段集合中第f个匹配语音段对应的错误表征值(如公式(8)所示)。

[0251][0252]

式中,表示第h个语音段集合中第f个匹配语音段对应的错误表征值;表示第h个语音段集合中第f个匹配语音段;表示第h个语音段集合中第f个匹配语音段的时长;表示第h个语音段集合中第f个匹配语音段对应的第二说话人个数;表示第h个语音段集合中第f个匹配语音段对应的第一说话人个数;表示第h个语音段集合中第f个匹配语音段对应的说话人匹配个数。

[0253]

基于上述s7231的相关内容可知,在获取到待分离语音数据对应的第h个语音段集合中第f个匹配语音段之后,可以参考说话人分离候选结果在该第f个匹配语音段上的说话人标识、与说话人分离参考结果在该第f个匹配语音段上的说话人标识之间的差异性,确定该第h个语音段集合中第f个匹配语音段对应的错误表征值,以使该错误表征值能够准确地表示出该说话人分离候选结果针对该第h个语音段集合中第f个匹配语音段发生错误的可能性。其中,f为正整数,f≤f,f为正整数。

[0254]

s7232:根据第h个语音段集合中第1个匹配语音段对应的错误表征值至该第h个语音段集合中第f个匹配语音段对应的错误表征值之间的和值,确定待分离语音数据对应的第h个候选表征值(如公式(9)所示)。

[0255][0256]

式中,error

h

表示待分离语音数据对应的第h个候选表征值;表示第h个语音段集合中第f个匹配语音段对应的错误表征值;表示第h个语音段集合中第f个匹配语音段;表示第h个语音段集合中第f个匹配语音段的时长;表示第h个语音段集合中第f个匹配语音段对应的第二说话人个数。

[0257]

基于上述s723的相关内容可知,在获取到待分离语音数据对应的第h个匹配语音段集合之后,可以参考说话人分离候选结果以及说话人分离参考结果在该第h个匹配语音段集合上所呈现的差异性,确定该待分离语音数据对应的第h个候选错误表征值,以使该第h个候选错误表征值能够准确地表示出该说话人分离候选结果按照该待分离语音数据对应的第h个候选标识对应关系所呈现的错误发生可能性(也就是,不可信程度或者不被使用可能性)。其中,h为正整数,h≤h。

[0258]

s724:将待分离语音数据对应的第1个候选错误表征值至该待分离语音数据对应的第h个候选错误表征值中最小值,确定为说话人分离候选结果的分离错误表征值(如公式(10)所示)。

[0259]

error

sd

=min(error1,error2,

…

,error

h

)

ꢀꢀꢀ

(10)

[0260]

式中,error

sd

表示说话人分离候选结果的分离错误表征值;error

h

表示待分离语音数据对应的第h个候选表征值,h=1,2,3,

……

,h。

[0261]

基于上述s72的相关内容可知,在获取到待分离语音数据对应的说话人分离候选结果以及说话人分离参考结果之后,可以根据该说话人分离候选结果与说话人分离参考结

果之间的差异性,确定该说话人分离候选结果的分离错误表征值,以使该分离错误表征值能够准确地表示出该说话人分离候选结果发生错误的可能性(也就是,不可信程度或者不被使用的可能性)。

[0262]

s73:若说话人分离候选结果的分离错误表征值低于预设错误阈值,则将待分离语音数据对应的说话人分离候选结果,确定为该待分离语音数据的说话人分离结果。

[0263]

其中,预设错误阈值可以预先设定。

[0264]

可见,在获取到说话人分离候选结果的分离错误表征值之后,若确定该分离错误表征值低于预设错误阈值,则表示该说话人分离候选结果发生错误的可能性比较小,从而可以表示该说话人分离候选结果的可信程度比较高,故可以直接将该说话人分离候选结果,确定为待分离语音数据的说话人分离结果,以使该说话人分离结果能够准确地表示出该待分离语音数据中每一个说话人对应的语音片段。

[0265]

s74:若说话人分离候选结果的分离错误表征值不低于预设错误阈值,则将待分离语音数据对应的说话人分离参考结果,确定为该待分离语音数据的说话人分离结果。

[0266]

本技术实施例中,在获取到说话人分离候选结果的分离错误表征值之后,若确定该分离错误表征值不低于预设错误阈值,则表示该说话人分离候选结果发生错误的可能性比较大,从而可以表示该说话人分离候选结果的可信程度比较低,故可以直接将待分离语音数据对应的说话人分离参考结果,确定为该待分离语音数据的说话人分离结果,以使该说话人分离结果能够准确地表示出该待分离语音数据中每一个说话人对应的语音片段。

[0267]

基于上述s4至s7的相关内容可知,在获取到待分离语音数据之后,可以先采用两种说话人分离方案针对该待分离语音数据进行说话人分离处理,得到该待分离语音数据对应的两种说话人分离结果;再从该两种说话人分离结果中筛选出较优的说话人分离结果,确定为最终的说话人分离结果,以使该说话人分离结果能够更准确地表示出该待分离语音数据中每一个说话人对应的语音片段,如此有利于提高说话人分离准确性。

[0268]

基于上述方法实施例提供的说话人分离方法,本技术实施例还提供了一种说话人分离装置,下面结合附图进行解释和说明。

[0269]

装置实施例

[0270]

装置实施例对说话人分离装置进行介绍,相关内容请参见上述方法实施例。

[0271]

参见图4,该图为本技术实施例提供的一种说话人分离装置的结构示意图。

[0272]

本技术实施例提供的说话人分离装置400,包括:

[0273]

语音获取单元401,用于获取待分离语音数据;其中,所述待分离语音数据包括至少一个说话人的语音信息;

[0274]

语音分离单元402,用于将所述待分离语音数据输入预先构建的语音分离模型,得到所述语音分离模型输出的至少一个语音分离数据,以使各个语音分离数据所携带语音信息的说话人不同;

[0275]

说话人分离单元403,用于根据所述至少一个语音分离数据,确定所述待分离语音数据的说话人分离结果。

[0276]

在一种可能的实施方式中,所述说话人分离单元403,包括:

[0277]

第一确定子单元,用于根据所述至少一个语音分离数据和预先训练好的语音活性检测模型,确定所述至少一个语音分离数据的语音边界信息;

[0278]

第二确定子单元,用于分别按照各个语音分离数据的语音边界信息对各个语音分离数据进行说话人标注,得到各个语音分离数据的说话人标注结果;

[0279]

第三确定子单元,用于根据所述至少一个语音分离数据的说话人标注结果,确定所述待分离语音数据的说话人分离结果。

[0280]

在一种可能的实施方式中,所述第一确定子单元,具体用于:若所述语音分离数据的个数为n,则对所述第n个语音分离数据进行频谱特征提取,得到所述第n个语音分离数据的频谱特征和所述第n个语音分离数据对应的映射关系;其中,所述第n个语音分离数据对应的映射关系用于描述所述第n个语音分离数据中各帧音频数据与所述第n个语音分离数据的频谱特征中各个数据特征之间的对应关系;将所述第n个语音分离数据的频谱特征输入所述语音活性检测模型,得到所述语音活性检测模型输出的所述第n个语音分离数据对应的语音边界检测结果;根据所述第n个语音分离数据对应的语音边界检测结果和所述第n个语音分离数据对应的映射关系,确定所述第n个语音分离数据的语音边界信息;其中,n为正整数,n≤n,n为正整数。

[0281]

在一种可能的实施方式中,所述第二确定子单元,包括:

[0282]

边界标注单元,用于若所述语音分离数据的个数为n,则按照所述第n个语音分离数据的语音边界信息,对所述第n个语音分离数据进行语音边界标注,得到所述第n个语音分离数据的语音边界标注结果;其中,n为正整数,n≤n,n为正整数;

[0283]

第四确定子单元,用于确定所述第n个语音分离数据对应的说话人标识,以使所述第n个语音分离数据对应的说话人标识不同于n个语音分离数据中除了所述第n个语音分离数据以外其他任一语音分离数据对应的说话人标识;

[0284]

第五确定子单元,用于根据所述第n个语音分离数据的语音边界标注结果和所述第n个语音分离数据的对应的说话人标识,确定所述第n个语音分离数据的说话人标注结果。

[0285]

在一种可能的实施方式中,所述第五确定子单元,具体用于:若所述第n个语音分离数据包括m帧音频数据,则若所述第n个语音分离数据中第m帧音频数据的语音边界标注结果满足预设标注条件,则将所述第n个语音分离数据的对应的说话人标识,确定为所述第n个语音分离数据中第m帧音频数据的说话人标注结果;若所述第n个语音分离数据中第m帧音频数据的语音边界标注结果不满足预设标注条件,则将所述第n个语音分离数据中第m帧音频数据的语音边界标注结果,确定为所述第n个语音分离数据中第m帧音频数据的说话人标注结果;其中,m为正整数,m≤m,m为正整数。

[0286]

在一种可能的实施方式中,所述第三确定子单元,具体用:若所述语音分离数据的个数为n,则将n个语音分离数据的说话人标注结果按照预设合并方式进行合并,得到所述待分离语音数据的说话人分离结果。

[0287]

在一种可能的实施方式中,所述语音分离模型的构建过程,包括:

[0288]

获取所述样本语音和所述样本语音对应的至少一个实际语音分离数据;将所述样本语音输入待训练模型,得到所述待训练模型输出的所述样本语音对应的至少一个预测语音分离数据;根据所述至少一个预测语音分离数据和所述至少一个实际语音分离数据,确定所述待训练模型的预测损失值;根据所述待训练模型的预测损失值,更新所述待训练模型,并继续执行所述将所述样本语音输入待训练模型的步骤,直至在达到预设停止条件之

后,根据所述待训练模型,确定所述语音分离模型。

[0289]

在一种可能的实施方式中,若所述样本语音的个数为g,则所述待训练模型的预测损失值的确定过程,包括:根据第g个样本语音对应的至少一个预测语音分离数据和所述第g个样本语音对应的至少一个实际语音分离数据,确定所述第g个样本语音对应的预测损失;其中,g为正整数,g≤g,g为正整数;

[0290]

根据g个样本语音对应的预测损失之间的和值,确定所述待训练模型的预测损失值。

[0291]

在一种可能的实施方式中,若所述实际语音分离数据的个数为k,且所述预测语音分离数据的个数为k,则所述第g个样本语音对应的预测损失的确定过程,包括:确定所述第g个样本语音对应的t个候选数据对应关系;其中,所述第g个样本语音对应的第t个候选数据对应关系用于描述所述第g个样本语音对应的k个实际语音分离数据与所述第g个样本语音对应的k个预测语音分离数据之间的对应关系;其中,t为正整数,t≤t,t为正整数;根据所述第g个样本语音对应的第t个候选数据对应关系、所述第g个样本语音对应的k个实际语音分离数据和所述第g个样本语音对应的k个预测语音分离数据,确定所述第g个样本语音对应的第t个数据匹配对集合;其中,所述第t个数据匹配对集合包括k个数据匹配对;t为正整数,t≤t;根据所述第t个数据匹配对集合中第1个数据匹配对之间的损失距离至所述第t个数据匹配对集合中第k个数据匹配对之间的损失距离,确定所述第g个样本语音对应的第t个候选损失;其中,t为正整数,t≤t;将所述第g个样本语音对应的第1个候选损失至所述第g个样本语音对应的第t个候选损失中最小值,确定为所述第g个样本语音对应的预测损失。

[0292]

在一种可能的实施方式中,所述说话人分离装置400,还包括:

[0293]

参考生成单元,用于对所述待分离语音数据进行频谱特征提取,得到所述待分离语音数据的频谱特征;根据所述待分离语音数据的频谱特征和预先训练好的语音活性检测模型,确定所述待分离语音数据对应的至少一个频谱特征切片;根据所述至少一个频谱特征切片,确定所述待分离语音数据对应的说话人分离参考结果;

[0294]

所述说话人分离单元403,具体用于:根据所述至少一个语音分离数据和所述说话人分离参考结果,确定所述待分离语音数据的说话人分离结果。

[0295]

在一种可能的实施方式中,所述说话人分离单元403,包括:

[0296]

第六确定子单元,用于根据所述至少一个语音分离数据,确定所述待分离语音数据对应的说话人分离候选结果;

[0297]

第七确定子单元,用于根据所述说话人分离候选结果和所述说话人分离参考结果,确定所述说话人分离候选结果的分离错误表征值;

[0298]

第八确定子单元,用于若所述说话人分离候选结果的分离错误表征值低于预设错误阈值,则将所述说话人分离候选结果,确定为所述待分离语音数据的说话人分离结果;若所述说话人分离候选结果的分离错误表征值不低于预设错误阈值,则将所述说话人分离参考结果,确定为所述待分离语音数据的说话人分离结果。

[0299]

在一种可能的实施方式中,所述第七确定子单元,包括:

[0300]

第九确定子单元,用于确定所述待分离语音数据对应的h个候选标识对应关系;其中,所述待分离语音数据对应的第h个候选标识对应关系用于表示所述说话人分离候选结

果中至少一个说话人标识与所述说话人分离参考结果中至少一个说话人标识之间的对应关系;h为正整数,h≤h,h为正整数;

[0301]

第十确定子单元,用于根据所述待分离语音数据对应的第h个候选标识对应关系、所述说话人分离候选结果和所述说话人分离参考结果,确定所述待分离语音数据对应的第h个匹配语音段集合;其中,h为正整数,h≤h;

[0302]

第十一确定子单元,用于根据所述待分离语音数据对应的第h个匹配语音段集合,确定所述待分离语音数据对应的第h个候选错误表征值;其中,h为正整数,h≤h;

[0303]

第十二确定子单元,用于将所述待分离语音数据对应的第1个候选错误表征值至所述待分离语音数据对应的第h个候选错误表征值中最小值,确定为所述说话人分离候选结果的分离错误表征值。

[0304]

在一种可能的实施方式中,所述第十一确定子单元,包括:

[0305]

第十三确定子单元,用于若所述第h个语音段集合包括f个匹配语音段,则根据所述第h个语音段集合中第f个匹配语音段、所述说话人分离候选结果、所述说话人分离参考结果、和所述第h个候选标识对应关系,确定所述第h个语音段集合中第f个匹配语音段对应的错误表征值;其中,f为正整数,f≤f,f为正整数;

[0306]

第十四确定子单元,用于根据所述第h个语音段集合中第1个匹配语音段对应的错误表征值至所述第h个语音段集合中第f个匹配语音段对应的错误表征值之间的和值,确定所述待分离语音数据对应的第h个候选表征值。

[0307]

在一种可能的实施方式中,所述第十三确定子单元,具体用于:根据所述说话人分离候选结果,确定所述第h个语音段集合中第f个匹配语音段对应的第一说话人标识和所述第h个语音段集合中第f个匹配语音段对应的第一说话人个数;根据所述说话人分离参考结果,确定所述第h个语音段集合中第f个匹配语音段对应的第二说话人标识和所述第h个语音段集合中第f个匹配语音段对应的第二说话人个数;根据所述第h个候选标识对应关系、所述第h个语音段集合中第f个匹配语音段对应的第一说话人标识、和所述第h个语音段集合中第f个匹配语音段对应的第二说话人标识,确定所述第h个语音段集合中第f个匹配语音段对应的说话人匹配个数;根据所述第h个语音段集合中第f个匹配语音段对应的第一说话人个数、所述第h个语音段集合中第f个匹配语音段对应的第二说话人个数、所述第h个语音段集合中第f个匹配语音段对应的说话人匹配个数、和所述第h个语音段集合中第f个匹配语音段的时长,确定所述第h个语音段集合中第f个匹配语音段对应的错误表征值。

[0308]

进一步地,本技术实施例还提供了一种说话人分离设备,包括:处理器、存储器、系统总线;

[0309]

所述处理器以及所述存储器通过所述系统总线相连;

[0310]

所述存储器用于存储一个或多个程序,所述一个或多个程序包括指令,所述指令当被所述处理器执行时使所述处理器执行上述说话人分离方法的任一种实现方法。

[0311]

进一步地,本技术实施例还提供了一种计算机可读存储介质,所述计算机可读存储介质中存储有指令,当所述指令在终端设备上运行时,使得所述终端设备执行上述说话人分离方法的任一种实现方法。

[0312]

进一步地,本技术实施例还提供了一种计算机程序产品,所述计算机程序产品在终端设备上运行时,使得所述终端设备执行上述说话人分离方法的任一种实现方法。

[0313]

通过以上的实施方式的描述可知,本领域的技术人员可以清楚地了解到上述实施例方法中的全部或部分步骤可借助软件加必需的通用硬件平台的方式来实现。基于这样的理解,本技术的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在存储介质中,如rom/ram、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者诸如媒体网关等网络通信设备,等等)执行本技术各个实施例或者实施例的某些部分所述的方法。

[0314]

需要说明的是,本说明书中各个实施例采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似部分互相参见即可。对于实施例公开的装置而言,由于其与实施例公开的方法相对应,所以描述的比较简单,相关之处参见方法部分说明即可。

[0315]

还需要说明的是,在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

[0316]

对所公开的实施例的上述说明,使本领域专业技术人员能够实现或使用本技术。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本技术的精神或范围的情况下,在其它实施例中实现。因此,本技术将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽的范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。