技术特征:

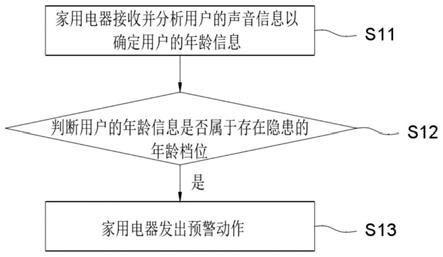

1.一种基于文本生成音频的方法,其特征在于,所述方法包括:

确定目标文本中的每个文本句对应的情绪类型信息;

确定所述目标文本中每个文本句对应的发音属性信息;

将每个文本句对应的情绪类型信息和发音属性信息输入预先训练完成的音频合成模型中,得到每个所述文本句对应的朗读音频段;

按照每个文本句在所述目标文本中的排列顺序,对每个文本句对应的朗读音频段进行拼接,得到所述目标文本对应的朗读音频。

2.根据权利要求1所述的方法,其特征在于,所述确定目标文本中的每个文本句对应的情绪类型信息,包括:

在所述目标文本中确定每个文本句对应的关联上下文,其中,所述文本句对应的关联上下文由所述文本句对应的至少一个关联文本句组成;

若确定出文本句对应的关联上下文,基于所述文本句和所述文本句对应的关联上下文组成的文本段落确定所述文本句的特征信息;若未确定出文本句对应的关联上下文,基于所述文本句确定所述文本句的特征信息;

将每个所述文本句的特征信息输入预先训练好的情绪识别模型,得到所述文本句对应的情绪类型信息,其中所述情绪识别模型由第一样本文本集合训练得到,所述第一样本文本集合包括样本文本句的特征信息以及所述样本文本句对应的情绪类型标签。

3.根据权利要求1所述的方法,其特征在于,所述发音属性信息包括发音单元信息、分词信息、韵律信息中的至少一种信息。

4.根据权利要求1所述的方法,其特征在于,所述音频合成模型包括频谱合成模型和声码器;

所述将每个文本句对应的情绪类型信息和发音属性信息输入预先训练完成的音频合成模型中,得到每个所述文本句对应的朗读音频段,包括:

将所述每个文本句对应的情绪类型信息和发音属性信息输入所述预先训练完成的频谱合成模型,得到所述每个文本句对应的梅尔频谱序列;其中频谱合成模型由第二样本文本集合训练得到,所述第二样本文本集合包括样本文本句的情绪类型信息和发音属性信息以及所述样本文本句对应的梅尔频谱序列标签;

将每个文本句对应的梅尔频谱序列输入所述声码器,生成每个文本句对应的朗读音频段。

5.根据权利要求4所述的方法,其特征在于,所述频谱合成模型包括情绪特征提取模块、发音特征提取模块、注意力网络模块和解码网络模块;

所述将所述每个文本句对应的情绪类型信息和发音属性信息输入所述预先训练完成的频谱合成模型,得到所述每个文本句对应的梅尔频谱序列,包括:

将每个所述文本句的情绪类型信息输入预先训练好的所述情绪特征提取模块,得到情绪特征向量;将每个所述文本句的发音属性信息输入预先训练好的所述发音特征提取模块,得到发音特征向量;

将每个所述文本句对应的所述情绪特征向量和所述发音特征向量进行拼接后输入所述注意力网络模块,得到权重系数矩阵;将每个所述文本句的权重系数矩阵输入所述解码网络模块,得到每个所述文本句对应的梅尔频谱序列。

6.根据权利要求5所述的方法,其特征在于,所述情绪特征提取模块包括变分自编码器vae子模块和全连接网络子模块,所述发音特征提取模块包括预处理网络pre-net子模块和包含一维卷积和双向门控循环单元的序列特征提取网络cbhg子模块。

7.根据权利要求5所述的方法,其特征在于,所述频谱合成模型还包括后处理网络post-net模块;

在所述将每个所述文本句的权重系数矩阵输入所述解码网络模块之后,所述方法还包括:

获得所述解码网络模块输出的所述文本句对应的初始梅尔频谱序列;

将所述初始梅尔频谱序列输入所述post-net子模块得到梅尔频谱修正信息;

使用所述梅尔频谱修正信息对所述初始梅尔频谱序列进行修正,以得到每个所述文本句对应的梅尔频谱序列。

8.根据权利要求1所述的方法,其特征在于,所述音频合成模型包括多个,则得到的所述文本句对应的朗读音频段为多组,且多组所述文本句的朗读音频段拼接得到的目标文本的朗读音频为多个;

不同的音频合成模型对应不同的朗读者类型,则各个所述音频合成模型输出的一组朗读音频段与所述音频合成模型的朗读者类型具有对应关系,且所述一组朗读音频段拼接得到的朗读音频与所述朗读者类型具有对应关系;

所述得到所述目标文本对应的朗读音频之后,还包括:

将各个所述目标文本的朗读音频与所述朗读音频的朗读者类型进行对应存储。

9.根据权利要求8所述的方法,其特征在于,所述将各个所述目标文本的朗读音频与所述朗读音频的朗读者类型进行对应存储之后,还包括:

接收终端发送的所述目标文本对应的朗读音频获取请求,其中,所述朗读音频获取请求中携带有目标朗读者类型;

将所述目标朗读者类型对应的所述朗读音频返回所述终端。

10.根据权利要求8所述的方法,其特征在于,所述朗读者类型包括:对话的第一朗读者类型和旁白的第二朗读者类型;且第一朗读者类型与第一音频合成模型对应,第二朗读者类型与第二音频合成模型对应;

所述将每个文本句对应的情绪类型信息和发音属性信息输入预先训练完成的音频合成模型中,得到每个所述文本句对应的朗读音频段,包括:

根据所述目标文本中的标点符号确定每个文本句的文本类型,其中所述文本类型为对话或旁白;

对于文本类型为对话的文本句,将所述文本句对应的情绪类型信息和发音属性信息输入所述第一音频合成模型,生成所述文本句对应的朗读音频段;

对于文本类型为旁白的文本句,将所述文本句对应的情绪类型信息和发音属性信息根据所述第二音频合成模型,生成所述文本句对应的朗读音频段。

11.一种计算机设备,其特征在于,所述计算机设备包括处理器和存储器,所述存储器中存储有至少一条指令,所述至少一条指令由所述处理器加载并执行以实现如权利要求1至权利要求10任一项所述的基于文本生成音频的方法所执行的操作。

12.一种计算机可读存储介质,其特征在于,所述存储介质中存储有至少一条指令,所述至少一条指令由处理器加载并执行以实现如权利要求1至权利要求10任一项所述的基于文本生成音频的方法所执行的操作。

技术总结

本申请公开了一种基于文本生成音频的方法、设备和存储介质,属于计算机技术领域。所述方法包括:确定目标文本中的每个文本句对应的情绪类型信息;确定所述目标文本中每个文本句对应的发音属性信息;将每个文本句对应的情绪类型信息和发音属性信息输入预先训练完成的音频合成模型中,得到每个所述文本句对应的朗读音频段;按照每个文本句在所述目标文本中的排列顺序,对每个文本句对应的朗读音频段进行拼接,得到所述目标文本对应的朗读音频。采用本申请,在生成朗读音频时融入了与情绪相关的信息,使得这种朗读音频具有感情色彩,可以提高用户的听觉体验。

技术研发人员:徐东;邓一平;陈洲旋;鲁霄;余洋洋;陈苑苑;邢佳佳;陈纳珩;周思瑜;赵伟峰;周蓝珺;易越;许瑶;唐志彬;曹利;雷兆恒;潘树燊;周文江

受保护的技术使用者:腾讯音乐娱乐科技(深圳)有限公司

技术研发日:2021.05.26

技术公布日:2021.07.30

本文用于企业家、创业者技术爱好者查询,结果仅供参考。