技术特征:

1.一种语音情绪识别方法,其特征在于,所述语音情绪识别方法包括:

获取初始语音数据,并对所述初始语音数据进行预处理,生成预处理后的语音数据;

对所述预处理后的语音数据中的每一帧数据分别进行特征提取,得到每一帧数据对应的多个目标特征,所述每一帧数据对应的多个目标特征包括能量特征、基频特征、共振特征和梅尔倒谱系数mfcc特征;

将所述每一帧数据对应的多个目标特征输入预置的深度网络模型,得到语音特征数据;

将所述语音特征数据输入预置的图网络模型,生成修正后的语音特征数据,并对所述修正后的语音特征数据进行分类处理,输出目标语音特征数据,所述目标语音特征数据用于指示识别到的语音情绪信息。

2.根据权利要求1所述的语音情绪识别方法,其特征在于,所述获取初始语音数据,并对所述初始语音数据进行预处理,生成预处理后的语音数据包括:

获取初始语音数据,所述初始语音数据包括用户端发送的录音数据;

调用语音端点检测算法vad对所述初始语音数据进行切分,得到语音切分片段,对所述语音切分片段进行过滤处理,删除无效片段,生成过滤后的语音数据,所述无效片段为包含噪音信号的语音片段和静音片段;

对所述过滤后的语音数据依次进行预加重、分帧和加窗处理,生成预处理后的语音数据。

3.根据权利要求1所述的语音情绪识别方法,其特征在于,所述对所述预处理后的语音数据中的每一帧数据分别进行特征提取,得到每一帧数据对应的多个目标特征,所述每一帧数据对应的多个目标特征包括能量特征、基频特征、共振特征和梅尔倒谱系数mfcc特征包括:

步骤一、采用预置的窗型和短时能量计算公式计算任意一帧数据的语音短时能量,得到任意一帧数据对应的能量特征,所述预置的窗型包括矩形窗;

步骤二、调用自相关函数算法提取任意一帧数据的基频特征,得到任意一帧数据对应的基频特征;

步骤三、采用线性预测分析算法提取任意一帧数据的共振峰参数,得到任意一帧数据对应的共振特征,所述共振峰参数包括共振峰频率和共振峰带宽;

步骤四、获取任意一帧数据对应的频谱数据,将所述频谱数据通过梅尔滤波器并经过离散余弦变换,得到任意一帧数据对应的梅尔倒谱系数mfcc特征;

步骤五、重复执行步骤一至步骤四,生成每一帧数据对应的能量特征、基频特征、共振特征和梅尔倒谱系数mfcc特征。

4.根据权利要求3所述的语音情绪识别方法,其特征在于,所述获取任意一帧数据对应的频谱数据,将所述频谱数据通过梅尔滤波器并经过离散余弦变换,得到任意一帧数据对应的梅尔倒谱系数mfcc特征包括:

对所述任意一帧数据进行傅里叶变换,得到任意一帧数据对应的频谱数据;

将所述任意一帧数据对应的频谱数据通过梅尔滤波器进行平滑化处理,并消除谐波的作用,得到平滑处理后的任意一帧数据;

计算所述梅尔滤波器输出的对数能量,并将所述平滑处理后的任意一帧数据进行离散余弦变换,得到任意一帧数据对应的梅尔倒谱系数mfcc特征。

5.根据权利要求1所述的语音情绪识别方法,其特征在于,所述将所述每一帧数据对应的多个目标特征输入预置的深度网络模型,得到语音特征数据包括:

将所述每一帧数据对应的多个目标特征输入预置的深度网络模型,提取语音情绪相关数据,得到每一帧数据对应的多个目标语音情绪特征;

分别计算每一个目标语音情绪特征的平均值,生成语音特征数据,所述每一个目标语音情绪特征的平均值包括能量特征平均值、基频特征平均值、共振特征平均值和梅尔倒谱系数mfcc特征平均值。

6.根据权利要求1所述的语音情绪识别方法,其特征在于,所述将所述语音特征数据输入预置的图网络模型,生成修正后的语音特征数据,并对所述修正后的语音特征数据进行分类处理,输出目标语音特征数据,所述目标语音特征数据用于指示识别到的语音情绪信息包括:

将所述语音特征数据输入预置的图网络模型,并调用所述预置的图网络模型中的图网络层提取全局信息,生成修正后的语音特征数据;

将所述修正后的语音特征数据输入预置的分类器中,按照预设数目的情绪类别对所述修正后的语音特征数据进行分类,输出目标语音特征数据,所述目标语音特征数据用于指示识别到的语音情绪信息。

7.根据权利要求1-6中任一项所述的语音情绪识别方法,其特征在于,在所述获取初始语音数据,并对所述初始语音数据进行预处理,生成预处理后的语音数据之前,所述方法还包括:

构建预置的图网络模型。

8.一种语音情绪识别装置,其特征在于,所述语音情绪识别装置包括:

获取模块,用于获取初始语音数据,并对所述初始语音数据进行预处理,生成预处理后的语音数据;

特征提取模块,用于对所述预处理后的语音数据中的每一帧数据分别进行特征提取,得到每一帧数据对应的多个目标特征,所述每一帧数据对应的多个目标特征包括能量特征、基频特征、共振特征和梅尔倒谱系数mfcc特征;

输入模块,用于将所述每一帧数据对应的多个目标特征输入预置的深度网络模型,得到语音特征数据;

输出模块,用于将所述语音特征数据输入预置的图网络模型,生成修正后的语音特征数据,并对所述修正后的语音特征数据进行分类处理,输出目标语音特征数据,所述目标语音特征数据用于指示识别到的语音情绪信息。

9.一种语音情绪识别设备,其特征在于,所述语音情绪识别设备包括:

存储器和至少一个处理器,所述存储器中存储有指令;

所述至少一个处理器调用所述存储器中的所述指令,以使得所述语音情绪识别设备执行如权利要求1-7中任意一项所述的语音情绪识别方法。

10.一种计算机可读存储介质,所述计算机可读存储介质上存储有指令,其特征在于,所述指令被处理器执行时实现如权利要求1-7中任一项所述语音情绪识别方法。

技术总结

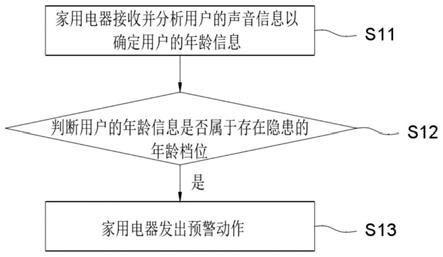

本发明涉及人工智能领域,公开了一种语音情绪识别方法、装置、设备及存储介质,用于通过建立图网络对特征信息进行修正,从而提升了特征信息片段之间的相关性,提取出语音情绪特征的全局信息。语音情绪识别方法包括:获取初始语音数据,并对初始语音数据进行预处理,生成预处理后的语音数据;对预处理后的语音数据进行特征提取,得到每一帧数据对应的多个目标特征;将每一帧数据对应的多个目标特征输入预置的深度网络模型,得到语音特征数据;将语音特征数据输入预置的图网络模型,生成修正后的语音特征数据并进行分类处理,输出目标语音特征数据。此外,本发明还涉及区块链技术,目标语音特征数据可存储于区块链节点中。

技术研发人员:顾艳梅;马骏;王少军

受保护的技术使用者:平安科技(深圳)有限公司

技术研发日:2021.04.16

技术公布日:2021.07.23

本文用于企业家、创业者技术爱好者查询,结果仅供参考。