技术特征:

1.一种语音处理方法,其特征在于,包括:

获取待处理的语音数据;

对所述语音数据进行语音识别,得到所述语音数据对应的文本信息;

调用情绪识别模型,将所述语音数据输入所述情绪识别模型进行情绪识别,得到所述语音数据对应的粗粒度情绪类别与细粒度情绪类别;

根据所述文本信息与所述粗粒度情绪类别,确定所述语音数据对应的应答文本信息;

根据所述细粒度情绪类别与所述应答文本信息进行语音合成,获得所述语音数据对应的应答语音信号。

2.根据权利要求1所述的语音处理方法,其特征在于,所述情绪识别模型包括第一情绪识别模型与第二情绪识别模型;所述调用情绪识别模型,将所述语音数据输入所述情绪识别模型进行情绪识别,得到所述语音数据对应的粗粒度情绪类别与细粒度情绪类别之前,还包括:

分别对所述第一情绪识别模型与所述第二情绪识别模型进行迭代训练至收敛,得到训练后的所述第一情绪识别模型与训练后的所述第二情绪识别模型;

所述调用情绪识别模型,将所述语音数据输入所述情绪识别模型进行情绪识别,得到所述语音数据对应的粗粒度情绪类别与细粒度情绪类别,包括:

将所述语音数据输入所述第一情绪识别模型进行情绪预测,获得所述语音数据对应的所述粗粒度情绪类别;

将所述语音数据输入所述粗粒度情绪类别对应的所述第二情绪识别模型进行情绪预测,获得所述语音数据对应的所述细粒度情绪类别。

3.根据权利要求2所述的语音处理方法,其特征在于,所述分别对所述第一情绪识别模型与所述第二情绪识别模型迭代训练至收敛,得到训练后的所述第一情绪识别模型与训练后的所述第二情绪识别模型,包括:

获取第一训练数据,所述第一训练数据包括预设数量的文本数据、预设数量的语音数据以及标注的粗粒度情绪类别标签;

获取第二训练数据,所述第二训练数据包括预设数量的文本数据、预设数量的语音数据以及标注的细粒度情绪类别标签;

将所述第一训练数据输入所述第一情绪识别模型进行迭代训练,直至所述第一情绪识别模型收敛;

将所述第二训练数据输入所述第二情绪识别模型进行迭代训练,直至所述第二情绪识别模型收敛。

4.根据权利要求1所述的语音处理方法,其特征在于,所述根据所述文本信息与所述粗粒度情绪类别,确定所述语音数据对应的应答文本信息,包括:

对所述文本信息进行分词处理,得到所述文本信息对应的多个词组;

将每个所述词组输入词向量模型进行向量化,得到所述文本信息对应的词向量矩阵;

将所述词向量矩阵输入意图识别模型中进行意图识别,获得所述文本信息对应的意图信息;

对所述意图信息与所述粗粒度情绪类别进行话术匹配,获得所述应答文本信息。

5.根据权利要求4所述的语音处理方法,其特征在于,所述对所述意图信息与所述粗粒度情绪类别进行话术匹配,获得所述应答文本信息,包括:

基于情绪类别与话术数据库之间预设的对应关系,根据所述粗粒度情绪类别确定目标话术数据库;

基于所述目标话术数据库,匹配与所述意图信息对应的话术信息,获得所述应答文本信息。

6.根据权利要求1所述的语音处理方法,其特征在于,所述根据所述细粒度情绪类别与所述应答文本信息进行语音合成,获得所述语音数据对应的应答语音信号,包括:

基于情绪类别与语调类型之间预设的对应关系,根据所述细粒度情绪类别确定目标语调类型;

对所述应答文本信息进行声音合成,得到对应的声音频谱图;

根据所述目标语调类型调节所述声音频谱图的语调,将调节后的所述声音频谱图确定为所述应答语音信号。

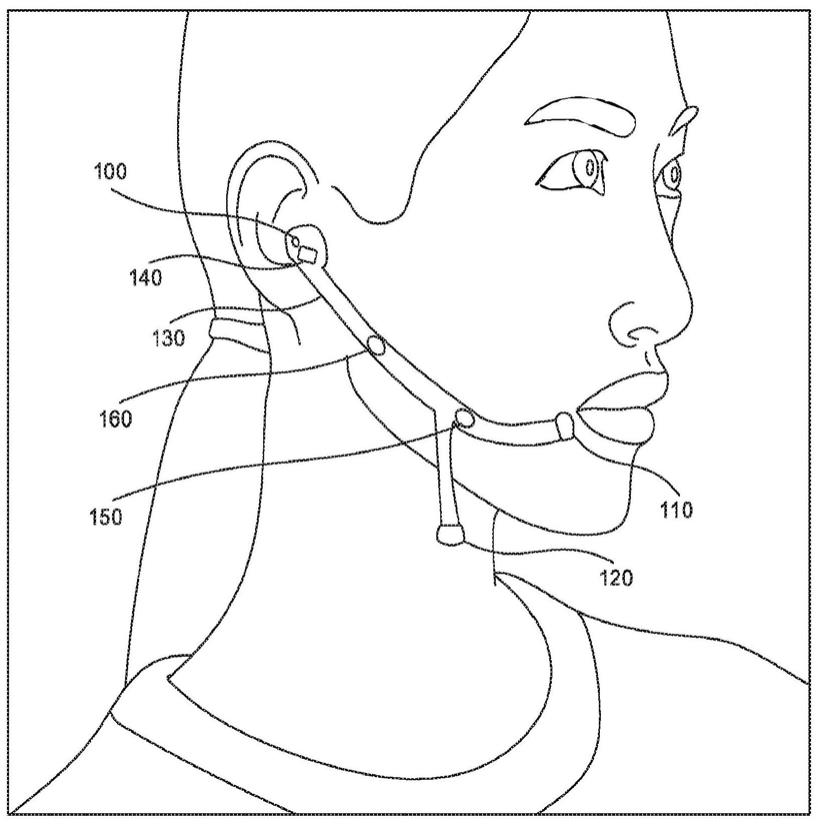

7.根据权利要求1-6任一项所述的语音处理方法,其特征在于,所述获取待处理的语音数据,包括:

获取语音采集装置采集的语音信号;

基于区块链中预设的语音检测模型,提取所述语音信号中的有用语音信号;

根据所述有用语音信号,确定所述语音数据。

8.一种语音处理装置,其特征在于,包括:

语音数据获取模块,用于获取待处理的语音数据;

语音识别模块,用于对所述语音数据进行语音识别,得到所述语音数据对应的文本信息;

情绪识别模块,用于调用情绪识别模型,将所述语音数据输入所述情绪识别模型进行情绪识别,得到所述语音数据对应的粗粒度情绪类别与细粒度情绪类别;

应答文本生成模块,用于根据所述文本信息与所述粗粒度情绪类别,确定所述语音数据对应的应答文本信息;

语音合成模块,用于根据所述细粒度情绪类别与所述应答文本信息进行语音合成,获得所述语音数据对应的应答语音信号。

9.一种计算机设备,其特征在于,所述计算机设备包括存储器和处理器;

所述存储器,用于存储计算机程序;

所述处理器,用于执行所述计算机程序并在执行所述计算机程序时实现如权利要求1至7任一项所述的语音处理方法。

10.一种计算机可读存储介质,其特征在于,所述计算机可读存储介质存储有计算机程序,所述计算机程序被处理器执行时使所述处理器实现如权利要求1至7任一项所述的语音处理方法。

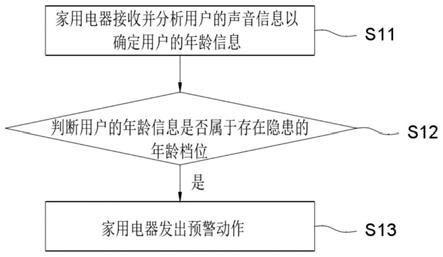

技术总结

本申请涉及语音处理技术领域,通过将粗粒度情绪类别融合在意图识别过程以及将细粒度情绪类别融合在语音合成过程,实现根据用户的情绪特征进行语音应答,提高了应答语音信号的准确性和用户的体验度。涉及一种语音处理方法、装置、计算机设备和存储介质,该方法包括:获取待处理的语音数据;对语音数据进行语音识别,得到文本信息;调用情绪识别模型,将语音数据输入情绪识别模型进行情绪识别,得到粗粒度情绪类别与细粒度情绪类别;根据文本信息与粗粒度情绪类别,确定语音数据对应的应答文本信息;根据细粒度情绪类别与应答文本信息进行语音合成,获得语音数据对应的应答语音信号。本申请还涉及区块链技术,情绪识别模型可存储于区块链中。

技术研发人员:顾艳梅;马骏;王少军

受保护的技术使用者:平安科技(深圳)有限公司

技术研发日:2021.02.26

技术公布日:2021.06.18

本文用于企业家、创业者技术爱好者查询,结果仅供参考。