1.本发明属于水上救生领域,具体涉及一种智能水下救生系统及溺水检测、救援方法。

背景技术:

2.水上救援对时效性、稳定性要求非常高,涉及到计算机、自动控制、传感器等广泛学科领域中的许多前沿技术。

3.从水上救援的国内外研究现状来看,无人机及水下机器人机动救援的研究成果相对较少,大部分仍处于初级研究和试验阶段,综合技术水平和服务水平偏低。针对人员密集和人员稀疏的不同水域游泳场景,现有技术的水上救援策略只实现了如何检测与定位方法,其中如何实现快速机动救援,快速提供救援服务并没有很好的实现,存在知晓有人溺水而无法及时提供救援服务的现象;同时,缺乏开放水域和室内游泳场馆兼容救援的技术的应用,以及救援的实用性。智能手环和救援无人机技术的不融合,导致了目前国内外水上救生系统始终不完善,在实际应用上还存在很大的空缺,救援方案综合技术水平和服务水平偏低。

技术实现要素:

4.本发明的目的是针对上述问题,提供一种智能水下救生系统以及溺水人员救援方法,设计提供对溺水人员实施水下自主救援的水下机器人,将水下机器人、无人机、智能手环和服务器集成,水下机器人、智能手环利用地磁定位技术与gps定位技术互补进行室内外准确定位;服务器一方面根据水下机器人或水下摄像头实时拍摄采集的图像,利用神经网络模型识别图像中的人体的姿态,根据人体姿态判断是否有溺水现象,另一方面根据智能手环实时采集的水中人员的心率、水下深度以及x、y、z轴加速度,通过机器学习算法实时判断是否出现人员溺水现象,通过两种方式实时检测溺水现象,尽早发现溺水人员,避免救援不及时导致人员伤亡。

5.本发明的技术方案是智能水下救生系统,包括水下机器人,水下机器人包括主体、人体支撑座、救生带和救生鱼,救生带的前端与救生鱼连接;主体内设有控制器以及与控制器连接的第一无线通讯模块、第一gps模块,主体的头部设有摄像头,摄像头经数据线与控制器连接;主体上设有用于提供水中上升下降动力的第一涡轮机,主体的尾部设有用于提供水中前进、后退以及转向动力的第二涡轮机,第一涡轮机、第二涡轮机的控制端分别与控制器连接;救生带的末端与主体的侧部连接固定。

6.救生鱼包括仿鱼体、仿生鳍和设置在仿鱼体尾部的螺旋桨推进器,螺旋桨推进器后端设有用于连接并拖曳救生带的牵引部;仿鱼体内设有第一微处理器以及分别与第一微处理器电性连接的第二无线通讯模块和第二地磁传感器,螺旋桨推进器的驱动电机的控制端与第一微处理器的控制信号输出端连接。

7.进一步地,仿生鳍的纵轴与舵机的输出轴连接,舵机的控制端与第一微处理器的

控制信号输出端连接。在舵机的驱动下,通过调节仿生鳍与螺旋桨推进器的中心线的角度以控制救生鱼的行进方向。

8.优选地,水下机器人还包括第一地磁传感器,第一地磁传感器经数据线与控制器连接。

9.优选地,所述系统还包括无人机,无人机的悬臂下方设有用于与水下机器人连接的连接杆,连接杆与水下机器人的连接端设有电动液压钳,电动液压钳与水下机器人顶部的连接孔位配合,电动液压钳的控制端与无人机的控制单元连接;无人机还包括第二gps模块、第二无线通讯模块,第二gps模块、第二无线通讯模块分别与无人机的控制单元连接。

10.优选地,所述系统还包括智能手环,智能手环包括单片机以及分别与其连接的心率传感器、水压传感器、第三gps模块、第三无线通讯模块、第二地磁传感器。

11.优选地,所述系统还包括服务器,服务器分别与水下机器人、无人机、智能手环通讯连接,服务器根据水下机器人、无人机提供的图像,检测图像中的人体发否发生溺水现象;服务器根据智能手环采集的人员的心率、水下深度以及三轴加速度数据进行溺水检测。

12.进一步地,水下机器人还包括在控制器的处理器上运行的目标识别模块,目标识别模块根据摄像头拍摄的图像,识别水中人体,根据人体的位置和图像特征判断其是否为救援目标。

13.基于水中人体图像的人体溺水检测方法,包括以下步骤:

14.步骤1:拍摄得到水中人体的图像;

15.步骤2:利用yolov5s模型对图像进行人体目标检测,得到人体定位框;

16.步骤3:采用alphapose模型识别人体定位框中的人体姿态,得到骨骼关键点并确定其坐标;

17.步骤4:根据人体骨骼关键点坐标,计算得到人体体态特征;

18.步骤5:根据人体体态特征判断是否溺水,若出现溺水,判断溺水时间长短,并发出警报。基于智能手环的人体溺水检测方法,包括以下步骤:

19.s1:分别利用智能手环获取正常游泳和模拟溺水人员在水中的心率、水下深度以及x、y、z轴加速度;

20.s2:采用支持向量机构建溺水检测模型,利用步骤s1得到的数据作为溺水检测模型的输入对其进行训练;

21.s3:利用智能手环实时采集待测水中人体的心率、水下深度以及x、y、z轴加速度;

22.s4:将步骤s3采集得到的数据作为溺水检测模型的输入,进行实时的溺水现象检测,若检测到溺水现象,则执行步骤s5,否则执行步骤s3;

23.s5:获取溺水人体的位置,发出溺水警报。

24.溺水人员救援方法,包括以下步骤:

25.1)对水中人体进行溺水检测,检测到人体溺水现象时,确定溺水人员的位置,执行步骤2),否则重复执行步骤1);

26.2)根据溺水人员的位置,在救援地点投放水下机器人;

27.3)控制水下机器人在水中行驶到溺水人员位置,采集所在位置人员的图像,并判断确认是否为救援目标;

28.4)控制水下机器人,使水下机器人的人体支撑座对准溺水人员的背部;

29.5)控制救生鱼牵引救生带对溺水人员躯体进行环绕;救生鱼牵引救生带环绕溺水人体后,控制救生鱼环绕人体支撑座进行圆周运动,继续将救生带紧实地缠绕在人体支撑座的根部;缠绕救生带后,控制救生鱼回游到收纳室,并对救生带充气;

30.6)控制水下机器人驶向水面,使溺水人员头部露出水面。

31.相比现有技术,本发明的有益效果包括:

32.1)本发明提供了对溺水人员实施水下救援的水下机器人,水下机器人带有人体支撑座和救生带,可在水中自主升降、转向,救援溺水人员时利用救生带将溺水人员缠绕在人体支撑座上将人体头部向上抬出水面,相比人工救援,救援效率高,实用性好,可避免救援时对溺水人体造成不必要的伤害;

33.2)本发明的水下机器人包含救生鱼,救援溺水人员时,救生鱼牵引救生带完成对溺水人员躯体的环绕,救生鱼自主性好,便于快速将溺水人员躯体缠绕在水下机器人的人体支撑座后将溺水人员头部抬离水面,实现对溺水人员的及时救援;

34.3)本发明实现了水下机器人、无人机、智能手环和服务器的集成,服务器一方面根据水下机器人实时拍摄采集的图像,识别图像中的人体的姿态并判断是否有溺水现象,另一方面根据智能手环实时采集的水中人员的心率、水下深度以及x、y、z轴加速度,实时判断是否出现人员溺水现象,通过两种方式实时检测溺水现象,及时发现溺水人员,提高了溺水检查和人员救援的效率;服务器通过溺水人员的智能手环的定位,便于水下机器人快速到达溺水人员的位置实施救援;实现了无人机飞到溺水人员的位置后空中投放水下机器人,进一步提高了救援效率;

35.4)本发明利用地磁定位技术弥补室内gps定位信号弱的缺陷,实现对室内水中溺水人员的准确定位,便于实施及时的救援;

36.5)本发明利用yolov5s模型对图像进行人体目标检测,得到人体定位框后,利用改进的alphapose模型识别人体定位框中的人体姿态,得到骨骼关键点并确定其坐标后,计算得到人体体态特征,实现人员溺水现象的实时判断,溺水检测准确率高;

37.6)本发明利用支持向量机,根据智能手环采集的水中人员的心率、水下深度以及x、y、z轴加速度,实时判断是否出现人员溺水现象,溺水检测实时性好,准确率高;

38.7)本发明的救援方法救援成功率高,救援过程中对溺水人员保护性好。

附图说明

39.下面结合附图和实施例对本发明作进一步说明。

40.图1为本发明实施例的智能水下救生系统的结构示意图。

41.图2为本发明实施例的水下机器人的示意图。

42.图3为本发明实施例的水下机器人的人体支撑座的示意图。

43.图4为本发明实施例的救生鱼的结构示意图。

44.图5为本发明实施例的无人机的示意图。

45.图6为yolov5s模型的结构示意图。

46.图7为本发明实施例改进yolov5s模型的示意图。

47.图8为本发明实施例的alphapose模型的示意图。

48.图9a为本发明实施例的人体骨骼关键点的示意图。

49.图9b为本发明实施例的水下人体骨骼关键点的示意图。

50.图10为本发明实施例的人体溺水检测方法的流程示意图。

具体实施方式

51.如图1所示,实施例的智能水下救生系统包括服务器以及分别与服务器通讯连接的水下机器人100、无人机200、智能手环300和监控终端。服务器根据水下机器人100、无人机200提供的图像,检测图像中的人体是否发生溺水现象。

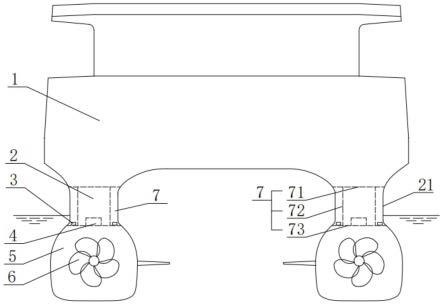

52.如图2-4所示,水下机器人100包括主体101、人体支撑座105、救生带103和救生鱼102,救生带103的前端与救生鱼102连接;主体101内设有控制器以及与控制器连接的第一无线通讯模块、第一gps模块、第一地磁传感器,主体的头部设有摄像头104,摄像头104经数据线与控制器连接;主体101上设有用于提供水中上升下降动力的第一涡轮机106,主体101的尾部设有用于提供水中前进、后退以及转向动力的第二涡轮机107,第一涡轮机106、第二涡轮机107的控制端分别与控制器连接。人体支撑座105两侧分别设有便于缠绕救生带的凹槽111。

53.如图3所示,水下机器人100的主体101一侧设有给救生带103充气的高压气罐108。主体101另一侧设有用于收纳救生带和救生鱼的收纳室109。救生带103为中空的气密性带状结构,救生带103的充气端经电磁阀与高压气罐108连接,电磁阀的控制端与控制器的控制信号输出端连接。实施例中,高压气罐108中储存液态氮气体。

54.如图4所示,救生鱼102包括仿鱼体1021、仿生鳍1024和设置在仿鱼体尾部的螺旋桨推进器1022,螺旋桨推进器1022后端设有用于连接并拖曳救生带的牵引部1023;仿鱼体1021内设有第一微处理器以及分别与第一微处理器电性连接的第二无线通讯模块和第二地磁传感器,螺旋桨推进器1022的驱动电机的控制端与第一微处理器的控制信号输出端连接。

55.仿生鳍1024的纵轴与舵机的输出轴连接,舵机的控制端与第一微处理器的控制信号输出端连接。在舵机的驱动下,通过调节仿生鳍1024与螺旋桨推进器1022的中心线的角度以控制救生鱼102的行进方向。

56.实施例的无人机、水下机器人、智能手环均采用地磁感应定位和gps定位相结合的方式,在室内游泳池等gps信号弱的环境中利用地磁传感器进行精确定位。

57.智能手环300包括第二微处理器以及分别与其连接的心率传感器、水压传感器、第三gps模块、第四无线通讯模块和第三地磁传感器,智能手环300与服务器通讯连接。智能手环300利用水压传感器输出的实时数据得到智能手环的水下深度。

58.如图5所示,无人机200的悬臂下方设有用于与水下机器人连接的连接杆201,连接杆201与水下机器人的连接端设有电动液压钳202,电动液压钳202的咬合头与水下机器人顶部的连接孔位111配合,电动液压钳202的控制端与无人机的控制单元连接;无人机200还包括第二gps模块、第三无线通讯模块,第二gps模块、第三无线通讯模块分别与无人机的控制单元连接。

59.实施例中,无人机200空中运输水下机器人100时,通过控制单元分别控制无人机4个悬臂下方的连接杆底端的电动液压钳202的咬合头在水下机器人顶部的连接孔位111处咬合,使得水下机器人100与无人机200连接,无人机200携带水下机器人100飞行。无人机

200空中投放水下机器人100时,通过控制单元分别控制无人机4个悬臂下方的连接杆底端的电动液压钳202的咬合头张开,水下机器人100在重力作用下与无人机200分离,完成投运。

60.救生鱼102的第二无线通讯模块与水下机器人100的第一无线通讯模块通讯连接;水下机器人100的第一无线通讯模块、无人机200的第三无线通讯模块以及智能手环300的第四无线通讯模块分别经无线路由器与服务器通讯连接。

61.人在水中的姿态可大致分为两类:一类为与水面平行,一类为与水面垂直,其他类别可归结为与水面垂直类。一般人溺水可归为第二类,姿态与水面垂直,此时人们意识尚存,可能仍持续更长时间,其溺水特征更容易获取。因此水中人员刚刚呈现出溺水时,溺水状态的可靠快速检测更具有实际意义。如图9a所示,提取人体的18个骨骼关键点,通过18个骨骼关键点的相对位置判断人体的姿态。

62.溺水时,人体的体态特征包括:

63.1)水下溺水特征:双脚不停摆动,并且身体上下浮动,脚部位的位置坐标随时间变化;

64.2)最终溺水特征:人体平行于水面,并且漂浮在水面之上,可判断随时间推移关键骨骼点是否有相对变化,以得出结论是否出现最终溺水特征。

65.人在刚刚溺水时,人的身体往往会头朝上,水下的双腿上下浮动,从水面下拍摄的图像中不太容易识别出人的整个身体,以图9b所示的人下半身的骨骼关键点为核心,可检测骨骼关键点的相对位置随时间的变化,从而检测水下溺水的状态。

66.如图10所示,基于水中人体图像的人体溺水检测方法,包括以下步骤:

67.步骤1:拍摄得到水中人体的图像;

68.步骤2:利用改进的yolov5s模型对图像进行人体目标检测,得到人体定位框;

69.如图6所示,yolov5s的网络模型包括骨干网络backbone、多尺度特征融合模块neck、预测端prediction。

70.实施例的yolov5s在backbone网络的第一层focus中,对高分辨率图像进行重构,对每个像素点周围的四个点进行堆叠,得到低分辨率图像,提高每个点的视野,减少原始信息的丢失,目的是为了减少计算量,加快计算速度。backbone网络的第三层c3/bottleneckcsp包含bottleneck和csp两部分,目的是为了提高卷积神经网络学习能力。backbone网络的第九层的spp模块采用5/9/13的最大池化后,再进行concat融合,提高每个点的视野。实施例的yolov5s的多尺度特征融合模块neck采用mask r-cnn和fpn框架,帮助像素传达强定位特征,两者同时使用可加强网络特征融合能力。

71.实施例的yolov5s的prediction模块包含损失函数bounding box和非极大值抑制(nonmaximum suppression,nms)。实施例的yolov5s中加入参数iou-thres,有效地解决了边界框不重合的问题,将值设为0.45,效果达到最好,有效地提高了预测框回归速度和精度。实施例的yolov5s在人体检测定位阶段使用nms,对复杂的环境如光影、遮盖等增强了识别能力,获得最优目标检测框。

72.如图7所示,实施例改进的yolov5s模型在yolov5s模型的基础上,对backbone网络的卷积层和head网络的卷积层均增加卷积权重系数,对backbone网络的上采样层和head网络的上采样层均增加上采样系数,bottleneckcsp模块数量设置为(3,6,6,3),将类别数量

nc设置为1。

73.实施例改进的目标检测模型yolov5s的模型参数量为8.1m,现有技术的yolov5s的模型参数量为7.1m,m表示兆。

74.步骤3:采用alphapose模型识别人体定位框中的人体姿态,得到骨骼关键点并确定其坐标;

75.如图8所示,实施例的alphapose模型采用区域多人姿态估计网络(regional multi-person pose estimation,rmpe)根据图像的人体定位框检测识别出多人姿态,rmpe包括依次连接的空间变换网络(space transformation network,stn)、单人姿态估计(single person pose estimation,sppe)、空间去转换器网络(spatial de-transformer network,sdtn)和姿态非极大值抑制器(parametric pose non-maximum suppression,ppnms)。

76.stn用于从多个人体定位框的图像中分割、提取单个的人体定位框以便于进一步进行单人姿态识别;sdtn用于将检测识别的人姿态变换还原到原图像中,sdtn实现stn的逆向过程,stn与sdtn形成对称空间变换网络(symmetric space transformation network,sstn)。sppe用于根据人体定位框检测识别出人姿态。实施例的sstn与sppe的组合,实现了对图像中多人姿态的检测识别。ppnms用于消除冗余姿态估计,通过定义姿态的距离计算相似程度来删除冗余的检测框,提高人姿态检测识别的精度。

77.在训练rmpe过程中,增加一条与sstn并行的流水线pipeline,并行流水线包括姿态引导的样本生成器(pose-guided proposals generator,pgpg)和平行sppe(parallel sppe)。pgpg根据训练样本中已确定的真实姿态和人体定位框,生成服从特定分布的人体定位框的样本,增加人体定位框不精确的样本,以训练提高实施例的sstn与sppe组合的姿态检测模型对不精确人体定位框的适应能力。为提高人姿态检测识别的精度,sppe输出的姿态标记应居中。平行sppe和姿态检测模型中与sstn组合的sppe共用stn,训练过程中将平行sppe的姿态标记与训练样本的真实的居中的人姿态相比较并计算偏差,将偏差反向传播给stn,以训练stn,使stn能聚焦在正确区域,提取出高准确度的人体区域。

78.实施例的rmpe参照卢策武等人2018年发表的论文“rmpe:regional multi-person pose estimation”公开的rmpe模型。

79.实施例中,利用alphapose模型对图像中的人体目标进行检测,得到图9a所示的人体骨骼的18个关键点,并得到这些关键点在图像中的坐标。

80.步骤4:根据人体骨骼关键点坐标,计算得到人体体态特征,根据人体体态特征判断是否溺水,若出现溺水,判断溺水时间长短,并发出警报;

81.步骤4.1:分别计算对应人体脚部的骨骼关键点(10)、(13)的线速度v

10

、v

13

,并利用骨骼关键点(11)、(13)的线速度计算得到人体单腿速度v

11-13

;计算人体胸部重心o的线速度vo;

82.实施例中,上述线速度根据连续的m帧图像中具有时间间隔的图像帧计算得到。人体胸部重心o的位置根据骨骼关键点(1)、(8)和(11)的坐标计算得到。

83.步骤4.2:计算人体脚部的线速度v

10

、v

13

与人体胸部重心o线速度vo的比例,初步判断是否出现溺水现象;

84.溺水判断的计算式如下:

[0085][0086]

式中λ表示设定的阈值,α、β分别表示平均线速度的上限、下限;

[0087]

如果v

10

、v

13

、vo、v

11-13

满足式(i),则初步判定为水下溺水,结束;如果v

10

、v

13

、vo、v

11-13

不满足式(i),则执行步骤4.3;

[0088]

步骤4.3:计算人体上半身中垂线与水平面夹角θa,若θ0<θa<θ1,夹角θa在时间t内持续保持在此范围内,且a<vo<b,则判定为最终溺水,结束。

[0089]

式中θ0表示溺水人体上半身中垂线与水平面夹角的最小值,θ1表示溺水人体上半身中垂线与水平面夹角的最大值,a表示线速度的下阈值,b表示线速度的上阈值;否则,执行步骤4.4;

[0090]

步骤4.4:计算人体中垂线与水平线夹角θb,若θ2<θb<θ3,夹角θb在时间t内持续保持在此范围内,且c<vo<d,并且人体头部的骨骼关键点也能被检测到,则判断为最终溺水,否则判定为未溺水,式中θ2表示溺水人体中垂线与水平面夹角的最小值,θ3表示溺水人体中垂线与水平面夹角的最大值,c表示线速度最小值,d表示线速度最大值。

[0091]

基于智能手环的人体溺水检测方法,包括以下步骤:

[0092]

s1:分别利用智能手环获取正常游泳和模拟溺水人员在水中的心率、水下深度以及x、y、z轴加速度;

[0093]

s2:采用支持向量机构建溺水检测模型,利用步骤s1得到的数据作为溺水检测模型的输入对其进行训练;

[0094]

s3:利用智能手环实时采集待测水中人体的心率、水下深度以及x、y、z轴加速度;

[0095]

s4:将步骤s3采集得到的数据作为溺水检测模型的输入,进行实时的溺水现象检测,若检测到溺水现象,则执行步骤s5,否则执行步骤s3;

[0096]

s5:获取溺水人体的位置,发出溺水警报。

[0097]

步骤s2的支持向量机参照2011年第40卷《电子科技大学学报》刊登的丁世飞等人的论文“支持向量机理论与算法研究综述”公开的支持向量机模型。

[0098]

溺水人员救援方法,包括以下步骤:

[0099]

1)服务器根据无人机、水下摄像头或水下机器人等采集的水中人体的图像进行溺水检测,或者根据智能手环采集的人员的心率、水下深度以及三轴加速度数据进行溺水检测,检测到人体溺水现象时,确定溺水人员的位置,将溺水人员的定位坐标以及溺水人员的图像发送到水下机器人,将溺水人员的定位坐标发送到无人机,执行步骤2),否则重复执行步骤1);

[0100]

2)无人机根据溺水人员的定位坐标,在救援地点投放水下机器人;

[0101]

3)控制水下机器人在水中行驶到溺水人员位置,采集所在位置人员的图像,并判断确认是否为救援目标;

[0102]

4)控制水下机器人,使水下机器人的人体支撑座对准溺水人员的背部;

[0103]

5)控制救生鱼牵引救生带对溺水人员躯体进行环绕;救生鱼牵引救生带环绕溺水人体后,控制救生鱼环绕人体支撑座进行圆周运动,继续将救生带紧实地缠绕在人体支撑座的根部;缠绕救生带后,控制救生鱼回游到收纳室,并对救生带充气;

[0104]

6)控制水下机器人驶向水面,使溺水人员头部露出水面。

[0105]

实施例的改进的yolov5s模型为轻量化模型,在检测精度与速度之间达到平衡,提高了人员溺水现象检测的时效性。

[0106]

水下机器人100对救生带充气时,通过控制器开启救生带103充气端的电磁阀,高压气罐108内的液氮流经电磁阀后气化,将救生带103充满。

[0107]

实施例中,水下机器人1还包括在控制器的处理器上运行的目标识别模块,目标识别模块根据摄像头104拍摄的图像,识别水中人体,根据人体的图像特征,与服务器提供的溺水人员的图像特征进行对比,进而判断其是否为救援目标。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。