1.本发明涉及图像检测的技术领域,尤其是指一种基于特征感知和多通道学习的图像色差检测方法。

背景技术:

2.随着工业领域的智能化发展,越来越多的工业检测任务开始应用视觉检测系统取代人工检测,如x光图像危险品检测、pcba(printed circuit board assembly)缺陷检测等。

3.x光图像是由x射线穿透待检测物体、根据物体的不同密度渲染出不同颜色所得到的图像,常用于安检识别危险品。pcba是通过贴片或打孔方式安装了各种元器件的电路板,为了保证生产质量,需要在出厂前对电路板成像进行质检。在视觉检测系统中,可利用x光图像中危险品与背景或pcba图像中缺陷与正常品间的纹理颜色差异信息进行目标检测。

4.相比于自然场景图像,上述工业图像在成像过程中易受噪声或其他因素干扰,如x光图像在物品堆叠或成像角度畸变时,危险品对象特征不稳定,容易与背景特征混叠,难以检测;pcba在板底复杂、元器件密时,所成图像具有复杂纹理及图案,缺陷色差难以察觉,若存在污渍,则更容易出现漏检误检。在以上纹理复杂且对象特征不稳定的情况下,任务目标检测更为困难,所以对复杂纹理及图案图像的色差检测一直是亟待解决的难题。

5.而近几年交通行业和快递行业的发展造成了x光行李/快递安检方面的巨大压力,pcba是空调、电热水器、洗衣机、冰箱等常用家电的核心器件,它的质量检测关系到家电的安全生产和可靠使用。因此,迫切需要研发准确可靠的算法解决上述工业检测的难题。

技术实现要素:

6.本发明的目的在于克服现有技术的缺点与不足,提出了一种基于特征感知和多通道学习的图像色差检测方法,利用多通道学习模块获取图像的全面特征,再利用特征感知模块在区分图像复杂纹理的同时挖掘图像的微小色差变化,实现对具有复杂纹理及图案的图像高速高精度色差检测。

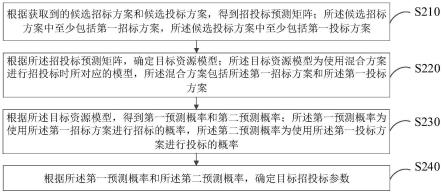

7.为实现上述目的,本发明所提供的技术方案为:基于特征感知和多通道学习的图像色差检测方法,包括以下步骤:

8.1)采集具有复杂纹理及图案的图像,对图像中的色差异常标注色差偏移量及位置,构建用于训练色差检测网络的训练集;其中,所述色差检测网络由多通道学习模块、特征感知模块、区域建议网络和预测回归网络组成;

9.2)将训练集中的图像输入色差检测网络进行训练,具体过程如下:

10.2.1)图像输入多通道学习模块,获取图像全面特征图;

11.2.2)将图像全面特征图输入特征感知模块,获得感知加权后的特征图;

12.2.3)将感知加权后的特征图输入区域建议网络,得到被网络判断存在色差异常的区块特征图;

13.2.4)将区块特征图输入预测回归网络,得到色差异常位置及色差偏移量,与真实的色差异常位置及色差偏移量做运算,计算损失,通过损失函数反向传播,调整多通道学习模块、特征感知模块及预测回归网络的参数;

14.3)返回步骤2),重新将训练集中的图像输入调整后的色差检测网络进行迭代训练,不断重复步骤2)至3),直至训练次数大于预设迭代次数,将最后一次得到的网络确定为训练好的色差检测网络;

15.4)将待检测的具有复杂纹理及图案的图像输入训练好的色差检测网络,识别出超过阈值的色差异常并在图中标注色差偏移量及位置,完成对具有复杂纹理及图案的图像的色差检测。

16.进一步,在步骤1)中,具有复杂纹理及图案的图像是物品繁多的快递包裹在x光机下成像得到的x光图像或具有复杂纹理板底的pcba在光学成像装置下得到的图像,为rgb格式图像,标注色差位置与色差偏移值,构建训练集。

17.进一步,在步骤2.1)中,所述多通道学习模块包含通道变换和分通道特征提取两个步骤:

18.2.1.1)在通道变换步骤,利用原先的rgb格式图像转换出hsv格式图像和yuv’格式图像,对图像中的每一个像素点做如下操作:

19.c

max

=max(r,g,b),c

min

=min(r,g,b),δ=c

max-c

min

[0020][0021]

y=0.299

·

r 0.587

·

g 0.114

·

b,u=(b-y)/1.772,v

′

=(r-y)/1.402

[0022]

式中,c

max

为像素点rgb三个通道值中的最大值,c

min

为像素点rgb三个通道值中的最小值,δ为c

max

与c

min

的差值,(r,g,b)为像素点rgb三个通道的值,(h,s,v)和(y,u,v

′

)分别为转换得到的hsv格式和yuv’格式的对应通道值,

·

为乘法运算;

[0023]

2.1.2)在分通道特征提取步骤,用不同的卷积层对图像所有9个通道进行分通道特征提取,获取图像全面特征图:

[0024]fi

[x,y]=ii[x,y]*wi[d,e],i∈{r,g,b,h,s,v,y,u,v

′

}

[0025]

式中,fi[x,y]表示对应i通道的特征图,ii[x,y]为对应i通道的图像,wi[d,e]表示对应i通道的卷积层中的卷积核,*为卷积运算。

[0026]

进一步,在步骤2.2)中,将图像全面特征输入特征感知模块,获得感知加权后的特征图:

[0027]

对不同通道的特征图加权求和:

[0028][0029]

将不同通道的特征图两两拼接再加权求和:

[0030][0031]

将上述两步求和得到的特征图c0[x,y]和c1[x,y]拼接,并通过k层卷积,得到感知加权后的特征图:

[0032]

c[x,y]=[c0[x,y]||c1[x,y]]*w1[d,e]*......*wk[d,e]

[0033]

以上三个公式中,fi[x,y]和fj[x,y]分别表示对应i通道和j通道的特征图,(r,g,b)为像素点rgb三个通道的值,(h,s,v)和(y,u,v

′

)分别为转换得到的hsv格式和yuv’格式的对应通道值,δi和δ

ij

为对应不同通道的感知权重,w1[d,e]......wk[d,e]为第1层到第k层的卷积核,*为卷积运算,

·

为乘法运算,c[x,y]为感知加权后的特征图。

[0034]

进一步,在步骤2.3)中,将感知加权后的特征图输入区域建议网络(rpn,为专有网络),得到被网络判断存在色差异常的区块特征图:

[0035]

{m1[x,y],......,mn[x,y]}=rpn(c[x,y])

[0036]

式中,c[x,y]为感知加权后的特征图,rpn()为区域建议网络,m1[x,y],......,mn[x,y]为n个存在色差异常概率高的区块特征图。

[0037]

进一步,所述步骤2.4)包括以下步骤:

[0038]

2.4.1)将区块特征图输入预测回归网络,得到色差异常位置及色差偏移量;

[0039]

色差偏移值预测:zr=h(mr[x,y])

[0040]

式中,mr[x,y]为存在色差异常概率高的区块特征图,h()是预测回归网络的预测部分,zr为预测得到的色差偏移值;

[0041]

边框预测:[xo,yo,h,w]=g(mr[x,y])

[0042]

式中,g()为预测回归网络的回归部分,[xo,yo,h,w]为网络输出的色差异常位置,用中心坐标[xo,yo]和宽高[h,w]描述一个边框;

[0043]

2.4.2)将预测值与真实的色差异常位置与色差偏移量做运算,计算损失,通过损失函数反向传播,调整多通道学习模块、特征感知模块及预测回归网络的参数;

[0044]

损失函数:

[0045][0046]

l

pre

=-(zk·

log(pk) (1-zk)

·

log(1-pk))

[0047][0048]

式中,l

pre

表示色差偏移量预测损失,表示边框回归损失,l表示总损失,zk表示预测得到的色差偏移值,pk表示真实色差偏移值,ti表示预测得到的位置参数向量,表示真实的位置参数向量,(x

o*

,y

o*

,h

*

,w

*

)为真实边框的中心坐标[x

o*

,y

o*

]和宽高[h

*

,w

*

]。

[0049]

本发明与现有技术相比,具有如下优点与有益效果:

[0050]

1、本发明方法设计的多通道学习模块,不局限于图像原有通道的信息利用,通过通道变换利用图像的多通道信息,能获得复杂纹理图像更全面的特征。

[0051]

2、本发明方法设计的特征感知模块,可以在图像具有复杂纹理时感知对色差检测有效的特征,挖掘图像的微小色差变化,实现对具有复杂纹理及图案的图像的色差检测。

[0052]

3、本发明方法在x光图像违禁品检测与pcba缺陷检测任务上的精度,均高于其它检测方法,且能有效实现对具有复杂纹理及图案的图像的高速高精度色差检测。

[0053]

4、本发明方法在工业视觉检测中具有广阔的应用前景,可以应用于多种任务检测场景。

具体实施方式

[0054]

下面结合实施例对本发明作进一步详细的描述,但本发明的实施方式不限于此。

[0055]

本实施例公开了一种基于特征感知和多通道学习的图像色差检测方法,包括以下步骤:

[0056]

1)采集具有复杂纹理及图案的图像,该图像可以是物品繁多的快递包裹在x光机下成像得到的x光图像或具有复杂纹理板底的pcba在光学成像装置下得到的图像,为rgb格式图像,标注色差位置(危险品或缺陷)与色差偏移值,构建用于训练色差检测网络的训练集,其中,所述色差检测网络由多通道学习模块、特征感知模块、区域建议网络和预测回归网络组成。

[0057]

2)将训练集中的图像输入色差检测网络进行训练,具体过程如下:

[0058]

2.1)图像输入多通道学习模块,获取图像全面特征图。多通道学习模块包含通道变换和分通道特征提取两个步骤:

[0059]

2.1.1)在通道变换步骤,利用原先的rgb格式图像转换出hsv格式图像和yuv’格式图像,对图像中的每一个像素点做如下操作:

[0060]cmax

=max(r,g,b),c

min

=min(r,g,b),δ=c

max-c

min

[0061][0062]

y=0.299

·

r 0.587

·

g 0.114

·

b,u=(b-y)/1.772,v

′

=(r-y)/1.402

[0063]

式中,c

max

为像素点rgb三个通道值中的最大值,c

min

为像素点rgb三个通道值中的最小值,δ为c

max

与c

min

的差值,(r,g,b)为像素点rgb三个通道的值,(h,s,v)和(y,u,v

′

)分别为转换得到的hsv格式和yuv’格式的对应通道值,

·

为乘法运算。

[0064]

2.1.2)在分通道特征提取步骤,用不同的卷积层对图像所有9个通道进行分通道特征提取,获取图像全面特征图:

[0065]fi

[x,y]=ii[x,y]*wi[d,e],i∈{r,g,b,h,s,v,y,u,v

′

}

[0066]

式中,fi[x,y]表示对应i通道的特征图,ii[x,y]为对应i通道的图像,wi[d,e]表示对应i通道的卷积层中的卷积核,*为卷积运算。

[0067]

每次卷积的具体过程如下:

[0068][0069]

式中,i[x,y]为图像,w[d,e]为卷积核,f[x,y]为卷积后所得特征。n1表示卷积核的长度,n2表示卷积核的宽度,i[x d,y e]表示正在卷积的图像像素点位置。

[0070]

图像经过多通道学习模块,学习到带有图像充分信息的全面特征,rgb图像只反映颜色信息,而hsv和yuv’图像,可以表示图像的色调、亮度、饱和度,能更准确的感知颜色联系,有利于后续对微小色差的检测。

[0071]

2.2)将图像全面特征图输入特征感知模块,获得感知加权后的特征图:

[0072]

对不同通道的特征图加权求和:

[0073][0074]

将不同通道的特征图两两拼接再加权求和:

[0075][0076]

将上述两步求和得到的特征图c0[x,y]和c1[x,y]拼接,并通过k层卷积,得到感知加权后的特征图:

[0077]

c[x,y]=[c0[x,y]||c1[x,y]]*w1[d,e]*......*wk[d,e]

[0078]

以上三式中,fi[x,y]和fj[x,y]分别表示对应i通道和j通道的特征图,δi和δ

ij

为对应不同通道的感知权重,w1[d,e]......wk[d,e]为第1层到第k层的卷积核,*为卷积运算,

·

为乘法运算,c[x,y]为感知加权后的特征图。

[0079]

不同通道包含不同的信息,对色差检测过程中的贡献不同,特征感知模块通过学习加强对色差检测有利的特征,减弱无关特征的影响,使其能应对复杂纹理下的色差检测。

[0080]

2.3)将感知加权后的特征图输入区域建议网络(rpn,为专有网络),得到被网络判断存在色差异常(危险品或缺陷)的区块特征图:

[0081]

{m1[x,y],......,mn[x,y]}=rpn(c[x,y])

[0082]

式中,c[x,y]为感知加权后的特征图,rpn()为区域建议网络,m1[x,y],......,mn[x,y]为n个存在色差异常概率较高的区块特征图。

[0083]

在生成区块特征图的过程中,图像特征图中的每一个点定义为锚点anchor,每个锚点以自身为中心定义9个锚框,除去超出图像区域的锚框,对剩下的锚框mi[x,y]进行二分类pi=f(mi[x,y])和边框回归[xo′

,yo′

,h

′

,w

′

]=g(mi[x,y])。其中f()表示二分类器,g()表示线性回归函数。

[0084]

在二分类器对应的训练过程中,当锚框与真实标记框之间的交并比大于0.7时,将其判断为色差异常(危险品或缺陷)类,小于0.3则判断为正常类。在实际检测过程中,二分类输出z小于设定置信度阈值时表示锚框为非色差异常区块,不进入后续步骤,否则,表示锚框为色差异常区块,对其做边框回归操作,最终输出为锚框中心点坐标和宽高[xo′

,yo′

,h

′

,w

′

]。在边框回归的训练过程中,可以计算有效锚框和真实标记框之间的偏移量,用得到的差异来学习调整锚框的大小,使其更好的框住对象。

[0085]

对色差异常锚框使用非极大值抑制进行筛选,剔除重叠的锚框。再取置信度最高的前n个锚框,作为色差异常区块特征图,进入后续步骤处理。

[0086]

区域建议网络使用它独有的一个损失函数反向传播进行训练,目标是最小化以下损失函数:

[0087][0088][0089][0090]

式中,l

′

cls

为二分类损失,为回归损失,pi为锚框的预测值,为锚框的真实值,如果锚框为色差异常类,则为1,否则为0,λ为损失权重,ti′

是一个向量,表示锚框的预测坐标,为真实标记框的坐标,包括中心点坐标和宽高(x

o*

,y

o*

,h

*

,w

*

)。当锚框为非色差异常时,不参与回归损失的计算。n

cls

表示参与二分类的样本总数,n

reg

表示参与边框回归的样本总数。

[0091]

2.4)将区块特征图输入预测回归网络,得到色差异常位置及色差偏移量,与真实的色差异常位置及色差偏移量做运算,计算损失,通过损失函数反向传播,调整多通道学习模块、特征感知模块及预测回归网络的参数。

[0092]

2.4.1)将区块特征图输入预测回归网络,得到色差异常位置及色差偏移量。

[0093]

色差偏移值预测:zr=h(mr[x,y])

[0094]

式中,mr[x,y]为存在色差异常概率较高的区块特征图,h()是预测回归网络的预测部分,zr为预测得到的色差偏移值。

[0095]

边框预测:[xo,yo,h,w]=g(mr[x,y])

[0096]

式中,g()为预测回归网络的回归部分,[xo,yo,h,w]为网络输出的色差异常位置,用中心坐标[xo,yo]和宽高[h,w]描述一个边框。

[0097]

2.4.2)将预测值与真实的色差异常位置与色差偏移量做运算,计算损失,通过损失函数反向传播,调整多通道学习模块、特征感知模块及预测回归网络的参数。

[0098]

损失函数:

[0099][0100]

l

pre

=-(zk·

log(pk) (1-zk)

·

log(1-pk))

[0101][0102]

式中,l

pre

表示色差偏移量预测损失,表示边框回归损失,l表示总损失,zk表示预测得到的色差偏移值,pk表示真实色差偏移值,ti表示预测得到的位置参数向量,表示真实的位置参数向量。

[0103]

3)返回步骤2),重新将训练集中图像输入调整后的色差检测网络进行迭代训练,不断重复步骤2)至3),直至训练次数大于预设迭代次数。将最后一次得到的网络确定为训练好的色差检测网络。

[0104]

4)将待检测的具有复杂纹理及图案的图像输入训练好的色差检测网络,识别出超过阈值的色差异常并在图中标注色差偏移量及位置,完成对具有复杂纹理及图案的图像的色差检测。

[0105]

上述实施例为本发明较佳的实施方式,但本发明的实施方式并不受上述实施例的限制,其他的任何未背离本发明的精神实质与原理下所作的改变、修饰、替代、组合、简化,均应为等效的置换方式,都包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。