1.本技术涉及计算机视觉技术领域,具体涉及一种检测方法、检测装置和计算机可读存储介质。

背景技术:

2.车位检测是智能停车系统的基本处理步骤,由于摄像头的成像角度或车位不规则等问题,使得车位不只是规则的矩形,因此倾斜车位检测是亟需解决的难题;虽然相关技术中有些方案可以实现对倾斜的目标进行检测,但是存在对角度的预测精度较低的问题。

技术实现要素:

3.本技术提供一种检测方法、检测装置和计算机可读存储介质,能够提升车辆检测的精度。

4.为解决上述技术问题,本技术采用的技术方案是:提供一种车位检测方法,该方法包括:获取待检测图像,待检测图像包括待检测车辆;基于车辆检测模型,对待检测图像进行检测,得到模型输出结果,车辆检测模型是基于训练数据训练的,训练数据包括多张样本图像以及与样本图像中车辆对应的倾斜角度标签,车辆检测模型的损失值包括角度损失,角度损失为角度标签编码值与车辆检测模型输出的车辆的角度估计值的损失,角度标签编码值由基于预设编码角度间隔对倾斜角度标签编码得到,且角度损失的权重跟随车辆检测模型的训练情况自适应调整;对模型输出结果进行处理,得到车辆检测结果,车辆检测结果包括待检测车辆的倾斜角度。

5.为解决上述技术问题,本技术采用的技术方案是:提供一种车位检测方法,该方法包括:获取目标监控场景中的待检测图像,待检测图像包括待检测车辆;基于车辆检测模型,对待检测图像进行检测,得到模型输出结果,车辆检测模型是基于训练数据训练的,训练数据包括多张样本图像以及与样本图像中车辆对应的倾斜角度标签,车辆检测模型的损失值包括角度损失,角度损失为角度标签编码值与车辆检测模型输出的车辆的角度估计值的损失,角度标签编码值由基于预设编码角度间隔对倾斜角度标签编码得到,且角度损失的权重跟随车辆检测模型的训练情况自适应调整;对模型输出结果进行处理,得到车辆检测结果,车辆检测结果包括待检测车辆的倾斜角度;基于车辆检测结果与预设车位数据,得到车位空闲结果,车位空闲结果为目标监控场景中的车位是否被待检测车辆覆盖。

6.为解决上述技术问题,本技术采用的另一技术方案是:提供一种检测装置,该检测装置包括互相连接的存储器和处理器,其中,存储器用于存储计算机程序,计算机程序在被处理器执行时,用于实现上述技术方案中的车位检测方法。

7.为解决上述技术问题,本技术采用的另一技术方案是:提供一种计算机可读存储介质,该计算机可读存储介质用于存储计算机程序,计算机程序在被处理器执行时,用于实现上述技术方案中的车位检测方法。

8.通过上述方案,本技术的有益效果是:先采用训练数据对车辆检测模型进行训练,

该训练数据包括多张样本图像以及与样本图像中车辆对应的倾斜角度标签;在训练过程中,利用预设编码角度间隔对车辆的倾斜角度标签进行编码得到角度标签编码值,计算角度标签编码值与车辆的角度估计值之间的损失,得到角度损失,且角度损失的权重跟随车辆检测模型的训练情况自适应调整,经过训练最终获得一个训练完的车辆检测模型;在实际应用中,先获取包含待检测车辆的待检测图像,再采用训练完的车辆检测模型对待检测图像进行检测得到模型输出结果;然后对模型输出结果进行解码,得到包含待检测车辆的倾斜角度的车辆检测结果;由于在计算模型的损失值时,根据预设编码角度间隔对倾斜角度标签进行了编码,编码后的角度的长度较短,有助于减少模型的输出通道数目,有助于简化模型;而且,能够通过自适应调整角度损失的权重,改善对角度的预测精度,进而提高车辆检测模型的检测精度。

附图说明

9.为了更清楚地说明本技术实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。其中:

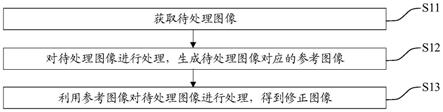

10.图1是本技术提供的倾斜车位检测与水平车位检测的对比示意图;

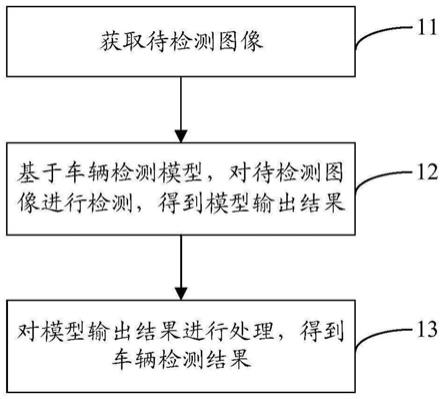

11.图2是本技术提供的车辆检测方法一实施例的流程示意图;

12.图3是本技术提供的旋转框的示意图;

13.图4是本技术提供的车辆检测方法另一实施例的流程示意图;

14.图5是本技术提供的车辆检测模型的示意图;

15.图6是本技术提供的车辆的检测框的矫正示意图;

16.图7是本技术提供的车位检测方法一实施例的流程示意图;

17.图8是本技术提供的待检测图像的可视化结果;

18.图9是本技术提供的检测装置一实施例的结构示意图;

19.图10是本技术提供的计算机可读存储介质一实施例的结构示意图。

具体实施方式

20.下面结合附图和实施例,对本技术作进一步的详细描述。特别指出的是,以下实施例仅用于说明本技术,但不对本技术的范围进行限定。同样的,以下实施例仅为本技术的部分实施例而非全部实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其它实施例,都属于本技术保护的范围。

21.在本技术中提及“实施例”意味着,结合实施例描述的特定特征、结构或特性可以包含在本技术的至少一个实施例中。在说明书中的各个位置出现该短语并不一定均是指相同的实施例,也不是与其它实施例互斥的独立的或备选的实施例。本领域技术人员显式地和隐式地理解的是,本文所描述的实施例可以与其它实施例相结合。

22.需要说明的是,本技术中的术语“第一”、“第二”、“第三”仅用于描述目的,而不能理解为指示或暗示相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”、“第三”的特征可以明示或者隐含地包括至少一个该特征。本技术的描述中,“多个”的含义是至少两个,例如两个,三个等,除非另有明确具体的限定。此外,术语“包括”和“具有”以及它们任何变形,意图在于覆盖不排他的包含。例如包含了一系列步骤或单元的过程、方法、系统、产品或设备没有限定于已列出的步骤或单元,而是可选地还包括没有列出的步骤或单元,或可选地还包括对于这些过程、方法、产品或设备固有的其它步骤或单元。

23.基于相机安装角度以及停车区的区域分布情况,如图1所示,室外停车场景一般有两种:一种是车位线与相机视角水平,如图1(a)所示;另一种是车位线与相机视角非水平,如图1(b)所示。当视角水平时,车头、车尾或车身正对相机,车辆的外接矩形框(即a)与所停车位的车位线(即b)高度匹配;当视角非水平时,车辆间存在遮挡,车位线由水平矩形变为倾斜的四边形,非水平的角越大,遮挡越严重,车位线倾斜度越大,导致车辆的外接矩形框跨越多个车位线,此时无论由车辆外接矩形框中心点绑定车位线,还是由车位线中心点绑定外接矩形框,都会有产生判断错误的风险,导致绑定停车位状态的准确率下降。

24.本技术针对上述车位绑定问题,提供了一种旋转目标检测算法,通过对旋转角度以及旋转目标同外接矩形框尺度变化的预测,得出车辆的实际四边形框,此四边形能够较少地占用两侧的车位线区域,以高准确率绑定实际的停车位。

25.请参阅图2,图2是本技术提供的车辆检测方法一实施例的流程示意图,该方法包括:

26.步骤11:获取待检测图像。

27.可从数据库中获取一张图片作为待检测图像,待检测图像包括待检测车辆;或者利用摄像设备(比如:相机)对目标监控场景进行拍摄,生成待检测图像。在获取到待检测图像后,可对待检测图像进行预处理,以便车辆检测模型处理,预处理的方式可以为调整待检测图像的大小、图像增强或几何变换等常见方式。

28.在一具体的实施例中,为了解决实际应用中可能存在的部分遮挡问题,可在从前端相机获取停车场中的图像(即待检测图像)后,使用滑动窗口的方法将待检测图像分割成尺寸为s*s(s可取为1024或512)的子图,同时将对应的坐标也分配至各小图中。可以理解地,相邻的两个子图之间可具有重叠区域,可以根据实际应用需要设置不同的重叠率(即重叠区域的面积占子图的面积的比例),重叠率越高,对模型的精度提升越有益,如可以但不局限于将上述重叠率设置为不超过50%。

29.步骤12:基于车辆检测模型,对待检测图像进行检测,得到模型输出结果。

30.车辆检测模型是基于训练数据训练的,其可以为卷积神经网络模型;训练数据包括多张样本图像以及与样本图像中车辆对应的倾斜角度标签,车辆检测模型的损失值包括角度损失,角度损失为角度标签编码值与车辆检测模型输出的车辆的角度估计值的损失,角度标签编码值由基于预设编码角度间隔对倾斜角度标签编码得到,且角度损失的权重跟随车辆检测模型的训练情况自适应调整。具体地,编码的方式可以为二进制编码,可根据当前训练次数、当前训练时长、角度损失的大小或当前车辆检测模型对应的损失值(即当前损失值),调整角度损失的权重。

31.在一具体的实施例中,如图3所示,本实施例基于长边定义法来表示旋转框,固定预设角度范围为[0,180),定义[x,y,w,h]分别为检测框的中心点的横坐标、中心点的纵坐标、长边、短边。例如,图3为本实施例采用的旋转框定义表示图,旋转框在水平框的基础上

还需要表达角度信息,分别包含框中心点(x,y)、框的宽度w、框的高度h和框的角度θ,该角度表示的是对角线与水平轴的逆时针夹角。

[0032]

步骤13:对模型输出结果进行处理,得到车辆检测结果。

[0033]

在车辆检测模型对待检测图像处理得到模型数据结果之后,可对该模型输出结果中的部分数据进行解码,生成相应的解码后的信息;具体地,模型输出结果包括预测角,对该预测角度进行解码得到待检测车辆的倾斜角度。

[0034]

本实施例中对车辆检测模型进行训练的过程中,在计算模型的损失值时,根据预设编码角度间隔,对样本图像中车辆的倾斜角度标签进行了编码,编码后的角度的位数较短,有助于减少模型的输出通道数目,简化模型;而且,能够通过二进制编码,克服独热编码无法衡量角度之间的距离的问题,改善对角度的预测精度,进而提高模型的检测精度,该方案能够用于智能停车场系统或安全监控系统等。

[0035]

请参阅图4,图4是本技术提供的车辆检测方法另一实施例的流程示意图,该方法包括:

[0036]

步骤21:从训练数据中选择一张样本图像并输入车辆检测模型,得到训练检测结果。

[0037]

利用车辆检测模型对当前选出的样本图像进行检测,生成相应的训练检测结果。

[0038]

在一具体的实施例中,车辆检测模型可以但不局限于为yolov5(you only look once)网络,如图3所示,车辆检测模型可以但不局限于包括骨干(backbone)模块、颈部(neck)模块以及检测头(head)模块,backbone模块包括通道洗牌(shuffle)模块与空间金字塔池化(spatial pyramid pooling,spp)模块;采用shuffle模块对样本图像进行特征提取处理,得到第一特征数据;采用spp模块对第一特征数据进行处理,得到第二特征数据;采用neck模块对第二特征数据进行上采样和拼接操作,以进行融合处理,得到第三特征数据,能够充分利用上下文信息,以便网络学习到更多有用的特征;采用head模块对第三特征数据进行分类和回归处理,得到训练检测结果。

[0039]

进一步地,对于backbone模块来说,本技术实施例中可以采用的轻量级网络shufflenetv2和spp网络的结合,同时将相关技术中backbone模块中的focus结构替换成普通卷积层(即conv),以实现下采样,该结构所使用的参数减少,可以对模型进行加速。neck模块采用fpn(feature pyramid networks,特征金字塔网络)和pan(perceptual adversarial network,感知对抗网络)的集成结构,该结构可使不同层间特征充分融合。对于head模块来说,将三个1

×

1的卷积层输出的特征分别进行分类和回归操作,在head模块增加了角度输出层,head模块的输出包含坐标(coord)通道输出(4维向量)、类别(class)通道输出(2维向量,输出目标和背景)、置信度(conf)通道输出(1维向量)以及角度(angle)通道输出(8维向量),因此,模型的输出维度为:4 2 1 8=15。

[0040]

本实施例将原始的yolov5网络中的focus结构替换成卷积结构进行下采样,同时利用shufflenetv2和spp模块组成backbone模块,使得模型在减少一定参数量的同时,可以适应不同的边缘计算设备,提高了模型在边缘段推理的性能;而且,由于在head模块设置8个输出通道对角度进行精确分类,有助于提升对角度的检测精度,进而提升整体检测精度。

[0041]

可以理解地,除了采用yolov5网络以外,还可采用其他目标检测网络,比如:快速区域卷积神经网络(faster region convolutional neural networks,faster r-cnn)或

单次多框检测器(single shot multibox detector,ssd)。

[0042]

步骤22:计算位置标签与位置估计值之间的损失,得到位置损失。

[0043]

车辆检测模型的损失值包括位置损失,训练数据还包括与样本图像对应的位置标签,该训练检测结果包括与样本图像中车辆对应的位置估计值。具体地,由于室外停车场场景较为复杂,可能存在长宽比较大的目标,对角度和距离比较敏感,因此在计算位置损失时采用对距离和位置比较敏感的ciou(intersection over union,交并比)损失,以取得更好的效果,即采用如下公式计算位置损失:

[0044]

l

coord

=ciou(bboxg,bbox

p

)

ꢀꢀ

公式(1)

[0045]

其中,在公式(1)中,l

coord

为位置损失,表示车辆的检测框回归损失,用以训练车辆的位置,bboxg为真实边框的位置坐标(即位置标签),bbox

p

为预测的边框(即预测框)的位置坐标。

[0046]

步骤23:基于预设最大倾斜角度与预设角度间隔,计算角度标签编码值,将倾斜角度标签与预设编码角度间隔相除得到第一数值,采用二进制编码对第一数值进行编码得到角度标签编码值。

[0047]

采用如下步骤来获取预设编码角度间隔:

[0048]

1)定义预设角度范围[0,180),预设角度范围中相邻两个角度之间的间隔(即预设角度间隔)记作k,k可以为1;预设最大倾斜角度记作r,其值为180。

[0049]

2)将预设最大倾斜角度与预设角度间隔相除,得到第二数值;对第二数值进行对数变换与取整处理,得到编码长度。

[0050]

可采用如下公式计算编码长度:

[0051][0052]

其中,在公式(2)中,为向上取整操作。

[0053]

3)基于编码长度与第二数值,得到预设编码角度间隔。

[0054]

采用如下公式计算预设编码角度间隔:

[0055][0056]

4)将真实的角度(即倾斜角度标签)转换为二值表示空间的角度值θb=θ/s,并将θb转换为相应的二进制数值(即角度标签编码值)。

[0057]

相较于独热(one-hot)编码来说,由于one-hot编码是一种稀疏编码方式,需要较长的位数来进行编码,在网络预测过程中需要设置较多的通道来对角度预测,给模型训练和测试带来了一定的负担;而本实施例所采用的这种编码方式相当于把角度类别信息编码到一个低维嵌入空间,能够将180类角度(即180个角度值)编码成八位的二进制数,一方面可以规避one-hot编码无法衡量角度之间的距离的问题,另一方面可以大大减少编码长度,在网络预测层上减少输出通道数目,提升模型训练和推理性能。

[0058]

步骤24:计算角度标签编码值与角度估计值之间的损失,得到角度损失。

[0059]

车辆检测模型的损失值还包括角度损失,该训练检测结果还包括角度估计值,采用如下公式计算出角度损失:

[0060][0061]

其中,在公式(4)中,l

angle

为角度损失,用于训练目标的方向角度,该损失值采用的是多分类交叉熵损失函数,表示角度估计值的第i个数值,表示角度标签编码值的第i个数值,1≤i≤8。

[0062]

步骤25:基于角度损失与位置损失,计算出当前损失值。

[0063]

训练数据还包括与样本图像对应的类别标签,训练检测结果还包括目标类别估计值;计算类别标签与目标类别估计值之间的损失,得到类别损失;计算位置标签对应的目标框标签与位置估计值对应的预测框之间的损失,得到置信度损失,目标框标签为位置标签中的数值所围成的目标框;对角度损失、类别损失、位置损失以及置信度损失进行加权求和,得到当前损失值。

[0064]

进一步地,在训练过程中,本实施例使采用的损失函数如下所示,其是一个多任务损失:

[0065]

l

rotate

=λ1×

l

cls

λ2×

l

corrd

λ3×

l

conf

λ4×

l

angle

ꢀꢀ

公式(5)

[0066][0067]

l

conf

=mse(overlapg,conf

p

)

ꢀꢀ

公式(7)

[0068]

其中,在公式(5)~(7)中,λ1~λ4为权重,l

cls

表示类别损失,用于训练车辆目标类别,l

cls

采用二分类交叉熵损失,类别标签采用的是one-hot编码的类别向量,pj表示目标类别估计值中的第j个数值,yj表示类别标签的第j个数值,1≤j≤2;l

conf

是置信度损失,用于回归目标的可信度,l

conf

采用的是均方误差(mean square error,mse)回归损失,overlapg为目标框标签,目标框标签采用的是传统的计算锚框(anchor)和真实框之间的最大iou的方式,本技术实施例中anchor是假设的不同长宽比的框,比如:假设一张图像的大小为9*9,则理论上anchor的数量为81个,如果anchor有3种长宽比(1:1、1:2、2:1),则anchor的数量为81*3个,真实框为图像中真实目标所在的框,overlapg是每个anchor和最近的真实框之间的交并比,其值可能为零,可能有多个(因为有些目标距离较近,因此一个anchor可能覆盖两个真实框),这种情况下将与真实框的交并比最大的anchor作为目标框标签,confg为预测框。

[0069]

步骤26:判断车辆检测模型是否满足预设训练结束条件。

[0070]

在计算出当前损失值之后,可判断车辆检测模型是否满足预设训练结束条件;如果车辆检测模型未满足预设训练结束条件,则返回从训练数据中选择一张样本图像并输入车辆检测模型的步骤,即返回步骤21,直至车辆检测模型满足预设训练结束条件。

[0071]

进一步地,该预设停止条件包括:损失值收敛,即上一损失值与当前损失值的差值小于设定值;判定当前损失值是否小于预设损失值,该预设损失值为预先设置的损失阈值,若当前损失值小于预设损失值,则确定达到预设停止条件;训练次数达到设定值(例如:可以但不局限于将上述设定值设置为10000);或者使用测试集进行测试时获得的准确率达到设定条件(比如:超过预设准确率)等。

[0072]

在实际应用场景中,由于大货车的车身较长,其长宽比往往很大;为了减少大长宽

比的目标对角度的影响,由于模型在前期训练时关注的是与坐标、类别相关的损失,对角度损失敏感度不大,因此可设定如下的训练策略:

[0073]

在车辆检测模型未满足预设训练结束条件时,对角度损失的权重进行调整。具体地,判断车辆检测模型是否满足预设调整条件;若车辆检测模型满足预设调整条件,则将角度损失的权重设置为第一预设值;若车辆检测模型未满足预设调整条件,则将角度损失的权重设置为第二预设值,第二预设值大于第一预设值。

[0074]

进一步地,可以判断当前训练次数是否达到预设次数,若当前训练次数达到预设次数,则确定满足预设调整条件。或者,判断当前训练时长是否达到预设时长,若当前训练时长达到预设时长,则确定满足预设调整条件;例如,在训练10万次后,调整角度损失的权重,使得模型训练能够拟合各种尺度大小的目标。或者,判断位置损失与类别损失之和是否大于第三预设值,若位置损失与类别损失之和大于第三预设值,则确定满足预设调整条件;例如,第三预设值为0.5,当位置损失和类别损失之和小于0.5时,将角度损失的权重调整至一个极小数值(比如:0.0001),重点优化位置损失和类别损失。

[0075]

步骤27:如果车辆检测模型满足预设训练结束条件,则结束训练,得到训练完的车辆检测模型。

[0076]

步骤28:基于车辆检测模型,对待检测图像进行检测,得到模型输出结果。

[0077]

步骤28与上述实施例中步骤12相同,在此不再赘述。

[0078]

步骤29:对模型输出结果进行处理,得到车辆检测结果。

[0079]

基于第四预设值,对第一角度检测值进行过滤处理,得到第二角度检测值;将第二角度检测值进行进制转换处理,得到第三角度检测值;将第三角度检测值与预设编码角度间隔相乘,得到待检测车辆的倾斜角度。

[0080]

进一步地,判断第一角度检测值中的每个数值是否大于第四预设值;若该数值大于第四预设值,则将该数值设置为第三数值;若该数值小于或等于第四预设值,则将该数值设置为第四数值。

[0081]

在一具体的实施例中,经过训练后,模型输出一个8维的向量(即第一角度检测值),第四预设值可以为0.5,第三数值为1,第四数值为0;如果该8维的向量中的某个数值大于0.5,则将该数值设置为1,否则设置为0;因此利用过滤能够得到一个二值向量,将该二值向量转换为十进制值;然后将该十进制值与预设编码角度间隔相乘,便可得到相应的角度值(即待检测车辆的倾斜角度)。

[0082]

在计算出待检测图像中待检测车辆所在的倾斜框之后,由于倾斜框的角度的特殊性,可通过计算交并比的方式进行非极大值处理;具体地,车辆检测结果输出待检测图像中各个目标的预测值[x,y,w,h,θ,score],分别为每个目标的预测框的中心点的横坐标、中心点的纵坐标、长、宽、角度值以及得分值;对得分值排序后,计算所有预测框与最大分数对应的预测框的之间的交并比,通过非极大值抑制算法去除冗余框;然后将剩余预测框映射回待检测图像,通过预测的角度值对预测框进行校正,得到车辆检测结果。例如,如图6所示,在获取到检测框b1之后,对其进行矫正得到检测框b2。

[0083]

本实施例提出了一种端到端的基于分类损失的倾斜车辆检测方法,缓解了传统角度回归方式带来的预测不稳定等难题,提高了倾斜目标检测的精度;而且,使用了基于二进制编码的方式对角度类别进行编码,能够减少编码位数,从而减少模型的输出通道数,有助

于减轻模型训练的负担。

[0084]

请参阅图7,图7是本技术提供的车位检测方法一实施例的流程示意图,该方法包括:

[0085]

步骤31:获取目标监控场景中的待检测图像。

[0086]

待检测图像包括待检测车辆。

[0087]

步骤32:基于车辆检测模型,对待检测图像进行检测,得到模型输出结果。

[0088]

车辆检测模型是基于训练数据训练的,训练数据包括多张样本图像以及与样本图像中车辆对应的倾斜角度标签,车辆检测模型的损失值包括角度损失,角度损失为角度标签编码值与车辆检测模型输出的车辆的角度估计值的损失,角度标签编码值由基于预设编码角度间隔对倾斜角度标签编码得到,且角度损失的权重跟随车辆检测模型的训练情况自适应调整。

[0089]

步骤33:对模型输出结果进行处理,得到待检测车辆的倾斜角度。

[0090]

步骤31-步骤33与上述实施例中步骤11-13类似,在此不再赘述。

[0091]

步骤34:基于车辆检测结果与预设车位数据,得到车位空闲结果。

[0092]

通过web端对视频数据中的车位进行标定,得到预设车位数据;车位空闲结果为目标监控场景中的车位是否被待检测车辆覆盖;模型输出结果包括车辆预测框,预设车位数据包括车位区域,基于车辆预测框与车位区域,判定车位是否满足预设覆盖条件;若车位满足预设覆盖条件,则车位空闲结果为车位被待检测车辆覆盖;若车位未满足预设覆盖条件,则车位空闲结果为车位未被待检测车辆覆盖。通过统计目标监控场景中所有的车位的状态,可以得到车位上是否停靠有车辆的信息,输出停车场所有车位是否空闲以及空闲总量等信息。

[0093]

进一步地,判断车辆预测框的中心点是否落在车位区域内;若车辆预测框的中心点落在车位区域内,则确定车位满足预设覆盖条件。或者,判断车辆预测框与车位区域的重合区域的面积是否大于预设面积;若车辆预测框与车位区域的重合区域的面积大于预设面积,则车位确定满足预设覆盖条件;例如,预设面积可以但不局限于为车辆预测框的面积的80%。

[0094]

例如,以图8所示的模型预测的可视化结果为例,车辆预测框分别为d1与d2,车辆预测框d1的置信度为0.92,车辆预测框d2的置信度为0.94。利用改进后的yolov5网络对图像进行处理后,可输出一个可视化图像,根据图8中各个车辆预测框和对应车位的位置关系,确定对应车位的空闲状态,从而可以确定剩余车位的数量,比如:以图8为例,可输出总车位为3个、剩余车位为1的车位检测结果。

[0095]

可以理解地,如果本方案用于处理指定停车场的监控视频中每一帧图像时,则可以基于每一帧图像的处理结果,确定该停车场内所有车位的空闲状态及空闲总量信息,实现动态检测车位是否空闲。

[0096]

本实施例提出了一种倾斜车位的后处理方法,通过检测不同车辆的倾斜框,来判断倾斜车位的空闲状态,进而统计停车场内所有车位的信息,实现车位是否空闲的检测。而且,不依赖于相机参数,不要求所有停车区内车位线趋势一致,通过对图像的检测便直接完成车辆检测和停车位绑定,实现简单。

[0097]

请参阅图9,图9是本技术提供的检测装置一实施例的结构示意图,检测装置90包

括互相连接的存储器91和处理器92,存储器91用于存储计算机程序,计算机程序在被处理器92执行时,用于实现上述实施例中的车位检测方法。

[0098]

请参阅图10,图10是本技术提供的计算机可读存储介质一实施例的结构示意图,计算机可读存储介质100用于存储计算机程序101,计算机程序101在被处理器执行时,用于实现上述实施例中的车位检测方法。

[0099]

计算机可读存储介质100可以是服务端、u盘、移动硬盘、只读存储器(rom,read-only memory)、随机存取存储器(ram,random access memory)、磁碟或者光盘等各种可以存储程序代码的介质。

[0100]

在本技术所提供的几个实施方式中,应该理解到,所揭露的方法以及设备,可以通过其它的方式实现。例如,以上所描述的设备实施方式仅仅是示意性的,例如,模块或单元的划分,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式,例如多个单元或组件可以结合或者可以集成到另一个系统,或一些特征可以忽略,或不执行。

[0101]

作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部单元来实现本实施方式方案的目的。

[0102]

另外,在本技术各个实施方式中的各功能单元可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中。上述集成的单元既可以采用硬件的形式实现,也可以采用软件功能单元的形式实现。

[0103]

以上所述仅为本技术的实施例,并非因此限制本技术的专利范围,凡是利用本技术说明书及附图内容所作的等效结构或等效流程变换,或直接或间接运用在其他相关的技术领域,均同理包括在本技术的专利保护范围内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。