1.本公开内容涉及信息处理装置、信息处理方法以及程序。

背景技术:

2.近年来,与用户通信的机器人装置已经变得普遍。在这种趋势下,需要这样的机器人装置具有用于实现与用户的更顺畅通信的技术。

3.例如,以下专利文献1公开了通过机器人装置模仿人类或生物动作以提高用户对机器人装置的熟练度的动作控制技术。具体地,专利文献1公开了基于用户与机器人装置的接触次数等来评估用户与机器人装置之间的亲密度以控制机器人装置从而使得其远离亲密度低的用户而接近亲密度高的用户的技术。

4.引文列表

5.专利文献

6.专利文献1:wo 2017/175559 a

技术实现要素:

7.技术问题

8.但是,由于上述专利文献1中公开的技术控制机器人装置与用户之间的距离,因此在提高用户与机器人装置之间的通信质量方面不是有效的。另外,不仅需要机器人装置,而且需要与用户通信的代理、智能扬声器等来提高这些装置与用户之间的通信质量。

9.因此,需要一种能够通过进一步增强用户与交互装置之间的交互来向用户提供更高质量的通信的技术。

10.问题的解决方案

11.根据本公开内容,提供了一种信息处理装置,包括:输出控制单元,其控制从交互装置到用户的输出;动作评估单元,其确定与交互装置的输出相对应地执行的用户的动作;情绪估计单元,其估计与用户的动作相对应的用户的情绪;以及信息累积单元,其将交互装置的输出、用户的动作和用户的情绪彼此关联地累积为交互信息,其中,输出控制单元基于累积的交互信息来控制从交互装置到用户的输出。

12.此外,根据本公开内容,提供了一种由算术处理装置执行的信息处理方法,包括:控制从交互装置到用户的输出;确定与交互装置的输出相对应地执行的用户的动作;估计与用户的动作相对应的用户的情绪;以及将交互装置的输出、用户的动作和用户的情绪彼此关联地累积为交互信息,并且基于累积的交互信息来控制从交互装置到用户的输出。

13.此外,根据本公开内容,提供了一种使计算机用作包括以下各项的单元的程序:输出控制单元,其控制从交互装置到用户的输出;动作评估单元,其确定与交互装置的输出相对应地执行的用户的动作;情绪估计单元,其估计与用户的动作相对应的用户的情绪;以及信息累积单元,其将交互装置的输出、用户的动作和用户的情绪彼此关联地累积为交互信息,并且该程序还使得输出控制单元工作以基于累积的交互信息来控制从交互装置到用户

的输出。

附图说明

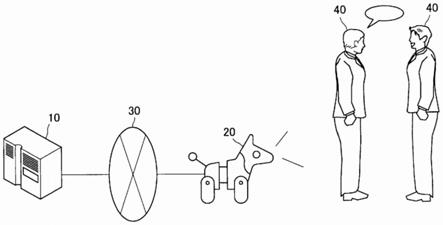

14.图1是示出应用了根据本公开内容的技术的系统的概要的图。

15.图2是示出根据本公开内容的第一实施方式的系统的功能配置的框图。

16.图3是示出典型室内空间的摄影图像的示例的示意图。

17.图4是示出与用户相关的预设信息的示例的表。

18.图5是示出其中机器人装置的输出和用户的动作以相同的时间序列列出的示例的表。

19.图6是示出由信息累积单元生成的交互信息的示例的表。

20.图7是示出由根据该实施方式的系统执行的操作的示例的流程图。

21.图8是示出根据实施方式的系统的修改的图。

22.图9是示出根据本公开内容的第二实施方式的系统的功能配置的框图。

23.图10是示出由根据该实施方式的系统执行的操作的示例的流程图。

24.图11a是示出由根据该实施方式的系统执行的操作的另一示例的流程图。

25.图11b是示出由根据该实施方式的系统执行的操作的另一示例的流程图。

26.图12是示出所生成的交互信息和所选择的交互信息的示例的表。

27.图13是示出基于图12中所示的示例而存储的交互信息的示例的表。

28.图14是示出根据该实施方式的系统的第三应用示例的图。

29.图15是示出构成根据本公开内容的实施方式的系统的信息处理装置中的硬件配置的示例的框图。

具体实施方式

30.下文中将参照附图详细描述本公开内容的优选实施方式。注意,通过对具有基本相同功能配置的部件分配相同的附图标记,将从本说明书和附图中省略冗余的描述。

31.注意,按如下顺序提供描述。

32.1.根据本公开内容的技术概述

33.2.第一实施方式

34.2.1.信息处理装置的配置

35.2.2.信息处理装置的操作

36.2.3.变型

37.3.第二实施方式

38.3.1.信息处理装置的配置

39.3.2.信息处理装置的操作

40.3.3.应用示例

41.4.硬件配置

42.<1.根据本公开内容的技术概述>

43.首先,将参照图1描述应用根据本公开内容的技术的系统的概要。图1是示出应用了根据本公开内容的技术的系统的概要的图。

44.如图1所示,应用了根据本公开内容的技术的系统包括信息处理装置10和经由网络30与信息处理装置10连接的机器人装置20。尽管图1将两个用户40例示为机器人装置20的用户,但是机器人装置20的用户的数目毫无疑问可以是一个或三个或更多个。

45.机器人装置20是能够与用户40进行交互的自主动作机器人装置。机器人装置20是在用户40附近操作的机器人装置,并且例如可以是宠物形机器人、人形通信机器人、传送机器人或关节型机器人。

46.通过基于由成像装置、麦克风或各种传感器获得的外部环境观察结果来控制机器人装置20的动作,可以允许机器人装置20与用户40交互。机器人装置20可以例如通过声音的输出或包括图像显示、移动或操作的其他输出来与用户40交互。

47.然而,在应用了根据本公开内容的技术的系统中,与用户40交互的装置毫无疑问可以是除机器人装置20之外的装置。例如,应用了根据本公开内容的技术的系统可以包括视觉地输出模仿角色或人物的代理的显示装置,或者听觉地输出代理的话语的声音输出装置,而不是机器人装置20。在本说明书中,包括机器人装置20的与用户40交互的一组这样的装置也被称为交互装置。

48.网络30是信息的有线或无线传输路径。例如,网络30可以是:诸如因特网、电话网络和卫星通信网络的公共网络、或包括以太网(注册商标)的各种局域网(lan)、广域网(wan)等。此外,网络30可以是专用网络,例如,互联网协议虚拟专用网络(ip

‑

vpn)。

49.注意,信息处理装置10和机器人装置20可以在没有网络30的情况下直接相互连接。例如,信息处理装置10和机器人装置20可以通过有线通信相互连接,或者可以通过使用wi

‑

fi(注册商标)或蓝牙(注册商标)的无线通信相互连接。

50.信息处理装置10控制机器人装置20与用户40之间的交互的细节。具体地,信息处理装置10基于关于用户40所在的空间的感测结果来控制从机器人装置20到用户40的输出。具体地,信息处理装置10可以基于感测到的用户40的话语或动作的细节来估计用户40期望或请求的对机器人装置20的输出,并且可以控制机器人装置20给出估计的输出。

51.例如,信息处理装置10可以生成对用户40所发出的问题的回答,并且可以允许机器人装置20将所生成的回答输出为语音或图像。替选地,信息处理装置10也可以控制机器人装置20的动作,以执行吸引用户40的兴趣或注意的动作。

52.利用应用了根据本公开内容的技术的系统,信息处理装置10对与其中用户40所在的空间有关的信息进行分析,并且基于分析的结果对机器人装置20的输出的细节进行控制,从而能够进行机器人装置20与用户40之间的双向通信。例如,应用了根据本公开内容的技术的系统可以使机器人装置20和用户40进行对话或响应,使机器人装置20执行模仿宠物的动作,或者使机器人装置20和用户40一起工作。

53.根据本公开内容的技术在这样的系统中彼此关联地累积机器人装置20对用户40的输出以及与该输出相对应的用户40的动作和情绪。

54.利用根据本公开内容的技术,由于信息处理装置10可以通过使用如上累积的信息来估计用户40对机器人装置20的输出的反应,所以能够进一步提高从机器人装置20到用户40的通信质量。

55.此外,根据本公开内容的技术,当期望在用户40中诱导预定动作或情绪时,信息处理装置10可以通过使用如上累积的信息来确定与要诱导的动作或情绪相对应的机器人装

置20的输出。因此,信息处理装置10可以经由机器人装置20在用户40诱导预定动作或情绪。

56.<2.第一实施方式>

57.(2.1.信息处理装置的配置)

58.在下文中,将参照图2描述根据本公内容的实现上述技术的第一实施方式。图2是示出根据第一实施方式的系统的功能配置的框图。

59.如图2所示,根据本实施方式的系统包括经由网络30彼此连接的信息处理装置10和机器人装置20。

60.机器人装置20基于与其中用户40所在的空间有关的感测结果,向用户40给出具有由信息处理装置10确定的细节的输出。这里,机器人装置20的输出表示对从机器人装置20到用户40的视觉、听觉或触觉中的至少一个或更多个的各种类型的刺激。例如,机器人装置20的输出可以表示从机器人装置20到用户40的任何输出,例如图像显示、声音输出、运动呈现、诸如接近或分离的移动、对象的传送和接触。

61.(信息处理装置10)

62.信息处理装置10包括传感器单元101、识别单元103、动作评估单元105、情绪估计单元107、信息累积单元109、存储单元111和通信单元113。

63.信息处理装置10例如可以是不从用户40接受直接刺激的信息处理装置(例如,监视摄像机系统的控制装置),或者也可以是从用户40接受直接刺激的信息处理装置(例如,智能扬声器)。此外,信息处理装置10可以是不包括传感器单元101并且单独执行信息处理的计算机等。

64.传感器单元101包括获取与其中用户40所在的空间有关的信息的传感器。

65.例如,传感器单元101包括各种摄像机,诸如rgb摄像机、灰度摄像机、深度摄像机、红外摄像机或飞行时间(tof)摄像机,并且可以获取其中用户40所在的空间的拍摄图像。传感器单元101还可以通过包括多个这些各种摄像机来获取与到诸如用户40的对象的距离有关的信息。此外,传感器单元101包括各种距离测量传感器,例如,激光成像检测和测距(lidar)传感器或无线电检测和测距(radar)传感器,并且可以获取与其中用户40所在的空间中的对象的布置有的信息。此外,传感器单元101可以包括麦克风,以获取其中用户40所在空间中的语音,从而获取与用户40的位置和状态有关的信息。传感器单元101可以包括多个麦克风,以进一步获取指定声源位置的信息。另外,传感器单元101可以包括诸如照度计、温度计或湿度计的传感器,以便获取与其中用户40所在的空间的环境有关的信息。

66.然而,传感器单元101可以毫无疑问地包括除上述传感器之外的已知传感器,只要其能够获取与其中用户40所在的空间有关的信息。

67.识别单元103基于由传感器单元101获取的信息来识别其中用户40所在的空间的状态。具体地,识别单元103可以通过对由传感器单元101的各种摄像机获取的其中用户40所在的空间的拍摄图像应用基于预定规则或机器学习算法的图像识别来识别空间的状态。

68.例如,当通过包括在传感器单元101中的各种摄像机获取图3所示的拍摄图像时,识别单元103可以基于对象识别算法来识别拍摄图像中捕获的空间中的对象的类型、数目、位置等。

69.图3是示出典型室内空间的摄影图像的示例的示意图。如图3所示,例如,假设桌子51、椅子52和53以及室内灯54存在于室内空间50中。

70.识别单元103可以基于诸如形状或颜色的特征来识别由居住在室内空间50中的用户40设置为桌子51、椅子52和53或室内光54的对象,并且可以由此识别在拍摄图像中捕获的室内空间50中的对象的位置等。替选地,识别单元103可以使用由监督机器学习构造的算法从存在于室内空间50中的对象之中分别地识别桌子51、椅子52和53以及室内灯54。

71.此外,识别单元103还可以执行用户40在空间中的个人和位置识别。具体地,识别单元103可以对拍摄图像应用基于预设特征量或机器学习的算法以执行用户40的面部识别,从而执行用户40的个人和位置识别。替选地,识别单元103可以从语音或身体特性识别用户40的性别和年龄,从而通过将识别的用户40的性别和年龄与关于用户40的预设信息进行比较来执行用户40的个人和位置识别。

72.顺便提及,与用户40有关的预设信息的示例包括如图4所示的信息。图4是示出信息处理装置10中与用户40有关的预设信息的示例的表。

73.如图4所示,作为与用户40有关的信息,信息处理装置10可以针对每个用户存储用户40的姓名、年龄和性别以及与另一用户的关系。此外,信息处理装置10可以基于由识别单元103获得的识别,存储在由传感器单元101感测的点处的空间中的用户40的存在或不存在。此外,信息处理装置10可以基于传感器单元101获得的感测结果,将其中用户40很可能存在的空间中的时区存储为频繁出现时间。另外,信息处理装置10可以存储用户40与机器人装置20之间的通信时间的持续时间。

74.此外,识别单元103还可以执行空间中的机器人装置20的位置和个人识别。具体地,识别单元103可以通过识别在拍摄图像中捕获的机器人装置20的形状或者附加到机器人装置20的识别二维码或识别号来执行机器人装置20的位置和个人识别。

75.动作评估单元105基于由传感器单元101取得的信息来掌握用户40在空间中的动作。具体地,动作评估单元105可以基于由传感器单元101取得的用户40的拍摄图像来掌握用户40的动作。此外,动作评估单元105也可以基于由传感器单元101取得的用户40的声音信息来掌握用户40的话语信息。

76.例如,动作评估单元105可以掌握在机器人装置20将输出给用户40的时间点处用户40的动作或状态连同时刻。此外,当用户40的动作或状态已经改变时,动作评估单元105可以与时刻一起掌握改变之后的用户的动作或状态。通过在这样的时刻掌握用户40的动作或状态,动作评估单元105可以确定与机器人装置20的输出相对应地执行的用户40的动作,而无需一直掌握用户40的动作或状态。

77.此外,动作评估单元105确定与机器人装置20的输出相对应地执行的用户40的动作。具体地,通过将机器人装置20向用户40的输出和用户40的动作以相同的时间序列列出,动作评估单元105可以确定与机器人装置20的输出相对应地执行的用户40的动作。

78.例如,在从机器人装置20向用户40输出后在预定时间内接连执行用户40的动作时,动作评估单元105可以确定机器人装置20的输出对应于用户40的动作。此外,当用户40的动作在从机器人装置20到用户40的输出之后发生了变化时,动作评估单元105可以确定机器人装置20的输出对应于变化后的用户40的动作。这是因为,考虑到为了实现与从机器人装置20到用户40的输出的对应,用户40已经改变了动作。此外,在多次确认了从机器人装置20到用户40的输出和用户40的动作的相同的组合时,动作评估单元105也可以确定机器人装置20的输出与用户40的动作之间的对应。

79.此外,在从用户40朝向机器人装置20的直接动作发生时,当机器人装置20的输出花费时间时,或者用户40的动作花费时间时,动作评估单元105可以考虑机器人装置20的输出与用户40的动作之间的时间的流逝来确定机器人装置20的输出与用户40的动作之间的对应。

80.注意,动作评估单元105还可以掌握除上述信息以外的信息,只要可以基于用户40的动作来掌握该信息。例如,在可以基于用户40的话语的频率或消息、用户40的位置关系、用户40的动作的对象或细节掌握多个用户40之间的关系的情况下,动作评估单元105可以基于用户40的话语或动作掌握多个用户40之间的关系。通过动作评估单元105所掌握的信息也可以通过添加到图4所示的与用户40有关的信息中而被存储在信息处理装置10中。

81.情绪估计单元107估计与用户40的动作相对应的用户40的情绪。具体地,首先,情绪估计单元107预先设置情绪的评估轴以及与该评估轴的情绪有关的用户40的动作。利用该设置,情绪估计单元107可以通过将由动作评估单元105掌握的用户40的动作与在评估轴上为每个情绪设置的动作进行比较来估计用户40的情绪。情绪评估轴的示例包括惊讶、恐惧、悲伤和快乐。

82.此外,在能够从传感器单元101中包括的各种摄像机、由用户40所佩戴的佩戴型终端等取得用户40的诸如心率、血压、体温等生物信息的情况下,情绪估计单元107可以基于用户40的生物信息来估计用户40的情绪。在这样的情况下,情绪估计单元107也可以通过将由生物信息指示的用户40的状态与在评估轴上针对每个情绪预先设定的状态进行比较来估计用户40的情绪。

83.这里,参照图5说明动作评估单元105和情绪估计单元107的操作的具体示例。图5是示出其中机器人装置20的输出和用户40的动作以相同的时间序列列出的示例的表。

84.如图5所示,在同一时钟上将时间戳附加到机器人装置20的输出和用户40的动作,使得可以在同一时间序列中列出机器人装置20的输出和用户40的动作。

85.例如,图5中所示的表指示,作为状态编号1,机器人装置20输出在“18:15:01”时“接近”处于状态“观看tv”的用户“a”。随后,作为状态编号2,其指示用户“a”已经在“18:15:10”时执行“触摸机器人装置”的动作。接下来,作为状态编号3,其指示机器人装置20已经在“18:16:30”时输出“凝视”用户“b”。此外,作为状态编号4,其指示用户“b”已经在“18:16:45”时执行了“与机器人装置谈话”的动作。另外,作为状态编号5,其指示机器人装置20在“18:20:11”时输出“接近”处于状态“学习”的用户“c”。随后,作为状态编号6,其指示用户“c”已经在“18:23:20”时执行了动作“关掉机器人装置”。

86.在这样的情况下,动作评估单元105可以确定在具有相同对象用户40且接近的发生时刻的状态编号3的机器人装置20的输出与状态编号4的用户40的动作之间存在对应。此外,动作评估单元105可以确定在具有相同对象用户40并且指示从机器人装置20输出之后的用户40的状态或动作的变化的状态编号1的机器人装置20的输出与状态编号2的用户40的动作之间存在对应。此外,即使发生的时刻不是很接近,动作评估单元105也可以确定在具有相同对象用户40并且指示从机器人装置20输出之后的用户40的状态或动作的变化的状态编号5的机器人装置20的输出与状态编号6的用户40的动作之间存在对应。

87.此外,图5所示的表示出了由情绪估计单元107根据状态编号2、4和6中的用户40的动作估计的用户40的每个情绪,该状态编号被确定成对应于机器人装置20的输出。例如,根

据状态编号2中的用户“a”执行的动作“触摸机器人装置”来估计“快乐”的情绪。此外,根据状态编号4中的用户“b”执行的动作“与机器人装置谈话”来估计“快乐”的情绪。此外,根据状态编号6中的用户“c”执行的动作“关掉机器人装置”来估计“惊讶”的情绪。

88.信息累积单元109将机器人装置20的输出、与机器人装置20的输出相对应的用户40的动作、以及根据用户40的动作估计的用户40的情绪彼此关联地累积作为交互信息。具体地,信息累积单元109将由动作评估单元105确定成相互对应的机器人装置20的输出、用户40的动作、以及由情绪估计单元107根据用户40的动作估计的用户40的情绪进行组合来生成每个用户40的交互信息。

89.例如,可以在存储单元111中累积所生成的交互信息以构造数据库。存储单元111可以由例如诸如硬盘驱动器(hdd)的磁存储装置、诸如固态驱动器(ssd)的半导体存储装置、光存储装置、磁光存储装置等来实现。

90.例如,信息累积单元109可以从图5所示的具体示例中生成图6所示的交互信息。图6是示出由信息累积单元109生成的交互信息的示例的表。

91.如图6所示,例如,信息累积单元109可以基于图5中的状态编号1和2的信息,关于“用户a”生成其中机器人装置20的“接近”的输出、用户40的“触摸机器人装置”的动作、以及用户40的“快乐“的情绪彼此相关联的交互信息。此外,信息累积单元109可以基于图5中的状态编号3和4的信息,关于“用户b”生成其中机器人装置20的“凝视”的输出、用户40的“与机器人装置谈话”的动作、以及用户40的“快乐”的情绪彼此相关联的交互信息。此外,信息累积单元109可以基于图5中的状态编号5和6的信息,关于“用户c”生成其中机器人装置20的“接近”的输出、用户40的“关掉机器人装置”的动作、以及用户40的“惊喜”的情绪彼此相关联的交互信息。

92.信息累积单元109在每次动作评估单元105掌握了从机器人装置20到用户40的输出和与来自机器人装置20的输出相对应的用户40的动作的组合时,生成交互信息。利用该配置,信息累积单元109能够生成包括用户40对来自机器人装置20的输出的反应的数据库作为交互信息。因此,当存在从机器人装置20到用户40的输出时,信息处理装置10可以从累积的交互信息之中搜索用户40的反应以获得类似的输出,使得能够预测用户40的反应。

93.此外,信息累积单元109也可以在机器人装置20的输出和用户40的动作的组合发生时,对该交互信息附加与环境等有关的前提条件。这是因为即使机器人装置20对用户40给出相同的输出,用户40的反应也可能不同。

94.在机器人装置20接近用户40的假设示例性情况下,用户40通常给出对机器人装置20抚摸的反应。但是,在用户40没有注意机器人装置20或执行其他作业时,即使机器人装置20接近用户40,用户40也未必给出对机器人装置20抚摸的反应。信息累积单元109可以将用户40的动作中的与机器人装置20的输出对应的情况的差异作为前提条件来进行分类以便提高交互信息的准确度。

95.例如,在图6所示的交互信息的具体示例中,将“当用户没有执行主动工作时”的前提条件添加到其中用户40的“触摸机器人装置”的动作与机器人装置20的“接近”的输出相关联的交互信息。此外,将“当机器人装置存在于用户的视野内时”的前提条件添加到其中用户40的“与机器人装置谈话”的动作与来自机器人装置20的“凝视”的输出相关联的交互信息。此外,将“当与用户b在一起时”的前提条件添加到其中用户40的“关掉机器人装置”的

动作与来自机器人装置20的“接近”的输出相关联的交互信息。

96.这些前提条件是在从机器人装置20到用户40给出相同的输出时,基于来自用户40的反应的差异,由信息累积单元109设置的。这里,假设的示例性情况是,在累积了其中从机器人装置20到用户40的“接近”的输出和用户40的“抚摸”的动作彼此相关联的交互信息之后,与从机器人装置20到用户40的“接近”的输出相对应地诱导用户40的“关掉”的动作。此时,在个别情况下,信息累积单元109通过参考用户40的动作的发生的时区、用户40的状态或用户40周围的环境的状态来提取各个情况下的差异。之后,信息累积单元109可以将所提取的差异作为前提条件添加到与各个情况相对应的交互信息。

97.通信单元113是用于在信息处理装置10与机器人装置20之间交换信息的通信接口。

98.例如,通信单元113可以经由网络30在信息处理装置10与机器人装置20之间交换信息。网络30可以是公共通信网络,例如因特网、卫星通信网络或电话线网络,或者可以是在有限区域中提供的通信网络,例如局域网(lan)或广域网(wan)。

99.此外,通信单元113可以在信息处理装置10与机器人装置20之间直接交换信息。例如,通信单元113可以使用诸如无线lan、wi

‑

fi(注册商标)或蓝牙(注册商标)的无线通信,或诸如使用同轴电缆的通信的有线通信,在信息处理装置10与机器人装置20之间交换信息。

100.(机器人装置20)

101.机器人装置20包括传感器单元201、识别单元203、输出控制单元205、输出单元207和通信单元209。

102.机器人装置20例如是能够自主动作的机器人装置。具体地,机器人装置20可以是能够与用户40执行通信的动物形机器人或人形机器人,或者可以是能够与用户40进行协作工作的传送机器人、关节型机器人(articulated robot)等。

103.传感器单元201包括获取机器人装置20的外部环境信息的传感器和获取机器人装置20的自身信息的传感器。例如,作为获取机器人装置20的外部环境信息的传感器,传感器单元201可以包括诸如rgb摄像机、灰度摄像机、立体摄像机、深度摄像机、红外摄像机或tof摄像机的各种摄像机,诸如lidar传感器和radar传感器的各种距离测量传感器,或诸如麦克风、照度计、温度计或湿度计的传感器。另外,传感器单元201可以包括例如编码器、电压表、电流表、应变仪、压力计、惯性测量单元(imu)等作为获取机器人装置20的自身信息的传感器。由传感器单元201中所包括的各种传感器获取的信息被用来控制机器人装置20的输出。

104.然而,传感器单元201可以毫无疑问地包括除上述传感器之外的已知传感器,只要其可以获取关于机器人装置20的周围环境的环境信息或机器人装置20的自身信息即可。

105.识别单元203基于由传感器单元201获取的信息来识别机器人装置20的外部环境状态或机器人装置20的自身装置状态。具体地,识别单元203可以通过基于由传感器单元201获取的环境信息执行对象识别、运动识别、文本识别或语音识别来识别机器人装置20的外部环境状态。此外,识别单元203也可以通过基于由传感器单元201取得的自身的装置信息执行位置识别、动作状态(例如速度、加速度、加加速度(jerk)、角速度、角加速度等)识别或装置主体状态(例如剩余电力、温度、关节角度等)识别,从而识别机器人装置20的自身的

状态。

106.识别单元203的识别可以通过使用任何已知的识别技术来执行。例如,可以基于预定规则或基于机器学习算法来执行识别单元203的识别。

107.输出控制单元205控制从机器人装置20到用户40将给出的输出。具体地,输出控制单元205基于所累积的交互信息生成向用户40将给出的输出,并且进而生成用于实现该输出的控制指令。

108.例如,基于累积的交互信息,输出控制单元205可以生成与期望在用户40中诱导的动作或情绪相对应的来自机器人装置20的输出,并且还可以生成用于实现该输出的控制命令。当控制从机器人装置20给出输出以在用户40中诱导预定情绪时,输出控制单元205可以通过参考累积的交互信息来提取可以在用户40中诱导预定情绪的输出,使得能够生成用于实现要从机器人装置20到用户40要给出的输出的控制命令。

109.注意,输出控制单元205的部分或全部功能可以被提供在信息处理装置10中而不是机器人装置20中。

110.输出单元207基于来自输出控制单元205的控制指令,生成从机器人装置20向用户40的输出。具体地,输出单元207可以是任何模块,只要该模块执行到真实空间的输出。例如,输出单元207可以是诸如被称为磁马达或流体泵的致动器、诸如引擎的动力装置、输出声音的扬声器、输出图像的投影仪、显示器、光发射器(例如,灯泡、led、激光器等)的装置。

111.通信单元209是用于在信息处理装置10与机器人装置20之间交换信息的通信接口。具体地,通信单元209可以是与信息处理装置10的通信单元113相对应的通信接口。

112.例如,通信单元209可以经由网络30在信息处理装置10与机器人装置20之间交换信息。网络30可以是公共通信网络,例如因特网、卫星通信网络或电话线网络,或者可以是在有限区域中提供的通信网络,例如局域网(lan)或广域网(wan)。

113.此外,通信单元209可以在信息处理装置10与机器人装置20之间直接交换信息。例如,通信单元209可以使用诸如无线lan、wi

‑

fi(注册商标)或蓝牙(注册商标)的无线通信,或诸如使用同轴电缆的通信的有线通信,在信息处理装置10与机器人装置20之间交换信息。

114.以上,对构成根据本实施方式的系统的功能组进行了具体说明。这些功能组不限于上述示例,并且也可以被包括在信息处理装置10或机器人装置20中。此外,也可以将这些功能组集成在机器人装置20中。

115.(2.2.信息处理装置的操作)

116.接下来,将参照图7描述根据本实施方式的系统的操作。图7是示出由根据本实施方式的系统执行的操作的示例的流程图。

117.图7所示的根据流程图的操作示例是为了提高用户40对机器人装置20的亲密度的操作示例。根据本实施方式的系统掌握用户40的话语,并且使得机器人装置20能够基于用户40的话语消息给出输出,从而能够进行用户40与机器人装置20之间的高质量交互。例如,根据本实施方式的系统能够使机器人装置20基于话语消息给出被估计为用户40从机器人装置20期望的输出,使得能够向用户40提供与机器人装置20进行相互理解的体验。

118.如图7所示,首先,信息处理装置10基于来自传感器单元101的环境中的感测结果来确定环境中是否存在多个用户40(s101)。根据本实施方式的系统针对每个用户将机器人

装置20的输出与用户40的动作和情绪相关联。因此,在多个用户40存在于环境中的情况下,信息处理装置10首先确定机器人装置20要向其给出输出的用户40。

119.当环境中存在多个用户40时(s101/是),信息处理装置10基于为每个用户40设置的优先级来确定机器人装置20要向其给出输出的用户40(s102)。

120.可以基于用户40与机器人装置20之间的交互(也称为通信)的程度来设置优先级。例如,可以基于诸如用户40与机器人装置20之间的交互的频率、时间、深度或密度的参数来设置优先级,使得用户40中的参数的程度越高,将分配越高的优先级。

121.这里,当用户40是没有与机器人装置20通信的经验并且因此没有设置的优先级的用户时,信息处理装置10可以基于用户40的属性信息来设置优先级。例如,信息处理装置10可以通过基于从拍摄图像等估计的用户40的年龄和性别来生成用户40的动作模型,来设置从机器人装置20到用户40进行输出的优先级。

122.当环境中仅存在一个用户40时(s101/否),信息处理装置10执行步骤s103的操作,而不执行步骤s102的操作。

123.随后,信息处理装置10确定在其中机器人装置20要对其给出输出的用户40的话语中是否存在与机器人装置20有关的话语(s103)。当不存在与机器人装置20有关的话语时(s103/否),信息处理装置10确定环境中的用户40的数目是否已经改变(s104),然后等待直到用户40给出与机器人装置20有关的话语。然而,当环境中的用户40的数目已经改变时(s104/是),具有较高优先级的用户40的出现可以将作为目标的用户40改变为具有输出。因此,信息处理装置10返回到步骤s102,并且再次执行操作。

124.接着,信息处理装置10基于用户40的话语消息确定从机器人装置20到用户40要给出的输出。此时,信息处理装置10基于所累积的交互信息,将从机器人装置20到用户40要执行的输出变更为更适当的输出(s105)。

125.例如,当用户40的话语指示具体指定机器人装置20的输出的消息(诸如“想要机器人靠近”)时,信息处理装置10可以直接确定从机器人装置20到用户40要给出的输出。

126.在用户40的话语指示没有指定机器人装置20(例如,“可爱机器人”)的输出的感觉或印象的消息的另一情况下,信息处理装置10可以基于累积的交互信息,确定将诱导用户40的话语消息中包括的情绪的输出作为要给出用户40的输出。例如,当用户40的话语包括“可爱机器人”的消息时,信息处理装置10可以确定被设置为可爱手势的多个输出模式用作将由机器人装置20给出的输出。此外,允许为多个确定的模式的输出中的每一个设置可行性。利用该配置,通过在诸如夜间声音的输出被限制的状况下,通过执行诸如降低使用声音的输出的可行性等控制,信息处理装置10可以考虑外部环境来控制机器人装置20的输出。

127.即使具有这些优点,根据本实施方式的技术也不限于以上示例。信息处理装置10还可以根据用户40的动作来估计用户40对机器人装置20的期望输出,并且确定从机器人装置20到用户40要给出的输出。

128.接着,信息处理装置10确定机器人装置20是否可以执行所确定的输出(s106)。例如,当机器人装置20是模仿诸如狗的动物的宠物形机器人时,机器人装置20具有行走机构,使得可以给出用于实现包括消息“机器人想要靠近”的话语的输出。相比之下,这样的机器人装置20不具有飞行机构,并且因此不可能给出实现包括消息“机器人想要飞行”的话语的输出。以这样的方式,信息处理装置10可以考虑机器人装置20的功能性来确定机器人装置

20是否可以执行所确定的输出。

129.当机器人装置20不能执行所确定的输出时(s106/否),信息处理装置10返回到步骤s103,并且等待直到用户40给出与机器人装置20有关的话语。

130.相比之下,当机器人装置20可以执行所确定的输出时(s106/是),信息处理装置10设置直到机器人装置20给出输出的等待时间(s107)。该设置是因为机器人装置20对用户40的话语的即时反应将给用户40机器人装置20采取反射动作和自动反应的印象,这对于用户40的情绪的发展将是无效的。可以基于机器人装置20给出的输出的细节来设置直到机器人装置20给出输出的等待时间的长度。例如,如果机器人装置20给出的输出是直接移动等,则等待时间可以被设置成较短的长度。此外,可以随机地设置直到机器人装置20给出输出的等待时间的长度,以便允许用户40保持新鲜感。

131.这里,当在直到机器人装置20给出输出的等待时间期间已经出现了与机器人装置20有关的新话语时(s108/是),信息处理装置10可以返回到步骤s105并且重新确定要由机器人装置20给出的输出。此外,尽管未示出,但是在直到机器人装置20给出输出的等待时间期间,在可以作为接收输出的对象的具有较高优先级的用户出现的情况下,信息处理装置10可以返回到步骤s103并且重新确定要由机器人装置20给出的输出。

132.在经过了等待时间而没有发生导致再次确定机器人装置20要给出的输出的事件的情况下(s108/否),信息处理装置10控制机器人装置20给出所确定的输出(s109)。以这种方式,信息处理装置10可以通过执行控制使得机器人装置20基于用户40的话语或动作给出估计为用户40对机器人装置20所期望的输出来支持机器人装置20与用户40之间的交互。

133.然后,信息处理装置10评估与机器人装置20的输出对应的用户40的动作和情绪(s111)。具体地,信息处理装置10确定与来自机器人装置20的输出相对应地执行的用户40的动作,并且根据用户40的动作来估计用户40的情绪。

134.此外,信息处理装置10生成其中来自机器人装置20的输出、与该输出相对应地执行的用户40的动作、以及根据该动作估计的用户40的情绪彼此相关联的交互信息,并且累积所生成的交互信息(s113)。

135.此时,当已经累积了具有与机器人装置20的输出相同的输出的交互信息时,信息处理装置10还可以通过将所生成的交互信息与已经累积的交互信息进行比较来向交互信息添加前提条件。

136.例如,这里是一种假设情况,其中已经存在交互信息的累积,该交互信息指示与从机器人装置20到用户40的“接近”的输出相对应地诱导用户40的“微笑”动作和“快乐”情绪。然而,在这种情况下,也可以假设,即使在用户40繁忙的情况下(例如在工作日早晨),机器人装置20的相同输出,用户40的动作和情绪也比累积的交互信息中指示的更消极。在这样的情况下,信息处理装置10可以掌握在工作日早晨的时区的前提下,与机器人装置20的“接近”的输出相对应地诱导用户40的消极动作和情绪。因此,通过基于所掌握的信息来更新累积交互信息,信息处理装置10可以将机器人装置20要给出的输出从“接近”改变为诸如在工作日早晨时区的“凝视”的其他输出。

137.(2.3.变型)

138.接下来,将参照图8描述根据本实施方式的系统的修改。图8是示出根据本实施方式的系统的变型的图。

139.在参照图7描述的示例中,基于用户40的关于机器人装置20的话语作为触发来给出机器人装置20的输出。然而,根据本实施方式的系统不限于以上示例。例如,可以自发地给出机器人装置20的输出。

140.具体地,图8中所示的示例假设其中两个用户40正在谈论他们已经购买的垫子55的情况。在这样的情况下,由于两个用户40没有给出与机器人装置20有关的话语,因此信息处理装置10难以基于话语中指示的消息来确定两个用户40期望来自机器人装置20的输出。因此,信息处理装置10可以通过允许机器人装置20自发地向两个用户40给出输出来引出两个用户40的动作和情绪。

141.例如,信息处理装置10可以控制机器人装置20以给出接近垫子55的输出作为两个用户40的对话的主题。也就是说,信息处理装置10可以将机器人装置20的输出应用到包括在两个用户40的话语中的对象上,从而诱导用户40朝向机器人装置20的动作或情绪。利用该配置,信息处理装置10可以从用户40中的任何一个提取能够估计“快乐”情绪的话语,诸如“乐于购买新的垫子”。在这样的情况下,信息处理装置10可以累积其中机器人装置20的“接近新的对象”的输出、由用户40执行的“关于新的对象的话语”的动作、以及用户40中的“快乐”的情绪彼此相关联的交互信息。

142.<3.第二实施方式>

143.(3.1.信息处理装置的配置)

144.接下来,将参照图9描述实现根据本公开内容的技术的第二实施方式。图9是示出根据第二实施方式的系统的功能配置的框图。

145.如图9所示,根据本实施方式的系统包括经由网络30彼此连接的信息处理装置11和机器人装置20。

146.根据本实施方式的系统基于在根据第一实施方式的系统的描述中的交互信息来控制机器人装置20的输出,从而在用户40中诱导期望的动作或情绪。例如,在期望诱导用户40朝向对象具有积极的情绪的情况下,根据本实施方式的系统给出交互信息中与用户40的积极的情绪相关联的机器人装置20的输出以与对象相关联。利用该控制,认为用户40也将具有与机器人装置20的输出相对应地朝向对象诱导的积极情绪。

147.(信息处理装置11)

148.信息处理装置11包括动作诱导器125、信息累积单元121、存储单元111、确定单元123和通信单元113。

149.动作诱导器125确定用户40中要诱导的动作或情绪。具体地,动作诱导器125可以确定对于关于对象的商业广告在用户40中诱导积极情绪,或者在用户40中诱导消极情绪,以便保持用户40远离对象。替选地,动作诱导器125可以确定为了安全而诱导用户40执行用户40的物理保护所必需的动作。此外,动作诱导器125可以确定诱导用户40跟随机器人装置20以引导用户40的动作。可以根据目的适当地选择用户40中的动作诱导器125要诱导的动作或情绪。用户40要诱导的动作或情绪可以由信息处理装置11自主确定,或者可以基于来自外部的指令来确定。

150.信息累积单元121累积在根据第一实施方式的系统的描述中的交互信息。也就是说,信息累积单元121累积其中将机器人装置20的输出、与机器人装置20的输出对应地执行的用户40的动作、以及根据用户40的动作估计的用户40的情绪彼此相关联的交互信息。通

过使用累积的交互信息,信息处理装置11可以确定机器人装置20的输出,该输出在用户40中诱导期望的动作或情绪。在信息累积单元121中累积的交互信息可以在根据第一实施方式的系统中生成和累积,或者可以从外部引入。

151.交互信息例如被累积在存储单元111中作为构建的数据库。存储单元111可以由例如诸如hdd的磁存储装置、诸如ssd的半导体存储装置、光存储装置、磁光存储装置等来实现。

152.确定单元123基于累积的交互信息来确定与用户40中要诱导的动作或情绪相对应的机器人装置20的输出。具体地,确定单元123从累积的交互信息之中提取与用户40中要诱导的动作或情绪相关联的机器人装置20的输出,并从机器人装置20的提取的输出中选择可以由机器人装置20执行的输出。

153.机器人装置20的输出作为对用户40的视觉、听觉或触觉中的至少一个或更多个的刺激而工作。机器人装置20的作为对视觉的刺激而工作的输出可以是例如机器人装置20到用户40的动作的呈现,或者从机器人装置20到用户40的视频或图像的呈现。机器人装置20的作为对听觉的刺激而工作的输出可以是例如来自机器人装置20的诸如鸣声的声音输出。机器人装置20的作为对触觉的刺激而工作的输出可以是例如通过机器人装置20与用户40之间的接触的振动或热感的呈现,或者使用气枪的非接触触觉的呈现。

154.确定单元123可以根据用户40所诱导的动作或情绪的细节和重要性来确定机器人装置20的输出的细节。例如,存在累积的交互信息包括与用户40中要诱导的动作或情绪相对应的机器人装置20的多个输出的情况。在这样的情况下,确定单元123可以基于用户40中要诱导的动作或情绪的细节从相应的机器人装置20的多个输出之中选择适当的输出。例如,确定单元123可以确定允许机器人装置20与用户40中要诱导的动作或情绪的重要性的增加一起输出更多。

155.例如,当立即诱导用户40的动作或情绪时,在机器人装置20的移动之后呈现信息将取消信息呈现的即时性。因此,在这样的情况下,确定单元123可以首先允许机器人装置20输出诸如鸣声的声音以将用户40的注意力吸引到机器人装置20上,并且此后可以确定允许机器人装置20执行移动和信息呈现。根据这样的控制,确定单元123可以确保信息呈现的即时性。

156.此外,确定单元123可以基于用户40与机器人装置20之间的交互程度(也就是说,诸如通信的频率、持续时间、密度或深度的参数)来确定机器人装置20的输出的细节。例如,当用户40与机器人装置20之间的交互的频率低时,确定单元123可以确定允许机器人装置20给出特定的和更容易理解的输出,诸如语音或视频。

157.例如,在诱导用户40朝向对象的商业广告具有积极情绪时,确定单元123可以确定允许机器人装置20给出输出,以便将该对象与在用户40中诱导积极情绪的输出相关联。此外,在诱导用户40具有消极情绪以便保持用户40远离对象时,确定单元123可以确定允许机器人装置20给出输出,以便将该对象与在用户40中诱导消极情绪的输出相关联。

158.例如,在为了安全而诱导用户40执行对用户40的身体保护所需的动作的情况下,确定单元123可以确定允许机器人装置20给出对用户40引起环境物理影响的输出。利用该配置,能够根据机器人装置20的输出,诱导用户40执行避免环境物理影响的动作。此外,在为了安全而诱导用户40执动对用户40的身体保护所需的动作的情况下,确定单元123可以

确定允许机器人装置20给出指示机器人装置20由于环境而存在问题的输出。利用该配置,通过对机器人装置20的关注或关心的感觉,诱导用户40执行用于解决机器人装置20中发生的问题的动作。

159.例如,当诱导用户40执行跟随机器人装置20的动作以便引导用户40的动作时,确定单元123可以确定允许机器人装置20给出输出以提示用户40执行期望的动作。利用该配置,通过对用户40给出与机器人装置20的竞争感,能够引导用户40追随机器人装置20的输出,能够诱导用户40执行期望的动作。

160.与第一实施方式类似,通信单元113是用于在信息处理装置11与机器人装置20之间交换信息的通信接口。由于通信单元113与第一实施方式中描述的通信单元113基本类似,所以这里将省略其描述。

161.(机器人装置20)

162.机器人装置20包括传感器单元201、识别单元203、输出控制单元205、输出单元207和通信单元209。由于机器人装置20的每个部件的功能与第一实施方式中描述的功能基本类似,因此这里将省略其描述。

163.以上,对构成根据本实施方式的系统的功能组进行了具体说明。与第一实施方式类似,这些功能组可以包括在信息处理装置11或机器人装置20中。此外,也可以将这些功能组集成在机器人装置20中。

164.(3.2.信息处理装置的操作)

165.接下来,将参照图10至11b描述根据本实施方式的系统的操作。

166.图10是示出由根据本实施方式的系统执行的操作的示例的流程图。根据图10中所示的流程图的操作示例是用于在用户40中诱导期望的动作或情绪的操作示例。

167.如图10所示,首先,信息处理装置11基于由传感器单元101获得的关于环境的感测结果来掌握存在于环境中的用户40(s201)。

168.随后,信息处理装置11基于用户40与机器人装置20之间的过去交互的历史来估计用户40的优先级(s202)。例如,信息处理装置11可以基于诸如用户40与机器人装置20之间的交互的频率、持续时间、密度或深度的参数来估计用户40的优先级。替选地,信息处理装置11可以基于从用户40到机器人装置20的交互的次数、或者诸如用户40已经关闭机器人装置20的电力的次数的用户40对机器人装置20的操作历史来估计用户40的优先级。

169.接下来,基于优先级,信息处理装置11确定其中要被诱导动作或情绪的用户40(s203)。交互信息针对每个用户将机器人装置20的输出与用户40的动作和情绪相关联。因此,通过从步骤s201到步骤s203的操作,信息处理装置11确定要对其执行交互信息的参考的用户。

170.注意,在步骤s201至s203中确定用户40的操作可以类似于参照图7描述的根据第一实施方式的系统的操作(步骤s101至s102)。

171.此后,信息处理装置11确定在所确定的用户40中要诱导的动作或情绪(s204)。具体地,信息处理装置11基于来自外部或内部信息处理的指令来确定要在用户40中诱导的动作或情绪。例如,信息处理装置11可以基于诸如针对对象吸引用户40的商业广告、诸如保持摄入水的对用户40的健康警报、或诸如指示危险地点的事故预防警报的目的来确定要在用户40中诱导的动作或情绪。

172.接下来,信息处理装置11确定诱导用户40的动作或情绪的执行的可能性(s205)。例如,当为了商业广告目的而诱导用户40中的朝向对象的积极情绪以吸引对象给用户40时,当对象的实际对象、广告等不存在于环境中时,信息处理装置11将难以诱导用户40中的朝向对象的情绪。信息处理装置11确定诱导用户40的动作或情绪的可能性,从而使得机器人装置20能够在适当的定时诱导用户40的动作或情绪。

173.当可执行对用户40的动作或情绪的诱导时(s205/是),信息处理装置11基于累积的交互信息确定与要诱导的动作或情绪相对应的机器人装置20的输出(s206)。具体地,信息处理装置11从所累积的交互信息中提取已经成功地诱导用户40的动作或情绪的输出,并且允许机器人装置20适当地输出所提取的输出。

174.相比之下,当不能执行对用户40的动作或情绪的诱导时(s205/否),信息处理装置11返回到步骤s204,并且重新确定要在用户40中诱导的动作或情绪。

175.在从机器人装置20到用户40给出输出之后,信息处理装置11响应于机器人装置20的输出来评估用户40的动作或情绪,从而测量诱导动作或情绪的效果(s207)。此外,信息处理装置11可以更新交互信息中的机器人装置20的输出,使得响应于机器人装置20的输出,基于用户40的动作或情绪的评估结果,进一步诱导用户40的动作或情绪(s208)。替选地,信息处理装置11可以响应于机器人装置20的输出,将与用户40中的动作或情绪的诱导程度有关的信息添加到交互信息。利用该配置,信息处理装置11可以针对用户40优化机器人装置20的输出,以便能够通过用户40与机器人装置20之间的交互来诱导期望的动作或情绪。

176.图11a和图11b是示出由根据本实施方式的系统执行的操作的另一示例的流程图。图11a和图11b所示的流程图中所示的操作示例是关注于在参照图10描述的操作示例中与信息处理装置11对交互信息的更新有关的操作的操作示例。

177.如图11a所示,信息处理装置11首先确定用户40中要诱导的动作或情绪(s301)。随后,信息处理装置11确定用户40是否是新用户(s302)。

178.当用户40是新用户时(s302/是),用户40的交互信息没有被累积在信息处理装置11中。因此,信息处理装置11基于关于用户40的感测信息来分析用户40的诸如年龄组和性别的属性(s305),并且基于所分析的属性来选择接近用户40的用户模型(s306)。用户模型具有交互信息的初步设置,其中机器人装置20的输出根据诸如年龄组和性别的属性与典型用户40的动作和情绪相关联。通过使用已经在用户模型中设置的交互信息作为临时交互信息,即使在没有累积交互信息的新用户中,信息处理装置11也可以诱导动作或情绪。此后,信息处理装置11从所选择的用户模型的交互信息之中选择与要诱导的动作或情绪相对应的信息(s307)。

179.相比之下,在用户40不是新用户的情况下(s302/否),在信息处理装置11中已经累积了用户40的交互信息。因此信息处理装置11确定在用户40的交互信息中是否存在与要诱导的动作或情绪相对应的交互信息(s303)。当存在与要诱导的动作或情绪相对应的交互信息时(s303/是),信息处理装置11从交互信息之中选择相应的信息(s308)。当不存在与诱导的动作或情绪相对应的交互信息时(s303/否),信息处理装置11选择与接近要诱导的动作或情绪相对应的信息(s304)。

180.接着,信息处理装置11基于在步骤s304、s307和s308中选择的信息来控制机器人装置20的输出(s309)。利用该控制,从机器人装置20到用户40给出诱导期望动作或情绪的

输出。

181.此后,如图11b所示,信息处理装置11感测与机器人装置20的输出相对应的用户40的动作(s310),并且然后根据所感测的动作来估计用户40的情绪。接着,信息处理装置11基于评估的用户40的动作和情绪,生成其中将机器人装置20的输出与相应的用户40的动作和情绪相关联的交互信息(s311)。

182.这里,信息处理装置11确定在确定机器人装置20的输出时选择的交互信息是否与生成的交互信息完全匹配(s312)。当选择的交互信息与生成的交互信息完全匹配时(s312/是),信息处理装置11再次将选择的交互信息存储为用户40的交互信息(s313)。

183.相比之下,在选择的交互信息与生成的交互信息不完全匹配的情况下(s312/否),信息处理装置11确定选择的交互信息与生成的交互信息是否实现关于机器人装置20的输出的匹配(s314)。当不存在关于机器人装置20的输出的匹配时(s314/否),信息处理装置11将生成的交互信息作为新的交互信息重新存储(s317)。

184.当存在关于机器人装置20的输出的匹配时(s314/是),信息处理装置11确定用户40的动作或情绪已经改变,因为选择的交互信息和生成的交互信息具有不同的前提条件。因此,信息处理装置11评估选择的交互信息与生成的交互信息之间的差异(s315)。此后,信息处理装置11将所评估的差异添加为前提条件,并且单独地存储选择的交互信息和生成的交互信息(s316)。

185.将参照图12和13更具体地描述信息处理装置11的步骤s315和s316的操作。图12是示出生成的交互信息和选择的交互信息的示例的表。图13是示出基于图12中图示的示例而存储的交互信息的示例的表。

186.如图12所示,这里是例如以下可假设情况:为了确定机器人装置20的输出而选择的交互信息将用户40的动作“触摸机器人装置”和用户40中的情绪“快乐”与机器人装置20的输出“接近”相关联。相比之下,可以存在另一情况:通过响应于机器人装置20的输出评估用户40的动作和情绪而生成的交互信息将用户40的动作“关掉机器人装置”和用户40的情绪“愤怒”与机器人装置20的输出“接近”相关联。

187.在这样的情况下,信息处理装置11通过参考其中生成交互信息的状态来评估交互信息之间的差异。例如,可以存在这样的情况,其中在“早晨”的时区中的“用户a在附近”的周围环境状态下生成选择的交互信息,而在“早晨”的时区中的“用户b在附近”的周围环境状态下生成所生成的交互信息。此时,信息处理装置11可以发现诸如“用户a在附近”或“用户b在附近”的周围环境的差异,作为其中生成两条交互信息的状态的差异。

188.因此,信息处理装置11可以将作为两条交互信息之间的差异而发现的周围环境的信息添加到两条交互信息中的每一条作为前提条件。因此,如图13所示,信息处理装置11可以从选择的交互信息生成已经添加了“用户a在附近”的前提条件的第一交互信息,并且可以存储生成的第一交互信息。此外,信息处理装置11可以从生成的交互信息生成已经添加了“用户b在附近”的前提条件的第二交互信息,并且可以存储生成的第二交互信息。

189.(3.3.应用示例)

190.接下来,将描述根据该实施方式的系统的具体应用示例。

191.(第一应用示例)

192.根据本实施方式的系统可以用于例如向用户40提供产品的商业广告。

193.例如,当希望诱导用户40对产品感兴趣时,信息处理装置11可以控制机器人装置20的输出,以给出诸如“当在电视上显示特定产品的商业视频时对电视叫”或“将环境中的产品带到用户40的脚处”的输出。由此,根据本实施方式的系统可以吸引用户40关注产品。

194.(第二应用示例)

195.根据本实施方式的系统可以用于例如警告用户40的身体保护。

196.例如,当在用户40可以撞到他/她的脚的环境中存在障碍物时,或者当环境温度高而可以引起用户40中暑时,信息处理装置11可以控制机器人装置20的输出,以给出提醒用户40可能后果的动作的输出。

197.具体地,信息处理装置11可以通过控制机器人装置20输出被障碍物遮挡的行为或因障碍物而发生故障的行为,从而诱导用户40执行移除障碍物的动作。此外,信息处理装置11可以通过控制机器人装置20输出诸如指示由于中暑而不能移动的行为、饮用水的行为、提示用户购买饮料的行为、使诸如空调的制冷装置工作的行为、引导用户到凉爽的地方的行为的一些行为,从而诱导用户40采取避免中暑的行为。

198.(第三应用示例)

199.根据本实施方式的系统可以用于提示用户40跟随机器人装置20的动作。将参照图14描述第三使用示例。图14是示出根据本实施方式的系统的第三应用示例的图。

200.如图14所示,这里是具有父母41和孩子42作为根据本实施方式的系统的用户的假定的情况。根据本实施方式的系统,可以通过利用孩子42对机器人装置20的竞争感控制机器人装置20执行父母41希望要由孩子42执行的动作,从而能够诱导孩子42跟随机器人装置20的输出。也就是说,当存在具有预定关系的多个用户40时,根据本实施方式的系统还能够通过考虑用户40之间的关系,向除了已经累积了交互信息的用户40之外的用户诱导动作或情绪。

201.例如,信息处理装置11可以基于父母41的话语消息来掌握从父母41到孩子42的指令,并且可以控制机器人装置20以将遵循来自父母41的指令的输出给孩子42。

202.具体地,在识别出诸如“清洁玩具57”的父母41的话语消息时,信息处理装置11可以控制机器人装置20,以便与孩子42相比,给出更主动地清洁玩具57的输出。利用该控制,机器人装置20可以通过刺激孩子42的竞争感来引导孩子42执行清洁玩具57的动作。此外,在识别出诸如“来到这里”的父母41的话语消息时,信息处理装置11可以控制机器人装置20,以便与孩子42相比给出更主动地接近父母41的输出。利用该控制,机器人装置20可以引导孩子42执行遵循父母41的话语的动作。

203.注意,信息处理装置11可以基于除了父母41的话语之外的触发来控制机器人装置20的输出。例如,在存在指示父母41的快乐的情绪由机器人装置20给出的清洁玩具57的输出诱导的交互信息的情况下,信息处理装置11可以控制机器人装置20在检测到玩具57没有被清洁的状态的情况下给出清洁玩具57的输出作为触发。利用该控制,机器人装置20可以引导孩子42执行跟随机器人装置20清洁玩具57的动作。

204.<4.硬件配置>

205.此外,将参照图15描述构成根据本公开内容的第一实施方式的系统的信息处理装置10的硬件配置的示例。图15是示出构成根据第一实施方式的系统的信息处理装置10中的硬件配置的示例的框图。注意,根据第二实施方式的信息处理装置11的硬件配置基本上类

似于根据第一实施方式的信息处理装置10的硬件配置,因此在此将省略其描述。

206.如图15所示,信息处理装置10包括cpu 901、rom 902、ram 903、主机总线905、桥接器907、外部总线906、接口908、输入装置911、输出装置912、存储装置913、驱动器914、连接端口915和通信装置916。信息处理装置10可以包括诸如电路、数字信号处理器(dsp)或专用集成电路(asic)的处理电路,以代替cpu 901或与cpu 901一起。

207.cpu 901用作算术处理装置或控制装置,并且根据各种程序控制信息处理装置10中的整个操作。另外,cpu 901可以是微处理器。rom 902存储由cpu 901使用的程序和计算参数。ram 903临时存储在cpu 901的执行中使用的程序、在执行中适当改变的参数等。cpu 901例如可以执行识别单元103、动作评估单元105、情绪估计单元107、信息累积单元109和121、确定单元123、动作诱导器125和输出控制单元205的功能。

208.cpu 901、rom 902和ram 903通过包括cpu总线等的主机总线905彼此连接。主机总线905经由桥接器907连接至诸如外围部件互连/接口(pci)总线的外部总线906。注意,主机总线905、桥接器907和外部总线906不必分开,并且这些功能可以安装在一个总线上。

209.输入装置911是用于由用户输入信息的装置,并且其示例包括鼠标、键盘、触摸面板、按钮、麦克风、开关或控制杆。此外,输入装置911可以包括例如输入控制电路,该输入控制电路基于用户使用上述输入装置输入的信息来生成输入信号。

210.输出装置912是能够视觉或听觉地向用户通知信息的装置。输出装置912可以是例如显示装置,例如,阴极射线管(crt)显示装置、液晶显示装置、等离子显示装置、电致发光(el)显示装置、激光投影仪、发光二极管(led)投影仪或灯,或者可以是声音输出装置,例如,扬声器和耳机。

211.输出装置912例如可以输出通过由信息处理装置10执行的各种类型的处理获得的结果。具体地,输出装置912可以以诸如文本、图像、表格和图形的各种格式可视地显示通过由信息处理装置10执行的各种处理获得的结果。替选地,输出装置912可以将音频数据、声音数据等的音频信号转换成模拟信号,并且可听见地输出该信号。

212.存储装置913是作为信息处理装置10的存储单元的示例而形成的数据存储装置。存储装置913可以由例如诸如硬盘驱动器(hdd)的磁性存储装置、半导体存储装置、光存储装置、光磁存储装置等来实现。存储装置913可以包括存储介质、将数据记录在存储介质上的记录装置、从存储介质读取数据的读取装置、删除记录在存储介质上的数据的删除装置等。存储装置913可以存储要由cpu 901执行的程序、各种数据以及从外部获取的各种数据等。存储装置913例如可以执行存储单元111的功能。

213.驱动器914是存储介质的读写器,内置在或外接至信息处理装置10。驱动器914读出在诸如安装磁盘、光盘、磁光盘或半导体存储器的可移除存储介质中记录的信息,并将读出的信息输出到ram 903。驱动器914还能够将信息写入可移除存储介质。

214.连接端口915是连接至外部装置的接口。例如,连接端口915可以是能够与外部装置执行数据交换的连接端口,并且可以是例如通用串行总线(usb)。

215.通信装置916例如是由通信装置等所形成的接口,用以连接至网络30。通信装置916例如可以是用于有线或无线局域网络(lan)、长期演进(lte)、蓝牙(注册商标)、无线usb(wusb)等的通信卡。此外,通信装置916可以是光学通信路由器、非对称数字订户线(adsl)路由器、用于各种通信的调制解调器等。通信装置916可以根据诸如tcp/ip的预定协议通过

因特网与其他通信装置交换信号等。

216.连接端口915或通信装置916可以执行通信单元113的功能。

217.顺便提及,还可以创建用于允许诸如内置在信息处理装置10中的cpu、rom和ram的硬件装置发挥与构成根据上述本实施方式的系统的信息处理装置10的各个配置等同的功能的计算机程序。还可以提供存储计算机程序的存储介质。

218.以上已经参照附图详细描述了本公开内容的优选实施方式。然而,本公开内容的技术范围不限于这样的示例。对于本公开内容的技术领域的技术人员来说明显的是,在权利要求中描述的技术思想的范围内可以构思各种修改和变更,并且这些修改和变更自然落入本公开内容的技术范围内。

219.此外,本说明书中描述的效果仅仅是说明性的或示例性的,而不是限制性的。也就是说,除了以上效果之外或代替以上效果,根据本公开内容的技术可以表现出根据本说明书的描述对本领域技术人员明显的其他效果。

220.注意,以下配置也属于本公开内容的技术范围。

221.(1)

222.一种信息处理装置,包括:

223.输出控制单元,其控制从交互装置到用户的输出;

224.动作评估单元,其确定与所述交互装置的输出相对应地执行的所述用户的动作;

225.情绪估计单元,其估计与所述用户的动作相对应的所述用户的情绪;以及

226.信息累积单元,其将所述交互装置的输出、所述用户的动作和所述用户的情绪彼此关联地累积为交互信息,

227.其中,所述输出控制单元基于所累积的交互信息来控制从所述交互装置到所述用户的输出。

228.(2)

229.根据(1)所述的信息处理装置,其中,所述动作评估单元通过以相同的时间序列列出所述交互装置的输出和所述用户的动作来确定与来自所述交互装置的输出相对应地执行的所述用户的动作。

230.(3)

231.根据(2)所述的信息处理装置,其中,当在预定时间内已经连续地执行了所述交互装置的输出和所述用户的动作时,所述动作评估单元确定所述交互装置的输出对应于所述用户的动作。

232.(4)

233.根据(2)或(3)所述的信息处理装置,其中,当在所述交互装置执行的输出之后所述用户的动作已经改变时,所述动作评估单元确定所述交互装置执行的输出对应于所述用户的改变后的动作。

234.(5)

235.根据(1)至(4)中任一项所述的信息处理装置,其中,所述情绪估计单元通过将设置为与每种类型的情绪有关的语音和动作与所述用户的动作进行比较,来估计与所述用户的动作相对应的所述用户的情绪。

236.(6)

237.根据(1)至(5)中任一项所述的信息处理装置,其中,所述交互信息还包括与将所述交互装置的输出、所述用户的动作和所述用户的情绪彼此相关联的前提条件有关的信息。

238.(7)

239.根据(6)所述的信息处理装置,其中,当与所述交互装置的相同输出相对应的所述用户的动作或情绪在多条交互信息中变化时,将所述交互装置或所述用户的周围环境的差异添加到所述多条交互信息中的每一条条交互信息作为所述前提条件。

240.(8)

241.根据(1)至(7)中任一项所述的信息处理装置,其中,当所述用户存在多个时,所述输出控制单元基于为每个用户设置的优先级来确定所述交互装置要向其给出输出的用户。

242.(9)

243.根据(8)所述的信息处理装置,其中,基于关于所述交互装置与每个用户的交互的频率、时间以及深度中的至少任意一个或更多个来设置所述优先级。

244.(10)

245.根据(1)至(9)中任一项所述的信息处理装置,其中,所述输出控制单元基于所述用户的说话的内容来估计所述用户期望从所述交互装置给出的输出,并且控制所述交互装置给出所估计的输出。

246.(11)

247.根据(10)所述的信息处理装置,其中,所述输出控制单元控制所述交互装置以给出在所述用户期望从所述交互装置给出的多个模式的输出之中能够由所述交互装置执行的输出。

248.(12)

249.根据(11)所述的信息处理装置,其中,所述输出控制单元在从所述用户的说话的点直到所述交互装置向用户给出输出的点为止的期间,提供预定长度的等待时间。

250.(13)

251.根据(12)所述的信息处理装置,其中,所述输出控制单元针对所述交互装置执行的每个输出随机地控制所述等待时间的长度。

252.(14)

253.根据(1)至(13)中任一项所述的信息处理装置,其中,所述交互装置是机器人装置。

254.(15)

255.根据(1)至(14)中任一项所述的信息处理装置,其中,所述交互装置给出输出,所述输出发动所述用户的视觉、听觉和触觉中的至少任意一个或更多个感觉。

256.(16)

257.一种信息处理方法,所述信息处理方法包括由算术处理装置执行:

258.控制从交互装置到用户的输出;

259.确定与所述交互装置的输出相对应地执行的所述用户的动作;

260.估计与所述用户的动作相对应的所述用户的情绪;

261.将所述交互装置的输出、所述用户的动作和所述用户的情绪彼此关联地累积为交

互信息;以及

262.基于所累积的所述交互信息来控制从所述交互装置到所述用户的输出。

263.(17)

264.一种程序,使计算机用作以下单元:

265.输出控制单元,其控制从交互装置到用户的输出;

266.动作评估单元,其确定与所述交互装置的输出相对应地执行的所述用户的动作;

267.情绪估计单元,其估计与所述用户的动作相对应的所述用户的情绪;以及

268.信息累积单元,其将所述交互装置的输出、所述用户的动作和所述用户的情绪彼此关联地累积为交互信息,

269.其中,所述程序还使所述输出控制单元工作,以便基于所累积的交互信息来控制从所述交互装置到所述用户的输出。

270.附图标记列表

271.10、11 信息处理装置

272.20 机器人装置

273.30 网络

274.40 用户

275.101 传感器单元

276.103 识别单元

277.105 动作评估单元

278.107 情绪估计单元

279.109 信息累积单元

280.111 存储单元

281.113 通信单元

282.121 信息累积单元

283.123 确定单元

284.125 动作诱导器

285.201 传感器单元

286.203 识别单元

287.205 输出控制单元

288.207 输出单元

289.209 通信单元

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。