1.本发明涉及一种用于运行深度神经网络的方法。本发明同样涉及分别被设立为实施该方法的一种设备和一种计算机程序。

背景技术:

2.作者fischer, v.、k

ö

hler, j.和pfeil, t.在他们的出版物“the streaming rollout of deep networks

‑

towards fully model

‑

parallel execution”(在advances in neural information processing systems中(4043

‑

4054页))中公开了一种用于能够完全并行化地运行深度神经网络的方法。

3.de 20 2018 104 373公开了一种用于实施其中给机器学习系统分派可预先给定的控制模式的方法的设备,该控制模式表征一顺序,机器学习系统的层按照该顺序确定它们的中间参量。

4.由于移动终端设备通常具有有限的能量预算,所以值得期望的是:在这些终端设备上运行深度神经网络时消耗尽可能少的能量。按照本发明的方法的优点在于:深度神经网络至少部分地依次被实施,以便节能并且仍然提供精确的结果。按照本发明的方法的另一优点在于:依次实施的深度神经网络比针对相应的(能量或时间)预算优化的多个深度神经网络需要更少的存储器。至少部分地依次实施深度神经网络的优点在于从输入信号到输出信号的低时延。接着,第一“粗略”结果通过添加其它路径来被精细化。

技术实现要素:

5.在本发明的第一方面中,提出了一种按照独立权利要求1所述的用于运行具有至少一个跨接连接的深度神经网络的方法、尤其是计算机实现的方法。该方法主要包括如下步骤:选择第一路径,该第一路径表征在使用跨接连接的情况下沿着深度神经网络的层的可预先给定的顺序的至少一部分的层序列。然后,借助于输入参量沿着第一路径的传播来确定输出参量。然后,检查该输出参量是否满足可预先给定的标准。如果不满足所述可预先给定的标准,则选择经过深度神经网络的另一路径,该另一路径不同于该第一路径,例如该另一路径比该第一路径长至少一个层。优选地,第二路径与第一路径的不同之处在于:尤其是除了第一路径的层之外,第二路径的层序列具有深度神经网络的未包含在第一路径中的层中的至少一个层。然后,输入参量被沿着第二路径传播。也可设想的是:如果深度神经网络的架构能够实现相同长度的路径,则选择经过该深度神经网络的相同长度的路径。

6.跨接连接(英文skip

‑

connection)将深度神经网络的层中的一个层附加地与该深度神经网络的层相继布置的可预先给定的顺序的另一、尤其是下一层连接。在所述可预先给定的顺序中,该另一层并不是具有跨接连接的层的紧挨着的下一层。

7.路径、尤其是信号传播路径可以表征深度神经网络的多个层的无中断的、前向的序列。也就是说,那么该路径表征深度神经网络的所述多个层如何相继连接,以便将输入参量通过深度神经网络在输入层、即深度神经网络的接收该深度神经网络的输入参量的层处

开始传播直至输出深度神经网络的输出参量的输出层为止。

8.应注意:形成相应路径的层分别只根据该路径的至少一个(紧挨着地)上一个连接的层的至少一个被分配给这些层的中间参量来确定这些层的中间参量。还应注意:相应路径的按深度神经网络的层的顺序与超过一个先前的层连接的层只根据按照该路径的紧挨着地上一个连接的层的紧挨着地上一个所确定的中间参量来确定该层的中间参量。中间参量被理解成层的输出参量,其中该输出参量被提供作为下一个连接的层的输入参量。

9.沿着该路径的传播被理解为使得输入参量通过深度神经网络沿着该路径的层的所规定的序列来被处理。

10.该方面的优点在于:在运行深度神经网络时节省能量,因为并不需要深度神经网络的所有层,而是只使用相应路径的层。另一优点在于:根据经过深度神经网络的可能路径中的哪些不同的路径被选择,可以动态调节能量需求。因此,深度神经网络的深度可以根据可预先给定的条件被动态适配,以便仍然确保对输入参量的更可靠的处理。

11.提出:在沿着路径来传播输入参量时,神经网络的对于相应的所使用的路径来说不需要的那些层被停用并且只有当对于相应路径来说需要那个层时才被激活。

12.被停用的层可以被理解为使得这些被停用的层不必从存储器中被加载并且因此不需要计算机的其它资源。如果深度神经网络纯粹以硬件来实现,则被停用的层可以被理解为使得即使例如在该层的所属的硬件模块处存在适合的数据,该模块也不实施运算操作。

13.由于该停用,针对该层不实施相应的运算操作。因此,深度神经网络可以能效特别高地处理输入参量。

14.还提出:在沿着第二路径传播时,第二路径与第一路径所不同的那些层确定它们的中间参量。还提出:在沿着第二路径来传播时,第二路径的与深度神经网络中的超过一个先前的层连接并且也曾包含在第一路径中的那些层还根据第二路径的相应的紧挨着的上一个连接的层的所提供的中间参量和第一路径的紧挨着的上一个连接的层的上一个提供的中间参量来确定那些层的中间参量。有利地,上一个提供的中间参量被重新使用,即不被重新计算。

15.上一个提供的中间参量是在沿着第一路径传播输入参量时被提供给该层的那个中间参量。

16.应注意:与超过一个先前的层连接的层也可以将它们的中间参量与先前已经使用的沿着第一路径被确定的中间参量彼此组合,例如利用数学运算mean()、max()、add()、concat()来组合。

17.在这种情况下的优点在于:可以避免针对相应的输入参量不必要地重新计算中间参量,由此能够实现对供支配的、有限的资源的还更节约的使用。

18.还提出:借助于同时沿着第一和第二路径传播深度神经网络的输入参量来确定输出参量。第一和第二路径的共同的层可以在正好一个计算单元上被正好实施一次。这些共同的层是其按深度神经网络的层的可预先给定的顺序的相应的位置对应于在第一路径的层序列中并且在第二路径的层序列中的相同位置的层。

19.优选地,其余的层中的包含在第一和第二路径的两个层序列中并且在第一路径的层序列中和在第二路径中具有分别不同的位置的那些层的中间参量在重复实施这些层时

根据在首次确定中间参量时按照相应的层的不同位置中的先前位置来被使用的上一个提供的中间参量和按照相应的层的不同位置的稍后的位置所提供的中间参量来被确定。

20.在计算单元上,第一和第二路径的层分别相继按照它们在相应路径的层序列中的位置来确定它们的中间参量。为此,可以给每个所选择的路径的每个层分别分配时间点序列中的一个时间点,在该时间点,相应的层根据被提供给该层的中间参量来确定该层的中间参量。与超过一个先前的层连接的那些层可分配有多个不同的时间点。在此,这些时间点是这些层在计算单元上实施它们的运算操作的时间点。还提出:在确定输出参量时,时间点序列开始并且在相应的当前时间点,所选择的路径的分配有与当前时间点相对应的时间点的所有层都确定它们的中间参量。与超过一个先前的层连接的层在相应的与分别被分配给这些层的不同时间点相对应的当前时间点分别根据对其来说直至相应的时间点存在的中间参量、尤其是在先前的时间点存在的中间参量来确定这些层的中间参量。每当确定了输出参量时,就检查可预先给定的标准。如果不满足该标准,则在相应的随后的时间点继续实施对这些层的处理,直至下一个输出参量被输出为止。

21.应注意:所选择的路径的被分配了相同的时间点的层同时分别确定它们的中间参量。这所具有的有利效果在于:这些层并行化地被实施并且因此使该方法加快。

22.对时间点的分配可以进行为使得在每个紧接着的下一时间点,按照该路径的分别紧接着的下一个连接的层根据上一个连接的层的所确定的中间参量来确定该层的中间参量。

23.这里可以说是这些层之间的相关性的解耦,因为与超过一个先前的层连接的层不必等待直至所有需要的中间参量都存在为止。因而,可以说是同时运行所有路径。

24.由于神经网络只具有前向连接,这些层在确定它们的中间参量之后不再被需要,而且多个输入参量可以有利地在各一个时间点被提供给输入层并且通过深度神经网络来被传播。由此,不仅这些路径被并行运行,而且输入参量通过深度神经网络被并行处理。

25.有利地,各个层在各一个自己的计算单元上、尤其是在并行化的硬件上被实施。这允许高效的运行,因为如上所述该方法高效地使用资源并且附加地通过并行化地运行这些层来实现对各个计算的高效的实施。

26.在这种情况下的另一优点在于:在并行化地运行这些层时,可以实现所要处理的输入参量的更高的吞吐量,因为在输入参量通过深度神经网络来被传播期间,已经可以通过深度神经网络来传播其它输入参量。因此,与深度神经网络的常规运行相比,在对输出参量的输出之间的时间间隔被缩短,并且在相同的时间段内可以处理更多输入参量。

27.有利地,深度神经网络的参数和激活被量化并且其中第一路径是经过深度神经网络的最短路径。

28.还提出:深度神经网络的每个路径都彼此分开地被教导和/或至少一组路径共同被教导。

29.在这种情况下的优点在于:通过对多个路径的并行优化可以确保:各个路径的中间参量不会退化,诸如当整个神经网络被训练时不会退化。

30.在这种情况下还有利的是:深度神经网络在这种教导之后相对于路径或层的失灵而言更加稳健,因为路径是彼此分开地被训练的。

31.还提出:在满足标准之后,根据深度神经网络的输出参量来确定控制参量。控制参

量可以被用于控制技术系统的执行器。该技术系统例如可以是至少部分自主机器、至少部分自主车辆、机器人、工具、工厂机器或者如无人驾驶飞机那样的飞行器。

32.在本发明的另一方面中提出:深度神经网络的输入参量是借助于传感器所检测到的参量。然后,通过深度神经网络沿着相应路径来传播传感器参量。

33.在另一方面中,提出了一种计算机程序。该计算机程序被设立为实施上文提到的方法之一。该计算机程序包括指令,当该计算机程序在计算机上运行时,这些指令促使该计算机以这些所提到的方法之一的所有步骤来实施该方法。还提出了一种机器可读存储模块,在其上存储有该计算机程序。还提出了一种设备,该设备被设立为实施这些方法之一。

附图说明

34.上述方面的实施例在随附的附图中示出并且在随后的描述中进一步予以阐述。在此:图1示出了具有经过深度神经网络的多个路径的该深度神经网络的示意图;图2示出了对路径的并行化实施的示意图;图3示出了用于运行深度神经网络的方法的实施方式的示意图;图4示出了机器人的实施方式的示意图,该机器人使用用于运行深度神经网络的方法。

具体实施方式

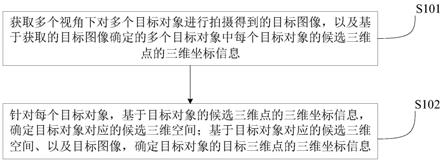

35.图1示出了深度神经网络(10)的示意图,该深度神经网络根据输入参量(x)来确定输出参量(y)。在深度神经网络(10)的一个实施方式中,深度神经网络(10)根据图像(x)来确定该图像(x)的分类(y)。在一个替选的实施方式中,深度神经网络(10)根据输入参量(x)来确定回归(y)。

36.如图1中所示,深度神经网络(10)通过多个彼此经由连接(12)来连接的层(11)被构造。应注意:至少两个层也可以彼此并联。

37.获得输入参量(x)的那个层在下文称为输入层并且将输出参量(y)输出的那个层在下文称为输出层。连接(12)可以配备有权重,以便将相应的层的所输出的中间参量加权地提供给相应的连接的下一个层。

38.这些层分别包括多个神经元,这些神经元分别具有可预先给定的激活函数。替选地,这些层中的至少一个层构造成卷积层(英文convolutional layer)。附加地,在该实施例中的深度神经网络(10)具有两个跨接连接(13a、13b)。第一跨接连接(13a)将输入层的紧挨着的下一层与输出层连接。也就是说,输入层的所确定的中间参量不仅被转发到该输入层的紧挨着的下一层并且被转发到输出层。第二跨接连接(13b)将输入层与输出层直接连接。

39.由于跨接连接(13a、13b),可以确定经过深度神经网络(10)的多个路径(10a、10b、10c)。这在图1中在示意性示出的深度神经网络(10)的右侧被示出。

40.经过深度神经网络(10)的第一路径(10a)只使用输入层和输出层,该输入层和该输出层经由两个跨接连接(13b)来彼此连接。也就是说,在通过深度神经网络(10)沿着第一路径(10a)来传播输入参量时,只使用输入层和输出层。

41.经过深度神经网络(10)的第二路径(10b)使用输入层、该输入层的紧挨着的下一层和输出层,该输出层经由连接(12)和第一跨接连接(13a)来彼此连接。输入层的紧挨着的下一层在下文称为第二层并且该第二层的紧挨着的下一层称为第三层。

42.第一路径与第二路径的区别在于:第二路径(10b)比第一路径(10a)长一个层。

43.另一路径(10c)可以通过使用深度神经网络(10)的每个层来被限定,这些层彼此间只通过前向连接(12)来彼此连接。

44.如果输入参量(x)通过深度神经网络(10)沿着第一路径(10a)被传播,则输出参量(y)在两个时间步长之后就已经存在。因为在第一时间步长之内,输入参量(x)在输入层中被处理并且作为中间参量被输出。由于第一路径(10a)通过第二跨接连接(13b)来被限定,所以输入层的中间参量在下一个时间步长通过输入层来被处理。也就是说,尽管整个深度神经网络都通过其分别需要一个时间步长来进行处理的层序列、即总共需要至少4个时间步长以便将输出参量(y)输出,但是在两个时间步长之后就已经存在输出参量。

45.应注意:如图1中所示,深度神经网络(10)的输出层根据三个中间参量来确定输出参量(y),但是在使用第一路径(10a)的情况下根据仅一个中间参量来确定该输出参量。在这种情况下,不考虑其它两个中间参量,因为第一路径(10a)不经过分别针对此所需要的层。

46.对于输入参量(x)通过深度神经网络沿着第二路径(10b)来被传播的情况来说,输入层同样在第一时间步长处理输入参量(x)并且输出该输入层的中间参量。在第二时间步长,第二层根据输入层的中间参量来确定该第二层的中间参量。然后,在第三时间点,由于第一跨接连接(13a),第二层的所输出的中间参量被输出层处理。也就是说,在已经三个时间步长之后,存在深度神经网络的输出参量。

47.相同的解释也可以被用于沿着第三路径对输入参量(x)的传播。在这种情况下,在第四个时间步长之后才存在输出参量,因为输入参量必须被传播经过全部四个层。

48.通过使用这些路径,可以实现深度神经网络的明显更高的响应性,因为不必等待直至输入参量完全被传播经过这些层中的每个层直到输出端为止。

49.图2示出了用于部分或完全并行化地实施(英文streaming rollouts)深度神经网络(10)的方法的简化图,在该深度神经网络的情况下,输入参量通过深度神经网络(10)同时沿着三个路径(10a、10b、10c)被传播。

50.用于并行化地实施深度神经网络(10)的方法的特点在于:这些层的一部分或者所有层都并行化地并且彼此独立地被运行。

51.在时间点序列(t)的第一时间点(t=1),输入参量(x)在输入层中被处理,在图2中通过对输入层的突出(21)来呈现。

52.由于深度神经网络(10)的各个层彼此独立地被运行,在第一时间点(t=1)的紧接着的下一个时间点(t=2),不仅输入层的该中间参量在第二层中被处理而且该中间参量在输出层中也被处理。对第二层和输出层的该并行化的计算在图2中通过对这些层的突出(22)来被呈现。应注意:通过第二跨接连接,输入层的中间参量被提供给输出层。也就是说,在第二时间点(t=2),输出层只根据输入层的中间参量来确定输出参量(y)。

53.对于深度神经网络(10)对输入参量(x)进行分类的情况来说,输出层输出分类,该分类的精度(acc)或可靠性在其上方的图表中示例性呈现。

54.在第三时间点(t=3),第二层的所确定的中间参量不仅在输出层中被进一步处理而且也在第三层中被进一步处理。优选地,在第三时间点(t=3),输出层根据输入层的已经在第一时间步长(t=1)被确定的中间参量和第二层的中间参量来确定输出参量(y)。在图2中通过突出(23)来呈现第三层在第三时间点(t=3)确定其中间参量。输出层同样配备有突出(23),因为该突出根据第二层的中间参量来对输出参量进行更新。

55.对于深度神经网络(10)执行对输入参量(x)的分类的情况来说,根据两个中间参量对输出层中的输出参量的确定引起:该分类将更精确或更可靠。这在其上方的图表中通过如下方式来呈现:描述输出参量(y)的精度(acc)或可靠性的变化过程的曲线(25)略微升高。

56.优选地,在第四时间点(t=4),输出层现在根据所有被提供给它的中间参量来确定输出参量。(这在图2中通过附图标记24来呈现)。因为由于通过使用太多的层对深度神经网络(10)的过度参数化而可能发生输出参量的精度或可靠性降低的情况,所以在其上方的图表中的曲线下降。但是,也可能发生如下情况:第三层贡献其它有价值的信息,这些信息可引起还更精确的分类。因此,于是曲线(25)会进一步升高。

57.可设想的是:在每个时间点(t=1, ... ,4),总是有相同的输入参量(x)附在输入层上,直至所有路径都被计算出了为止。应注意:在图2的一个替选的实施例中,在每个时间点(t=2, 3, 4)都存在深度神经网络的时间上后续的输入参量并且这些输入参量可以通过深度神经网络来逐步被传播。于是,在相应的时间点,不仅被需要用于处理能分配给输入参量(x)的中间参量的层活跃,而且处理能分配给后续的输入参量的中间参量的层活跃。因此,可以实现深度神经网络(10)的更高的利用率。

58.对于该网络替代分类而实施回归的情况来说,曲线(25)可以示例性地呈现深度神经网络(10)的输出参量(y)的值的经插值的变化过程。

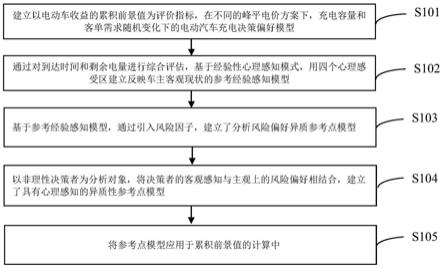

59.图3示出了用来实施用于运行神经网络的方法的流程图的示意图。

60.方法(30)开始于步骤s31。在步骤s31中,所提供的具有至少一个跨接连接的深度神经网络、例如按照图1的深度神经网络(10)被分解成多个路径(10a、10b、10c)。各个层的权重可以被路径(10a、10b)共享。附加地,这些路径也可以通过将这些层限于更小集合的参数、尤其是权重来被限定。可选地,在步骤s31之后可以实施步骤s32。在步骤s32中,深度神经网络被教导。教导被理解为:对深度神经网络的参数化根据所提供的训练数据和分别被分配给这些训练数据的标签来被适配为使得成本函数关于训练标准方面变得最佳。通过各个路径分开地、尤其是彼此独立地被教导,可以对深度神经网络进行教导。也就是说,对于这些路径中的每个路径来说,在教导时评估成本函数(英文loss function)。由此,形成信息处理的平行路径,使得在一条路径中有干扰时,其它路径可维持神经网络的原来的输出值。

61.还应注意:对于作为输入参量的时间序列来说,可以将需要一样多的时间步长的那些路径组合成组并且配备成本函数。

62.附加地或替选地,可以共同教导一组路径或者所有路径。在这种情况下,于是该成本函数由各个路径的各个、优选地经加权的成本函数组成。

63.在教导时使用的不同路径的数目可以根据可支配的资源的所希望的粒度来被选择。

64.也可设想的是:已经在教导时、尤其是在结束教导前不久检查哪些路径合理。例如检查:使用这些路径之一是否可有助于改善输出参量的质量。如果查明这些路径之一无助于改善,则该路径可以被丢弃或者该路径与其它路径所不同的相对应的层可以从深度神经网络中被除去。在这种情况下的有利的效果在于:在教导时已经优化深度神经网络的架构。

65.替选地或附加地,借助于强化学习(英文reinforcement learning)可以教导:根据输入参量来确定哪条路径是最适合于相应的输入参量的路径。

66.在步骤s31或可选的步骤s32结束了之后,接着是步骤s33。其中最初选择在步骤s31中被选择的多个路径中的路径之一。优选地,最初选择经过深度神经网络的最短路径,即其中需要深度神经网络(10)的最少的层的那条路径,以便通过深度神经网络(10)来传播输入参量(x)。替选地,最初和/或在重复实施步骤s33时,可以借助于所教导的上下文通过强化学习来从步骤s32中选择另一路径。接着,深度神经网络可以按照所选择的路径来被配置。如果该另一路径被选择了,则神经网络可以按照该另一路径被重新配置。对深度神经网络的配置可以被理解为:只使用属于相应路径的那些层。也可设想的是:使用另一神经网络,该另一神经网络按照另一路径来被配置,使得输入参量可以在随后的步骤中通过该另一神经网络来被传播。

67.然后,在下一步骤s34中,输入参量通过深度神经网络来被传播,该深度神经网络按照步骤s33中所选择的路径来被配置,参见关于图1的阐述。例如,深度神经网络按照所选择的路径来被配置,其方式是将不属于第一路径或不属于其它路径之一的那个层停用。

68.然后,在步骤s35中检查:神经网络的在步骤s34中传播输入参量之后在深度神经网络的输出端处被输出的输出参量是否满足可预先给定的标准。例如,在分类的情况下该可预先给定的标准可以是:在概率最高的类别与其它类别之间必须存在可预先给定的最小分类区别,例如输出值最高的类别的输出值应该至少与其它类别的输出值相差20%。附加地或替选地,可以检查:可预先给定的资源配额、如能量/时间预算或者存储配额是否已经由于根据步骤s34的传播而被用完。因而,该标准优选地表征阈值,例如输出参量(y)的置信度或方差和/或资源配额。附加地或替选地,该标准可以表征不同路径的分别输出的输出参量的变化。如果例如输出参量被改变小于5%,则满足该标准。

69.如果按照步骤s34的标准不应该被满足(图3:分岔“否”),则重新实施步骤s33,其中现在从多个所选择的路径中选择另一路径。该另一路径至少比先前所选择的路径长一个层。由此,有效地将另一层接上深度神经网络,该另一层提高了深度神经网络的表达能力,由此可以确定更精确的输出参量、尤其是经改善的分类。接着,按照该另一路径来配置神经网络。

70.该另一路径可以从所有可能路径的集合中被随机抽取或各个层可以以一定的概率被排除在外。优选地,在教导时使用该随机抽取。在推理期间,随机抽取的好处在于能执行对输出参量的离散度的计算。

71.此外,通过各个路径和/或路径组的显式加权、尤其是关于在教导期间的成本项/函数的显式加权,可以影响网络的特性。例如,应该是单独特别有工作能力的和/或不那么易受干扰的那些路径可以被特别强地加权。同样,路径可以依据它们的资源需求、例如能量需求来被加权。

72.输入参量(x)越复杂,或有越多资源供支配,就优选地将越多的层用于计算输出信

号、尤其是更长的路径。

73.在结束步骤s33之后,重新执行步骤s34。

74.优选地,在重复实施步骤s34时,再次使用在沿着第一路径传播时所确定的中间结果,由此深度神经网络的参数不必重复地被加载到计算单元中。此外,不必重新执行已经被执行的计算。

75.如果现在在步骤s35中满足该标准,则接着是步骤s36。在步骤s36中,例如可以根据深度神经网络的输出参量来操控至少部分自主机器人。

76.在方法(30)的一个替选的实施方式中,深度神经网络(10)按照图2并行化地运行。

77.在这种情况下,尤其是在每个时间步长(t=2, 3, 4)之后,每当该网络将输出参量(y)输出时,就可以实施步骤s35。如果步骤s35输出否,则深度神经网络继续按照根据图2的做法来运行。

78.与图3中不同,按照图2中的计算的所描述的做法,在步骤s33中,神经网络不必针对所选择的另一路径被重新配置,而是仅须实施对随后的时间步长的所需的计算。例如,在时间点t=2,对步骤s35的检查得出:输出参量不满足该标准,实施时间点t=3的计算,即具有突出(23)的层现在实施它们的计算。

79.如果在步骤s35之后判定输出参量满足该标准,则像在图3中那样实施步骤s36。

80.该至少部分自主机器人在图4中通过至少部分自主车辆(40)来示意性呈现。在另一实施例中,该至少部分自主机器人可以是服务机器人、装配机器人或固定式生产机器人,替选地可以是自主飞行器、如无人驾驶飞机。

81.至少部分自主车辆(40)包括检测单元(41)。检测单元(41)例如可以是摄像机,该摄像机检测车辆(40)的周围环境。检测单元(41)与深度神经网络(10)连接。按照图3的方法,深度神经网络(10)根据由检测单元(41)提供的所提供的输入参量并且根据多个参数来确定输出参量。该输出参量将被转发给控制单元(43)。

82.控制单元(43)根据深度神经网络(10)的输出参量(y)来控制执行器,优选地将该执行器控制为使得车辆(40)实施无碰撞的机动动作。在第一实施例中,执行器可以是车辆(40)的马达或制动系统。在另一实施例中,该部分自主机器人可以是工具、机床或生产机器人。工件的材料可以借助于深度神经网络(10)来被分类。在这种情况下,执行器例如可以是驱动磨削头的马达。

83.车辆(40)、尤其是部分自主机器人还包括计算单元(44)和机器可读存储元件(45)。在存储元件(45)上可以存储计算机程序,该计算机程序包括指令,在计算单元(44)上实施这些指令时,这些指令引起计算单元(44)实施按照图3的方法(30)。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。