基于卷积的swin transformer植物叶片病害程度和种类的识别与分类方法

技术领域

1.本发明涉及复杂环境下植物叶片病害检测和分类领域,具体为基于卷积的swin transformer植物叶片病害程度和种类的识别与分类方法,本方法以convolutionalswin transformer模型进行特征提取和利用全连接神经网络作为分类器实现植物叶片病害程度和种类识别。

背景技术:

2.在农业发展过程中,植物病害带来的负面影响一直是一个重大挑战。如果早期对植物病害程度以及种类没有有效的监测,并且及时采取相关措施,将会严重影响经济收益。传统的人工检测方式并不适用于大面积的病害监测,耗费大量的人力财力的同时,并不能及时有效的获取病害发展情况,错过采取相关措施的最佳时间,从而,导致巨大的损失。因此,对植物病害进行及时有效的监管措施十分重要。

3.近些年来,随着人工智能的迅猛发展,很多领域采用人工智能的相关技术,有效的解决了各自领域内的重大问题。计算机视觉作为人工智能领域的一个重要分支,为解决其他领域内的问题,提供了强有力的方法,促进了多个领域的发展,在物体的识别和分类问题中,取得了重大进展。当植物受到病害的侵害,往往将会在植物的叶片、茎、花或者果实上显现相关病理特征。一般情况下,叶片中所显示的特征最为明显,并且利于检测,因此叶片上的病理特征将作为植物病害程度检测的主要信息来源。在植物病害检测问题中,有研究成功的应用深度学习技术解决了cassava disease 识别分类问题,采用卷积神经网络实现了实时西红柿病害的识别与监测。

技术实现要素:

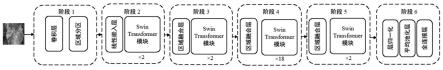

4.监测植物病害程度和病害种类识别是现代农业中十分重大的挑战,因为植物病害会造成严重的经济损失和威胁食品安全。随着人工智能技术的发展,有不少研究工作利用图像检测植物病害。由于,植物病害的图像获取困难,导致数据量并不充分。因此,高效的利用现有的图像数据显得尤为重要。为了解决这个问题,本发明基于swin transformer提出一种高效的专门检测病害程度和病害种类的网络结构(convolutional swin transformer),网络模型中,采用window based self-attention, shifted window self-attention ,residual structure and convolutional block保证网络可以高效的学习图像信息,本发明立足于科研的实际应用价值,着手于研究在真实环境下植物叶片病害的检测与分类,提出基于convolutional swin transformer模型的植物叶片病害程度和种类的识别与分类方法。

5.本发明基于卷积的(convolutional)swin transformer模型可以高效的利用图像信息,准确的识别与分类植物叶片病害程度和种类。基于卷积的swin transformer植物叶片病害程度和种类的识别与分类方法,包括以下步骤:

包括以下步骤:步骤1:构建植物叶片病害数据集:通过现实采集或者从网络中获取公开的数据集,将获得到的图像数据,按照病害种类和病害程度分为两大类,每一类的图像数据按比例划分训练集和测试集;步骤2:数据预处理:读取每一张图像尺寸信息,检验尺寸是否达到要求;若满足尺寸要求则不做处理,若不满足要求则需要利用双线性插值的方法,调整图像的尺寸大小;步骤3:建模步骤:构建convolutional swin transformer6个阶段的模型结构,在swin transformer模型5个阶段的基础上增加一个阶段作为第1个阶段,第1个阶段包括卷积层和区域分区;步骤4:确定训练参数步骤:根据数据集图像总数量,以及图像除了待检测叶片外包含的背景是否复杂数据因素,初步确定模型训练参数;步骤5:训练模型:在pytorch框架下,将经过预处理的数据集送入模型中按照步骤4设置的超参数进行训练;步骤6:将训练好的模型,利用步骤1划分出的测试集经行测试;步骤7:最后得到的植物病害种类分类模型和植物病害程度识别模型用于植物病害程度和种类的识别与分类。

6.上述的基于卷积的swin transformer植物叶片病害程度和种类的识别与分类方法,每一类的图像数据根据数据总量按照8:2的比例划分训练集和测试集,即训练集图像数据数量占总数量的80%,其余作为测试集。

7.上述的基于卷积的swin transformer植物叶片病害程度和种类的识别与分类方法,每一张图像尺寸为224

×

224

×

3,其中宽和高都是224个像素,并且每张图像拥有红绿蓝三个通道。

8.通过本发明的研究,实现的目标如下:(1)利用双线性插值将数据集中所有的图像尺寸调整为224

×

224

×

3。其中宽和高都是224个像素,并且每张图片拥有红绿蓝三个通道。

9.(2)将数据集按照病害种类和病害程度分为两类。其中,病害种类的数据集中之包含不同种类的植物病害图像,在此数据集中不考虑植物病害程度。同理,植物病害程度这一类的数据集只包含不同程度的植物病害图像,不考虑植物病害种类。

10.(3)将convolutional swin transformer模型单独在两类数据集下分别训练得到两个模型,这两个模型可以分别识别植物病害程度、分类植物病害种类。

11.(4)两个模型分别对于植物病害种类和程度具有很高的识别准确率。

12.本发明的优势:利用深度学习的特性,不需要人工提取图像特征,只需要将图像数据送入模型中训练,计算机就可以学习到数据集内的植物叶片病害特征,通过这些特征的学习可以准确的识别植物病害种类和程度。

附图说明

13.图1为 convolutional swin transformer模型结构图。

14.图2为实施例测试结果图。

15.图3为模型训练初步参数设定图。

16.图4为pc机的配置图。

具体实施方式

17.下面结合具体实例对本发明进行详细说明。在本次的实施样例中,采用个人pc机作为硬件平台,并且在gpu模式下经行。采用黄瓜叶片病害程度数据集、马铃薯叶片病害程度数据集以及plant village数据集中番茄数据集的子集作为实例的数据集。pc机的配置如图4所示。

18.根据本发明提供的一种基于卷积的swin transformer植物叶片病害程度和种类的识别与分类方法,包括以下步骤:步骤1:构建植物叶片病害数据集。在使用的数据集中黄瓜叶片病害程度数据集和马铃薯叶片病害程度数据集是属于描述植物病害程度的数据集,而plant village数据集中番茄数据集的子集作为实例的数据集是属于描述植物病害种类的数据集。每一类的图像数据根据,数据总量按照8:2的比例划分训练集和测试集。其中,训练集图像数量占总数量的80%,其余作为测试集。

19.步骤2:由于三个数据集中的所有图像尺寸均不符合模型要求,因此采用双线性插值的方式将所有数据集中的图像尺寸调整为224

×

224

×

3。其中宽和高都是224个像素,并且每张图片拥有红绿蓝三个通道。

20.步骤3:建模步骤:构建convolutional swin transformer6个阶段的模型结构。

21.步骤4:确定训练参数步骤:根据数据集图像总数量,以及图像除了待检测叶片外包含的背景是否复杂等数据因素,初步确定模型训练参数。本实例中采用的参数如图3所示。

22.步骤5:训练模型。在pytorch框架下,将经过预处理的数据集送入模型中按照步骤4设置的超参数进行训练。

23.步骤6:将训练好的模型,利用步骤1划分出的测试集经行测试。本实例的测试结果如图2所示,本发明网络在真实环境下识别植物病害程度达到90.91%的准确率,在稳定环境下识别病害程度达到97.53%的准确率,在识别病害类别达到了98.2%的准确率。实验结果证明了本发明网络的可靠性,并且可以有效的利用图像信息检测病害程度和识别病害种类。

24.步骤7:最后得到的植物病害种类分类模型和植物病害程度识别模型用于植物病害程度和种类的识别与分类。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。