1.本发明涉及深度学习的目标识别技术领域,尤其是涉及一种基于深度学习内外双反馈的空间目标部件智能识别方法。

背景技术:

2.随着航天技术的飞速发展,传统人工地面判读、上注指令操控已无法满足航天飞行器在轨服务任务多样性、信息海量化、响应实时性的发展趋势,空间相机等探测载荷由从传统的地面人工遥操作提供数据型应用向星上自主识别、判读、决策等提供信息服务型应用转变,空间目标部件智能识别作为操控类飞行器信息自主处理的首要环节,已成为决定在轨高实时性操控服务任务成败的关键。空间目标识别准确率很大程度上受到目标图像质量影响,相机在轨工作过程中因镜头材料挥发、结构形变引起相机离焦、平台高低频颤振、空间光照条件的急剧变化等都会引发相机成像质量不同程度的下降,导致空间目标部件识别准确率降低,甚至无法完成部件识别与判读,进而影响后续在轨任务的完成。国内对于结合空间目标图像环境影响因素的图像质量提升以适应智能识别算法构建智能识别外部反馈机制的研究相对较少,对空间目标智能识别研究多在智能识别算法内部构建基于损失函数的内反馈机制,接受“低质”图像作为输入,在此基础上通过增加目标特征提取灵敏度尽可能多的获取目标特征信息,此过程由于没有剔除空间特有“低质”影响,导致空间目标的识别准确率提升效果不佳。

3.为给后续复杂空间环境下在轨任务规划及验证提供准确的信息支撑,提升空间在轨服务效率,有必要开展适应于空间成像环境的目标部件识别方法研究。本发明针对空间目标智能识别的实际工程应用需求,研究一种基于深度学习内外双反馈的空间目标部件智能识别方法,目前没有发现与本发明类似相关技术的说明或报道,也尚未收集到国内外类似的资料。

技术实现要素:

4.本发明的目的在于提供一种基于深度学习内外双反馈的空间目标部件智能识别方法,以解决复杂光照条件和空间相机成像质量低下带来的空间目标部件智能识别准确率下降问题。

5.为了解决上述技术问题,本发明的技术方案是:提供一种基于深度学习内外双反馈的空间目标部件智能识别方法,包括如下步骤:

6.s1、构建基于卷积神经网络与损失函数的内反馈网络,实现空间目标部件的初步检测,获得空间目标部件的识别准确率;

7.s2、构建基于主成分分析、bp神经网络的空间目标图像质量评价和图像质量提升构建的外反馈网络,并将像质提升后的图像重新送入所述步骤s1中的基于卷积神经网络与损失函数的内反馈网络进行训练与识别,提升空间目标部件的识别准确率,拓宽在轨智能识别算法的环境适应性与识别鲁棒性。

8.进一步的,所述步骤s1包括:

9.s1-1、在神经网络输入端采用图像放缩器将训练图像尺寸放缩到统一大小,对应部件标签参数归一化调整,实现神经网络算法对任意输入训练样本的适应性;

10.s1-2、根据空间目标样本训练库构建一个21层的深度卷积神经网络,其中包含9层卷积层、9层池化层、3层全连接层;

11.在每一个卷积层,输入图像与一个非线性滤波器进行卷积,叠加预置偏置权重,通过一个非线性激活函数获取该层的特征映射图;每一层卷积层后都紧接着一个池化层用以进行下采用;每三层卷积和三层池化后紧接着一个全连接层用以进行目标特征分类;

12.s1-3、构建针对空间目标部件特征的损失函数,包含:目标定位偏移量损失l

loc

(l,g),目标置信度损失l

conf

(o,c)以及目标分类损失l

cla

(o,c):

13.l(o,o,c,c,l,g)=λ1l

conf

(o,c) λ2l

cla

(o,c) λ3l

loc

(l,g)

ꢀꢀꢀꢀꢀ

(1)

14.其中λ1,λ2,λ3是权重系数;通过以上步骤构建基于卷积神经网络与损失函数的内反馈网络,可实现空间目标部件的初步检测,获得空间目标部件的识别准确率。

15.进一步的,所述步骤s2包括:

16.s2-1、构建空间目标图像质量评价参数库,提取18个无参考图像质量评价参数作为图像质量评价指标库,依次为灰度参数、纹理参数、边缘参数、其他参数;采用图像质量评价参数分别计算参与深度学习训练的空间目标样本集和参与智能识别的测试集图像的图像质量作为像质关联性分析的输入;

17.s2-2、采用主成分分析方法进行空间目标图像质量评价参数的去相关处理以实现参数优选与数据降维,获得包含所述步骤s2-1中18个图像质量评价参数的无相关评价多项式:

18.设x1,x2,...,x

p

为空间目标图像质量评价参数值,记成x=(x1,x2,...,x

p

),协方差矩阵可以表示为:

19.∑=(σ

ij

)

p

=e[(x-e(x))(x-e(x))

t

]

ꢀꢀꢀ

(2)

[0020]

上式是一个p阶非负矩阵;对x1,x2,...,x

p

进行线性变换,求得可以满足上述要求的无关联变量y1,y2,...,y

p

,其表达式如下所示:

[0021][0022]

式中,ii=(i

i1

,i

i2

,...,i

ip

)(i=1,2,...p)——常数向量;

[0023]

s2-3、采用bp神经网络构建目标图像质量参数与目标智能识别准确率间的关系描述,确定图像质量中影响部件识别准确率的敏感项;

[0024]

s2-4、针对图像质量中影响部件识别准确率的敏感项,基于空间光学相机全链路频域仿真模型生成的调制传递函数逆卷积与灰度非线性拉伸增强方法提升目标频域中高频信息与空间对比度。

[0025]

进一步的,所述步骤s2-1中,所述灰度参数包括灰度均值、均方误差、辐射精度陡度、灰度熵,所述纹理参数包括角二阶矩、纹理熵、对比度、自相关、逆差距,所述边缘参数包

括边缘能量、细节能量,所述其他参数包括小梯度优势、大梯度优势、梯度分布不均匀性、梯度平均、梯度方差。

[0026]

进一步的,所述步骤s2-1中,灰度均值从整体上反映图像的亮度,是对场景地物实际辐射能量的定量反映,其基本表达式为:

[0027][0028]

式中m,n为图像的高度和宽度,p(i,j)为图像某点的灰度值;

[0029]

辐射精度陡度反映图像的灰度层次的丰富程度,其计算公式为:

[0030]

k=∑(i-μ)4p(i)/σ8ꢀꢀꢀ

(6)

[0031]

式中,i为像素灰度值,μ为均值,σ2为方差,p(i)为灰度级i在图像中的分布概率;

[0032]

熵是从信息论角度反映图像信息丰富程度的一种度量方式,可表示为:

[0033][0034]

式中,l为图像的最大灰度级,pi为图像上像元灰度值为i的分布概率;

[0035]

角二阶矩是衡量纹理的一致性指标其基本表达式为:

[0036][0037]

式中,p(i,j)是灰度对的统计个数;

[0038]

图像的对比度是图像中最亮部分和最暗部分密度之比或对数差,其基本表达式为:

[0039][0040]

式中|i-j|=n;

[0041]

图像自相关是图像灰度线性度的测量,能够反映地物的空间排列规律,其基本表达式为:

[0042][0043]

式中:

[0044][0045]

逆差矩描述的是图像的局部同质性,反映纹理局部走向的对比度:

[0046]

0.79x

10-0.97x

11

0.86x

12-0.99x

13

0.98x

14-0.99x

15

0.98x

16

0.96x

17

0.96x

18

ꢀꢀꢀ

(18)

[0060]

y2=-0.71x

1-0.88x

2-0.52x

3-0.06x

4-0.37x

5-0.21x6 0.33x

7-0.52x

8-0.11x

9-0.13x

10

0.1x

11-0.16x

12

0.83x

13-0.04x

14

0.06x

15-0.04x

16

0.08x

17-0.07x

18

ꢀꢀꢀ

(19)

[0061]

y3=0.39x

1-0.33x

2-0.27x

3-0.66x

4-0.51x5 0.23x6 0.009x

7-0.012x

8-0.14x9 0.06x

10

0.0095x

11-0.03x

12

0.01x

13-0.09x

14

0.016x

15-0.09x

16-0.21x

17

0.05x

18

ꢀꢀꢀ

(20)

[0062]

进一步的,所述步骤s2-4中:

[0063]

因定焦光学相机与目标距离改变引起的相面平移量为

[0064][0065]

其中,f为焦距,s1为目标距离改变前物距,s2为目标距离改变后物距,s1为目标距离改变前像距,s2为目标距离改变后像距;

[0066]

线性运动的像移调制传递函数表示为:

[0067][0068]

其中s

linear

=vtf/h,v为相机相对于目标的运动速度;t为相机积分时间;f为光学系统焦距;h为卫星绕飞高度,fv为空间频率;

[0069]

卫星平台高频振动对像质影响的调制传递函数表示为:

[0070]

mtf

hf

=j0(2πfva)

ꢀꢀꢀꢀ

(23)

[0071]

式中fv为空间频率;j0为零阶贝塞尔函数;a为最大像振幅;θ为振幅角;f为相机焦距,a=fθ;

[0072]

卫星平台随机抖动对像质影响的调制传递函数表示为:

[0073]

mtf

gauss

=exp(-2π2σ2f

v2

)

ꢀꢀꢀꢀ

(24)

[0074]

式中σ为位移标准差;fv为空间频率;

[0075]

面阵ccd接收面偏离光学系统焦平面对像质影响的调制传递函数可表示为:

[0076][0077]

式中j1为一阶贝塞尔函数;δf为轴向离焦量;na=d/(2f)=1/(2f);d为入射光瞳直径;fv为空间频率;

[0078]

ccd像元几何尺寸对像质影响的调制传递函数可表示为:

[0079][0080]

式中,d为像元尺寸;fk为输出信号的空间频率;

[0081]

电荷转移损失产生的mtf表达式为:

[0082][0083]

式中,n为ccd像元数目;f为输出信号的空间频率;fn为奈奎斯特频率;ε为电荷转移损失率,电荷转移至下一势阱与原势阱中电荷之比。

[0084]

本发明提供的基于深度学习内外双反馈的空间目标部件智能识别方法取得的有益效果是:

[0085]

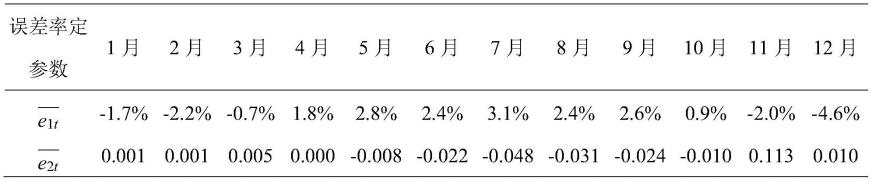

构建基于卷积神经网络与损失函数的内反馈网络,可实现空间目标部件的初步检测,获得空间目标部件的识别准确率;构建基于主成分分析、bp神经网络的空间目标图像质量评价和图像质量提升构建的外反馈网络,并将像质提升后的图像重新送入内反馈网络进行训练与识别,可进一步实现对光学相机的识别,且卫星典型小尺寸部件(雷达天线、光学镜头)的识别准确率提升幅度在20%以上,有效拓宽在轨智能识别算法的环境适应性与识别鲁棒性。

附图说明

[0086]

下面结合附图对发明作进一步说明:

[0087]

图1为基于双反馈神经网络的空间目标部件智能识别示意图;

[0088]

图2为bp神经网络工作流程图;

[0089]

图3为基于光学全链路成像仿真示意图;

[0090]

图4为光学系统成像距离对成像结果影响图。

具体实施方式

[0091]

以下结合附图和具体实施例对本发明提出的基于深度学习内外双反馈的空间目标部件智能识别方法作进一步详细说明。根据下面说明和权利要求书,本发明的优点和特征将更清楚。需说明的是,附图均采用非常简化的形式且均使用非精准的比率,仅用以方便、明晰地辅助说明本发明实施例的目的。

[0092]

本发明的核心思想在于,本发明提供的便携式塞尺自动在线检定装置设备简便、实用性高,简化了传统测量中操作人员的工作强度,提高了测量效率和测量质量;利用本发明提供的便携式塞尺自动在线检定装置,整个检定过程操作方便、数据准确。

[0093]

为解决复杂光照条件和空间相机成像质量低下带来的空间目标部件智能识别准确率下降问题,本发明的目的在于提出一种基于深度学习内外双反馈的空间目标部件智能识别方法,本发明方法氛围两个部分,分别为1)基于空间目标智能识别与损失函数构建的内反馈网络,2)基于主成分分析、bp神经网络的空间目标图像质量评价和图像质量提升构建的外反馈网络。具体步骤如下:

[0094]

本发明解决的复杂光照条件下空间相机因过曝、欠曝、离焦、平台高频振动、低频振动、线性移动拖尾等造成的图像质量下降带来的空间目标部件智能识别准确率下降问题是基于空间光学全链路成像仿真构建的空间目标数据集,该数据集包含150个空间目标,150万张标签样本集,标注卫星部位包括:卫星本体、太阳帆板、对接环、发动机喷管、雷达天线五类部件,数据集中图像包含一系列不同尺寸且因光学相机过曝、欠曝、离焦、平台高频振动、低频振动、线性移动拖尾造成的降质图像。

[0095]

步骤一:在神经网络输入端采用改进的最邻近算法图像放缩器将训练图像尺寸放缩到统一大小,可选的512

×

512、1024

×

1024、2048

×

2048,对应部件标签参数归一化调整,实现神经网络算法对任意输入训练样本的适应性。

[0096]

步骤二:在经典的vgg16网络基础上构建一个21层的深度卷积神经网络,其中包含

9层卷积层、9层池化层、3层全连接层。在每一个卷积层,输入图像与一个非线性滤波器进行卷积,叠加预置偏置权重,通过一个非线性激活函数获取该层的特征映射图。每一层卷积层后都紧接着一个池化层用以进行下采用。每三层卷积和三层池化后紧接着一个全连接层用以进行目标特征分类。

[0097]

步骤三:构建针对空间目标部件特征的损失函数,包含:目标定位偏移量损失l

loc

(l,g),目标置信度损失l

conf

(o,c)以及目标分类损失l

cla

(o,c)。

[0098]

l(o,o,c,c,l,g)=λ1l

conf

(o,c) λ2l

cla

(o,c) λ3l

loc

(l,g)

ꢀꢀꢀꢀ

(4)

[0099]

其中λ1,λ2,λ3是权重系数,三者权重比例依次为0.2、0.5、0.3。通过以上步骤构建基于卷积神经网络与损失函数的内反馈网络,可实现空间目标部件的初步检测,获得空间目标部件的识别准确率。

[0100]

步骤四:构建空间目标图像质量评价参数库,提取18个无参考图像质量评价参数作为图像质量评价指标库,依次为灰度参数(灰度均值、均方误差、辐射精度陡度、灰度熵),纹理参数(角二阶矩、纹理熵、对比度、自相关、逆差距),边缘参数(边缘能量、细节能量),其他参数(小梯度优势、大梯度优势、梯度分布不均匀性、梯度平均、梯度方差)。

[0101]

灰度均值从整体上反映图像的亮度,是对场景地物实际辐射能量的定量反映。其基本表达式为

[0102][0103]

式中m,n为图像的高度和宽度,p(i,j)为图像某点的灰度值辐射精度陡度反映图像的灰度层次的丰富程度。其计算公式为:

[0104]

k=∑(i-μ)4p(i)/σ8ꢀꢀꢀꢀ

(6)

[0105]

式中,i为像素灰度值,μ为均值,σ2为方差,p(i)为灰度级i在图像中的分布概率。

[0106]

熵是从信息论角度反映图像信息丰富程度的一种度量方式,可表示为:

[0107][0108]

式中,l为图像的最大灰度级,pi为图像上像元灰度值为i的分布概率。

[0109]

角二阶矩是衡量纹理的一致性(局部平稳性)指标其基本表达式为:

[0110][0111]

式中,p(i,j)是灰度对的统计个数。

[0112]

图像的对比度是图像中最亮部分和最暗部分密度之比或对数差。其基本表达式为:

[0113][0114]

式中|i-j|=n。

[0115]

图像自相关是图像灰度线性度的测量,能够反映地物的空间排列规律。其基本表达式为:

[0116][0117]

式中:

[0118][0119]

逆差矩描述的是图像的局部同质性(反映纹理局部走向的对比度)

[0120][0121]

平均梯度能敏感地反映图像对微小细节反差表达的能力。其计算公式为:

[0122][0123]

式中,和分别为图像像点灰度及其行、列方向上的梯度。

[0124]

细节能量从图像的局部来描述图像的细节边缘的丰富程度。其计算公式为:

[0125][0126]

其中

[0127][0128]

式中,mf(x,y)为图像的平均亮度。

[0129]

设原图像为f(x,y),x=1,2,...,n,其灰度级为l。把梯度图像进行灰度级离散化,设灰度级数目为lg,新灰度为其中灰度-梯度共生矩阵为{h

ij

,i=0,1,...l-1,j=0,1,...l

g-1},其中,h

ij

定义为集合{(x,y)|f(x,y)=i,g(x,y)=j}中元素的数目。将做归一化处理,得到

[0130]

小梯度优势定义为大梯度优势定义为梯度分布不均匀性定义为梯度平均定义为梯度方差定义为

[0131]

采用图像质量评价参数分别计算参与深度学习训练的空间目标样本集和参与智能识别的测试集图像的图像质量作为像质关联性分析的输入。

[0132]

步骤五:采用主成分分析方法进行空间目标图像质量评价参数的去相关处理以实现参数优选与数据降维,获得包含步骤四中18个图像质量评价参数的无相关评价多项式。

[0133]

设x1,x2,...,x

p

为空间目标图像质量评价参数值,记成x=(x1,x2,...,x

p

),协方差矩阵可以表示为:

[0134]

∑=(σ

ij

)

p

=e[(x-e(x))(x-e(x))

t

]

ꢀꢀꢀꢀ

(16)

[0135]

上式是一个p阶非负矩阵。对x1,x2,...,x

p

进行线性变换,求得可以满足上述要求的无关联变量y1,y2,...,y

p

,其表达式如下所示:

[0136][0137]

式中,ii=(i

i1

,i

i2

,...,i

ip

)(i=1,2,...p)——常数向量。

[0138]

针对典型空间目标仿真图像源,采用主成分分析方法对上节18个像质评价参数进行优选,选取累积贡献率大于90%的第一、第二、第三主成份作为后续图像质量对跟踪精度影响关系分析的有效输入。得到图像第一、第二、第三主成份的表达式为:

[0139]

y1=0.89x

1-0.17x

2-0.50x3 0.66x4 0.97x

5-0.66x

6-0.99x7 0.99x8 0.50x

9-0.79x

10-0.97x

11

0.86x

12-0.99x

13

0.98x

14-0.99x

15

0.98x

16

0.96x

17

0.96x

18

ꢀꢀꢀꢀ

(18)

[0140]

y2=-0.71x

1-0.88x

2-0.52x

3-0.06x

4-0.37x

5-0.21x6 0.33x

7-0.52x

8-0.11x

9-0.13x

10

0.1x

11-0.16x

12

0.83x

13-0.04x

14

0.06x

15-0.04x

16

0.08x

17-0.07x

18

ꢀꢀꢀꢀ

(19)

[0141]

y3=0.39x

1-0.33x

2-0.27x

3-0.66x

4-0.51x5 0.23x6 0.009x

7-0.012x

8-0.14x9 0.06x

10

0.0095x

11-0.03x

12

0.01x

13-0.09x

14

0.016x

15-0.09x

16-0.21x

17

0.05x

18

ꢀꢀꢀꢀ

(20)

[0142]

步骤六:采用bp神经网络构建目标图像质量参数与目标智能识别准确率间的关系描述,确定图像质量中影响部件识别准确率的敏感项。以目标图像质量参数为输入,以目标智能识别准确率为输出,计算隐层与输出层各单元数据,将目标值与实际值的平方差和损失函数比较,不满足要求则调整隐层与输出层权重值,直到满足要求为止。

[0143]

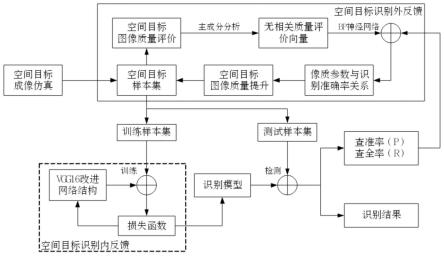

表1各图像质量评价参数对目标识别准确率的影响

[0144]

像质评价各参数影响因子像质评价各参数影响因子均方误差0.044对比度0.099峰值信噪比0.078自相关0.052归一化互相关系数0.041逆差距0.040边缘能量0.066灰度熵0.042细节能量0.049小梯度优势0.040辐射精度陡度0.053大梯度优势0.047角二阶矩0.12梯度分布不均匀性0.039纹理熵0.040梯度平均0.047灰度均值0.033梯度方差0.032

[0145]

步骤七:针对图像质量中影响部件识别准确率的敏感项,基于空间光学相机全链路频域仿真模型生成的调制传递函数逆卷积与灰度非线性拉伸增强方法提升目标频域中高频信息与空间对比度。

[0146]

其中,因定焦光学相机与目标距离改变引起的相面平移量为

[0147][0148]

其中,f为焦距,s1为目标距离改变前物距,s2为目标距离改变后物距,s1为目标距离改变前像距,s2为目标距离改变后像距。

[0149]

线性运动的像移调制传递函数可表示为:

[0150][0151]

其中s

linear

=vtf/h,v为相机相对于目标的运动速度;t为相机积分时间;f为光学系统焦距;h为卫星绕飞高度,fv为空间频率。

[0152]

卫星平台高频振动对像质影响的调制传递函数可表示为:

[0153]

mtf

hf

=j0(2πfva)

ꢀꢀꢀꢀ

(23)

[0154]

式中fv为空间频率;j0为零阶贝塞尔函数;a为最大像振幅;θ为振幅角;f为相机焦距,a=fθ。

[0155]

卫星平台随机抖动对像质影响的调制传递函数可表示为:

[0156]

mtf

gauss

=exp(-2π2σ2f

v2

)

ꢀꢀꢀꢀ

(24)

[0157]

式中σ为位移标准差;fv为空间频率。

[0158]

面阵ccd接收面偏离光学系统焦平面对像质影响的调制传递函数可表示为:

[0159][0160]

式中j1为一阶贝塞尔函数;δf为轴向离焦量;na=d/(2f)=1/(2f);d为入射光瞳直径;fv为空间频率。

[0161]

ccd像元几何尺寸对像质影响的调制传递函数可表示为:

[0162][0163]

式中,d为像元尺寸;fk为输出信号的空间频率。

[0164]

电荷转移损失产生的mtf表达式为:

[0165][0166]

式中,n为ccd像元数目;f为输出信号的空间频率;fn为奈奎斯特频率;ε为电荷转移损失率,电荷转移至下一势阱与原势阱中电荷之比。

[0167]

通过以上步骤构建基于主成分分析、bp神经网络的空间目标图像质量评价和图像质量提升构建的外反馈网络,并将像质提升后的图像重新送入内反馈网络进行训练与识别,可进一步实现对光学相机的识别,且卫星典型小尺寸部件(雷达天线、光学镜头)的识别准确率提升幅度在20%以上,有效拓宽在轨智能识别算法的环境适应性与识别鲁棒性。

[0168]

表2图像质量提升前后的部件识别精度结果

[0169][0170][0171]

本说明书中未作详细描述的内容属于本领域专业技术人员公知的现有技术。对于本领域技术人员而言,显然本发明不限于上述示范性实施例的细节,而且在不背离本发明的精神或基本特征的情况下,能够以其他的具体形式实现本发明。因此,无论从哪一点来看,均应将实施例看作是示范性的,而且是非限制性的,本发明的范围由所附权利要求而不是上述说明限定,因此旨在将落在权利要求的等同要件的含义和范围内的所有变化囊括在本发明内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。