1.本发明涉及声音识别技术领域,尤其涉及一种人声识别系统。

背景技术:

2.语音识别技术是通过机器的识别和理解过程将人发出的声音、字节或短语转换成相应的文字或符号,或者给出响应的一种信息技术。声纹是用电声学仪器显示的携带言语信息的声波频谱,人类语言的产生是人体语言中枢与发音器官之间一个复杂的生理物理过程,人在讲话时使用的发声器官,如,舌、牙齿、喉头、肺以及鼻腔,在尺寸和形态上个体差异很大,因此,任何两个人的声纹图谱均会存在差异。不同的用户讲话时对应的声波频谱存在差异性,故可通过声纹识别出唯一的用户。

3.现有技术中,声纹识别方式存在识别不准确的缺陷,与人脸识别、指纹识别等身份识别方式相比,由于其缺陷的存在,至今应用并不广泛。

4.因此,提供一种识别准确的人声识别系统,是本领域技术人员亟需解决的问题。

技术实现要素:

5.有鉴于此,本发明提供了一种人声识别系统,可通过声纹准确识别出用户身份的技术效果。

6.为了实现上述目的,本发明采用如下技术方案:

7.一种人声识别系统,人声采集模块、预处理模块、声纹特征提取模块、功能切换模块、声纹识别模块和模型训练模块;

8.所述人声采集模块,与所述预处理模块的输入端连接,用于采集人声后获取声纹信息;

9.所述预处理模块,与所述声纹特征提取模块的输入端连接,用于将声纹信息进行降噪处理;

10.所述声纹特征提取模块,与所述功能切换模块的输入端连接,用于提取声纹特征;

11.所述功能切换模块,用于进行声纹识别和模型训练功能的选择;

12.所述模型训练模块,与所述功能切换模块的第一输出端连接,用于对所述声纹特征进行模型训练,获得声纹模板;

13.所述声纹模板库,与所述模型训练模板的输出端连接,用于获取和存储所述声纹模板;

14.所述声纹识别模块的输入端与所述功能切换模块的第二输出端连接,所述声纹识别模块的第一输入/输出端与所述声纹模板库的输入/输出端连接,用于根据声纹模板来识别用户身份。

15.优选的,所述人声采集模块包括:声音收集单元和音量自适应单元;

16.所述声音收集单元,与所述音量自适应单元的输入端连接,用于收集进行人声识别的用户声音;所述音量自适应单元,用于对用户声音音量大小的自适应处理,将用户的声

音音量大小进行识别模型训练后做总体归一化处理到相同的最大值。

17.该技术方案所实现的技术效果:用户声音音量经过处理得到相同最大值,使声音信号强度平衡便于进行声纹特征提取。

18.优选的,所述预处理模块包括:降噪单元和信号增强单元;

19.所述降噪单元,用于对声纹信息进行降噪处理,获得降噪后的声纹信息;采用了谱去除法和/或学习同定法和/或降噪自动编码器至少之一进行噪声抑制;所述信号增强单元与所述降噪单元的输入端连接,用于将所述人声采集模块的声纹信息进行加强。

20.该技术方案所实现的技术效果:降低用户声纹信息的噪声,提高最终辨别的准确度。

21.优选的,所述声纹特征提取模块包括:声纹特征提取单元和语谱图片转换单元;所述声纹特征提取单元,用于通过训练好的神经网络算法模型,提取用户声音的声纹特征;所述语谱图片转换单元与所述声纹特征提取单元的输出端连接,用于将获得的所述声纹特征转换为语谱图。

22.优选的,还包括:反馈语音模块和声音输出模块;

23.所述反馈语音模块,与所述声纹识别模块的输入/输出端连接,获取所述声纹识别模块的识别结果,输出对应语音反馈信号至所述声纹识别模块;所述声音输出模块,与所述声纹识别模块的第三输入端连接,用于接收并输出所述语音反馈信号。

24.该技术方案所实现的技术效果:直接通过语音得知人声(身份)识别结果。

25.经由上述的技术方案可知,与现有技术相比,本发明提供了一种人声识别系统:本发明可使输入特征更完善、噪声更小、算法精度更高;采用深度神经卷积网络算法进行声音的高维特征提取分类,对说话人声音特征提取直接对说话人的声音特征进行直接辨识,避免通过说话人的说话内容进行识别的缺陷,提高辨识准确度。

附图说明

26.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据提供的附图获得其他的附图。

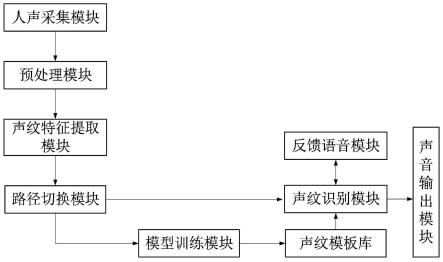

27.图1为本发明一种人声识别系统结构框图;

28.图2为本发明人声采集模块结构框图;

29.图3为本发明预处理模块结构框图;

30.图4为本发明声纹特征提取模块结构框图;

具体实施方式

31.下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

32.实施例1

33.参照图1所示,本实施例公开了一种人声识别系统,

34.人声采集模块、预处理模块、声纹特征提取模块、功能切换模块、声纹识别模块和模型训练模块;

35.人声采集模块,与预处理模块的输入端连接,用于采集人声后获取声纹信息;

36.预处理模块,与声纹特征提取模块的输入端连接,用于将声纹信息进行降噪处理;

37.声纹特征提取模块,与功能切换模块的输入端连接,用于提取声纹特征;

38.功能切换模块,用于进行声纹识别和模型训练功能的选择;

39.模型训练模块,与功能切换模块的第一输出端连接,用于对声纹特征进行模型训练,获得声纹模板;

40.声纹模板库,与模型训练模板的输出端连接,用于获取和存储声纹模板;

41.声纹识别模块的输入端与功能切换模块的第二输出端连接,声纹识别模块的第一输入/输出端与声纹模板库的输入/输出端连接,用于根据声纹模板来识别用户身份。

42.在一个实施例中,功能切换模块包括:声纹模板获取和声纹识别两种功能;在声纹模板获取功能状态下,采集固定内容的语音信息,经过模型训练,获得声纹模板;在声纹识别更能状态下,采集当前声音识别者所发出的语音,经过语音预处理,提取声纹特征后与声纹模板库内的声纹进行比对,直接辨识。

43.在一个具体实施例中,模型训练模块中声纹特征提取后所进行训练的模型,为现有技术中任一可实现该技术效果的神经网络模型。

44.在一个具体实施例中,人声采集模块包括:声音收集单元和音量自适应单元;

45.声音收集单元,与音量自适应单元的输入端连接,用于收集进行人声识别的用户声音;

46.音量自适应单元,用于对用户声音音量大小的自适应处理,将用户的声音音量大小进行识别模型训练后做总体归一化处理到相同的最大值。

47.在一个具体实施例中,对音量的自适应处理包括有音区和静音区,对于有音区的

48.1):求出当前声音数据的最大值;

49.2):以音量最大值为基准,求出相对于一个常数的系数值;

50.3):当前声音数据乘着系数获取自适应音量的数据。

51.具体的,对静音区的自适应处理采用输入声音特征的静音区自截断算法,输入声音特征的静音区自截断算法包括以下步骤:

52.1)求1600个采样数值约0.1s的绝对值的均值;

53.2)通过阈值判断当前数据是否是静音区;

54.3)对于是静音区的数据进行截断处理。

55.在一个具体实施例中,预处理模块包括:降噪单元和信号增强单元;

56.降噪单元,用于对声纹信息进行降噪处理,获得降噪后的声纹信息;采用了谱去除法和/或学习同定法和/或降噪自动编码器至少之一进行噪声抑制;

57.信号增强单元与所述降噪单元的输入端连接,用于将人声采集模块的声纹信息进行加强。

58.在一个具体实施例中,声纹特征提取模块包括:声纹特征提取单元和语谱图片转换单元;声纹特征提取单元,用于通过训练好的神经网络算法模型,提取用户声音的声纹特

征;语谱图片转换单元与声纹特征提取单元的输出端连接,用于将获得的声纹特征转换为语谱图。

59.在一个具体实施例中,利用卷积神经网络结合注意力机制对用户声音进行特征提取,得到帧级特征向量序列;结合注意力机制对帧级特征向量序列进行降采样,以将帧级特征向量序列转化为预定维度的中间特征向量;对中间特征向量进行全连接操作,以获得句子级的声纹特征向量。

60.在一个具体实施例中,利用卷积神经网络结合注意力机制对输入的目标语音数据进行特征提取,得到帧级特征向量序列包括:

61.对所述目标语音数据顺次执行至少一次卷积加整流操作,得到第一特征向量序列;根据第一特征向量序列计算通道注意力向量,利用通道注意力向量序列对第一特征向量序列进行加权,得到第二特征向量序列;根据第二特征向量序列计算时间注意力向量,利用时间注意力向量序列对第二特征向量序列进行加权,得到第三特征向量序列;对第三特征向量序列进行整流操作得到帧级特征向量序列。

62.在一个具体实施例中,第一特征向量序列计算通道注意力向量,利用通道注意力向量对第一特征向量序列进行加权,得到第二特征向量序列包括:分别利用平均池化操作和最大池化操作聚合第一特征向量序列的每个通道的时间信息;将平均池化操作和所述最大池化操作的结果分别输入多层感知机中;利用sigmoid函数根据多层感知机输出的结果计算通道注意力向量;将第一特征向量序列和通道注意力向量逐元素相乘得到所述第二特征向量序列。

63.在一个具体实施例中,第二特征向量序列计算时间注意力向量,利用时间注意力向量对第二特征向量序列进行加权,得到第三特征向量序列包括:分别利用平均池化操作和最大池化操作聚合第二特征向量序列的每个时间点的通道信息;将平均池化操作和所述最大池化操作的结果合并成多维向量;采用预置卷积核对多维向量进行卷积处理得到时间注意力向量;将第二特征向量序列和时间注意力向量逐元素相乘得到第三特征向量序列。

64.在一个具体实施例中,第二特征向量序列计算时间注意力向量,利用时间注意力向量对第二特征向量序列进行加权,得到第三特征向量序列之后,还包括:在第三特征向量序列的基础上加入残差;对所述第三特征向量序列进行整流操作得到帧级特征向量序列包括:对第三特征向量序列和残差的加和进行整流操作得到帧级特征向量序列。

65.在一个具体实施例中,神经网络算法模型包括输入层、svm层、卷积层、池化层、全连接层,输入层来自预处理模块输出的声纹信息经过拉普拉斯变换获得的频谱信息,svm层的输入来全连接层的频谱信息经过声纹特征提取模块得到的特征向量,卷积层采用5*5的卷积核,8个滤波器;池化层的池化窗口大小为3*3,通道数为16;所述全连接层采用16个滤波器,3*3的卷积核;全连接层的输入来自池化层的输出;

66.池化层的池化方法如下:

67.xe=f(ue φ(ue))

[0068][0069]

其中,xe表示当前层的输出,ue表示激活函数的输入,f()表示激活函数,we表示当前层的权重,φ表示损失函数,x

e-1

表示下一层的输出,be表示偏置,δ表示常数。

[0070]

在一个具体实施例中,还包括:反馈语音模块和声音输出模块;

[0071]

反馈语音模块,与声纹识别模块的输入/输出端连接,获取声纹识别模块的识别结果,输出对应语音反馈信号至声纹识别模块;

[0072]

声音输出模块,与声纹识别模块的第三输入端连接,用于接收并输出语音反馈信号,如:识别成功、姓名张三、学号001、考试科目为数学等等。

[0073]

在一个具体实施例中,用户为参加考试的学生,进行声音识别,辨别其身份信息,防止替考的作弊行为。

[0074]

在一个具体实施例中,声音收集单元包括麦克风。

[0075]

在一个具体实施例中,声音输出模块包括喇叭。

[0076]

在一个具体实施例中,降噪单元包括xfm10412芯片。

[0077]

对所公开的实施例的上述说明,按照递进的方式进行,使本领域专业技术人员能够实现或使用本发明。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本发明的精神或范围的情况下,在其它实施例中实现。因此,本发明将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽的范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。