1.本发明涉及一种固定空间内人员特定活跃度的监测方法。

背景技术:

2.随着人工智能、物联网等技术的蓬勃发展,在家居领域催生出了智能化的新趋势。一方面具有无线联网和信息交互能力的设备开始进入家居环境,提供了智能化的硬件基础,显著增强了人们对生活、工作环境的调控能力;另一方面,基于智能硬件和人工智能等新技术,对于人员行为状态分析等传统计算机技术难以实现的高阶功能需求应运而生。以老人呆坐、儿童剧烈奔跑为例,这些行为具有一定的潜在危险性,需要在家居环境中做好预防消除。这些人员行为是由行人位置、行人轨迹等多种基础状态组成的高阶状态,难以采用单一的传统计算机技术实现检测。此外,如何从计算机视觉的角度去定义人员行为也非常困难,这也导致了难以准确工程化智能家居领域的这些新需求。鉴于此,为应对智能家居化的新趋势,亟需提出一种合理的人员行为状态评价指标,并能提供切实可行的实现方法。

技术实现要素:

3.针对现有技术中存在的缺陷,本发明的目的在于提供一种固定空间内人员特定活跃度的监测方法,通过红外热成像技术获取人员目标在固定空间内的视频数据,利用深度学习方法实时计算目标人员的图像移动速度,并同步获取目标人员的身体最高温度,最后结合图像移动速度和最高温度计算活跃度指标。

4.为达到以上目的,本发明采取的技术方案是:

5.一种固定空间内人员特定活跃度的监测方法,包括以下步骤:

6.步骤1、采集目标人员的红外热成像视频;

7.步骤2、采用目标检测算法在红外热成像图像上定位目标人员,并计算目标人员的图像移动速度;

8.步骤3、从目标检测算法检测到的目标人员区域图像上读取最高温度;

9.步骤4、根据目标人员的图像移动速度与最高温度值得到目标人员的活跃度。

10.步骤1中,采用红外热成像摄像头采集目标人员的红外视频,红外热成像摄像头布置在高处,采取由高往低的方式拍摄目标人员的行为。

11.步骤2中,所述目标检测算法为yolo深度学习目标检测算法或efficientdet深度学习目标检测算法。

12.步骤2中,目标人员的图像移动速度为:

[0013][0014]

其中,v

inner

为图像视场面内速度,v

outer

为图像视场面外速度。

[0015]

图像视场面内速度按照下式计算,

[0016][0017]

其中δs为目标人员中心点的图像位移量,δt为对应的时间。

[0018]

图像视场面外速度按照下式计算,

[0019][0020]

其中,x为目标人员与摄像头的物理空间距离,c为空间距离与像素坐标之间的比例值,可以通过标定的方法获得该值,δa为目标人员在视频图像中的像素面积的变化量。当目标人员与摄像头之间的距离较大时,可以近似认为x为常数,此时有:

[0021][0022]

其中,c

′

为需要标定的常数。

[0023]

步骤3中,从目标检测算法检测到的目标人员区域图像上直接读取最高温度值t

max

,δt为目标人员体温的变化量,按照下式进行计算:

[0024][0025]

其中,t0为由红外热成像图像读取的目标人员日常最高温度的平均值,预设为36.5℃,并根据实际情况进行调整。

[0026]

步骤4中,目标人员的活跃度为:

[0027]

e=b

·

v2 δt

[0028]

其中,b为目标人员的图像移动速度与体温变化量之间的转化因子,可以通过标定的方式给出。

[0029]

本发明的有益效果:

[0030]

a、目标人员活跃度的检测结果可被用于人员行为模式识别,实现老人呆坐、儿童剧烈奔跑、室内打斗等高阶监测功能。

[0031]

b、活跃度计算方法中包含了人体温度数据,使得目标人员原地运动等行为也能被有效识别,并能与静坐进行区分。

[0032]

c、本发明能够实现普通2d相机难以实现的面外运动检测。

附图说明

[0033]

本发明有如下附图:

[0034]

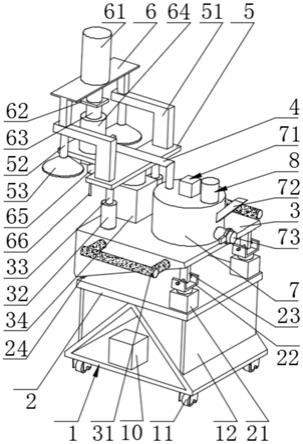

图1整体技术框架示意图。

[0035]

图2目标人员的红外热成像图像示意图。

[0036]

图3目标人员的活跃度时序图。

具体实施方式

[0037]

以下结合附图对本发明作进一步详细说明。

[0038]

整体技术框架如图1所示,其中红外热成像摄像头需要布置在较高的位置,采取由

高往低的方式拍摄目标人员的行为,尽量避免目标人员正对摄像头的移动方式;采用当前主流的目标检测算法在红外视频图像上定位目标人员,并计算其图像移动速度;从目标检测算法检测到的目标人员区域图像上读取目标人员的最高温度值;最后根据目标人员的图像移动速度的平方与最高温度值得到目标人员活跃度的评价指标。

[0039]

目标人员图像移动速度检测方法:

[0040]

图像移动速度可以分解为相对摄像头的面内和面外两个分量,对于2d摄像头,能够直接检测目标人员的面内位移或速度,对于面外速度则需要通过目标人员在视频图像上所占据的像素面积的变化率来间接计算。具体地,应用yolo、efficientdet等当前性能较好的深度学习目标检测算法,在红外热成像视频图像中检测目标人员的位置,得到如图2所示的检测结果,其中虚线框即为目标人员的位置。目标人员的图像视场面内速度按照下式计算,

[0041][0042]

其中δs为目标人员中心点的图像位移量,δt为对应的时间。

[0043]

图像视场面外速度按照下式计算,

[0044][0045]

其中,x为目标人员与摄像头的物理空间距离,c为空间距离与像素坐标之间的比例值,可以通过标定的方法获得该值,δa为目标人员在视频图像中的像素面积的变化量。当目标人员与摄像头之间的距离较大时,可以近似认为x为常数,此时有:

[0046][0047]

其中,c

′

为需要标定的常数。

[0048]

目标人员总的图像移动速度为:

[0049][0050]

特别地,当目标人员仅存在面内移动时,v

outer

→

0此时有

[0051]

v=v

inner

[0052]

即目标人员仅具有相对摄像头视场的面内运动。

[0053]

目标人员最高体温检测方法:

[0054]

由深度学习目标检测算法得到如图2所示的检测结果,图中虚线框对应目标人员在视频图像中的位置,从该区域中可直接读取目标人员的最高温度值t

max

。

[0055]

目标人员在固定空间内具有移动和原位运动两种行为,前述目标人员的图像移动速度v可以描述第一种行为,前述目标人员的最高温度值t

max

同时与这两种行为关联,此处定义目标人员的活跃度为:

[0056]

e=b

·

v2 δt

[0057]

其中,b为目标人员图像移动速度与体温变化量之间的转化因子,可以通过标定的方式给出,δt为目标人员体温的变化量,按照下式进行计算,

[0058][0059]

其中,t0为由红外热成像图像读取的目标人员日常最高温度的平均值,预设为36.5℃,并应根据实际情况进行调整。

[0060]

最后可以将目标人员的活跃度随时间的变化绘制成如图3所示的时序图。

[0061]

以上实施方式仅用于说明本发明,而并非对本发明的限制,有关技术领域的普通技术人员,在不脱离本发明的实质和范围的情况下,还可以做出各种变化和变型,因此所有等同的技术方案也属于本发明的保护范围。

[0062]

本说明书中未作详细描述的内容属于本领域专业技术人员公知的现有技术。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。