1.本发明涉及一种基于毫米波雷达与视频数据的坐标转换匹配车辆检测方法,属于智能车辆检测技术领域。

背景技术:

2.多传感器信息融合环境感知技术在提高道路环境感知能力方面具有举足轻重的作用,在目标探测方面,与传统单一的感知相比,多传感器信息融合设备的道路环境信息获取能力更高、更准确、更兼容。多传感器融合可以利用红外、相机、声纳、雷达、激光测距等传感器的不同传感优势,尽可能准确、完整地获取周围环境的感知信息。

3.智能交通系统是道路有序运行的重要保证,基于毫米波雷达的同步定位及融合定位技术是智能交通系统的关键技术。

4.相比激光雷达,毫米波雷达具有探测性能稳定、作用距离较长,穿透雾、烟、灰尘的能力强,具有全天候全天时的特点,基于毫米波雷达及相机,对获取的数据进行时间空间融合,使该系统可以实现实时、可靠地检测前方道路环境,从而对机动车辆进行精确识别与显示。

技术实现要素:

5.为了解决上述技术问题,本发明提供一种基于毫米波雷达与视频数据的坐标转换匹配车辆检测方法,其具体技术方案如下:

6.包括以下步骤:

7.步骤1:毫米波雷达采集检测数据,所述检测数据包括机动车辆与毫米波雷达的直线距离、角度信息和径向速度以及每帧雷达数据的时间信息;

8.步骤2:高角度相机采集视频数据;

9.步骤3:数据处理:包括检测数据的坐标转换与校正

10.步骤3.1:将车辆的毫米波雷达坐标转换为车辆在图像中的像素坐标;

11.步骤3.2:向训练好的车辆检测模型输入视频数据直接获得机动车辆的像素坐标;

12.步骤3.3:根据实际毫米波雷达和高角度相机安装角度进行坐标校正;

13.步骤4:数据匹配与融合

14.步骤4.1:对毫米波雷达坐标转换的车辆像素坐标与视频数据经过车辆检测模型获得的像素坐标进行时间匹配;

15.步骤4.2:对毫米波雷达坐标转换的车辆像素坐标与视频数据经过车辆检测模型获得的像素坐标进行空间匹配;

16.步骤4.3:将时间匹配和空间匹配均成功的数据进行融合;

17.步骤5:融合数据的存储与显示:对最终匹配成功的结果进行存储,并将完成数据融合后的图像输出。

18.进一步的,所述步骤3设毫米波雷达在相机正上方h0处,两传感器相距小于10cm,

将h0忽略,一起固定在离地面高度为h处,与水平面垂直方向的倾斜角度为α,α的余角记为θ,设检测车辆高度为定值h

car

,步骤3.1的具体步骤为:

19.步骤3.1.1:建立坐标系

20.步骤3.1.1.1:建立毫米波雷达坐标系or-xryr,以毫米波雷达为原点or,xr轴与相机的光轴平行,yr轴与水平面平行且垂直于yr轴,用(xr,yr)表示其在毫米波雷达坐标系中坐标值;

21.步骤3.1.1.2:建立相机坐标系oc-xcyczc,以光心为坐标原点oc,xc轴和yc轴分别平行于图像平面的两条垂直边,相机的光轴为zc轴,用(xc,yc,zc)表示其在相机坐标系中坐标值;

22.步骤3.1.1.3:建立世界坐标系ow-xwywzw,以经过相机设备并垂直于水平地面的交点为ow,yw 垂直于水平面,xw位于水平面且与相机坐标系的xc轴平行,zw位于水平面且与相机坐标系的yc 轴平行,用(xw,yw,zw)表示其在世界坐标系中坐标值;

23.步骤3.1.1.4:建立图像坐标系oi-xy,以图像平面的中心为坐标原点oi,x轴和y轴分别平行于图像平面的两条垂直边,用(x,y)表示其坐标值;

24.步骤3.1.1.5:建立像素坐标系o-uv,以图像平面的左上角顶点为原点o,u轴和v轴分别平行于图像平面的两条垂直边,用(u,v)表示其坐标值,所述像素坐标系就是以像素为单位的图像坐标系;

25.步骤3.1.2:坐标转换

26.步骤3.1.2.1:将世界坐标系转化为相机坐标系,具体公式如下:

[0027][0028][0029][0030]

其中,r为3

×

3的正交单位矩阵,描述旋转关系,t为三维平移向量,描述平移关系;o

t

为三维零向量,即o

t

=[0 0 0];

[0031]

步骤3.1.2.2:相机坐标系转化为图像坐标系,具体公式如下:

[0032][0033]

其中,f为相机焦距;

[0034]

步骤3.1.2.3:图像坐标系转化为像素坐标系,具体公式如下:

[0035][0036]

其中,a为内参矩阵,通过张正友相机标定法获得;

[0037]

步骤3.1.2.4:雷达坐标系转换为世界坐标系,具体公式如下:

[0038][0039]

步骤3.1.2.5:毫米波雷达坐标转换为像素坐标,根据公式(1)至公式(6),推知转换关系如下:

[0040][0041]

进一步的,所述坐标校正的对象包括:相机的俯角,相机的投影中心点,图像序列的帧宽和帧高,得到校正后的机动车辆的像素坐标。

[0042]

进一步的,所述步骤3.2采用yolo网络模型,对paddle框架进行训练,得到车辆检测模型,所述车辆检测模型提供车辆的像素预测框坐标。

[0043]

进一步的,所述步骤4的时间匹配具体步骤为:

[0044]

步骤4.1.1:设置毫米波雷达的采样频率和相机的采样频率,所述毫米波雷达的采样频率大于相机的采样频率;

[0045]

步骤4.1.2:以毫米波雷达的时刻为基准,获取毫米波雷达的时刻前后两帧图像的时刻数据,将雷达数据的时间信息与两帧图像的时间信息进行差值比较,保留差值较小的图像数据。

[0046]

进一步的,所述步骤4的空间匹配与数据融合具体步骤为:将坐标转换后的像素坐标与车辆预测模型提供的车辆像素预测框进行比较,如果坐标转换后的像素坐标包含在预测框内,则判定为同一车辆信息,进行数据融合,所述数据融合将匹配后的数据利用opencv库函数一起显示在图片上。

[0047]

本发明的有益效果是:本发明使用毫米波雷达和高角度相机采集数据,通过坐标转换和时间空间数据匹配,将毫米波雷达数据与图像数据融合,通过融合数据对车辆检测模型进行训练,提高了车辆检测模型的灵敏性和准确性;高视角采集与平视视角不同,本发明世界坐标系的选取适用于高视角的机动车辆检测,坐标转换准确,误差小;结合雷达与视频数据的优点,稳定性高,受天气光线等环境因素影响小,抗干扰能力强。

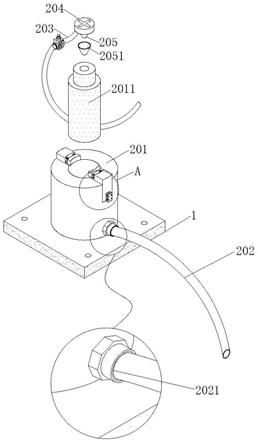

附图说明

[0048]

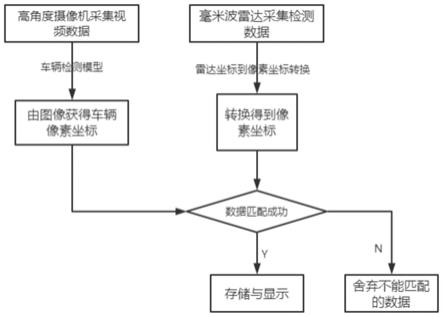

图1是本发明的数据采集与处理方法的流程示意图,

[0049]

图2是本发明的毫米波雷达坐标系、相机坐标系和世界坐标系的立体视角示意图,

[0050]

图3是本发明的相机坐标系和世界坐标系侧视图,

[0051]

图4是本发明的世界坐标系俯视图,

[0052]

图5是本发明的毫米波雷达坐标系、相机坐标系和图像坐标系的关系示意图,

[0053]

图6是本发明的图像坐标系和像素坐标系的关系示意图,

[0054]

图7是本发明的测试效果图。

具体实施方式

[0055]

下面结合附图和具体实施例,进一步阐明本发明,应理解这些实施例仅用于说明本发明而不用于限制本发明的范围,在阅读了本发明之后,本领域技术人员对本发明的各种等价形式的修改均落于本技术所附权利要求所限定的范围。

[0056]

如图1所示,本发明的基于毫米波雷达与视频数据的坐标转换匹配车辆检测方法,包括以下步骤:

[0057]

步骤1:毫米波雷达采集检测数据,所述检测数据包括机动车辆与毫米波雷达的直线距离、角度信息和径向速度以及每帧雷达数据的时间信息;

[0058]

步骤2:高角度相机采集视频数据;

[0059]

步骤3:数据处理,将坐标数据进行转换并进行校正

[0060]

步骤3.1:将车辆的毫米波雷达坐标转换为车辆在图像中的像素坐标,毫米波雷达坐标无法直接转换成像素坐标,因此通过将毫米波雷达转换成世界坐标系,间接转换成像素坐标。

[0061]

步骤3.1.1:建立坐标系

[0062]

步骤3.1.1.1:如图2所示,以毫米波雷达为原点建立毫米波雷达坐标系or-xryr,以毫米波雷达为原点or,xr轴与相机的光轴平行,yr轴与水平面平行且垂直于yr轴,用(xr,yr)表示其在毫米波雷达坐标系中坐标值;

[0063]

步骤3.1.1.2:建立相机坐标系oc-xcyczc,以光心为坐标原点oc,xc轴和yc轴分别平行于图像平面的两条垂直边,相机的光轴为zc轴,用(xc,yc,zc)表示其在相机坐标系中坐标值;

[0064]

步骤3.1.1.3:建立世界坐标系ow-xwywzw,世界坐标系俯视图如图4所示,以经过相机设备并垂直于水平地面的交点为ow,yw垂直于水平面,xw位于水平面且与相机坐标系的xc轴平行,zw 位于水平面且与相机坐标系的yc轴平行,用(xw,yw,zw)表示其在世界坐标系中坐标值,相机坐标系和世界坐标系侧视图如图3所示;

[0065]

步骤3.1.1.4:建立图像坐标系oi-xy,以图像平面的中心为坐标原点oi,x轴和y轴分别平行于图像平面的两条垂直边,用(x,y)表示其坐标值,毫米波雷达坐标系、相机坐标系和图像坐标系的关系如图5所示;

[0066]

步骤3.1.1.5:建立像素坐标系o-uv,以图像平面的左上角顶点为原点o,u轴和v轴分别平行于图像平面的两条垂直边,用(u,v)表示其坐标值,所述像素坐标系就是以像素为单位的图像坐标系,图像坐标系和像素坐标系的关系如图6;

[0067]

步骤3.1.2:坐标转换

[0068]

步骤3.1.2.1:将世界坐标系转化为相机坐标系,具体公式如下:

[0069][0070][0071][0072]

其中,r为3

×

3的正交单位矩阵,描述旋转关系,t为三维平移向量,描述平移关系;o

t

为三维零向量,即o

t

=[0 0 0];

[0073]

步骤3.1.2.2:相机坐标系转化为图像坐标系,具体公式如下:

[0074][0075]

其中,f为相机焦距;

[0076]

步骤3.1.2.3:图像坐标系转化为像素坐标系,具体公式如下:

[0077][0078]

其中,a为内参矩阵,通过张正友相机标定法获得;

[0079]

步骤3.1.2.4:雷达坐标系转换为世界坐标系,具体公式如下:

[0080][0081]

步骤3.1.2.5:毫米波雷达坐标转换为像素坐标,根据公式(1)至公式(6),推知毫米波雷达坐标与像素坐标的转换关系如下:

[0082][0083]

步骤3.2:向训练好的车辆检测模型输入视频数据直接获得机动车辆的像素坐标;

[0084]

步骤3.3:根据实际毫米波雷达和高角度相机安装角度进行坐标校正;

[0085]

步骤4:数据匹配与融合

[0086]

步骤4.1:对毫米波雷达坐标转换的车辆像素坐标与视频数据经过车辆检测模型获得的像素坐标进行时间匹配:设置毫米波雷达的采样频率和相机的采样频率,毫米波雷达的采样频率大于相机的采样频率;设毫米波雷达采样频率为80hz,摄像头采样频率为30fps,即雷达数据采样间隔时间约为83.33ms,每秒约12帧;摄像头采样间隔约为33.33ms,每秒30帧,以毫米波雷达的时刻为基准,获取毫米波雷达的时刻前后两帧图像的时刻数据,将雷达数据的时间信息与两帧图像的时间信息进行差值比较,保留差值较小的图像数据;

[0087]

步骤4.2:对毫米波雷达坐标转换的车辆像素坐标与视频数据经过车辆检测模型获得的像素坐标进行空间匹配:将坐标转换后的像素坐标与车辆预测模型提供的车辆像素预测框进行比较,如果坐标转换后的像素坐标包含在预测框内,则判定为同一车辆信息,进行空间匹配;

[0088]

步骤4.3:将时间匹配和空间匹配均成功的数据进行数据融合;

[0089]

步骤5:融合数据的存储与显示:对最终匹配成功的结果进行存储,并将完成数据融合后的图像输出,利用opencv库函数将匹配后数据一起显示在图片上,如图7所示是本实施例的测试效果图。

[0090]

以上述依据本发明的理想实施例为启示,通过上述的说明内容,相关工作人员完全可以在不偏离本项发明技术思想的范围内,进行多样的变更以及修改。本项发明的技术性范围并不局限于说明书上的内容,必须要根据权利要求范围来确定其技术性范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。