1.本发明涉及数据处理技术领域,特别涉及一种自动驾驶车辆的盲区监测预警方法。

背景技术:

2.对常规的有人驾驶车辆,在其行驶过程中对于后视镜盲区的信息获取一般都由驾驶人员通过人为方式获取,例如,驾驶员以侧身转头的方式,获得更多的环境视觉信息。但这种操作方式对无人驾驶或者自动驾驶的车辆而言是不适合的。

技术实现要素:

3.本发明的目的,就是针对现有技术的缺陷,提供一种自动驾驶车辆的盲区监测预警方法、电子设备及计算机可读存储介质,首先对环境可见度状态进行识别,若识别出环境可见度状态较差则选择不受可见度影响的雷达进行盲区监测和预警处理,若识别出环境可见度状态较好则选择摄像头进行盲区监测和预警处理。通过本发明,可基于可见度自动切换盲区监测预警的处理方式,从而保证了自动驾驶车辆的盲区监测效率和准确度。

4.为实现上述目的,本发明实施例第一方面提供了一种自动驾驶车辆的盲区监测预警方法,所述方法应用于一种自动驾驶车辆,所述自动驾驶车辆包括车身侧摄像头和车身侧雷达;所述方法包括:

5.所述自动驾驶车辆获取环境可见度状态数据;

6.当所述环境可见度状态数据为第一状态时,以所述车身侧雷达的探测范围为第一监测盲区;并调用所述车身侧雷达对所述第一监测盲区进行雷达目标对象检测处理,生成对应的第一目标对象集合;

7.当所述环境可见度状态数据为第二状态时,以所述车身侧摄像头的拍摄范围为第二检测盲区;并调用所述车身侧摄像头对所述第二监测盲区进行实时视频拍摄,生成对应的第一视频;并对所述第一视频进行分帧目标对象识别和多帧目标跟踪处理,生成对应的所述第一目标对象集合;

8.根据所述第一目标对象集合进行目标分级预警处理。

9.优选的,所述自动驾驶车辆获取环境可见度状态数据之前,所述方法还包括:

10.每隔预设的第一时间间隔调用车载摄像头对所述自动驾驶车辆的周围环境进行实时图像拍摄,生成对应的第一环境图像;

11.对所述第一环境图像进行目标对象识别处理生成多个第一环境目标对象,并统计所述第一环境目标对象的数量生成第一数量;

12.对所述第一数量是否低于预设的第一数量阈值进行判断,若所述第一数量低于所述第一数量阈值,则设置所述环境可见度状态数据为第一状态;若所述第一数量不低于所述第一数量阈值,则设置环境可见度状态数据为第二状态。

13.优选的,所述车身侧雷达的雷达类型包括毫米波雷达、超声波雷达和激光雷达;

14.所述车身侧雷达包括左车身侧雷达和右车身侧雷达;所述车身侧雷达的探测范围包括左车身侧雷达探测范围和右车身侧雷达探测范围;所述左车身侧雷达与所述左车身侧雷达探测范围对应;所述右车身侧雷达与所述右车身侧雷达探测范围对应;

15.所述车身侧摄像头的拍摄范围为预设的后视镜盲区范围;所述车身侧摄像头包括左车身侧摄像头和右车身侧摄像头;所述后视镜盲区范围包括左后视镜盲区范围和右后视镜盲区范围;所述左车身侧摄像头与所述左后视镜盲区范围对应;所述右车身侧摄像头与所述右后视镜盲区范围对应;

16.所述车身侧雷达的探测范围大于所述后视镜盲区范围,具体为:所述左车身侧雷达探测范围大于所述左后视镜盲区范围,所述右车身侧雷达探测范围大于所述右后视镜盲区范围。

17.优选的,所述第一目标对象集合包括多个第一目标对象数组;

18.所述第一目标对象数组包括第一标识数据、第一类型数据、第一距离数据和第一相对速度数据。

19.优选的,所述调用所述车身侧雷达对所述第一监测盲区进行雷达目标对象检测处理,生成对应的第一目标对象集合,具体包括:

20.调用所述车身侧雷达按预设的第一雷达探测频率,对所述第一监测盲区进行雷达扫描,生成对应的第一雷达帧数据;

21.对最近的指定数量的所述第一雷达帧数据,进行雷达点云的多目标检测与目标运动轨迹跟踪处理,得到多个第一检测目标和对应的第一检测目标数据组;所述第一检测目标数据组包括第一检测目标标识数据、第一检测目标类型数据和第一检测目标运动轨迹数据;所述第一检测目标运动轨迹数据包括多个第一检测目标轨迹点数据;

22.根据各个所述第一检测目标对应的所述第一检测目标运动轨迹数据与所述自动驾驶车辆的当前位置信息,计算当前检测目标与所述自动驾驶车辆间的最短行驶距离,生成对应的第一检测目标距离数据;并根据各个所述第一检测目标对应的所述第一检测目标运动轨迹数据,计算当前检测目标与所述自动驾驶车辆的相对速度,生成对应的第一检测目标相对速度数据;

23.为每个所述第一检测目标创建一个对应的所述第一目标对象数组;并设置所述第一目标对象数组的所述第一标识数据为对应的所述第一检测目标数据组的所述第一检测目标标识数据;设置所述第一目标对象数组的所述第一类型数据为对应的所述第一检测目标数据组的所述第一检测目标类型数据;设置所述第一目标对象数组的所述第一距离数据为对应的所述第一检测目标距离数据;设置所述第一目标对象数组的所述第一相对速度数据为对应的所述第一检测目标相对速度数据;并由完成设置的所有所述第一目标对象数组,组成所述第一目标对象集合。

24.优选的,所述对所述第一视频进行分帧目标对象识别和多帧目标跟踪处理,生成对应的所述第一目标对象集合,具体包括:

25.对所述第一视频进行帧图像提取处理,生成多个第一图像帧数据;

26.对最近的指定数量的所述第一图像帧数据,进行二维图像的多目标检测与目标运动轨迹跟踪处理,得到多个第二检测目标和对应的第二检测目标数据组;所述第二检测目标数据组包括第二检测目标标识数据、第二检测目标类型数据和第二检测目标运动轨迹数

据;所述第二检测目标运动轨迹数据包括多个第二检测目标轨迹点数据;

27.根据各个所述第二检测目标对应的所述第二检测目标运动轨迹数据与所述自动驾驶车辆的当前位置信息,计算当前检测目标与所述自动驾驶车辆间的最短行驶距离,生成对应的第二检测目标距离数据;并根据各个所述第二检测目标对应的所述第二检测目标运动轨迹数据,计算当前检测目标与所述自动驾驶车辆的相对速度,生成对应的第二检测目标相对速度数据;

28.为每个所述第二检测目标创建一个对应的所述第一目标对象数组;并设置所述第一目标对象数组的所述第一标识数据为对应的所述第二检测目标数据组的所述第二检测目标标识数据;设置所述第一目标对象数组的所述第一类型数据为对应的所述第二检测目标数据组的所述第二检测目标类型数据;设置所述第一目标对象数组的所述第一距离数据为对应的所述第二检测目标距离数据;设置所述第一目标对象数组的所述第一相对速度数据为对应的所述第二检测目标相对速度数据;并由完成设置的所有所述第一目标对象数组,组成所述第一目标对象集合。

29.优选的,所述根据所述第一目标对象集合进行目标分级预警处理,具体包括:

30.在所述第一目标对象集合中,根据每个所述第一目标对象数组中的所述第一距离数据和所述第一相对速度数据,估算当前检测目标与所述自动驾驶车辆间的碰撞时间,生成对应的第一碰撞时间数据;并将数值最小的所述第一碰撞时间数据记为第一最短时间;

31.在所述第一目标对象集合中,将数值最小的所述第一距离数据记为第一最短距离;

32.根据预设的第一预警距离阈值、第二预警距离阈值、第一碰撞预警时间、第二碰撞预警时间,对所述第一最短距离和所述第一最短时间进行预警级别识别处理,生成对应的第一预警级别;第一预警距离阈值>第二预警距离阈值;第一碰撞预警时间>第二碰撞预警时间;所述第一预警级别包括一级、二级、三级、四级和五级预警级别,从所述一级预警级别到所述五级预警级别对应的预警等级逐级提升;

33.根据所述第一预警级别,进行对应的等级预警处理。

34.进一步的,所述根据预设的第一预警距离阈值、第二预警距离阈值、第一碰撞预警时间、第二碰撞预警时间,对所述第一最短距离和所述第一最短时间进行预警级别识别处理,生成对应的第一预警级别,具体包括:

35.当所述第一最短距离低于所述第一预警距离阈值但未低于所述第二预警距离阈值,且所述第一最短时间未低于所述第一碰撞预警时间时,设置所述第一预警级别为一级预警级别;

36.当所述第一最短距离低于所述第一预警距离阈值但未低于所述第二预警距离阈值,且所述第一最短时间低于所述第一碰撞预警时间但未低于所述第二碰撞预警时间时,设置所述第一预警级别为二级预警级别;

37.当所述第一最短距离低于所述第二预警距离阈值,且所述第一最短时间未低于所述第一碰撞预警时间时,设置所述第一预警级别为三级预警级别;

38.当所述第一最短距离低于所述第一预警距离阈值但未低于所述第二预警距离阈值且所述第一最短时间低于所述第二碰撞预警时间时,或者当所述第一最短距离低于所述第二预警距离阈值且所述第一最短时间低于所述第一碰撞预警时间但未低于所述第二碰

撞预警时间时,设置所述第一预警级别为四级预警级别;

39.当所述第一最短距离低于所述第二预警距离阈值,且所述第一最短时间低于所述第二碰撞预警时间时,设置所述第一预警级别为五级预警级别。

40.本发明实施例第二方面提供了一种电子设备,包括:存储器、处理器和收发器;

41.所述处理器用于与所述存储器耦合,读取并执行所述存储器中的指令,以实现上述第一方面所述的方法步骤;

42.所述收发器与所述处理器耦合,由所述处理器控制所述收发器进行消息收发。

43.本发明实施例第三方面提供了一种计算机可读存储介质,所述计算机可读存储介质存储有计算机指令,当所述计算机指令被计算机执行时,使得所述计算机执行上述第一方面所述的方法的指令。

44.本发明实施例提供了一种自动驾驶车辆的盲区监测预警方法、电子设备及计算机可读存储介质,首先对环境可见度状态进行识别,若识别出环境可见度状态较差则选择不受可见度影响的雷达进行盲区监测和预警处理,若识别出环境可见度状态较好则选择摄像头进行盲区监测和预警处理。通过本发明,可基于可见度自动切换盲区监测预警的处理方式,从而保证了自动驾驶车辆的盲区监测效率和准确度。

附图说明

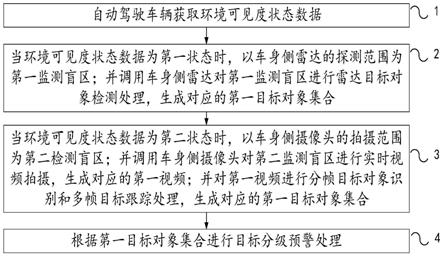

45.图1为本发明实施例一提供的一种自动驾驶车辆的盲区监测预警方法示意图;

46.图2为本发明实施例一提供的预警级别象限示意图;

47.图3为本发明实施例二提供的一种电子设备的结构示意图。

具体实施方式

48.为了使本发明的目的、技术方案和优点更加清楚,下面将结合附图对本发明作进一步地详细描述,显然,所描述的实施例仅仅是本发明一部份实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其它实施例,都属于本发明保护的范围。

49.自动驾驶车辆在行驶过程中,基于本发明实施例一提供的一种自动驾驶车辆的盲区监测预警方法,基于环境可见度状态选择对应的车载雷达或摄像头来进行盲区监测和预警处理,保证了自动驾驶车辆的盲区监测效率和准确度;图1为本发明实施例一提供的一种自动驾驶车辆的盲区监测预警方法示意图,如图1所示,本方法主要包括如下步骤:

50.步骤1,自动驾驶车辆获取环境可见度状态数据;

51.其中,本方法适用的一种自动驾驶车辆包括车身侧摄像头和车身侧雷达。

52.这里,自动驾驶车辆获取的环境可见度状态数据是用于标识自车周围环境的可见度状态;环境可见度状态数据包括第一状态和第二状态,若环境可见度状态数据为第一状态说明自车周围环境的可见度较差;若环境可见度状态数据为第二状态说明自车周围环境的可见度良好。

53.另外,车身侧摄像头包括左车身侧摄像头和右车身侧摄像头;车身侧摄像头的拍摄范围为预设的后视镜盲区范围,后视镜盲区范围包括左后视镜盲区范围和右后视镜盲区范围;左车身侧摄像头与左后视镜盲区范围对应;右车身侧摄像头与右后视镜盲区范围对

应;

54.车身侧雷达的雷达类型包括毫米波雷达、超声波雷达和激光雷达;车身侧雷达包括左车身侧雷达和右车身侧雷达;车身侧雷达的探测范围包括左车身侧雷达探测范围和右车身侧雷达探测范围;左车身侧雷达与左车身侧雷达探测范围对应;右车身侧雷达与右车身侧雷达探测范围对应;

55.车身侧雷达的探测范围大于预设的后视镜盲区范围,具体为:左车身侧雷达探测范围大于左后视镜盲区范围,右车身侧雷达探测范围大于右后视镜盲区范围。

56.这里,左车身侧摄像头常规被安装在自动驾驶车辆的左后视镜侧面或者底部,也可以安装在左a柱外部高于左后视镜的位置,同理,右车身侧摄像头常规被安装在右后视镜侧面或者底部,也可以安装在右a柱外部高于右后视镜的位置;预设的后视镜盲区范围实际就是自动驾驶车辆的车外左后视镜、车内后视镜、车外右后视镜未能覆盖的左侧盲区和右侧盲区的总称,这里的左侧盲区就是左后视镜盲区范围,右侧盲区就是右后视镜盲区范围;那么,左车身侧摄像头实际就是对左后视镜盲区范围进行拍摄的设备,右车身侧摄像头实际就是对右后视镜盲区范围进行拍摄的设备;

57.左车身侧雷达可被安装在自动驾驶车辆前、后保险杆的左侧,还可被安装在左侧车身上的指定位置,同理,右车身侧雷达可被安装在自动驾驶车辆前、后保险杆的右侧,还可被安装在右侧车身上的指定位置;左车身侧雷达实际就是对左车身侧雷达探测范围进行探测扫描的雷达设备,右车身侧雷达实际就是对右车身侧雷达探测范围进行探测扫描的雷达设备;

58.由后续步骤可知,若使用雷达进行盲区监测说明当前环境的可见度较低,在这种情况下,更应扩大探测范围,所以车身侧雷达的探测范围要被设定大于后视镜盲区范围,以左右区域进行细分,自然就是左车身侧雷达探测范围大于左后视镜盲区范围,右车身侧雷达探测范围大于右后视镜盲区范围。

59.另外,在自动驾驶车辆获取环境可见度状态数据之前,本发明实施例还给出了环境可见度状态数据的生成机制,具体包括:

60.步骤a1,每隔预设的第一时间间隔调用车载摄像头对自动驾驶车辆的周围环境进行实时图像拍摄,生成对应的第一环境图像;

61.这里,第一时间间隔为预先设定的时间间隔参数,可以进行灵活设置;若自动驾驶车辆所在地区天气变化快、气候状态复杂,则可将第一时间间隔设为较短间隔,从而提高环境可见度的检查频率;反之,若自动驾驶车辆所在地区天气变化不大、气候状态简单,则可将第一时间间隔设为较长间隔,从而佳妮高低环境可见度的检查频率;在调用车载摄像头对自动驾驶车辆的周围环境进行实时图像拍摄时,可调用任一车载摄像头(包括车身侧摄像头)进行拍摄;

62.步骤a2,对第一环境图像进行目标对象识别处理生成多个第一环境目标对象,并统计第一环境目标对象的数量生成第一数量;

63.这里,使用训练成熟的基于卷积神经网络结构的二维图像目标识别模型或图像语义分割模型,对第一环境图像进行目标检测,从而可以得到多个目标对象也就是第一环境目标对象,其数量为第一数量;若自动驾驶车辆的周围环境可见度差,那么能被成功检测出的目标对象的数量就会较少;

64.步骤a3,对第一数量是否低于预设的第一数量阈值进行判断,若第一数量低于第一数量阈值,则设置环境可见度状态数据为第一状态;若第一数量不低于第一数量阈值,则设置环境可见度状态数据为第二状态。

65.这里,第一数量阈值为预先设定的一个目标对象数量阈值,该阈值往往被设为一个较小值;在第一数量低于该阈值时,说明周围环境可见度差,上述二维图像目标识别模型或图像语义分割模型的识别效率较低,若继续使用摄像头进行盲区监测和预警处理可能会导致漏检率增大、自动驾驶的安全度降低,所以,需要将环境可见度状态数据设为第一状态便于后续步骤选择车身侧雷达作为盲区监测设备;在第一数量不低于该阈值时,则将环境可见度状态数据设为第二状态便于后续步骤选择车身侧摄像头为盲区监测设备。

66.步骤2,当环境可见度状态数据为第一状态时,以车身侧雷达的探测范围为第一监测盲区;并调用车身侧雷达对第一监测盲区进行雷达目标对象检测处理,生成对应的第一目标对象集合;

67.其中,第一目标对象集合包括多个第一目标对象数组;第一目标对象数组包括第一标识数据、第一类型数据、第一距离数据和第一相对速度数据;

68.此处,每个第一目标对象数组对应一个环境中的目标对象;第一标识数据为对每个目标对象分配的唯一标识信息;第一类型数据为每个目标对象对应的目标类型,例如,建筑物、人、动物、自行车、摩托车、轿车、货车、轨道列车等;第一距离数据为环境中每个目标对象到自动驾驶车俩的行驶距离;第一相对速度数据为环境中每个目标对象与自动驾驶车俩的相对行驶速度;

69.这里,环境可见度状态数据为第一状态说明自动驾驶车俩周围环境可见度较差,因此以车身侧雷达的探测范围为第一监测盲区从而达到扩大监测范围的目的,并使用车身侧雷达对第一监测盲区进行目标检测得到对应的第一目标对象集合;

70.具体包括:步骤21,以车身侧雷达的探测范围为第一监测盲区;

71.步骤22,调用车身侧雷达对第一监测盲区进行雷达目标对象检测处理,生成对应的第一目标对象集合;

72.具体包括:步骤221,调用车身侧雷达按预设的第一雷达探测频率,对第一监测盲区进行雷达扫描,生成对应的第一雷达帧数据;

73.这里,车身侧雷达具体为左车身侧雷达时,第一监测盲区具体为左车身侧雷达探测范围,第一雷达帧数据为车身侧雷达对左车身侧雷达探测范围扫描得到的帧数据;车身侧雷达具体为右身侧雷达时,第一监测盲区具体为右车身侧雷达探测范围,第一雷达帧数据为右身侧雷达对右车身侧雷达探测范围扫描得到的帧数据;

74.步骤222,对最近的指定数量的第一雷达帧数据,进行雷达点云的多目标检测与目标运动轨迹跟踪处理,得到多个第一检测目标和对应的第一检测目标数据组;

75.其中,第一检测目标数据组包括第一检测目标标识数据、第一检测目标类型数据和第一检测目标运动轨迹数据;第一检测目标运动轨迹数据包括多个第一检测目标轨迹点数据;

76.具体包括:步骤b1,由最近的指定数量的第一雷达帧数据组成最新的第一雷达帧数据序列;

77.步骤b2,对第一雷达帧数据序列进行雷达点云的多目标检测与目标运动轨迹跟踪

处理,得到多个第一检测目标和对应的第一检测目标数据组;

78.具体的:步骤b21,对第一雷达帧数据序列中各个第一雷达帧数据进行点云数据转换生成对应的第一帧点云集合;

79.这里,在对各个第一雷达帧数据进行滤波降噪之后,根据当前车身侧雷达的具体类型,对完成滤波降噪的第一雷达帧数据进行对应类型的雷达坐标到点云坐标的数据转换处理,从而得到对应的第一帧点云集合;

80.步骤b22,基于训练成熟的点云目标识别模型或点云语义分割模型,对各个第一帧点云集合进行目标检测处理,得到多个第一单帧检测目标;

81.这里,每个第一单帧检测目标都对应一个目标位置信息和目标类型信息;

82.步骤b23,将所有第一帧点云集合中对应同一目标对象的第一单帧检测目标归为一组,记为第一检测目标组;

83.步骤b24,为每个第一检测目标组分配一个唯一标识,作为对应的第一检测目标标识数据;以每个第一检测目标组对应的目标类型信息,作为对应的第一检测目标类型数据;提取每个第一检测目标组的第一单帧检测目标的目标位置信息作为第一检测目标轨迹点数据,并按时间先后顺序对所有第一检测目标轨迹点数据进行排序组成对应的第一检测目标运动轨迹数据;由第一检测目标标识数据、第一检测目标类型数据和第一检测目标运动轨迹数据组成与每个第一检测目标组对应的第一检测目标数据组;

84.步骤223,根据各个第一检测目标对应的第一检测目标运动轨迹数据与自动驾驶车辆的当前位置信息,计算当前检测目标与自动驾驶车辆间的最短行驶距离,生成对应的第一检测目标距离数据;并根据各个第一检测目标对应的第一检测目标运动轨迹数据,计算当前检测目标与自动驾驶车辆的相对速度,生成对应的第一检测目标相对速度数据;

85.步骤224,为每个第一检测目标创建一个对应的第一目标对象数组;并设置第一目标对象数组的第一标识数据为对应的第一检测目标数据组的第一检测目标标识数据;设置第一目标对象数组的第一类型数据为对应的第一检测目标数据组的第一检测目标类型数据;设置第一目标对象数组的第一距离数据为对应的第一检测目标距离数据;设置第一目标对象数组的第一相对速度数据为对应的第一检测目标相对速度数据;并由完成设置的所有第一目标对象数组,组成第一目标对象集合。

86.步骤3,当环境可见度状态数据为第二状态时,以车身侧摄像头的拍摄范围为第二检测盲区;并调用车身侧摄像头对第二监测盲区进行实时视频拍摄,生成对应的第一视频;并对第一视频进行分帧目标对象识别和多帧目标跟踪处理,生成对应的第一目标对象集合;

87.这里,环境可见度状态数据为第二状态说明自动驾驶车俩周围环境可见度较好,因此以车身侧摄像头的拍摄范围为第二监测盲区,并对第二监测盲区进行目标检测得到对应的第一目标对象集合;

88.具体包括:步骤31,以车身侧摄像头的拍摄范围为第二检测盲区;

89.步骤32,调用车身侧摄像头对第二监测盲区进行实时视频拍摄,生成对应的第一视频;

90.这里,车身侧摄像头具体为左车身侧摄像头时,第二监测盲区具体为左后视镜盲区范围,第一视频为左车身侧摄像头对左后视镜盲区范围拍摄得到的视频数据;车身侧摄

像头具体为右车身侧摄像头时,第二监测盲区具体为右后视镜盲区范围,第一视频为右车身侧摄像头对右后视镜盲区范围拍摄得到的视频数据;

91.步骤33,对第一视频进行分帧目标对象识别和多帧目标跟踪处理,生成对应的第一目标对象集合;

92.具体包括:步骤331,对第一视频进行帧图像提取处理,生成多个第一图像帧数据;

93.步骤332,对最近的指定数量的第一图像帧数据,进行二维图像的多目标检测与目标运动轨迹跟踪处理,得到多个第二检测目标和对应的第二检测目标数据组;

94.其中,第二检测目标数据组包括第二检测目标标识数据、第二检测目标类型数据和第二检测目标运动轨迹数据;第二检测目标运动轨迹数据包括多个第二检测目标轨迹点数据;

95.具体包括:步骤c1,由最近的指定数量的第一图像帧数据组成最新的第一图像帧数据序列;

96.步骤c2,对第一图像帧数据序列进行二维图像的多目标检测与目标运动轨迹跟踪处理,得到多个第二检测目标和对应的第二检测目标数据组;

97.具体的:步骤c21,对第一图像帧数据序列中各个第一图像帧数据进行滤波降噪处理;

98.步骤c22,基于训练成熟的二维图像目标识别模型或二维图像语义分割模型,对各个第一图像帧数据进行目标检测处理,得到多个第二单帧检测目标;

99.这里,每个第二单帧检测目标都对应一个目标位置信息和目标类型信息;

100.步骤c23,将所有第一图像帧数据中对应同一目标对象的第二单帧检测目标归为一组,记为第二检测目标组;

101.步骤c24,为每个第二检测目标组分配一个唯一标识,作为对应的第二检测目标标识数据;以每个第二检测目标组对应的目标类型信息,作为对应的第二检测目标类型数据;提取每个第二检测目标组的第二单帧检测目标的目标位置信息作为第二检测目标轨迹点数据,并按时间先后顺序对所有第二检测目标轨迹点数据进行排序组成对应的第二检测目标运动轨迹数据;由第二检测目标标识数据、第二检测目标类型数据和第二检测目标运动轨迹数据组成与每个第二检测目标组对应的第二检测目标数据组;

102.步骤333,根据各个第二检测目标对应的第二检测目标运动轨迹数据与自动驾驶车辆的当前位置信息,计算当前检测目标与自动驾驶车辆间的最短行驶距离,生成对应的第二检测目标距离数据;并根据各个第二检测目标对应的第二检测目标运动轨迹数据,计算当前检测目标与自动驾驶车辆的相对速度,生成对应的第二检测目标相对速度数据;

103.步骤334,为每个第二检测目标创建一个对应的第一目标对象数组;并设置第一目标对象数组的第一标识数据为对应的第二检测目标数据组的第二检测目标标识数据;设置第一目标对象数组的第一类型数据为对应的第二检测目标数据组的第二检测目标类型数据;设置第一目标对象数组的第一距离数据为对应的第二检测目标距离数据;设置第一目标对象数组的第一相对速度数据为对应的第二检测目标相对速度数据;并由完成设置的所有第一目标对象数组,组成第一目标对象集合。

104.步骤4,根据第一目标对象集合进行目标分级预警处理;

105.具体包括:步骤41,在第一目标对象集合中,根据每个第一目标对象数组中的第一

距离数据和第一相对速度数据,估算当前检测目标与自动驾驶车辆间的碰撞时间,生成对应的第一碰撞时间数据;并将数值最小的第一碰撞时间数据记为第一最短时间;

106.这里,按距离/相对速度=碰撞时间的对应关系进行当前检测目标与自动驾驶车辆间的碰撞时间估算;

107.步骤42,在第一目标对象集合中,将数值最小的第一距离数据记为第一最短距离;

108.步骤43,根据预设的第一预警距离阈值、第二预警距离阈值、第一碰撞预警时间、第二碰撞预警时间,对第一最短距离和第一最短时间进行预警级别识别处理,生成对应的第一预警级别;

109.其中,第一预警距离阈值>第二预警距离阈值;第一碰撞预警时间>第二碰撞预警时间;第一预警级别包括一级、二级、三级、四级和五级预警级别,从一级预警级别到五级预警级别对应的预警等级逐级提升;

110.这里,本发明实施例以最短距离和碰撞时间为二维坐标横、纵轴建立二维坐标系,并在该二维坐标系中以第一预警距离阈值、第二预警距离阈值、第一碰撞预警时间、第二碰撞预警时间划分出多个预警级别象限,如图2为本发明实施例一提供的预警级别象限示意图所示;

111.具体包括:步骤431,当第一最短距离低于第一预警距离阈值但未低于第二预警距离阈值,且第一最短时间未低于第一碰撞预警时间时,设置第一预警级别为一级预警级别;

112.步骤432,当第一最短距离低于第一预警距离阈值但未低于第二预警距离阈值,且第一最短时间低于第一碰撞预警时间但未低于第二碰撞预警时间时,设置第一预警级别为二级预警级别;

113.步骤433,当第一最短距离低于第二预警距离阈值,且第一最短时间未低于第一碰撞预警时间时,设置第一预警级别为三级预警级别;

114.步骤434,当第一最短距离低于第一预警距离阈值但未低于第二预警距离阈值且第一最短时间低于第二碰撞预警时间时,或者当第一最短距离低于第二预警距离阈值且第一最短时间低于第一碰撞预警时间但未低于第二碰撞预警时间时,设置第一预警级别为四级预警级别;

115.步骤435,当第一最短距离低于第二预警距离阈值,且第一最短时间低于第二碰撞预警时间时,设置第一预警级别为五级预警级别;

116.步骤44,根据第一预警级别,进行对应的等级预警处理;

117.具体包括:若第一预警级别为一、二、三、四或五级预警级别,则进行对应的一、二、三、四或五级预警处理。

118.这里,在具体处理预警时,可通过不同频率的蜂鸣装置,以及不同颜色、不同闪烁频率、不同亮度的灯光装置进行多级预警,预警级别越高蜂鸣频率越高、颜色越显眼、闪烁频率越高、亮度越大;并同时向自动驾驶车辆的车辆控制模块发送第一预警级别,以便车辆控制模块可以及时根据当前预警级别做出适应的车辆操控动作。

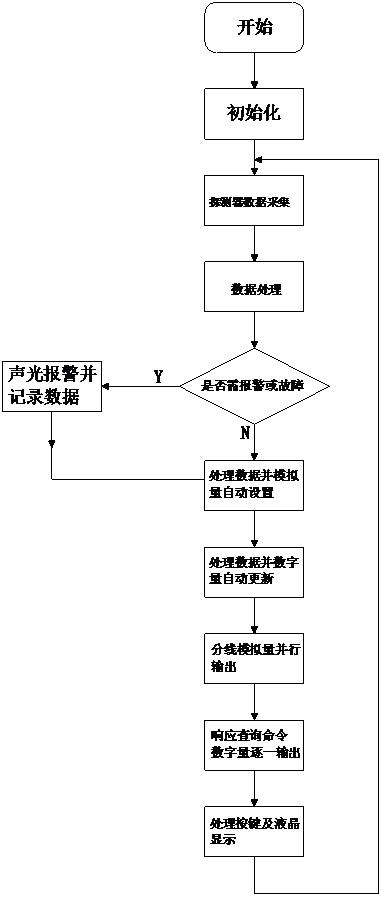

119.图3为本发明实施例二提供的一种电子设备的结构示意图。该电子设备可以为实现本发明实施例方法的终端设备或者服务器,也可以为与前述终端设备或者服务器连接的实现本发明实施例方法的终端设备或服务器。如图3所示,该电子设备可以包括:处理器301(例如cpu)、存储器302、收发器303;收发器303耦合至处理器301,处理器301控制收发器303

的收发动作。存储器302中可以存储各种指令,以用于完成各种处理功能以及实现前述方法实施例描述的处理步骤。优选的,本发明实施例涉及的电子设备还包括:电源304、系统总线305以及通信端口306。系统总线305用于实现元件之间的通信连接。上述通信端口306用于电子设备与其他外设之间进行连接通信。

120.在图3中提到的系统总线305可以是外设部件互连标准(peripheral component interconnect,pci)总线或扩展工业标准结构(extended industry standard architecture,eisa)总线等。该系统总线可以分为地址总线、数据总线、控制总线等。为便于表示,图中仅用一条粗线表示,但并不表示仅有一根总线或一种类型的总线。通信接口用于实现数据库访问装置与其他设备(例如客户端、读写库和只读库)之间的通信。存储器可能包含随机存取存储器(random access memory,ram),也可能还包括非易失性存储器(non

‑

volatile memory),例如至少一个磁盘存储器。

121.上述的处理器可以是通用处理器,包括中央处理器(central processing unit,cpu)、网络处理器(network processor,np)、图形处理器(graphics processing unit,gpu)等;还可以是数字信号处理器(digital signal processor,dsp)、专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field programmable gate array,fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件。

122.需要说明的是,本发明实施例还提供一种计算机可读存储介质,该计算机可读存储介质中存储有指令,当其在计算机上运行时,使得计算机执行上述实施例中提供的方法和处理过程。

123.本发明实施例还提供一种运行指令的芯片,该芯片用于执行前述方法实施例描述的处理步骤。

124.本发明实施例提供了一种自动驾驶车辆的盲区监测预警方法、电子设备及计算机可读存储介质,首先对环境可见度状态进行识别,若识别出环境可见度状态较差则选择不受可见度影响的雷达进行盲区监测和预警处理,若识别出环境可见度状态较好则选择摄像头进行盲区监测和预警处理。通过本发明,可基于可见度自动切换盲区监测预警的处理方式,从而保证了自动驾驶车辆的盲区监测效率和准确度。

125.专业人员应该还可以进一步意识到,结合本文中所公开的实施例描述的各示例的单元及算法步骤,能够以电子硬件、计算机软件或者二者的结合来实现,为了清楚地说明硬件和软件的可互换性,在上述说明中已经按照功能一般性地描述了各示例的组成及步骤。这些功能究竟以硬件还是软件方式来执行,取决于技术方案的特定应用和设计约束条件。专业技术人员可以对每个特定的应用来使用不同方法来实现所描述的功能,但是这种实现不应认为超出本发明的范围。

126.结合本文中所公开的实施例描述的方法或算法的步骤可以用硬件、处理器执行的软件模块,或者二者的结合来实施。软件模块可以置于随机存储器(ram)、内存、只读存储器(rom)、电可编程rom、电可擦除可编程rom、寄存器、硬盘、可移动磁盘、cd

‑

rom、或技术领域内所公知的任意其它形式的存储介质中。

127.以上所述的具体实施方式,对本发明的目的、技术方案和有益效果进行了进一步详细说明,所应理解的是,以上所述仅为本发明的具体实施方式而已,并不用于限定本发明

的保护范围,凡在本发明的精神和原则之内,所做的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。