技术特征:

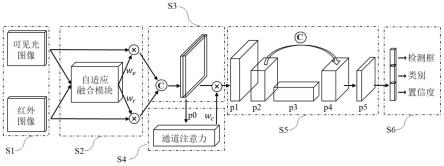

1.一种自适应融合可见光和红外图像的双模态无人机识别方法,其特征在于,该识别方法通过深度学习网络实现,该深度学习网络包括第一主干网络、第二主干网络、自适应融合模块、通道注意力模块和fpn结构,该方法包括:s1:获取无人机的可见光图像和红外图像,将可见光图像输入至第一主干网络,将红外图像输入至第二主干网络;s2:通过第一主干网络对可见光图像进行特征提取得到可见光特征图,通过第二主干网络对红外图像进行特征提取得到红外特征图,然后将可见光特征图和红外特征图输入至自适应融合模块;s3:自适应融合模块根据可见光特征图和红外特征图的特征质量对可见光图像和红外图像进行权重分配,将可见光特征图和红外特征图分别与各自的权重相乘,并对赋权重的可见光特征图和红外特征图进行拼接得到特征图p0;s4:通过通道注意力模块在各通道对特征图p0赋权重w

c

,将w

c

与特征图p0相乘,得到特征图p1;s5:通过fpn结构对特征图p1进行多尺度特征融合操作,得到检测层p5;s6:根据检测层p5得到无人机识别结果。2.如权利要求1所述的方法,其特征在于,可见光图像通过可见光相机得到且宽*高*通道数为640*640*3;红外图像通过红外相机得到且宽*高*通道数为640*640*1;经过预处理和主干网络后,可见光特征图和红外特征图的尺寸均为640*640*8。3.如权利要求1所述的方法,其特征在于,步骤s3中,可见光特征图的权重w

v

和红外特征图的权重w

i

分别表示为:f

d

=conv(concat(maxpool(f),avgpool(f))));ω=sig(mean(f

d

) max(f

d

));其中,w1表示可见光特征图的预权重;w2表示红外特征图的预权重;ω表示预权重;f

d

表示空间特征图;f表示输入的可见光特征图或红外特征图;maxpool(f)表示对特征图进行最大池化操作;avgpool(f)表示对特征图进行平均池化操作;concat表示对最大池化操作和平均池化操作的特征图按某一维度进行拼接;conv表示卷积层;max(f

d

)表示空间特征图上的最大值;mean(f

d

)表示空间特征图的全局平均值;sig代表sigmoid激活函数。4.如权利要求3所述的方法,其特征在于,若自适应融合模块输入的是宽*高*通道数为w*h*3的特征图,对该特征图进行最大池化操作和平均池化操作,分别得到w*h*1的最大池化层和w*h*1的平均池化层,将w*h*1的最大池化层和w*h*1的平均池化层直接拼接形成w*h*2的特征图,再将w*h*2的特征图输入至人工卷积层得到w*h*1的空间特征图,将该空间特征图的最大值和平均值进行相加得到分数值,最后将该分数值传入sigmoid激活函数得到预权重ω。5.如权利要求3所述的方法,其特征在于,步骤s4中,特征图p1表示为:w

c

=sig(mlp(avgpool(p0)) mlp(maxpool(p0)));

其中,mlp表示多层感知机;w

c

即通道注意力模块的权重。6.如权利要求5所述的方法,其特征在于,所述识别网络的损失函数表示为:6.如权利要求5所述的方法,其特征在于,所述识别网络的损失函数表示为:6.如权利要求5所述的方法,其特征在于,所述识别网络的损失函数表示为:其中,l

eiou

表示一种有效的边界框回归损失;ρ2表示预测框中点和目标框中点之间的欧几里得距离,b表示预测框的中点;b

gt

表示目标框的中点;w表示预测框的宽度;w

gt

表示目标框的宽度;h表示预测框的高度;h

gt

表示目标框的高度;c表示覆盖两个检测框最小框的对角线距离;c

w

表示覆盖两个检测框最小框的宽度;c

h

表示覆盖两个检测框最小框的高度;l

obj

表示置信度损失;p

o

表示预测框中的目标置信度分数;p

iou

表示预测框和对应的目标框的iou值;表示二分类交叉熵损失;w

obj

表示正样本的权重;k表示输出特征图,s2表示输出特征图的单元格,b表示每个单元格中的预测锚定框;代表第k个输出特征映射第i个单元格和第j个锚定框时是否为正样本;x

p

表示预测向量;x

gt

表示真值向量;α

box

表示位置误差的权重;α

obj

表示置信误差的权重。7.如权利要求1所述的方法,其特征在于,所述第一主干网络和所述第二主干网络均包括conv模块和c3模块,第一主干网络和第二主干网络的输出尺寸均为640*640*8。8.如权利要求1所述的方法,其特征在于,fpn结构共有11层,依次为conv层、c3层、conv层、c3层、conv层、c3层、sppf层、conv层、upsample层、concat层和c3层。

技术总结

本发明公开了一种自适应融合可见光和红外图像的双模态无人机识别方法,涉及计算机视觉技术领域,解决了单独用可见光相机在复杂环境下对无人机检测效果较差的技术问题,其技术方案要点是利用可见光图像和红外图像的互补性;利用自适应融合模块根据图像特征质量对双模态输入分配权重,再通过轻型的双模态网络对无人机进行实时识别。该算法在满足实时性的要求下,能够在光照复杂环境下对微小目标进行识别,以应对复杂环境下的无人机检测任务,在军事领域有较好的应用前景。且该网络的结构简单,计算量小,对小目标有较好的检测效果,具有较强的鲁棒性。较强的鲁棒性。较强的鲁棒性。

技术研发人员:耿可可 成小龙 殷国栋 庄伟超 王金虎 孙宇啸 丁鹏博 柳智超

受保护的技术使用者:东南大学

技术研发日:2022.10.27

技术公布日:2023/2/6

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。