基于深度学习的交通违法行为分类检测方法及soc芯片

技术领域

1.本发明属于计算机视觉技术领域,特别涉及基于深度学习的交通违法行为分类检测方法及soc芯片。

背景技术:

2.近些年,随着国民生活水平的提高,国家汽车保有量越来越高,道路上行驶的车辆越来越多。在道路复杂的交通环境下,车辆违章行为也经常发生,严重威胁了道路安全和车主人身财产安全。对于机动车的交通违法行为,目前有固定电子监控设备抓拍系统和移动抓拍道路交通技术监控设备,通过对拍摄的图像路上进行人工筛查,但在效率上不能达到很好的效果,而且还增加了人力成本。近年来随着计算机多媒体技术和图像处理技术的发展,基于视频的违法行为判断在智能交通中占据的分量也越来越大,社会各界投入的研究力量也越来越多。由于我国对道路监控的日益重视,视频检测技术已经成为智能交通领域最重要的信息采集手段,综合评比,将视频检测技术应用于道路交通违法行为检测具有很大的可行性。

3.为解决车辆交通违法行为人工筛查效率低下以及人力成本高昂的问题,公开号为“cn113177443a”的中国发明专利公开了一种基于图像视觉的智能识别道路交通违章的方法,其方案如下:建模和建模后的预训练;车道线检测分类和车道数确定;检测行人、斑马线、交通灯和公交车道标识;车辆检测和跟踪;交通违法判定;利用单目平面摄像头和边缘计算功能,采用深度学习的方法对抓取一系列帧图像进行目标检测和分类,然后通过逻辑判断检测的车辆是否产生交通违章。

4.同时,而行人交通违法行为愈发严重,相比车辆的交通违法行为,行人的交通违法行为明显缺乏监管措施,行人参与道路交通的主要特点是行走随意性大,方向多变,很容易引起险情,因此增强对参与道路交通的行人的监管也迫在眉睫。交通违法行为的检测就不能只限于车辆交通违法行为,也应对行人的交通违法行为作出检测。

5.公开号为“cn112528759a”公开了一种基于计算机视觉的交通违章行为检测方法,除检测交通场景下车辆的违法行为外,还对其他的道路交通参与者的违法行为进行检测。其方案如下:通过计算机视觉技术,对在交通场景下的行人、不同类别机动车、交通指示灯、行车线、斑马线、车牌、车标等物体进行实时的目标识别,同时对机动车车速、车流量等信息进行实时检测与统计,对于行人闯红灯、机动车闯红灯、机动车不礼让行人、机动车超速行驶等违反交通道路规范章程的行为,该应用也进行捕捉和识别,协助交通监管者进行交通监管。但是,该方案通过单一的深度学习算法模型对交通场景下的不同交通参与者的违法行为进行检测,存在算法复杂度高,检测精度不足以及检测效率较低的问题。

技术实现要素:

6.本发明提供基于深度学习的交通违法行为分类检测方法及soc芯片,旨在解决算法复杂度高,检测精度不足以及检测效率较低的问题。

7.为解决上述技术问题,本发明首先对交通场景下采集的图片按照不同的交通参与者进行分类,然后再将分类好的图片分别输入至相应的神经网络模型中进行交通违法行为的检测判定。具体方案如下:基于深度学习的交通违法行为分类检测方法,包括以下步骤:s1:通过成像设备采集交通场景视频,分解为连续的多个视频帧。

8.s2:将所述视频帧输入训练好的分类神经网络模型,对视频帧中的路面、交通指示标志、信号灯以及交通参与者进行标注,所述分类神经网络模型采用改进yolov5s神经网络模型;所述改进yolov5s神经网络模型将模型的神经网络的层数和每层的通道数减小,并将空间金字塔池化结构的流程改进为特征图依序通过三层最大池化层;s3:所述分类神经网络模型将视频帧按交通参与者进行分类,将具有车辆标注的视频帧分类为车辆特征图,将具有行人标注的视频帧分类为行人特征图;s4:将所述车辆特征图输入训练好的车辆交通违法检测模型,进行车辆交通违法行为判断,若判定为交通违法行为,则进行车牌识别后生成车辆交通违法图像供后续处理使用;所述车辆交通违法检测模型包括车辆违法判定算法和车牌识别模型,所述车辆违法判定算法根据车辆的行驶轨迹、路面标识、交通指示标识以及信号灯状态对车辆是否违法作出判定,所述车牌识别模型采用svm模型,通过车牌定位模块、车牌字符分割模块以及车牌字符识别模块对车牌进行识别;s5:将所述行人特征图输入训练好的行人交通违法检测模型,进行行人交通违法行为判断,若判定为交通违法行为,则进行人脸识别后生成行人交通违法图像供后续处理使用;所述行人交通违法检测模型包括违法判定算法和人脸识别模型,所述违法判定算法根据行人的行动轨迹、路面标识、交通指示标识以及信号灯状态对车辆是否违法作出判定,所述人脸识别模型采用简化retinaface模型,所述简化retinaface模型进一步包括:主干特征提取网络、fpn特征金字塔网络、ssh特征增强网络以及人脸目标输出端。

9.优选地,所述改进yolov5s神经网络模型包括:输入端,所述输入端使用mosaic方法、自适应锚框计算与自适应图片缩放方法,输出分辨率为640

×

640大小rgb三通道的特征图a。

10.特征提取网络,接收所述特征图a,并将所述特征图a通过卷积网络进行提取,用于后续的目标检测;特征图a依序经过所述特征提取网络的focus模块、cbl模块、csp1模块、cbl模块以及csp1模块后输出特征图b;特征图b依序经过所述特征提取网络的cbl模块以及csp1模块后输出特征图c;特征图c依序经过所述特征提取网络的cbl模块、sppf模块、csp2模块以及cbl模块后输出特征图d。

11.特征融合网络,对不同阶段的特征图进行混合与组合,并且将混合与组合后的特征图传递给输出端进行预测;在特征融合网络中,特征图b、特征图c以及特征图d分别与特征融合网络的不同阶段的特征图进行融合,生成不同大小的特征图f、特征图g以及特征图h至输出端进行目标检测。

12.输出端,分别对所述特征图f、特征图g以及特征图h进行一次3

×

3卷积后,通过分类损失函数和回归损失函数,输出三个不同大小的目标检测结果,所述分类损失函数采用交叉熵损失函数,所述回归损失函数采用ciou_loss。

13.优选地,所述改进yolov5s神经网络模型的训练具体包括以下步骤:

s2-1:建立交通场景数据集,所述交通场景数据集按设定比例划分为训练集与验证集。

14.s2-2:将所述训练集依序输入改进yolov5s神经网络的输入端、特征提取网络、特征融合网络以及输出端,对训练集中的路面、交通指示标志、信号灯以及交通参与者的位置与分类进行预测并输出预测结果,所述预测结果与所述验证集进行对比验证。

15.s2-3:重复步骤s2-2,直至达到设定的训练次数,保存最后一次训练的模型,作为训练好的分类神经网络模型。

16.优选地,所述输入端中mosaic数据增强操作使用四张图片以随机缩放、随机裁剪、随机排布的方式进行拼接;自适应锚框计算自适应的计算不同训练集中的最佳锚框值,针对默认锚框计算最佳召回率,如果最佳召回率低于0.98,则重新计算锚框;自适应图片缩放方法先根据输入的图像尺寸和输出的特征图尺寸分别计算宽度和高度的缩放比例,再根据缩放比例计算缩放后的实际尺寸,根据实际尺寸计算灰度填充数值,以对齐为640

×

640的输出特征图a尺寸。

17.优选地,所述特征提取网络进一步包括三组卷积,在每组卷积中加入csp模块,csp模块将特征图拆成两个部分,一部分进行卷积操作,另一部分和上一部分卷积操作的结果进行通道数增加的特征融合操作;第三组卷积中采用改进的空间金字塔池化结构。

18.优选地,所述改进的空间金字塔池化结构将输入的特征图经过一次cbl模块后分两路输出,一路串行经过三个5

×

5的最大池化层,每个最大池化层均输出一个特征图与另一路特征图进行张量拼接操作,拼接后的特征图经cbl模块后输出至csp2模块。

19.优选地,所述特征融合网络采用特征金字塔网络和路径聚合网络来聚合该阶段的图像特征,其对特征图的融合方式具体如下:特征图d经上采样操作后与特征图c进行张量拼接操作,拼接后的特征图依序经过csp2模块和cbl模块后输出特征图e,将特征图e再经过一次上采样后与特征图b进行张量拼接操作,拼接后的特征图经过一个csp2模块输出特征图f;特征图f经过一个cbl模块后与特征图e进行张量拼接操作,拼接后的特征图经过一个csp2模块输出特征图g;特征图g经过一个cbl模块后与特征图d进行张量拼接操作,拼接后的特征图经过一个csp2模块输出特征图h;所述特征图f、特征图g与特征图h作为特征融合网络的最终输出,输入至所述改进yolov5s神经网络模型的输出端。

20.优选地,所述ciou_loss算法衡量真实框和预测框之间的重合程度,ciou_loss算法设置了一个可以将真实框和预测框包裹住的最小矩形,以此评价两个框之间的距离,此矩形的对角线距离为,引入了真实框和预测框的中心点距离,以此评价两个框互相包裹的情况,引入了真实框和预测框的宽高比,以此评价两个框的中心点重合的情况,ciou_loss算法的公式如下:loss算法的公式如下:

其中,即真实框和预测框的重合程度,是真实框与预测框的交并比,是预测框的宽度,是预测框的高度,是真实框的宽度,是真实框的高度。

21.优选地,所述改进yolov5s神经网络模型将分类为车辆的已标记特征图输入车辆交通违法检测模型,所述车辆交通违法检测模型对分类为车辆的特征图进行违法判定以及车牌识别,基于车辆的行驶轨迹、路面标识、交通指示标志以及信号灯状态对车辆进行交通违法判定,若交通违法行为成立,则进一步进行车牌识别;车牌识别采用训练完成的svm模型。

22.优选地,所述改进yolov5s神经网络模型将分类为行人的已标记特征图输入行人交通违法检测模型,所述行人交通违法检测模型对分类为行人的已标记特征图进行违法判定以及人脸识别;基于行人的行动轨迹、路面标识、交通指示标志以及信号灯状态对行人进行交通违法判定,若交通违法行为成立,则进一步进行人脸识别;人脸识别采用训练完成的简化retinaface模型,所述简化retinaface模型进一步包括依序设置的主干特征提取网络、fpn特征金字塔网络、ssh特征增强网络以及人脸目标输出端。

23.基于深度学习的交通违法行为分类检测soc芯片,所述soc芯片包括通用处理器以及多个神经网络处理器,所述通用处理器通过自定义指令控制多个神经网络处理器运行,所述多个神经网络处理器进一步包括:用于图像分类的神经网络处理器、用于车辆交通违法检测的神经网络处理器以及用于行人交通违法检测的神经网络处理器,用于执行上述的方法。

24.与现有技术相比,本发明具有以下技术效果:1.利用改进yolov5s神经网络模型预先对实时采集的交通图像按照不同交通参与者进行标注以及分类,充分利用改进yolov5s神经网络模型网络深度小以及特征图宽度小的特点,减小了运算的复杂度,使得神经网络模型在轻量化的同时保持准确,将改进yolov5s神经网络模型应用于交通场景下以大目标为主进行目标检测分类,可以有效提升目标检测分类的效率。

25.2.改进yolov5s神经网络模型的体积非常小,内存使用较少,可以轻松部署在嵌入式设备中,可有效减小检测设备的复杂度,增加设备使用场景。

26.3.在改进yolov5s神经网络模型中,采用sppf模块代替spp模块,将特征图串行通过三层5

×

5最大池化层后进行张量拼接,相比spp模块中并行通过最大池化层后进行张量拼接,二者的计算结果相同,sppf模块的计算速度为spp模块的2.5倍,提高特征提取的效率。

27.4.通过训练不同的算法模型对不同的道路交通参与者的违法行为进行检测,相比通过单一神经网络模型对交通参与者进行分类、标注、识别,采用适合各阶段任务的神经网络模型,可以有效降低交通违法检测模型的算法复杂度,提高整体的检测效率,充分满足道路交通违法行为检测的实时性要求。

附图说明

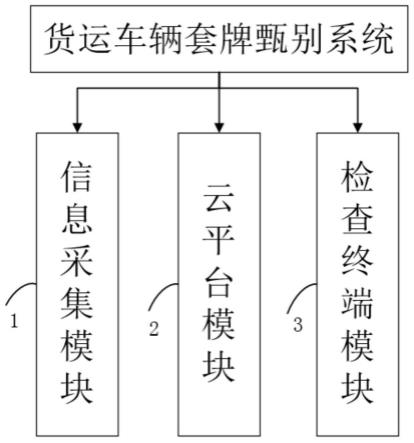

28.图1是本发明所述的基于深度学习的交通违法行为分类检测方法的流程图;图2是本发明所述的基于深度学习的交通违法行为分类检测方法的改进yolov5s模型结构示意图;图3是本发明所述的基于深度学习的交通违法行为分类检测方法的框回归算法ciou的示意图。

29.图中:1、输入端;2、特征提取网络;3、特征融合网络;4、输出端。

具体实施方式

30.为使本发明的目的、技术方案和优点更加清楚,下面将结合本技术具体实施例,并参照附图,对本发明技术方案进行清楚、完整地描述。

31.请参阅图1~3,基于深度学习的交通违法行为分类检测方法,包括以下步骤:s1:通过成像设备采集交通场景视频,成像设备包括车载的移动拍摄设备和固定的监控设备,采集的交通场景视频按视频的拍摄帧数分解为连续的多个视频帧,生成的图像用于分类神经网络模型进行目标检测与标注。

32.s2:将视频帧输入训练好的分类神经网络模型,对视频帧中的路面、交通指示标志、信号灯以及交通参与者进行标注,并按交通参与者进行分类,分别生成车辆特征图与行人特征图,分类神经网络模型采用改进yolov5s神经网络模型,相比yolov5神经网络模型,改进yolov5s神经网络模型将模型的神经网络层数和每层通道数减小,并将空间金字塔池化结构的流程改进为特征图依序通过三层最大池化层,充分利用改进yolov5s神经网络模型神经网络层数少以及特征图宽度小的特点,减小了运算的复杂度,使得神经网络模型在轻量化的同时保持准确,将改进yolov5s神经网络模型应用于交通场景下以大目标为主进行目标检测分类,可以有效提升目标检测分类的效率。

33.s3:分类神经网络模型将视频帧按交通参与者进行分类,将具有车辆标注的视频帧分类为车辆特征图,将具有行人标注的视频帧分类为行人特征图。通过对视频帧进行分类,可将不同交通参与者的交通违法图片送入相应的神经网络模型进行交通违法行为检测与交通参与者识别,可以有效提高交通违法行为检测的准确率和效率。

34.s4:将车辆特征图输入训练好的车辆交通违法检测模型,进行车辆交通违法行为判断,若判定为交通违法行为,则生成车辆交通违法图像供后续处理使用。车辆交通违法检测模型包括违法判定算法和车牌识别模型,违法判定算法根据车辆的行驶轨迹、路面标识、交通指示标识以及信号灯状态对车辆是否违法作出判定,车牌识别模型采用svm模型,通过车牌定位模块、车牌字符分割模块以及车牌字符识别模块对车牌进行识别。

35.s5:将行人特征图输入训练好的行人交通违法检测模型,进行行人交通违法行为判断,若判定为交通违法行为,则生成行人交通违法图像供后续处理使用。行人交通违法检测模型包括违法判定算法和人脸识别模型,违法判定算法根据行人的行动轨迹、路面标识、交通指示标识以及信号灯状态对车辆是否违法作出判定,人脸识别模型采用简化retinaface模型,简化retinaface模型进一步包括:主干特征提取网络、fpn特征金字塔网络、ssh特征增强网络以及人脸目标输出端。

36.改进yolov5s神经网络模型结构包括输入端1、特征提取网络2、特征融合网络3以

及输出端4。

37.输入端1(input),输入端1使用mosaic数据增强操作以提升模型的训练速度和网络的精度,并提出了一种自适应锚框计算与自适应图片缩放方法,输出分辨率为640

×

640大小rgb三通道的特征图a。

38.其中,mosaic数据增强操作使用四张图片以随机缩放、随机裁剪、随机排布的方式进行拼接,使图片能丰富检测目标的背景,同时能够提高小目标的检测效果;自适应锚框计算自适应的计算不同训练集中的最佳锚框值,针对不同的数据集,都需要设定特定长宽的锚点框,在网络训练阶段,模型在初始锚框的基础上输出对应的预测框,计算其与真实框之间的差距,并执行反向更新操作,从而更新整个网络的参数;自适应图片缩放方法先根据输入的图像尺寸和输出的特征图尺寸分别计算宽度和高度的缩放比例,再根据缩放比例计算缩放后的实际尺寸,最后根据实际尺寸计算灰度填充数值,以对齐为640

×

640的rgb三通道输出特征图a。

39.特征提取网络2(backbone),接收特征图a,并将特征图a通过卷积网络进行提取,用于后续的目标检测;特征图a依序经过特征提取网络的focus模块、cbl模块、csp1模块、cbl模块以及csp1模块后输出特征图b,此为第一组卷积;特征图b依序经过特征提取网络的cbl模块以及csp1模块后输出特征图c,此为第二组卷积;特征图c依序经过特征提取网络的cbl模块、sppf模块、csp2模块以及cbl模块后输出特征图d,此为第三组卷积。

40.其中,focus模块对输入的特征图a进行切片,特征图a并行经过四次切片操作,生成四个320

×

320

×

12的中间特征图一,将该特征图进行张量拼接后,经过一次32个卷积核的cbl模块,最终生成320

×

320

×

32的中间特征图二;cbl模块是yolov5s中最基本的模块,依序为conv卷积、bn(batch normalization,批量归一化)以及leakyrelu激活函数;由focus模块生成的中间特征图二在cbl模块中继续卷积,生成160

×

160

×

64的中间特征图三;csp模块在本实施例中设置了两种结构,csp1结构应用于特征提取网络2(backbone)中,csp2结构应用于特征融合网络3(neck)中;csp1模块将中间特征图三并行分为两路,一路依序经过cbl模块、n个残差组件(resunit)和一次卷积,与经过一次卷积的另一路进行张量拼接操作,生成的特征图经过一次bn批量归一化模块、激活函数leakyrelu以及cbl模块生成80

×

80

×

128的中间特征图四,中间特征图四再经过一次csp1模块,生成80

×

80

×

128特征图b;增加残差结构可以增加层与层之间反向传播的梯度值,避免因为加深而带来的梯度消失,从而可以提取到更细粒度的特征并且不用担心网络退化;特征图b经过第二组卷积生成特征图c,第二组卷积包括一个cbl模块和一个csp1模块,特征图b经过cbl模块后大小变为40

×

40

×

256,经过csp1模块输出同样大小的特征图c;特征图c经过第三组卷积生成特征图d,第三组卷积包括一个cbl模块、一个sppf模块、一个csp2模块和一个cbl模块,第一次经过cbl模块,特征图大小变为20

×

20

×

512,第二次经过cbl模块,生成大小为20

×

20

×

256的特征图d;sppf模块将输入的特征图经过一次cbl模块后分两路输出,一路串行经过三个5

×

5的最大池化层,每个最大池化层均输出一个特征图与另一路特征图进行张量拼接操作,拼接后的特征图经cbl模块后输出至csp2模块;csp2模块的结构与cps1模块相似,区别在于将其中n个残差组件更换为2n个cbl模块。

41.特征融合网络3(neck),对不同阶段的特征图进行混合与组合,增强网络的鲁棒性,加强物体检测能力,并且将这些特征传递给输出端进行预测;在特征融合网络中,特征图b、特征图c以及特征图d经过不同层次的融合,生成不同大小的特征图f、特征图g以及特征图h至输出端进行目标检测。具体融合过程如下:特征图d经上采样操作后与特征图c进行张量拼接操作,拼接后的中间特征图大小为40

×

40

×

512,依序经过csp2模块和cbl模块后输出大小为40

×

40

×

128的特征图e,将特征图e再经过一次上采样后与特征图b进行张量拼接操作,拼接后的中间特征图大小为80

×

80

×

256,经过一个csp2模块输出大小为80

×

80

×

128的特征图f;特征图f经过一个cbl模块后与特征图e进行张量拼接操作,拼接后的特征图大小为40

×

40

×

256,经过一个csp2模块输出大小为40

×

40

×

128的特征图g;特征图g经过一个cbl模块后与特征图d进行张量拼接操作,拼接后的特征图大小为20

×

20

×

512,经过一个csp2模块输出大小为20

×

20

×

128的特征图h;特征图f、特征图g与特征图h作为特征融合网络的最终输出,输入至改进yolov5s神经网络模型的输出端4。

42.输出端4(output),分别对特征图f、特征图g以及特征图h进行一次3

×

3卷积后,通过分类损失函数、回归损失函数以及置信度损失函数,输出三个不同大小的目标检测结果,分类损失函数采用交叉熵损失函数,用于计算锚框与对应的标定分类是否正确。回归损失函数采用ciou_loss,用于预测框与真实框之间的误差。置信度损失函数由正样本匹配得到的样本对计算,一是预测框中的目标置信度分数,二是预测框和与之对应的目标框的iou值,其作为真实框,两者计算二进制交叉熵得到最终的目标置信度损失,用于计算网络的置信度。

43.输出端4(output)采用ciou_loss算法衡量真实框和预测框之间的重合程度,ciou_loss算法设置了一个可以将真实框和预测框包裹住的最小矩形,以此评价两个框之间的距离,此矩形的对角线距离为,引入了真实框和预测框的中心点距离,以此评价两个框互相包裹的情况,引入了真实框和预测框的宽高比,以此评价两个框的中心点重合的情况,ciou_loss算法的公式如下:ciou_loss算法的公式如下:ciou_loss算法的公式如下:其中,即真实框和预测框的重合程度,是真实框与预测框的交并比,是预测框的宽度,是预测框的高度,是真实框的宽度,是真实框的高度。

44.改进yolov5s神经网络模型的训练具体包括以下步骤:s2-1:建立交通场景数据集,交通场景数据集按8:2的比例划分为训练集与验证集;交通场景数据集可采用ua-detrac 数据集,该数据集主要拍摄于北京和天津的道路过街天桥,并手动标注了8250个车辆和121万目标对象外框。车辆分为四类,即轿车、公共汽

车、厢式货车和其他车辆;天气情况分为四类,即多云、夜间、晴天和雨天。

45.s2-2:将训练集依序输入改进yolov5s神经网络的输入端1、特征提取网络2、特征融合网络3以及输出端4,对训练集中的路面、交通指示标志、信号灯以及交通参与者的位置与分类进行预测并输出预测结果,预测结果与验证集进行对比验证。

46.s2-3:重复步骤s2-2,直至达到设定的训练次数,保存最后一次训练的模型,作为训练好的分类神经网络模型。

47.改进yolov5s神经网络模型将分类为车辆的特征图输入车辆交通违法检测模型,车辆交通违法检测模型对特征图进行违法判定以及车牌识别,基于车辆的行驶轨迹、路面标识、交通指示标志以及信号灯状态对车辆进行交通违法判定,若交通违法行为成立,则进一步进行车牌识别;车牌识别采用训练完成的svm模型。利用svm模型进行车牌识别包括以下步骤:车牌定位,进行灰度转换,将彩色图片转换为灰度图像,常见的r=g=b=像素平均值;利用高斯平滑和中值滤波去除噪声;进行二值化处理,将图像转换为黑白两色,通常像素灰度值大于127设置为255,灰度值小于127则设置为0;canny边缘检测,进行闭运算与开运算,消除小的区域,保留大块的区域,从而定位车牌位置;膨胀和细化,放大图像轮廓,转换为一个个区域,这些区域内包含车牌;通过算法选择合适的车牌位置,通常将较小的区域过滤掉或寻找蓝色底的区域;标注车牌位置并提取车牌。

48.车牌字符分割,由于图像中只有黑色和白色像素,因此可以通过图像的白色像素和黑色像素来分割开字符,分别通过判断每一行每一列的黑色白色像素值的位置,来定位出字符。

49.车牌字符识别,通过训练两个svm模型分别用于识别车牌上中文省份简称以及后面的字母和数字。

50.改进yolov5s神经网络模型将分类为行人的已标记特征图输入行人交通违法检测模型,行人交通违法检测模型对特征图进行违法判定以及人脸识别;基于行人的行动轨迹、路面标识、交通指示标志以及信号灯状态对行人进行交通违法判定,若交通违法行为成立,则进一步进行人脸识别;人脸识别采用训练完成的简化retinaface模型,简化retinaface模型进一步包括依序设置的主干特征提取网络、fpn特征金字塔网络、ssh特征增强网络以及人脸目标输出端。

51.主干特征提取网络采用基于mobilenet的轻量版本mnet,检测速度更快。mnet保留了在特征金字塔网络的3层特征图,生成3个不同尺度上的检测框,每个尺度上又引入了不同尺寸的锚框大小,保证可以检测到不同大小的人脸;fpn特征金字塔网络首先利用1x1卷积对三个有效特征图进行通道数的调整,调整后利用上采样和张量相加进行上采样的特征融合,输出三个特征图c1、c2与c3;经fpn特征金字塔网络得到三个有效特征层p1、p2、p3,retinaface模型为了进一步加强特征提取,使用了ssh模块加强感受野(卷积神经网络每一层输出的特征图上的像素点映射回输入图像上的区域大小),ssh模块包含三个检测模块:detection module m3用于检测大脸,detection module m2用于检测中脸,detection module m1用于检测小脸。ssh模块通过在特征图中引入上下文信息来提高小人脸的检测,输出三个有效特征层;人脸目标输出端通过s1、s2、s3三个有效特征层来获得预测结果,预测结果分为三个:分类预测、人脸框预测、人脸关键点预测。

52.基于深度学习的交通违法行为分类检测soc芯片,soc芯片包括通用处理器以及多个神经网络处理器,通用处理器通过自定义指令控制多个神经网络处理器运行,多个神经网络处理器进一步包括:用于图像分类的神经网络处理器、用于车辆交通违法检测的神经网络处理器以及用于行人交通违法检测的神经网络处理器,用于执行上述的方法。

53.以上所述的仅是本发明的优选实施方式,应当指出,对于本领域的普通技术人员来说,在不脱离本发明创造构思的前提下,还可以做出若干变形和改进,这些都属于本发明的保护范围。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。