1.本发明涉及自然语言处理技术领域,尤其是指一种实体关系抽取方法、系统、设备及可读存储介质。

背景技术:

2.随着现代互联网的高速发展和人工智能及大数据在工业界的应用,随之产生了指数级的数据和海量信息,这些数据蕴含了许多有价值的信息,由于其中信息冗余多,信息量大,信息来源广泛以及信息结构多样性的原因,在这些无序的信息中如何挖掘这些高价值的信息变得越来越迫切,而信息抽取在挖掘信息方面变得越来越重要,它是从非结构化文本中提取结构化信息,而信息抽取中的关系抽取任务最为关键,因为它可以抽取出两个实体之间的关系。

3.关系抽取在自然语言处理中构建知识图谱等方面有着广泛的应用,知识图谱的初衷是让机器具备识别能力,推理能力,让它保存实体和实体相互连接的关系,构建其实体与关系的依赖路径。在工业界、学术界和日常生活中知识图谱被广泛应用,如在信息化推荐,问答系统,智能化搜索等方面。在智能化搜索方面通过输入文本即可得到相关问题的答案,例如现在的语音助手和聊天机器人;其次,在医学相关领域已经得到广泛的应用,例如根据症状智能寻找相似病例诊疗,可以做出更精确的治疗。关系抽取任务在生活中拥有重大的研究意义,可以极大的方便人们生活,减少生活中的繁琐事项,为生活提供智能与边界,因此对关系抽取在自然语言处理等方面被越来越多的研究者所研究,研究者通过对关系抽取性能的提升来提高关系抽取在信息化领域与工业界的医学界等应用范围。

4.现有的关系抽取方法通过卷积神经网络自动提取特征减少了大量的特征标记工作,节省了大量人力资源,但是由于卷积神经网络无法细化池化特征造成了语义信息的丢失;除此之外,还有人提出了递归神经网络模型在实体关系抽取中的应用,但其存在梯度消失和梯度爆炸的问题,且容易丢失长距离关系,难以处理长距离依赖问题。

5.综上所述,现有的关系抽取技术中存在语义信息丢失和长距离关系提取困难的问题。

技术实现要素:

6.为此,本发明所要解决的技术问题在于克服现有技术中关系抽取时语义信息丢失以及长距离关系难以提取的问题。

7.为解决上述技术问题,本发明提供了一种实体关系抽取方法,包括:

8.将待进行实体关系抽取的句子输入训练好的实体关系抽取模型中,利用所述实体关系抽取模型中的word2vec网络提取句子的特征输入向量;

9.将所述句子的特征输入向量输入到所述实体关系抽取模型中的pcnn特征提取网络中提取句子的局部特征向量;

10.将所述句子的局部特征向量输入到所述实体关系抽取模型中的bigru神经网络中

进行双向学习得到句子的目标特征向量;

11.将所述句子的目标特征向量输入所述实体关系抽取模型中的多分支注意力机制计算句子的目标特征向量权重值;

12.使用所述实体关系抽取模型中的softmax函数根据所述句子的目标特征向量权重值对句子的实体关系进行分类,得到句子中每个词被选作实体关系的概率。

13.在本发明的一个实施例中,所述利用所述实体关系抽取模型中的 word2vec网络提取句子的特征输入向量包括:

14.获取待进行实体关系抽取的句子的输入文本序列s={w1,w2,...,w

l

},其中, wi表示句子中第i个单词的编码,l表示句子的长度;

15.将所述输入文本序列输入到word2vec网络中,输出维度为d

p

的词向量,并根据所述词向量得到句子中第一实体到句子中每个词距离的文本序列 m={p1,p2,......,pm}和句子中第二实体到句子中每个词距离的文本序列 n={p1,p2,......,pn};

16.将所述文本序列m和文本序列n分别输入到word2vec网络中,输出两个维度为d

t

的词向量;

17.将维度为d

p

的词向量和两个维度为d

t

的词向量拼接得到维度为d

p

2d

t

的特征输入向量。

18.在本发明的一个实施例中,所述将所述句子的局部特征向量输入到所述实体关系抽取模型中的bigru神经网络中进行双向学习得到句子的目标特征向量的计算公式为:

19.z

t

=σ(wz*[h

t-1

,x

t

]),

[0020]rt

=σ(wr*[h

t-1

,x

t

]),

[0021][0022][0023][0024][0025][0026]

其中,r

t

是复位门,z

t

是更新门,x

t

是输入数据,wz、wr、w分别是重置门、更新门、候选隐藏状态的权重矩阵,σ是一个sigmoid函数,为候选隐藏状态的输出,h

t

是当前时刻的输出,h

t-1

是上一时刻的输出,为后向学习得到的特征向量,为前向学习得到的特征向量,为目标特征向量。

[0027]

在本发明的一个实施例中,所述将所述句子的目标特征向量输入所述实体关系抽取模型中的多分支注意力机制计算句子的目标特征向量权重值包括:

[0028]

计算句子的目标特征向量在t时刻的权重,其计算公式为:

[0029][0030]

其中,βi为初始化特征参数,为目标特征向量,z

t

为句子的目标特征向量在t时刻的权重;

[0031]

对句子的目标特征向量1至t时刻的权重求和得到句子的目标特征向量权重值,其

计算公式为:

[0032][0033]

其中,j={1,2,3,......,t},z为句子的目标特征向量权重值。

[0034]

在本发明的一个实施例中,所述句子中每个词被选作实体关系的概率的计算公式为:

[0035][0036]

其中,p(k)为句子中第k个词被选作实体关系的概率。

[0037]

在本发明的一个实施例中,所述实体关系抽取模型的训练过程为:

[0038]

采集包含不同实体与关系的句子作为训练样本,将训练样本输入 word2vec网络中得到样本的特征输入向量;

[0039]

将所述样本的特征输入向量输入到pcnn特征提取网络中提取样本的局部特征向量;

[0040]

将所述样本的局部特征向量输入到bigru神经网络中进行双向学习得到样本的目标特征向量;

[0041]

将所述样本的目标特征向量输入多分支注意力机制中计算样本的目标特征向量权重值;

[0042]

使用softmax函数根据所述样本的目标特征向量权重值对样本的实体关系进行分类,得到样本中每个词被选作实体关系的概率;

[0043]

不断调整模型参数直到损失函数收敛,得到训练好的实体关系抽取模型。在本发明的一个实施例中,所述实体关系抽取模型的损失函数为:

[0044]

l=bceloss(p(k),p(k')),

[0045]

其中,p(k)为样本中第k个词作为实体关系的真实概率,p(k')为样本中第 k个词作为实体关系的预测概率。

[0046]

本发明还提供了一种实体关系抽取系统,包括:

[0047]

输入模块,用于将待进行实体关系抽取的句子输入至训练好的实体关系抽取模型中的word2vec网络得到句子的特征输入向量;

[0048]

特征提取模块,用于利用实体关系抽取模型中的pcnn特征提取网络提取所述特征输入向量的局部特征向量;

[0049]

双向学习模块,用于利用实体关系抽取模型中的bigru网络使所述局部特征向量进行前向后向学习得到目标特征向量;

[0050]

注意力分配模块,用于利用实体关系抽取模型中的多分支注意力机制计算目标特征向量权重值;

[0051]

分类模块,用于利用实体关系抽取模型中的softmax函数对句子的实体关系进行分类,计算句子中每个词被选作实体关系的概率。

[0052]

本发明还提供了一种实体关系抽取设备,包括:

[0053]

存储器:用于存储计算机程序;

[0054]

处理器:用于执行所述计算机程序时实现所述的实体关系抽取方法的步骤。

[0055]

本发明还提供了一种计算机可读存储介质,所述计算机存储介质上存储有计算机程序,所述计算机程序被处理执行时实现所述的实体关系抽取方法的步骤。

[0056]

本发明所述的实体关系抽取方法利用word2vec网络提取句子的词向量,后引入pcnn特征提取网络可以有效地将提取到的句子特征进行特征信息采集,使句子特征信息在传递过程中保留句子前后的依赖信息,减少句子特征值在传递过程中的退化问题,再通过bigru神经网络让句子更好地充分利用句子特征信息进行识别与训练,可以更好地解决长期依赖和反向特征依赖传递问题,最后利用多分支注意力机制可以更好地识别实体与关系,得到句子中每部分与关系之间地相关性并为其分配相应的权重,让正确的关系与实体之间赋予更高的权重,使正向实体与关系增强,提升模型的关系抽取性能,本发明所提供的实体关系抽取方法在nyt,webnlg,scierc,ade数据集上均取得了很好的性能。

附图说明

[0057]

为了使本发明的内容更容易被清楚的理解,下面根据本发明的具体实施例并结合附图,对本发明作进一步详细的说明,其中

[0058]

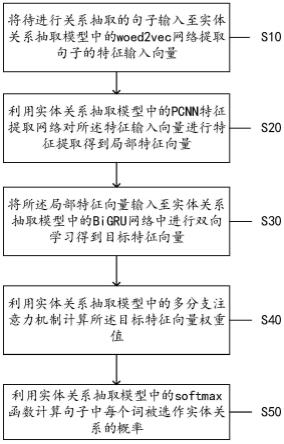

图1为实体关系抽取方法流程图;

[0059]

图2为pcnn-bigru-mulatt模型图;

[0060]

图3为实体关系抽取系统图。

具体实施方式

[0061]

下面结合附图和具体实施例对本发明作进一步说明,以使本领域的技术人员可以更好地理解本发明并能予以实施,但所举实施例不作为对本发明的限定。

[0062]

关系抽取能在非结构化、程序化的文本中提取实体之间的关系,从而为用户提供更加精准、全面的信息,实体关系抽取是抽取文本中实体之间的二元关系,并组成关系三元组的形式,例如,entity1和entity2表示两个实体,relation表示两个实体之间的关系。给定一个句子“liangsicheng isa famous chinese architect”,可以看出两个实体之间的关系为“is”。

[0063]

实施例1:

[0064]

参照图1所示,本发明实施例提供的实体关系抽取方法包括:

[0065]

s10:将待进行实体关系抽取的句子输入训练好的实体关系抽取模型中,利用所述实体关系抽取模型中的word2vec网络提取句子的特征输入向量,其具体包括:

[0066]

s100:获取待进行实体关系抽取的句子的输入文本序列s={w1,w2,...,w

l

},其中,wi表示句子中第i个单词的编码,l表示句子的长度;

[0067]

s101:将所述输入文本序列输入到word2vec模型中,输出维度为d

p

的词向量,并根据所述词向量得到句子中第一实体到句子中每个词距离的文本序列m={p1,p2,......,pm}和句子中第二实体到句子中每个词距离的文本序列 n={p1,p2,......,pn};

[0068]

s102:将所述文本序列m和文本序列n分别输入到word2vec模型中,输出两个维度为d

t

的词向量;

[0069]

s103:将维度为d

p

的词向量和两个维度为d

t

的词向量拼接得到维度为 d

p

2d

t

的特征输入向量。

white house.”中,当句子的实体关系为president时,句子中的ceremony 与white house更能体现句子中的实体关系表达,故而在多分支注意力机制让句子对词分配更大的权重;而在句子“trump is a famous americanbusiness boss.”中,句子没有能直接体现出president的词语,故而各个词语在计算与president的权重时会得到更少的权重,而当语句表达 business时,boss能得到更高的权重,从而对实体产生影响。由此,多分支注意力机制融合bigru网络更能体现实体与句子中各个词语的关系,更好的得到特征表达。

[0091]

s50:使用所述实体关系抽取模型中的softmax函数根据所述句子的目标特征向量权重值对句子的实体关系进行分类,得到句子中每个词被选作实体关系的概率,其概率计算公式为:

[0092][0093]

其中,p(k)为句子中第k个词被选作实体关系的概率。

[0094]

其中,所述实体关系抽取模型的训练过程包括:

[0095]

采集包含不同实体与关系的句子作为训练样本,将训练样本输入 word2vec网络中得到样本的特征输入向量;

[0096]

将所述样本的特征输入向量输入到pcnn特征提取网络中提取样本的局部特征向量;

[0097]

将所述样本的局部特征向量输入到bigru神经网络中进行双向学习得到样本的目标特征向量;

[0098]

将所述样本的目标特征向量输入多分支注意力机制中计算样本的目标特征向量权重值;

[0099]

使用softmax函数根据所述样本的目标特征向量权重值对样本的实体关系进行分类,得到样本中每个词被选作实体关系的概率;

[0100]

不断调整模型参数直到损失函数收敛,得到训练好的实体关系抽取模型,其中,损失函数的公式为:

[0101]

l=bceloss(p(k),p(k')),

[0102]

其中,p(k)为样本中第k个词作为实体关系的真实概率,p(k')为样本中第k个词作为实体关系的预测概率。

[0103]

本实施例提供的实体关系抽取方法基于pcnn特征提取网络与多分支注意力机制融合bigru网络,更好地处理实体特征表达,减少特征消退问题,使实体与关系能够更好的交互。

[0104]

实施例2:

[0105]

基于上述实施例提出的实体关系抽取方法,本实施例为验证该方法的效果,在四个数据集上评估了所述实体关系抽取模型,四个数据集分贝为nyt、 webnlg、ade、scierc,各个数据集所对应的训练集、验证集、测试集以及各个实体和关系种类的大小如表1所示:

[0106]

表1

[0107][0108]

scierc数据集是来自500篇的人工智能相关论文的摘要部分,一共拥有 2687条数据,而其中的训练数据集有1861条相关数据,测试数据集有551 条数据,验证数据集有275条数据;该数据集中一共有六种类型的实体与7 种类型的关系。

[0109]

ade数据集,该数据集描述的是药物使用所引起不良反应的医疗报告中整理得到的,其中包含了4272条数据,在该数据集上面原模型使用了10倍交叉验证的方法进行验证,在本文的实验中并灭有与之前的验证方法保持一致,而是从训练集中随机采样403条数据作为验证集;该数据集中总共只有一种关系类型和两种实体类型,包含有6821个关系。

[0110]

webnlg数据集中,训练集有5019条数据,测试集有703条数据,验证集有500条数据,关系类型有170种。

[0111]

在nyt和webnlg数据集中没有标准实体类型,故将实体类型的标签设置为“none”,因此在nyt和webnlg数据集中不会预测实体类型。

[0112]

本实施例中采用精确率p、召回率r、f值来评估本模型,在关系抽取中,实体之间的关系类型都正确时才能得到关系抽取正确,其中,精确率p、召回率r、f值的计算公式分别为:

[0113][0114][0115][0116]

其中,tp表示正样本预测为正的样本数量,fp表示负样本预测为正的样本数量,fn表示将正样本预测为负的样本数量。

[0117]

在本实施例中,实体关系抽取的模型参数如表2所示:

[0118]

表2

[0119][0120]

为验证本方法的优越性,本实施例还提供了cnn one模型和cnn att模型与本发明所采用的pcnn_bigru_mulatt模型在不同验证集上的对比分析结果:

[0121]

cnn one:该模型使用卷积神经网络来进行句子的特征提取,然后通过使用多个实例来缓解标签的错误问题,one相当于句子实例中只选取其中的一个句子来进行特征表示;

[0122]

cnn att:该模型是由cnn模块和attention机制模块组合而得到的,使用的是分段卷积神经网络与注意力机制相结合的关系抽取模型,使用cnn来提取特征,然后使用注意力机制为句子中的各部分与目标关系赋予相应的权重信息。

[0123]

三种模型在nyt数据集上的实验结果如表3所示:

[0124]

表3

[0125]

模型种类prfcnn one78.568.976.4cnn att80.275.478.9pcnn_bigru_mulatt84.681.482.3

[0126]

三种模型在webnlg数据集上的实验结果如表4所示:

[0127]

表4

[0128]

模型种类prfcnn one80.575.779.3cnn att85.182.084.2pcnn_bigru_mulatt87.584.385.3

[0129]

三种模型在ade数据集上的实验结果如表5所示:

[0130]

表5

[0131]

模型种类prfcnn one83.177.682.9cnn att87.084.685.8pcnn_bigru_mulatt91.586.388.7

[0132]

三种模型在scierc数据集上的试验结果如表6所示:

[0133]

表6

[0134]

模型种类prfcnn one55.752.054.9cnn att67.261.366.1pcnn_bigru_mulatt69.267.968.2

[0135]

由表3、表4、表5、表6可以看出,本发明提供的模型中在各个数据集上进行实体关系抽取时的准确率、召回率以及准确联系和召回率的调和平均数均优于其余两种模型;本发明提供的模型可以很好的解决实体与关系间的特征信息交互不平衡的问题,后续提取的关系特征与先提取的实体特征没有直接联系,错误信息特征传播等问题。

[0136]

本发明的具体实施例还提供了一种实体关系抽取系统,如图3所示,其包括:

[0137]

输入模块100,用于将待进行实体关系抽取的句子输入至训练好的实体关系抽取模型中的word2vec网络得到句子的特征输入向量;

[0138]

特征提取模块200,用于利用实体关系抽取模型中的pcnn特征提取网络提取所述特征输入向量的局部特征向量;

[0139]

双向学习模块300,用于利用实体关系抽取模型中的bigru网络使所述局部特征向量进行前向后向学习得到目标特征向量;

[0140]

注意力分配模块400,用于利用实体关系抽取模型中的多分支注意力机制计算目标特征向量权重值;

[0141]

分类模块500,用于利用实体关系抽取模型中的softmax函数对句子的实体关系进行分类,计算句子中每个词被选作实体关系的概率。

[0142]

所述实体关系抽取系统用于实现前述的实体关系抽取方法,因此实体关系抽取系统的具体实施方式可见前文中的实体关系抽取方法的实施例部分,例如,输入模块100用于实现上述实体关系抽取方法中的步骤s10,特征提取模块200用于实现上述实体关系抽取方法中的步骤s20,双向学习模块300 用于实现上述实体关系抽取方法中的步骤s30,注意力分配模块400用于实现上述实体关系抽取方法中的步骤s40,分类模块500用于实现上述实体关系抽取方法中的步骤s50,所以具体实施方法可以参照相应的实施例的描述,在此不再赘述。

[0143]

本发明的具体实施例还提供了一种实体关系抽取设备,包括:

[0144]

存储器:用于存储计算机程序;

[0145]

处理器:用于执行所述计算机程序时实现上述的实体关系抽取方法的步骤。

[0146]

本发明的具体实施例还提供了一种计算机可读存储介质,所述计算机存储介质上存储有计算机程序,所述计算机程序被处理执行时及实现上述的实体关系抽取方法的步骤。

[0147]

本领域内的技术人员应明白,本技术的实施例可提供为方法、系统、或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。

[0148]

本技术是参照根据本技术实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

[0149]

这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

[0150]

这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

[0151]

显然,上述实施例仅仅是为清楚地说明所作的举例,并非对实施方式的限定。对于所属领域的普通技术人员来说,在上述说明的基础上还可以做出其它不同形式变化或变动。这里无需也无法对所有的实施方式予以穷举。而由此所引伸出的显而易见的变化或变动仍处于本发明创造的保护范围之中。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。