1.本发明涉及计算机技术领域,具体提供一种图像识别方法、图像审核方法及电子设备。

背景技术:

2.现有很多场景下需要对用户的多种证件进行审核,仅依靠人工审核存在效率低、容易出现遗漏或误检的问题,另外,现有技术中有通过获取证件图像,基于ocr(optical chatacter recognition,光学字符识别)技术对证件图像进行信息提取,以用于相关信息的审核。

3.然而,现有技术ocr技术对证件图像进行信息提取时,都是基于同一ocr模型、无差别的对不同种类的证件的证件图像分别进行信息提取,存在效率低的问题,另外,在出现图像倾斜的问题时仅能通过倾斜矫正预处理来解决,模型鲁棒性差。

技术实现要素:

4.本发明旨在解决上述技术问题,即,解决现有基于同一图像识别模型对不同类型的待识别图像分别进行信息提取,图像识别效率低且鲁棒性差的问题。

5.在第一方面,本发明提供一种图像识别方法,其包括:

6.针对每个所述待识别图像,根据所述待识别图像的图像类型确定与所述待识别图像对应的图像识别模型,并将所述待识别图像输入与所述待识别图像对应的所述图像识别模型,以利用所述图像识别模型得到所述待识别图像的识别结果;

7.其中,利用所述图像识别模型得到所述待识别图像的识别结果包括:

8.获取所述待识别图像的文本框并获取所述文本框的两个对角顶点坐标、偏转角度和文字信息;其中,所述两个对角顶点坐标包括左上角顶点坐标和右下角顶点坐标;

9.根据与所述图像类型对应的目标识别内容,从获取到的所述文本框中筛选出所述文字信息为所述目标识别内容的第一文本框;

10.根据所述图像类型、所述第一文本框的所述文字信息、所述两个对角顶点坐标和所述偏转角度确定捕捉区域;

11.针对所述待识别图像对应的文本框中除所述第一文本框之外的其余文本框,从所述其余文本框中筛选出位于所述捕捉区域内的第二文本框,所述第二文本框对应的所述文字信息与所述目标识别内容匹配;

12.至少根据所述第一文本框的所述文字信息和所述第二文本框的所述文字信息得到所述待识别图像的识别结果。

13.在一些实施例中,所述根据所述图像类型、所述第一文本框的所述文字信息、所述两个对角顶点坐标和所述偏转角度确定捕捉区域,包括:

14.确定与所述图像类型、所述第一文本框的所述文字信息、所述两个对角顶点坐标以及所述偏转角度对应的所述预设经验值,其中,所述左上角顶点坐标包括左上角顶点的

第一方向坐标和第二方向坐标,所述右下角顶点坐标包括右下角顶点的第一方向坐标和第二方向坐标,所述预设经验值包括第一经验值、第二经验值、第三经验值和第四经验值;

15.根据所述第一文本框的所述右下角顶点的第一方向坐标和所述第一经验值,确定所述捕捉区域的第一顶点的第一方向坐标,所述第一顶点为所述捕捉区域距离所述第一文本框的所述左上角顶点距离最近的顶点;

16.根据所述右下角顶点的第一方向坐标和所述第二经验值,确定所述捕捉区域的第二顶点的第一方向坐标;所述第二顶点为所述第一顶点的对角顶点;

17.根据所述第一顶点的第一方向坐标、所述左上角顶点的第一方向坐标、所述左上角顶点的第二方向坐标、所述偏转角度以及所述第三经验值,确定所述第一顶点的第二方向坐标;

18.根据所述第二顶点的第一方向坐标、所述右下角顶点的第一方向坐标、所述右下角顶点的第二方向坐标、所述偏转角度以及所述第四经验值,确定所述第二顶点的第二方向坐标;

19.根据所述第一顶点的第一方向坐标和第二方向坐标以及所述第二顶点的第一方向坐标和第二方向坐标确定所述捕捉区域。

20.在一些实施例中,通过以下表达式确定所述捕捉区域:

21.m

a1

=a

a2-t122.m

b1

=a

b1-(m

a1-a

a1

)

·

tanθ-t323.m

a2

=a

a2

t224.m

b2

=a

b2-(m

a2-a

a2

)

·

tanθ t425.其中,m

a1

和m

b1

分别表示所述第一顶点的第一方向坐标和第二方向坐标,m

a2

和m

b2

分别表示所述第二顶点的第一方向坐标和第二方向坐标,a

a1

和a

b1

分别表示所述左上角顶点的第一方向坐标和第二方向坐标,a

a2

和a

b2

分别表示所述右下角顶点的第一方向坐标和第二方向坐标,θ表示所述偏转角度,t1表示所述第一经验值,t2表示所述第二经验值,t3表示所述第三经验值,t4表示所述第四经验值。

26.在一些实施例中,所述根据所述图像类型、所述第一文本框的所述文字信息、所述两个对角顶点坐标和所述偏转角度确定捕捉区域之前,所述方法还包括:

27.针对每种所述图像类型,基于不同偏转角度下的所述第一文本框和所述第二文本框,分别设置覆盖所述第二文本框的实际捕捉区域;

28.获取所述第一文本框的所述两个对角顶点坐标以及所述实际捕捉区域的第三顶点和第四顶点的坐标,所述第三顶点为所述实际捕捉区域距离所述第一文本框的左上角顶点距离最近的顶点,所述第四顶点为所述第三顶点的对角顶点;

29.根据所述偏转角度、所述第一文本框的所述两个对角顶点坐标、所述第三顶点和所述第四顶点的坐标,确定所述预设经验值并将所述预设经验值与所述图像类型、所述第一文本框的所述文字信息、所述偏转角度和所述两个对角顶点坐标对应存储。

30.在一些实施例中,所述根据所述偏转角度、所述第一文本框的所述两个对角顶点坐标、所述第三顶点和所述第四顶点的坐标,确定所述预设经验值,包括:

31.根据第一辅助线和第一延长线的交点确定第一交点,所述第一辅助线过所述实际捕捉区域的所述第三顶点并与第二方向平行,所述第一延长线为过所述第一文本框的所述

左上角顶点和右上角顶点的延长线;

32.根据第二辅助线和第二延长线的交点确定第二交点,所述第二辅助线过所述实际捕捉区域的所述第四顶点并与所述第二方向平行,所述第二延长线过所述第一文本框的右下角顶点且所述第二延长线的倾斜角等于所述偏转角度;

33.根据所述第一交点、所述第二交点、所述预设经验值、所述偏转角度构建所述实际捕捉区域和所述第一文本框的位置关系模型;

34.基于所述位置关系模型,根据所述第一文本框的所述两个对角顶点坐标以及所述实际捕捉区域的所述第三顶点和所述第四顶点的坐标确定所述预设经验值;

35.其中,所述预设经验值包括第一经验值、第二经验值、第三经验值和第四经验值,所述位置关系模型表示为:

36.m

a01

=a

a2-t137.m

b01

=e

b-t338.eb=a

b1-(m

a01-a

a1

)

·

tanθ

39.m

a02

=a

a2

t240.m

b02

=fb t441.fb=a

b2-(m

a02-a

a2

)

·

tanθ

42.其中,m

a01

和m

b01

分别表示所述实际捕捉区域的所述第三顶点的第一方向坐标和第二方向坐标,m

a02

和m

b02

分别表示所述实际捕捉区域的所述第四顶点的第一方向坐标和第二方向坐标,eb表示所述第一交点的第二方向坐标,fb表示所述第二交点的第二方向坐标,a

a1

和a

b1

分别表示所述左上角顶点的第一方向坐标和第二方向坐标,a

a2

和a

b2

分别表示所述右下角顶点的第一方向坐标和第二方向坐标,θ表示所述偏转角度,t1表示所述第一经验值,t2表示所述第二经验值,t3表示所述第三经验值,t4表示所述第四经验值。

43.在一些实施例中,所述图像识别模型包括文本检测子模型和文字识别子模型,所述获取待识别图像的文本框并获取所述文本框的两个对角顶点坐标、偏转角度和文字信息,包括:

44.将所述待识别图像输入文本检测子模型,得到所述待识别图像的文本框区域图以及所述文本框区域图中每个所述文本框的所述两个对角顶点坐标和所述偏转角度;

45.将所述文本框区域图输入文字识别模型,得到所述文本框对应的文字信息。

46.在第二方面,本发明提供了一种图像审核方法,其包括:

47.应用上述任意一项所述的图像识别方法对待审核图像集中每个待审核图像进行图像识别,得到每个所述待审核图像的识别结果;

48.针对每个所述待审核图像,根据所述待审核图像的识别结果以及与所述待审核图像的图像类型相对应的审核模式,对所述待审核图像进行审核。

49.在一些实施例中,所述根据所述待审核图像的识别结果以及与所述待审核图像的图像类型相对应的审核模式,对所述待审核图像进行审核,包括:

50.当所述审核模式为信息匹配时,获取与所述待审核图像的图像类型对应的预存储信息;

51.将所述待审核图像的识别结果与所述预存储信息进行匹配,根据匹配结果对所述待审核图像进行审核。

52.在第三方面,本发明提供了一种计算机可读存储介质,所述计算机可读存储介质中存储有计算机程序,所述计算机程序被处理器执行时实现上述任意一项所述的图像识别方法或所述的图像审核方法。

53.在第四方面,本发明提供了一种电子设备,其包括存储器和处理器,所述存储器中存储有计算机程序,所述计算机程序被所述处理器执行时实现上述任意一项所述的图像识别方法或所述的图像审核方法。

54.在采用上述技术方案的情况下,本发明能够获取待识别图像集中每个待识别图像的图像类型并根据每个待识别图像的图像类型分别调用与待识别图像对应的图像识别模型,以利用图像识别模型得到相应待识别图像的识别结果。其中,利用图像识别模型对待识别图像进行识别时,能够从待识别图像的文本框中确定出文字信息为目标识别内容的第一文本框,其中目标识别内容与图像类型对应,根据图像类型、第一文本框的文字信息、两个对角定点坐标和偏转角度确定出捕捉区域,并根据捕捉区域筛选出文字信息与目标识别内容匹配的第二文本框,从而可至少根据第一文本框的文字信息和第二文本框的文字信息得到识别结果。该方法可以同时对多种不同图像类型的待识别图像进行识别,并针对不同图像类型采用与图像类型对应的图像识别模型,有效的提高了识别效率。另外,可以基于图像类型、偏转角度等确定捕捉区域,由捕捉区域确定与第一文本框匹配的第二文本框,适用于倾斜情况下的待识别图像,有效提高了图像识别的鲁棒性。

55.另外,本发明提供的图像识别方法还可以应用于图像审核方法中,从而能够有效提高审核效率和准确性。

附图说明

56.下面结合附图来描述本发明的优选实施方式,附图中:

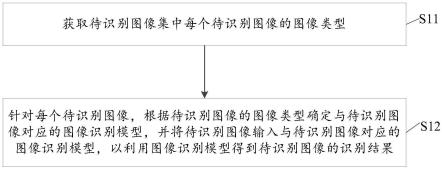

57.图1是本发明实施例提供的一种图像识别方法的流程示意图;

58.图2是本发明实施例提供的基于图像识别模型得到待识别图像识别结果的方法流程示意图;

59.图3是本发明具体示例提供的待识别图像示意图;

60.图4是本发明实施例提供的确定预设经验值的方法流程示意图;

61.图5是本发明实施例提供的样本图像示意图;

62.图6是本发明实施例提供的另一样本图像示意图;

63.图7是本发明实施例提供的一种图像审核方法的流程示意图。

具体实施方式

64.下面参照附图来描述本发明的一些实施方式。本领域技术人员应当理解的是,这些实施方式仅仅用于解释本发明的技术原理,并非旨在限制本发明的保护范围

65.现有技术ocr技术对证件图像进行信息提取时,都是基于同一ocr模型、无差别的对不同种类的证件的证件图像分别进行信息提取,存在效率低的问题,另外,在出现图像倾斜的问题时仅能通过倾斜矫正预处理来解决,模型鲁棒性差。

66.有鉴于此,本发明提供了一种图像识别方法,通过获取待识别图像集中每个待识别图像的图像类型并根据每个待识别图像的图像类型分别调用与待识别图像对应的图像

识别模型,以利用图像识别模型得到相应待识别图像的识别结果。其中,利用图像识别模型对待识别图像进行识别时,能够从待识别图像的文本框中确定出文字信息为目标识别内容的第一文本框,其中目标识别内容与图像类型对应,根据图像类型、第一文本框的文字信息、两个对角定点坐标和偏转角度确定出捕捉区域,并根据捕捉区域筛选出文字信息与目标识别内容匹配的第二文本框,从而可至少根据第一文本框的文字信息和第二文本框的文字信息得到识别结果。该方法可以同时对多种不同图像类型的待识别图像进行识别,并针对不同图像类型采用与图像类型对应的图像识别模型,有效的提高了识别效率。另外,可以基于图像类型、偏转角度等确定捕捉区域,由捕捉区域确定与第一文本框匹配的第二文本框,适用于倾斜情况下的待识别图像,有效提高了图像识别的鲁棒性。

67.参见图1所示,图1是本发明实施例提供的一种图像识别方法的流程示意图,其可以包括:

68.步骤s11:获取待识别图像集中每个待识别图像的图像类型;

69.步骤s12:针对每个待识别图像,根据待识别图像的图像类型确定与待识别图像对应的图像识别模型,并将待识别图像输入与待识别图像对应的图像识别模型,以利用图像识别模型得到待识别图像的识别结果。

70.在一些实施例中,步骤s11可以具体为采用预先训练好的分类器对待识别图像集中每个待识别图像进行分类并得到每个待识别图像的图像类型。

71.作为示例,图像类型可以包括身份证、银行卡、营业执照、确认书和合同中的至少一种。

72.不同的图像类型对应不同的文本模板,基于此,在一些实施例中,不同的图像类型可以对应不同的图像识别模型。从而可以同时对多种不同图像类型的待识别图像进行识别,并针对不同图像类型采用与图像类型对应的图像识别模型,有效的提高了识别效率。

73.其中,参见图2所示,图2是本发明实施例提供的基于图像识别模型得到待识别图像识别结果的方法流程示意图,其可以包括:

74.步骤s21:获取待识别图像的文本框并获取文本框的两个对角顶点坐标、偏转角度和文字信息;其中,两个对角顶点坐标包括左上角顶点坐标和右下角顶点坐标;

75.步骤s22:根据与图像类型对应的目标识别内容,从获取到的文本框中筛选出文字信息为目标识别内容的第一文本框;

76.步骤s23:根据图像类型、第一文本框的文字信息、两个对角顶点坐标和偏转角度确定捕捉区域;

77.步骤s24:针对待识别图像对应的文本框中除第一文本框之外的其余文本框,从其余文本框中筛选出位于捕捉区域内的第二文本框,第二文本框对应的文字信息与目标识别内容匹配;

78.步骤s25:至少根据第一文本框的文字信息和第二文本框的文字信息得到待识别图像的识别结果。

79.参见图3所示,图3是本发明具体示例提供的待识别图像示意图,可以建立0-xy二维坐标系,分别得到待识别图像的中文本框a和文本框b在该二维坐标系下的两个对角顶点坐标,文本框a的两个对角顶点坐标可表示为:左上角顶点坐标为(a

x1

,a

y1

),右下角顶点坐标为(a

x2

,a

y2

),偏转角度θ1;文本框b的两个对角顶点坐标可表示为:左上角顶点坐标为

(b

x1

,b

y1

),右下角顶点坐标为(b

x2

,b

y2

),偏转角度θ2。

80.在一些实施例中,步骤s21可以具体为根据预先存储的数据,直接获取待识别图像的文本框以及文本框的两个对角顶点坐标、偏转角度和文字信息。

81.在另一些实施例中,图像识别模型可以包括文本检测子模型和文字识别子模型,步骤s21可以具体为:

82.将待识别图像输入文本检测子模型,得到待识别图像的文本框区域图以及文本框区域图中每个文本框的两个对角顶点坐标和偏转角度。

83.将文本框区域图输入文字识别子模型,得到文本框对应的文字信息。

84.作为示例,文本检测子模型可以采用dbnet(differentiable binarization net)模型;文字识别模型子可以采用densenet模型。

85.其中,文本框的两个对角顶点坐标、偏转角度和文字信息可以以列表的方式存储,以图3为例,得到的列表可以表示为{[(a

x1

,a

y1

),(a

x2

,a

y2

),angle_θ1,text_“法定代表人”],[(b

x1

,b

y1

),(b

x2

,b

y2

),angle_θ2,text_“李明”]}。

[0086]

在一些实施例中,步骤s22可以具体为:根据与图像类型对应的目标识别内容,采用遍历的方法从获取到的待识别图像的多个文本框中筛选出文字信息为目标识别内容的文本框,并将该文本框作为第一文本框。

[0087]

作为示例,图像类型为身份证时对应的目标识别内容为身份证号、姓名和性别中的至少一种;图像类型为营业执照时对应的目标识别内容为住所、法定代表人、注册号和企业类型中的至少一种。以图3作为示例,当需要对营业执照中的法定代表人进行识别时,可以将“法定代表人”作为目标识别内容,将与“法定代表人”对应的文本框a作为第一文本框,将“李明”作为与“法定代表人”匹配的另一目标识别内容。

[0088]

在一些实施例中,步骤s23中根据图像类型、第一文本框的文字信息、两个对角顶点坐标和偏转角度确定捕捉区域,包括:

[0089]

确定与图像类型、第一文本框的文字信息、两个对角顶点坐标以及偏转角度对应的预设经验值,其中,左上角顶点坐标包括左上角顶点的第一方向坐标和第二方向坐标,右下角顶点坐标包括右下角顶点的第一方向坐标和第二方向坐标,预设经验值包括第一经验值、第二经验值、第三经验值和第四经验值;

[0090]

根据第一文本框的右下角顶点的第一方向坐标和第一经验值,确定捕捉区域的第一顶点的第一方向坐标,第一顶点为捕捉区域距离第一文本框的左上角顶点距离最近的顶点;

[0091]

根据右下角顶点的第一方向坐标和第二经验值,确定捕捉区域的第二顶点的第一方向坐标;第二顶点为第一顶点的对角顶点;

[0092]

根据第一顶点的第一方向坐标、左上角顶点的第一方向坐标、左上角顶点的第二方向坐标、偏转角度以及第三经验值,确定第一顶点的第二方向坐标;

[0093]

根据第二顶点的第一方向坐标、右下角顶点的第一方向坐标、右下角顶点的第二方向坐标、偏转角度以及第四经验值,确定第二顶点的第二方向坐标;

[0094]

根据第一顶点的第一方向坐标和第二方向坐标以及第二顶点的第一方向坐标和第二方向坐标确定捕捉区域。

[0095]

其中,可预先基于相互垂直的第一方向和第二方向构建二维坐标系,以图3为例,

第一方向可以为x方向,第二方向可以为y方向,从而得到文本框在相应坐标系下的两个对角顶点坐标。

[0096]

在一些实施例中,可以通过以下表达式确定捕捉区域:

[0097]ma1

=a

a2-t1[0098]mb1

=a

b1-(m

a1-a

a1

)

·

tanθ-t3[0099]ma2

=a

a2

t2[0100]mb2

=a

b2-(m

a2-a

a2

)

·

tanθ t4[0101]

其中,m

a1

和m

b1

分别表示第一顶点的第一方向坐标和第二方向坐标,m

a2

和m

b2

分别表示第二顶点的第一方向坐标和第二方向坐标,a

a1

和a

b1

分别表示左上角顶点的第一方向坐标和第二方向坐标,a

a2

和a

b2

分别表示右下角顶点的第一方向坐标和第二方向坐标,θ表示偏转角度,t1表示第一经验值,t2表示第二经验值,t3表示第三经验值,t4表示第四经验值。

[0102]

在本发明实施例中,参见图4所示,在步骤s23之前可以通过以下步骤确定预设经验值:

[0103]

步骤s41:针对每种图像类型,基于不同偏转角度下的第一文本框和第二文本框,分别设置覆盖第二文本框的实际捕捉区域;

[0104]

步骤s42:获取第一文本框的两个对角顶点坐标以及实际捕捉区域的第三顶点和第四顶点的坐标,第三顶点为实际捕捉区域距离第一文本框的左上角顶点距离最近的顶点,第四顶点为第三顶点的对角顶点;

[0105]

步骤s43:根据偏转角度、第一文本框的两个对角顶点坐标、第三顶点和第四顶点的坐标,确定预设经验值并将预设经验值与图像类型、第一文本框的文字信息、偏转角度和两个对角顶点坐标对应存储。

[0106]

参见图5所示,图5示出了本发明实施例提供的样本图像示意图,可以基于该样本图像确定预设经验值。

[0107]

以相互垂直的第一方向a和第二方向b建立二维坐标系,该样本图像中包括第一文本框c和第二文本框d,实际捕捉区域为虚线矩形框。其中,可以获取到第一文本框c的两个对角顶点坐标分别为(a

a1

,a

b1

)和(a

a2

,a

b2

),第二文本框d的两个对角顶点坐标分别为(b

a1

,b

b1

)和(b

a2

,b

b2

),第一文本框c和第二文本框d的偏转角度均为θ,实际捕捉区域的第三顶点坐标为(m

a01

,m

b01

)和(m

a02

,m

b02

)。

[0108]

在一些实施例中,步骤s41可以具体为在保证实际捕捉区域可以完全覆盖第二文本框且不会覆盖到其他文本框的前提下,根据需要调整实际捕捉区域的大小。其中,实际捕捉区域可以为矩形且与第一文本框的偏转角度相同。在其他实施例中,捕捉区域也可以呈其他形状。

[0109]

在一些实施例中,步骤s43中根据偏转角度、第一文本框的两个对角顶点坐标、第三顶点和第四顶点的坐标,确定预设经验值,包括:

[0110]

根据第一辅助线和第一延长线的交点确定第一交点,第一辅助线过实际捕捉区域的第三顶点并与第二方向平行,第一延长线为过第一文本框的左上角顶点和右上角顶点的延长线;

[0111]

根据第二辅助线和第二延长线的交点确定第二交点,第二辅助线过实际捕捉区域的第四顶点并与第二方向平行,第二延长线过第一文本框的右下角顶点且第二延长线的倾

斜角等于偏转角度;

[0112]

根据第一交点、第二交点、预设经验值、偏转角度构建实际捕捉区域和第一文本框的位置关系模型;

[0113]

基于位置关系模型,根据第一文本框的两个对角顶点坐标以及实际捕捉区域的第三顶点和第四顶点的坐标确定预设经验值;

[0114]

其中,预设经验值包括第一经验值、第二经验值、第三经验值和第四经验值,位置关系模型表示为:

[0115]ma01

=a

a2-t1[0116]mb01

=e

b-t3[0117]

eb=a

b1-(m

a01-a

a1

)

·

tanθ

[0118]ma02

=a

a2

t2[0119]mb02

=fb t4[0120]

fb=a

b2-(m

a02-a

a2

)

·

tanθ

[0121]

其中,m

a01

和m

b01

分别表示实际捕捉区域的第三顶点的第一方向坐标和第二方向坐标,m

a02

和m

b02

分别表示实际捕捉区域的第四顶点的第一方向坐标和第二方向坐标,eb表示第一交点的第二方向坐标,fb表示第二交点的第二方向坐标,a

a1

和a

b1

分别表示左上角顶点的第一方向坐标和第二方向坐标,a

a2

和a

b2

分别表示右下角顶点的第一方向坐标和第二方向坐标,θ表示偏转角度,t1表示第一经验值,t2表示第二经验值,t3表示第三经验值,t4表示第四经验值。

[0122]

参见图6所示,其中可以过第一文本框c的左上角顶点做第一辅助线的垂线,第一交点e、第一文本框c的左上角顶点以及该垂线和第一辅助线的交点可构成一个直角三角形,其中第一延长线和该垂线的夹角等于偏转角度θ,基于此可以确定出位置关系模型中的关系式:eb=a

b1-(m

a01-a

a1

)

·

tanθ。

[0123]

类似的,可以过第一文本框c的右下角顶点做第二辅助线的垂线,第二交点f、第一文本框c的右下角顶点以及该垂线和第二辅助线的交点可以构成一个直角三角形,其中第二延长线和该垂线的夹角等于偏转角度θ,基于此可以确定出位置关系模型中的关系式fb=a

b2-(m

a02-a

a2

)

·

tanθ。

[0124]

在一些实施例中,步骤s24可以具体为:

[0125]

根据捕捉区域的第一顶点的第一方向坐标m

a1

和第二顶点的第一方向坐标m

a2

,判断除第一文本框之外的其与文本框中左上角顶点的第一方向坐标小于m

a1

且右下角顶点的第一方向坐标大于m

a2

的文本框,并将该文本框作为第二文本框。

[0126]

作为示例,当第一文本框的文字信息为“法定代表人”,对应确定出文字信息为法定代表人具体姓名“李明”的文本框作为第二文本框;当第一文本框的文字信息为“身份证号”,对应确定出文字信息为具体身份证号数字的文本框作为第二文本框。

[0127]

在一些实施例中,步骤s25可以具体为:当得到一个第二文本框时,将第一文本框的文字信息和第二文本框的文字信息拼接成字典,得到待识别图像的识别结果。

[0128]

作为示例,第一文本框的文字信息为“法定代表人”,第二文本框的文字信息为“李明”,从而可以得到字典为{“法定代表人”:“李明”}。

[0129]

在另一些实施例中,步骤s25可以具体为:当得到多个第二文本框时,根据每个第

二文本框的左上角顶点或右下角顶点与第一文本框的左上角顶点或右下角顶点之间的距离由近至远对多个第二文本框进行排序;

[0130]

基于多个第二文本框排序后的顺序,将第一文本框的文字信息和多个第二文本框的文字信息拼接成字典,得到待识别图像的识别结果。

[0131]

作为示例,根据多个第二文本框的左上角顶点与第一文本框的左上角顶点的距离由近至远对多个第二文本框进行排序,得到第二文本框b1《第二文本框b2《第二文本框b3,第一文本框的文字信息和多个第二文本框的文字信息拼接成字典后可以得到{text_a:text_b1 text_b2 text_b3}。

[0132]

在另一些实施例中,步骤s25可以具体为:当得到多个第二文本框时,根据多个第二文本框的左上角顶点或右下角顶点的第一方向坐标大小进行排序;或者,根据多个第二文本框的左上角顶点或右下角顶点的第二方向坐标大小进行排序;

[0133]

将第一文本框的文字信息和排序后的多个第二文本框的文字信息拼接成字典,得到待识别图像的识别结果。

[0134]

其中,可以根据第一文本框和第二文本框的相对位置来确定多个第二文本框的排序方式。作为示例,当第一文本框在第二文本框的左侧,且第一文本框的左上角顶点的第一方向坐标小于所有第二文本框的左上角顶点的第一方向坐标,可根据第二文本框的左上角顶点的第一方向坐标从小到大对多个第二文本框进行排序。

[0135]

该方法可以基于图像类型、偏转角度等确定捕捉区域,由捕捉区域确定与第一文本框匹配的第二文本框,适用于倾斜情况下的待识别图像,有效提高了图像识别的鲁棒性。

[0136]

参见图7所示,图7是本发明实施例提供的一种图像审核方法的流程示意图,其可以包括:

[0137]

步骤s71:应用如上任一实施例所述的图像识别方法对待审核图像集中每个待审核图像进行图像识别,得到每个待审核图像的识别结果;

[0138]

步骤s72:针对每个待审核图像,根据待审核图像的识别结果以及与待审核图像的图像类型相对应的审核模式,对待审核图像进行审核。

[0139]

在一些实施例中,步骤s72可以具体为:

[0140]

当审核模式为信息匹配时,获取与待审核图像的图像类型对应的预存储信息;将待审核图像的识别结果与预存储信息进行匹配,根据匹配结果对待审核图像进行审核。

[0141]

当匹配结果为匹配成功时,待审核图像通过审核;当匹配结果为匹配失败时,待审核图像审核失败。

[0142]

在另一些实施例中,步骤s72还可以具体为:

[0143]

针对每种图像类型的待审核图像,根据待审核图像中每个第二文本框对应的文字信息确定与该文字信息对应的审核模式,其中,审核模式可以包括信息匹配和/或条件匹配。

[0144]

当审核模式为信息匹配时,从与图像类型对应的预存储信息中获取与第二文本框对应的预存储文字信息,并判断识别出的第二文本框的文字信息和预存储文字信息是否一致,如果一致,匹配成功,通过审核;如果不一致,匹配失败,审核失败。

[0145]

当审核模式为条件匹配时,判断第二文本框对应的文字信息是否满足预设条件,作为示例,当第二文本框对应的文字信息为日期时,可以判断该日期是否在有效期内,根据

判断结果确定审核是否通过。

[0146]

以上为本发明实施例提供的一种图像审核方法,其可以实现同时对多种不同图像类型的待审核图像进行审核,并针对每种图像类型调用与该图像类型对应的图像识别模型以及审核模式,在提高审核速度的同时可以有效提高审核精确度,另外,该方法基于上述实施例中所述的图像识别模型进行待审核图像的识别,可以有效提高图像识别的鲁棒性,进一步提高了审核准确性。

[0147]

本发明的另一方面还提供了一种计算机可读存储介质,该计算机可读存储介质中存储有计算机程序,计算机程序被处理器执行时能够实现上述任一实施例中的图像识别方法或图像审核方法。该计算机可读存储介质可以是包括各种电子设备形成的存储装置设备,可选的,本发明实施例中计算机可读存储介质是非暂时性的计算机可读存储介质。

[0148]

本发明的另一方面,还提供了一种电子设备,其包括:存储器和处理器,存储器中存储有计算机程序,计算机程序被处理器执行时实现上述任一实施例所述的图像识别方法或图像审核方法。

[0149]

至此,已经结合附图所示的优选实施方式描述了本发明的技术方案,但是,本领域技术人员容易理解的是,本发明的保护范围显然不局限于这些具体实施方式。在不偏离本发明的原理的前提下,本领域技术人员可以对相关技术特征作出等同的更改或替换,这些更改或替换之后的技术方案都将落入本发明的保护范围之内。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。