1.本技术涉及图像识别技术领域,具体涉及一种宠物身份识别方法、装置、电子设备及存储介质。

背景技术:

2.近年来,越来越多的人选择养宠物,根据《宠物行业白皮书》,2019年全国城镇宠物犬猫数量达到9915万只,比2018年增长766万只。其中宠物犬数量为5503万只,比2018年增长8.2%;宠物猫数量为4412万只,比2018年增长8.6%,宠物猫数量增幅超过宠物犬的增幅。2022年我国宠物犬猫数量会有更大的突破。

3.随着宠物数量越来越多,宠物的管理越发困难,尤其是对宠物的身份管理极其困难,为了便于实现宠物身份的管理,国外甚至国内兴起了宠物芯片,即在宠物芯片中存入宠物的身份信息,将宠物芯片再植入到宠物体内,这样可以通过读取芯片中的信息识别宠物的身份。这种植入芯片的方式,对宠物的身体伤害性比较强,且芯片造价昂贵;而且,非法份子可以将芯片从身体中取出,仍然无法获取宠物身份。基于此开发了一种基于宠物鼻纹的宠物身份识别的方式。即基于宠物的鼻纹进行身份识别,不需要对宠物进行任何操作,造价成本比较低,且对宠物无伤,基于宠物鼻纹的宠物身份识别的方式逐渐普及和火热。

4.然而,目前基于宠物鼻纹对宠物进行身份识别时,获取到的宠物鼻纹图像的精度比较低,导致对宠物的身份识别精度较低。

技术实现要素:

5.本技术实施例提供了一种宠物身份识别方法、装置、电子设备及存储介质,通过与宠物鼻纹图像适配的优化模式对宠物鼻纹图像进行优化,得到高精度的待识别图像,以及根据用户设备的识别准确率进行身份识别,提高了宠物身份识别的精度。

6.第一方面,本技术实施例提供一种宠物身份识别方法,包括:

7.获取宠物鼻纹图像和当前身份识别需求对应的识别准确率;

8.根据所述宠物鼻纹图像的拍摄信息以及所述宠物鼻纹图像,确定所述宠物鼻纹图像对应的至少一种优化模式;

9.使用所述至少一种优化模式对所述宠物鼻纹图像进行优化,得到待识别图像;

10.对所述待识别图像进行目标检测,得到目标图像;

11.根据所述识别准确率对所述目标图像进行身份识别,得到宠物的身份信息

12.第二方面,本技术实施例提供一种宠物身份识别装置,包括:获取单元和处理单元;

13.所述获取单元,用于获取宠物鼻纹图像和当前身份识别需求对应的识别准确率;

14.所述处理单元,用于根据所述宠物鼻纹图像的拍摄信息以及所述宠物鼻纹图像,确定所述宠物鼻纹图像对应的至少一种优化模式;使用所述至少一种优化模式对所述宠物鼻纹图像进行优化,得到待识别图像;对所述待识别图像进行目标检测,得到目标图像;根

据所述识别准确率对所述目标图像进行身份识别,得到宠物的身份信息。

15.第三方面,本技术实施例提供一种电子设备,包括:处理器,所述处理器与存储器相连,所述存储器用于存储计算机程序,所述处理器用于执行所述存储器中存储的计算机程序,以使得所述电子设备执行如第一方面所述的方法。

16.第四方面,本技术实施例提供一种计算机可读存储介质,所述计算机可读存储介质存储有计算机程序,所述计算机程序使得计算机执行如第一方面所述的方法。

17.第五方面,本技术实施例提供一种计算机程序产品,所述计算机程序产品包括存储了计算机程序的非瞬时性计算机可读存储介质,所述计算机可操作来使计算机执行如第一方面所述的方法。

18.实施本技术实施例,具有如下有益效果:

19.可以看出,在本技术实施例中,在获取到宠物鼻纹图像之后,并不是直接使用宠物鼻纹图像进行宠物身份的识别,而是先获取与该宠物鼻纹图像适配的至少一种优化模式,对宠物鼻纹图像进行优化,从而得到高精度的待识别图像,进而提高后续宠物身份识别的精度。此外,在得到待识别图像之后,也并非直接使用待识别图像进行身份验证,而是结合当前身份识别需求对应的识别准确率,以及待识别图像去识别宠物的身份,即结合当前的识别需求去识别宠物的身份,进一步提高宠物身份识别的精准性。

附图说明

20.为了更清楚地说明本技术实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

21.图1为本技术实施例提供的一种宠物身份识别系统的示意图;

22.图2a为本技术实施例提供的一种基于宠物身份识别的小区管理的应用场景;

23.图2b为本技术实施例提供的一种基于宠物身份识别的游乐园管理的应用场景;

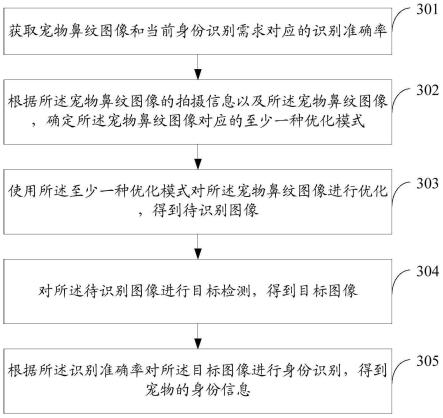

24.图3为本技术实施例提供的一种宠物身份识别方法的流程示意图;

25.图4为本技术实施例提供的一种截取多个子图像的示意图;

26.图5为本技术实施例提供的另一种截取多个子图像的示意图;

27.图6为本技术实施例提供的一种目标检测方法的流程示意图;

28.图7为本技术实施例提供的一种第一目标检测模型的示意图;

29.图8为本技术实施例提供的一种第二目标检测模型的示意图;

30.图9为本技术实施例提供的一种宠物身份识别装置的功能单元组成框图;

31.图10为本技术实施例提供的一种电子设备的结构示意图。

具体实施方式

32.下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。

33.本技术的说明书和权利要求书及所述附图中的术语“第一”、“第二”、“第三”和“第四”等是用于区别不同对象,而不是用于描述特定顺序。此外,术语“包括”和“具有”以及它们任何变形,意图在于覆盖不排他的包含。例如包含了一系列步骤或单元的过程、方法、系统、产品或设备没有限定于已列出的步骤或单元,而是可选地还包括没有列出的步骤或单元,或可选地还包括对于这些过程、方法、产品或设备固有的其它步骤或单元。

34.在本文中提及“实施例”意味着,结合实施例描述的特定特征、结果或特性可以包含在本技术的至少一个实施例中。在说明书中的各个位置出现该短语并不一定均是指相同的实施例,也不是与其它实施例互斥的独立的或备选的实施例。本领域技术人员显式地和隐式地理解的是,本文所描述的实施例可以与其它实施例相结合。

35.参阅图1,图1为本技术实施例提供的一种宠物身份识别系统。宠物身份识别系统包括图像获取装置10、宠物身份识别装置20和云服务器30。其中,图像获取装置10、宠物身份识别装置20和云服务器30之间保持通信连接,且图像获取装置10可以集成在宠物身份识别装置20上,服务器30为一种可选的设备。

36.示例性的,通过图像获取装置10对宠物的鼻子进行拍摄,得到宠物鼻纹图像。相应地,宠物身份识别装置20可以通过图像获取装置10获取宠物鼻纹图像;然后,获取当前身份识别需求对应的识别准确率,该识别准确率是预先配置到宠物身份识别装置20的。进一步地,宠物身份识别装置20根据所述宠物鼻纹图像的拍摄信息以及所述宠物鼻纹图像,确定所述宠物鼻纹图像对应的至少一种优化模式;使用所述至少一种优化模式对所述宠物鼻纹图像进行优化,得到待识别图像;对所述待识别图像进行目标检测,得到目标图像;根据所述识别准确率对所述目标图像进行身份识别,得到宠物的身份信息。

37.可选地,上述对宠物鼻纹图像进行身份识别的过程也可以由云服务器30实现,比如,宠物身份识别装置20获取到宠物鼻纹图像,可以将识别准确率以及宠物鼻纹图像发送给云服务器30,并指示云服务器30进行身份识别。

38.可以看出,在本技术实施例中,在获取到宠物鼻纹图像之后,并不是直接使用宠物鼻纹图像进行宠物身份的识别,而是先获取与该宠物鼻纹图像适配的至少一种优化模式,对宠物鼻纹图像进行优化,从而得到高精度的待识别图像,进而提高后续宠物身份识别的精度。此外,在得到待识别图像之后,也并非直接使用待识别图像进行身份验证,而是结合当前身份识别需求对应的识别准确率,以及待识别图像去识别宠物的身份,即结合当前的识别需求去识别宠物的身份,进一步提高宠物身份识别的精准性。

39.首先说明,本技术的宠物身份识别方法可以应用到各个宠物身份识别场景。下面以几个实际的场景说明,本技术的应用场景。

40.图2a示出了一种基于宠物身份识别的小区管理的应用场景。如图2a所示,当宠物进入小区时,小区的门禁终端可以通过执行本技术的宠物身份识别方法,验证宠物是否为本小区的宠物;如果验证时本小区的宠物,则对宠物进行放行,允许宠物进入小区。当宠物离开小区时,门禁终端可以通过执行本技术的宠物身份识别方法,识别出宠物的身份,基于该身份获取宠物的主人的联系方式,通过该联系方式向宠物的主人发送提示信息,该提示信息用于提示该宠物的主人,该宠物即将离开小区,请及时关注宠物的行为。

41.图2b示出了一种基于宠物身份识别的游乐园管理的应用场景。如图2b所示,当宠物进入游乐园时,游乐园的闸道终端可以通过执行本技术的宠物身份识别方法,验证宠物

是否有预约;如果有预约,则对宠物进行放行,允许宠物进入游乐园。当宠物离开游乐园时,闸道终端可以通过执行本技术的宠物身份识别方法,识别出宠物的身份,基于该身份获取宠物的主人的联系方式,通过该联系方式向宠物的主人发送提示信息,该提示信息用于提示该宠物的主人,该宠物即将离开游乐园,请及时关注宠物的行为。

42.参阅图3,图3为本技术实施例提供的一种宠物身份识别方法的流程示意图。该方法应用于上述的宠物身份识别装置。该方法包括但不限于以下步骤内容:

43.301:获取宠物鼻纹图像和当前身份识别需求对应的识别准确率。

44.示例性的,可以通过上述的图像获取装置10对宠物进行拍摄,然后图像获取装置10将拍摄到的宠物发送给宠物身份识别装置;或者,用户终端将预先存储或者拍摄好的宠物鼻纹图像发送给宠物身份识别装置。

45.示例性的,用户可以通过用户终端将当前身份识别需求对应的识别准确率发送给宠物身份识别装置;或者,宠物身份识别装置上设置有输入-输出设备(例如,键盘或者显示屏),则用户可以通过该输入-输出设备输入该识别准确率;又或者,针对每种身份识别需求预先设置一个识别准确率,检测当前的身份设备需求,然后获取与当前身份识别需求对应的识别准确率。

46.其中,上述身份识别需求包括但不限于:预约认证(例如,美容预约之后的身份验证)、入园身份管理(例如,游乐园入园的身份验证)、公共场合的身份登记(例如,演唱会或者公园的入场的身份登记),等等。

47.302:根据所述宠物鼻纹图像的拍摄信息以及所述宠物鼻纹图像,确定所述宠物鼻纹图像对应的至少一种优化模式。

48.示例性的,在对宠物进行拍摄得到宠物鼻纹图像时,可以将当时的拍摄信息存储到宠物鼻纹图像。例如,将宠物鼻纹图像的格式设置为jpeg文件交换格式(jpeg file interchange format,jfif),并将拍摄信息存储到宠物鼻纹图像中。相应地,宠物身份识别装置获取到宠物鼻纹图像之后,对jpeg文件交换格式的宠物鼻纹图像进行解析,得到拍摄信息。

49.示例性的,拍摄信息包括环境信息,即对宠物进行拍摄时的环境信息。

50.进一步地,根据宠物鼻纹图像以及环境信息,确定宠物鼻纹图像对应的至少一种优化模式。其中,该优化模式包括去噪处理、增强处理、校正处理和补全处理中的一种或多种。其中,去噪处理是对图像中噪声进行去除;增强处理是对图像的亮度进行增强;校正处理是对图像进行校正;补全处理是对图像的特征进行补全,本技术中主要是对图像中宠物的鼻纹特征进行补全。

51.进一步地,根据所述环境信息,确定所述宠物鼻纹图像的环境噪声的含量。具体地,根据上述环境信息,确定宠物鼻纹图像的分块策略。例如上述环境信息包括pm2.5的含量,基于pm2.5的含量以及预设的对应关系,确定分块策略;基于该分块策略对宠物鼻纹图像进行分块,得到多个图像块;计算每个图像块的噪声含量,将该多个图像块的噪声总含量作为宠物鼻纹图像的环境噪声的含量;若所述含量大于第一阈值,确定所述的至少一种优化模式包括去噪处理,即需要对宠物鼻纹图像进行去噪处理。根据所述环境信息,确定拍摄所述宠物鼻纹图像时的环境亮度。具体地,环境信息中记载有拍摄宠物鼻纹图像时的环境亮度若所述环境亮度小于第二阈值,确定所述至少一种优化模式包括增强处理,即确定需

要对宠物鼻纹图像进行增强处理;若所述宠物鼻纹图像倾斜,确定所述至少一种优化模式包括校正处理;若所述宠物鼻纹图像的鼻纹缺失,确定所述至少一种优化模式包括补全处理。示例性的,可以对宠物鼻纹图像进行边缘检测,然后检测到的边缘进行绘制,若绘制出的连通区域不符合鼻纹的形状,则确定宠物鼻纹图像中的鼻纹缺失,需进行补全处理。

52.应说明,本技术以至少一种优化模式中包括校正处理、去噪处理、增强处理以及补全处理为例进行说明。

53.303:使用所述至少一种优化模式对所述宠物鼻纹图像进行优化,得到待识别图像。

54.示例性的,获取至少一种优化模式的优化顺序,并根据至少一种优化模式的优化顺序,先后使用该至少一种优化模式对宠物鼻纹图像进行优化,得到待识别图像,其中,该优化顺序为预先设置好的。一般来说,其优化顺序可以为校正处理、去噪处理、增强处理以及补全处理。也就是说,先使用校正处理对宠物鼻纹图像进行校正,再使用去噪处理对校正处理后的宠物鼻纹图像进行去噪,再使用增强处理对去噪后的宠物鼻纹图像进行增强;最后,再使用补全处理对增强后的宠物鼻纹图像进行补全。

55.304:对所述待识别图像进行目标检测,得到目标图像。

56.示例性的,调用与待识别图像对应的目标检测模型对待识别图像进行目标检测,得到宠物鼻纹图像中鼻纹所在的目标区域;对目标区域的图像进行截取,得到目标图像。后续详细叙述对待识别图像进行目标检测的过程,在此不做过多的描述。

57.305:根据所述识别准确率对所述目标图像进行身份识别,得到宠物的身份信息。

58.可选地,若识别准确率大于第三阈值,将所述目标图像缩放到预设尺寸,得到候选图像。应理解,若目标图像的尺寸大于预设尺寸,则将目标图像缩小,使尺寸变为预设尺寸,得到候选图像;若目标图像的尺寸小于预设尺寸,则将目标图像放大,使尺寸变为预设尺寸,得到候选图像。其中,预设尺寸为模板鼻纹图像的尺寸,模板鼻纹图像为录入的各个宠物的宠物鼻纹图像。并且在录入各个宠物的宠物鼻纹图像时,将获取到的各个宠物的宠物鼻纹图像的尺寸转换到预设尺寸后,再进行保存。进一步地,获取与所述识别准确率对应的预设半径和预设偏移值。示例性的,预先设置识别准确率、预设半径以及预设偏移值三者之间的对应关系。基于该对应关系,以及当前身份识别需求对应的识别准确率,获取上述预设半径和预设偏移值。进一步地,根据所述预设半径和所述预设偏移值,对所述候选图像进行多次截取,得到多个子图像。具体地,根据上述预设偏移值,对预设半径进行偏移,得到多个截取半径,其中,多个截取半径包括上述预设半径,即以预设半径为基础半径,然后基于上述预设偏移值对预设半径进行多次偏移,得到多个截取半径。

59.示例性的,多个截取半径中的第i个截取半径满足以下公式:

60.ri=r0 (i-1)*offset;

61.其中,ri为所述第i个截取半径,r0为预设半径,offset为预设偏移值,i的取值为1到n的整数,n为多个截取半径的数量。

62.可选地,如图4所示,获取候选图像的中心像素点,以所述候选图像的中心像素点为圆心,以每个截取半径对所述候选图像进行截取,得到多个圆形图像;然后,将每个圆形图像作为子图像,得到多个子图像。

63.可选地,如图5所示,获取候选图像的中心像素点,并以多个截取半径对所述候选

图像进行截取,得到多个圆形图像;然后,获取任意两个相邻圆形图像之间的圆环图像,得到多个圆环图像;将每个圆环图像作为子图像,得到多个子图像。

64.进一步地,根据所述多个子图像进行身份识别,得到所述宠物的身份信息。

65.具体地,基于获取上述多个子图像的方式,使用多个截取半径对各个鼻纹图像模板进行截取,得到与各个鼻纹图像模板对应的多个子鼻纹图像模板,具体的截取过程。然后,针对每个截取半径,将使用该截取半径对宠物鼻纹图像进行截取得到的子图像与使用该截取半径对各个鼻纹图像模板进行截取得到的子模板鼻纹图像进行匹配,得到该子图像与该子模板鼻纹图像之间的相似度。示例性的,对该子图像进行特征提取,得到该子图像对应的特征向量;以及对该子模板图像进行特征提取,得到该子模板图像对应的特征向量;基于该子图像对应的特征向量以及该子模板图像对应的特征向量,确定出该子图像与该子模板鼻纹图像之间的相似度。然后,将该相似度作为宠物鼻纹图像在每个截取半径下与各个鼻纹图像模板之间的相似度,进而得到宠物鼻纹图像在多个截取半径下与各个鼻纹图像模板之间的多个相似度。最后,基于每个截取半径对应的权重,对宠物鼻纹图像在多个截取半径下与各个鼻纹图像模板之间的多个相似度进行加权,得到宠物鼻纹图像与各个鼻纹图像模板之间的目标相似度。

66.示例性的,根据每个截取半径,确定每个截取半径对应的权重。可选地,对多个截取半径进行归一化处理,得到每个截取半径对应的权重。应说明,对多个截取半径进行归一化处理,则截取半径越大,对应的权重越大,这也正是因为截取半径越大从宠物鼻纹图像中所截取到的鼻纹特征越多,那这些鼻纹特征在匹配时,更具有说服力。因此,通过归一化处理,可以得到每个截取半径所对应的精确的权重。

67.最后,根据宠物鼻纹图像与各个鼻纹图像模板之间的目标相似度,得到宠物的身份信息。示例性的,获取最大目标相似度所对应的鼻纹图像模板,将该鼻纹图像模板所对应的身份信息作为该宠物的身份信息。

68.可以看出,当识别准确率较高时,即对身份识别要求比较高时,对宠物鼻纹图像进行截取,分不同的等级和层次进行匹配,并非整体匹配,经过多层次的匹配,进而可以提高身份识别的准确度。

69.可选地,若所述识别准确率小于或者等于所述第三阈值,对所述目标图像进行特征提取,得到特征信息,例如,可以通过训练好的神经网络对目标图像进行特征提取,得到目标图像的特征信息;根据所述特征信息进行身份识别,得到所述宠物的身份信息,同样的,可以通过上述神经网络对各个宠物鼻纹图像模板进行特征提取,得到各个鼻纹图像模板的特征信息。最后,将宠物鼻纹图像的特征信息与各个鼻纹图像模板的特征信息进行匹配,得到宠物鼻纹图像与各个鼻纹图像模板之间的目标相似度;并根据物鼻纹图像与各个鼻纹图像模板之间的目标相似度,确定出宠物的身份信息。

70.可以看出,当识别准确率不高时,即对身份识别的要求没有那么高的情况下,可以对宠物鼻纹图像整体进行特征识别和匹配,从而提高身份识别的效率。

71.可以看出,在本技术实施例中,在获取到宠物鼻纹图像之后,并不是直接使用宠物鼻纹图像进行宠物身份的识别,而是先获取与该宠物鼻纹图像适配的至少一种优化模式,对宠物鼻纹图像进行优化,从而得到高精度的待识别图像,进而提高后续宠物身份识别的精度。此外,在得到待识别图像之后,也并非直接使用待识别图像进行身份验证,而是结合

当前身份识别需求对应的识别准确率,以及待识别图像去识别宠物的身份,即结合当前的识别需求去识别宠物的身份,进一步提高宠物身份识别的精准性。

72.参阅图6,图6为本技术实施例提供的一种目标检测方法的流程示意图。该方法包括但不限于以下步骤内容:

73.601:获取宠物的种类和饲养时长。

74.示例性的,宠物身份识别装置上设置有输入-输出设备,则用户可以通过输入-输出设备向宠物身份识别装置输入宠物的种类和饲养时长。

75.602:根据所述种类和所述饲养时长,调用与所述宠物鼻纹图像对应的目标检测模型。

76.示例性的,宠物身份识别装置根据种类和饲养时长,确定宠物的鼻子在宠物鼻纹图像中的相对占比。示例性的,宠物身份识别装置根据宠物的种类,获取宠物的成长规则。根据宠物的成长规则,以及饲养时长,确定宠物的成长模型。即对宠物按照上述成长规则进行成长,在正常状态下成长,成长到饲养时长时的成长模型。获取该成长模型下,宠物头部上的各个器官相对于整个头部的占比;将鼻子相对于整个头部的占比,作为宠物的鼻子在宠物鼻纹图像中的相对占比。根据上述相对占比,调用与宠物对应的目标检测模型。

77.603:基于所述目标检测模型、所述种类以及所述饲养时长,对所述宠物鼻纹图像进行目标检测,得到所述宠物的鼻子在所述宠物鼻纹图像中的目标区域。

78.可选地,当相对占比小于第一阈值时,相对来说,宠物的鼻子在宠物鼻纹图像中属于小目标时,则可以通过与该相对占比对应的目标检测模型对宠物鼻纹图像进行目标检测,本技术将这样的目标检测模型称为第一目标检测模型。

79.示例性的,获取与上述种类对应的多个查询向量,其中,每个查询向量用于表征与上述种类的宠物对应的一个面部特征。比如,某个查询向量表征上述种类的宠物的鼻子特征,另一个查询向量表征上述宠物的眼睛特征。应说明,上述多个查询向量是通过预先训练得到的。本技术中针对每种宠物,设置与每种宠物对应的查询向量,并不是对所有的宠物使用同样的查询向量,这样对每种宠物进行目标检测时,可以有针对性的进行目标检测,提高目标检测的效率和精度。然后,根据种类和饲养时长,确定宠物的面部器官之间的关联关系,其中,关联关系主要指面部器官之间的空间位置关系。

80.示例性的,根据宠物的种类,确定宠物的各个面部器官之间的初始相对距离和初始相对方向,即宠物刚出生时的各个面部器官之间的相对距离和相对方向。示例性的,宠物身份识别装置中预先存储有各种宠物的各个面部器官之间的初始相对距离和初始相对方向。然后,根据饲养时长,以及初始相对距离和初始相对方向,以及上述种类的宠物的成长规则,确定到达饲养时长所对应的时刻,宠物的各个面部器官之间的相对距离和相对方向;根据到达饲养时长所对应的时刻各个面部器官之间的相对距离和相对方向,确定上述关联关系。

81.可选地,上述关联关系可以通过三维矩阵表征。示例性的,以宠物的鼻子的中心作为三维空间坐标系的坐标原点,并获取其他各个面部器官的中心点与鼻子的中心点之间的相对方向和相对距离。基于其他各个面部器官的中心点与鼻子的中心点之间的相对方向和相对距离,确定其他各个面部器官的中心点在上述三维空间坐标系下的三维空间坐标。最后,基于其他各个面部器官的三维空间坐标构建上述三维矩阵。

82.具体地,获取其他各个面部器官的中心点的三维空间坐标中x轴的最大值、y轴的最大值以及z轴的最大值。分别获取到x轴的最大值、y轴的最大值以及z轴的最大值为x1、y1和z1。然后,将x轴的最大值作为三维空间坐标作为上述三维矩阵的长,y轴的最大值作为上述三维矩阵的宽,z轴的最大值作为上述三维矩阵的高,得到一个长、宽、高分别为x1、y1,z1的三维矩阵。最后,将三维矩阵按间隔为1的取值进行分割,得到三维矩阵中各个元素的空间坐标,并将各个元素的空间坐标相对于坐标原点之间的距离作为每个元素的取值,即可得到用于表征上述关联关系的三维矩阵。

83.最后,根据关联关系、多个查询向量以及所述目标检测模型,对宠物鼻纹图像进行目标检测,得到宠物的鼻子在物鼻纹图像中的目标区域。

84.具体地,如图7所示,第一目标检测模型包括编码网络、特征提取网络、编码器和解码器。示例性的,基于图7示出的目标检测模型,根据关联关系,对宠物鼻纹图像进行特征提取,得到多个第一特征向量。具体地,对宠物鼻纹图像进行特征提取,得到第一特征图,即将宠物鼻纹图像输入到特征提取网络进行特征提取,得到第一特征图;对关联关系进行编码,得到第二特征图。示例性的,将关联关系输入到编码网络进行编码,可得到第二特征图,即对上述三维矩阵进行映射处理,使得到的第二特征图的维度与第一特征图的尺寸(即长和宽)相同,以便于后续与第一特征图的融合。

85.进一步地,将第一特征图和第二特征图进行融合,得到第三特征图。应理解,第一特征图和第二特征图均是一个三维矩阵,且长和宽相同,则可以将第一特征图和第二特征图在纵向(高度)上进行拼接,得到第三特征图。例如,第一特征图的高度为h1,第二特征图高度为h2,则第一特征图和第二特征图拼接所得到的第三特征图的高度为(h1 h2)。

86.进一步地,对第三特征图进行平铺,得到多个第一特征向量。示例性的,先将第三特征图按高度(按层)进行平铺,得到多个二维矩阵。例如,第三特征图的高度为(h1 h2),则可以平铺出(h1 h2)个二维矩阵,且每个二维矩阵的尺寸相同,为第三特征图的尺寸。然后,针对每个二维矩阵,对其按行或者按列(本技术中主要按行进行平铺为例进行说明)进行平铺,得到多个一维序列,其中,每个一维序列的元素数量为二维矩阵的列数,多个一维序列的数量为每个二维矩阵的行数。例如,每个二维矩阵的尺寸为w*l,则按行平铺之后,可得到w个一维序列,每个一维序列的元素数量为l。最后,将每个二维矩阵对应的多个一维序列进行拼接,得到与每个二维矩阵对应的特征向量,则该特征向量的元素数量为w*l。最后,将每个二维矩阵对应的特征向量作为一个第一特征向量,得到多个第一特征向量。因此,针对一个尺寸为w*l*(h1 h2)的第三特征图,可以平铺出(h1 h2)个,元素数量为w*l的第一特征向量。

87.进一步地,将多个第一特征向量输入到编码器中进行编码,得到多个第二特征向量,其中,编码过程可以参考transform编码器的编码过程,不再叙述;然后,将多个查询向量述多个第二特征向量输入到解码器中进行解码,得到多个第三特征向量,其中,解码过程可以参考transform解码器的解码过程,不再叙述。最后,根据每个第三特征向量进行目标检测,得到与每个第三特征向量对应的候选框以及分类类别,即基于每个第三特征向量进行类别预测,以及候选框的预测,可以得到与每个第三特征向量对应的候选框以及分类类别。

88.最后,根据每个第三特征向量对应的候选框以及分类类别,确定目标候选框。即从

每个第三特征向量对应的分类类别中确定出属于鼻子的分类类别,然后将该分类类别对应的候选框作为目标候选框。并将目标候选框在宠物鼻纹图像中框选的区域作为宠物的鼻子在宠物鼻纹图像中的目标区域。

89.可选地,当相对占比大于或者等于第一阈值时,相对来说,宠物的鼻子在宠物鼻纹图像中属于大目标时,则可以通过与该相对占比对应的目标检测模型对宠物鼻纹图像进行目标检测,本技术将这样的目标检测模型称为第二目标检测模型。

90.参阅图8,图8示出了第二目标检测模型的示意图。第二目标检测模型包括特征提取网络、映射层以及卷积层。应说明,与第一目标检测模型不同的是,使用第二目标检测模型之前,需训练出与每种宠物对应的多个参考框和多个参考特征,其中,多个参考框可以大致框选出该种宠物的面部图像中所包含的所有目标,多个参考特征与多个参考框对应,每个参考特征用于表征与该参考特征对应的参考框所框选的目标所包含的特征。

91.示例性的,对宠物鼻纹图像进行特征提取,得到第一特征图,即输入到特征提取网络进行特征提取,得到第一特征图。然后,获取与上述种类对应的多个参考框以及多个参考特征。应说明,在本技术中针对每种宠物训练出与其对应的参考框,并不是对所有的宠物使用相同的参考框,从而可以实现针对每种宠物进行针对性的目标检测,提高目标检测的精度。进一步地,从第一特征图中截取出与每个参考框对应的候选图像。

92.应理解,第一特征图是对特征提取网络中的各个通道所提取出的特征图进行拼接得到的一个三维矩阵,因此使用参考框从第一特征图进行图像截取时,本质上就是从每个通道所对应的特征图中截取图像,并将多哥通道截取出的多个图像进行拼接,得到与每个候选框对应的候选图像。因此,每个候选框对应的候选图像也是一个三维矩阵。

93.进一步地,将每个候选框对应的候选图像输入到映射层进行映射,得到与每个参考框对应的第四特征图,即对每个候选框对应的候选图像输入到映射层执行roi align操作,将每个候选框对应的候选图像映射成第五特征图。

94.进一步地,对每个参考框对应的第四特征图与每个参考框对应的参考特征进行卷积处理,得到每个参考框对应的第五特征图。示例性的,如图8所示,将每个参考框对应的参考特征进行映射,得到每个参考框对应的二维矩阵,其中,二维矩阵的列数与每个参考框对应的第四特征图的高度相同,以保证第五特征向量的维度与第四特征图的高度相同,其中,二维矩阵的行数取决于卷积层设置的卷积核的数量。然后,对每个参考框对应的二维矩阵进行平铺,得到多个第五特征向量,其中,每个第五特征向量的维度均与上述二维矩阵的列数相同;然后,将多个第五特征向量作为多个卷积核的卷积参数,这样就可以使用多个第五特征向量中的每个第五特征向量分别与每个参考框对应的第四特征图进行卷积处理,得到与每个第五特征向量对应的子特征图;将所述多个第五特征向量对应的多个子特征图进行拼接,得到与每个参考框对应的第五特征图。因此,每个参考框对应的第五特征图也是一个三维矩阵。

95.最后,如图8所示,对每个参考框对应的第五特征图进行平铺,得到与每个参考框对应的第四特征向量,其中,对第五特征图进行平铺的过程与上述对第三特征图的平铺过程类似,可平铺出与第五特征图对应的二维矩阵,再将二维矩阵平铺为多个一维序列。与对第三特征图平铺不同的是,对第五特征图平铺为多个一维序列之后,再将多个一维序列,得到一个长的一维序列,将这个长的一维序列作为与每个参考框对应的第四特征向量。

96.同样的,根据每个参考框对应的第四特征向量进行目标检测,得到与每个参考框对应的候选框和分类类别;根据每个参考框对应的候选框以及分类类别,确定目标候选框;将目标候选框在宠物鼻纹图像中框选的区域作为目标区域。

97.可以看出,在本技术实施例中,在对宠物鼻纹图像进行目标检测之前,先获取宠物的种类和饲养时长,然后调用与该种类以及饲养时长对应的目标检测模型,这样就可以针对不同宠物,调用与其相匹配的目标检测模型对宠物鼻纹图像进行针对性的目标检测,并非对所有的宠物使用同一个模型进行目标检测,从而提高了对宠物的鼻子的分割精度,提高了目标检测的精度。

98.参阅图9,图9本技术实施例提供的一种宠物身份识别装置的功能单元组成框图。宠物身份识别装置900包括:获取单元901和处理单元902;

99.获取单元901,用于获取宠物鼻纹图像和当前身份识别需求对应的识别准确率;处理单元902,用于根据所述宠物鼻纹图像的拍摄信息以及所述宠物鼻纹图像,确定所述宠物鼻纹图像对应的至少一种优化模式;使用所述至少一种优化模式对所述宠物鼻纹图像进行优化,得到待识别图像;对所述待识别图像进行目标检测,得到目标图像;根据所述识别准确率对所述目标图像进行身份识别,得到宠物的身份信息。

100.在本技术一些可能的实施方式中,所述拍摄信息包括拍摄所述宠物鼻纹图像时的环境信息;在根据所述宠物鼻纹图像的拍摄信息,以及所述宠物鼻纹图像,确定所述宠物鼻纹图像对应的至少一种优化模式方面,处理单元902,具体用于:根据所述宠物鼻纹图像和所述环境信息,确定所述宠物鼻纹图像对应的至少一种优化模式;其中,所述至少一种优化模式包括去噪处理、增强处理、校正处理和补全处理中的一种或多种。

101.在本技术一些可能的实施方式中,在根据所述宠物鼻纹图像以及所述环境信息,确定所述宠物鼻纹图像对应的至少一种优化模式方面,处理单元902,具体用于:根据所述环境信息,确定所述宠物鼻纹图像的环境噪声的含量;若所述含量大于第一阈值,确定所述的至少一种优化模式包括去噪处理;根据所述环境信息,确定拍摄所述宠物鼻纹图像时的环境亮度;若所述环境亮度小于第二阈值,确定所述至少一种优化模式包括增强处理;若所述宠物鼻纹图像倾斜,确定所述至少一种优化模式包括校正处理;若所述宠物鼻纹图像的鼻纹缺失,确定所述至少一种优化模式包括补全处理。

102.在本技术一些可能的实施方式中,在使用所述至少一种优化模式对所述宠物鼻纹图像进行优化,得到待识别图像方面,处理单元902,具体用于:获取所述至少一种优化模式的优化顺序;根据所述至少一种优化模式的优化顺序,使用所述至少一种优化模式,对所述宠物鼻纹图像进行优化,得到所述待识别图像。

103.在本技术一些可能的实施方式中,在根据所述识别准确率对所述目标图像进行身份识别,得到宠物的身份信息方面,处理单元902,具体用于:若所述识别准确率大于第三阈值,将所述目标图像缩放到预设尺寸,得到候选图像;获取与所述识别准确率对应的预设半径和预设偏移值;根据所述预设半径和所述预设偏移值,对所述候选图像进行多次截取,得到多个子图像;根据所述多个子图像进行身份识别,得到所述宠物的身份信息;若所述识别准确率小于或者等于所述第三阈值,对所述目标图像进行特征提取,得到特征信息;根据所述特征信息进行身份识别,得到所述宠物的身份信息。

104.在本技术一些可能的实施方式中,在根据所述预设半径和所述预设偏移值,对所

述候选图像进行多次截取,得到多个子图像方面,处理单元902,具体用于:基于所述预设偏移值,对所述预设半径进行偏移,得到多个截取半径;以所述候选图像的中心像素点为圆心,以每个截取半径对所述候选图像进行截取,得到多个圆形图像;将每个圆形图像作为子图像,得到所述多个子图像;其中,所述多个截取半径中的第i个截取半径满足以下公式:

105.ri=r0 (i-1)*offset;

106.其中,ri为所述第i个截取半径,r0为预设半径,offset为预设偏移值,i的取值为1到n的整数,n为多个截取半径的数量。

107.在本技术一些可能的实施方式中,在对所述待识别图像进行目标检测,得到目标图像方面,处理单元902,具体用于:获取所述宠物的种类和饲养时长;根据所述种类和所述饲养时长,调用与所述宠物鼻纹图像对应的目标检测模型;

108.基于所述目标检测模型、所述种类以及所述饲养时长,对所述宠物鼻纹图像进行目标检测,得到所述宠物的鼻子在所述宠物鼻纹图像中的目标区域;

109.从所述宠物鼻纹图像中截取出与所述目标区域对应的图像,作为目标图像。

110.参阅图10,图10为本技术实施例提供的一种电子设备的结构示意图。如图10所示,电子设备1000包括收发器1001、处理器1002和存储器1003。它们之间通过总线1004连接。存储器1003用于存储计算机程序和数据,并可以将存储器1003存储的数据传输给处理器1002。

111.处理器1002用于读取存储器1003中的计算机程序执行以下操作:

112.控制收发器1001获取宠物鼻纹图像和当前身份识别需求对应的识别准确率;

113.根据所述宠物鼻纹图像的拍摄信息以及所述宠物鼻纹图像,确定所述宠物鼻纹图像对应的至少一种优化模式;使用所述至少一种优化模式对所述宠物鼻纹图像进行优化,得到待识别图像;对所述待识别图像进行目标检测,得到目标图像;根据所述识别准确率对所述目标图像进行身份识别,得到宠物的身份信息。

114.在本技术一些可能的实施方式中,所述拍摄信息包括拍摄所述宠物鼻纹图像时的环境信息;在根据所述宠物鼻纹图像的拍摄信息,以及所述宠物鼻纹图像,确定所述宠物鼻纹图像对应的至少一种优化模式方面,处理器1002具体用于执行以下操作:

115.根据所述宠物鼻纹图像和所述环境信息,确定所述宠物鼻纹图像对应的至少一种优化模式;

116.其中,所述至少一种优化模式包括去噪处理、增强处理、校正处理和补全处理中的一种或多种。

117.在本技术一些可能的实施方式中,在根据所述宠物鼻纹图像以及所述环境信息,确定所述宠物鼻纹图像对应的至少一种优化模式方面,处理器1002具体用于执行以下操作:

118.根据所述环境信息,确定所述宠物鼻纹图像的环境噪声的含量;

119.若所述含量大于第一阈值,确定所述的至少一种优化模式包括去噪处理;

120.根据所述环境信息,确定拍摄所述宠物鼻纹图像时的环境亮度;

121.若所述环境亮度小于第二阈值,确定所述至少一种优化模式包括增强处理;

122.若所述宠物鼻纹图像倾斜,确定所述至少一种优化模式包括校正处理;

123.若所述宠物鼻纹图像的鼻纹缺失,确定所述至少一种优化模式包括补全处理。

124.在本技术一些可能的实施方式中,在使用所述至少一种优化模式对所述宠物鼻纹图像进行优化,得到待识别图像方面,处理器1002具体用于执行以下操作:

125.获取所述至少一种优化模式的优化顺序;

126.根据所述至少一种优化模式的优化顺序,使用所述至少一种优化模式,对所述宠物鼻纹图像进行优化,得到所述待识别图像。

127.在本技术一些可能的实施方式中,在根据所述识别准确率对所述目标图像进行身份识别,得到宠物的身份信息方面,处理器1002具体用于执行以下操作:

128.若所述识别准确率大于第三阈值,将所述目标图像缩放到预设尺寸,得到候选图像;获取与所述识别准确率对应的预设半径和预设偏移值;根据所述预设半径和所述预设偏移值,对所述候选图像进行多次截取,得到多个子图像;根据所述多个子图像进行身份识别,得到所述宠物的身份信息;

129.若所述识别准确率小于或者等于所述第三阈值,对所述目标图像进行特征提取,得到特征信息;根据所述特征信息进行身份识别,得到所述宠物的身份信息。

130.在本技术一些可能的实施方式中,在根据所述预设半径和所述预设偏移值,对所述候选图像进行多次截取,得到多个子图像方面,处理器1002具体用于执行以下操作:

131.基于所述预设偏移值,对所述预设半径进行偏移,得到多个截取半径;

132.以所述候选图像的中心像素点为圆心,以每个截取半径对所述候选图像进行截取,得到多个圆形图像;

133.将每个圆形图像作为子图像,得到所述多个子图像;

134.其中,所述多个截取半径中的第i个截取半径满足以下公式:

135.ri=r0 (i-1)*offset;

136.其中,ri为所述第i个截取半径,r0为预设半径,offset为预设偏移值,i的取值为1到n的整数,n为多个截取半径的数量。

137.在本技术一些可能的实施方式中,在对所述待识别图像进行目标检测,得到目标图像方面,处理器1002具体用于执行以下操作:

138.获取所述宠物的种类和饲养时长;根据所述种类和所述饲养时长,调用与所述宠物鼻纹图像对应的目标检测模型;基于所述目标检测模型、所述种类以及所述饲养时长,对所述宠物鼻纹图像进行目标检测,得到所述宠物的鼻子在所述宠物鼻纹图像中的目标区域;从所述宠物鼻纹图像中截取出与所述目标区域对应的图像,作为目标图像。

139.具体地,上述收发器1001可为图9所述的实施例的宠物身份识别装置900的获取单元901,上述处理器1002可以为图9所述的实施例的宠物身份识别装置900的处理单元902。

140.应理解,本技术中的电子设备可以包括智能手机(如android手机、ios手机、windows phone手机等)、平板电脑、掌上电脑、笔记本电脑、移动互联网设备mid(mobile internet devices,简称:mid)或穿戴式设备等。上述电子设备仅是举例,而非穷举,包含但不限于上述电子设备。在实际应用中,上述电子设备还可以包括:智能车载终端、计算机设备等等。

141.本技术实施例还提供一种计算机可读存储介质,所述计算机可读存储介质存储有计算机程序,所述计算机程序被处理器执行以实现如上述方法实施例中记载的任何一种宠物身份识别方法的部分或全部步骤。

142.本技术实施例还提供一种计算机程序产品,所述计算机程序产品包括存储了计算机程序的非瞬时性计算机可读存储介质,所述计算机程序可操作来使计算机执行如上述方法实施例中记载的任何一种宠物身份识别方法的部分或全部步骤。

143.需要说明的是,对于前述的各方法实施例,为了简单描述,故将其都表述为一系列的动作组合,但是本领域技术人员应该知悉,本技术并不受所描述的动作顺序的限制,因为依据本技术,某些步骤可以采用其他顺序或者同时进行。其次,本领域技术人员也应该知悉,说明书中所描述的实施例均属于可选实施例,所涉及的动作和模块并不一定是本技术所必须的。

144.在上述实施例中,对各个实施例的描述都各有侧重,某个实施例中没有详述的部分,可以参见其他实施例的相关描述。

145.在本技术所提供的几个实施例中,应该理解到,所揭露的装置,可通过其它的方式实现。例如,以上所描述的装置实施例仅仅是示意性的,例如所述单元的划分,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式,例如多个单元或组件可以结合或者可以集成到另一个系统,或一些特征可以忽略,或不执行。另一点,所显示或讨论的相互之间的耦合或直接耦合或通信连接可以是通过一些接口,装置或单元的间接耦合或通信连接,可以是电性或其它的形式。

146.所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部单元来实现本实施例方案的目的。

147.另外,在本技术各个实施例中的各功能单元可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中。上述集成的单元既可以采用硬件的形式实现,也可以采用软件程序模块的形式实现。

148.所述集成的单元如果以软件程序模块的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储器中。基于这样的理解,本技术的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的全部或部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储器中,包括若干指令用以使得一台计算机设备(可为个人计算机、服务器或者网络设备等)执行本技术各个实施例所述方法的全部或部分步骤。而前述的存储器包括:u盘、只读存储器(rom,read-only memory)、随机存取存储器(ram,random access memory)、移动硬盘、磁碟或者光盘等各种可以存储程序代码的介质。

149.本领域普通技术人员可以理解上述实施例的各种方法中的全部或部分步骤是可以通过程序来指令相关的硬件来完成,该程序可以存储于一计算机可读存储器中,存储器可以包括:闪存盘、只读存储器(英文:read-only memory,简称:rom)、随机存取器(英文:random access memory,简称:ram)、磁盘或光盘等。

150.以上对本技术实施例进行了详细介绍,本文中应用了具体个例对本技术的原理及实施方式进行了阐述,以上实施例的说明只是用于帮助理解本技术的方法及其核心思想;同时,对于本领域的一般技术人员,依据本技术的思想,在具体实施方式及应用范围上均会有改变之处,综上所述,本说明书内容不应理解为对本技术的限制。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。