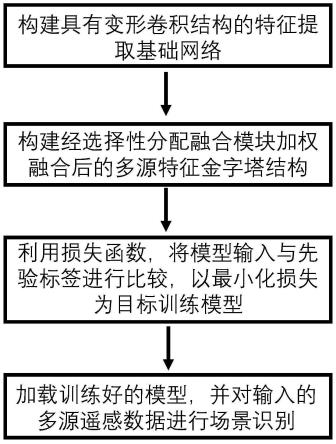

1.本发明属于深度学习技术领域,涉及认知知识中元知识在深度学习领域应用于深度聚类的一种实现,具体涉及一种基于元特征的伪监督聚类方法。

背景技术:

2.聚类是最基础和最重要的数据分析手段之一,实现对海量数据快速智能的聚类分析对于帮助整理、摘要和储存数据具有重要意义。在大数据和人工智能迅速发展的背景下,对海量无标签数据进行智能分析与处理的需求日益增大。将传统聚类和深度学习结合成为目前的研究热点,我们称该方法为深度聚类。深度聚类动机是借助深度神经网络的强大表示学习能力,提升数据的特征质量,从而在没有人工标注的复杂样本上实现良好的聚类效果。

3.深度聚类一般分为深度神经网络提取特征和利用特征进行聚类两个过程。传统的深度聚类方法虽然利用深度神经网络自动提取数据特征,但是数据特征提取方法倾向于关注人类认为非语义的低级特征,特别是在工业或医疗领域,待识别目标通常是复杂且非均匀分布的,目标模式改变也很大,而深度聚类没有稳定的标签信息作为监督信号,若将不准确的聚类结果作为监督信号引导神经网络的训练时,存在误导神经网络的风险,而使用误导的网络提取特征做聚类则会造成结果的进一步恶化,很难达到理想的聚类效果。

4.目前的深度聚类方法主要基于互信息最大化的聚类分配,但是这些方法过于依赖网络初始化,并且很可能锁定到非语义的低级特征。这类方法没有充分考虑模型在认知决策过程中的稳定特征,不适用于实际应用;深度聚类能够挖掘具有稳定语义的特征具有重要意义,这样如何选择具备稳定语义的特征作为聚类的监督信号就成为深度聚类过程中的核心问题。

技术实现要素:

5.本发明的目的在于解决现有技术中存在的上述问题,提出了一种基于元特征的伪监督聚类方法,综合考虑模型提取稳定语义特征和聚类过程中稳定的监督信号来训练深度聚类模型,可以有效提高聚类语义,极大提高分类的准确率;该方法将人类对事物认知中的稳定语义引入深度学习模型,具有重要意义。

6.本发明的技术方案是:

7.一种基于元特征的伪监督聚类方法,包括以下步骤:

8.s1:将数据集输入深度模型进行预训练;

9.s2:将原始图像和数据增强后的图像输入预训练模型中分别用于实例级别特征提取和类别预测,利用分类器对类别样本进行预测,对置信度较高的样本特征进行挑选,选取高置信度的样本用于构建含有稳定语义信息的元特征f

meta

;

10.选取每个类别概率最高的k个样本作为自信样本ck,自信样本加权平均后作为元

特征f

meta

,

11.s3:伪标签构建和伪标签全局分配;即,获取元特征后,为元特征在全局范围内寻找语义最近邻样本,为元特征和对应的语义最近邻分配相同的伪标签,lk={n(f

meta

)|k∈[1,2

…

,s]},其中,n(

·

)表示样本的全局最近邻,lk为元特征近邻分配的伪标签;

[0012]

s4:伪标签优化深度模型,采用带有标签平滑的交叉熵损失指导并优化元特征的选取和伪标签的分配;

[0013]

标签平滑方法通过添加均匀噪音来改进类别伪标签y,给定带有相应标签,将噪声注入所有类别,如下所示:

[0014][0015]

其中,c是类别数量,ε~uniform(0,1)是噪声,y是类别伪标签,是添加均匀噪声后的类别伪标签;

[0016]

使用添加均匀噪声后的类别伪标签和随机增强样本的预测标签来计算交叉熵,为其中,χ为数据集,pi由对模型倒数第二层输出的logits向量z应用到函数计算得到,zj为目标类别。使用交叉熵损失的目的是通过该损失拉近伪标签和标签预测概率之间的距离,使模型学到良好的类别语义信息。

[0017]

上述基于元特征的伪监督聚类方法解决了三个方面的问题:首先,解决了在传统的基于实例的图像聚类算法中为每个实例寻找最近邻训练分类器,造成错分标签的误差累积问题;其次,采用直接标签映射解决了特征多层优化造成的次优解问题;最后,通过元特征全局分配标签增强了分配标签的语义鲁棒性,提高了聚类的准确率。

[0018]

进一步的,步骤s1中的深度模型为对比学习模型moco,将数据集输入对比学习模型moco进行预训练,训练数据集均为图像数据集。

[0019]

进一步的,步骤s1中,当预训练的深度模型收敛之后,停止训练,将参数冻结,用于后续的深度模型进行实例级特征提取。

[0020]

进一步的,所述元特征由置信度最高的样本进行加权平均后形成,所述元特征是相应类别中概率最高、最具有类别代表性的特征,有效保证了该类别稳定的语义属性,能够有效表示该类别的语义信息。

[0021]

进一步的,步骤s2中将原始图像输入预训练深度模型,得到实例级特征;增强后的图像经过预训练深度模型后,将特征输入分类器,用于对样本概率进行预测,输出增强图像的预测概率,从中选取高置信度的样本特征并加权平均后作为元特征。

[0022]

进一步的,增强后的图像r(x)输入预训练深度模型后得到f(r(x)),经过由两层的多层感知机构成的分类器φc,分类器输出增强图像预测概率pk,其中,

[0023]

pk=φc(f(r(x))),

[0024]ck

=topk(p

ki

,f(x));其中,p

ki

是指第i个类别的预测概率,由通过预训练模型得到

的特征经过一个softmax(即归一化指数函数)函数获得;f(x)是原图像输入预训练模型后得到的特征;topk()是挑选对应类别中k个概率最高的特征;ck为自信样本,通过对相应类别的特征概率进行从高到低进行排列,选取前k个概率最高的作为ck。

[0025]

进一步的,步骤s4中采用带有标签平滑的交叉熵损失函数,有效避免模型对于预测过于自信;通过不断迭代运行,分类器预测越来越准确,最终达到良好的聚类效果。

[0026]

本发明的有益效果:

[0027]

(1)本发明通过提出聚类过程中构建稳定特征即元特征,将元特征作为监督信号分配伪标签训练分类器不断提高分类模型的识别精度,从而使模型逐步适应复杂目标和环境变化所造成的模式变化;并且根据元特征的特点提出了一种新型的基于元特征的伪监督聚类方法,从而在有效保证特征语义的情况下,提供稳定的聚类监督信号,通过在全局范围内分配伪标签完成从稳定样本到语义标签的直接映射,有效提高深度模型的分类精度,实现了稳定特征的语义自学习。

[0028]

(2)本发明充分考虑到人类认知过程借助稳定经验指导实践的启发,通过综合考虑分类过程中的稳定判别特征和应用稳定特征作为监督信号,提出一种基于元特征的伪监督聚类方法,将人类认知中的稳定信息和深度学习网络相结合,具有深刻的意义。

附图说明

[0029]

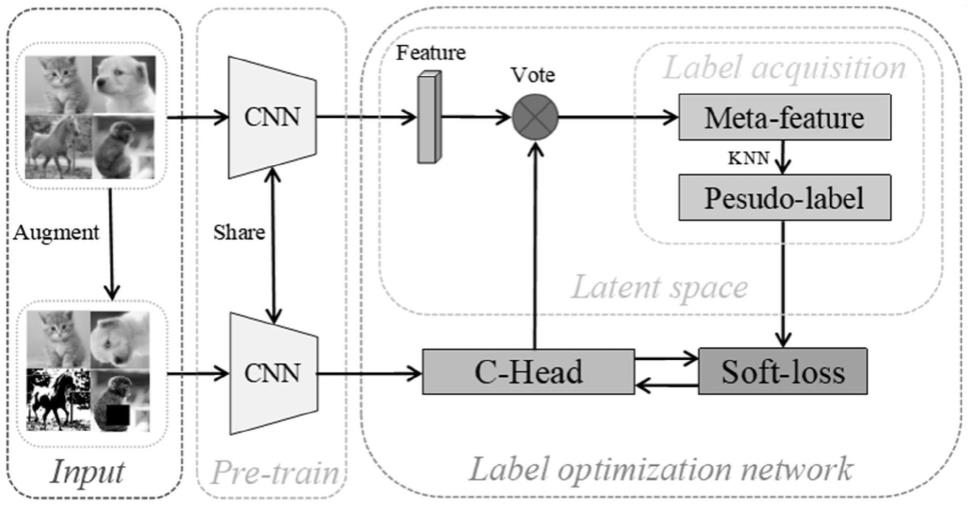

图1为本发明提供的基于元特征的伪监督聚类方法的原理示意图;

[0030]

图2为本发明实施例使用的数据集cifar-10、cifar-100和stl-10混淆矩阵;

[0031]

图3为本发明实施例在stl-10实验上得到的top-3类别图;

[0032]

图4为本发明实施例在stl-10上对主要对象的热图可视化图;

[0033]

图5为本发明实施例在三个图像数据集cifar-10、cifar-100和stl-10使用不同损失的实验结果对比图;

[0034]

图6为本发明实施例在cifar-10数据库下三种方法的实验结果对比图;

[0035]

图7为本发明实施例在cifar-100数据库下三种方法的实验结果对比图;

[0036]

图8为本发明实施例在stl-10数据库下三种方法的实验结果对比图。

具体实施方式

[0037]

为了进一步理解本发明,下面将结合附图和实施例对本发明中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0038]

本发明提供的一种基于元特征的伪监督聚类方法,包括:

[0039]

使用预训练好的深度模型提取实例级别特征,输入由两部分组成,原图像和数据增强后的图像,原图像输入预训练模型得到实例特征,增强图像经过预训练深度模型后将特征输入分类器,用于对样本概率进行预测;在聚类阶段,对第一阶段中置信度较高的样本进行挑选,将置信度高的样本挑选处理用于构建具有稳定语义信息的元特征;元特征由高置信度样本进行加权平均后形成,能够有效表示该类别的语义信息;选取出元特征后,在全局范围内为元特征寻找语义最近邻,为元特征和对应的语义最近邻分配相同的伪标签;使

用带有标签平滑的交叉熵损失逼近特征和伪标签,完成深度模型从特征到标签的映射,该过程重复执行,逐步提高元特征和伪标签的语义属性和聚类精度从而适应在复杂目标和环境所带来的模式变化;该方法将人类对事物认知中的稳定语义引入深度学习模型,具有重要意义。

[0040]

实施例1

[0041]

如图1所示,本实施例提供了一种基于元特征的伪监督聚类方法,首先通过实例级对比学习模型moco来进行预训练,参数冻结后,通过预训练的实例级对比学习模型提取实例级特征;利用分类器对类别样本进行预测,选出高置信度样本的特征并加权平均后作为元特征,在图3中给出了各个类别参与构建元特征的前三位的高置信度样本,这些样本都是语义鲁棒的,这为语义伪标签的正确分配提供了基准。与此同时,为了验证预训练深度模型提取的特征是否关注到了正确的语义,如图4所示,本实施例对参与构建元特征前三位的高置信度样本进行了类激活图的可视化,从图像中可以看出,类激活图的热量均关注到了语义类别,这也保证了分类语义的稳定性。然后为元特征在一个批次的全局范围内分配伪标签,通过一个带有标签平滑的交叉熵损失对元特征和伪标签进行进一步优化,不断提高分配标签的语义准确性,有效避免模型对于预测过于自信,如图5所示,本发明中采用的带有标签平滑的交叉熵损失函数和仅采用交叉熵损失函数的实验对比中,在三个数据集上,本发明提出的带有标签平滑的交叉熵损失函数的实验效果均好于直接使用交叉熵损失的实验效果;最后,通过不断迭代运行,分类器预测越来越准确,最终达到良好的聚类效果,本发明在cifar-10、cifar-100和stl-10聚类效果的混淆矩阵图如图2所示,从混淆矩阵图可以看出,混淆矩阵的对角线颜色深,这证明了方法进行了准确分类。最终,本实施例在图6、图7和图8中给出了本文方法和基于类别语义的方法contrasive clustering(下文称cc)和基于实例特征的伪标签分配方法(下文称scan)的对比,这些实验均证明,本发明提出的基于元特征的伪监督聚类方法相对于上述cc和scan具有显著优越性。

[0042]

具体的,基于元特征的伪监督聚类方法的步骤如下:

[0043]

一种基于元特征的伪监督聚类方法,包括以下步骤:

[0044]

s1:将数据集输入对比学习模型moco进行预训练;训练数据集均为图像数据集;当预训练的深度模型收敛之后,停止训练,将参数冻结,用于后续的深度模型进行实例级特征提取。

[0045]

本实施例基于现有的一些端到端的深度聚类方法所存在的对模型初始化很敏感的问题,对无监督学习模型进行预训练来获取实例级别的语义信息,并将预训练好的模型作为特征提取模型。考虑到样本对的数量对对比学习的重要影响,采用moco的工作,保证有足够的负例保证模型学到实例级语义特征,moco提出使用动量编码器替换存储器,通过维护一个动态的更新序列q来存储先前的迭代特征。

[0046]

假设有一个样本s及其增广版本的特征u和u’,对于moco工作,有以下形式:

[0047][0048]

其中,sim()是类似于余弦相似性的相似函数,τ是可调整的温度参数,m为队列大小;显然,这种损失有一个正样本和m个负样本。由于队列q不需要梯度,那么m的大小能够设

置很大,这对数据集的特征学习很有利。

[0049]

s2:目标是在不使用任何人工标注标签的情况下,将数据集χ划分入已经预定义好的k个类别,k∈[1,2

…

,s],具体来说,经过预训练对比学习模型作为特征提取模型f(

·

),输入部分包括两部分组成,一部分是原始数据x(即原始图像),这部分数据输入对比学习模型moco后,预训练模型,当模型收敛之后,将参数冻结,提取得到模型的实例级特征e=f(x);在工作中,原始图像输入对比学习模型moco后进行随机增强,然后通过卷积神经模型并通过对比损失保证迫使两个增强产生一致性预测,保证模型学到良好的特征表示。另一部分是随机增强后的图像r(x),这部分图像输入模型后得到f(r(x)),经过由两层mlp构成的分类器φc,分类器输出增强图像预测概率pk,

[0050]

pk=φc(f(r(x))),

[0051]ck

=topk(p

ki

,f(x)),

[0052]

其中,p

ki

是指第i个类别的预测概率;f(x)是原图像输入预训练模型后得到的特征;topk()是挑选对应类别中k个概率最高的特征;ck为自信样本。对相应类别的特征概率进行从高到低进行排列,根据余弦相似性度量选取每个类别概率最高的k个样本作为自信样本ck,自信样本加权平均后作为元特征f

meta

,

[0053][0054]

元特征由置信度最高的样本进行加权平均后形成,是相应类别中概率最高、最具有类别代表性的特征,有效保证了该类别稳定的语义属性,能够有效表示该类别的语义信息。

[0055]

s3:伪标签构建和伪标签全局分配;即,获取元特征后,在每个批次范围内为元特征在全局搜索近邻样本,并给其近邻样本分配相同的伪标签,lk={n(f

meta

)|k∈[1,2

…

,s]},其中,n(

·

)表示样本的全局最近邻,lk为元特征近邻分配的伪标签。

[0056]

s4:伪标签优化深度模型,采用带有标签平滑的交叉熵损失指导并优化元特征的选取和伪标签的分配;采用带有标签平滑的交叉熵损失函数,有效避免模型对于预测过于自信;通过不断迭代运行,分类器预测越来越准确,最终达到良好的聚类效果。

[0057]

实现样本分类本质上就是通过分配标签将样本区分开的过程,因此,在本实施例中采取标签优化方案。具体来说,标签优化方案主要由以下两部分组成:伪标签优化模型和标签平滑损失。

[0058]

1)伪标签优化模型

[0059]

伪标签优化模型的思想是通过建立嵌入特征和伪标签的映射关系训练分类器。与现有方法中仅通过挖掘实例级语义相似性或仅关注聚类不同,本发明提出了基于元特征的伪监督分类,既保留了实例级别的判别信息又考虑到分类边界处距离度量可能造成的语义不一致性问题。元特征选取、伪标签构建和分类器优化是一个动态优化的过程,具体来说,获取的伪标签和分类器通过软交叉熵损失进行优化,得到优化的分类器在下一个轮次继续参与自信样本的选举、元特征构建,最小化伪标签和分类器预测之间的交叉熵损失,通过多次迭代优化,分类器学到良好的特征和伪标签的映射关系。

[0060]

2)标签平滑损失

[0061]

采用最小化交叉熵损失优化分类模型,考虑到伪标签构造过程中不可避免引入噪

声,为了将模型从过度自信调整为噪声预测,本发明采用了标签平滑的正则化方法。标签平滑方法通过添加均匀噪音来规定类别伪标签y,并改进预测中的校准。给定带有相应标签,将噪声注入所有类别,如下所示:

[0062][0063]

其中,c是类别数量,ε-uniform(0,1)是噪声,y是类别伪标签,是添加均匀噪声后的类别伪标签。使用添加均匀噪声后的类别伪标签和随机增强样本的预测标签来计算交叉熵。

[0064][0065]

其中,pi由对模型倒数第二层输出的logits向量z应用到函数计算得到,

[0066][0067]

这里主要针对传统one-hot编码标签的模型学习过程中,鼓励模型预测为目标类别的概率趋近于1,非目标类别概率趋近0,即最终预测的logits向量中目标类别zi的值会趋于无穷大,使得模型向预测正确与错误标签的logit差值无限增大的方向学习,而过大的logit差值会使模型缺乏适应性,对它的预测过于自信。而在标签分发的策略中,由于度量造成的误差不可避免的引入噪声标签,通过标签平滑策略,使得模型缩小预测正负样本的输出值差别,提高模型的鲁棒性。

[0068]

上述说明仅为本发明的优选实施例,并非是对本发明的限制,尽管参照前述实施例对本发明进行了详细的说明,对于本领域技术人员来说,其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换。凡在本发明的精神和原则之内,所作的任何修改、等同替换、改型等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。