1.本发明涉及智能眼镜技术领域,特别涉及一种眼动跟踪交互的智能眼镜及其方法。

背景技术:

2.智能眼镜设备包括ar、mr眼镜等,其交互方法可以提高人对眼镜的交互效率,减少操作强度。

3.公开号为cn111475017a的中国专利公开了一种智能眼镜设备及人机交互方法。所述智能眼镜设备包括:智能交互眼镜、眼球拍摄摄像头、服务器、触摸键盘眼镜盒和触摸按键戒指;智能交互眼镜上设置眼球拍摄摄像头和服务器;服务器分别与智能交互眼镜和眼球拍摄摄像头连接;服务器与触摸键盘眼镜盒和触摸按键戒指无线连接;触摸键盘眼镜盒的内壁上设置有按键;设置有按键的触摸键盘眼镜盒的内壁之间铰接;触摸键盘眼镜盒用于向智能交互眼镜输入信息。能够在避免用户过多运动肢体造成疲劳的情况下,实现用户自然、高效、准确地与智能眼镜设备进行交互。

4.公开号为cn103336575b的中国专利公开了一种人机交互的智能眼镜系统,包括:智能眼镜,为可透视型智能眼镜,能够使可见光透过所述智能眼镜镜片,同时将图像信息叠加在人的真实视野上;智能眼镜上安装两个摄像头和一个红外led,两个摄像头平行对称安装于智能眼镜的左右两端,红外led安装在所述智能眼镜的中心位置;智能眼镜的两个摄像头和红外led组成了一个用于捕捉一定三维空间范围内物体运动轨迹和坐标的三维运动捕捉系统。对人的手指运动信息进行捕捉并判断,实现与智能眼镜进行人机交互。但是上述专利存在以下缺陷:

5.采用智能眼镜进行数据交互时,仍需要借助于外界设备且用户手部操作,不能解放用户双手,其交互不便利,使智能眼镜服务不便捷。

技术实现要素:

6.本发明的目的在于提供一种眼动跟踪交互的智能眼镜及其方法,利用用户眼动状态进行智能交互,不需要借助于外界设备即可实现智能交互,使智能眼镜服务更加便捷,根据不同的响应策略进行眼动跟踪的智能交互,使智能交互便利,解放双手,以解决上述背景技术中提出的问题。

7.为实现上述目的,本发明提供如下技术方案:

8.一种眼动跟踪交互的智能眼镜,包括智能交互眼镜体,所述智能交互眼镜体上设置有左镜片和右镜片且左镜片和右镜片对称分布,所述智能交互眼镜体上设置有信息采集模块和交互服务器,所述信息采集模块通过无线网络与交互服务器进行数据交互。

9.进一步地,所述信息采集模块包括惯性测量单元、高清采集摄像头、测距传感器和计时传感器,其中

10.所述惯性测量单元安装在智能交互眼镜体上,且惯性测量单元用于测量用户眼球

相对于用户头部移动的三轴姿态角以及加速度,其中惯性测量单元包含了三个单轴的加速度计和三个单轴的陀螺,加速度计用于检测用户眼球在移动的过程中在载体坐标系统独立三轴的加速度信号,陀螺用于检测用户眼球在移动的过程中相对于导航坐标系的角速度信号,测量用户眼球在移动的过程中在三维空间中的角速度和加速度,且以此解算出用户眼球移动时的姿态;

11.所述高清采集摄像头为两个且对称安装在智能交互眼镜体上,两个所述高清采集摄像头分别位于左镜片和右镜片的上方,且高清采集摄像头用于实时拍摄用户眼球移动的情况且感知用户眼动状态;

12.所述测距传感器安装在智能交互眼镜体的中端,所述测距传感器为激光测距传感器,且测距传感器用于测量用户头部到正前方障碍物的直线距离;

13.所述计时传感器安装在智能交互眼镜体上,所述计时传感器用于对用户眼球移动且观看时进行定时,记录用户眼动观看时间。

14.进一步地,所述交互服务器内置有信息处理模块、信息分析模块和交互执行模块,其中

15.信息处理模块用于对信息采集模块实时采集的眼动数据进行处理,首先对实时采集的眼动数据进行特征提取且自动获取眼动数据,对获取的眼动数据进行识别判断,且生成相对应地三维坐标,最终形成眼动跟踪坐标体系,且将处理后的所述眼动跟踪数据传送给信息分析模块;

16.信息分析模块用于对信息处理模块实时处理的眼动跟踪数据进行分析,首先根据形成的眼动跟踪坐标体系查找出用户想要交互访问的roi区域,根据计时传感器记录的用户眼动观看时间且参照访问存储单元内存储的访问交互阈值,对用户想要交互访问的roi区域进行自动化分析,判断用户是否需要进行交互,且将分析结果反馈给交互执行模块;

17.交互执行模块用于对信息分析模块实时传送的分析结果进行交互执行,首先读取用户想要交互访问的roi区域的分析结果,分析结果读取后,根据不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互。

18.进一步地,所述信息处理模块处理实时采集的眼动数据,执行以下操作:

19.信息采集模块实时采集眼动数据后,将实时采集的所述眼动数据传送给特征提取单元,利用特征提取单元对实时采集的三轴姿态角、加速度、用户眼动状态、用户头部到正前方障碍物的直线距离以及用户眼动观看时间进行特征提取,提取出有用地用户眼动数据,且将提取的有用地用户眼动数据传送给识别判断单元;

20.识别判断单元接收到特征提取单元传送的提取数据后,利用识别判断单元对提取的有用地用户眼动数据进行识别判断,找出用户眼动数据之间的相互关联,根据三轴姿态角、加速度及用户眼动状态生成相对应地三维坐标,最终形成眼动跟踪坐标体系。

21.进一步地,所述信息分析模块分析所述眼动跟踪数据,执行以下操作:

22.识别判断单元将最终形成的所述眼动跟踪坐标体系数据传送给区域查找单元,利用区域查找单元从接收的所述眼动跟踪坐标体系数据中以方框、圆、椭圆、不规则多边形等方式勾勒出用户想要交互访问的区域,查找出用户想要交互访问的roi区域,且将查找的用户想要交互访问的roi区域传送给自动分析单元;

23.自动分析单元接收到识别判断单元传送的roi区域数据后,利用自动分析单元对

用户想要交互访问的roi区域进行自动化分析,判断用户是否需要进行智能交互;

24.对roi区域进行自动化分析时,自动分析单元向计时传感器传送指令,根据计时传感器实时记录用户眼动观看时间,且将实时记录的用户眼动观看时间传送给自动分析单元;

25.自动分析单元接收到计时传感器传送的用户眼动观看时间后,根据计时传感器记录的用户眼动观看时间且参照访问存储单元内存储的访问交互阈值进行分析,且将分析结果反馈给交互执行模块。

26.进一步地,所述区域查找单元,包括:

27.序列确定子单元,用于基于所述眼动跟踪坐标体系数据确定出眼动轨迹,并确定出每个眼动轨迹点的坐标值,基于所述眼动轨迹中的眼动轨迹点的点序列将每个眼动轨迹点的横坐标值进行排序,获得横向坐标序列,同时,基于所述点序列将每个眼动轨迹点的纵坐标值进行排序,获得纵向坐标序列;

28.第一确定子单元,用于确定出所述横向坐标序列中每个横坐标值与对应前一横坐标值的横坐标差值,统计出所述横坐标差值中包含的正数的第一总数和包含的负数的第二总数,将所述第一总数和所述第二总数中的较小值和所述眼动轨迹中包含的眼动轨迹点的第一眼动轨迹点总数的比值作为所述眼动轨迹的第一往返系数;

29.第二确定子单元,用于确定出所述纵向坐标序列中每个纵坐标值与对应前一纵坐标值的纵坐标差值,统计出所述纵坐标差值中包含的正数的第三总数和包含的负数的第四总数,将所述第三总数和所述第四总数中的较小值和所述第一眼动轨迹点总数的比值作为所述眼动轨迹的第二往返系数;

30.权重确定子单元,用于将所述第一往返系数和第二往返系数的和作为所述眼动轨迹的综合往返系数,将所述眼动轨迹点在所述眼动轨迹中的点序数和所述眼动轨迹中包含的眼动轨迹点的第一眼动轨迹点总数的比值当作所述眼动轨迹点的追踪权重,基于所述追踪权重和所述综合往返系数确定出所述眼动追踪点的感兴趣权重;

31.区域确定子单元,用于以所述眼动轨迹点为视野中心位置,基于对应的感兴趣权重,确定出所述眼动轨迹点的追踪区域,将所有眼动轨迹点对应的追踪区域汇总,获得对应的综合追踪区域;

32.最终确定子单元,用于确定出所述综合追踪区域与预设形状列表中包含的预设形状的匹配度,基于最大匹配度对应的预设形状确定出包含所述综合追踪区域的最小区域,将所述最小区域当作用户想要交互访问的roi区域,且将确定的用户想要交互访问的roi区域传送给自动分析单元;

33.其中,预设形状列表包含方框、圆、椭圆、不规则多边形。

34.进一步地,其特征在于,所述自动分析单元,包括:

35.区域读取子单元,用于对所述roi区域进行信息读取,获得所述roi区域中包含的感兴趣信息和感兴趣图形,

36.指令读取子单元,用于获取最新交互指令,并调取出所述最新交互指令对应的交互roi区域,对所述交互roi区域进行信息读取,获得最新交互信息;

37.词汇排序子单元,用于识别出所述感兴趣信息中的第一核心词汇,基于所述第一核心词汇在所述感兴趣信息中的出现顺序对所述第一核心词汇进行排序,获得第一核心词

汇序列,同时,识别出所述最新交互信息中的第二核心词汇,基于所述第二核心词汇在所述最新交互信息中的出现顺序对所述第二核心词汇进行排序,获得第二核心词汇序列;

38.第三确定子单元,用于基于所述第一核心词汇序列和所述第二核心词汇序列确定出所述感兴趣信息和最新交互信息之间的关联程度,基于预设感兴趣形状列表,确定出所述感兴趣形状的预测感兴趣程度,基于所述预测感兴趣程度和所述关联程度确定出第一交互程度系数;

39.轨迹划分子单元,用于基于所述roi区域调取出对应的眼动轨迹,确定出眼动轨迹中包含的拐点,基于所述拐点将所述眼动轨迹划分为多个眼动子轨迹;

40.系数确定子单元,用于基于所述眼动轨迹中包含的拐点总数和所述第一眼动轨迹点总数的比值确定出所述眼动轨迹的轨迹振动系数,基于所述眼动子轨迹中包含的眼动轨迹点的第二眼动轨迹点总数和所述第一眼动轨迹点总数的比值确定出所述眼动子轨迹的子交互程度系数;

41.第四确定子单元,用于基于所述最大子交互程度系数和所述轨迹振动系数确定出第二交互程度系数;

42.最终判断子单元,用于基于所述第一交互程度系数和所述第二交互程度系数确定出综合交互系数,当所述综合交互系数大于交互系数阈值时,则判定用户需要进行智能交互,否则,判定用户不需要进行智能交互。

43.进一步地,所述交互执行模块执行分析结果,执行以下操作:

44.自动分析单元将最终形成的分析结果传送给信息读取单元,利用信息读取单元对用户想要交互访问的roi区域的分析结果进行相应地读取,且将信息读取结果传送给策略执行单元;

45.策略执行单元接收到信息读取单元传送的信息读取结果后,利用策略执行单元对不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互。

46.进一步地,所述策略执行单元执行以下操作:

47.针对计时传感器记录的用户眼动观看时间值未超过访问存储单元内存储的访问交互阈值的分析结果,则策略执行单元根据该种分析结果,执行一级响应策略,则此时用户观看页面未出现变化,使用户与观看页面未进行交互;

48.针对计时传感器记录的用户眼动观看时间值超过访问存储单元内存储的访问交互阈值的分析结果,则策略执行单元根据该种分析结果,执行二级响应策略,则此时用户观看页面出现变化,使用户与观看页面进行眼动跟踪智能交互。

49.根据本发明的另一个方面,提供了一种眼动跟踪交互的智能眼镜的眼动跟踪交互方法,包括如下步骤:

50.s10:用户佩戴智能眼镜,采用信息采集模块实时采集用户眼动的三轴姿态角以及加速度,实时拍摄用户眼球移动的情况且感知用户眼动状态,测量用户头部到正前方障碍物的直线距离及记录用户眼动观看时间,上述眼动数据信息采集后,且实时采集的所述眼动数据信息传送给信息处理模块;

51.s20:信息处理模块对实时采集的所述眼动数据信息进行特征提取,提取出有用地用户眼动数据,且对提取的有用地用户眼动数据进行识别判断,找出用户眼动数据之间的

相互关联,根据三轴姿态角、加速度及用户眼动状态生成相对应地三维坐标,最终形成眼动跟踪坐标体系,且所述眼动跟踪坐标体系数据传送给信息分析模块;

52.s30:信息分析模块从接收的所述眼动跟踪坐标体系数据中以方框、圆、椭圆、不规则多边形等方式勾勒出用户想要交互访问的区域,查找出用户想要交互访问的roi区域,根据计时传感器记录的用户眼动观看时间且参照访问存储单元内存储的访问交互阈值对用户想要交互访问的roi区域进行自动化分析,判断用户是否需要进行智能交互,且将分析结果反馈给交互执行模块;

53.s40:交互执行模块对用户想要交互访问的roi区域的分析结果进行相应地读取,对不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互。

54.与现有技术相比,本发明的有益效果是:

55.1、本发明的眼动跟踪交互的智能眼镜及其方法,用户佩戴智能眼镜,采用信息采集模块实时采集用户眼动的三轴姿态角以及加速度,实时拍摄用户眼球移动的情况且感知用户眼动状态,测量用户头部到正前方障碍物的直线距离及记录用户眼动观看时间,上述眼动数据信息采集后,信息处理模块对实时采集的眼动数据信息进行特征提取,提取出有用地用户眼动数据,且对提取的有用地用户眼动数据进行识别判断,找出用户眼动数据之间的相互关联,根据三轴姿态角、加速度及用户眼动状态生成相对应地三维坐标,最终形成眼动跟踪坐标体系,便于了解用户眼动状态,利用用户眼动状态进行智能交互,不需要借助于外界设备即可实现智能交互,使智能眼镜服务更加便捷。

56.2、本发明的眼动跟踪交互的智能眼镜及其方法,信息分析模块从接收的眼动跟踪坐标体系数据中以方框、圆、椭圆、不规则多边形等方式勾勒出用户想要交互访问的区域,查找出用户想要交互访问的roi区域,根据计时传感器5记录的用户眼动观看时间且参照访问存储单元内存储的访问交互阈值对用户想要交互访问的roi区域进行自动化分析,判断用户是否需要进行智能交互,交互执行模块对用户想要交互访问的roi区域的分析结果进行相应地读取,对不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互,使智能交互便利,解放双手。

57.3、本发明的眼动跟踪交互的智能眼镜及其方法,通过区域查找单元中包含的序列确定子单元确定出对应的坐标值序列,为后续确定出眼动轨迹的综合往返系数提供了重要的数据基础;基于第一确定子单元和第二确定子单元实现基于眼动轨迹中每个横坐标和前一横坐标的差值中的正数的个数和负数的个数以及每个纵坐标和前一纵坐标的差值中的正数的个数和负数的个数确定出表征眼动轨迹中往返次数的综合往返系数,为准确确定出用户的感兴趣区域提供了基础,基于权重确定子单元实现了考虑到了眼动轨迹中包含的眼动轨迹的点序数对区域确定的影响程度和眼动轨迹中往返次数的系数确定出眼动追踪点的感兴趣权重,基于区域确定子单元和最终确定子单元实现了基于感兴趣权重准确划分出用户想要交互的感兴趣区域,实现基于对眼动轨迹的追踪分析确定区域的划分权重,使得划分出的感兴趣区域更加贴近用户的交互需求。

58.4、本发明的眼动跟踪交互的智能眼镜及其方法,通过自动分析单元中包含的区域读取子单元和指令读取子单元,实现了对当前确定出的感兴趣区域中包含的信息和图形以及最后一次执行的交互指令对应的感兴趣区域中包含的信息和图形的读取,为后续确定出

当前的感兴趣区域和最后一次执行的交互指令对应的感兴趣区域之间的关联程度提供了重要的信息基础,再基于词汇排序子单元和第三确定子单元,实现了综合确定出的当前的感兴趣区域和最后一次执行的交互指令对应的感兴趣区域之间的关联程度以及感兴趣图形的预测感兴趣权重确定出表征用户想要进行交互的程度系数,基于轨迹划分子单元、系数确定子单元、第四确定子单元,实现了综合眼动轨迹的拐点统计和最长的无拐点眼动子轨迹的影响,确定出第二交互程度系数,最后通过最终判断子单元综合第一交互程度系数和第二交互程度系数与交互程度系数阈值的比较,判断用户是否需要进行智能交互,实现了综合考虑到了用户在感兴趣区域中往返次数以及持续注视的轨迹长度等因素判断用户的交互需求。

附图说明

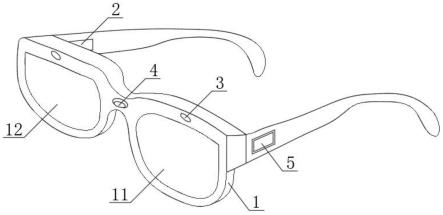

59.图1为本发明的眼动跟踪交互的智能眼镜的示意图;

60.图2为本发明的眼动跟踪交互的智能眼镜的原理图;

61.图3为本发明的眼动跟踪交互的智能眼镜的模块图;

62.图4为本发明的交互执行模块执行分析结果的算法图;

63.图5为本发明的眼动跟踪交互方法的流程图;

64.图6为本发明的区域查找单元示意图;

65.图7为本发明的自动分析单元示意图。

66.图中:1、智能交互眼镜体;11、左镜片;12、右镜片;2、惯性测量单元;3、高清采集摄像头;4、测距传感器;5、计时传感器。

具体实施方式

67.下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

68.实施例一

69.参阅图1-图3,一种眼动跟踪交互的智能眼镜,包括智能交互眼镜体1,智能交互眼镜体1上设置有左镜片11和右镜片12且左镜片11和右镜片12对称分布。

70.智能交互眼镜体1上设置有信息采集模块和交互服务器,信息采集模块通过无线网络与交互服务器进行数据交互。

71.信息采集模块包括惯性测量单元2、高清采集摄像头3、测距传感器4和计时传感器5,其中

72.惯性测量单元2安装在智能交互眼镜体1上,且惯性测量单元2用于测量用户眼球相对于用户头部移动的三轴姿态角以及加速度。

73.其中惯性测量单元2包含了三个单轴的加速度计和三个单轴的陀螺,加速度计用于检测用户眼球在移动的过程中在载体坐标系统独立三轴的加速度信号,陀螺用于检测用户眼球在移动的过程中相对于导航坐标系的角速度信号,测量用户眼球在移动的过程中在三维空间中的角速度和加速度,且以此解算出用户眼球移动时的姿态;

74.惯性测量装置imu属于捷联式惯导,该系统有三个加速度传感器与三个角速度传感器组成,加速度计用来感受用户眼动相对于地垂线的加速度分量,角速度传感器用来感受用户眼动的角度信息,该子部件主要有两个a/d转换器ad7716bs与64k的e/eprom存储器x25650构成,a/d转换器采用imu各传感器的模拟变量,转换为数字信息后经过cpu计算后最后输出用户眼动俯仰角度及倾斜角度。

75.高清采集摄像头3为两个且对称安装在智能交互眼镜体1上,两个高清采集摄像头3分别位于左镜片11和右镜片12的上方,且高清采集摄像头3用于实时拍摄用户眼球移动的情况且感知用户眼动状态;

76.测距传感器4安装在智能交互眼镜体1的中端,测距传感器4为激光测距传感器,且测距传感器4用于测量用户头部到正前方障碍物的直线距离;

77.计时传感器5安装在智能交互眼镜体1上,计时传感器5用于对用户眼球移动且观看时进行定时,记录用户眼动观看时间。

78.实施例二

79.交互服务器内置有信息处理模块、信息分析模块和交互执行模块,其中信息处理模块、信息分析模块和交互执行模块之间进行数据传输的步骤为:

80.s1:对实时采集的眼动数据进行特征提取且自动获取眼动数据,对获取的眼动数据进行识别判断,且生成相对应地三维坐标,最终形成眼动跟踪坐标体系,且将处理后的眼动跟踪数据传送给信息分析模块;

81.需要说明的是,信息处理模块处理实时采集的眼动数据的步骤为:

82.s11:信息采集模块实时采集眼动数据后,将实时采集的眼动数据传送给特征提取单元,利用特征提取单元对实时采集的三轴姿态角、加速度、用户眼动状态、用户头部到正前方障碍物的直线距离以及用户眼动观看时间进行特征提取,提取出有用地用户眼动数据,且将提取的有用地用户眼动数据传送给识别判断单元;

83.s12:识别判断单元接收到特征提取单元传送的提取数据后,利用识别判断单元对提取的有用地用户眼动数据进行识别判断,找出用户眼动数据之间的相互关联,根据三轴姿态角、加速度及用户眼动状态生成相对应地三维坐标,最终形成眼动跟踪坐标体系。

84.s2:根据形成的眼动跟踪坐标体系查找出用户想要交互访问的roi区域,根据计时传感器5记录的用户眼动观看时间且参照访问存储单元内存储的访问交互阈值,对用户想要交互访问的roi区域进行自动化分析,判断用户是否需要进行交互,且将分析结果反馈给交互执行模块;

85.roi属于ive技术的一种,即智能视频编码,ive技术可以根据客户要求对视频进行智能编码,并在不损失图像质量的前提下,优化视频编码性能,最终降低网络带宽占用率和减少存储空间,在监控画面中,有些监控区域是不需要被监控或无关紧要,例如天空,墙壁,草地等等监控对象,普通网络监控摄像机对整个区域进行视频编码并传输,这样就给网络带宽和视频存储带来了压力,而roi智能视频编码技术却很好的解决了这个问题,roi功能的摄像机可以让用户选择画面中感兴趣的区域,启用roi功能后,重要的或者移动的区域将会进行高质量无损编码,而对那些不移动,不被选择的区域降低其码率和图像质量,进行标准清晰度视频压缩,甚至是不传输这部分区域视频,达到节省网络带宽占用和视频存储空间。

86.需要说明的是,信息分析模块分析眼动跟踪数据的步骤为:

87.s21:识别判断单元将最终形成的眼动跟踪坐标体系数据传送给区域查找单元,利用区域查找单元从接收的眼动跟踪坐标体系数据中以方框、圆、椭圆、不规则多边形等方式勾勒出用户想要交互访问的区域,查找出用户想要交互访问的roi区域,且将查找的用户想要交互访问的roi区域传送给自动分析单元;

88.s22:自动分析单元接收到识别判断单元传送的roi区域数据后,利用自动分析单元对用户想要交互访问的roi区域进行自动化分析,判断用户是否需要进行智能交互;

89.参阅图6,s21中的所述区域查找单元,包括:

90.序列确定子单元,用于基于所述眼动跟踪坐标体系数据确定出眼动轨迹,并确定出每个眼动轨迹点的坐标值,基于所述眼动轨迹中的眼动轨迹点的点序列将每个眼动轨迹点的横坐标值进行排序,获得横向坐标序列,同时,基于所述点序列将每个眼动轨迹点的纵坐标值进行排序,获得纵向坐标序列;

91.第一确定子单元,用于确定出所述横向坐标序列中每个横坐标值与对应前一横坐标值的横坐标差值,统计出所述横坐标差值中包含的正数的第一总数和包含的负数的第二总数,将所述第一总数和所述第二总数中的较小值和所述眼动轨迹中包含的眼动轨迹点的第一眼动轨迹点总数的比值作为所述眼动轨迹的第一往返系数;

92.第二确定子单元,用于确定出所述纵向坐标序列中每个纵坐标值与对应前一纵坐标值的纵坐标差值,统计出所述纵坐标差值中包含的正数的第三总数和包含的负数的第四总数,将所述第三总数和所述第四总数中的较小值和所述第一眼动轨迹点总数的比值作为所述眼动轨迹的第二往返系数;

93.权重确定子单元,用于将所述第一往返系数和第二往返系数的和作为所述眼动轨迹的综合往返系数,将所述眼动轨迹点在所述眼动轨迹中的点序数和所述眼动轨迹中包含的眼动轨迹点的第一眼动轨迹点总数的比值当作所述眼动轨迹点的追踪权重,基于所述追踪权重和所述综合往返系数确定出所述眼动追踪点的感兴趣权重;

94.区域确定子单元,用于以所述眼动轨迹点为视野中心位置,基于对应的感兴趣权重,确定出所述眼动轨迹点的追踪区域,将所有眼动轨迹点对应的追踪区域汇总,获得对应的综合追踪区域;

95.最终确定子单元,用于确定出所述综合追踪区域与预设形状列表中包含的预设形状的匹配度,基于最大匹配度对应的预设形状确定出包含所述综合追踪区域的最小区域,将所述最小区域当作用户想要交互访问的roi区域,且将确定的用户想要交互访问的roi区域传送给自动分析单元;

96.其中,预设形状列表包含方框、圆、椭圆、不规则多边形。

97.该实施例中,眼动轨迹即为基于眼动跟踪坐标体系数据确定出的用户眼球注视点移动的轨迹。

98.该实施例中,横向坐标序列即为基于眼动轨迹中的眼动轨迹点的点序列将每个眼动轨迹点的横坐标值进行排序后获得的横坐标的序列。

99.该实施例中,眼动轨迹点即为眼动轨迹中包含的坐标点。

100.该实施例中,纵向坐标序列即为基于眼动轨迹中的眼动轨迹点的点序列将每个眼动轨迹点的纵坐标值进行排序后获得的横坐标的序列。

101.该实施例中,第一总数即为横向坐标序列中每个横坐标值与对应前一横坐标值的横坐标差值中包含的正数的总数。

102.该实施例中,第二总数即为横向坐标序列中每个横坐标值与对应前一横坐标值的横坐标差值中包含的负数的总数。

103.该实施例中,第一往返系数即为基于眼动轨迹点的横坐标确定出表征眼动轨迹横向往返次数的系数。

104.该实施例中,第三总数即为纵向坐标序列中每个纵坐标值与对应前一纵坐标值的纵坐标差值中包含的正数的总数。

105.该实施例中,第四总数即为纵向坐标序列中每个纵坐标值与对应前一纵坐标值的纵坐标差值中包含的负数的总数。

106.该实施例中,第二往返系数即为基于眼动轨迹点的横坐标确定出表征眼动轨迹纵向往返次数的系数。

107.该实施例中,综合往返系数即为第一往返系数和第二往返系数的和。

108.该实施例中,追踪权重即为眼动轨迹点在眼动轨迹中的点序数和眼动轨迹中包含的第一眼动轨迹点总数的比值。

109.该实施例中,第一眼动轨迹点总数即为眼动轨迹中包含的眼动轨迹点的总数。

110.该实施例中,感兴趣权重即为追踪权重和综合往返系数的乘积。

111.该实施例中,以所述眼动轨迹点为视野中心位置,基于对应的感兴趣权重,确定出所述眼动轨迹点的追踪区域,包括:

112.以眼动轨迹点为圆心、以预设划分长度和感兴趣权重的乘积为半径,确定出的圆区域即为眼动轨迹点的追踪区域。

113.该实施例中,视野中心位置即为追踪区域的中心位置。

114.该实施例中,综合追踪区域即为将所有眼动轨迹点对应的追踪区域汇总后获得的区域。

115.该实施例中,预设形状列表即为包含方框、圆、椭圆、不规则多边形的列表。

116.该实施例中,预设形状即为方框、圆、椭圆、不规则多边形。

117.该实施例中,确定出所述综合追踪区域与预设形状列表中包含的预设形状的匹配度,包括:

118.基于综合追踪区域的第一轮廓点的坐标值和预设形状的第二轮廓点的坐标值,计算出综合追踪区域与预设形状的匹配度,包括:

[0119][0120]

式中,ρ为综合追踪区域与预设形状的匹配度,i为综合追踪区域中的第i个第一轮廓点,n为综合追踪区域中包含的第一轮廓点的总数,j为预设形状中的第j个第二轮廓点,m为预设形状中包含的第二轮廓点的总数,xi为第i个第一轮廓点的横坐标值,xj为第j个第二轮廓点的横坐标值,yi为第i个第一轮廓点的纵坐标值,xj为第j个第二轮廓点的纵坐标值;

[0121]

式中,第一轮廓点的坐标值分别为(3,4)、(5,12)、(6,8),第二轮廓点的坐标值分

别为(4,4)、(5,5)、(6,6),则ρ为0.868;

[0122]

基于1与综合追踪区域中包含的每个第一轮廓点和预设形状中的每个第二轮廓点之间的坐标差值和对应第一轮廓点与坐标原点的差值的比值的差值,准确确定出综合追踪区域与预设形状的匹配度。

[0123]

该实施例中,最小区域即为最大匹配度对应的预设形状的、包含综合追踪区域的面积最小的区域。

[0124]

以上技术的有益效果为:本发明的眼动跟踪交互的智能眼镜及其方法,通过区域查找单元中包含的序列确定子单元确定出对应的坐标值序列,为后续确定出眼动轨迹的综合往返系数提供了重要的数据基础;基于第一确定子单元和第二确定子单元实现基于眼动轨迹中每个横坐标和前一横坐标的差值中的正数的个数和负数的个数以及每个纵坐标和前一纵坐标的差值中的正数的个数和负数的个数确定出表征眼动轨迹中往返次数的综合往返系数,为准确确定出用户的感兴趣区域提供了基础,基于权重确定子单元实现了考虑到了眼动轨迹中包含的眼动轨迹的点序数对区域确定的影响程度和眼动轨迹中往返次数的系数确定出眼动追踪点的感兴趣权重,基于区域确定子单元和最终确定子单元实现了基于感兴趣权重准确划分出用户想要交互的感兴趣区域,实现基于对眼动轨迹的追踪分析确定区域的划分权重,使得划分出的感兴趣区域更加贴近用户的交互需求。

[0125]

参阅图7,s22中的所述自动分析单元,包括:

[0126]

区域读取子单元,用于对所述roi区域进行信息读取,获得所述roi区域中包含的感兴趣信息和感兴趣图形,

[0127]

指令读取子单元,用于获取最新交互指令,并调取出所述最新交互指令对应的交互roi区域,对所述交互roi区域进行信息读取,获得最新交互信息;

[0128]

词汇排序子单元,用于识别出所述感兴趣信息中的第一核心词汇,基于所述第一核心词汇在所述感兴趣信息中的出现顺序对所述第一核心词汇进行排序,获得第一核心词汇序列,同时,识别出所述最新交互信息中的第二核心词汇,基于所述第二核心词汇在所述最新交互信息中的出现顺序对所述第二核心词汇进行排序,获得第二核心词汇序列;

[0129]

第三确定子单元,用于基于所述第一核心词汇序列和所述第二核心词汇序列确定出所述感兴趣信息和最新交互信息之间的关联程度,基于预设感兴趣形状列表,确定出所述感兴趣形状的预测感兴趣程度,基于所述预测感兴趣程度和所述关联程度确定出第一交互程度系数;

[0130]

轨迹划分子单元,用于基于所述roi区域调取出对应的眼动轨迹,确定出眼动轨迹中包含的拐点,基于所述拐点将所述眼动轨迹划分为多个眼动子轨迹;

[0131]

系数确定子单元,用于基于所述眼动轨迹中包含的拐点总数和所述第一眼动轨迹点总数的比值确定出所述眼动轨迹的轨迹振动系数,基于所述眼动子轨迹中包含的眼动轨迹点的第二眼动轨迹点总数和所述第一眼动轨迹点总数的比值确定出所述眼动子轨迹的子交互程度系数;

[0132]

第四确定子单元,用于基于所述最大子交互程度系数和所述轨迹振动系数确定出第二交互程度系数;

[0133]

最终判断子单元,用于基于所述第一交互程度系数和所述第二交互程度系数确定出综合交互系数,当所述综合交互系数大于交互系数阈值时,则判定用户需要进行智能交

互,否则,判定用户不需要进行智能交互。

[0134]

该实施例中,感兴趣信息即为roi区域中包含的信息。

[0135]

该实施例中,感兴趣图形即为roi区域中包含的图形。

[0136]

该实施例中,最新交互指令即为最新一次判断用户需要进行智能交互时执行的交互指令。

[0137]

该实施例中,交互roi区域即为最新一次判断用户需要进行智能交互时的roi区域。

[0138]

该实施例中,最新交互信息即为在交互roi区域中读取的信息。

[0139]

该实施例中,第一核心词汇即为感兴趣信息中包含的核心词汇(预设核心词汇库中的词汇)。

[0140]

该实施例中,第一核心词汇序列即为基于第一核心词汇在感兴趣信息中的出现顺序对第一核心词汇进行排序后获得的词汇序列。

[0141]

该实施例中,第二核心词汇即为最新交互信息中包含的核心词汇。

[0142]

该实施例中,第二核心词汇序列即为基于第二核心词汇在最新交互信息中的出现顺序对第二核心词汇进行排序后获得的词汇序列。

[0143]

该实施例中,基于所述第一核心词汇序列和所述第二核心词汇序列确定出所述感兴趣信息和最新交互信息之间的关联程度,包括:

[0144]

确定出第一核心词汇在第一核心词汇序列中的第一词序数以及第二核心词汇在第二核心词汇序列中的第二词序数,基于核心词汇关联系数列表(即包含不同核心词汇之间的关联系数)确定出每个第一核心词汇和每个第二核心词汇之间的关联系数,基于第一词序数和第二词序数以及关联系数计算出感兴趣信息和最新交互信息之间的关联程度:

[0145][0146]

式中,ε为感兴趣信息和最新交互信息之间的关联程度,p为第一核心词汇序列中的第p个第一核心词汇,a为第一核心词汇序列中包含的第一核心词汇的总个数,q为第二核心词汇序列中的第q个第二核心词汇,b为第二核心词汇序列中包含的第二核心词汇的总个数,g

pq

为第p个第一核心词汇和第q个第二核心词汇之间的关联程度;

[0147]

例如,a为2,b为2,g

11

为0.5,g

12

为0.8,g

21

为0.1,g

22

为0.6,ε为0.175;

[0148]

基于第一核心词汇在第一核心词汇序列中的第一词序数以及第二核心词汇在第二核心词汇序列中的第二词序数以及每个第一核心词汇和每个第二核心词汇之间的关联系数,准确地计算出感兴趣信息和最新交互信息之间的关联程度。

[0149]

该实施例中,预设感兴趣形状列表即为包含每个感兴趣形状的预测感兴趣程度地列表。

[0150]

该实施例中,第一交互程度系数即为预测感兴趣程度和关联程度的乘积。

[0151]

该实施例中,拐点即为眼动轨迹中拐弯的点。

[0152]

该实施例中,眼动子轨迹即为基于拐点将眼动轨迹划分获得的多个子轨迹。

[0153]

该实施例中,轨迹振动系数即为眼动轨迹中包含的拐点总数和第一眼动轨迹点总数的比值。

[0154]

该实施例中,第二眼动轨迹点总数即为眼动子轨迹中包含的眼动轨迹点的总数。

[0155]

该实施例中,子交互程度系数即为眼动子轨迹中包含的眼动轨迹点的第二眼动轨迹点总数和第一眼动轨迹点总数的比值。

[0156]

该实施例中,第二交互程度系数即为最大子交互程度系数和迹振动系数的乘积。

[0157]

该实施例中,综合交互系数即为第一交互程度系数和第二交互程度系数的和。

[0158]

该实施例中,交互系数阈值即为判定用户需要进行智能交互时对应的最小交互系数阈值。

[0159]

以上技术的有益效果为:本发明的眼动跟踪交互的智能眼镜及其方法,通过区域查找单元中包含的序列确定子单元确定出对应的坐标值序列,为后续确定出眼动轨迹的综合往返系数提供了重要的数据基础;基于第一确定子单元和第二确定子单元实现基于眼动轨迹中每个横坐标和前一横坐标的差值中的正数的个数和负数的个数以及每个纵坐标和前一纵坐标的差值中的正数的个数和负数的个数确定出表征眼动轨迹中往返次数的综合往返系数,为准确确定出用户的感兴趣区域提供了基础,基于权重确定子单元实现了考虑到了眼动轨迹中包含的眼动轨迹的点序数对区域确定的影响程度和眼动轨迹中往返次数的系数确定出眼动追踪点的感兴趣权重,基于区域确定子单元和最终确定子单元实现了基于感兴趣权重准确划分出用户想要交互的感兴趣区域,实现基于对眼动轨迹的追踪分析确定区域的划分权重,使得划分出的感兴趣区域更加贴近用户的交互需求。

[0160]

s23:对roi区域进行自动化分析时,自动分析单元向计时传感器5传送指令,根据计时传感器5实时记录用户眼动观看时间,且将实时记录的用户眼动观看时间传送给自动分析单元;

[0161]

s24:自动分析单元接收到计时传感器5传送的用户眼动观看时间后,根据计时传感器5记录的用户眼动观看时间且参照访问存储单元内存储的访问交互阈值进行分析,且将分析结果反馈给交互执行模块。

[0162]

s3:读取用户想要交互访问的roi区域的分析结果,分析结果读取后,根据不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互。

[0163]

参阅图4,需要说明的是,交互执行模块执行分析结果的步骤为:

[0164]

s31:自动分析单元将最终形成的分析结果传送给信息读取单元,利用信息读取单元对用户想要交互访问的roi区域的分析结果进行相应地读取,且将信息读取结果传送给策略执行单元;

[0165]

s32:策略执行单元接收到信息读取单元传送的信息读取结果后,利用策略执行单元对不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互。

[0166]

需要说明的是,策略执行单元执行的步骤为:

[0167]

s321:针对计时传感器5记录的用户眼动观看时间值未超过访问存储单元内存储的访问交互阈值的分析结果,则策略执行单元根据该种分析结果,执行一级响应策略,则此时用户观看页面未出现变化,使用户与观看页面未进行交互;

[0168]

s322:针对计时传感器5记录的用户眼动观看时间值超过访问存储单元内存储的访问交互阈值的分析结果,则策略执行单元根据该种分析结果,执行二级响应策略,则此时用户观看页面出现变化,使用户与观看页面进行眼动跟踪智能交互。

[0169]

根据不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互,如表1所示:

[0170]

表1:不同的分析结果智能执行不同的响应策略

[0171][0172][0173]

实施例三

[0174]

参阅图5,为了更好的展现眼动跟踪交互的智能眼镜的眼动跟踪交互流程,本实施例现提出一种眼动跟踪交互的智能眼镜的眼动跟踪交互方法,包括如下步骤:

[0175]

s10:用户佩戴智能眼镜,采用信息采集模块实时采集用户眼动的三轴姿态角以及加速度,实时拍摄用户眼球移动的情况且感知用户眼动状态,测量用户头部到正前方障碍物的直线距离及记录用户眼动观看时间,上述眼动数据信息采集后,且实时采集的眼动数据信息传送给信息处理模块;

[0176]

s20:信息处理模块对实时采集的眼动数据信息进行特征提取,提取出有用地用户眼动数据,且对提取的有用地用户眼动数据进行识别判断,找出用户眼动数据之间的相互关联,根据三轴姿态角、加速度及用户眼动状态生成相对应地三维坐标,最终形成眼动跟踪坐标体系,且眼动跟踪坐标体系数据传送给信息分析模块;

[0177]

s30:信息分析模块从接收的眼动跟踪坐标体系数据中以方框、圆、椭圆、不规则多边形等方式勾勒出用户想要交互访问的区域,查找出用户想要交互访问的roi区域,根据计时传感器5记录的用户眼动观看时间且参照访问存储单元内存储的访问交互阈值对用户想要交互访问的roi区域进行自动化分析,判断用户是否需要进行智能交互,且将分析结果反馈给交互执行模块;

[0178]

s40:交互执行模块对用户想要交互访问的roi区域的分析结果进行相应地读取,对不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互。

[0179]

综上所述,本发明的眼动跟踪交互的智能眼镜及其方法,用户佩戴智能眼镜,采用信息采集模块实时采集用户眼动的三轴姿态角以及加速度,实时拍摄用户眼球移动的情况且感知用户眼动状态,测量用户头部到正前方障碍物的直线距离及记录用户眼动观看时间,上述眼动数据信息采集后,信息处理模块对实时采集的眼动数据信息进行特征提取,提取出有用地用户眼动数据,且对提取的有用地用户眼动数据进行识别判断,找出用户眼动数据之间的相互关联,根据三轴姿态角、加速度及用户眼动状态生成相对应地三维坐标,最终形成眼动跟踪坐标体系,便于了解用户眼动状态,利用用户眼动状态进行智能交互,不需要借助于外界设备即可实现智能交互,使智能眼镜服务更加便捷,信息分析模块从接收的眼动跟踪坐标体系数据中以方框、圆、椭圆、不规则多边形等方式勾勒出用户想要交互访问

的区域,查找出用户想要交互访问的roi区域,根据计时传感器5记录的用户眼动观看时间且参照访问存储单元内存储的访问交互阈值对用户想要交互访问的roi区域进行自动化分析,判断用户是否需要进行智能交互,交互执行模块对用户想要交互访问的roi区域的分析结果进行相应地读取,对不同的分析结果智能执行不同的响应策略,根据不同的响应策略进行眼动跟踪的智能交互,使智能交互便利,解放双手。

[0180]

以上所述,仅为本发明较佳的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明披露的技术范围内,根据本发明的技术方案及其发明构思加以等同替换或改变,都应涵盖在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。