1.本发明涉及显示方法、显示装置以及程序。

背景技术:

2.以往,在佩戴于使用者的头部的显示装置中,已知有进行与使用者的视线变化对应的动作的显示装置。专利文献1公开了在使用者的视线方向发生了超过规定角度的变化的情况下,使图像的显示方式变化的显示装置。例如,在成为使用者的视线方向的前方的位置显示十字的标记。

3.专利文献1:日本特开2018-141874号公报

4.即便使用者的姿势变化,佩戴于使用者头部的显示装置也使得显示图像与使用者视野的相对位置关系不发生变化。因此,在使用者想要观察的图像不在视野的中心的情况下,使用者需要持续观察从视野的中心偏离的位置,希望对此提高便利性。

技术实现要素:

5.解决上述课题的一个方式是一种显示方法,使佩戴于使用者的头部的显示装置显示图像,该显示方法包含:确定步骤,确定显示于所述显示装置的所述图像中所述使用者注视的注视区域;以及调整步骤,对显示所述图像的位置进行调整,以使所述注视区域接近与所述使用者的正面对应的规定的位置。

6.解决上述课题的另一方式是一种显示装置,其佩戴于使用者的头部,该显示装置具有:显示部;注视方向确定部,其确定所述使用者注视的方向;以及显示控制部,其调整所述显示图像的显示方式,以使在显示于所述显示部的显示图像中所述使用者正注视的注视区域接近与所述使用者的正面对应的规定的位置。

7.解决上述课题的另一方式是一种计算机可执行的程序,其使佩戴于使用者的头部的显示装置显示图像,该程序用于:确定所述使用者注视的方向;以及调整所述显示图像的显示方式,以使在所述显示装置所显示的显示图像中所述使用者正注视的注视区域接近与所述使用者的正面对应的规定的位置。

附图说明

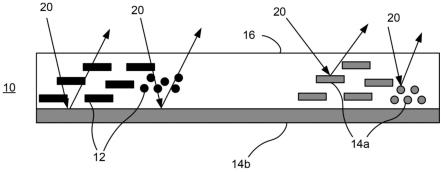

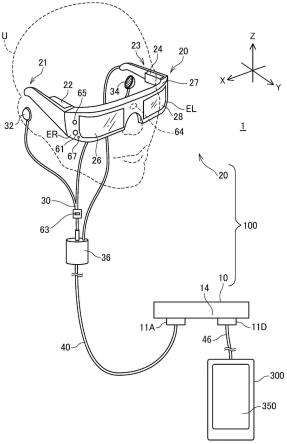

8.图1是表示显示系统的概略结构的图。

9.图2是图像显示部的立体图。

10.图3是显示系统的框图。

11.图4是dp控制部的框图。

12.图5是表示使显示图像的显示方式变化的过程的示意图。

13.图6是确定视线方向的处理的说明图。

14.图7是设定部的动作的说明图。

15.图8是表示hmd的动作的流程图。

16.图9是表示hmd的动作的流程图。

17.图10是表示hmd的动作的流程图。

18.标号说明

19.1:显示系统;10:连接装置;11a、11d:连接器;20:图像显示部(显示部);21:右保持部;22:右显示部;23:左保持部;24:左显示部;26:右导光板;27:前部框架;28:左导光板;29:视线基准位置;30:耳机;32:右耳机;34:左耳机;36:音频连接器;40:连接线缆;46:usb线缆;61:外侧摄像头;63:麦克风;64:距离传感器;65:照度传感器;67:led指示器;68、69:内侧摄像头;100:hmd(显示装置);110:i/f部;120:dp控制部;140:操作部;160:处理器;161:显示控制部;162:注视方向确定部;163:特定操作检测部;164:设定部;170:存储器;171:控制程序;172:视线基准数据;173:视野设定数据;221、241:oled单元;261、281:半反射镜;291:视野中心;293:第1范围;295:第2范围;300:控制装置;350:触摸面板;502:设定画面;511:注视位置;512:注视区域;521:标记;522:引导;d1、d2:注视方向;dl1、dl2、dl3、dr1、dr2、dr3:视线方向;el:端部;er:端部;m:移动方向;p1、p2:注视点;re:右眼;le:左眼;u:使用者;vsc:虚拟屏幕。

具体实施方式

20.[1.显示系统的结构]

[0021]

以下,参照附图对应用了本发明的实施方式进行说明。

[0022]

图1是表示显示系统1的概略结构的图。

[0023]

显示系统1具有hmd 100和控制装置300。hmd 100是具有佩戴于使用者u的头部的图像显示部20而令使用者u看到图像或影像的头部佩戴型显示装置,是本发明的显示装置的一例。hmd是head mounted display(头戴式显示器)的缩写。

[0024]

hmd 100具有与图像显示部20连接的连接装置10。连接装置10作为将hmd 100和与hmd 100不同的装置连接的接口发挥功能。在显示系统1中,对连接装置10连接控制装置300。

[0025]

控制装置300是向hmd 100输出图像信号的外部装置的一例。控制装置300所输出的图像信号例如可列举依据hdmi或mhl的数字图像,但也可以是其他格式的数据,还可以是模拟图像信号。控制装置300输出的图像信号中也可以包含声音信号。hdmi和mhl是注册商标。

[0026]

控制装置300是具有显示字符、图像的显示画面以及作为检测触摸操作、按压操作的操作部发挥功能的触摸面板350,且为能够携带的尺寸的终端装置,例如能够使用智能手机。触摸面板350具有在显示画面上重叠配置有触摸传感器的结构。触摸面板350作为显示图像等的显示器以及检测使用者u的操作的操作设备发挥功能。控制装置300也可以是台式个人计算机、笔记本型个人计算机、平板型个人计算机等。

[0027]

连接装置10具有连接器11a以及连接器11d。图像显示部20经由连接线缆40与连接器11a连接,控制装置300经由usb线缆46与连接器11d连接。hmd 100和控制装置300相互可收发数据地连接。例如,控制装置300能够如上述那样将图像信号输出到hmd 100。并且例如,hmd 100能够将图像显示部20所具有的各种传感器的检测数据发送到控制装置300。此外,也可以是,从控制装置300经由usb线缆46对图像显示部20提供电力。

[0028]

使用usb线缆46将连接装置10和控制装置300连接起来的结构只不过是一例,连接装置10和控制装置300的具体连接方式不受限制。例如,也可以使用其他种类的线缆进行有线连接,还可以将连接装置100和控制装置300无线连接。

[0029]

图像显示部20在具有右保持部21、左保持部23以及前部框架27的主体上具有右显示部22、左显示部24、右导光板26以及左导光板28。

[0030]

右保持部21和左保持部23从前部框架27的两端部向后延伸,将图像显示部20保持于使用者u的头部。右保持部21与前部框架27的位于使用者u右侧的端部er连结,左保持部23与前部框架27的位于使用者u左侧的端部el连结。

[0031]

右导光板26和左导光板28设置于前部框架27。右导光板26在图像显示部20的佩戴状态下位于使用者u的右眼的眼前,使右眼看到图像。左导光板28在图像显示部20的佩戴状态下位于使用者u的左眼的眼前,使左眼看到图像。右导光板26和左导光板28是由透光性的树脂等形成的光学部,将右显示部22和左显示部24输出的图像光引导至使用者u的眼睛。右导光板26和左导光板28例如是棱镜。

[0032]

前部框架27具有将右导光板26的一端和左导光板28的一端相互连结起来的形状,在使用者u佩戴图像显示部20的佩戴状态下,该连结位置与使用者u的眉间对应。前部框架27可以具有在图像显示部20的佩戴状态下抵靠于使用者u的鼻子的鼻托部,也可以是对右保持部21和左保持部23连接带子,并通过带子将图像显示部20保持于使用者u的头部的结构。

[0033]

右显示部22和左显示部24分别是将光学单元和外围电路进行单元化而得的模块。右显示部22通过右导光板26显示图像,左显示部24通过左导光板28显示图像。右显示部22设置在右保持部21上,左显示部24设置在左保持部23上。

[0034]

由右导光板26引导的图像光和透过右导光板26的外部光入射到使用者u的右眼。同样,由左导光板28引导的图像光和透过左导光板28的外部光入射到左眼。来自右导光板26以及左导光板28的图像光和透过右导光板26以及左导光板28的外部光入射到使用者u的眼睛。由此,使用者u重叠看到图像显示部20显示的图像和透过右导光板26以及左导光板28的外景。

[0035]

在前部框架27配置有照度传感器65。照度传感器65是如下的传感器:接收来自佩戴图像显示部20的使用者u的前方的外部光。

[0036]

外侧摄像头61在前部框架27中设置在不遮挡透过右导光板26以及左导光板28的外部光的位置处。外侧摄像头61是具有ccd或cmos等拍摄元件和拍摄镜头等的数字摄像头,可以是单眼摄像头,也可以是立体摄像头。外侧摄像头61的视场角包含佩戴了图像显示部20的使用者u透过右导光板26以及左导光板28而看到的外景范围的至少一部分。在前部框架27配置有在外侧摄像头61的动作中点亮的led指示器67。在前部框架27设置有距离传感器64,该距离传感器64检测到位于预先设定的测量方向上的测量对象物的距离。距离传感器64例如是使用led或激光二极管等的光反射式距离传感器、红外线式深度传感器、超声波式距离传感器或者激光测距仪。

[0037]

右显示部22和左显示部24分别通过连接线缆40与连接装置10连接。连接线缆40具有音频连接器36。在音频连接器36上连接有具有构成立体声耳机的右耳机32和左耳机34、以及麦克风63的耳机30。右耳机32和左耳机34根据连接装置10输出的声音信号输出声音。

麦克风63收集声音,并将声音信号输出到连接装置10。

[0038]

图2是图像显示部20的立体图,详细而言,是从使用者u的左眼le以及右眼re侧观察图像显示部20的图。

[0039]

右显示部22和左显示部24例如构成为左右对称。

[0040]

在右显示部22与左显示部24之间配置有内侧摄像头68、69。内侧摄像头68、69是配置在使用者u的右眼re与左眼le之间的摄像头。内侧摄像头68拍摄右眼re,内侧摄像头69拍摄左眼le。hmd 100根据内侧摄像头68的拍摄图像,检测右眼re的瞳孔位置,由此检测右眼re的视线方向。同样地,hmd 100根据内侧摄像头69的拍摄图像,检测左眼le的瞳孔位置,由此检测左眼le的视线方向。为了容易地进行瞳孔的位置检测,内侧摄像头68、69也可以具有发出光的光源。

[0041]

右显示部22和左显示部24分别具有光源和对光源发出的光进行调制而生成图像光的光调制装置。在本实施方式中,如后所述,右显示部22具有oled单元221,左显示部24具有oled单元241,通过oled单元221、241射出图像光。

[0042]

右显示部22具有位于右眼re的正面的右导光板26。右导光板26将oled单元221发出的图像光引导至位于右眼re的正面的半反射镜261。半反射镜261将图像光朝向右眼re反射,由此令使用者u的右眼re看到图像。左显示部24具有位于左眼le的正面的左导光板28。左导光板28将oled单元241发出的图像光引导至位于左眼le的正面的半反射镜281。半反射镜281将图像光朝向左眼le反射,由此使左眼le看到图像。

[0043]

半反射镜261、281是反射右显示部22和左显示部24分别输出的图像光来提取图像的图像提取部,构成显示部。

[0044]

hmd 100作为透射型的显示装置发挥作用。即,由半反射镜261反射的图像光和透过右导光板26的外部光入射到使用者u的右眼re。由半反射镜281反射的图像光和透过半反射镜281的外部光入射到左眼le。hmd 100使在内部处理后的图像的图像光与外部光重叠地入射到使用者u的眼睛。因此,使用者u能够透过右导光板26以及左导光板28看见外景,并与该外景重叠地看到图像。

[0045]

在图1和后述的各图中,将图像显示部20中右导光板26和左导光板28排列的方向设为x方向。x方向相当于使用者u的右眼re和左眼le排列的方向。另外,将使用者u的头部正立的情况下的铅直方向设为z方向。将与x方向及z方向垂直的方向设为y方向。x方向、y方向以及z方向是以佩戴了图像显示部20的使用者u的头部为基准的方向。y方向相当于使用者u的正面方向。

[0046]

[2.hmd的控制系统]

[0047]

图3是显示系统1的框图,特别是详细示出hmd 100的结构。

[0048]

图像显示部20的右显示部22具有右显示部基板210。在右显示部基板210上安装有与连接线缆40连接的右i/f部211、以及接收经由右i/f部211而从连接装置10输入的数据的接收部213。右i/f部211将接收部213、dp外侧摄像头61、距离传感器64、照度传感器65、led指示器67以及内侧摄像头68与连接装置10连接。接收部213将oled单元221与连接装置10连接。

[0049]

左显示部24具有左显示部基板230。在左显示部基板230上安装有与连接线缆40连接的左i/f部231、以及接收经由左i/f部231而从连接装置10输入的数据的接收部233。

[0050]

左i/f部231将接收部233、内侧摄像头69、六轴传感器235以及磁传感器237与连接装置10连接。接收部233将oled单元241与连接装置10连接。

[0051]

在本实施方式的说明以及附图中,i/f是接口的缩写。在图中,将接收部213以及接收部233记载为rx 213、rx 233。

[0052]

外侧摄像头61按照经由右i/f部211输入的信号执行拍摄,并将拍摄图像数据输出到右i/f部211。照度传感器65接收外部光,输出与受光量或受光强度对应的检测值。led指示器67按照经由右i/f部211输入的控制信号或驱动电流而点亮。

[0053]

距离传感器64经由右i/f部211将表示检测到距离的检测结果的信号输出到连接装置10。

[0054]

内侧摄像头68按照经由右i/f部211输入的信号执行拍摄,并将拍摄图像数据输出到右i/f部211。内侧摄像头69按照经由左i/f部231输入的信号执行拍摄,并将拍摄图像数据输出到左i/f部231。

[0055]

接收部213接收经由右i/f部211而从连接装置10传输的显示用的影像数据,并输出到oled单元221。oled单元221显示基于连接装置10传输的影像数据的影像。

[0056]

接收部233接收经由左i/f部231而从连接装置10传输的显示用的影像数据,并输出到oled单元241。oled单元221、241显示基于连接装置10传输的影像数据的影像。

[0057]

六轴传感器235是具有三轴加速度传感器和三轴陀螺传感器的运动传感器。磁传感器237例如是三轴的地磁传感器。六轴传感器235以及磁传感器237可以是上述各传感器被模块化的imu,也可以将六轴传感器235以及磁传感器237形成一体化的模块。imu是inertial measurement unit(惯性测量单元)的缩写。六轴传感器235和磁传感器237分别将检测值输出到连接装置10。

[0058]

图像显示部20的各部分利用通过连接线缆40从连接装置10提供的电力进行动作。

[0059]

连接装置10具有i/f部110、dp控制部120、传感器控制部122、显示处理部124、电源控制部126、非易失性存储部130、操作部140、连接部145以及声音处理部147。

[0060]

i/f部110具有连接器11d以及接口电路,该接口电路通过连接器11d执行基于各种通信标准的通信协议。i/f部110例如是安装有连接器11d以及接口电路的接口基板。i/f部110可以具有外部的存储装置、能够连接存储介质的存储卡用接口等,也可以由无线通信接口构成i/f部110。

[0061]

如参照图4后述的那样,dp控制部120具有cpu、微型计算机等处理器160以及存储器170。dp控制部120通过处理器160执行程序,控制连接装置10的各部分。存储器170存储处理器160执行的控制程序171以及其他各种程序和数据。另外,存储器170也可以具有易失性的存储区域,形成临时存储程序、数据的工作区。

[0062]

在dp控制部120上连接有非易失性存储部130、操作部140、连接部145以及声音处理部147。非易失性存储部130是非易失性地存储程序和数据的rom。rom是read only memory(只读存储器)的缩写。

[0063]

传感器控制部122使图像显示部20具有的各传感器进行动作。在此,各传感器是指外侧摄像头61、照度传感器65、六轴传感器235以及磁传感器237的各个传感器。各传感器至少包含外侧摄像头61、照度传感器65、六轴传感器235以及磁传感器237中的任意1个以上。传感器控制部122按照dp控制部120的控制进行各传感器的采样周期的设定以及初始化,并

按照各传感器的采样周期,执行向各传感器的通电、控制数据的发送、检测值的取得等。

[0064]

传感器控制部122在预先设定的定时,将表示各传感器的检测值、检测结果的检测数据输出到i/f部110。另外,传感器控制部122也可以将外侧摄像头61的拍摄图像数据与其他传感器的检测值、检测结果同样地输出到i/f部110。传感器控制部122也可以将内侧摄像头68、69的拍摄图像数据输出至i/f部110。

[0065]

通过传感器控制部122的动作,与i/f部110连接的控制装置300能够取得hmd100的各传感器的检测值、外侧摄像头61的拍摄图像数据。

[0066]

显示处理部124基于输入到i/f部110的图像信号,执行用于使图像显示部20显示图像的各种处理。显示处理部124例如执行帧的截取、分辨率转换、缩放、中间帧生成、帧频转换等各种处理。显示处理部124将与oled单元221、241对应的影像数据输出到连接部145。输入到连接部145的影像数据从连接器11a被传输到右i/f部211以及左i/f部231。

[0067]

传感器控制部122和/或显示处理部124也可以由处理器执行程序而通过软件与硬件的协作来实现。即,传感器控制部122和显示处理部124由处理器构成,通过执行程序来执行上述动作。在该例中,传感器控制部122和显示处理部124也可以通过由构成dp控制部120的处理器执行程序来实现。换言之,也可以通过处理器执行程序来作为dp控制部120、传感器控制部122以及显示处理部124发挥功能。在此,处理器可以改述为计算机。传感器控制部122和显示处理部124可以具备用于进行数据处理的工作存储器,也可以利用dp控制部120的存储器170来进行处理。

[0068]

显示处理部124和传感器控制部122也可以由dsp、fpga等编程后的硬件构成。也可以将传感器控制部122和显示处理部124合并而构成为soc-fpga。dsp是digital signal processor(数字信号处理器)的缩写,fpga是field programmable gate array(现场可编程门阵列)的缩写,soc是system-on-a-chip(片上系统)的缩写。

[0069]

电源控制部126具有与连接器11d连接的电源电路。电源控制部126基于从连接器11d供给的电力对连接装置10的各部分以及图像显示部20供给电源。

[0070]

操作部140检测连接装置10所具有的开关等的操作,将表示操作内容的数据输出到dp控制部120。

[0071]

声音处理部147按照从dp控制部120输入的声音数据,生成声音信号,并输出到连接部145。从连接部145经由音频连接器36将该声音信号输出到右耳机32和左耳机34。声音处理部147生成麦克风63收集到的声音的声音数据,并输出到dp控制部120。从声音处理部147输出的声音数据与图像显示部20所具有的传感器的检测数据同样,可以由传感器控制部122进行处理。

[0072]

[3.控制部的结构]

[0073]

图4是dp控制部120的框图。

[0074]

dp控制部120具有处理器160和存储器170。

[0075]

在图4中,作为处理器160所具有的功能部,示出显示控制部161、注视方向确定部162、特定操作检测部163以及设定部164。这各个功能部也可以由处理器160执行程序而通过软件与硬件的协作来实现。

[0076]

存储器170存储控制程序171、视线基准数据172以及视野设定数据173。视线基准数据172是判定使用者u的视线方向的处理中的作为基准的数据。视野设定数据173是配合

使用者u的视线方向而使图像的显示方式变化的处理中的作为基准的数据。

[0077]

显示控制部161控制显示处理部124,使由oled单元221、241显示的图像的显示方式变化。

[0078]

注视方向确定部162确定佩戴了图像显示部20的使用者u的注视方向以及注视区域。使用者u的注视方向是指使用者u的视线所朝的方向。注视区域是指在图像显示部20显示的图像中位于使用者u的注视方向的区域。

[0079]

特定操作检测部163检测佩戴了图像显示部20的使用者u进行的特定操作。特定操作被预先设定。例如,在检测到使用者u进行了闭上双眼的动作、或者使用者u进行了凝视特定方向的动作的情况下,特定操作检测部163判定为进行了特定操作。另外,特定操作也可以是使用者u对操作部140进行的操作。

[0080]

[4.显示系统的动作概要]

[0081]

图5是表示在显示系统1中使显示图像的显示方式变化的过程的示意图。

[0082]

显示系统1在佩戴图像显示部20的使用者u的视线处于预先设定的范围外的情况下,使图像显示部20显示的显示图像的显示方式变化。详细而言,将在图像显示部20的显示图像中使用者u正注视的区域移动到使用者u容易看到的位置。

[0083]

在图5中,将使图像显示部20的显示图像变化的过程大致分为3个阶段来表示。

[0084]

在图5中,用十字的标记表示在显示图像501中使用者u正在注视的注视位置511,用虚拟线表示包含注视位置511的注视区域512。注视位置511和注视区域512实际上不显示。注视区域512也被称为aoi。aoi是area of interest的缩写。

[0085]

显示区域290是图像显示部20显示图像的区域。图像显示部20通过从半反射镜261、281向使用者u的右眼re和左眼le射出图像光,令使用者u看到虚像。使用者u感知到在使用者u的前方空间中,在与使用者u相隔规定距离的位置处存在显示区域290。即,在图像显示部20中没有与图像显示区域对应的部件,显示区域290表示图像显示部20令使用者u看到的图像的整体。

[0086]

视野中心291是在显示区域290中使用者u的视线方向朝向正面的情况下与视线重叠的位置。朝向使用者u的正面的情况下的使用者u的视线方向是指使用者u感觉正朝向正面时的、使用者u的视线方向。换言之,是使用者u下意识地感觉正朝向正面时的视线方向、或者使用者u自然地观察正面时的视线方向。视野中心291对应于与使用者u的正面对应的规定的位置。视野中心291也可以称为基准位置。

[0087]

第1范围293是以视野中心291为中心的规定的范围。在图5中示出了第1范围293为矩形的例子,但第1范围293也可以是圆形或椭圆形。第1范围293表示在使用者u的视线朝向视野中心291的情况下,在不给使用者u的视觉带来大的负担的情况下使用者u能看到的范围。

[0088]

通常,人的视角在水平方向上大约为200度,在垂直方向上大约为125度,其中,信息接受能力优异的有效视野在水平方向上大约为30度,在垂直方向上大约为20度。人的视觉能够发挥较高的识别能力的中心视觉的范围以视野中心291为中心在垂直方向以及水平方向上为2

°

。另外,在视线朝向视野中心291的情况下使用者u能够识别字符的字符识别极限相当于以视野中心291为中心的10

°

~20

°

以内的范围。同样地,使用者u能够识别图像、图形等的符号识别极限为10

°

~60

°

以内,能够判别颜色的颜色判别极限为60

°

~120

°

以内。另

外,人的自然的眼球运动范围为30

°

左右,即,从视野的中心向垂直方向以及水平方向

±

15

°

左右。

[0089]

因此,在本实施方式中,作为认为使用者u能够舒适地看到的范围,设定第1范围293。第1范围293是在以视野中心291为中心的垂直方向和水平方向上20

°

以内的范围。第1范围293在人的字符识别极限的范围内。即,使用者u能够识别位于第1范围293的字符和图像。并且,在本实施方式中,设定比第1范围293宽的第2范围295。第2范围295是比第1范围293宽的范围,考虑人的字符识别极限与人的自然的眼球运动组合而成的极限来确定。使用者u能够通过移动右眼re以及左眼le来识别位于第2范围295的字符、图像。

[0090]

第1范围293和第2范围295以视野中心291为基准来确定。表示图像显示部20的显示位置与视野中心291、第1范围293以及第2范围295的位置关系的数据作为视野设定数据173被存储在存储器170中。

[0091]

视野中心291、第1范围293以及第2范围295由后述的设定部164设定。在设定部164设定视野中心291的情况下,根据视野中心291求出第1范围293和第2范围295。另外,设定部164也可以设定第1范围293和第2范围295,而省略视野中心291的设定。

[0092]

在显示系统1使显示图像501的显示方式变化之前的状态下,如图5中作为状态1所示,在显示区域290的整体显示出显示图像501。在此,显示系统1检测到使用者u的视线正朝向注视位置511的情况,确定注视区域512。显示系统1使显示图像501的一部分或全部移动,以使注视区域512包含在第1范围293中。

[0093]

显示系统1可以通过使显示图像501的整体相对于显示区域290相对地移动,来改变显示方式,以使注视区域512进入第1范围293中。显示系统1也可以使显示于注视区域512的字符、图像等显示对象移动。

[0094]

以下,对使显示图像501的整体相对于显示区域290相对移动的例子进行说明。

[0095]

图5的状态1是确定了注视位置511和注视区域512的状态。在此,决定使注视区域512移动的移动方向m,开始显示图像501的移动。状态2是注视区域512到达第2范围295的状态。在图5中,将成为了注视区域512的整体进入第2范围295中的状态的情况称为到达了第2范围295。即,将注视区域512的整体是否位于第2范围295的内侧作为注视区域512是否位于第2范围295外的判定基准。这是一个例子,例如,也可以将注视区域512的至少一部分与第2范围295的外缘重叠的状态作为判定基准。另外,还可以将注视区域512的外缘与第2范围295的外缘重叠、或者注视位置511与第2范围295的外缘重叠作为判定基准。

[0096]

同样,能够适当地设定注视区域512是否处于第1范围293外的判定基准。即,可以以注视区域512的整体是否位于第1范围293的内侧为基准,判定注视区域512是否位于第1范围293外。并且例如,也可以将注视区域512的至少一部分与第1范围293的外缘重叠的状态作为判定基准。另外,还可以将注视区域512的外缘与第1范围293的外缘重叠、或者注视位置511与第1范围293的外缘重叠作为判定基准。

[0097]

显示系统1从状态2起进一步继续显示图像501的移动。状态3是注视区域512到达了第1范围293的状态。在此,显示系统1结束显示图像501的移动。

[0098]

在从状态1到状态3的过程中,显示系统1改变使显示图像501在移动方向m上移动的移动速度。例如,从状态1到状态2,使显示图像501以第1速度移动,从状态2到状态3,使显示图像501以第2速度移动。第2速度比第1速度低。即,在注视区域512到达第2范围295之后,

显示图像501以比之前低的速度移动。由此,在成为使用者u容易看到注视区域512的状态之后,通过使显示图像501的移动速度为低速,能够减轻由显示图像501的移动引起的使用者u的不适感。另外,在初期,通过以更高速的第1速度使显示图像501移动,能够实现迅速的移动。

[0099]

以下,参照附图,详细说明显示系统1的动作。

[0100]

在本实施方式中,对hmd 100执行包含检测使用者u的视线方向的动作、以及使显示图像501的显示方式变化的动作在内的各种动作的例子进行说明。以下说明的hmd 100的动作的一部分也能够通过控制装置300执行来实现。

[0101]

[5.hmd的动作]

[0102]

图6是确定视线方向的处理的说明图,俯视地示出了图像显示部20以及使用者u的右眼re、左眼le的位置关系。图6的虚拟屏幕vsc是位于佩戴了图像显示部20的使用者u前方的虚拟平面。使用者u将由图像显示部20显示的图像识别为投影在虚拟屏幕vsc上的图像。因此,在使用者u注视图像显示部20的显示图像时,使用者u的视线朝向虚拟屏幕vsc。

[0103]

图6所示的视线方向dr1、dr2、dr3、dl1、dl2、dl3、注视点p1、p2以及注视方向d1、d2均表示z方向上的同一平面中的方向或位置。

[0104]

hmd 100所具有的注视方向确定部162根据由内侧摄像头68拍摄右眼re而得到的拍摄图像,检测右眼re的瞳孔位置,由此计算右眼re的视线方向。另外,注视方向确定部162根据由内侧摄像头69拍摄左眼le而得到的拍摄图像,检测左眼le的瞳孔位置,由此计算左眼le的视线方向。注视方向确定部162计算的视线方向是图6所示的视线方向dr1、dr2、dr3、视线方向dl1、dl2、dl3等。

[0105]

注视方向确定部162根据右眼re的视线方向和左眼le的视线方向,计算使用者u的注视方向。在此,使用者u的注视方向是指使用者u用双眼注视的方向,例如,能够改述为以图像显示部20为起点朝向注视点的方向。更详细而言,注视方向确定部162在图像显示部20中的右眼re和左眼le的中央设定视线基准位置29。注视方向确定部162计算从视线基准位置29朝向注视点的方向作为使用者u的注视方向。

[0106]

作为对照例,将使用者u的右眼re朝向正面的情况下的视线方向表示为视线方向dr1,将左眼le朝向正面的情况下的视线方向表示为视线方向dl1。视线方向dr1、dl1分别是以右眼re以及左眼le为起点在y方向上直行的方向。

[0107]

注视点p1是在虚拟屏幕vsc中位于使用者u的正面的点,位于视线基准位置29的y方向。将使用者u注视着注视点p1时的右眼re以及左眼le的视线设为视线方向dr2、dl2。

[0108]

注视方向确定部162将视线方向dr2、dl2设为使用者u注视正面时的基准的视线方向。视线方向dr2、dl2与视线方向dr1、dl1不同,但由于是朝向位于视线基准位置29正面的注视点p1的方向,因此适合作为基准。注视方向确定部162检测视线方向dr2、dl2,将以视线基准位置29为起点朝向注视点p1的注视方向d1与视线方向dr2、dl2相关联。

[0109]

注视方向确定部162也可以在右眼re朝向视线方向dr1与视线方向dr2之间的方向、左眼le朝向视线方向dl1与视线方向dl2之间的方向时,视为使用者u正在注视正面。即,也可以将这些情况下的注视方向设为注视方向d1。具体而言,将视线方向dr2相对于视线方向dr1所成的角设为角度θr,将视线方向dl2相对于视线方向dl1所成的角设为角度θl。此时,在右眼re的视线方向处于角度θr的范围内且左眼le的视线方向处于角度θl的范围内的

情况下,将使用者u的注视方向判定为注视方向d1。在这样的情形下,使用者u正在注视与注视点p1同样地位于视线基准位置29的正面、且注视点p1的远方,因此将注视方向设为注视方向d1是适当的。

[0110]

例如,在使用者u注视着图中的注视点p2的情况下,注视方向确定部162根据内侧摄像头68的拍摄图像计算右眼re的视线方向dr3,根据内侧摄像头69的拍摄图像计算左眼le的视线方向dl3。注视方向确定部162基于视线方向dr3和视线方向dl3,求出以视线基准位置29为起点的注视方向d2。以下,将该处理称为确定注视方向d2。

[0111]

注视方向确定部162也可以基于内侧摄像头68拍摄的多个拍摄图像以及内侧摄像头69的多个拍摄图像,一并考虑右眼re以及左眼le的细微的运动来计算使用者u的视线方向。已知人的眼球进行注视震颤或被称为眼跳(saccade)的细微的、不自主的动作。内侧摄像头68的拍摄图像受到右眼re的注视震颤的影响,因此根据内侧摄像头68的拍摄图像求出的右眼re的视线方向包含注视震颤引起的抖动。注视方向确定部162也可以使内侧摄像头68每隔规定时间进行多次拍摄,根据通过这些拍摄而得到的多个拍摄图像分别计算右眼re的视线方向,并对计算出的视线方向进行统计处理,由此求出右眼re的视线方向。同样地,注视方向确定部162也可以使内侧摄像头69每隔规定时间进行多次拍摄,根据多个拍摄图像分别计算左眼le的视线方向,统计性地处理计算出的视线方向。在该情况下,注视方向确定部162能够降低右眼re和左眼le的注视震颤的影响,计算更准确的视线方向。

[0112]

使用者u注视着注视点p1时的视线方向dr2、dl2成为注视方向确定部162的处理基准。

[0113]

hmd 100通过设定部164的功能来设定视线方向dr2、dl2。例如,设定部164可以通过执行校准来检测视线方向dr2、dl2。

[0114]

图7是表示设定部164的动作的一例的说明图,表示由图像显示部20显示的设定画面502。

[0115]

设定部164通过图像显示部20显示设定画面502,执行校准。设定画面502包含标记521和引导522。设定部164根据操作部140的操作或对触摸面板350的操作,使标记521移动。

[0116]

引导522引导使用者u将标记521移动到使用者u认为是视野中央的位置。使用者u按照引导522对操作部140或触摸面板350进行操作,使标记521移动。

[0117]

设定部164在标记521移动之后,根据内侧摄像头68、69的拍摄图像求出右眼re的视线方向以及左眼le的视线方向。设定部164将求出的视线方向设为与注视方向d1对应的视线方向dr1以及视线方向dl1。设定部164将表示与注视方向d1对应的视线方向dr1以及视线方向dl1的信息作为视线基准数据172存储于存储器170。

[0118]

设定部164根据移动后的标记521的位置,决定视野中心291。设定部164将视野中心291的位置与图像显示部20的显示位置之间的位置关系作为视野设定数据173存储在存储器170中。这里,设定部164也可以以视野中心291为基准来决定第1范围293和第2范围295,生成与第1范围293和第2范围295的位置相关的数据,并包含在视野设定数据173中。

[0119]

视野中心291例如通过显示区域290中的坐标来确定。即,视野中心291可以是使用者u的视野中的1个点。另外,视野中心291也可以是具有规定面积的圆等图形。在视野中心291是具有面积的图形的情况下,在校准中对使用者u要求的精度也可以低,因此能够减轻使用者u的负担。在该情况下,第1范围293以及第2范围295例如以视野中心291的外缘为基

准来设定。另外,在校准中,能够代替可指定点的十字形的标记521,使用圆等具有面积的标记。

[0120]

设定部164也可以通过校准以外的方法取得与视线方向dr1和视线方向dl1相关的数据。例如,也可以基于从佩戴图像显示部20起规定时间内的右眼re以及左眼le的视线方向,生成视线基准数据172。具体而言,也可以将使用者u的姿势变动以及右眼re和左眼le的视线方向变动较小时的、右眼re和左眼le的视线方向视为使用者u的正面方向,生成视线基准数据172。另外,也可以通过人工智能学习使用者u的姿势与右眼re以及左眼le的视线方向之间的相关,求出使用者u朝向正面时的右眼re以及左眼le的视线方向,生成视线基准数据172。在该情况下,设定部164可以使用处理器160所具有的人工智能,也可以利用控制装置300、其他装置所具有的学习完毕的人工智能。

[0121]

设定部164也可以是能够设定视线基准位置29的位置的结构。在该情况下,例如,设定部164根据内侧摄像头68的拍摄图像确定右眼re的位置,根据内侧摄像头69的拍摄图像确定左眼le的位置。设定部164也可以基于右眼re以及左眼le的位置来设定视线基准位置29。例如,设定部164将视线基准位置29设定在前部框架27中与右眼re及左眼le的中心重叠的位置。另外,设定部164也可以基于右眼re的位置以及左眼le的位置来估计或者计算使用者u的pd,并基于使用者u的pd来决定视线基准位置29的位置。pd是瞳孔间距离,是pupillary distance的缩写。

[0122]

图8、图9以及图10是示出hmd 100的动作的流程图。这各个图所示的动作由处理器160执行。

[0123]

hmd 100进行处理,检测使显示图像501的显示方式变化的处理的开始触发(步骤s1)。在此,在图9中详细示出步骤s1的动作。

[0124]

在本实施方式中,作为开始触发,特定操作检测部163检测使用者u注视操作用的标记的动作、使用者u闭上双眼的动作、以及操作部140的特定操作。操作用的标记是指hmd 100重叠显示于显示图像501的图形、图标。hmd 100能够在图像显示部20的显示图像501中配置标记,作为使用者u用来指示使显示方式变化的处理的开始或结束的指示用的图像。

[0125]

hmd 100确定使用者u的注视方向(步骤s21)。在步骤s21中,hmd 100例如根据内侧摄像头68、69的拍摄图像计算使用者u的右眼re和左眼le的视线方向,根据计算出的视线方向求出注视方向。

[0126]

hmd 100判定在步骤s21中确定出的注视方向是否是与操作用的标记重叠的位置(步骤s22)。在步骤s21中确定的注视方向是标记位置的情况下(步骤s22;是),hmd 100判定为存在开始触发(步骤s23),转移到图8的步骤s2。

[0127]

在步骤s21中确定的注视方向不是标记位置的情况下(步骤s22;否),hmd 100根据内侧摄像头68、69的拍摄图像,判定有无使用者u闭上双眼的动作(步骤s24)。在使用者u进行了闭上双眼的动作的情况下(步骤s24;是),hmd 100转移到步骤s23。

[0128]

在判定为使用者u未进行闭上双眼的动作的情况下(步骤s24;否),hmd 100判定是否通过操作部140进行了指示使显示方式变化的处理开始的操作(步骤s25)。在进行了相应的操作的情况下(步骤s25;是),hmd 100转移到步骤s23。在未进行相应的操作的情况下(步骤s25;否),hmd 100判定为不存在开始触发(步骤s26),转移到图8的步骤s2。

[0129]

hmd 100参照步骤s1的判定结果(步骤s2)。在判定为不存在开始触发的情况下(步

骤s2;否),返回步骤s1。在判定为存在开始触发的情况下(步骤s2;是),hmd 100确定使用者u注视的注视区域512(步骤s3)。

[0130]

在图10中详细示出步骤s3的动作。

[0131]

hmd 100从内侧摄像头68的拍摄图像中提取右眼re的图像,检测右眼re的视线(步骤s31)。另外,hmd 100从内侧摄像头69的拍摄图像中提取左眼le的图像,检测左眼le的视线(步骤s32)。hmd 100根据在步骤s31、s32中检测到的视线,分别计算右眼re的视线方向和左眼le的视线方向(步骤s33)。hmd 100根据右眼re的视线方向和左眼le的视线方向,计算以视线基准位置29为起点的注视方向(步骤s34)。hmd 100在图像显示部20的显示图像501中,确定与使用者u的注视方向对应的注视区域512(步骤s35)。在步骤s35中,hmd 100也可以根据注视方向,计算在显示图像501中使用者u注视的注视位置511的坐标,求出以注视点为中心的注视区域512。另外,hmd 100也可以基于注视方向、以及图像显示部20与虚拟屏幕vsc之间的距离,直接计算注视区域512。在图3的处理之后,hmd100的动作转移到图8的步骤s4。

[0132]

hmd 100判定注视区域512是否在第1范围293外(步骤s4)。在此,在注视区域512不在第1范围293外的情况下(步骤s4;否),不需要使显示图像501移动,因此,hmd 100维持显示图像501的显示并返回到步骤s3。

[0133]

在注视区域512在第1范围293外的情况下(步骤s4;是),hmd 100开始使注视区域512朝向视野中心291移动的处理(步骤s5)。hmd 100在开始移动时,判定注视区域512是否在第2范围295外(步骤s6)。在注视区域512处于第2范围295外的情况下(步骤s6;是),hmd 100将显示图像501的移动速度设定为第1速度,开始显示图像501的移动(步骤s7)。

[0134]

hmd 100能够将使显示图像501移动的速度设定为至少2个阶段。在本实施方式中,hmd 100能够将显示图像501的移动速度设定为第1速度和第2速度,第1速度比第2速度高。另外,hmd 100能够变更显示图像501的移动速度。

[0135]

hmd 100进行确定注视区域512的处理(步骤s8)。步骤s8以及后述的步骤s11的动作例如是与步骤s3相同的动作。

[0136]

hmd 100判定在步骤s8中确定的注视区域512的位置是否在第2范围295外(步骤s9)。在注视区域512处于第2范围295外的情况下(步骤s9;是),hmd 100返回到步骤s8。在注视区域512通过使显示图像501移动的处理而到达了第2范围295的内侧的情况下,hmd 100在步骤s9中判定为否定。hmd 100以规定时间间隔反复执行步骤s8的动作,直到在步骤s9中判定为否定为止。

[0137]

hmd 100在判定为注视区域512的位置不在第2范围295外的情况下(步骤s9:否),以及在步骤s6中判定为注视区域512不在第2范围295外的情况下(步骤s6:否),转移到步骤s10。在步骤s10中,hmd 100将显示图像501的移动速度设定为第2速度,使显示图像501移动(步骤s10)。

[0138]

hmd 100确定注视区域512(步骤s11),判定注视区域512的位置是否在第1范围293外(步骤s12)。在注视区域512处于第1范围293外的情况下(步骤s12;是),hmd 100返回到步骤s11。在注视区域512通过使显示图像501移动的处理而到达了第1范围293的内侧的情况下,hmd 100在步骤s12中判定为否定。hmd 100以规定时间间隔反复执行步骤s11的动作,直到在步骤s12中判定为否定为止。

[0139]

hmd 100在判定为注视区域512的位置不在第1范围293外的情况下(步骤s12;否),结束显示图像501的移动(步骤s13)。

[0140]

图8的动作示出了hmd 100能够将显示图像501的移动速度设定为2个阶段的动作例,但连接装置10也可以将显示图像501的移动速度设定为3个阶段以上的精细阶段。

[0141]

hmd 100也可以在结束了图8的动作之后还进行确定注视区域512的处理。即,hmd 100可以在步骤s13之后返回到步骤s3。

[0142]

另外,在图8的动作中以及图8的动作后,hmd 100也可以将特定的动作作为触发,结束显示图像501的移动。即,特定操作检测部163在检测到使用者u闭上双眼的动作和操作部140的特定操作中的任意操作的情况下,判定为存在结束触发,结束显示图像501的移动。在此,在hmd 100使显示图像501移动的动作中判定为存在结束触发的情况下,也可以通过中断处理使显示图像501的移动停止。另外,在判定为存在结束触发的情况下,hmd 100也可以恢复到执行图8的动作之前的状态。

[0143]

另外,作为特定操作检测部163判定为存在结束触发的操作,也可以包含如下操作:使用者u注视重叠显示于显示图像501的标记。在该情况下,具有如下优点:使用者u能够在不从显示图像501移开视线的情况下,指示结束使显示方式变化的处理。

[0144]

设定部164也可以对hmd 100显示的操作用的标记的显示位置进行校准。例如,设定部164使图像显示部20显示操作用的标记,令使用者u注视各标记。设定部164例如使用内侧摄像头68、69的拍摄图像来检测注视标记时的右眼re及左眼le的视线方向。由此,能够配合使用者u注视标记时的视线方向的个人差异,更准确地检测标记的注视状态。

[0145]

在本实施方式中,说明了为了使注视区域512移动而使显示图像501的整体移动的例子,但也可以从显示图像501切出注视区域512,使注视区域512朝向视野中心291移动。另外,在本实施方式中,示出了使显示图像501移动直到注视区域512进入第1范围293中为止的动作,但也可以继续移动直到注视区域512到达视野中心291为止。

[0146]

[6.实施方式的作用和效果]

[0147]

如以上说明的那样,在应用了本发明的实施方式的显示系统1中,佩戴于使用者u的头部的hmd 100具有图像显示部20和确定使用者u注视的方向的注视方向确定部162。hmd 100具有显示控制部161,该显示控制部161调整显示图像的显示方式,以使在显示于图像显示部20的显示图像中使用者u正注视的注视区域接近与使用者u的正面对应的规定位置即视野中心291。

[0148]

根据hmd 100,使用者u注视的区域接近在使用者u的视野中容易观察的位置,因此能够减轻使用者u的负担,实现便利性的提高。

[0149]

本公开是通过hmd 100显示图像的显示方法。该显示方法包含确定使用者u注视的方向的确定步骤。该显示方法包含调整步骤,在该调整步骤中,调整显示图像的显示方式,以使在hmd 100显示的显示图像中使用者u正注视的注视区域接近与使用者u的正面对应的规定的位置。

[0150]

本公开是通过佩戴于使用者u的头部的hmd 100显示图像的计算机可执行的程序。该程序是如下程序:用于确定使用者u注视的方向,并调整显示图像的显示方式,以使在hmd 100显示的显示图像中使用者u正注视的注视区域接近与使用者u的正面对应的规定的位置。

[0151]

根据上述显示方法以及程序,使用者u注视的区域接近在使用者u的视野中容易观察的位置,所以能够减轻使用者u的负担,实现便利性的提高。

[0152]

在本公开的显示方法中,预先设定规定的位置,在调整步骤中,移动显示图像的至少一部分,以使注视区域位于从规定的位置起的规定范围内。由此,能够容易地使显示图像中使用者u注视的区域移动到使用者u容易观察的位置。

[0153]

本公开的显示方法包含设定步骤,在该设定步骤中,基于使用者u朝向正面的情况下的视线方向来设定规定的位置。由此,能够设定对于使用者u而言适当的规定的位置。

[0154]

本公开的显示方法在通过调整步骤使显示图像移动的过程中,变更显示图像的移动速度。由此,能够使显示图像迅速地移动,并且能够减轻伴随显示图像移动的使用者u的不适感。

[0155]

本公开的显示方法在调整步骤中,在注视区域位于以规定的位置为中心的目标范围外的阶段,使显示图像以第1速度移动,在注视区域位于目标范围以内的阶段,使显示图像以比第1速度低的第2速度移动。由此,能够根据注视区域与规定的位置的相对位置来变更显示图像的移动速度。因此,能够使显示图像迅速地移动,并且能够减轻伴随显示图像移动的使用者u的不适感。

[0156]

本公开的显示方法在确定步骤中,通过hmd 100具有的视线检测部检测使用者u的视线方向,基于视线检测部的检测结果,确定使用者u注视的方向。由此,能够迅速地确定使用者u注视的方向。

[0157]

本公开的显示方法包含检测使用者u的特定操作的检测步骤,在检测到特定操作的情况下,执行开始确定步骤的处理和结束调整步骤的处理中的任意1个以上的处理。由此,使用者u能够容易地指示使显示图像的显示方式变化的处理的开始、结束。

[0158]

本公开的显示方法通过图像显示部20显示配置有标记的显示图像,在检测步骤中,将使用者u注视标记的情况检测为特定操作。由此,使用者u能够在不从图像显示部20的显示图像移开视线的情况下,容易地指示处理的开始、结束。

[0159]

[7.其他实施方式]

[0160]

本发明不限于在上述各实施方式中说明的结构,在不脱离其主旨的范围内能够以各种方式实施。

[0161]

图像显示部20并不限定于直接佩戴于使用者u的头部的方式。例如,也可以是将图像显示部20例如像帽子那样佩戴的方式。并且例如,图像显示部20也可以设为将右显示部22与左显示部24分离的方式。另外,图像显示部20也可以设为仅具有右显示部22和左显示部24中的任意一方的方式。另外,图像显示部20也可以构成为内置于头盔等身体防护用具的显示器。

[0162]

hmd 100是作为本发明的应用对象的显示装置的一例,并不限定于图2所示的结构。例如,在上述实施方式中,以图像显示部20和连接装置10分离的结构为例进行了说明,但也可以是连接装置10和图像显示部20构成为一体并佩戴于使用者u头部的结构。此外,图像显示部20的光学系统的结构是任意的,例如,可以使用位于使用者u的眼睛前方并与使用者u视野的一部分或全部重叠的光学部件。或者,也可以采用使激光等进行扫描而形成图像光的扫描方式的光学系统。或者,不限于在光学部件的内部对图像光进行引导,也可以仅具有朝向使用者u的眼睛使图像光折射和/或反射而进行引导的功能。

[0163]

此外,图2、图3所示的各功能块中的至少一部分可以通过硬件来实现,也可以是通过硬件与软件的协作实现的结构,不限定于如图中所示地配置独立的硬件资源的结构。另外,也可以构成为hmd 100经由通信线路取得存储于外部装置的程序来执行处理器160所执行的程序。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。