1.本发明涉及交通监控技术领域,特别是涉及一种基于深度卷积的车辆多目标检测方法。

背景技术:

2.深度学习在机器视觉和激光雷达信息等多传感器数据处理上的使用正受到越来越多的研究学者的关注,并被逐步应用于产品中。目标检测与定位是无人驾驶车辆的感知核心技术之一,可细分为目标检测与目标定位两部分。其中目标检测是实现在图像中能够检测和识别目标,目标定位是实现能够获得目标相对传感器的距离信息。针对目标检测与定位技术,目前多采用传统的方法和复杂度高的卷积神经网络来实现。传统的方法中每个目标需要特定设计的特征和分类器,且每个分类器的参数无法共享,这对于多目标的检测会需要很多计算时间,完全不能满足无人驾驶车辆的实时性处理要求。

3.复杂度高的卷积神经网络内采用的传统卷积操作需要较大的运算次数和内存空间,且特征层之间缺少数据的交流,不易于网络的训练,以及不能满足无人驾驶车辆的实时性处理要求。因此,现有的目标检测与定位方法应具有较高的准确度,能够用于存在多个静态、动态目标的复杂场景,并且满足自动驾驶车辆的实时性检测定位需求;不可以同时根据算法快速的进行道路溢出检测,从而不能有效的对多车辆检测进行轻量化计算,不能更好的通过算法降低车辆拥堵的情况发生。

技术实现要素:

4.本发明的目的是提供一种基于深度卷积的车辆多目标检测方法,解决了现有技术中基于车辆多目标检测的方法,不能有效的对多车辆检测进行轻量化计算,不能更好的通过算法降低车辆拥堵的情况发生的问题。

5.为了实现上述目的,本发明采用了如下技术方案:

6.一种基于深度卷积的车辆多目标检测方法,包括以下步骤:

7.第一步,实时采集车辆前方的图像数据和点云数据;相机预置位设置以及相机标定,所述的相机预置位为进行道路溢出区域检测时相机所处的固定位置;

8.第二步,将上述采集到的图像数据实时传输到训练好的目标检测模型,进行目标识别,获取目标信息;所述目标检测模型采用轻量化卷积神经网络;

9.第三步,获取实时视频流,使用卷积神经网络模型对兴趣区域进行车辆目标检测;道路溢出事件上报并设置睡眠状态;

10.第四步,上述目标信息及点云数据匹配到对应车辆的位置信息。

11.优选的,所述目标信息包括目标的类别和目标的2d包围盒信息;所述轻量化卷积神经网络包括:骨干网络和特征提取网络,获取的目标的2d包围盒信息进行处理,当出现相同类别的多个2d包围盒位置重叠程度超过设定的iou阈值时,保留检测分数高的2d包围盒,移除其他2d包围盒。

12.优选的,所述将上述目标检测模型获取的目标信息及点云数据输入到训练好的目标定位模型,进行目标定位,得到目标相对于车辆的位置信息,包括:获取kitti数据集作为目标定位模型的训练集。

13.优选的,所述基于tensorflow深度学习框架,构建目标定位模型;将上述获取的训练集输入到目标定位模型中,设置初始化方法、学习率、优化器和损失函数,对模型进行多次训练,获得网络模型定位权重文件。

14.优选的,所述将采集的点云数据与激光雷达坐标系投影到像素坐标系的标定参数进行计算后投影到图像上,基于目标检测模型获取的目标2d包围盒信息,从投影到图像上的点云数据中获取在目标2d包围盒内的点云数据。

15.优选的,所述将每一个目标2d包围盒内的点云数据分别输入到目标定位模型中,以上述网络模型定位权重文件作为定位网络的权重参数,得到每一个目标与车辆的距离信息和目标的3d包围盒信息,所述点云数据由所述激光雷达采集得到。

16.优选的,所述道路溢出上报并设置睡眠状态包含以下步骤:

17.(1):如果成功检测出道路溢出,选择在前tduring时刻的视频帧和当前视频帧上绘制出当前的道路溢出检测区域,并在视频帧底边添加视频帧时间和地点信息后将两张图像左右排列合并,最后将道路溢出信息以及合成图进行上报;

18.(2):如果成功将道路溢出事件上报,则设置为睡眠状态,直至tsleep后重新开启道路溢出检测,其中tsleep为预先阈值的阈值,单位为秒,其取值范围为tsleep≥1。

19.本发明具备以下有益效果:

20.1.应用于相机与激光雷达数据融合处理的场合,用于对静态、动态目标进行检测和定位,通过对图像和点云数据输入至轻量化卷积神经网络模型中,经过数据与模型权重的计算,实时地输出目标的类别信息、目标与传感器之间的距离信息,从而使得车辆能够实时感知目标信息,检测和识别结果具有较高的准确度,能够用于存在多个静态、动态目标的复杂场景,并且满足自动驾驶车辆的实时性检测定位要求。

21.2.实现了实时的检测效果以及较高的道路溢出识别精度,可以极大降低人力资源成本,及时提供道路溢出情况,辅助交通调度,避免交通瘫痪,同时本发明也可以为路口溢出统计提供有效的数据、减少交通负荷和环境污染、保证交通安全、提高通行效率。

附图说明

22.为了更清楚地说明本发明实施例技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

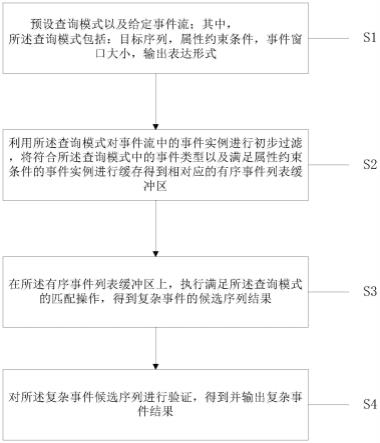

23.图1为车辆多目标检测方法流程示意图。

具体实施方式

24.为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行进一步详细说明。应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明。

25.实施例一

26.参照图1,一种基于深度卷积的车辆多目标检测方法,包括以下步骤:

27.第一步,实时采集车辆前方的图像数据和点云数据;相机预置位设置以及相机标定,的相机预置位为进行道路溢出区域检测时相机所处的固定位置;

28.第二步,将上述采集到的图像数据实时传输到训练好的目标检测模型,进行目标识别,获取目标信息;目标检测模型采用轻量化卷积神经网络;

29.第三步,获取实时视频流,使用卷积神经网络模型对兴趣区域进行车辆目标检测;道路溢出事件上报并设置睡眠状态;

30.第四步,上述目标信息及点云数据匹配到对应车辆的位置信息;

31.本实施例中,应用于相机与激光雷达数据融合处理的场合,用于对静态、动态目标进行检测和定位,通过对图像和点云数据输入至轻量化卷积神经网络模型中,经过数据与模型权重的计算,实时地输出目标的类别信息、目标与传感器之间的距离信息,从而使得车辆能够实时感知目标信息,检测和识别结果具有较高的准确度,能够用于存在多个静态、动态目标的复杂场景,并且满足自动驾驶车辆的实时性检测定位要求。

32.实施例二

33.参照图1,一种基于深度卷积的车辆多目标检测方法,包括以下步骤:第一步,实时采集车辆前方的图像数据和点云数据;相机预置位设置以及相机标定,的相机预置位为进行道路溢出区域检测时相机所处的固定位置;第二步,将上述采集到的图像数据实时传输到训练好的目标检测模型,进行目标识别,获取目标信息;目标检测模型采用轻量化卷积神经网络;第三步,获取实时视频流,使用卷积神经网络模型对兴趣区域进行车辆目标检测;道路溢出事件上报并设置睡眠状态;第四步,上述目标信息及点云数据匹配到对应车辆的位置信息;

34.目标信息包括目标的类别和目标的2d包围盒信息;轻量化卷积神经网络包括:骨干网络和特征提取网络,获取的目标的2d包围盒信息进行处理,当出现相同类别的多个2d包围盒位置重叠程度超过设定的iou阈值时,保留检测分数高的2d包围盒,移除其他2d包围盒;将上述目标检测模型获取的目标信息及点云数据输入到训练好的目标定位模型,进行目标定位,得到目标相对于车辆的位置信息,包括:获取kitti数据集作为目标定位模型的训练集;基于tensorflow深度学习框架,构建目标定位模型;将上述获取的训练集输入到目标定位模型中,设置初始化方法、学习率、优化器和损失函数,对模型进行多次训练,获得网络模型定位权重文件;

35.将采集的点云数据与激光雷达坐标系投影到像素坐标系的标定参数进行计算后投影到图像上,基于目标检测模型获取的目标2d包围盒信息,从投影到图像上的点云数据中获取在目标2d包围盒内的点云数据;将每一个目标2d包围盒内的点云数据分别输入到目标定位模型中,以上述网络模型定位权重文件作为定位网络的权重参数,得到每一个目标与车辆的距离信息和目标的3d包围盒信息,点云数据由激光雷达采集得到;

36.其中,道路溢出上报并设置睡眠状态包含以下步骤:

37.(1):如果成功检测出道路溢出,选择在前tduring时刻的视频帧和当前视频帧上绘制出当前的道路溢出检测区域,并在视频帧底边添加视频帧时间和地点信息后将两张图像左右排列合并,最后将道路溢出信息以及合成图进行上报;

38.(2):如果成功将道路溢出事件上报,则设置为睡眠状态,直至tsleep后重新开启

道路溢出检测,其中tsleep为预先阈值的阈值,单位为秒,其取值范围为tsleep≥1

39.本实施例中,实现了实时的检测效果以及较高的道路溢出识别精度,可以极大降低人力资源成本,及时提供道路溢出情况,辅助交通调度,避免交通瘫痪,同时本发明也可以为路口溢出统计提供有效的数据、减少交通负荷和环境污染、保证交通安全、提高通行效率。

40.以上显示和描述了本发明的基本原理、主要特征和本发明的优点。本行业的技术人员应该了解,本发明不受上述实施例的限制,上述实施例和说明书中描述的只是本发明的原理,在不脱离本发明精神和范围的前提下本发明还会有各种变化和改进,这些变化和改进都落入要求保护的本发明的范围内。本发明要求的保护范围由所附的权利要求书及其等同物界定。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。