1.本发明涉及计算机视觉领域,特别是一种道路分割方法及计算机装置。

背景技术:

2.道路信息在应急响应、智慧城市、城市可持续扩展、车辆管理、城市规划、交通导航、公共健康,无人机导航、灾害管理、农业发展,以及无人驾驶车路径规划和交通管理等多个领域扮演着基础性的角色。光学遥感、倾斜摄影正射影像等数据,不仅具有宏观性、多源性、真实性、海量性等一系列优点,而且能够以较高的空间分辨率对目标地物进行精细化解译,其提取的目标信息具有严格的地理坐标转换关系,可为不同行业用户提供统一的表达模式。

3.目前道路提取传统手段主要采用模板匹配、知识驱动、面向对象等方法,王文峰(基于局部方向编码的遥感影像平行边缘识别.光学学报.2012,32(3):0315001)等利用道路平行边缘的特点,提出了交叉点共线约束的8邻域边界追踪算法和9像素滑动窗口内直线检测算法,但该方法对道路边缘模糊、遮挡等问题敏感,schubert(efficient computation of greyscale path openings.mathematical morphology theory and applications,2016,1(1):189-202)等根据道路的几何特征,利用路径形态学提取影像中长而窄的结构,但受到遮挡(树木)、相似纹理(房屋)等干扰时,会出现道路错提、漏提问题。

4.随着深度学习的崛起,众多优秀的网络模型被相继提出,如unet、pspnet、deeplabv3等,而这些网络也被广泛应用于道路提取中,其通过encoder阶段(编码器阶段)对图像进行特征提取,再在decoder阶段(解码器阶段)上采样和叠加细节特征来恢复原始大小进行分类,由于空间信息的保留,道路轮廓分割结果边缘抗干扰性较高,边缘更细致化,但是受建筑物阴影、绿化带遮挡时其容易出现误识别,道路提取结果连通性不足。

5.专利申请cn113888550a《一种结合超分辨率和注意力机制的遥感图像道路分割方法》以语义分割unet网络为基础结合注意力机制,实现了城市遥感图像道路的准确提取,但该方法存在以下缺陷:(1)并未针对道路特有的形态特征设计网络结构,对于一些农村非常规道路,可能出现无法识别的问题;(2)其注意力机制只考虑了空间层面的特征融合,未考虑通道层面的融合,同时其模型结构不具备扩张感受野的能力,无法有效识别树木遮挡场景下的道路。

技术实现要素:

6.本发明所要解决的技术问题是,针对现有技术不足,提供一种道路分割方法及计算机装置,更准确的捕捉道路拓扑结构特征。

7.为解决上述技术问题,本发明所采用的技术方案是:一种道路分割方法,包括以下步骤:

8.s1、从无人机航拍高分辨率道路数据集获取n张图像,利用所述n张图像获取训练集;

9.s2、利用所述训练集训练道路提取模型,得到训练后的道路提取模型;

10.所述道路提取模型包括:

11.特征提取层,用于对所述训练集中的图像进行降采样操作;

12.至少一个双注意力残差模块,包括至少一个残差单元,所述残差单元用于对输入进行包括如下步骤的操作:

13.对所述特征提取层的输出进行卷积操作,得到特征向量f1;

14.将所述特征向量f1输入通道注意力模块,并将所述通道注意力模块的输出与所述特征向量f1相乘,得到第一输出结果;

15.将所述第一输出结果输入空间注意力模块,并将所述空间注意力模块的输出与所述第一输出结果相乘,得到第二输出结果;

16.拼接所述特征向量f1与所述第二输出结果,得到第三输出结果;

17.上采样重建模块,用于对所述第三结果进行上采样操作,得到最终输出结果;

18.s3、将待测试图像输入所述训练后的道路提取模型,得到道路提取结果。

19.本发明构建了双注意力残差模块,在自适应调节感受野之外兼顾了全局信息的提取,能够更准确地捕捉道路拓扑结构特征,获得更拟合目标的感受野,提升了道路提取的连贯性和准确性,可以识别各种环境下的道路,解决了建筑物阴影和树木遮挡的干扰造成的道路无法识别问题。

20.所述双注意力残差模块数量为两个,其中第一个双注意力残差模块的输出经池化层后输入第二个双注意力残差模块,且两个所述双注意力残差模块的输出拼接后的结果为所述上采样重建模块的输入。两个双注意力残差模块串联有利于图像深层特征提取,拼接两个所述双注意力残差模块的输出有助于多层次特征信息融合,提升道路分割精度。

21.所述双注意力残差模块数量为三个,其中第一个双注意力残差模块的输出经池化层后输入第二个双注意力残差模块,第二个双注意力残差模块的输出经池化层后输入第三个双注意力残差模块,且三个所述双注意力残差模块的输出拼接后的结果为所述上采样重建模块的输入。三个双注意力残差模块串联有利于进一步提取图像高层语义信息,拼接三个所述双注意力残差模块的输出有助于多尺度特征信息融合,提升道路分割精度。

22.每个所述双注意力残差模块与一个全局金字塔聚合模块连接。全局金字塔聚合模块扩展感受野并融合上下文语义信息,保障了图像全局信息的融合,降低图像信息损失。

23.本发明中,所有金字塔聚合模块的输出拼接后得到的拼接结果输入所述上采样重建模块。该结构有利于整合图像多尺度全局信息,为上采样层提供丰富的语义信息,提高道路的分割精度。

24.或者,第n个金字塔聚合模块的输出经第一上采样层后与第n-1个金字塔聚合模块的输出拼接,得到的第一拼接结果输入第二上采样层,第二上采样层的输出与第n-2个金字塔采样模块的输出拼接后,得到的第二拼接结果输入第三上采样层,依此类推;其中,n为最后一个金字塔聚合模块,n≥3。该结构实现了图像多尺度特征的高效融合、局部信息与全局信息的深度关联,降低了图像上采样过程中的图像信息损失,有助于图像的精确分割。

25.本发明的道路提取模型还包括非局部注意力聚合模块,所述非局部注意力聚合模块的输入为所述双注意力残差模块的输出经池化层操作后的结果;所述非局部注意力聚合模块的输出与上一处理层的输出拼接后输入所述上采样重建模块;其中,所述上一处理层

为最后一个双注意力残差模块,或者最后一个金字塔聚合模块。该结构整合图像多个维度方向的信息,专注捕获目标感兴趣特征,剔除冗余特征,降低模型参数量,提高了道路形状分割精度。

26.所述非局部注意力聚合模块与池化层之间还设有可变形卷积网络。所述可变形卷积网络可以较好的适应图像中目标的多种尺寸形状,使得提取到的特征更丰富更加集中于目标本身。

27.所述双注意力残差模块包括多个串联的残差单元,其中第一个残差单元的输入为所述特征提取层的输出;第二个残差单元的输入为所述第一个残差单元的输出,依此类推。多个残差单元的串联有利于提取到更深层的图像特征,有助于网络理解图像语义信息。

28.当所述双注意力残差模块个数为多个时,每个所述双注意力残差模块中残差单元的数量不同。多个具有不同数量残差单元的双注意力残差模块串联可实现对不同层次阶段的特征进行多维度融合,有利于图像深度语义信息的获取。

29.本发明还提供了一种计算机装置,包括存储器、处理器及存储在存储器上的计算机程序;所述处理器执行所述计算机程序,以实现本发明所述方法的步骤。

30.与现有技术相比,本发明所具有的有益效果为:

31.(1)本发明提出了双注意力的残差学习模块,结合可变形卷积网络,在自适应调节感受野之外兼顾了多维度信息的提取,能够更准确的捕捉道路拓扑结构特征,获得更拟合目标的感受野,提升了道路提取的连贯性;

32.(2)本发明采用了全局金字塔聚合模块与非局部注意力结构,通过扩展模型感受野并融合上下文语义信息,降低图像在上采样过程中的信息损失,使模型具有拓扑结构自推理能力,解决了建筑物阴影和树木遮挡的干扰造成的无法识别问题。

附图说明

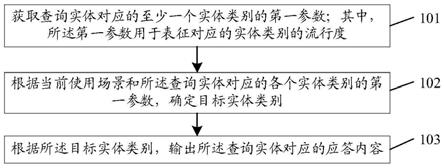

33.图1为本发明实施例1道路提取模型结构原理图;

34.图2为本发明实施例1双注意力残差模块结构原理图;

35.图3为本发明实施例1通道注意力模块结构原理图;

36.图4为本发明实施例1空间注意力模块结构原理图;

37.图5为本发明实施例1残差块结构原理图;

38.图6为本发明实施例1可变形卷积层结构原理图;

39.图7为本发明实施例1可变形池化层结构原理图;

40.图8为本发明实施例1全局金字塔聚合模块结构原理图;

41.图9为本发明实施例1非局部注意力聚合模块结构原理图;

42.图10为本发明实施例2道路提取模型结构原理图;

43.图11为本发明实施例3道路提取模型结构原理图;

44.图12为本发明实施例4道路提取模型结构原理图;

45.图13(a)~图13(c)为本发明实施例1方案对应的道路连贯性实验结果图;图13(a)为原始图像;13(b)为本发明方法对应的提取结果;13(c)为deeplabv3方法对应的提取结果;

46.图14(a)~图14(c)为本发明实施例1方案对应的道路连贯性实验结果图;图14(a)

in neural information processing systems,2015,28.)进行串联,其中通道注意力模块输入为步骤s2.2中第二个3x3卷积输出的特征向量f1,将特征向量f1分别经过全局最大池化和全局平均池化得到f

max

和f

avg

两个特征向量,将f

max

和f

avg

两个特征向量通过mlp层进行全局特征提取获得f`

max

和f`

avg

,将f`

max

和f`

avg

相加,经过sigmoid函数激活操作,生成最终的通道注意力权重f

mc

。将该通道注意力权重和特征向量f1做乘法操作,获得特征向量f2。

63.f

mc

=σ(mlp(avgpool(f1)) mlp(maxpool(f1)))

64.=σ(w1(w0(f

avg

)) w1(w0(f

max

)))

65.其中f1表示输入的特征向量,f

avg

和f

max

分别表示经过全局最大池化和全局平均池化得到的两个特征向量,mlp是多层感知机,w1和w0代表的是多层感知机模型中的两层参数,σ表示sigmoid激活函数,f

mc

表示生成的最终的通道注意力权重。

66.空间注意力模块输入为特征向量f2,将特征向量f2分别经过全局最大池化和全局平均池化得到特征向量f

max2

和f

avg2

,将f

max2

和f

avg2

通过conv7x7的卷积层进行全局特征提取获得f、,经过sigmoid函数(对应图3和图4中的)激活操作,生成最终的空间注意力权重f

ms

,f

ms

与特征向量f2通过矩阵乘法的结果与双注意力残差模块的输入进行拼接操作,获得输出特征向量f3。

67.f

ms

=σ(f7×7([avgpool(f2);maxoool(f2)]))

[0068]

=σ(f7×7([f

avg2

;f

max2

]))

[0069]

其中σ为sigmoid操作,f7×7代表卷积核为7

×

7的卷积,f

avg2

和f

max2

分别代表经过全局最大池化和全局平均池化得到的特征向量。

[0070]

3个双注意力残差模块(图1中的res-block(with cbam))以串联形式依次连接,图1中,3*res-block(with cbam)表示3个残差单元串联,4*res-block(with cbam)表示4个残差单元串联,6*表示6个残差单元串联。双注意力残差模块的结构见图2。第3个双注意力残差模块后接可变形卷积网络(dcnv2,见图6,dai j,qi h,xiong y,et al.deformable convolutional networks[c]//proceedings of the ieee international conference on computer vision.2017:764-773.),该可变形卷积网络包含可变形卷积层与可变形池化层,可变形卷积层设置为两个分支,第一个分支增加额外的卷积层来学习偏置,第二个分支卷积核先基于偏置进行插值操作,然后与输入特征进行常规卷积操作,获得输出特征:

[0071][0072]

其中,p0代表输入特征上的一点,pn代表第n个位置,w是卷积运算函数,x为输入特征,δpn为偏移量。

[0073]

上述可变形卷积层输出通过可变形池化层(见图7)进行下采样处理,该可变形池化层设置为两个分支,第一个分支通过常规池化操作获得局部特征向量,利用全连接层(fc)来学习偏置,第二个分支先基于偏置进行插值操作,然后与输入特征进行常规池化操作,获得输出特征:

[0074][0075]

其中,p0代表输入特征上的一点,pn代表每个位置,x为输入特征,δpn为偏移量,n

ij

为池化的尺寸。

[0076]

s2.3全局金字塔聚合模块如图8所示,对于多个分支的输入,先用1x1卷积层使各输入特征向量通道数相同,再上采样得到相同的尺寸,而后拼接个分支的输出,再经过具有不同膨胀系数的可分离膨胀卷积,此处膨胀系数设置为1、2、4,获取不同感受野的各层融合信息,最后通过3

×

3卷积层得到最终结果;

[0077][0078]

其中gk是第k步的输出,fk为第k步时编码层的特征图,表示上采样倍率为2

i-k

,代表特征拼接操作,d

sconv

@2

i-k

表示可分离空洞卷积;

[0079]

s2.4非局部注意力模块(wang x,girshick r,gupta a,et al.non-local neural networks[c]//proceedings of the ieee conference on computer vision and pattern recognition.2018:7794-7803.)如图9所示,将可变形池化层的输出x经过3个1

×

1卷积,把通道缩减为原来一半得到θ、g三个张量,通过展平操作将θ、g三个张量的高(h),宽(w)两个维度进行展平(将多维的输入向量一维化,即图9中的flatten),维数变为h

×

w,获得形状为[c/2,h

×

w]的θ1、g1三个张量,c为单个特征向量的通道数。对θ1、g1对应的张量进行通道重排,在线性代数中也就是转置,分别得到形状为[h

×

w,c/2]的张量θ2、g2,将θ2与代表的张量进行矩阵乘法,得到一个形状为[h

×

w,h

×

w]的矩阵f,经过softmax函数进行归一化,得到形状为[h

×

w,h

×

w]的分数矩阵fc,将得到的分数矩阵fc与g2进行矩阵相乘,得到的形状为[h

×

w,c/2]的张量fd。将fd转置为[c/2,h

×

w]的张量,将h

×

w维度重新伸展为[h,w],从而得到了形状为[c/2,h,w]的张量fe,利用1

×

1卷积核,将fe通道扩展为原来的c,维度变为[c,h,w],并将其与可变形池化层的输出x进行相加得到输出y。

[0080]

g(xj)=wgxj[0081]

其中wg是可学习的权重矩阵,xj为输入

[0082][0083][0084]

其中代表相似度计算

[0085][0086]

x是输入信号feature map;

[0087]

i代表的是输出位置,如空间、时间或者时空的索引,对j进行枚举后计算得到;

[0088]

f函数计算i和j的相似度;

[0089]

g函数计算feature map在j位置的表示;

[0090]

最终的y是通过响应因子c(x)进行标准化处理以后得到的。

[0091]

s2.4图1中的3个上采样层(图1竖向箭头表示上采样层,decoder block)采用1x1卷积层 3x3转置卷积 1x1卷积层组合,利用转置卷积学习自适应映射,得到更详细的信息

恢复特征,其中从下往上第1上采样层的输入为非局部注意力聚合模块的输出与第1个全局金字塔聚合模块的输出拼接所得的特征向量,第2个上采样层的输入为第1个上采样层的输出与第2全局金字塔聚合模块的输出拼接所得的特征向量,第3个上采样层的输入为第2个上采样层的输出与第3全局金字塔聚合模块的输出拼接所得的特征向量。

[0092]

进一步,s3的具体实现步骤如下:

[0093]

s3.1使用pytorch作为深度学习框架。所有模型均在2个nvidia gtx2080 gpu上进行了训练。

[0094]

s3.2使用二值交叉熵函数作为损失函数,并选择adam作为优化器,学习率为2*10-4

,训练批次大小为4,训练周期为160epoch。s2中所给定数据集{(x1,y1),

…

(xn,yn)},目标函数如下定义,其中n是训练集的样本数。

[0095]

f(xi;0)=-[yiln(σ(xi)) (1-yi)ln(1-σ(xi))]

[0096]

其中yi为标签,网络预测结果为

[0097][0098]

其中f(xi;θ)为特征提取函数;xi为输入特征;yi为对应的真值;θ为求解的最优参数;l(θ)为目标函数

[0099]

s3.3训练时采用随机梯度下降(sgd)来最小化目标函数。其更新过程可写成如下:

[0100][0101]

其中α为步长,为梯度

[0102]

具体步骤如下:首先对网络参数θ进行随机初始化,然后参数θ按照以下更新规则来最小化目标函数:

[0103][0104][0105]

……

[0106][0107]

进行n次迭代,直到满足要求,循环结束,得到θ值。

[0108]

s3.4利用pytorch框架api,torch.save()函数保存最佳训练权重,通过torch.load()函数加载模型参数,将训练完成的模型对s.1中的测试集进行推理测试。、

[0109]

本发明实施例2中,双注意力残差模块数量也可以只有一个,如图10所示。图10中的m为残差单元数量,可以为1个或者多个。

[0110]

本发明实施例3中,双注意力残差模块的数量为两个,如图11所示。

[0111]

本发明实施例4中,所有全局金字塔聚合模块的输出可以拼接到一起,以实施例1的结构为例,得到图12的结构。

[0112]

图11、12中,残差单元数量可以根据实际使用需要设置。

[0113]

图10~图12的实施例中,双注意力残差模块也可以不接全局金字塔聚合模块。

[0114]

图1、图11和图12的实施例中,可以只有一个或者两个双注意力残差模块接全局金字塔聚合模块。

[0115]

进一步,具体实现结果如下。

[0116]

由图13(a)~图13(c)可以看出,常规语义分割算法(chen l c,zhu y,papandreou g,et al.encoder-decoder with atrous separable convolution for semantic image segmentation[c]proceedings of the european conference on computer vision(eccv),2018:801-818)识别结果中道路出现多处未识别,道路提取线条连贯性差的问题,本发明实施例方法所提取道路整体结构完整,连续性好。

[0117]

由图14(a)~图14(c)可以看出,常规语义分割算法在面对道路被树木遮挡场景,无法有效识别被遮挡部分,本发明实施例方法在树木遮挡场景下,依然能成功提取出遮挡部分,识别效果极佳。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。