1.本发明涉及计算机视觉与自动驾驶技术领域,特别是涉及一种多传感器融合体素特征图生成方法及系统。

背景技术:

2.在过去的十几年中,许多学者对计算机视觉技术开展研究并取得了丰硕的研究成果,作为计算机视觉技术的重要应用之一,自动驾驶领域中的环境感知技术近年来也被广泛研究,成为一个研究热点。自动驾驶汽车通常装载摄像机和激光雷达传感器从而分别获取周围环境的高分辨率图像和激光雷达点云,高分辨率图像由规则稠密分布的像素组成,包含颜色信息;激光雷达点云则由不规则且稀疏分布于空间中的离散点组成,包含位置信息。这两种信息是环境感知技术中最常见的两种输入信息,大部分计算机视觉任务都建立在这两种信息的基础上。在计算机视觉领域,卷积神经网络是一种常用且有效的技术,通过使用卷积神经网络可以构建深度学习网络,将包含各种信息的数据输入深度学习网络,从而提取出输入数据中的特征信息并完成一些视觉任务,比如自动驾驶场景下的三维目标检测,语义分割和实例分割等。

3.目前,在实际应用中,现存高性能三维目标检测方法通常仅使用点云数据作为输入,但这类方法缺少图像信息中的rgb通道信息值,图像中的rgb信息和点云蕴含的三维结构信息都是辨别物体的重要特征。现存也有一些多模态融合方法,它们通常以pixel-to-pixel的方式将点云特征图和图像特征图相加以进行融合,但这种融合方法受限于特征图与特征图之间的校准,结果并没有单模态方法的准确率高。

4.因此,如何设计一种能够提高三维目标检测准确率的多传感器融合体素特征图生成方法及系统,成为本领域亟需解决的技术问题。

技术实现要素:

5.本发明的目的是提供一种多传感器融合体素特征图生成方法及系统,通过本发明能够提高三维目标检测的准确率。

6.为实现上述目的,本发明提供了如下方案:

7.一种多传感器融合体素特征图生成方法,该方法包括以下步骤:

8.获取激光雷达点和原始图像;

9.根据所述原始图像与所述激光雷达点之间的映射关系,将所述原始图像的像素映射到相应的激光雷达点,得到第一映射数据;

10.根据所述激光雷达点与前视图像之间的映射关系,将所述第一映射数据映射到前视图像的像素上,得到第二映射数据;

11.对所述第二映射数据进行稀疏化编码,生成轻量化稀疏图像;

12.将所述激光雷达点进行体素化,得到所述激光雷达点的三维体素;

13.对所述轻量化稀疏图像和所述三维体素进行特征提取,得到像素特征和体素特

征;

14.将所述像素特征和所述体素特征编码到对应的点云位置,得到像素点云特征和体素点云特征;

15.将所述像素点云特征和所述体素点云特征进行特征融合,得到点云融合特征;

16.对所述点云融合特征进行反映射,得到多传感器融合体素特征图。

17.可选的,根据所述原始图像与所述激光雷达点之间的映射关系,将所述原始图像的像素映射到相应的激光雷达点,得到第一映射数据,具体包括:

18.根据摄像机和激光雷达之间的标定矩阵,建立所述原始图像与所述激光雷达点之间的第一映射关系;所述第一映射关系为:

[0019][0020]

其中,x为点云深度维度上的坐标,y为点云宽度维度上的坐标,z为点云高度维度上的坐标,ur为原始图像中像素的横坐标,vr为原始图像中像素的纵坐标,i为内参矩阵,e为外参矩阵。

[0021]

可选的,根据所述激光雷达点与前视图像之间的映射关系,将所述第一映射数据映射到前视图像的像素上,得到第二映射数据,具体包括:

[0022]

利用球面投影原理建立所述激光雷达点与所述前视图像之间的第二映射关系;所述第二映射关系为:

[0023][0024]

其中,u为前视图像中像素的横坐标,v为前视图像中像素的纵坐标,x为点云深度维度上的坐标,y为点云宽度维度上的坐标,z为点云高度维度上的坐标,r为反射强度,w为前视图像的宽度,h为前视图像的高度,fov

down

为激光雷达下方垂直视角,fov为激光雷达垂直视角;

[0025]

根据所述第二映射关系将所述第一映射数据映射到前视图像像素上,得到第二映射数据。

[0026]

可选的,对所述第二映射数据进行稀疏化编码,生成轻量化稀疏图像,具体包括:

[0027]

判断所述第二映射数据中的任一映射数据是否为所述第一映射数据中的多个映射数据映射得到,得到第一判断结果;

[0028]

若所述第一判断结果为是,则将所述第一映射数据中的所述多个映射数据的平均值作为所述第二映射数据中的所述任一映射数据的编码值;

[0029]

判断所述第二映射数据中的任一映射数据是否为所述第一映射数据中的一个映射数据映射得到,得到第二判断结果;

[0030]

若所述第二判断结果为是,则将所述第一映射数据中对应的映射数据作为所述第

二映射数据中的所述任一映射数据的编码值;

[0031]

若所述第一判断结果和所述第二判断结果都为否,则不进行编码。

[0032]

可选的,将所述激光雷达点进行体素化,得到所述激光雷达点的三维体素,具体包括:

[0033]

判断体素中的任一体素是否包含多个所述激光雷达点,得到第三判断结果;

[0034]

若所述第三判断结果为是,则使用多个所述激光雷达点的平均值作为体素中的任一体素的编码值;

[0035]

判断体素中的任一体素是否包含一个所述激光雷达点,得到第四判断结果;

[0036]

若所述第四判断结果为是,则使用对应的激光雷达点作为体素中的任一体素的编码值;

[0037]

若所述第三判断结果和所述第四判断结果都为否,则不进行编码。

[0038]

可选的,对所述轻量化稀疏图像和所述三维体素进行特征提取,得到像素特征和体素特征,具体包括:

[0039]

分别构建二维稀疏卷积的特征提取网络和三维稀疏卷积的特征提取网络;

[0040]

利用所述二维稀疏卷积的特征提取网络对所述轻量化稀疏图像进行特征提取,得到像素特征;

[0041]

利用所述三维稀疏卷积的特征提取网络对所述三维体素进行特征提取,得体素特征。

[0042]

可选的,将所述像素特征和所述体素特征编码到对应的点云位置,得到像素点云特征和体素点云特征,具体包括:

[0043]

使用基于四近邻域的二次线性插值算法将所述像素特征编码至点云位置,得到所述像素点云特征;

[0044]

使用基于反距离权重法的三次线性插值算法将所述体素特征编码至点云位置,得到所述体素点云特征。

[0045]

可选的,将所述像素点云特征和所述体素点云特征进行特征融合,得到点云融合特征,具体包括:

[0046]

使用第一全连接块对所述像素点云特征进行处理,得到一维像素点云特征;所述第一全连接块包括三个全连接层、二个批标准化层和二个relu激活函数层;

[0047]

使用第二全连接块对所述体素点云特征进行处理,得到一维体素点云特征;所述第二全连接块包括三个全连接层、二个批标准化层和二个relu激活函数层;

[0048]

使用sigmoid函数对所述一维像素点云特征和所述一维体素点云特征进行处理,得到像素点云特征权重和体素点云特征权重;所述sigmoid函数为:

[0049][0050]

其中,w

pp

为像素点云特征权重,w

pv

为体素点云特征权重,为一维像素点云特

征,为一维体素点云特征;

[0051]

利用所述像素点云特征权重和所述体素点云特征权重融合所述像素点云特征和所述体素点云特征,得到点云融合特征;融合表达式为:

[0052]ffuse

=[f

pp

(1 w

pp

),f

pv

(1 w

pv

)]

[0053]

其中,f

fuse

为点云融合特征,f

pp

为像素点云特征,f

pv

为体素点云特征。

[0054]

可选的,对所述点云融合特征进行反映射,得到多传感器融合体素特征图,具体包括:

[0055]

使用三次线性插值方法将所述点云融合特征反映射至体素特征中非空体素的位置,得到替换点云融合特征;

[0056]

将所述替换点云融合特征替换体素特征中对应位置的非空体素特征,得到多传感器融合体素特征图。

[0057]

本发明还提供了一种多传感器融合体素特征图生成系统,该系统包括:

[0058]

数据获取模块,用于获取激光雷达点和原始图像;

[0059]

第一映射模块,用于根据所述原始图像与所述激光雷达点之间的映射关系,将所述原始图像的像素映射到相应的激光雷达点,得到第一映射数据;

[0060]

第二映射模块,用于根据所述激光雷达点与前视图像之间的映射关系,将所述第一映射数据映射到前视图像的像素上,得到第二映射数据;

[0061]

稀疏化编码模块,用于对所述第二映射数据进行稀疏化编码,生成轻量化稀疏图像;

[0062]

体素化模块,用于将所述激光雷达点进行体素化,得到所述激光雷达点的三维体素;

[0063]

特征提取模块,用于对所述轻量化稀疏图像和所述三维体素进行特征提取,得到像素特征和体素特征;

[0064]

点云特征获取模块,用于将所述像素特征和所述体素特征编码到对应的点云位置,得到像素点云特征和体素点云特征;

[0065]

特征融合模块,用于将所述像素点云特征和所述体素点云特征进行特征融合,得到点云融合特征;

[0066]

反映射模块,用于对所述点云融合特征进行反映射,得到多传感器融合体素特征图。

[0067]

根据本发明提供的具体实施例,本发明公开了以下技术效果:

[0068]

本发明所述方法建立原始图像与激光雷达点之间的映射关系,激光雷达点和前视图像之间的映射关系,生成轻量化稀疏图像,为图像信息的快速处理提供了基础。同时,本发明所述方法融合两种传感器特征提取网络提取的特征,构建了信息更丰富的环境信息特征,提高了三维目标检测的准确率。

附图说明

[0069]

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施

例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

[0070]

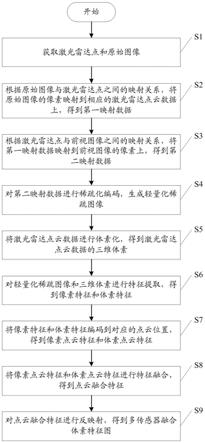

图1为本发明实施例1提供的一种多传感器融合体素特征图生成方法的流程图;

[0071]

图2为kitti自动驾驶数据集中7312号样本的原始图像;

[0072]

图3为kitti自动驾驶数据集中7312号样本的激光雷达点;

[0073]

图4为kitti自动驾驶数据集中7312号样本的轻量化稀疏图像;

[0074]

图5为特征融合网络结构图;

[0075]

图6为多传感器融合体素特征图生成原理图。

[0076]

图7为本发明实施例2提供的一种多传感器融合体素特征图生成系统的结构图。

[0077]

符号说明:

[0078]

1、数据获取模块;2、第一映射模块;3、第二映射模块;4、稀疏化编码模块;5、体素化模块;6、特征提取模块;7、点云特征获取模块;8、特征融合模块;9、反映射模块。

具体实施方式

[0079]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0080]

本发明的目的是提供一种多传感器融合体素特征图生成方法及系统,通过本发明能够提高三维目标检测的准确率。

[0081]

为使本发明的上述目的、特征和优点能够更加明显易懂,下面结合附图和具体实施方式对本发明作进一步详细的说明。

[0082]

实施例1:

[0083]

请参阅图1,本发明提供了一种多传感器融合体素特征图生成方法,该方法包括以下步骤:

[0084]

s1:获取激光雷达点和原始图像;

[0085]

s2:根据所述原始图像与所述激光雷达点之间的映射关系,将所述原始图像的像素映射到相应的激光雷达点,得到第一映射数据;

[0086]

s3:根据所述激光雷达点与前视图像之间的映射关系,将所述第一映射数据映射到前视图像的像素上,得到第二映射数据;

[0087]

s4:对所述第二映射数据进行稀疏化编码,生成轻量化稀疏图像;

[0088]

s5:将所述激光雷达点进行体素化,得到所述激光雷达点的三维体素;

[0089]

s6:对所述轻量化稀疏图像和所述三维体素进行特征提取,得到像素特征和体素特征;

[0090]

s7:将所述像素特征和所述体素特征编码到对应的点云位置,得到像素点云特征和体素点云特征;

[0091]

s8:将所述像素点云特征和所述体素点云特征进行特征融合,得到点云融合特征;

[0092]

s9:对所述点云融合特征进行反映射,得到多传感器融合体素特征图。

[0093]

在步骤s2中,根据所述原始图像与所述激光雷达点之间的映射关系,将所述原始

图像的像素映射到相应的激光雷达点,得到第一映射数据,具体包括:

[0094]

根据摄像机和激光雷达之间的标定矩阵,建立所述原始图像与所述激光雷达点之间的第一映射关系;所述第一映射关系为:

[0095][0096]

其中,x为点云深度维度上的坐标,y为点云宽度维度上的坐标,z为点云高度维度上的坐标,ur为原始图像中像素的横坐标,vr为原始图像中像素的纵坐标,i为内参矩阵,e为外参矩阵。

[0097]

在步骤s3中,根据所述激光雷达点与前视图像之间的映射关系,将所述第一映射数据映射到前视图像的像素上,得到第二映射数据,具体包括:

[0098]

利用球面投影原理建立所述激光雷达点与所述前视图像之间的第二映射关系;所述第二映射关系为:

[0099][0100]

其中,u为前视图像中像素的横坐标,v为前视图像中像素的纵坐标,x为点云深度维度上的坐标,y为点云宽度维度上的坐标,z为点云高度维度上的坐标,r为反射强度,w为前视图像的宽度,h为前视图像的高度,fov

down

为激光雷达下方垂直视角,fov为激光雷达垂直视角;

[0101]

根据所述第二映射关系将所述第一映射数据映射到前视图像像素上,得到第二映射数据。

[0102]

在步骤s4中,对所述第二映射数据进行稀疏化编码,生成轻量化稀疏图像,具体包括:

[0103]

判断所述第二映射数据中的任一映射数据是否为所述第一映射数据中的多个映射数据映射得到,得到第一判断结果;

[0104]

若所述第一判断结果为是,则将所述第一映射数据中的所述多个映射数据的平均值作为所述第二映射数据中的所述任一映射数据的编码值;

[0105]

判断所述第二映射数据中的任一映射数据是否为所述第一映射数据中的一个映射数据映射得到,得到第二判断结果;

[0106]

若所述第二判断结果为是,则将所述第一映射数据中对应的映射数据作为所述第二映射数据中的所述任一映射数据的编码值;

[0107]

若所述第一判断结果和所述第二判断结果都为否,则不进行编码。

[0108]

在步骤s5中,将所述激光雷达点进行体素化,得到所述激光雷达点的三维体素,具体包括:

[0109]

判断体素中的任一体素是否包含多个所述激光雷达点,得到第三判断结果;

[0110]

若所述第三判断结果为是,则使用多个所述激光雷达点的平均值作为体素中的任一体素的编码值;

[0111]

判断体素中的任一体素是否包含一个所述激光雷达点,得到第四判断结果;

[0112]

若所述第四判断结果为是,则使用对应的激光雷达点作为体素中的任一体素的编码值;

[0113]

若所述第三判断结果和所述第四判断结果都为否,则不进行编码。

[0114]

在步骤s6中,对所述轻量化稀疏图像和所述三维体素进行特征提取,得到像素特征和体素特征,具体包括:

[0115]

分别构建二维稀疏卷积的特征提取网络和三维稀疏卷积的特征提取网络;

[0116]

利用所述二维稀疏卷积的特征提取网络对所述轻量化稀疏图像进行特征提取,得到像素特征;

[0117]

利用所述三维稀疏卷积的特征提取网络对所述三维体素进行特征提取,得体素特征。

[0118]

在步骤s7中,将所述像素特征和所述体素特征编码到对应的点云位置,得到像素点云特征和体素点云特征,具体包括:

[0119]

使用基于四近邻域的二次线性插值算法将所述像素特征编码至点云位置,得到所述像素点云特征;

[0120]

使用基于反距离权重法的三次线性插值算法将所述体素特征编码至点云位置,得到所述体素点云特征。

[0121]

在步骤s8中,将所述像素点云特征和所述体素点云特征进行特征融合,得到点云融合特征,具体包括:

[0122]

使用第一全连接块对所述像素点云特征进行处理,得到一维像素点云特征;所述第一全连接块包括三个全连接层、二个批标准化层和二个relu激活函数层;

[0123]

使用第二全连接块对所述体素点云特征进行处理,得到一维体素点云特征;所述第二全连接块包括三个全连接层、二个批标准化层和二个relu激活函数层;

[0124]

使用sigmoid函数对所述一维像素点云特征和所述一维体素点云特征进行处理,得到像素点云特征权重和体素点云特征权重;所述sigmoid函数为:

[0125][0126]

其中,w

pp

为像素点云特征权重,w

pv

为体素点云特征权重,为一维像素点云特征,为一维体素点云特征;

[0127]

利用所述像素点云特征权重和所述体素点云特征权重融合所述像素点云特征和所述体素点云特征,得到点云融合特征;融合表达式为:

[0128]ffuse

=[f

pp

(1 w

pp

),f

pv

(1 w

pv

)]

[0129]

其中,f

fuse

为点云融合特征,f

pp

为像素点云特征,f

pv

为体素点云特征。

[0130]

在步骤s9中,对所述点云融合特征进行反映射,得到多传感器融合体素特征图,具

体包括:

[0131]

使用三次线性插值方法将所述点云融合特征反映射至体素特征中非空体素的位置,得到替换点云融合特征;

[0132]

将所述替换点云融合特征替换体素特征中对应位置的非空体素特征,得到多传感器融合体素特征图。

[0133]

在步骤s9之后,还包括:将得到的多传感器融合体素特征图送入后续网络进行三维目标检测任务。在本实施例中,后续网络指的是pv-rcnn的网络结构或其他网络结构(比如sa-ssd)。也就是说生成的多传感器融合体素特征图可以接到现存很多网络结构中(只要是基于体素特征图即可)。

[0134]

本发明所述方法建立原始图像与激光雷达点之间的映射关系,激光雷达点和前视图像之间的映射关系,生成轻量化稀疏图像,为图像信息的快速处理提供了基础。同时,本发明所述方法融合两种传感器特征提取网络提取的特征,构建了信息更丰富的环境信息特征,提高了三维目标检测的准确率。

[0135]

为了便于理解本发明,下面结合附图2-附图6对本发明进行说明。

[0136]

步骤一、获取周围环境的三维激光雷达点云数据和周围环境的照片。

[0137]

在本实施例中,使用自动驾驶领域最常用和权威的kitti自动驾驶数据集对本发明所述方法做详细说明,该数据集的数据采集自装载的2个灰度相机(0号和1号),两个彩色相机(2号和3号)和一个激光雷达,0号相机为参考相机。以kitti自动驾驶数据集中训练集的7312号样本的2号彩色相机原始图像和对应的激光雷达点云数据为例说明数据的一个迭代周期,其原始图像分辨率为1242

×

375,共465750个像素,如图2所示。对应范围内的激光雷达点云数据中包含18656个点,如图3所示。

[0138]

建立原始图像与激光雷达点之间的映射关系,定义p:{pi=(xi,yi,zi,ri),i=1,2,3,

…

,18656}为激光雷达点云中的点,其中,x为点云深度维度上的坐标,y为点云宽度维度上的坐标,z为点云高度维度上的坐标,r为该点对应的反射强度。pi指的就是激光雷达点云中的点,rp:{rpi=(ur,vr),i=1,2,3,

…

,465750}为2号彩色相机原始图像中的像素,ur为原始图像中像素的横坐标,vr为原始图像中像素的纵坐标。2号彩色相机所拍摄的原始图像像素与激光雷达点之间的映射关系可由公式(1)表示。

[0139]

步骤二、建立原始图像像素与激光雷达点之间的映射关系以及激光雷达点与前视图像之间的映射关系。

[0140][0141]

其中2号彩色摄像机的内参矩阵i2为:

[0142][0143]

0号灰度相机的修正旋转矩阵r0为:

[0144][0145]

把激光雷达点映射到0号灰度相机的外参矩阵tr_velo_to_cam为:

[0146][0147]

接着,建立激光雷达点与前视图像之间的映射关系。激光雷达的上方垂直视角为fov

down

=0.43rad,垂直视角为fov=0.47rad,设定生成的前视图的宽度和高度w和h分别为512和48可以得到激光雷达点和前视图像素之间的映射关系如公式(5)所示。

[0148][0149]

步骤三、将原始图像中的像素映射到相应的激光雷达点,进而映射到生成的前视图像的像素上进行稀疏化编码,生成轻量化稀疏图像,同时将原始点云转换为三维体素。

[0150]

根据公式(1)所示原始图像像素与激光雷达点之间的映射关系,将原始图像像素中的颜色信息映射到激光雷达点上,激光雷达点特征更新为p:{pi=(rdi,gri,bli),i=1,2,3,

…

,n},其中rd,gr,bl分别为激光雷达点对应原始图像中像素的红色通道值,绿色通道值和蓝色通道值。再根据公式(5)所示激光雷达点与前视图像素之间映射关系,将激光雷达点映射到前视图像像素,并进行稀疏化编码。前视图像像素稀疏化编码遵循以下规则:对于多个激光雷达点映射到同一个前视图像像素的情况,使用这些激光雷达点特征的平均值作为该像素的编码值;对于一个激光雷达点映射到一个前视图像像素的情况,使用对应激光雷达点的特征值作为该像素的编码值;对于不存在对应激光雷达点的前视图像像素,不进行编码,保持其稀疏性。通过上述稀疏化编码操作,前视图像转化为轻量化稀疏图像,原始高分辨率图像中的颜色信息被转移至生成的轻量化稀疏图像中。7312号样本的轻量化稀疏图像如图4所示,其中黑色像素为未编码像素,由图可以看出,相比于不进行稀疏化编码的稠密前视图像,进行稀疏化编码的稀疏图像中存在一些未编码像素,因此占用内存更少。

[0151]

限定点云空间在深度,宽度和高度维度上的范围在[0,-40,-1]米和[70.4,40,3]米之间,体素尺寸在深度,宽度和高度维度上分别为[0.05,0.05,0.1]米,生成分辨率为1408

×

1600

×

40的三维体素。和轻量化稀疏图像生成类似,若体素中包含多个激光雷达点,则使用这些点的平均值作为该体素的编码值,若体素中不包含激光雷达点,则不对其进行编码。综合考虑计算消耗,保留最多16000个非空三维体素。

[0152]

步骤四、使用特征提取网络对轻量化稀疏图像和三维体素进行特征提取,得到像素特征和体素特征,并将这两种特征编码到点云上,得到两种点云特征。

[0153]

表1体素特征提取网络结构及其参数

[0154][0155]

构建基于稀疏卷积的特征提取网络对生成的轻量化稀疏图像和三维体素进行特征提取得到降采样尺度为8的像素特征图和体素特征图其中的特征分别为和特征提取网络结构及其参数如表1所示,其中对于像素特征和体素特征的提取,分别采用二维稀疏卷积和三维稀疏卷积,在每一次稀疏卷积或流形稀疏卷积之后,进行批标准化操作并使用relu激活函数进行激活。表示fm

p

是尺寸为8

×

64的二维像素集合,如前面所述它是稀疏的,表示fm

p

中非空像素的个数为348,每个像素的特征有64个特征通道。表示fmv是尺寸为5

×

200

×

176的三维体素集合,如前面所述它是稀疏的(即这5

×

200

×

176个体素中有空体素和非空体素),表示fmv中非空体素的个数为10632,每个体素的特征有64个特征通道。

[0156]

使用基于四近邻域的二次线性插值算法将像素特征编码至点云得到像素点云特征计算过程如公式(6)所示,其中p

ul

,p

ur

,p

bl

和p

br

代表编码点,pi∈p周围邻域的四个稀疏像素,下标x和y分别代表在像素特征图宽度和高度方向上的坐标。

[0157][0158]

使用基于反距离权重法的三次线性插值算法将体素特征编码至点云位置,得到体素点云特征计算过程如公式(7)所示,其中j是体素的索引,f

vj

是第j个体素的特征,wj(pi)为基于反距离权重法计算出的第j个体素和编码点pi∈p之间的权重,权重由公式(8)计算得出,r

itp

为反距离权重法的搜索半径,η(vj)和η(pi)分别为第j个体素和第i个点的三维坐标。

[0159]

[0160][0161]

步骤五、将两种点云特征送入特征融合网络,得到点云融合特征。

[0162]

构建特征融合网络如图5所示,其全连接层参数如表2所示,全连接块1和2由三个全连接层,二个批标准化层和二个relu激活函数层组成。首先使用两个全连接块对点云像素特征和点云体素特征进行处理,得到点云的一维特征和和

[0163]

表2特征融合网络结构及其参数

[0164] 全连接层特征输入和输出尺寸全连接块1(64,64)全连接块2(64,64)

[0165]

之后使用sigmoid函数对得到的点云一维特征进行处理,将一维特征压缩到[0,1]之间得到点云权重,sigmoid函数如公式(9)所示:

[0166][0167]

其中,w

pp

指点云像素特征权重,w

pv

指点云体素特征权重。

[0168]

最后利用点云权重融合两种点云特征得到点云融合特征f

fuse

,点云融合特征表达式如公式(10)所示:

[0169]ffuse

=[f

pp

(1 w

pp

),f

pv

(1 w

pv

)]

ꢀꢀꢀꢀꢀ

(10)

[0170]

步骤六、由点云融合特征得到多传感器融合体素特征图并送入后续网络进行三维目标检测任务。

[0171]

如图6所示使用基于反距离权重法的三次线性插值方法将点云融合特征反映射至特征提取网络的输出(降采样尺度为8的体素特征图fmv)中非空体素的位置,计算过程如公式(11)所示,其中i是点的索引,wi(vj)为基于反距离权重法计算出的第i个点和体素vj∈fmv之间的权重,权重由公式(12)计算得出,r

itp

为反距离权重法的搜索半径,η(vj)和η(pi)分别为第j个体素和第i个点的三维坐标。

[0172][0173][0174]

使用f

′

fuse

替换体素特征图fmv中非空体素的特征生成多传感器融合体素特征图。最后,将该特征图接入后续网络进行目标检测任务。f

′

fuse

为反映射至fmv中非空体素位置的体素特征。

[0175]

本实施例中所有实验在相同的实验平台(因特尔志强银牌中央处理器,英伟达rtx-2080ti显卡,64gb内存)下完成。训练集和验证集均从kitti公开数据集的训练样本中获取,其中训练集共3712个训练样本,验证集共3769个训练样本,验证集中的车辆根据车辆包围框的大小和被遮挡程度被分为简单,中等和困难三个难度。训练批尺寸为2,学习率为0.00125,训练周期为50。本实施例进行两组实验,一组为原始pv-rcnn目标检测网络实验,另一组实验将本发明所述多传感器融合体素特征图生成网络替换原pv-rcnn网络中的体素特征图生成网络进行三维目标检测,结果如表3所示。表3使用平均准确率对三维视角下的汽车检测结果进行评价,若最终检测出的汽车包围盒和真值之间的交集大于70%,则认为此检测为正确的,反之为错误的。

[0176]

由表3看出,本发明所述方法稍稍降低了简单难度车辆的平均精度,但有效地提升了三维目标检测评价中最重要且最常用的中等难度车辆的检测准确率,同时本发明所述方法对于困难难度车辆的检测也有有益效果。整体来看,通过使用本发明所述方法,pv-rcnn目标检测网络的三维目标检测准确率提升了0.19%,验证了本发明所述方法的有效性。

[0177]

表3 pv-rcnn与本发明所述方法的目标检测结果

[0178][0179]

综上所述,本发明所述方法建立原始图像像素与激光雷达点之间的映射关系,激光雷达点和前视图像像素之间的映射关系,生成轻量化稀疏图像,为图像信息的快速处理提供了基础。同时,本发明所述方法融合两种传感器特征提取网络提取的特征,构建了信息更丰富的环境信息特征,为后续的计算机视觉任务提供了良好的基础。本发明所述方法在点云特征编码过程和多传感器融合体素特征图生成过程中均使用线性插值方法,与现存的点集抽象算法相比计算效率更高。与使用原始图像作为输入的方法相比,本发明所述方法生成的特征图融合了额外的三维坐标信息;与使用点云作为输入的方法相比,本发明所述方法融合了额外的图像rgb信息。

[0180]

实施例2:

[0181]

请参阅图7,本发明提供了一种多传感器融合体素特征图生成系统,该系统包括:

[0182]

数据获取模块1,用于获取激光雷达点和原始图像;

[0183]

第一映射模块2,用于根据所述原始图像与所述激光雷达点之间的映射关系,将所述原始图像的像素映射到相应的激光雷达点,得到第一映射数据;

[0184]

第二映射模块3,用于根据所述激光雷达点与前视图像之间的映射关系,将所述第一映射数据映射到前视图像的像素上,得到第二映射数据;

[0185]

稀疏化编码模块4,用于对所述第二映射数据进行稀疏化编码,生成轻量化稀疏图像;

[0186]

体素化模块5,用于将所述激光雷达点进行体素化,得到所述激光雷达点的三维体素;

[0187]

特征提取模块6,用于对所述轻量化稀疏图像和所述三维体素进行特征提取,得到像素特征和体素特征;

[0188]

点云特征获取模块7,用于将所述像素特征和所述体素特征编码到对应的点云位置,得到像素点云特征和体素点云特征;

[0189]

特征融合模块8,用于将所述像素点云特征和所述体素点云特征进行特征融合,得到点云融合特征;

[0190]

反映射模块9,用于对所述点云融合特征进行反映射,得到多传感器融合体素特征图。

[0191]

本说明书中各个实施例采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似部分互相参见即可。对于实施例公开的系统而言,由于其与实施例公开的方法相对应,所以描述的比较简单,相关之处参见方法部分说明即可。

[0192]

本文中应用了具体个例对本发明的原理及实施方式进行了阐述,以上实施例的说明只是用于帮助理解本发明的方法及其核心思想;同时,对于本领域的一般技术人员,依据本发明的思想,在具体实施方式及应用范围上均会有改变之处。综上所述,本说明书内容不应理解为对本发明的限制。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。