1.本发明涉及图像处理技术领域,特别涉及一种光流预测模型的训练方法及系统和视频生成方法及系统。

背景技术:

2.随着ota(在线旅游)行业的发展和智能设备的进步,其发展和使用过程中所产生的图像和视频的数量呈现出了指数级的增长,与此同时,人们对图像和视频的多样性和质量的要求也越来越高。但是,由于视频的采集成本相对于图像的采集成本要高出很多,因此,随着人力成本的迅速提高,利用人工进行视频采集难以满足对海量数据进行处理的需求。基于此,如何低成本且快速有效地利用图像生成视频已经成为相关人员的一个重要课题。

3.随着硬件(如gpu)设备的快速发展,深度学习在近年来受到了学术与工业界的关注,很多基于神经网络的由图像生成视频的方法也应运而生。现有技术中,可以通过光流预测来追踪图像中的目标物的运动轨迹,从而模拟生成目标物的运动场。但是,现有的光流预测模型所预测的出的光流序列所生成的图像通常具有严重的棋盘效应和水滴效应,无法很好地用于后续生成视频。

技术实现要素:

4.本发明要解决的技术问题是为了克服现有技术中现有的光流预测模型所预测的出的光流序列所生成的图像通常具有严重的棋盘效应和水滴效应的缺陷,提供一种光流预测模型的训练方法及系统和视频生成方法及系统。

5.本发明是通过下述技术方案来解决上述技术问题:

6.第一方面,本发明提供一种光流预测模型的训练方法,所述光流预测模型的训练方法包括:

7.加载初始光流预测模型,所述初始光流预测模型包括生成对抗网络结构;

8.获取训练数据集,所述训练数据集包括若干数据对,所述数据对由训练图像及其对应的光流构成;

9.对所述初始光流预测模型进行修改,并将所述训练数据集输入修改后的初始光流预测模型进行训练,以获得目标光流预测模型;

10.其中,所述对所述初始光流预测模型进行修改,包括:

11.将所述初始光流预测模型的上采样设置为采用双线性插值的卷积上采样;

12.将所述初始光流预测模型的归一化操作设置为实例正则化;

13.在所述初始光流预测模型的loss函数中增加以下函数:

[0014][0015]

其中,flow

pre

表示预测获得的光流,flow

label

表示实际光流,n表示生成光流的数

量。

[0016]

较佳地,所述获取训练数据集的步骤之前,还包括:

[0017]

获取训练视频;

[0018]

对所述训练视频进行拆帧,以获得若干帧所述训练图像;

[0019]

将所述训练图像的第n帧及其后的第α帧作为图像对输入训练光流预测模型,以获取所述第n帧训练图像对应的训练光流;

[0020]

将所述第n帧训练图像及所述训练光流作为所述数据对,以构建所述训练数据集;

[0021]

其中,n和α为大于等于2的整数,并且n小于或等于α。

[0022]

第二方面,本发明提供一种光流预测模型的训练系统,所述光流预测模型的训练系统包括:

[0023]

模型加载模块,用于加载初始光流预测模型,所述初始光流预测模型包括生成对抗网络结构;

[0024]

训练数据获取模块,用于获取训练数据集,所述训练数据集包括若干数据对,所述数据对由训练图像及其对应的光流构成;

[0025]

模型训练模块,用于对所述初始光流预测模型进行修改,并将所述训练数据集输入修改后的所述初始光流预测模型进行训练,以获得目标光流预测模型;

[0026]

其中,所述对所述初始光流预测模型进行修改,包括:

[0027]

将所述初始光流预测模型的上采样设置为采用双线性插值的卷积上采样;

[0028]

将所述初始光流预测模型的归一化操作设置为实例正则化;

[0029]

在所述初始光流预测模型的loss函数中增加以下函数:

[0030][0031]

其中,flow

pre

表示预测获得的光流,flow

label

表示实际光流,n表示生成光流的数量。

[0032]

第三方面,本发明提供一种视频生成方法,所述视频生成方法包括:

[0033]

获取待处理数据,所述待处理数据包括目标图像;

[0034]

将所述待处理数据输入通过如上所述的光流预测模型的训练方法训练得到的目标光流预测模型,以获得目标光流序列,所述目标光流序列用于表征对应于所述目标图像的运动模拟预测;

[0035]

基于所述目标图像和所述目标光流序列生成目标视频。

[0036]

较佳地,所述待处理数据还包括所述目标图像对应的图像掩膜,所述获取待处理数据的步骤之前,所述方法还包括:

[0037]

获取图像分割模型;

[0038]

将所述目标图像输入所述图像分割模型,以获得与所述目标图像对应的图像掩膜。

[0039]

较佳地,所述基于所述目标图像和所述目标光流序列生成目标视频,包括:

[0040]

构建图像翻译模型;

[0041]

将所述目标图像和所述目标光流序列输入所述图像翻译模型以获得第一图像序列;

[0042]

基于所述第一图像序列生成目标视频。

[0043]

较佳地,所述图像翻译模型包括特征编码模块、特征融合模块和特征翻译模块,所述将所述目标图像和所述目标光流序列输入所述图像翻译模型以获得第一图像序列,包括:

[0044]

将所述目标图像输入所述特征编码模块,以生成特征矩阵;

[0045]

将所述特征矩阵和所述目标光流序列输入所述特征融合模块,以生成特征序列;

[0046]

将所述特征序列输入所述特征翻译模块,以生成第一图像序列;

[0047]

和/或,所述获得第一图像序列的步骤之后,还包括:

[0048]

将所述第一图像序列的最后一帧和所述目标光流序列输入所述图像翻译模型,以生成第二图像序列;

[0049]

基于所述第一图像序列和所述第二图像序列生成目标视频。

[0050]

第四方面,本发明提供一种视频生成系统,所述视频生成系统包括:

[0051]

待处理数据获取模块,用于获取待处理数据,所述待处理数据包括目标图像;

[0052]

光流生成模块,用于将所述待处理数据输入通过如上所述的光流预测模型的训练方法训练得到的目标光流预测模型,以获得目标光流序列,所述目标光流序列用于表征对应于所述目标图像的运动模拟预测;

[0053]

视频生成模块,用于基于所述目标图像和所述目标光流序列生成目标视频。

[0054]

第五方面,本发明提供一种电子设备,包括存储器、处理器以及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现如上所述的光流预测模型的训练方法,或如上所述的视频生成方法。

[0055]

第六方面,本发明提供一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现如上所述的光流预测模型的训练方法,或如上所述的视频生成方法

[0056]

本发明的积极进步效果在于:本发明所提供的光流预测模型的训练方法中,通过对包括生成对抗网络的初始光流目标预测模型中的上采样、归一化操作和loss函数的修改,并对修改后的模型进行训练,从而使得训练后的目标光流预测模型输出的光流质量较高,根据该生成的图像的棋盘效应和水滴效应显著降低,具有较好的分辨率,并因此能够大幅提升最终生成的视频的画面效果。

附图说明

[0057]

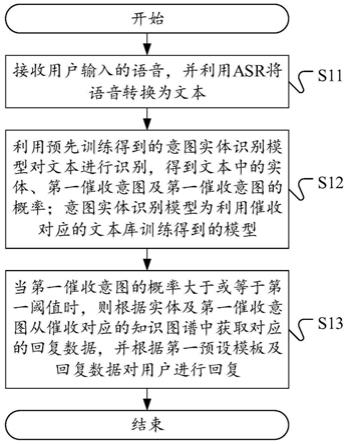

图1为本发明实施例1的光流预测模型的训练方法的第一流程示意图。

[0058]

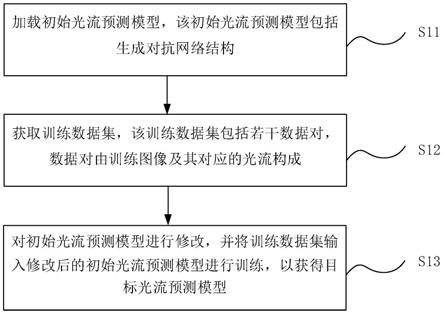

图2为本发明实施例1的光流预测模型的训练方法的部分流程示意图。

[0059]

图3为本发明实施例2的光流预测模型的训练系统的模块示意图。

[0060]

图4为本发明实施例3的视频生成方法的第一流程示意图。

[0061]

图5为本发明实施例3的视频生成方法的第二流程示意图。

[0062]

图6为本发明实施例3的视频生成方法中目标光流预测模型的输入与输出的对比示意图。

[0063]

图7为本发明实施例3的视频生成方法的步骤s23的具体流程示意图。

[0064]

图8为本发明实施例3的视频生成方法的步骤s232的具体流程示意图。

[0065]

图9为本发明实施例3的视频生成方法中图像翻译模型的各个流程对应的输入示意图。

[0066]

图10为本发明实施例3的视频生成方法的步骤s23的另一具体流程示意图。

[0067]

图11为本发明实施例4的视频生成系统的模块示意图。

[0068]

图12为本发明实施例4的图像翻译模型的模块示意图。

[0069]

图13为本发明实施例5中的电子设备的结构示意图。

具体实施方式

[0070]

下面通过实施例的方式进一步说明本发明,但并不因此将本发明限制在所述的实施例范围之中。

[0071]

实施例1

[0072]

本实施例公开了一种光流预测模型的训练方法,如图1所示,该光流预测模型的训练方法包括:

[0073]

s11、加载初始光流预测模型,该初始光流预测模型包括生成对抗网络结构;

[0074]

s12、获取训练数据集,该训练数据集包括若干数据对,数据对由训练图像及其对应的光流构成;

[0075]

s13、对初始光流预测模型进行修改,并将训练数据集输入修改后的初始光流预测模型进行训练,以获得目标光流预测模型;

[0076]

其中,对初始光流预测模型进行修改,包括:

[0077]

将初始光流预测模型的上采样设置为采用双线性插值的卷积上采样;

[0078]

将初始光流预测模型的归一化操作设置为实例正则化;

[0079]

在初始光流预测模型的loss函数中增加以下函数:

[0080][0081]

其中,flow

pre

表示预测获得的光流,flow

label

表示实际光流,n表示生成光流的数量。

[0082]

本实施例以步骤s11中所加载的初始光流预测模型为pix2pixhd(一种用于图像翻译的生成对抗网络模型)为例进行说明,即本实施例中进行模型训练时的基础训练方式与基础模型结构与pix2pixhd模型保持一致。

[0083]

需要说明的是,此处pix2pixhd模型仅作举例说明,并不因此步骤s11中的用于进行光流预测的生成对抗网络模型限制于此。

[0084]

在本实施例中,需要通过输入单张三通道的目标图像来生成对应于目标图像的运动场预测的双通道的目标光流矩阵序列,而对于现有的pix2pixhd模型来说,其输入和输出的通道的数量相同,因此,首先需要在卷积层将对应于输出通道的数量设置为双通道,以使得能够通过pix2pixhd输出对应的预测光流矩阵。

[0085]

然而,由于pix2pixhd模型本身的上采样采用了反卷积,因此仅修改输出通道的数量,最终生成的预测光流中会出现严重的棋牌效应,故在步骤s3中,将其上采样修改为双线性插值上采样及卷积操作,以有效避免输出的预测光流的棋牌效应。

[0086]

同时,现有的pix2pixhd模型的instance normilization(一种模型训练时的归一

光流对形式的训练数据,提高了目标光流预测模型最终输出的预测光流与实际光流之间的对应准确性,从而提升了预测光流的质量,在提高效率的同时更好地满足了对于生成的视频的质量要求。

[0101]

实施例2

[0102]

本实施例公开了一种光流预测模型的训练系统,如图3所示,该光流预测模型的训练系统包括:

[0103]

模型加载模块1,用于加载初始光流预测模型,该初始光流预测模型包括生成对抗网络结构;

[0104]

训练数据获取模块2,用于获取训练数据集,该训练数据集包括若干数据对,数据对由训练图像及其对应的光流构成;

[0105]

模型训练模块3,用于对初始光流预测模型进行修改,并将训练数据集输入修改后的初始光流预测模型进行训练,以获得目标光流预测模型;

[0106]

其中,对初始光流预测模型进行修改,包括:

[0107]

将初始光流预测模型的上采样设置为采用双线性插值的卷积上采样;

[0108]

将初始光流预测模型的归一化操作设置为实例正则化;

[0109]

在初始光流预测模型的loss函数中增加以下函数:

[0110][0111]

其中,flow

pre

表示预测获得的光流,flow

label

表示实际光流,n表示生成光流的数量。

[0112]

本实施例以初始光流预测模型为pix2pixhd(一种用于图像翻译的生成对抗网络模型)为例进行说明,即本实施例中进行模型训练时的基础训练方式与基础模型结构与pix2pixhd模型保持一致。

[0113]

需要说明的是,此处pix2pixhd模型仅作举例说明,并不因此将上述用于进行光流预测的生成对抗网络模型限制于此。

[0114]

在本实施例中,需要通过输入单张三通道的目标图像来生成对应于目标图像的运动场预测的双通道的目标光流矩阵序列,而对于现有的pix2pixhd模型来说,其输入和输出的通道的数量相同,因此,在模型加载模块1加载pix2pixhd模型作为初始光流预测模型时,首先需要在卷积层将对应于输出通道的数量设置为双通道,以使得能够通过pix2pixhd输出对应的预测光流矩阵。

[0115]

然而,由于pix2pixhd模型本身的上采样采用了反卷积,因此仅修改输出通道的数量,最终生成的预测光流中会出现严重的棋牌效应,故采用模型训练模块3将其上采样修改为双线性插值上采样及卷积操作,以有效避免输出的预测光流的棋牌效应。

[0116]

同时,现有的pix2pixhd模型的instance normilization(一种模型训练时的归一化操作)还会导致输出的预测光流出现水滴效应,影响后续对该预测光流的使用,因此,在具体实施时,模型训练模块3进一步用于将pix2pixhd模型的归一化操作设置为weight normalization(另一种模型训练时的归一化操作),以提升输出的模型输出的预测光流的分辨率和效果。

[0117]

基于上述修改,模型训练模块3对应地对loss函数(损失函数)进行设置,即在基于

现有的pix2pixhd模型本身的loss函数的基础上,增加对生成光流与光流label(标签)形成约束的l1 loss函数,以确保目标图像生成预测光流时的质量。

[0118]

具体地,l1 loss函数为:

[0119][0120]

其中,flow

pre

表示对应于目标图像运动场预测的预测光流,flow

label

表示对应的真实光流,n表示生成光流的数量。

[0121]

为了进一步提高基于pix2pixhd模型的目标光流预测模型所输出的预测光流的质量,在一种优选实施方式中,训练数据获取模块2还用于:

[0122]

获取训练视频;

[0123]

对训练视频进行拆帧,以获得若干帧训练图像;

[0124]

将训练图像的第n帧及其后的第α帧作为图像对输入训练光流预测模型,以获取第n帧训练图像对应的训练光流;

[0125]

将第n帧训练图像及其训练光流作为数据对,以构建训练数据集;

[0126]

其中,n和α为大于等于2的整数,并且n小于或等于α。

[0127]

在对修改后的pix2pixhd模型进行训练时,训练数据获取模块2使用flownet(一种基于卷积神经网络的光流预测算法)来估计图像对,以通过训练视频总结真实的光流运动轨迹,并将获取到的光流运动轨迹及其对应的图像帧构成图像-光流对作为训练数据来训练目标光流预测模型。

[0128]

具体地,上述训练数据由{i

image

,i

flow

}构成,其中,i

image

是由训练视频进行拆帧所获得的第n帧训练图像,而i

flow

则是由i

image

及其后的第α帧所构成的图像对通过开源的flownet模型进行预测后所得,即

[0129]

通过对变量n和α的修改,即可获得若干个图像-光流对,从而能够构成训练数据集。并且,由于该训练数据中包括了从训练视频中总结的真实光流运动轨迹,因此,基于以该图像-光流对所构成的训练数据集对修改后的pix2pixhd模型进行训练,不仅能够提高训练效率,还能够使得最终训练得到的目标光流预测模型所输出的预测光流具有更高的准确性,以便于后续使用。

[0130]

因此,本实施例中,通过模型训练模块对包括生成对抗网络的初始光流目标预测模型中的上采样、归一化操作和loss函数的修改,并对修改后的模型进行训练,从而使得训练后的目标光流预测模型输出的光流质量较高,根据该生成的图像的棋盘效应和水滴效应显著降低,具有较好的分辨率,并因此能够大幅提升最终生成的视频的画面效果。同时,训练数据获取模块所构建的基于图像-光流对形式的训练数据,提高了目标光流预测模型最终输出的预测光流与实际光流之间的对应准确性,从而提升了预测光流的质量,在提高效率的同时更好地满足了对于生成的视频的质量要求。

[0131]

实施例3

[0132]

本实施例公开了一种视频生成方法,如图4所示,该视频生成方法包括:

[0133]

s21、获取待处理数据,待处理数据包括目标图像;

[0134]

s22、将待处理数据输入通过如实施例1所述的光流预测模型的训练方法训练得到的目标光流预测模型,以获得目标光流序列,目标光流序列用于表征对应于目标图像的运动模拟预测;

[0135]

s23、基于目标图像和目标光流序列生成目标视频。

[0136]

本实施例中同样以上述修改后pix2pixhd模型作为初始光流预测模型训练后得到的目标光流预测模型为例进行说明。

[0137]

具体地,在步骤s22中,待处理数据对应输出的预测光流flow为:

[0138]

flow=pix2pixhd(i)

[0139]

对于通过目标光流预测模型预测得到的预测光流flow,通过插值和欧拉积分法,并使用梯形积分来代替矩形积分,获得积分公式:

[0140][0141]

其中,f(flow,t)是根据流体相关先验知识提前设定的积分函数,此处不再进行赘述。因此,通过上式即可对应输出光流序列之间的运动模拟,从而能够最终形成包括对目标图像的目标物的运动场预测的目标光流序列{flow1,flow2,

…

,flown}。

[0142]

在一种较佳的实施方式中,上述待处理数据还包括目标图像对应的图像掩膜,故如图5所示,步骤s21之前,上述方法还包括:

[0143]

s211、获取图像分割模型;

[0144]

s212、将目标图像输入图像分割模型,以获得与目标图像对应的图像掩膜。

[0145]

在本实施方式中,图像分割模型包括但不限于swin transformerm模型。需要说明的是,此处的图像分割模型还可以选择其他用于获得分割结果包括目标标签的图像掩膜的模型,具体地,目标标签可以为如江、河、湖、海、瀑布等。

[0146]

参见图6,输入与输出间的若干方形框表示pix2pixhd模型中的生成器、判别器及损失函数等部分,由于本实施例中的目标光流预测模型保持了pix2pixhd模型的基本结构,故此处不再对模型中的结构一一进行赘述。

[0147]

在具体实施时,输入的目标图像为包括瀑布和河流的风景图,其对应的图像掩膜的两个不同色块分别对应于瀑布区域和河流区域,将二者一起输入目标光流预测模型,使得最终的输出结果可以有目的性地针对目标图像的瀑布区域和河流区域进行光流预测,从而避免了对计算目标区域以外的其他位置的光流,有效提高进行光流预测的效率,减少计算资源的浪费,节约成本。

[0148]

对于步骤s23,由于本实施例中的步骤s22最终输出的目标光流序列用于表征对目标图像中的目标物的运动场的预测,因此,作为一种较佳实施方式,如图7所示,步骤s23包括:

[0149]

s231、构建图像翻译模型;

[0150]

s232、将目标图像和目标光流序列输入图像翻译模型以获得第一图像序列;

[0151]

s233、基于第一图像序列生成目标视频。

[0152]

在本实施方式中,采用类unet(一种图像语义分割网络)网络结构作为图像翻译模型的基础,从而实现通过目标光流序列预测出目标图像对应的第一图像序列,以生成目标

视频。

[0153]

优选地,上述图像翻译模型包括特征编码模块、特征融合模块和特征翻译模块。基于该图像翻译模型,如图8和图9所示,步骤s232包括:

[0154]

s2321、将目标图像输入特征编码模块,以生成特征矩阵;

[0155]

s2322、将特征矩阵和目标光流序列输入特征融合模块,以生成特征序列;

[0156]

s2323、将特征序列输入特征翻译模块,以生成第一图像序列。

[0157]

在具体实施过程中,特征编码模块由7个改进的resblock(一种残差网络的模块子类)构成,其中,为了适配本实施例中的目标光流序列并获得更好的输出的图像序列的效果,将其中relu函数(一种激活函数)修改为leakeyrelu函数(另一种激活函数),将bn(一种归一化操作)修改为pn(另一种归一化操作),并使用上下采样和短链接构成。

[0158]

在进行特征编码时,该模块首先经由两次下采样得到目标图像原尺寸的1/4,然后再经由两次上采样得到与目标图像原尺寸一直的特征矩阵。例如,将一个原始大小为h

×w×

3的图像i作为目标图像输入到该特征编码模块,将图像i的特征编码为:

[0159]

feature

encoder

=encoder(i)

[0160]

并生成一个h

×w×

c的特征矩阵。

[0161]

在特征融合模块中,h

×w×

n的特征矩阵feature

encoder

与目标光流序列{flow1,flow2,

…

,flown}通过特征wrap(仿射变换)的方式进行融合,并生成wrap后的特征:

[0162][0163]

从而得到n个大小为h

×w×

c的特征矩阵,以此构成warp特征序列

[0164]

特征翻译模块的结构与特征编码模块的结构一致,都是由7个改进的resblock构成。在完成特征融合后,将其获得的n个大小为h

×w×

c的wrap后的特征矩阵逐一输入特征翻译模块中,从而获得翻译后的图像翻译模块中,从而获得翻译后的图像并生成个n大小为h

×w×

3的图像,并以此构成第一图像序列

[0165]

本实施方式中同样包括对图像翻译模型的loss函数的设计,该loss函数与cocosnet(一种图像翻译网络模型)的loss函数设计保持一致,即:

[0166]

l

total

=γ1l

mse

γ2l

context

γ3l

perc

γ4l

gan

[0167]

其中,l

gan

表示生成对抗网络模型的loss函数,γi表示各个loss函数的权重。

[0168]

针对上述loss函数中的其他部分,其设计如下所示:

[0169][0170]

其中,i和j索引包括n

l

个特征的φ

l

层的特征图,φ

l

表示预训练vgg-19(一种卷积神经网络模型)模型中第l层的激活,并且,由于低级特征捕获了更丰富的样式信息,例如颜色、纹理等,故此处使用其中的relu2_2至relu5-2层;

[0171]

[0172]

其中,φ

l

表示预训练vgg-19模型中第l层的激活,并且此处使用relu4_2层之后的特征,因此这些层主要包括高级语义特征;

[0173][0174]

其中,yi表示label图像,表示图像翻译模型得到的图像,从而进行约束,以使得输出生成图像的同时不发生扭曲,即在细节信息处保持一致。

[0175]

因此,在本实施方式中,通过构建图像翻译模型,从而能够实现对目标图像及其对应的目标光流序列进行翻译处理,以输出一系列的图像序列,从而能够基于图像序列拼接生成视频。

[0176]

作为另一种较佳的实施方式,如图10所示,步骤s232之后还包括:

[0177]

s23201、将第一图像序列的最后一帧和目标光流序列输入图像翻译模型,以生成第二图像序列;

[0178]

s23202、基于所述第一图像序列和所述第二图像序列生成目标视频。

[0179]

具体地,利用第一图像序列中的最后一帧图像作为目标图像,并再次输入到图像翻译模型中,以获得第二图像序列型中,以获得第二图像序列然后将最终得到两个图像序列中的若干帧图像拼接形成视频,以突破模型本身或其他客观因素产生的对生成视频时长的限制,从而能够简单有效地生成任意时长的目标视频,提高生成视频的效率,节约成本,提高本实施方式中的基于光流预测的视频生成方法的适用范围。

[0180]

应当理解,此处同样可以基于每一图像序列的最后一帧递归进行δ次图像翻译,以最终生成δ

×

n帧图像,然后拼接生成任意时长的视频。

[0181]

因此,在本实施例中,通过将目标图像输入构建好的目标光流预测模型,以生成用于表征目标图像中的目标物的运动场预测的目标光流序列,从而能够基于该目标光流序列中包括的运动场预测来生成对应的目标图像序列并拼接为目标视频,避免了在循环由上一帧图像预测下一帧图像的过程中所出现的中间预测图像扭曲的情况,并因此大幅提升最终生成的视频的画面效果。

[0182]

实施例4

[0183]

本实施例公开了一种视频生成系统,如图11所示,该视频生成系统包括:

[0184]

待处理数据获取模块4,用于获取待处理数据,待处理数据包括目标图像;

[0185]

光流生成模块5,用于将待处理数据输入通过实施例1的光流预测模型的训练方法训练得到的目标光流预测模型,以获得目标光流序列,目标光流序列用于表征对应于目标图像的运动模拟预测;

[0186]

视频生成模块6,用于基于目标图像和目标光流序列生成目标视频。

[0187]

本实施例中同样以上述修改后pix2pixhd模型作为初始光流预测模型训练后得到的目标光流预测模型为例进行说明,光流生成模块5包括该目标光流预测模型。

[0188]

具体地,光流生成模块5输出的预测光流flow为:

[0189]

flow=pix2pixhd(i)

[0190]

对于通过目标光流预测模型预测得到的预测光流flow,通过插值和欧拉积分法,并使用梯形积分来代替矩形积分,获得积分公式:

[0191][0192]

其中,f(flow,t)是根据流体相关先验知识提前设定的积分函数,此处不再进行赘述。因此,光流生成模块5通过上式对应输出光流序列之间的运动模拟,从而能够最终形成包括对目标图像的目标物的运动场预测的目标光流序列{flow1,flow2,

…

,flown}。

[0193]

在一种较佳的实施方式中,上述待处理数据还包括目标图像对应的图像掩膜,故上述系统还包括掩膜生成模块7,该掩膜生成模块7用于:

[0194]

获取图像分割模型;

[0195]

将目标图像输入图像分割模型,以获得与目标图像对应的图像掩膜。

[0196]

在本实施方式中,掩膜生成模块7中的图像分割模型包括但不限于swin transformerm模型。需要说明的是,此处的图像分割模型还可以选择其他用于获得分割结果包括目标标签的图像掩膜的模型,具体地,目标标签可以为如江、河、湖、海、瀑布等。

[0197]

参见图6,输入与输出间的若干方形框表示pix2pixhd模型中的生成器、判别器及损失函数等部分,由于本实施例中光流生成模块5的目标光流预测模型保持了pix2pixhd模型的基本结构,故此处不再对模型中的结构一一进行赘述。

[0198]

在具体实施时,输入的目标图像为包括瀑布和河流的风景图,其对应的图像掩膜的两个不同色块分别对应于瀑布区域和河流区域,将二者一起输入目标光流预测模型,使得最终的输出结果可以有目的性地针对目标图像的瀑布区域和河流区域进行光流预测,从而避免了对计算目标区域以外的其他位置的光流,有效提高进行光流预测的效率,减少计算资源的浪费,节约成本。

[0199]

光流生成模块5最终输出的目标光流序列用于表征对目标图像中的目标物的运动场的预测,因此,作为一种较佳实施方式,上述系统还包括图像翻译单元8,图像翻译单元8用于:

[0200]

构建图像翻译模型81;

[0201]

将目标图像和目标光流序列输入图像翻译模型以获得第一图像序列;

[0202]

基于第一图像序列生成目标视频。

[0203]

在本实施方式中,采用类unet(一种图像语义分割网络)网络结构作为图像翻译模型的基础,从而实现通过目标光流序列预测出目标图像对应的第一图像序列,以生成目标视频。

[0204]

优选地,如图12所示,上述图像翻译模型包括特征编码模块811、特征融合模块812和特征翻译模块813。基于该图像翻译模型81,图像翻译单元8用于:

[0205]

将目标图像输入特征编码模块811,以生成特征矩阵;

[0206]

将特征矩阵和目标光流序列输入特征融合模块812,以生成特征序列;

[0207]

将特征序列输入特征翻译模块813,以生成第一图像序列。

[0208]

在具体实施过程中,特征编码模块811由7个改进的resblock(一种残差网络的模块子类)构成,其中,为了适配本实施例中的目标光流序列并获得更好的输出的图像序列的效果,将其中relu函数(一种激活函数)修改为leakeyrelu函数(另一种激活函数),将bn(一种归一化操作)修改为pn(另一种归一化操作),并使用上下采样和短链接构成。

[0209]

在进行特征编码时,特征编码模块811首先经由两次下采样得到目标图像原尺寸

的1/4,然后再经由两次上采样得到与目标图像原尺寸一直的特征矩阵。例如,将一个原始大小为h

×w×

3的图像i作为目标图像输入到该特征编码模块811,将图像i的特征编码为:

[0210]

feature

encoder

=encoder(i)

[0211]

并生成一个h

×w×

c的特征矩阵。

[0212]

在特征融合模块812中,h

×w×

n的特征矩阵feature

encoder

与目标光流序列{flow1,flow2,

…

,flown}通过特征wrap(仿射变换)的方式进行融合,并生成wrap后的特征:

[0213][0214]

从而得到n个大小为h

×w×

c的特征矩阵,以此构成warp特征序列

[0215]

特征翻译模块813的结构与特征编码模块811的结构一致,都是由7个改进的resblock构成。在完成特征融合后,将其获得的n个大小为h

×w×

c的wrap后的特征矩阵逐一输入特征翻译模块813中,从而获得翻译后的图像并生成个n大小为h

×w×

3的图像,并以此构成第一图像序列

[0216]

本实施方式中同样包括对图像翻译模型81的loss函数的设计,该loss函数与cocosnet(一种图像翻译网络模型)的loss函数设计保持一致,即:

[0217]

l

total

=γ1l

mse

γ2l

context

γ3l

perc

γ4l

gan

[0218]

其中,l

gan

表示生成对抗网络模型的loss函数,γi表示各个loss函数的权重。

[0219]

针对上述loss函数中的其他部分,其设计如下所示:

[0220][0221]

其中,i和j索引包括n

l

个特征的φ

l

层的特征图,φ

l

表示预训练vgg-19(一种卷积神经网络模型)模型中第l层的激活,并且,由于低级特征捕获了更丰富的样式信息,例如颜色、纹理等,故此处使用其中的relu2_2至relu5-2层;

[0222][0223]

其中,φ

l

表示预训练vgg-19模型中第l层的激活,并且此处使用relu4_2层之后的特征,因此这些层主要包括高级语义特征;

[0224][0225]

其中,yi表示label图像,表示图像翻译模型得到的图像,从而进行约束,以使得输出生成图像的同时不发生扭曲,即在细节信息处保持一致。

[0226]

因此,在本实施方式中,通过构建图像翻译模型81,从而能够实现对目标图像及其对应的目标光流序列进行翻译处理,以输出一系列的图像序列,从而能够基于图像序列拼接生成视频。

[0227]

作为另一种较佳的实施方式,图像翻译单元8还用于:

[0228]

将第一图像序列的最后一帧和目标光流序列输入图像翻译模型81,以生成第二图

像序列;

[0229]

基于所述第一图像序列和所述第二图像序列生成目标视频。

[0230]

具体地,利用第一图像序列中的最后一帧图像作为目标图像,并再次输入到图像翻译模型81中,以获得第二图像序列像翻译模型81中,以获得第二图像序列然后将最终得到两个图像序列中的若干帧图像拼接形成视频,以突破模型本身或其他客观因素产生的对生成视频时长的限制,从而能够简单有效地生成任意时长的目标视频,提高生成视频的效率,节约成本,提高本实施方式中的基于光流预测的视频生成方法的适用范围。

[0231]

应当理解,此处同样可以基于每一图像序列的最后一帧递归进行δ次图像翻译,以最终生成δ

×

n帧图像,然后拼接生成任意时长的视频。

[0232]

因此,在本实施例中,通过将目标图像输入构建好的目标光流预测模型,以生成用于表征目标图像中的目标物的运动场预测的目标光流序列,从而能够基于该目标光流序列中包括的运动场预测来生成对应的目标图像序列并拼接为目标视频,避免了在循环由上一帧图像预测下一帧图像的过程中所出现的中间预测图像扭曲的情况,并因此大幅提升最终生成的视频的画面效果。

[0233]

实施例5

[0234]

图13为本发明实施例5提供的一种电子设备的结构示意图。电子设备包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,处理器执行程序时实现实施例1中的光流预测模型的训练方法,或实施例2中的视频生成方法。图13显示的电子设备30仅仅是一个示例,不应对本发明实施例的功能和使用范围带来任何限制。

[0235]

如图13所示,电子设备30可以以通用计算设备的形式表现,例如其可以为智能手表。电子设备30的组件可以包括但不限于:上述至少一个处理器31、上述至少一个存储器32、连接不同系统组件(包括存储器32和处理器31)的总线33。

[0236]

总线33包括数据总线、地址总线和控制总线。

[0237]

存储器32可以包括易失性存储器,例如随机存取存储器(ram)321和/或高速缓存存储器322,还可以进一步包括只读存储器(rom)323。

[0238]

存储器32还可以包括具有一组(至少一个)程序模块324的程序/实用工具325,这样的程序模块324包括但不限于:操作系统、一个或者多个应用程序、其它程序模块以及程序数据,这些示例中的每一个或某种组合中可能包括网络环境的实现。

[0239]

处理器31通过运行存储在存储器32中的计算机程序,从而执行各种功能应用以及数据处理,例如本发明实施例1中的光流预测模型的训练方法,或实施例2中的视频生成方法。

[0240]

电子设备30也可以与一个或多个外部设备34(例如手机)通信。这种通信可以通过输入/输出(i/o)接口35进行。并且,模型生成的设备30还可以通过网络适配器36与一个或者多个网络(例如局域网(lan),广域网(wan)和/或公共网络,例如因特网)通信。如图13所示,网络适配器36通过总线33与模型生成的设备30的其它模块通信。应当明白,尽管图中未示出,可以结合模型生成的设备30使用其它硬件和/或软件模块,包括但不限于:微代码、设备驱动器、冗余处理器、外部磁盘驱动阵列、raid(磁盘阵列)系统、磁带驱动器以及数据备份存储系统等。

[0241]

应当注意,尽管在上文详细描述中提及了电子设备的若干单元/模块或子单元/模块,但是这种划分仅仅是示例性的并非强制性的。实际上,根据本发明的实施方式,上文描述的两个或更多单元/模块的特征和功能可以在一个单元/模块中具体化。反之,上文描述的一个单元/模块的特征和功能可以进一步划分为由多个单元/模块来具体化。

[0242]

实施例6

[0243]

本实施例提供了一种计算机可读存储介质,其上存储有计算机程序,程序被处理器执行时实现实施例1中的光流预测模型的训练方法,或实施例2中的视频生成方法。

[0244]

其中,可读存储介质可以采用的更具体可以包括但不限于:便携式盘、硬盘、随机存取存储器、只读存储器、可擦拭可编程只读存储器、光存储器件、磁存储器件或上述的任意合适的组合。

[0245]

在可能的实施方式中,本发明还可以实现为一种程序产品的形式,其包括程序代码,当程序产品在终端设备上运行时,程序代码用于使终端设备执行实现实施例1中的光流预测模型的训练方法,或实施例2中的视频生成方法。

[0246]

其中,可以以一种或多种程序设计语言的任意组合来编写用于执行本发明的程序代码,程序代码可以完全地在用户设备上执行、部分地在用户设备上执行、作为一个独立的软件包执行、部分在用户设备上部分在远程设备上执行或完全在远程设备上执行。

[0247]

虽然以上描述了本发明的具体实施方式,但是本领域的技术人员应当理解,这仅是举例说明,本发明的保护范围是由所附权利要求书限定的。本领域的技术人员在不背离本发明的原理和实质的前提下,可以对这些实施方式做出多种变更或修改,但这些变更和修改均落入本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。