1.本技术涉及信号处理设备、信号处理方法和程序,尤其涉及实现声音的直观操作的信号处理设备、信号处理方法和程序。

背景技术:

2.以往,提出了用于根据用户的身体的运动来操作声音的技术(例如,参考专利文献1)。

3.例如,在专利文献1中,因为基于附连到用户的传感器的输出波形来执行效果处理,所以当用户移动传感器的附连部位时,根据运动再现的声音改变。

4.此外,通过使用这样的技术,例如,dj可以通过移动dj的手臂以使得手臂上下摆动来改变正在再现的声音的音量等,即,可以操作声音。

5.引用列表

6.专利文献

7.专利文献1:wo2017/061577

技术实现要素:

8.本发明要解决的问题

9.然而,用户难以利用上述技术直观地操作声音,因为即使将传感器的输出波形直接应用于参数以操作声音,也无法在操作声音时充分反映用户的意图。

10.本技术是鉴于上述情况而开发的,并且旨在实现声音的直观操作。

11.问题的解决方案

12.根据本技术的一个方面的信号处理设备包括:获取单元,所述获取单元获取指示用户的身体的预定部位的运动或器具的运动的感测值;以及控制单元,所述控制单元根据所述感测值对声学信号执行非线性声学处理。

13.根据本技术的一个方面的信号处理方法或程序包括以下步骤:获取指示用户的身体的预定部位的运动或器具的运动的感测值;以及根据所述感测值对声学信号执行非线性声学处理。

14.在本技术的一方面,获取指示用户的身体的预定部位的运动或器具的运动的感测值,以及根据感测值对声学信号执行非线性声学处理。

附图说明

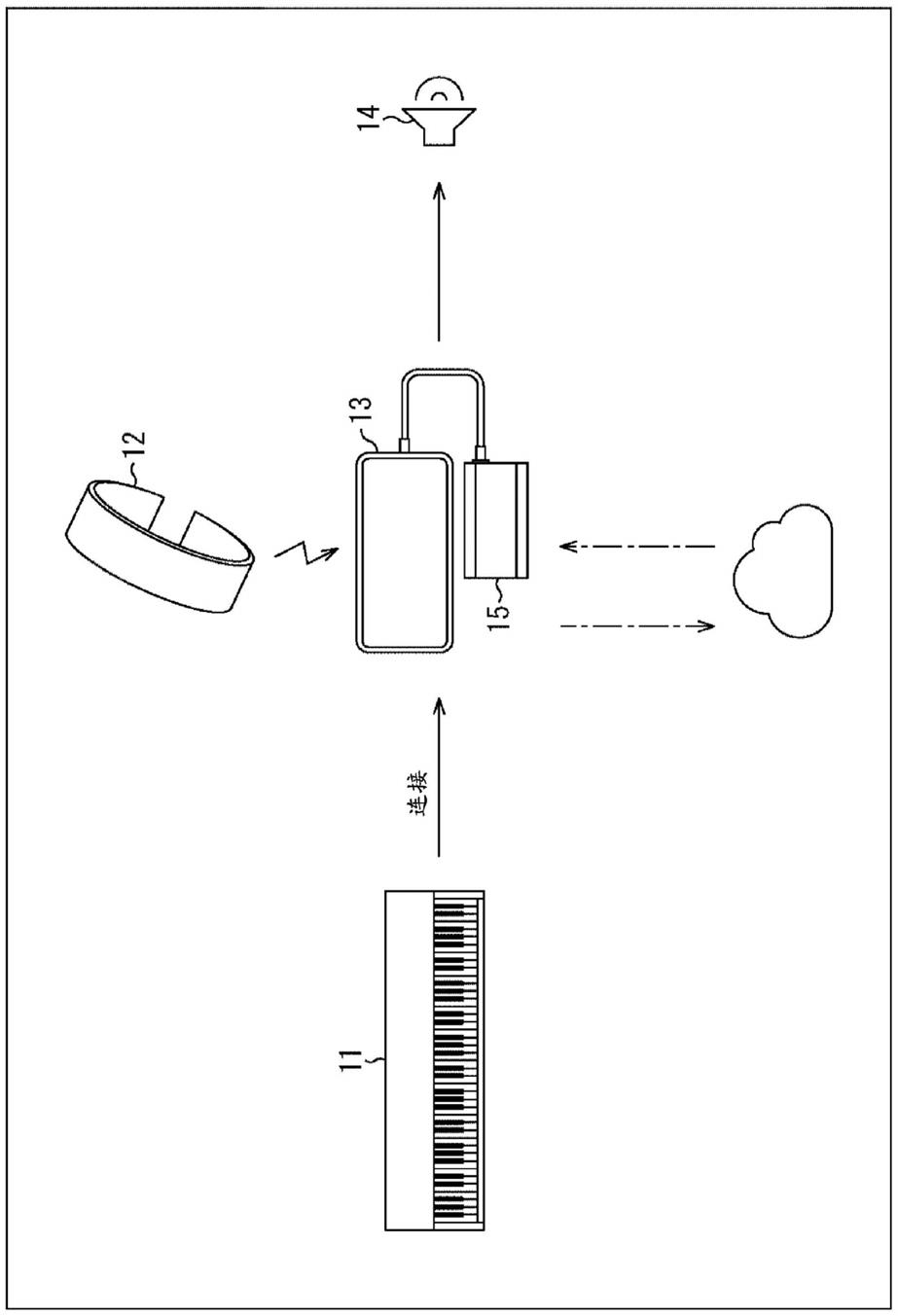

15.图1是图示声学再现系统的配置示例的图。

16.图2是图示声学再现系统的配置示例的图。

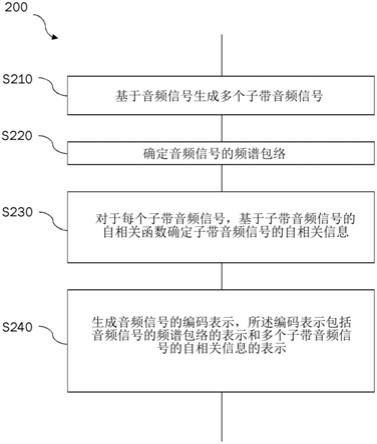

17.图3是图示信息终端设备的配置示例的图。

18.图4是图示灵敏度曲线的示例的图。

19.图5是描述再现处理的流程图。

20.图6是图示灵敏度曲线的示例的图。

21.图7是图示灵敏度曲线的示例的图。

22.图8是图示灵敏度曲线的示例的图。

23.图9是图示灵敏度曲线的示例的图。

24.图10是用于描述用户的运动和声学效果的示例的图。

25.图11是用于描述用户的运动和声学效果的示例的图。

26.图12是用于描述用户的运动和声学效果的示例的图。

27.图13是用于描述用户的运动和声学效果的示例的图。

28.图14是用于描述用户的运动的检测的示例的图。

29.图15是用于描述用户的运动的检测的示例的图。

30.图16是用于描述用户的运动和声学效果的示例的图。

31.图17是用于描述用户的运动和声学效果的示例的图。

32.图18是用于描述用户的运动和声学效果的示例的图。

33.图19是用于描述用户的运动和声学效果的示例的图。

34.图20是用于描述用户的运动和声学效果的示例的图。

35.图21是用于描述用户的运动和声学效果的示例的图。

36.图22是用于描述用户的运动和声学效果的示例的图。

37.图23是描述选择处理的流程图。

38.图24是图示灵敏度曲线的选择画面的示例的图。

39.图25是描述选择处理的流程图。

40.图26是图示用户的运动和灵敏度曲线的示例的图。

41.图27是描述绘制处理的流程图。

42.图28是图示灵敏度曲线输入画面的示例的图。

43.图29是图示动画曲线的示例的图。

44.图30是图示动画曲线的示例的图。

45.图31是描述再现处理的流程图。

46.图32是图示动画曲线的示例的图。

47.图33是图示动画曲线的示例的图。

48.图34是描述再现处理的流程图。

49.图35是图示计算机的配置示例的图。

具体实施方式

50.在下文中,将参考附图描述应用本技术的实施例。

51.《第一实施例》

52.《声学再现系统的配置示例》

53.在声音根据用户的身体的运动而改变的情况下,本技术通过基于检测用户的运动的结果对要再现的声学信号执行非线性声学处理,实现用户对声音的直观操作。

54.例如,将考虑dj通过上下移动dj的手臂来操作声音的情况。

55.在这种情况下,在许多情形中,在从dj观察的向上方向上的范围内,例如,在手臂

从手臂向前突出的状态(水平状态)起在向上方向上移动的角度是45度或更多的范围内,手臂最频繁和快速地移动。

56.因此,如果dj的手臂在上方时声音的变化量增加,而当dj的手臂在下方时声音的变化量减小,则dj应该能够直观地操作声音。

57.然而,例如,在将附连到dj的手臂的传感器的输出波形直接应用于参数并且基于该参数对声学信号执行诸如效果处理之类的声学处理的情况下,无论dj的手臂在上方还是下方,声音都会相对于dj的手臂的位置(高度)的变化而线性地变化。于是,dj在移动手臂时预期的声音的变化与实际声音的变化之间产生差距,因此直观操作是困难的。

58.此外,例如,在通过对dj的手臂的位置执行阈值处理并且根据阈值处理的结果对要再现的声学信号执行声学处理来改变声音的情况下,声音的变化是离散的,因此不仅直观操作是困难的,而且通过操作声音进行的表达也受到限制。

59.因此,在本技术中,根据用户的运动对要再现的声学信号执行非线性声学处理。

60.具体地,例如,在本技术中,预先通过插值处理获得特定曲线或折线的函数,该函数将用户的运动的感测值作为输入并且将与操作声音时的感测值相对应的灵敏度作为输出,以及利用与该函数的输出值相对应的参数执行声学处理。

61.以此方式,要被操作的声音的变化程度,即在操作声音时的灵敏度,根据诸如用户的身体部位的角度或位置、或者运动的速度或强度之类的用户的运动的幅度而动态地变化,并且用户可以对声音执行直观操作。换句话说,用户在操作声音时可以容易地反映自己的意图。

62.在下文中,将更具体地描述本技术。

63.首先,将描述应用本技术的声学再现系统。

64.例如,如图1所示,应用本技术的声学再现系统具有由用户演奏的乐器11、附连到用户的预定部位的可穿戴设备12、信息终端设备13、扬声器14和音频接口15。

65.在该示例中,例如,乐器11、信息终端设备13和扬声器14通过音频接口15连接,并且如果用户演奏乐器11,则与演奏对应的声音由扬声器14再现。此时,再现的演奏声音根据用户的运动而变化。

66.注意,乐器11可以是任何器具,例如诸如钢琴或键盘之类的键盘乐器、诸如吉他或小提琴之类的弦乐器、诸如鼓之类的打击乐器、管乐器或诸如轨迹板之类的电子乐器。

67.此外,可穿戴设备12是可以附连到用户的任何部位(诸如手臂)的装置,并且包括各种传感器,例如加速度传感器、陀螺仪传感器、麦克风、肌电图仪、压力传感器、或弯曲传感器。

68.利用传感器,可穿戴设备12检测用户的运动,更具体地,用户的可穿戴设备12的附连部位的运动,并且通过无线或有线通信将指示检测结果的感测值提供给信息终端设备13。

69.注意,这里,将描述通过可穿戴设备12检测用户的运动的示例。然而,不限于此,用户的运动可以通过在未附连到用户的状态下布置在用户周围的传感器(例如相机或红外传感器)来检测,或者这样的传感器可以设置在乐器11上。

70.此外,这样的布置在用户周围的传感器和可穿戴设备12可以组合以检测用户的运动。

71.信息终端设备13例如是诸如智能电话或平板计算机之类的信号处理设备。注意,不限于此,信息终端设备13可以是诸如个人计算机之类的任何信号处理设备。

72.在图1中所示的声学再现系统中,例如,在可穿戴设备12附连到用户的情况下演奏乐器11时,用户执行期望的运动(动作)以实现用户期望根据演奏表达的声音变化。这里所指的运动例如是诸如举起或放下手臂或挥手之类的运动。

73.然后,用于再现演奏声音的声学信号经由音频接口15从乐器11提供给信息终端设备13。

74.注意,这里将假设音频接口15是输入和输出用于再现演奏声音的声学信号的普通音频接口来给出描述。然而,音频接口15可以是输入和输出指示演奏声音的高度的midi信号的midi接口等。

75.此外,在可穿戴设备12中,检测在演奏期间的用户的运动,并且将作为结果获得的感测值提供给信息终端设备13。

76.然后,基于从可穿戴设备12提供的感测值和预先准备的表示灵敏度曲线的变换函数,信息终端设备13计算要对声学信号执行的声学处理的声学参数。该声学参数相对于感测值而非线性地变化。

77.信息终端设备13基于所获得的声学参数对经由音频接口15从乐器11提供的声学信号执行声学处理,并且经由音频接口15将作为结果获得的再现信号提供给扬声器14。

78.扬声器14基于经由音频接口15从信息终端设备13提供的再现信号输出声音。利用该布置,向演奏乐器11的声音添加了诸如与用户的运动相对应的效果之类的声学效果的声音被再现。

79.这里,灵敏度曲线是指示当通过用户的运动执行对演奏声音的操作(也就是说,声学效果的添加)时的灵敏度特性的非线性曲线或折线,以及表示灵敏度曲线的函数是变换函数。

80.在该示例中,例如,将指示用户的运动的检测结果的感测值代入到变换函数中,并且执行计算。

81.然后,作为计算结果,即变换函数的输出值(以下称为函数输出值),获得指示向用户的运动添加的声学效果的强度(幅度)程度的值(也就是说,灵敏度)。

82.此外,在信息终端设备13中,基于函数输出值计算声学参数,并且基于所获得的声学参数执行添加声学效果的声学处理。

83.例如,向声学信号添加的声学效果是各种效果,诸如延迟、弯音(pitch bend)、平移或由增益校正引起的音量变化。

84.因此,例如,当添加弯音作为声学效果时,声学参数是指示弯音时的音高(pitch)的位移量的值。

85.在声学处理时,可以通过使用从表示非线性灵敏度曲线的变换函数的函数输出值获得的声学参数来实现非线性声学处理。也就是说,可以根据用户的身体的运动来动态地改变灵敏度。

86.利用该布置,可以充分地反映用户的意图,并且用户可以在演奏乐器11等的同时对声音执行直观操作,也就是说,添加声学效果。

87.注意,可以预先准备变换函数,或者用户可以创建期望的运动和添加与该运动相

对应的新声学效果的变换函数。

88.在这样的情况下,例如,信息终端设备13可以经由有线或无线网络从服务器等下载预先准备的期望的变换函数,或者将通过将由用户创建的变换函数与指示运动的信息相关联而获得的东西上传到服务器等。

89.另外,例如,应用本技术的声学再现系统可以具有图2中所示的配置等。注意,在图2中,与图1中的部分相对应的部分被赋予相同的附图标记,并且将适当地省略对相应部分的描述。

90.在图2中所示的示例中,乐器11和信息终端设备13无线地连接或通过诸如音频接口或midi接口之类的有线来连接,以及信息终端设备13和可穿戴设备12无线地连接或通过有线来连接。

91.在这种情况下,例如,信息终端设备13接收从乐器11提供的声学信号,基于从可穿戴设备12提供的感测值获得的声学参数对声学信号执行声学处理,并且生成再现信号。然后,信息终端设备13基于所生成的再现信号来再现声音。

92.另外,可以在乐器11侧再现声音。在这样的情况下,例如,信息终端设备13可以向乐器11提供与再现信号相对应的midi信号以再现声音,或者信息终端设备13可以向乐器11发送感测值、声学参数等,并且可以在乐器11侧执行声学处理。

93.注意,在下文中,将假设信息终端设备13接收从乐器11提供的声学信号并且基于再现信号在信息终端设备13中再现声音来给出描述。

94.《信息终端设备的配置示例》

95.接着,将描述图1和图2中所示的信息终端设备13的配置示例。

96.例如,信息终端设备13如图3中所示地配置。

97.图3中所示的信息终端设备13具有数据获取单元21、感测值获取单元22、控制单元23、输入单元24、显示单元25和扬声器26。

98.数据获取单元21通过有线或无线地连接到乐器11,获取从乐器11输出的声学信号,并且将声学信号提供给控制单元23。

99.注意,尽管这里将描述要再现的声学信号是演奏乐器11的声音的情况作为示例,但不限于此,可以通过数据获取单元21获取任何声音的声学信号作为再现对象。

100.因此,例如,在通过数据获取单元21获取预先记录的预定音乐等的声学信号的情况下,执行向声学信号添加声学效果的声学处理,并且添加了声学效果的音乐被再现。

101.另外,例如,要再现的声学信号可以是声学效果的声音信号,即声音效果(效果声音)本身,并且声音效果中的效果程度可以根据用户的运动而变化。此外,可以与乐器11的演奏声音一起再现效果(effect)的强度根据用户的运动而改变的声音效果。

102.感测值获取单元22通过有线或无线地连接到可穿戴设备12,从可穿戴设备12获取指示可穿戴设备12在用户上的附连部位的运动的感测值,并且将该感测值提供给控制单元23。

103.注意,感测值获取单元22可以从设置在诸如由用户演奏的乐器11之类的器具上的传感器获取指示器具的运动(换言之,操作该器具的用户的运动)的感测值。

104.控制单元23控制整个信息终端设备13的操作。此外,控制单元23具有参数计算单元31。

105.参数计算单元31基于从感测值获取单元22提供的感测值和预先保存的变换函数来计算声学参数。

106.控制单元23基于由参数计算单元31计算的声学参数对从数据获取单元21提供的声学信号执行非线性声学处理,并且将作为结果获得的再现信号提供给扬声器26。

107.输入单元24包括例如叠加在显示单元25上的触摸面板、按钮、开关等,并且将与用户的操作相对应的信号提供给控制单元23。

108.显示单元25包括例如液晶显示面板等,并且在控制单元23的控制下显示各种图像。扬声器26基于从控制单元23提供的再现信号来再现声音。

109.《关于灵敏度曲线》

110.这里,将描述用于计算声学参数的变换函数,即由变换函数表示的灵敏度曲线。

111.例如,灵敏度曲线为非线性曲线等,如图4中所示。注意,在图4中,横轴代表用户的运动、即感测值,而纵轴代表灵敏度、即函数输出值。

112.特别地,在图4中所示的示例中,在感测值小的范围和感测值大的范围内,对感测值变化的灵敏度变化也很大,并且变换函数为非线性函数。

113.此外,在该示例中,通过将感测值代入到变换函数中获得的函数输出值被设定为0到1之间的值。

114.这样的灵敏度曲线可以例如通过以下方式来获得:指定预定点(即感测值)和与感测值对应的灵敏度(函数输出值)的两个或多个组合,并且基于所指定的点和特定的贝塞尔曲线来执行插值处理。也就是说,基于贝塞尔曲线在针对所指定的点确定的两个或多个点之间执行插值,并且获得灵敏度曲线。

115.因此,在使用表示这样的灵敏度曲线的变换函数的情况下,声学参数沿着灵敏度曲线而非线性地变化。也就是说,乐器11的演奏声音的变化量可以根据用户的运动沿着灵敏度曲线而动态地变化。

116.例如,在可被作为感测值等的值的范围内,通过将响应于用户的运动的声音变化的灵敏度被期望为低的范围和灵敏度被期望为高的范围连接起来,可以无缝地改变灵敏度。

117.此外,如果使用灵敏度曲线,则可以扩展用户对音乐的表达范围,因为与通过阈值处理来离散地改变声音的情况不同,可以非线性地且连续地改变声音。

118.《再现处理的说明》

119.接下来,将说明信息终端设备13的操作。也就是说,下文中将参考图5中的流程图来说明信息终端设备13的再现处理。

120.当附连有可穿戴设备12的用户在适当地执行期望运动的同时演奏乐器11时开始再现处理。

121.在步骤s11中,数据获取单元21获取从乐器11输出的声学信号并且将该声学信号提供给控制单元23。

122.在步骤s12中,感测值获取单元22通过无线通信等从可穿戴设备12接收感测值来获取指示用户的运动(motion)的感测值并且将该感测值提供给控制单元23。

123.在步骤s13中,参数计算单元31将从感测值获取单元22提供的感测值代入到预先保存的变换函数中并且执行计算以获得函数输出值。

124.注意,对于用户的多个运动,参数计算单元31可以保持与各个运动相对应的变换函数,并且可以在步骤s13中使用与由感测值指示的运动相对应的变换函数。

125.另外,例如,可以通过使用由用户等预先操作输入单元24从多个预先保存的变换函数当中选择的变换函数来获得函数输出值。

126.在步骤s14中,参数计算单元31基于在步骤s13中获得的函数输出值来计算声学参数。

127.例如,参数计算单元31通过将函数输出值执行尺度变换为声学参数的尺度来计算声学参数。因此,声学参数根据感测值而非线性地变化。

128.在这种情况下,因为函数输出值可以说是归一化的声学参数,所以变换函数可以说是将用户的运动(运动量)作为输入并且将由于声学效果引起的声音变化量(即声学参数)作为输出的函数。

129.在步骤s15中,控制单元23通过基于在步骤s14中获得的声学参数对在步骤s11中获取并从数据获取单元21提供的声学信号执行非线性声学处理来生成再现信号。

130.在步骤s16中,控制单元23将在步骤s15中获得的再现信号提供给扬声器26以再现声音,并且再现处理结束。

131.通过在扬声器26中输出基于再现信号的声音,再现了根据用户的运动(motion)添加了声学效果的乐器11的演奏声音。

132.如上所述,信息终端设备13基于感测值和表示非线性灵敏度曲线的变换函数来计算声学参数,并且基于该声学参数对声学信号执行非线性声学处理。以此方式,可以动态地改变声音操作的灵敏度,并且用户可以直观地操作声音。

133.《灵敏度曲线的另一示例》

134.注意,由变换函数表示的灵敏度曲线不限于图4中所示的示例,并且可以是任何其他灵敏度曲线,只要灵敏度曲线是非线性曲线或折线即可。

135.例如,灵敏度曲线可以是如图6中所示的指数函数曲线。注意,在图6中,横轴代表用户的身体的运动、即感应值,而纵轴代表灵敏度、即函数输出值。

136.例如,类似于图4中所示的示例,图6中所示的灵敏度曲线可以基于贝塞尔曲线通过插值处理来获得,并且在该示例中,表示灵敏度曲线的变换函数为指数函数。

137.在这样的灵敏度曲线中,灵敏度、即函数输出值随着用户的运动变小而减小,反之,函数输出值随着用户的运动变大而增大。

138.此外,输入到变换函数的用户的身体的运动、即感应值可以例如是用户在三维xyz空间中的x轴、y轴和z轴中的每个轴的方向上的加速度,这些加速度的组合加速度,用户的运动的跃度(jerk),以x轴、y轴和z轴中的每个轴作为旋转轴的用户的旋转角度(倾斜角)等。

139.另外,感测值可以是由用户的运动产生的气动声音的声压级或每个频率分量、气动声音的主频率、用户的移动距离、由肌电图仪测量的肌肉的收缩状态、用户按压键盘等的压力等。

140.可以通过以下方式来获得指示灵敏度曲线的非线性变换函数:适当地使用诸如贝塞尔曲线之类的曲线执行插值处理,使得灵敏度根据以此方式获得的指示用户的诸如旋转或移动之类的运动的感测值的幅度来非线性地变化。

141.此外,如图7和图8中所示的曲线可以用作基于贝塞尔曲线通过插值处理获得的灵敏度曲线。

142.请注意,在图7和图8中,每条曲线代表灵敏度曲线,并且作为灵敏度曲线的曲线的名称写在每个灵敏度曲线图的下侧。此外,在每条灵敏度曲线中,水平方向(横轴)指示用户的运动,而垂直方向(纵轴)指示灵敏度。

143.通过利用图7和图8中所示的这样的灵敏度曲线(变换函数),演奏声音的变化量可以根据用户的运动而曲线地(非线性地)改变。

144.特别地,即使图7和图8中所示的一些灵敏度曲线具有相似的形状,灵敏度的变化方式也取决于每个灵敏度曲线上的弯曲部分的角度等而变化。

145.例如,当将曲线名称中包括“easein(缓入)”的被称为easein的类型的曲线用作灵敏度曲线时,声音的变化量随着用户的身体的运动变小而减小,并且声音的变化量随着用户的身体的运动变大而增大。

146.相反,例如,当使用曲线名称中包括“easeout(缓出)”的被称为easeout的类型的曲线时,声音的变化量随着用户的身体的运动变小而增大,并且声音的变化量随着用户的身体的运动变大而减小。

147.如上所述,取决于弯曲部分的角度或起始位置,即使具有相似形状的曲线,其灵敏度变化较大的位置或变化量也不同。

148.此外,当使用被称为easeinout(缓入缓出)的类型的曲线时,在用户的身体的运动小的范围内声音的变化量小,当用户的身体的运动适中时声音的变化量迅速变大,以及在用户的身体的运动较大的范围内声音的变化量小。

149.当使用被称为elastic(弹性)的类型的曲线时,可以表达声音,就好像声音随着用户的身体的运动的变化而伸展或收缩,而当使用被称为bounse(弹跳)的类型的曲线时,可以表达声音,就好像声音根据用户的身体的运动的变化而弹跳(跳动)。

150.此外,除了使用贝塞尔曲线通过插值处理获得的曲线之外,例如,可以使用任何非线性曲线或折线(诸如图9中所示的折线或曲线)作为灵敏度曲线。

151.请注意,在图9中,横轴代表用户的运动、即感测值,而纵轴代表灵敏度、即函数输出值。

152.例如,在由箭头q11所示的示例中灵敏度曲线是具有三角波形的折线,而在由箭头q12所示的示例中灵敏度曲线是具有矩形波形的折线。此外,在由箭头q13所示的示例中,灵敏度曲线是周期性的正弦曲线。

153.《动作和声学效果的示例》

154.此外,将描述上述用户的运动(motion)和根据该运动添加的声学效果的具体示例。

155.例如,如图10中所示,当作为用户的dj做出在垂直方向、即由箭头w11指示的方向上移动用户的手(手臂)的运动时,可以改变基于声学信号的声音。例如,可以通过可穿戴设备12中设置的陀螺仪传感器等来检测(测量)用户移动手臂的角度。

156.在这种情况下,例如,要对声学信号执行的声学效果可以是由延迟滤波器实现的被称为回声效果的延迟效果、使用截止滤波器通过低频截止实现的滤波器效果等。

157.在这样的情况下,在控制单元23中,执行延迟滤波器或截止滤波器的滤波处理作

为非线性声学处理。

158.特别地,在这种情况下,如果使用表示图7和图8中所示的easyin(缓入)的灵敏度曲线的变换函数,声音的延迟等变化(即声学效果的应用程度)随着用户移动手臂的角度减小(即手臂的角度更接近于水平状态)而减小。换言之,所谓的干成分增加,而湿成分减少。相反,随着用户的手臂的角度增大,声音的变化增大。

159.此外,相反地,声音的变化可能随着用户的手臂的角度减小而增大,并且声音的变化可能随着用户的手臂的角度增大而减小。

160.此外,例如,如图11中所示,当作为用户的dj做出在横向方向、即由箭头w21指示的方向上移动用户的手(手臂)的运动时,可以改变基于声学信号的声音。

161.此时,例如,根据用户的手臂在横向方向上的位置,可以添加基于声学信号横向平移声音的声像位置的效果等作为声学效果。特别地,在这种情况下,随着用户的手臂在横向方向上的角度增大,可以想到更大程度地平移声源(声音),即更大程度地移动声像位置。此外,相反地,随着用户的手臂在横向方向上的角度减小,可以更大程度地平移声音。

162.此外,例如,如图12中所示,当用户用用户的手指执行快速动作作为运动时,可以向声学信号添加诸如混响、失真或弯音之类的效果(即声学效果)。

163.在这种情况下,用户的快速动作可以通过感测在快速动作时施加到附连到用户的手腕等的可穿戴设备12的振动(即跃度)来检测。

164.然后,在信息终端设备13中,基于跃度的感测值执行诸如添加效果的滤波处理之类的声学处理,以使得诸如混响之类的效果(声学效果)的变化量改变。

165.另外,例如,如图13中所示,当用户执行在横向方向、即由箭头w31指示的方向上摇晃用户的手指或手臂的动作作为在演奏作为乐器11的诸如钢琴之类的键盘乐器时的运动时,可以添加诸如弯音或颤音之类的效果(声学效果)。

166.在这种情况下,例如,通过附连到用户的手腕等的可穿戴设备12中设置的加速度传感器等来检测在横向方向上摇晃手臂的动作,并且基于作为检测结果获得的作为感测值的加速度值来添加声学效果。

167.具体地,例如,随着作为感测值的加速度值增大,作为声学效果的弯音中的音高位移量可以增大;以及相反地,随着加速度值减小,音高位移量可以减小。在该示例中,弯音中的音高位移量被视为声学参数。

168.此外,在图13中的示例中,例如,可以通过如图14中所示的设置在作为乐器11的钢琴的每个键盘部分(诸如键盘ky11部分)中的压力传感器来检测作为运动的用户的手臂(手指)在横向方向上的摇晃。

169.在这种情况下,根据设置在每个键盘部分中的压力传感器的输出值,可以识别在每个时间(定时)按压哪个键盘,并且可以基于所识别的结果来检测用户的手臂在横向方向上的摇晃。

170.另外,在图13中的示例中,例如,可以通过如图15中所示的在作为乐器11的钢琴处设置在用户前方的部分等上的传感器ca11(诸如相机或红外线传感器)来检测作为运动的用户的手臂(手指)在横向方向上的摇晃。

171.例如,在通过作为传感器ca11的相机检测到用户的运动的情况下,在乐器11侧或感测值获取单元22中从由相机捕获的运动图像中获得用户在横向方向上的摇晃幅度,并且

指示摇晃幅度的值被用作感测值。

172.此外,例如,如图16中所示,当用户执行在垂直方向、即由箭头w41指示的方向上摇晃用户的手臂的动作作为在演奏作为乐器11的诸如钢琴之类的键盘乐器时的运动时,可以添加声学效果。

173.在这种情况下,例如,根据用户的手臂在垂直方向上的运动(摇晃)的幅度,可以向基于声学信号的演奏声音添加音量水平的变化或诸如驱动、失真或共振(resonance)之类的效果作为声学效果。此时,声音的变化量、即所添加的声学效果的强度也根据检测到的摆动的幅度而变化。

174.此外,例如,如图17中所示,在以下情况下可以添加声学效果:在演奏作为乐器11的诸如钢琴之类的键盘乐器时,用户执行如由箭头w51或箭头w52所示向左或向右摇晃手臂的动作作为在用手指按压键盘时的运动。

175.在这种情况下,弯音被添加为声学效果,并且例如,随着用户如箭头w51所示将手臂移动到右侧,通过弯音将乐器11的演奏声音位移到较高的音符;以及相反地,随着用户如箭头w52所示将手臂移动到左侧,通过弯音将演奏声音位移到较低的音符。

176.此外,例如,如图18中所示,可以在以下情况下添加声学效果:在演奏作为乐器11的诸如钢琴之类的键盘乐器时,用户执行如箭头w61所示向右和向左转动手臂的动作作为在用手指按压键盘时的运动。

177.在这种情况下,用户的手臂向右和向左的旋转角度被检测为感测值,并且根据旋转角度向演奏声音添加诸如弯音之类的效果作为声学效果。

178.此外,例如,如图19中所示,在用户执行摇晃吉他的琴弦或头部(颈部)等的动作作为在演奏作为乐器11的诸如吉他之类的弦乐器时的运动的情况下,可以添加诸如颤音或弯音之类的声学效果。

179.在这种情况下,例如,当用户如由箭头w71所示在按压琴弦的同时摇晃手或手指或者如由箭头w72所示上下摇晃头部的运动被执行为运动时,向吉他等的演奏声音添加颤音或弯音作为声学效果。

180.在这种情况下,例如,感测值获取单元22可以从设置在作为乐器11的吉他等上的传感器获取指示吉他的头部分等的运动的感测值,或者可以获取从可穿戴设备12输出的感测值作为指示头部分的运动的感测值。

181.此外,例如,如图20中所示,用户按压作为乐器11的轨迹板的板(键盘)或键盘乐器(诸如钢琴)的键盘的动作、特别是按压板或键盘的力度(压力)可以被检测为运动,并且可以根据检测到的压力添加声学效果。

182.在这种情况下,不是可穿戴设备12而是设置在乐器11的板(键盘)部分上的压力传感器检测用户的运动(按压板等的力度)。因此,例如,如果用户在按压板部分的同时摇晃手,则施加到板部分的压力根据摇晃而变化,因此所添加的声学效果的强度也变化。

183.类似地,例如,如图21中所示,可以通过设置在打击乐器上的压力传感器等来检测作为乐器11的打击乐器(诸如鼓)的敲击力度(压力),并且根据检测结果,可以向鼓等的演奏声音添加效果(声学效果)。

184.在这种情况下,鼓等的演奏声音例如被麦克风收集,并且作为结果获得的声学信号可以被数据获取单元21获取。以此方式,控制单元23可以基于声学参数对鼓等的演奏声

音的声学信号执行非线性声学处理。注意,在没有收集鼓等的演奏声音的情况下,可以与演奏声音一起从扬声器26再现具有与声学参数相对应的效果的强度的声学声音效果。

185.此外,例如,如图22中所示,用户在由箭头w81所示的方向上倾斜作为乐器11的管乐器的动作可以被检测为运动,并且根据倾斜的程度,可以向乐器11的演奏声音的声学信号添加声学效果。在这种情况下,可以通过利用麦克风收集声音来获得管乐器的演奏声音。此外,不仅对于管乐器而且对于诸如吉他之类的弦乐器,使弦乐器倾斜的运动可以被检测为运动。

186.《关于灵敏度曲线的选择》

187.此外,如果在参数计算单元31计算声学参数之前准备了多条灵敏度曲线、即多个变换函数,则可以从灵敏度曲线当中选择期望的灵敏度曲线并且将其用于声学参数的计算。

188.例如,在预先准备了多条灵敏度曲线的情况下,考虑了使用默认地预设的灵敏度曲线的方法、用户从多条灵敏度曲线当中选择灵敏度曲线的方法、利用与运动的类型相对应的灵敏度曲线的方法等。

189.例如,在针对运动默认地预设灵敏度曲线的情况下,当用户执行特定运动时,参数计算单元31从感测值获取单元22接收与该运动对应的感测值的提供。

190.然后,参数计算单元31基于表示针对由用户执行的运动预先确定的、即预设的灵敏度曲线的变换函数,并且基于所提供的感测值来计算声学参数。

191.因此,在这种情况下,如果用户做出特定的运动(motion),则从用户的视点来看,乐器11的演奏声音沿着预设的灵敏度曲线自动地变化。

192.具体地,例如,当用户执行摇晃手臂的运动时,假设针对指示手臂的摇晃的感测值预设了表示指数函数曲线的变换函数。在这种情况下,当手臂的摇晃小时灵敏度低,并且随着手臂的摇晃变大,灵敏度自动地增大,并且声音的变化增大。

193.《选择处理的说明》

194.此外,在用户从多条灵敏度曲线当中选择灵敏度曲线的情况下,例如,根据用户的指示选择灵敏度曲线的选择处理在由用户提供指示的定时执行。

195.在下文中,将参考图23中的流程图来说明由信息终端设备13执行的选择处理。

196.在步骤s41中,通过从未示出的存储器中读取图像数据并且将图像数据提供给显示单元25,控制单元23基于图像数据显示作为图形用户界面(gui)的选择画面。

197.利用该布置,例如,图24中所示的灵敏度曲线(变换函数)的选择画面被显示在显示单元25上。

198.在图24中所示的示例中,选择画面被显示在显示单元25上,并且预先保存在参数计算单元31中的多条灵敏度曲线和这些灵敏度曲线的名称在选择画面上被显示为列表。

199.用户通过利用手指等触摸期望的灵敏度曲线从被显示为列表的多条灵敏度曲线当中指定(选择)期望的灵敏度曲线。

200.在本例中,作为输入单元24的触摸面板叠加在显示单元25上,并且当用户在显示灵敏度曲线的区域执行触摸操作时,将与触摸操作对应的信号从输入单元24提供给控制单元23。注意,用户可能能够为每个运动选择灵敏度曲线。

201.返回对图23中的流程图的描述,在步骤s42中,控制单元23基于从输入单元24提供

的信号,从选择画面上显示的多个灵敏度曲线当中选择表示由用户指定的灵敏度曲线的变换函数,作为要用于计算声学参数的变换函数。

202.当以这种方式选择灵敏度曲线、即变换函数时,在随后要执行的图5中的再现处理的步骤s13中,通过使用在图23中的步骤s42中选择的变换函数来获得函数输出值。

203.当变换函数被控制单元23选择并且指示选择结果的信息被控制单元23的参数计算单元31记录时,选择处理结束。

204.如上所述,信息终端设备13显示选择画面,并且根据用户的指示选择变换函数。以此方式,不仅可以根据用户的偏好或者用户想要的应用来切换变换函数,而且可以沿着用户想要的灵敏度曲线添加声学效果。

205.《选择处理的说明》

206.此外,在从多条灵敏度曲线当中选择与运动的类型对应的灵敏度曲线的情况下,即在灵敏度曲线根据用户的运动而改变的情况下,执行图25中所示的选择处理作为选择处理。

207.在下文中,将参考图25中的流程图来说明由信息终端设备13执行的选择处理。注意,参考图25描述的选择处理在参考图5描述的再现处理的步骤s12中获取感测值时开始。

208.在步骤s71中,参数计算单元31基于从感测值获取单元22提供的感测值来识别用户的运动(motion)的类型。

209.例如,基于以下各项来识别运动的类型:感测值的时间变化,与来自可穿戴设备12的感测值一起提供并且指示已经被用于获得该感测值的传感器的类型的信息等。

210.在步骤s72中,参数计算单元31从预先保存的多个灵敏度曲线的变换函数中选择针对在步骤s71中识别的运动类型确定的灵敏度曲线的变换函数,并且选择处理结束。

211.在以这种方式选择灵敏度曲线的变换函数之后,在图5中的再现处理的步骤s13中,通过使用在步骤s72中选择的变换函数来获得函数输出值。

212.注意,哪种类型的运动(motion)导致选择哪个灵敏度曲线的变换函数可以被预先确定,或者可以能够由用户指定。

213.如上所述,信息终端设备13根据感测值等识别用户的运动类型,并且根据所识别的结果选择灵敏度曲线(变换函数)。以此方式,可以为每种类型的运动添加具有适当灵敏度的声学效果。

214.例如,如由图26中的箭头q31所示,假设用户在演奏作为乐器11的钢琴的同时执行横向地摇晃手的运动(motion)。

215.在这种情况下,例如,在参数计算单元31中,在步骤s72中选择被称为“easeinexpo(缓入指数)”的曲线的变换函数作为灵敏度曲线。换言之,选择缓入指数(easeinexponential)函数作为变换函数。

216.假设从该状态开始,用户停止演奏的手的横向摇晃运动,并且例如,如由箭头q32所示,用户执行使演奏作为乐器11的钢琴的手倾斜的运动(motion)。

217.然后,在图25中的步骤s72中的新执行的选择处理中,选择被称为“easeoutexpo(缓出指数)”的曲线的变换函数作为灵敏度曲线。换言之,选择缓出指数(easeoutexponential)函数作为变换函数。

218.利用该布置,根据用户的运动类型的变化,变换函数从缓入指数

(easeinexponential)函数切换到缓出指数(easeoutexponential)函数。

219.在图26中所示的这样的示例中,当用户执行摇晃手的运动时,随着微小的摇晃,灵敏度低,并且演奏声音的变化小,以及当手的摇晃变大时,灵敏度逐渐提高,并且演奏声音的变化也变大。

220.相反,当用户执行使手倾斜的运动(motion)时,即使用户的手的倾斜小,灵敏度也高,并且演奏声音变化很大,而在手倾斜很大的情况下,灵敏度逐渐降低,并且演奏声音的变化变得温和。

221.注意,尽管这里描述了根据用户的运动类型选择灵敏度曲线的示例,但是此外可以根据乐器11的类型、音乐的类型(流派)等选择灵敏度曲线或声学效果。

222.例如,可以通过控制单元23经由数据获取单元21连接到乐器11并且从乐器11获取指示乐器11的类型(type)的信息来识别乐器11的类型。此外,例如,控制单元23可以通过根据从感测值获取单元22提供的感测值识别用户在演奏乐器11时的运动来识别乐器11的类型。

223.此外,例如,基于要再现的声学信号的声音、即音乐的类型(流派)可以通过控制单元23对从数据获取单元21提供的声学信号执行各种分析处理来识别,或者可以从声学信号的元数据等中识别。

224.《选择处理的说明》

225.另外,除了用户从预先准备的多条灵敏度曲线中选择期望的灵敏度曲线之外,用户还可以通过经由绘制灵敏度曲线等输入灵敏度曲线来指定期望的灵敏度曲线。

226.在这样的情况下,在信息终端设备13中执行图27中所示的绘制处理。下文中将参考图27中的流程图来描述信息终端设备13的绘制处理。

227.在步骤s101中,控制单元23控制显示单元25以显示用于在显示单元25上输入灵敏度曲线的灵敏度曲线输入画面。

228.利用该布置,例如,图28中所示的灵敏度曲线输入画面被显示在显示单元25上。

229.在图28中所示的示例中,用户可以通过以下方式来指定任何灵敏度曲线:通过利用手指等在灵敏度曲线输入画面上进行勾画,绘制灵敏度曲线,其中横轴代表运动(motion)并且纵轴代表灵敏度。

230.在该示例中,作为输入单元24的触摸面板叠加在显示单元25上,并且用户通过利用手指等在灵敏度曲线输入画面上执行勾画操作来输入期望的灵敏度曲线,诸如非线性曲线或折线。

231.注意,用于输入灵敏度曲线的方法不限于此,并且可以使用任何方法。此外,例如,可以在灵敏度曲线输入画面上显示预设的灵敏度曲线,并且用户可以通过触摸操作等使灵敏度曲线变形来输入期望的灵敏度曲线。

232.返回到图27中的流程图的说明,在步骤s102中,基于根据用户绘制灵敏度曲线的操作从输入单元24提供的信号,参数计算单元31生成并且记录表示由用户输入的灵敏度曲线的变换函数。当记录了由用户绘制的灵敏度曲线的变换函数时,绘制处理结束。

233.如上所述,信息终端设备13生成并且记录表示由用户自由地绘制的灵敏度曲线的变换函数。

234.利用该布置,用户可以通过根据用户的运动精细地调整或定制在操作声音时的灵

敏度来指定用户想要的灵敏度曲线,并且进一步可以直观地操作声音。

235.《第二实施例》

236.《关于动画效果的添加》

237.顺便提及,在上面,已经描述了在信息终端设备13中以与用户的运动相对应的灵敏度向乐器11的演奏声音添加声学效果的示例。

238.然而,不限于此,并且例如,当用户执行特定的运动(motion)时,可以在一定时间段内向要根据运动的类型再现的声音添加动画效果作为声学效果。注意,在下文中,用户的特定运动(motion)也被特别地称为姿势。

239.这里,例如,动画效果是这样的声学效果,其中,在一定时间段内向要沿着基于贝塞尔曲线通过插值处理而获得的动画曲线来再现的声音添加效果。

240.例如,动画曲线可以是图29中所示的曲线。注意,在图29中,纵轴代表声音变化,而横轴代表时间。

241.例如,在音量水平随时间变化的动画效果的情况下,可以说由动画曲线的纵轴上的值指示的声音变化代表音量水平。

242.下文中,表示动画曲线的函数被称为动画函数。因此,动画曲线的纵轴上的值、即指示声音变化的值是动画函数的输出值(下文中被称为函数输出值)。

243.例如,假设动画效果是改变要再现的声音的音量水平的效果,当沿着图29中所示的动画曲线向要再现的声音添加动画效果时,要再现的声音的音量水平随着时间推移而减小。

244.这里,将描述在添加动画效果时的姿势和动画效果的具体示例。

245.例如,在感测值获取单元22中,可以基于感测值将用户的手臂在横向方向或纵向方向上的摆动检测为姿势,以及当检测到该姿势时,可以再现针对该姿势(更具体地为该姿势的类型)预先确定的声源的声音(下文中也被称为姿势声音)。

246.此时,添加如下动画效果:例如,沿着图30中所示的动画曲线,姿势声音的音量水平随着时间推移而逐渐减小。注意,在图30中,纵轴代表声音变化、即动画函数的函数输出值,而横轴代表时间。

247.在这种情况下,例如在控制单元23中,可以根据检测到的姿势来选择动画曲线和声学处理、即动画效果。

248.当选择动画曲线时,基于每个时间的函数输出值,在参数计算单元31中计算作为各个时间的声学参数的增益值。例如,将函数输出值进行尺度变换为声学参数的尺度以作为声学参数。这里,作为声学参数的增益值在稍后时间(未来时间)更小。

249.当以这种方式获得各个时间的声学参数时,在控制单元23中,在每个时间基于该时间的声学参数对姿势声音的声学信号执行增益校正作为声学处理,并且生成再现信号。

250.当基于以此方式获得的再现信号由扬声器26再现声音时,再现姿势声音以使得音量水平随着时间推移而减小。

251.此外,例如,可以将按压键盘的动作、弹拨琴弦的动作等检测为演奏乐器11的用户的运动(姿势),并且可以在预定时间内沿着与用户的运动相对应的动画曲线向乐器11的演奏声音添加动画效果。

252.在这种情况下,可以原样地演奏乐器11的演奏声音,并且可以与该演奏声音一起

再现根据用户的运动添加了动画效果的声音效果。

253.《再现处理的说明》

254.此外,例如,在感测值获取单元22中,基于在每个时间获取的指示用户运动的感测值,可以依次检测这些感测值的时间波形的峰值,并且可以根据检测到的峰值确定声学参数的初始值。

255.在这样的情况下,例如在信息终端设备13中,例如执行图31中所示的再现处理。下文中,将参考图31中的流程图来说明信息终端设备13的再现处理。

256.在步骤s131中,感测值获取单元22通过经由无线通信等从可穿戴设备12接收感测值来获取指示用户的运动(motion)的感测值。

257.在步骤s132中,基于迄今为止获取的感测值,感测值获取单元22检测用户是否执行了特定的姿势。

258.在步骤s133中,感测值获取单元22判定作为步骤s132中的检测结果是否已经检测到姿势。

259.在步骤s133中判定没有检测到姿势的情况下,处理返回到步骤s131,并且重复执行上述处理。

260.同时,在步骤s133中判定已经检测到姿势的情况下,在步骤s134中,感测值获取单元22基于迄今为止获取的最近预定时间段内的感测值来检测感测值的波形峰值。

261.感测值获取单元22将指示以此方式检测到的姿势和峰值的信息提供给参数计算单元31。

262.在步骤s135中,参数计算单元31基于从感测值获取单元22提供的指示检测到的姿势和峰值的信息来确定动画效果(即动画曲线)和声学处理。

263.这里,例如,假设针对姿势(即用户的运动)的类型,预先确定动画效果和要再现的姿势声音。在这种情况下,参数计算单元31选择针对检测到的姿势预先确定的动画效果作为要向姿势声音添加的动画效果。

264.另外,此时,控制单元23控制数据获取单元21以获取针对检测到的姿势预先确定的姿势声音的声学信号。

265.注意,尽管这里将描述要再现的声音是针对姿势确定的姿势声音的情况,但不限于此,可以向任何声音(诸如乐器11的演奏声音)添加动画效果。

266.在步骤s136中,参数计算单元31基于从感测值获取单元22提供的指示检测到的姿势和峰值的信息来计算声学参数。

267.在这种情况下,例如,参数计算单元31通过将感测值的峰值执行尺度变换为声学参数的尺度来计算声学参数的初始值。

268.这里的声学参数的初始值是要向姿势声音添加的动画效果的开始时间点处的声学参数的值。

269.此外,基于声学参数的初始值和用于实现在步骤s135中确定的动画效果的动画曲线,参数计算单元31计算在向姿势声音添加动画效果的时间段内的各个时间的声学参数。

270.这里,基于声学参数的初始值和表示动画曲线的动画函数在各时间的函数输出值来计算各时间的声学参数的值,以使得声学参数的值沿着动画曲线从初始值起逐渐变化。

271.注意,在下文中,其中添加了动画效果的时间段也被特别地称为动画时间段。

272.在步骤s137中,控制单元23通过执行基于在步骤s136中计算的各个时间的声学参数对姿势声音的声学信号添加动画效果的声学处理来生成再现信号。

273.也就是说,控制单元23通过基于声学参数对姿势声音的声学信号执行声学处理、同时使声学参数的值沿着动画曲线从初始值起逐渐改变来生成再现信号。

274.因此,在这种情况下,由于声学参数随着时间推移而变化,所以对声学信号执行非线性声学处理。

275.在步骤s138中,控制单元23将在步骤s137中获得的再现信号提供给扬声器26以再现声音,并且再现处理结束。

276.利用该布置,在扬声器26中再现添加了与姿势对应的动画效果的姿势声音。

277.如上所述,信息终端设备13基于感测值的峰值来计算声学参数,并且基于该声学参数对声学信号执行非线性声学处理。

278.以此方式,用户可以仅通过做出预定的姿势来向姿势声音添加想要的动画效果。因此,用户可以直观地操作声音。

279.这里,将描述添加与姿势相对应的动画效果的上述情况的具体示例。

280.作为这样的示例,可以想到,在用户做出摆动手臂的姿势的情况下,例如,向姿势声音添加具有如图32中所示的动画曲线的弹跳(bounce)动画,其中姿势声音的音量逐渐减小。

281.注意,在图32中,纵轴代表声音变化、即动画函数的函数输出值,而横轴代表时间。

282.图32中所示的动画曲线是声音在上下变化的同时随着时间推移而逐渐减小的曲线。

283.因此,例如,假设获取当用户挥动手臂时的跃度作为感测值,则在感测值获取单元22中检测作为感测值的跃度的波形峰值。

284.此外,在参数计算单元31中,基于跃度的峰值来确定作为声学参数的增益值、即在再现姿势声音时的音量的初始值,并且确定各个时间的声学参数,以使得声学参数沿着图32中所示的动画曲线变化。

285.然后,在控制单元23中,基于所确定的各个时间的声学参数、即增益值,对姿势声音的声学信号执行作为声学处理的增益校正,并且作为结果,向姿势声音添加弹跳(bounce)动画效果。

286.在这种情况下,由于弹跳(bounce)动画效果,再现了姿势声音,其中根据用户的姿势(即手臂的摆动)生成的声音的音量通过就好像声音通过撞击物体而反弹并且蹦跳(bound)一样地变化来随着时间推移而逐渐减小。

287.另外,还可以想到例如向姿势声音添加具有例如图33中所示的动画曲线的弹性(elastic)动画。注意,在图33中,纵轴代表声音变化、即动画函数的函数输出值,而横轴代表时间。

288.当姿势声音的音量沿着图33中所示的这样的动画曲线变化时,可以向姿势声音添加根据姿势生成的声音(姿势声音)仿佛有弹性地返回的效果。

289.此外,例如,可以获取指示当作为乐器11的打击乐器被敲击时的振动的加速度等作为感测值,并且与上述示例类似,可以通过使用指示振动波形的感测值的峰值来将诸如混响或延迟之类的各种效果动画化。

290.在这样的情况下,向乐器11的演奏声音等添加的诸如混响或延迟之类的声学效果的应用程度沿着动画曲线随时间推移而变化。

291.《第二实施例的第一变型》

292.《关于动画效果的添加》

293.此外,例如,可以根据用户的运动(姿势)生成姿势声音,并且可以向姿势声音、即声音的波形添加动画效果。

294.例如,假设指示用户的运动的加速度被检测为感测值,并且根据感测值,生成具有特定频率的声音波形(诸如正弦波)的声学信号作为姿势声音的信号。

295.在这样的情况下,可以想到,与上述示例类似地确定声学参数的初始值,并且向姿势声音添加其中效果的应用程度沿着预定的动画曲线随时间推移而变化的动画效果。

296.此外,例如,还可以想到向由用户的运动所生成的气动声音添加具有特定波形的动画效果。

297.在这样的情况下,例如,气动声音的声压等被检测为感测值,基于该感测值的波形峰值确定声学参数的初始值,并且对通过声音采集获得的气动声音的声学信号执行基于每个时间的声学参数的声学处理。

298.《第二实施例的第二变型》

299.《关于动画效果的添加》

300.此外,在根据用户的运动添加动画效果的情况下,当在动画结束之前新检测到用户的大运动时,可以再次添加动画效果。

301.例如,假设根据指示用户的运动的感测值的峰值确定声学参数的初始值,并且基于初始值和动画曲线向声学信号添加用于改变效果的应用程度的动画效果。

302.这里,虽然基于声学信号的声音可以是诸如乐器11的演奏声音或针对用户的运动确定的声音效果之类的任何声音,但是这里假设再现乐器11的演奏声音。

303.此时,例如假设用户的身体的预定部位的加速度被检测为感测值,基于该加速度的峰值确定声学参数的初始值。

304.此外,当确定声学参数的初始值时,确定各个后续时间的声学参数的值,以使得声学参数的值沿着针对用户的运动等确定的动画曲线而变化。

305.当以此方式确定包括初始值的各个时间的声学参数时,基于各个时间的声学参数对要再现的声学信号执行声学处理,并且生成再现信号。然后,当基于以此方式获得的再现信号再现声音时,特定时间段的动画效果被添加到乐器11的演奏声音并且被再现。

306.在这种情况下,在针对指示用户的运动的加速度(感测值)的峰值获得的声学参数在动画时间段结束之前超过当前时间的声学参数的情况下,针对该峰值获得的声学参数被设定为新的初始值。

307.也就是说,在根据动画时间段内的任意时间的峰值获得的声学参数大于该时间的实际声学参数的情况下,针对该时间的峰值获得的声学参数被设定为新声学参数的初始值,并且向乐器11的演奏声音新添加动画效果。

308.注意,虽然这里已经描述了向乐器11的演奏声音添加动画效果的示例,但是类似地可以应用于其他情况,例如,向由用户的运动生成的气动声音添加动画效果的情况等。

309.《再现处理的说明》

310.这里,如上所述,将描述在根据用户的运动适当地更新声学参数的初始值并且新添加动画效果的情况下执行的处理。

311.也就是说,在下文中,将参考图34中的流程图描述信息终端设备13的再现处理。

312.注意,这里,将描述在用户做出预定运动时向乐器11的演奏声音添加动画效果的情况作为示例。

313.在步骤s161中,数据获取单元21获取从乐器11输出的声学信号并且将该声学信号提供给控制单元23。

314.在步骤s162中,感测值获取单元22通过经由无线通信等从可穿戴设备12接收感测值来获取指示用户的运动(motion)的感测值。

315.在步骤s163中,感测值获取单元22基于迄今为止获取的最近预定时间段内的感测值来检测感测值的波形峰值。

316.感测值获取单元22将以此方式检测到的感测值的峰值提供给参数计算单元31。

317.在步骤s164中,参数计算单元31基于从感测值获取单元22提供的峰值来计算声学参数。

318.在这种情况下,例如,参数计算单元31通过将感测值的峰值执行尺度变换为声学参数的尺度来计算声学参数的初始值。

319.在步骤s165中,参数计算单元31判定在步骤s164中计算的声学参数的初始值是否大于当前时间的声学参数。

320.例如,假设当用户做出预定运动时,向乐器11的演奏声音添加针对该动作预先确定的动画效果。

321.此时,在不是动画时间段的情况下,如果步骤s164中获得的声学参数的初始值大于0,则在步骤s165中判定该初始值大于当前时间的声学参数。

322.另外,在是动画时间段的情况下,如果步骤s164中获得的声学参数的初始值大于实际用于添加动画效果的当前时间的声学参数,则在步骤s165中判定该初始值大于当前时间的声学参数。

323.在步骤s165中判定声学参数的初始值不大于当前时间的声学参数的情况下,不执行步骤s166至步骤s168中的处理,此后处理进行到步骤s169。

324.在这种情况下,如果不是动画时间段,则控制单元23向扬声器26提供没有添加声学效果(即动画效果)的声学信号作为再现信号,并且再现乐器11的演奏声音。

325.此外,如果是动画时间段,则基于当前时间的声学参数对声学信号执行声学处理,并且基于所获得的再现信号由扬声器26再现声音。在这种情况下,再现添加了动画效果的演奏声音。

326.同时,在步骤s165中判定声学参数的初始值大于当前时间的声学参数的情况下,此后处理进行到步骤s166。

327.在这种情况下,无论当前是否向乐器11的演奏声音添加动画效果,即无论是否为动画时间段,基于在步骤s164中计算的声学参数的初始值来计算新动画时间段中的各个时间的声学参数,并且向乐器11的演奏声音新添加动画效果。

328.在步骤s166中,参数计算单元31基于在步骤s164中计算的声学参数的初始值和针对用户的运动等确定的动画曲线,计算动画时间段中的各个时间的声学参数。

329.这里,基于声学参数的初始值和表示动画曲线的动画函数的各个时间的函数输出值来计算声学参数的值,以使得声学参数的值沿着动画曲线从初始值起逐渐变化。

330.在步骤s167中,控制单元23通过执行基于在步骤s166中计算的各个时间的声学参数对由数据获取单元21获取的声学信号添加动画效果的声学处理来生成再现信号。

331.也就是说,控制单元23通过对声学信号执行基于声学参数的声学处理、同时使声学参数的值沿着动画曲线从初始值起逐渐改变来生成再现信号。

332.在步骤s168中,控制单元23将在步骤s167中获得的再现信号提供给扬声器26以再现声音。利用该布置,新的动画时间段开始,并且动画效果被添加到乐器11的演奏声音并且被再现。

333.如果执行了步骤s168中的处理,或者在步骤s165中判定声学参数不大于当前时间的声学参数,则控制单元23在步骤s169中基于声学信号判定是否结束声音的再现。

334.例如,在步骤s169中,在用户结束演奏乐器11等的情况下,判定结束再现。

335.在步骤s169中判定再现尚未结束的情况下,处理返回到步骤s161,并且重复执行上述处理。

336.同时,在步骤s169中判定要结束再现的情况下,信息终端设备13的每个单元停止正在执行的处理,并且再现处理结束。

337.如上所述,信息终端设备13基于感测值的峰值计算声学参数,并且基于声学参数对声学信号执行声学处理。

338.另外,当在动画时间段中存在声学参数的值大于当前时间的声学参数的值的用户运动时,信息终端设备13根据该运动向乐器11的演奏声音新添加动画效果。

339.以此方式,用户可以根据用户的运动添加想要的动画效果。因此,用户可以直观地操作声音。

340.《计算机的配置示例》

341.顺便提及,上述一系列处理可以由硬件执行或可以由软件执行。在由软件执行一系列处理的情况下,构成软件的程序安装在计算机上。这里,计算机包括并入专用硬件的计算机、例如能够通过安装各种程序来执行各种功能的通用个人计算机等。

342.图35是示出利用程序执行上述一系列处理的计算机的硬件的配置示例的框图。

343.在计算机中,中央处理单元(cpu)501、只读存储器(rom)502和随机存取存储器(ram)503通过总线504相互连接。

344.此外,输入/输出接口505连接到总线504。输入单元506、输出单元507、记录单元508、通信单元509和驱动器510连接到输入/输出接口505。

345.输入单元506包括键盘、鼠标、麦克风、图像传感器等。输出单元507包括显示器、扬声器等。记录单元508包括硬盘、非易失性存储器等。通信单元509包括网络接口等。驱动器510驱动诸如磁盘、光盘、磁光盘或半导体存储器之类的可移除记录介质511。

346.在如上配置的计算机中,上述一系列处理由cpu 501经由输入/输出接口505和总线504将例如记录在记录单元508中的程序加载到ram 503并且执行该程序来执行。

347.由计算机(cpu 501)执行的程序可以通过例如记录在作为封装介质的可移除记录介质511等上来提供。此外,程序可以经由诸如局域网、因特网或数字卫星广播之类的有线或无线传输介质来提供。

348.在计算机中,程序可以经由输入/输出接口505通过将可移除记录介质511附连到驱动器510来安装在记录单元508上。此外,程序可以经由有线或无线传输介质由通信单元509接收并安装在记录单元508上。另外,程序可以预先安装在rom 502或记录单元508上。

349.注意,由计算机执行的程序可以是按照本说明书中描述的顺序按时间序列处理的程序,或者可以是并行处理的程序,或者可以是在诸如进行调用时之类的需要定时处理的程序。

350.此外,本技术的实施例不限于上述实施例,并且可以在不偏离本技术的范围的情况下进行各种改变。

351.例如,本技术可以具有云计算的配置,其中一个功能由多个设备经由网络共享地且共同地处理。

352.此外,上述流程图中描述的每个步骤可以由一个设备执行,或者可以由多个设备共享来执行。

353.另外,在一个步骤中包括多个处理的情况下,一个步骤中包括的多个处理除了由一个设备执行之外,还可以由多个设备共享来执行。

354.此外,本技术可以具有以下配置。

355.(1)一种信号处理设备,包括:

356.获取单元,所述获取单元获取指示用户的身体的预定部位的运动或器具的运动的感测值;以及

357.控制单元,所述控制单元根据所述感测值对声学信号执行非线性声学处理。

358.(2)根据(1)所述的信号处理设备,

359.其中,所述控制单元基于根据所述感测值而非线性地变化的参数来执行声学处理。

360.(3)根据(2)所述的信号处理设备,

361.其中,所述控制单元基于具有非线性曲线或折线的变换函数来计算与所述感测值相对应的参数,所述变换函数由用户输入。

362.(4)根据(2)所述的信号处理设备,

363.其中,所述控制单元基于由用户从用于从所述感测值获得参数的多个变换函数当中选择的变换函数来计算参数。

364.(5)根据(2)所述的信号处理设备,

365.其中,所述控制单元从用于从所述感测值获得参数的多个变换函数当中选择针对运动的类型确定的变换函数,并且基于所选择的变换函数来计算参数。

366.(6)根据(1)所述的信号处理设备,

367.其中,所述控制单元利用声学处理向声学信号添加动画效果。

368.(7)根据(6)所述的信号处理设备,

369.其中,所述控制单元向声学信号添加针对运动的类型确定的动画效果。

370.(8)根据(6)或(7)所述的信号处理设备,

371.其中,所述控制单元通过如下方式向声学信号添加动画效果:基于所述感测值的波形峰值获得声学处理的参数的初始值,并且在使参数从所述初始值起改变的同时执行声学处理。

372.(9)根据(8)所述的信号处理设备,

373.其中,在执行动画效果期间的动画时间段中的任意时间处与该时间的峰值相对应的参数大于该时间的实际参数的情况下,所述控制单元执行声学处理,以使得基于在以该时间的峰值为基础获得的初始值,向声学信号新添加动画效果。

374.(10)根据(1)至(9)中任一项所述的信号处理设备,

375.其中,声学信号包括由用户演奏的乐器的演奏声音的信号。

376.(11)根据(1)至(9)中任一项所述的信号处理设备,

377.其中,声学信号包括针对运动的类型确定的信号。

378.(12)一种信号处理方法,包括:

379.由信号处理设备:

380.获取指示用户的身体的预定部位的运动或器具的运动的感测值;以及

381.根据所述感测值对声学信号执行非线性声学处理。

382.(13)一种使计算机执行处理的程序,所述处理包括以下步骤:

383.获取指示用户的身体的预定部位的运动或器具的运动的感测值;以及

384.根据所述感测值对声学信号执行非线性声学处理。

385.参考标记列表

386.11 乐器

387.12 可穿戴设备

388.13 信息终端设备

389.21 数据获取单元

390.22 感测值获取单元

391.23 控制单元

392.24 输入单元

393.25 显示单元

394.26 扬声器

395.31 参数计算单元

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。