1.本发明涉及行为检测技术领域,特别是涉及一种课堂行为检测方法。

背景技术:

2.课堂上的师生行为检测时后续教学分析中的重要环节,通过对师生的课堂行为进行检测,有助于提高教学质量。然而,目前大部分学校仍然采用人为巡视的方式对师生的课堂行为进行记录和监督,但是教室众多,仅通过人为巡视并不能有效地解决问题,效率低下且效果不佳。

3.尽管目前随着智慧教室的不断普及,对师生的课堂行为的检测逐步采用自动化检测的方式,即通过在教室内安装摄像机对师生的课堂行为进行采集,并通过人为地观看所采集的图像,这种方式在一定程度上降低了巡视人员的负担。但是,由于教室的位置和布局存在一定的差异,如教室内的光线强度、教室内人员的位置分布等,均有可能对所采集的图像造成影响,从而导致对师生的课堂行为产生误判。

技术实现要素:

4.本发明的主要目的在于提供一种课堂行为检测方法,旨在解决目前对师生的课堂行为检测效果不佳的问题。

5.为实现上述目的,本发明提供的一种课堂行为检测方法包括以下步骤:

6.获取待检测的课堂图像,并对所述待检测的课堂图像进行预处理;

7.将经过预处理的课堂图像输入至学生和/或教师的行为检测模型,从而确定所述学生和/或教师的课堂行为类型。

8.在本技术的一实施例中,获取待检测的课堂图像,并对所述待检测的课堂图像进行预处理,进一步包括以下步骤:

9.将所述待检测的课堂图像进行灰度化处理;

10.采用3

ⅹ

3的拉普拉斯算子对灰度化处理后的待检测的课堂图像进行滤波,并计算所述滤波后的待检测的课堂图像的方差或标准差;

11.将所述方差或标准差与预设的方差阈值或标准差阈值作比较,若所述方差或标准差大于预设的方差阈值或标准差阈值,则进行下一步处理;否则,剔除所述待检测的课堂图像。

12.在本技术的一实施例中,所述学生和/或教师的行为检测模型为预先利用学生和/或教师的行为样本集进行训练获得。

13.在本技术的一实施例中,将经过预处理的课堂图像输入至学生和/或教师的行为检测模型,从而确定所述学生和/或教师的课堂行为类型,进一步包括以下步骤:

14.基于所述经过预处理的课堂图像,确定人脸区域和人体区域,并确定所述人脸区域和所述人体区域之间的映射关系;

15.基于所述人脸区域,确定所述人脸区域所对应的身份信息;

16.基于所述人体区域,确定所述人体区域所对应的行为类型。

17.在本技术的一实施例中,所述人体区域所对应的行为类型至少包括举手、起立、趴桌子、低头和行走中的一者。

18.在本技术的一实施例中,将经过预处理的课堂图像输入至学生和/或教师的行为检测模型,从而确定所述学生和/或教师的课堂行为类型,还包括以下步骤:基于所述人脸区域,确定所述人脸的表情。

19.在本技术的一实施例中,基于所述人体区域,确定所述人体区域所对应的行为类型,进一步包括以下步骤:

20.采用神经网络算法确定所述人体区域;

21.提取所述人体区域内的特征点,并连接所述特征点,得到相应的行为框架;

22.基于所述行为框架,确定所述行为框架所对应的行为类型。

23.在本技术的一实施例中,在提取所述人体区域内的特征点之后,进一步包括以下步骤:

24.统计所述特征点的个数,并将所述特征点的个数与预设的特征点阈值作比较,若所述特征点的个数大于预设的特征点阈值,则进行下一步处理;否则,剔除所述课堂图像。

25.在本技术的一实施例中,基于所述行为框架,确定所述行为框架所对应的行为类型,进一步包括以下步骤:

26.基于所述行为框架,确定所述行为框架所对应的行为姿态;

27.基于连续的课堂图像,确定所述行为姿态的时序,进而确定所述行为框架所对应的行为类型。

28.在本技术的一实施例中,在将经过预处理的课堂图像输入至学生和/或教师的行为检测模型,从而确定所述学生和/或教师的课堂行为类型之后,还进一步包括以下步骤:

29.基于所述学生和/或教师的课堂行为类型,统计目标行为的数量占总行为的数量的比例和/或统计目标表情的数量占总表情的数量的比例;

30.将所述目标行为的数量占总行为的数量的比例与预设的行为阈值进行比较和/或将所述目标表情的数量占总表情的数量的比例与预设的表情阈值进行比较;

31.基于所述比较的结果,分析所述学生和/或教师的课堂行为。

32.本发明具有如下有益效果:

33.1.通过学生和/或教师的行为检测模型对学生和/或教师的课堂行为进行检测和分析,能够准确地、实时地获取和分析学生和教师的课堂行为,且通过计算目标行为和/或目标表情的占比,判断学生的学习效果和/或教师的教学效果,以便后续有针对性地提高教学质量;

34.2.通过采集实时视频并根据预设的截取频率提取课堂图像,以实现学生和/或教师的课堂行为的动态分析,与现有技术中的静态分析相比,具有更高的分析价值;

35.3.通过对课堂行为样本进行预处理,即通过计算课堂行为样本的方差或标准差以对模糊图像进行剔除,有利于提高课堂行为样本的可信度,进而提高学生和/或教师的行为检测模型的检测精度。

附图说明

36.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的示例性的实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图示出的结构获得其他的附图,其中:

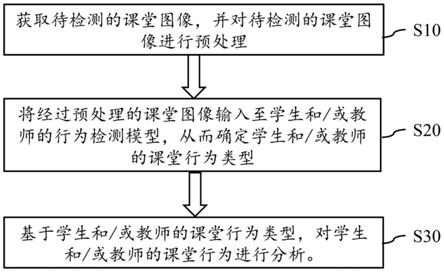

37.图1为本发明实施例一种课堂行为检测方法的流程示意图。

具体实施方式

38.下面将结合附图对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明的示例性的实施例,而不是唯一的实施例。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

39.如图1所示,本发明提供的一种课堂行为检测方法包括以下步骤:

40.s10获取待检测的课堂图像,并对待检测的课堂图像进行预处理。

41.具体地,在教室内预先部署一个或多个图像采集装置,如摄像机。当部署的摄像机数量较少时,摄像机优选地朝向教室内学生和/或教师的人脸设置。通过图像采集装置采集教室内的实时视频,并根据预设的帧数提取相应的课堂图像作为待检测的课堂图像。

42.s11将待检测的课堂图像进行灰度化处理。

43.具体地,采用现有技术的灰度化处理对待检测的课堂图像进行处理,以提高待检测的课堂图像的特征的精度,以及便于后续对待检测的课堂图像进行进一步的处理。

44.其中,通过教室内预先部署的图像采集装置采集教室内的实时视频,并对实时视频进行解码处理,根据预设的帧数提取相应的课堂图像,此时所提取的课堂图像即为待检测的课堂图像。通过根据预设的帧数提取相应的课堂图像,在保障对待检测的课堂图像进行分析的准确性的同时,在一定程度上减轻图像处理和存储的压力。

45.s12采用3

ⅹ

3的拉普拉斯算子对灰度化处理后的待检测的课堂图像进行滤波,并计算滤波后的待检测的课堂图像的方差或标准差;将方差或标准差与预设的方差阈值或标准差阈值作比较,若方差或标准差大于预设的方差阈值或标准差阈值,则进行下一步处理,即将经过预处理的课堂图像输入至学生和/或教师的行为检测模型,从而确定学生和/或教师的课堂行为类型;否则,剔除该待检测的课堂图像。

46.具体地,由于是基于图像采集装置所采集的实时视频进行课堂图像的提取,未免会出现因为学生和/或教师作出行为而造成图像采集装置所采集的部分图像清晰度不够,采用步骤s12对课堂图像进行处理,在一定程度上,可以筛选出模糊的图像,并将其剔除,从而提高后续对待检测的课堂图像的检测精度和效率。其中,方差阈值和/或标准差阈值可以根据实际情况进行设置。

47.s20将经过预处理的课堂图像输入至学生和/或教师的行为检测模型,从而确定学生和/或教师的课堂行为类型。

48.具体地,学生和/或教师的行为检测模型采用现有技术的faster rcnn模型或ssd模型。学生和/或教师的行为检测模型为预先利用学生和/或教师的行为样本集进行训练获得,学生和/或教师的行为样本集的处理分析方法与下述对待处理的课堂图像的处理分析

方法相同。优选地,基于图像采集装置所采集的课堂图像,建立学生和/或教师的行为样本集,还可以对所提取的课堂图像进行数据增广。

49.s21基于经过预处理的课堂图像,确定人脸区域和人体区域,并确定人脸区域和人体区域之间的映射关系。

50.具体地,由于本发明的目的主要是采集并分析学生和/或教师的课堂行为,所以需要通过确定人脸区域与人体区域之间的映射关系,以便于后续确认某个动作来自于哪位学生或教师。

51.s22基于人脸区域,确定人脸区域所对应的身份信息。

52.具体地,预先构建存有学生和/或教师的人脸数据库,将人脸区域内的人脸信息与人脸数据库内的人脸信息进行匹配,若匹配成功,即可确认该人脸区域内的人脸的身份信息,并将身份信息作为标签记录于对应的待检测的课堂图像中,否则,则在对应的待检测的课堂图像中记录其他标签,如“未知”、“待确认”等。

53.s23基于人体区域,确定人体区域所对应的行为类型。

54.具体地,人体区域所对应的行为至少包括举手、起立、趴桌子、低头和行走中的一者。确定人体区域所对应的行为类型,进一步包括以下步骤:提取人体区域内的特征点,并连接特征点,得到相应的行为框架,根据行为框架,确认行为类型。

55.优选地,在提取人体区域内的特征点后,统计特征点的个数,并将特征点的个数与预设的特征点阈值作比较,若特征点的个数大于预设的特征点阈值,则进行下一步处理;否则,剔除该待检测的课堂图像。由于特征点较少时,连接特征点的难度较大,且得到的行为框架难以有效地反映行为类型,所以通过特征点的个数为条件,进一步剔除精度不高的待检测的课堂图像,进而提高课堂行为采集和检测的准确率。特征点阈值根据实际情况设定。

56.优选地,由于课堂上学生和/或教师往往处于运动状态,若仅仅通过判断单张待检测的课堂图像,准确率不高,如当该待检测的课堂图像中的学生的手处于斜向前举起时,难以判断,该学生此时是正在举手还是把手放下。为了更准确的采集学生和/或教师的行为,本实施例通过确定行为框架所对应的行为姿态,并基于连续的待检测的课堂图像,确定行为姿态的时序,进而确定行为框架所对应的行为类型。

57.s24基于人脸区域,确定人脸的表情。

58.具体地,表情能够较好地反映当前学生和/或教师的状态,如走神等。通过确定人脸的表情,为后续对学生和/或教师的课堂行为的分析提供更充分的证据。

59.s30基于学生和/或教师的课堂行为类型,对学生和/或教师的课堂行为进行分析。

60.s31基于学生和/或教师的课堂行为类型,统计目标行为的数量占总行为的数量的比例和/或统计目标表情的数量占总表情的数量的比例。

61.具体地,目标行为可以为趴桌子、低头等,目标表情可以为皱眉等,通过统计目标行为的数量占总行为的数量的比例和/或统计目标表情的数量占总表情的数量的比例,可以大致了解学生的学习情况,如学生对该课程或教师是否感兴趣等。

62.s32将目标行为的数量占总行为的数量的比例与预设的行为阈值进行比较和/或将目标表情的数量占总表情的数量的比例与预设的表情阈值进行比较。

63.具体地,由于不同的课程对学生的课堂行为的要求有所不同,比如音乐等艺术类课程往往要求学生和教师尽可能多的互动,而数学等课程则往往更多时间是学生听教师讲

课,所以预设的行为阈值和表情阈值根据科目等实际情况设定。

64.s33基于比较的结果,分析学生和/或教师的课堂行为。

65.具体地,根据比较的结果,能够有效地对学生和/或教师的课堂行为进行分析。优选地,还可结合其他的学生的学习数据和/或教师的教学数据进行分析,如学生成绩等。

66.以上所述仅是本发明的优选实施方式,本发明的保护范围并不仅局限于上述实施例,凡属于本发明思路下的技术方案均属于本发明的保护范围。应当指出,对于本领域的普通技术人员来说,在不脱离本发明原理前提下的若干改进和润饰,这些改进和润饰也应视为本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。