1.本发明涉及自动化制鞋技术领域,尤其是涉及一种基于鞋型特征曲线提取的鞋底自动涂胶方法。

背景技术:

2.涂胶是制鞋领域的重要环节之一,在传统的手工制鞋操作中,鞋胶在加热的过程中会挥发出有害甚至有毒气体,影响了工人的身体健康,同时也给他们造成了无法逆转的职业危害。由于制鞋车间通常温度较高,操作工人在车间长时间工作容易产生疲劳,同时涂胶质量也跟其技术熟练程度有着重要关系。因此,以机器人涂胶为代表的自动化制鞋技术逐渐成为制鞋行业发展的必然趋势。

3.目前由于立体视觉系统的匮乏和操作工人技术水平限制,机器人尚未在制鞋行业得到大规模的应用,制鞋行业的大部分工序包括涂胶等仍然处于手工操作的阶段。

技术实现要素:

4.本发明的目的在于提供一种基于鞋型特征曲线提取的鞋底自动涂胶方法,以解决现有技术中手工涂胶方式对人体造成职业危害以及涂胶质量不高的问题。

5.为解决上述问题,本发明提供一种基于鞋型特征曲线提取的鞋底自动涂胶方法,具体包括以下步骤:

6.s1:标定相机视觉系统,基于所述相机视觉系统建立鞋底rgb-d图与鞋体在世界坐标系下的空间变换关系;

7.s2:利用所述相机视觉系统采集鞋底的rgb-d图,并对鞋底数据进行扩增形成鞋底数据集合;

8.s3:根据所述鞋底数据集合,并结合深度卷积神经网络模型提取所述鞋底的特征曲线;

9.s4:基于提取的鞋型特征曲线,获取涂胶路径曲线;

10.s5:对所述涂胶路径曲线进行离散,拾取自动涂胶路径点,生成自动涂胶路径。

11.进一步的,所述步骤s1中的相机视觉系统采用结构光视觉测量系统,所述相机视觉系统包括被测量的鞋体、相机和激光器,步骤s1得到被测量的鞋体、相机和激光器之间的空间变换关系的具体步骤包括:

12.s101:获取多组鞋体在世界坐标系中的三维坐标以及在像素坐标系中的像素坐标,对相机视觉系统进行标定,获得相机的内参数和外参数;

13.s102:对激光器产生的激光平面进行标定,确定成像平面上特征点的空间坐标,得到鞋体、相机和激光器之间的空间变换关系。

14.进一步的,所述步骤s102中采用立体标靶方法对所述激光平面进行标定,其具体方法为:

15.将所述立体标靶的八个顶点作为参考点,拟合出激光平面方程;获取相机成像平

面上多个特征点的坐标,并结合所述激光平面方程,得到激光平面在相机坐标系下的三坐标轴参数;获取由所述激光平面投射在成像平面上形成的激光条纹上的激光条纹点在成像平面上的坐标,结合所述激光平面方程以及激光条纹点的坐标,得到该激光条纹点在相机坐标系下的坐标,进而得到鞋体、相机和激光器之间的空间转换关系。

16.进一步的,在步骤s101中,所述相机的内参数和外参数由如下公式计算得到:

[0017][0018]

其中:(xw,yw,zw)为被测量鞋体在世界坐标系中的三维坐标,(u,v)为被测量鞋体在像素坐标系中的坐标;为相机的外参数矩阵;

[0019]

在步骤s102中,所述激光条纹点对应的空间点在相机坐标系下的坐标可表示为:

[0020][0021]

其中:(xc,yc,zc)为激光条纹点对应的空间点在相机坐标系下的坐标(也即激光平面上的点在相机坐标系下的三坐标轴上的坐标);(xi,yi,zi)为激光条纹上的激光条纹点pi在相机成像平面(也即相机视觉系统的归一化成像面)上的坐标。

[0022]

进一步的,所述步骤s2获得鞋底数据集合的具体方法为:

[0023]

利用标定完成后的相机视觉系统采集不同鞋底的rgb-d图,并对每一rgb-d图中鞋底的鞋型特征曲线进行标注,得到含有若干标注了鞋型特征曲线的rgb-d图样本库;

[0024]

采用滑动窗口算法对所述rgb-d图样本库中的每一样本进行滑动采样,以对鞋底数据进行扩增,得到鞋底数据集合。

[0025]

进一步的,在步骤s3中,采用基于segnet网络的深度卷积神经网络模型进行鞋型特征曲线的提取,其具体步骤为:

[0026]

s301:将所述鞋底数据集合划分为训练集和测试集;

[0027]

s302:将训练集输入所述深度卷积神经网络模型,对鞋型特征曲线进行识别,并将识别出的鞋型特征曲线反向传递至深度卷积神经网络模型中进行模型训练;

[0028]

s303:将测试集输入训练好的深度卷积神经网络模型中,测试所述深度卷积神经网络模型的提取精度,实现鞋型特征曲线的提取。

[0029]

进一步的,所述基于segnet网络的深度卷积神经网络模型的网络结构包含呈对称结构的编码器和解码器,所述编码器具有4层上采样层,所述解码器具有4层下采样层;且所述网络结构的左侧采用vgg-16的前10层卷积网络用于提取特征并保存池化编号,所述网络结构的右侧采用反卷积与去采样过程重现图像特征。

[0030]

进一步的,所述深度卷积神经网络模型在激活层的每一卷积层上还包括有一批标准化层,且在最后一卷积层上具有softmax层,以计算鞋底rgb-d图中每一像素在所有类别中的最大概率,完成像素级别分类,进而提取鞋型特征曲线。

[0031]

进一步的,所述步骤s4获取涂胶路径曲线的具体方法为:

[0032]

设置涂胶间距,并以所述涂胶间距为基准拾取所述特征曲线的左、右两侧相对位置的点对,从而获取每对点对之间的连线形成所述涂胶路径曲线。

[0033]

进一步的,所述步骤s5生成自动涂胶路径的具体方法为:

[0034]

分别计算每一涂胶路径曲线的总体曲率值,并设定曲率误差阈值;

[0035]

沿鞋底长度方向依次对每一涂胶路径曲线按照其曲线的总体曲率值进行离散,得到若干路径点;

[0036]

对于每一涂胶路径曲线,以该涂胶路径曲线的起始路径点开始迭代计算每一路径点的曲率值,并判断该路径点的曲率值与总体曲率值的误差是否在曲率误差范围内,若不在,则该点为非拾取点,若在,则该点为拾取点,将所述拾取点依次存入路径点集合,并对拾取点进行编号生成自动涂胶轨迹。

[0037]

本发明通过对相机视觉系统进行标定得到鞋底rgb-d图与其在世界坐标系中的对应关系,可对鞋底的rgb-d图进行采集,得到鞋体的三维空间位置;并利用深度卷积神经网络模型提取鞋底的鞋型特征曲线进行提取,基于鞋型特征曲线获取涂胶路径曲线,最后对涂胶路径曲线进行离散,拾取自动涂胶路径点,生成机器人的自动涂胶轨迹,工作效率高,且涂胶质量能够得到保证。

附图说明

[0038]

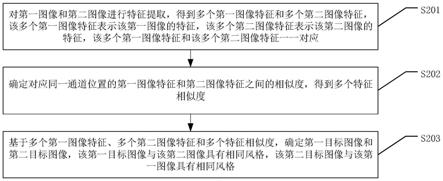

图1为本发明基于鞋型特征曲线提取的鞋底自动涂胶方法的流程图。

[0039]

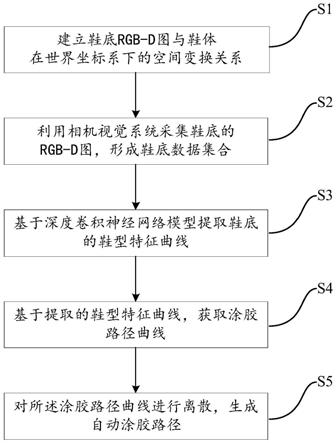

图2为步骤s1的流程图。

[0040]

图3为步骤s2中鞋型特征曲线的标注示意图。

[0041]

图4为步骤s3的流程图。

[0042]

图5为步骤s4中涂胶路径曲线的示意图。

具体实施方式

[0043]

下面结合附图对本发明作进一步说明。

[0044]

如图1所示,为本发明基于鞋型特征曲线提取的鞋底自动涂胶方法的流程图,具体包括以下步骤:

[0045]

s1:建立鞋底rgb-d图与鞋体在世界坐标系下的空间变换关系。

[0046]

具体的,构建相机视觉系统,在本实施例中,所述相机视觉系统采用结构光视觉测量系统,所述结构光视觉测量系统包括被测量的鞋体、相机和激光器。所述结构光视觉测量系统根据三角测量原理和立体标靶方法求取鞋体的三维空间坐标,进而得到被测量的鞋体、相机和激光器的空间变换关系,从而得到被测量鞋体的三维空间位置。

[0047]

如图2所示,所述步骤s1包括以下步骤:

[0048]

s101:标定相机视觉系统,获得相机的内参数和外参数。

[0049]

具体的,获取多组鞋体在世界坐标系中的三维坐标以及在像素坐标系中的像素坐标,对相机的内参数和外参数进行标定。假设所述相机的内参数为包括焦距和像素等变量的相机模型,根据获取的鞋体在世界坐标系中的三维坐标以及在像素坐标系中的像素坐标,采用线性标定方法对所述相机视觉系统进行标定,可得到所述鞋体在像素坐标系与世界坐标系下的数学转换关系:

[0050][0051]

其中:(xw,yw,zw)为被测量鞋体在世界坐标系中的三维坐标,(u,v)为被测量鞋体在像素坐标系中的坐标;为相机的外参数矩阵。

[0052]

上述公式(1)中被测量鞋体在世界坐标系中的三维坐标和其在像素坐标系中的坐标已知,通过获取多组鞋体在世界坐标系中的三维坐标和其在像素坐标系中的坐标,联立上述方程组(1)即可获得所述相机的外参数矩阵。

[0053]

s102:标定激光平面,得到鞋体、相机和激光器之间的空间变换关系。

[0054]

对激光器产生的激光平面进行标定,确定成像平面上特征点的空间坐标,得到鞋体、相机和激光器之间的空间变换关系。在本实施例中,采用立体标靶方法对所述激光平面进行标定,所述立体标靶可视为一立方体。

[0055]

具体的,将所述立体标靶的八个顶点作为参考点,拟合出激光平面方程:

[0056]

axc byc czc 1=0

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(2)

[0057]

其中:(xc,yc,zc)为激光平面上的点在相机坐标系下的三坐标轴上的坐标,a,b,c为激光平面在相机坐标系下的三坐标轴参数。

[0058]

获取相机的成像平面上形成的鞋体图像上的多个特征点的坐标,带入上述激光平面方程,联立计算得到该激光平面在相机坐标系下的三坐标轴参数。

[0059]

由于所述相机的成像平面上的特征点同样位于激光平面上,且位于所述激光平面投射在立体标靶的两个面上形成的激光条纹上,因此可通过激光平面方程与所述激光条纹的直线方程计算得到该激光条纹上的激光条纹点(也即特征点)对应的空间点在相机坐标系下的坐标:

[0060][0061]

其中:(xc,yc,zc)为激光条纹点对应的空间点在相机坐标系下的坐标(也即激光平面上的点在相机坐标系下的三坐标轴上的坐标);(xi,yi,zi)为激光条纹上的激光条纹点pi在相机成像平面(也即相机视觉系统的归一化成像面)上的坐标。

[0062]

所述公式(3)中的激光条纹点pi的坐标可根据空间点在像素坐标系中的坐标(u,v)通过缩放得到,进而求得所述特征点在相机坐标下的坐标,得到鞋体、相机和激光器之间的空间转换关系。

[0063]

在本实施例中,通过求解相机的成像平面上的特征点在在相机坐标下的坐标以及相机的内参数和外参数,即通过相机视觉系统采集到的鞋体的rgb-d图求解图像上的特征点,进而得到鞋体的表面轮廓。

[0064]

s2:利用相机视觉系统采集鞋底的rgb-d图,形成鞋底数据集合。

[0065]

具体的,首先,利用步骤s1中标定完成的相机视觉系统,采集不同鞋底的rgb-d图,并对rgb-d图中的鞋型特征曲线a进行人工标注,所述鞋型特征曲线a标注如图3所示,得到

含有若干标注了鞋型特征曲线a的rgb-d图样本库。

[0066]

然后,采用滑动窗口算法对所述rgb-d图样本库中的每一样本进行滑动采样,以此来对鞋底数据进行扩增,得到鞋底数据集合。在本实施例中,所述滑动窗口的大小固定,如480*360。

[0067]

s3:基于深度卷积神经网络模型提取鞋底的鞋型特征曲线a。

[0068]

根据步骤s2中得到的鞋底数据集合,对深度卷积神经网络模型进行训练,并利用训练好的深度卷积神经网络模型来对生产线上待加工鞋体的鞋型特征曲线a进行识别和提取。

[0069]

如图4所示,步骤s3的具体步骤如下:

[0070]

s301:将鞋底数据集合划分为训练集和测试集。

[0071]

将所述鞋底数据集合中的鞋型特征数据随机划分为训练集和测试集,所述训练集用于对深度卷积神经网络模型进行模型训练,所述测试集用于测试深度卷积神经网络模型的预测精度。

[0072]

s302:对深度卷积神经网络模型模型进行训练。

[0073]

将训练集输入所述深度卷积神经网络模型中,对鞋型特征曲线a进行识别,并将识别出的鞋型特征曲线a反向传递至深度卷积神经网络模型中进行迭代,直到达到最大迭代次数或损失函数不再变化为止,完成模型训练,得到训练好的深度卷积神经网络模型,以对生产线上的待加工鞋体的鞋底的鞋型特征曲线进行识别和提取。

[0074]

在本实施例中,所述深度卷积神经网络基于segnet网络实现,所述segnet网络的网络结构包括编码器和解码器,所述编码器具有4层上采样层,所述解码器具有4层下采样层,且编码器与解码器之间呈对称结构设置,所述网络结构的左侧采用vgg-16的前10层卷积网络(所述网络结构的左侧即对应所述编码器),用于提取特征并保存池化编号,所述网络结构的右侧采用反卷积与去采样过程(所述网络结构的右侧即对应所述解码器),用于重现图像特征;所述深度卷积神经网络模型在激活层的每一卷积层上还包括有一批标准化层,以将特征信息进行标准化处理后用于计算所述深度卷积神经网络模型当前的学习率;且在最后一卷积层上具有softmax层,用于对特征信息对应的像素级别进行分类,进而实现鞋型特征曲线a的提取。具体的,所述编码器的每一上采样层在对训练集中的特征曲线数据进行卷积、激活、批标准化、最大池化操作后提取出每一特征曲线数据所包含的特征信息,然后将提取的特征信息输入解码器中与之一一对应的下采样层进行特征拼接、反卷积、激活和批标准化处理后输入softmax层中,softmax层进一步计算出鞋底rgb-d图中特征信息对应的每一像素在所有像素类别中的最大概率,将该最大概率设置为该像素的标签,以对每一特征信息对应的像素级别进行分类,从而提取出鞋型特征曲线a。在本实施例中,所述激活层对应的激活函数采用非线性激活函数relu函数,其表达式为:

[0075]

f=max(0,t)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(4)

[0076]

其中:f为激活层的输出,t为输入激活层的特征信息。

[0077]

s303:测试深度卷积神经网络模型的预测精度,提取鞋型特征曲线a。

[0078]

具体的,将测试集中的鞋型特征数据输入训练好的深度卷积神经网络模型中进行鞋型特征曲线a的提取,对比通过所述深度卷积神经网络模型提取出的鞋型特征曲线a与实际的人工手动标注的鞋型特征曲线a之间的差异,判断该经过训练的深度卷积神经网络模

型对鞋型特征曲线a的识别和提取是否达到预先设定的识别精度和速度等技术指标。在本实施例中,所述技术指标可根据具体的生产加工需求设定,在此不作限定。

[0079]

若深度卷积神经网络模型识别和提取的鞋型特征曲线a能达到对应的技术指标,则完成模型训练,并将相机视觉系统采集到的生产线上鞋底的rgb-d图输入深度卷积神经网络模型中进行鞋型特征曲线a的提取。若不能达到技术指标,则修改深度卷积神经网络模型的参数继续利用训练集对深度卷积神经网络模型进行训练,直至其识别和提取到的鞋型特征曲线a能达到对应的技术指标为止。

[0080]

s4:基于提取的鞋型特征曲线a,获取涂胶路径曲线b。

[0081]

如图5所示,设置涂胶间距;在本实施例中,所述涂胶间距为涂胶位置之间的间隔具体,通常根据实际生产加工中的经验值所确定。然后以设置的涂胶间距为基准拾取所述鞋型特征曲线a的左、右两侧相对位置的点对c,并以各点对c为依据获取各点对之间的连线以形成可近似为相互平行的涂胶路径曲线b。

[0082]

s5:对所述涂胶路径曲线b进行离散,生成自动涂胶路径。

[0083]

具体的,分别计算每一涂胶路径曲线b的总体曲率值q,并设定曲率误差阈值ε,所述曲率误差阈值ε可根据加工质量的精度要求设定,一般为其值较小。沿鞋底长度方向依次对每一涂胶路径曲线b按照其曲线的总体曲率值q进行离散,得到若干路径点{1,2,...,n}(其中:n=1,2,...,n,n为对应涂胶路径曲线b离散后得到的路径点的数量)。判断各路径点是否为拾取点,进行将得到的所有拾取点进行编号生成对应的自动涂胶轨迹。在判断路径点是否为拾取点时,对于每一涂胶路径曲线b,以涂胶路径曲线b的起始路径点(所述起始路径点为所述鞋型特征曲线上拾取到的点对c中的任一一点)开始迭代计算该涂胶路径曲线b上每一路径点n的曲率值kn,并判断该路径点的曲率值kn与总体曲率值q的误差是否在曲率误差范围ε内:

[0084]

当q-kn》ε时,说明该路径点的曲率值kn与总体曲率值q的误差不在所述曲率误差范围ε规定的范围内,则该路径点为非拾取点,需舍弃。

[0085]

当q-kn≤ε时,说明该路径点的曲率值kn与总体曲率值q的误差在所述曲率误差范围ε规定的范围内,则该路径点为拾取点,并将认定为拾取点的路径点依次存入路径点集合中,依次类推,直至所有涂胶路径曲线b对应的路径点均已处理,然后将路径点集合中的路径点按存入顺序进行编号生成自动涂胶轨迹,以实现机器人的对鞋底的自动涂胶。

[0086]

本发明通过对相机视觉系统采集鞋底的rgb-d图,能够还原待加工鞋体在生产线上的三维空间位置,并利用深度卷积神经网络模型对rgb-d图中鞋体的鞋型特征曲线a进行识别和提取,最后根据识别和提取出的鞋型特征曲线a进行涂胶路径曲线b的获取及离散,生成机器人的自动涂胶轨迹,有效提高了鞋底涂胶的加工精度和交工效率,并且整个过程均可由机器人自动完成,避免了鞋胶等在加工过程中挥发出有害甚至有毒气体影响工人的身体健康,降低了工人职业危害的风险。

[0087]

需要说明的是,在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。以上仅为本发明的实施方式,并非因此限制本发明的专利范围,凡是利用本发明说明书及附图内容所作的等效结构,直接或间接运用在其他相关的技术领域,均同理在本发明的专利保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。