1.本发明涉及自动紧急制动技术领域,尤其涉及一种毫米波雷达与视觉识别目标的融合方法和系统。

背景技术:

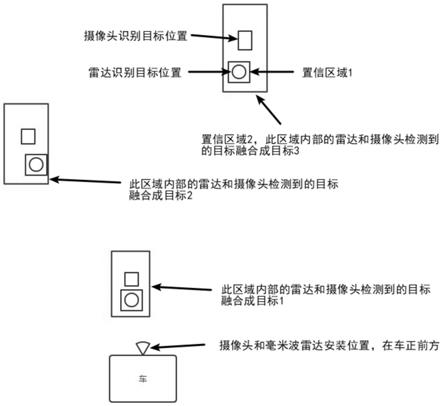

2.当前自动紧急制动系统(aebs)设计方案大多通过雷达和摄像头两种传感器,对识别到的目标通过融合,得到障碍物的位置,如图1所示。摄像头在识别目标的时候,目标的运动速度以及距离对摄像头的识别造成很大偏差。摄像头和雷达融合如果不考虑摄像头和雷达在运动或者距离的因素导致的识别偏差,就有可能会使得有些雷达和摄像头识别是同一个物体,却不能通过融合成同一个目标,导致虚目标的出现,如图2所示。

技术实现要素:

3.有鉴于现有技术的上述缺陷,本发明的目的是提供一种毫米波雷达与视觉识别目标的融合方法和系统,可减少虚目标的出现,提高对目标的识别精度。

4.为实现上述目的,本发明提供了一种毫米波雷达与视觉识别目标的融合方法,包括以下步骤:

5.获取多个第一目标点和多个第二目标点的数据信息,所述数据信息包括目标点的纵向距离信息和横向距离信息,其中纵向表示车辆的行进方向;所述第一目标点代表毫米波雷达传感器探测到的目标物,所述第二目标点代表摄像头探测到的目标物;

6.以所述第一目标点为中心以设定的绝对阈值做纵向和横向扩展,形成第一置信区间;以所述第二目标点为中心以相对阈值做纵向扩展和横向扩展形成第二置信区间;所述相对阈值的大小是与第二目标点的距离和速度呈线性关系;

7.执行km算法进行融合,将尽可能多的毫米波雷达探测到的第一目标点和摄像头探测到的第二目标点一对一关联为同一目标物:根据所述第一目标点、所述第二目标点的距离远近,由近及远,选取一个第一目标点和一个第二目标点进行比对;当所述第一目标点处于所述第二目标点的第二置信区间或所述第二目标点处于所述第一目标点的第一置信区间,则认为所述第一目标点和所述第二目标点是同一目标物。

8.进一步地,所述第一置信区间是以第一目标点(x

l

,y

l

)为中心,以r

δ

做纵向和横向扩展所在矩形区域。

9.进一步地,所述第二置信区间是以第二目标点(x

c,

y

c

)为中心,以(x

min

,y

min

)、(x

max

,y

max

)为对角点的矩形区域,所述(x

min

,y

min

)、(x

max

,y

max

),通过如下公式获得:

10.x

max

=x

c

x

δ

×

x

c

11.x

min

=x

c

‑

x

δ

×

x

c

12.y

max

=y

c

y

δ

×

y

c

13.y

min

=y

c

‑

y

δ

×

y

c

14.其中,x

δ

表示摄像头测距的x轴偏差百分比阈值;y

δ

表示摄像头测距的y轴偏差百分

比阈值。

15.进一步地,所述x

δ

、y

δ

为常量,所述x

δ

为不小于在设定的测距区间的x轴偏差百分比测量值的最大值的某个值;所述y

δ

为不小于在设定的测距区间的y轴偏差百分比测量值的最大值的某个值。

16.进一步地,所述x

δ

、y

δ

的取值为变量,所述x

δ

、y

δ

的计算公式为:

17.x

δ

=k1×

y

c

k3×

v c118.y

δ

=k2×

y

c

k4×

v c219.其中,y

c

为摄像头与目标的纵向距离,v表示当前车速,k1、k2、k3、k4、c1、c2为拟合系数。

20.进一步地,所述融合方法还包括:根据融合结果,将毫米波雷达探测到的该目标物的纵向距离、横向距离和速度、摄像头探测到的该目标物的类别组合作为该目标物的目标级数据信息。

21.本发明还提出了一种毫米波雷达与视觉识别目标的融合系统,包括毫米波雷达、摄像头和融合处理器;所述融合处理器同步接收所述毫米波雷达和所述摄像头探测到的目标物信息,并执行如上的毫米波雷达与视觉识别目标的融合方法,将所述毫米波雷达探测的目标物和所述摄像头探测的目标物进行关联。

22.本发明实现了如下技术效果:本发明通过研究速度和距离对摄像头及雷达识别目标的影响,将摄像头识别目标的置信区间根据速度、距离的百分比方式进行设定,从而在km融合时,对摄像头测距目标的置信区间根据距离、速度进行自适应调整,从而提高目标融合效果,减少虚目标的产生。

附图说明

23.图1是车辆毫米波雷达、摄像头与目标的位置示意图;

24.图2是现有车辆毫米波雷达、摄像头识别目标的km融合结果示意图;

25.图3是车辆静止时,雷达识别目标的x轴偏差值和纵向距离关系的测试样本;

26.图4是车辆静止时,雷达识别目标的y轴偏差值和纵向距离关系的测试样本;

27.图5是车运动时,雷达识别目标的x轴偏差值和纵向距离关系的测试样本;

28.图6是车运动时,雷达识别目标的y轴偏差值和纵向距离关系的测试样本;

29.图7是摄像头识别目标的x轴偏差值和纵向距离关系的测试样本;

30.图8是摄像头识别目标的y轴偏差值和纵向距离关系的测试样本;

31.图9是摄像头识别目标的x轴偏差值和速度关系的测试样本;

32.图10是摄像头识别目标的y轴偏差值和速度关系的测试样本;

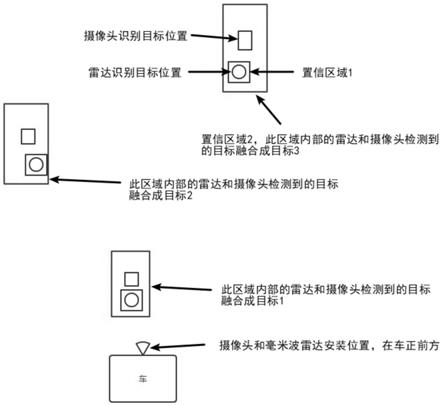

33.图11是本发明的雷达和摄像头识别目标的km融合示意图;

34.图12是本发明的毫米波雷达与视觉识别目标的融合系统。

具体实施方式

35.为进一步说明各实施例,本发明提供有附图。这些附图为本发明揭露内容的一部分,其主要用以说明实施例,并可配合说明书的相关描述来解释实施例的运作原理。配合参考这些内容,本领域普通技术人员应能理解其他可能的实施方式以及本发明的优点。图中

的组件并未按比例绘制,而类似的组件符号通常用来表示类似的组件。

36.现结合附图和具体实施方式对本发明进一步说明。

37.本发明提出了一种毫米波雷达与视觉识别目标的融合方法,用于将车辆的毫米波雷达与车载摄像头的识别的目标进行关联。

38.首先对车载毫米波雷达和摄像头的测距性能进行标定。

39.如图3到图6所示,选取一个普通的车载毫米波雷达,在一设定的车辆紧急制动范围(如0

‑

160米)内进行测距误差标定。经实验标定,车辆在静止时和行驶时,雷达识别到的目标的x轴偏差值(车辆横摆方向)和y轴偏差值(车辆行进方向)的绝对值均在1米以内,可以用绝对偏差值表示雷达测距的x轴偏差值阈值和y轴偏差值阈值,且在设定的速度区间,速度对雷达测距的影响可忽略不计。通过实验数据统计,可以设置偏差值的置信区间,如95%,即有95%的雷达测试数据的偏差值小于设定的偏差值阈值。可以设置这个偏差值阈值为r

δ

=1(单位:米),假设雷达识别到的目标位置为(x

l

,y

l

),则真实目标位置的置信区间为以(x

l

,y

l

)为中心,以r

δ

做纵向和横向扩展所在矩形区域。

40.同样,如图7到图10所示,选取一车用摄像头,在0

‑

160米范围内进行测距误差测定。经实验测定,摄像头目标识别的偏差值会随距离的增加而加大,该偏差值适合用偏差百分比表示。实施例中,摄像头识别到的目标x轴偏差百分比和目标y轴偏差百分比在0

‑

8%之间,换算成绝对偏差值,则在100米距离处,其绝对偏差值可达数米。

41.因此,在标定时,可以统计在设定的测距区间(如0

‑

160米),该摄像头或该类摄像头测距的x轴偏差百分比的最大值;选取不小于该x轴偏差百分比的最大值的某个值作为x轴偏差百分比阈值;同理,在标定时,可以统计在设定的测距区间(如0

‑

160米),该摄像头或该类摄像头测距的y轴偏差百分比的最大值;选取不小于该y轴偏差百分比的最大值的某个值作为y轴偏差百分比阈值。

42.如图9和图10所示,车速对测距的x轴误差、y轴偏差也有一定的影响,但影响较小。

43.进一步的,如图7到图10的实验数据所示,受算法精度影响,摄像头测距的偏差百分比会随距离、速度的增加而加大,此时,通过线性拟合,得到摄像头测距的x轴偏差百分比和y轴偏差百分比和距离的线性方程,及得到摄像头测距的x轴偏差百分比和y轴偏差百分比和速度的线性方程,通过两线性方程,确定摄像头测距的x轴偏差百分比和y轴偏差百分比和距离、速度的线性方程,再通过设置置信度(如95%或100%),调整线性方程中的常数,确定摄像头测距的x轴偏差百分比阈值和y轴偏差百分比阈值,这样设定的阈值精度更高。

44.摄像头测距的x轴偏差百分比阈值和y轴偏差百分比阈值和距离的线性方程如下:

45.x1=k1×

d b146.y1=k2×

d b247.其中,d为目标距离,k1、k2、b1、b2均为拟合常数,为正实数。

48.摄像头测距的x轴偏差百分比阈值和y轴偏差百分比阈值和速度的线性方程如下:

49.x2=k3×

v b350.y2=k4×

v b451.其中,v为车速,k3、k4、b3、b4均为拟合常数,为正实数。

52.则摄像头测距的x轴偏差百分比阈值和y轴偏差百分比阈值和距离、速度的线性方程可以表示为:

53.x

δ

=x1 x2=k1×

d k3×

v b554.y

δ

=y1 y2=k2×

d k4×

v b655.其中,b5、b6均为拟合常数,为正实数。

56.从图7到图10可以看出,在纵向距离处于0

‑

160米区间,摄像头测距的x轴及y轴误差百分比均从约2%逐步增加到约8%,在车速处于10

‑

100公里/小时的区间,摄像头测距的x轴偏差值从0.05米增大到约0.22米;摄像头测距的y轴偏差值从0.2米增加到1.9米,因此,通过拟合曲线并计算可得,参数k1为3.2%/米,参数k3为3.9%/米,参数k2为0.018小时/公里,参数k4为0.20小时/公里。

57.假设摄像头测距目标的位置为(x

c,

y

c

),则真实目标位置的置信区间为以(x

min

,y

min

)、(x

max

,y

max

)为对角点的矩形区域,其中:

58.x

max

=x

c

x

δ

×

x

c

59.x

min

=x

c

‑

x

δ

×

x

c

60.y

max

=y

c

y

δ

×

y

c

61.y

min

=y

c

‑

y

δ

×

y

c

62.因此,摄像头和毫米波雷达融合需要考虑摄像头和雷达在运动或者距离的因素导致的识别偏差,将毫米波雷达和摄像头识别到同一个目标物,通过融合形成同一目标物,以将毫米波雷达探测到的该目标物的纵向距离、横向距离和速度、摄像头探测到的该目标物的类别组合作为该目标物的目标级数据信息。

63.为此,本发明提出了一种毫米波雷达与视觉识别目标的融合方法,包括以下步骤:

64.获取多个第一目标点和多个第二目标点的数据信息,所述数据信息包括目标点的纵向(y轴)距离信息和横向(x轴)距离信息,其中纵向(y轴)表示车辆的行进方向;所述第一目标点代表毫米波雷达传感器探测到的目标物,所述第二目标点代表摄像头探测到的目标物;

65.以所述第一目标点为中心以设定的绝对阈值做纵向和横向扩展,形成第一置信区间;以所述第二目标点为中心以相对阈值做纵向扩展和横向扩展形成第二置信区间;所述相对阈值的大小是与第二目标点的距离和速度呈线性关系;

66.执行km算法进行融合,将尽可能多的毫米波雷达探测到的第一目标点和摄像头探测到的第二目标点一对一关联为同一目标物:根据所述第一目标点、所述第二目标点的距离远近,由近及远,选取一个第一目标点和一个第二目标点进行比对;当所述第一目标点处于所述第二目标点的第二置信区间或所述第二目标点处于所述第一目标点的第一置信区间,则认为所述第一目标点和所述第二目标点是同一目标物;

67.根据融合结果,将毫米波雷达探测到的该目标物的纵向距离、横向距离和速度、摄像头探测到的该目标物的类别组合作为该目标物的目标级数据信息。

68.在本实施例中,所述第一置信区间是以第一目标点(x

l,

y

l

)为中心,以r

δ

做纵向和横向扩展所在矩形区域。

69.在本实施例中,所述第二置信区间是以第二目标点(x

c,

y

c

)为中心,以(x

min

,y

min

)、(x

max

,y

max

)为对角点的矩形区域,所述(x

min

,y

min

)、(x

max

,y

max

),通过如下公式获得:

70.x

max

=x

c

x

δ

×

x

c

71.x

min

=x

c

‑

x

δ

×

x

c

72.y

max

=y

c

y

δ

×

y

c

73.y

min

=y

c

‑

y

δ

×

y

c

74.其中,x

δ

表示摄像头测距的x轴偏差百分比阈值;y

δ

表示摄像头测距的y轴偏差百分比阈值。

75.由于x

δ

、y

δ

受摄像头测距的距离和车速的综合影响,摄像头的测距精度随距离的增加、速度的增加而下降,因此x

δ

、y

δ

可进一步表示为:

76.x

δ

=k1×

y

c

k3×

v c177.y

δ

=k2×

y

c

k4×

v c278.其中,y

c

为摄像头与目标的纵向距离,v表示当前车速,k1、k2、k3、k4、c1、c2为拟合系数。在本实施例给出的测试数据中,k1、k2、k3、k4、c1、c2均为正实数。x

δ

、y

δ

为无单位数值,此时,k1、k3的单位为“/米”,k2、k4的单位为“小时/公里”,c1、c2无单位。

79.如图11所示,雷达识别目标的第一置信区间包含在摄像头识别目标的第二置信区间内,这样就可以判断第二置信区间内的雷达识别目标和摄像头识别目标为同一目标,从而将二者的信息融合。而图2的传统融合方法没法将同样位置识别到的目标融合成一个目标。当采取高精度摄像头,或通过软件优化获得高精度的摄像头测距值,在近距离时,也可能是摄像头识别目标的第二置信区间包含在雷达识别目标的第一置信区间内,从而判断第一置信区间内的雷达识别目标和摄像头识别目标为同一目标,从而将二者的信息融合。

80.本发明通过研究速度和距离对摄像头及雷达识别目标的影响,将摄像头识别目标的置信区间根据速度、距离的百分比方式进行设定,从而在km融合时,对摄像头测距目标的置信区间根据距离、速度进行自适应调整,从而提高目标融合效果,减少虚目标的产生。

81.如图12所示,本发明还提出了一种毫米波雷达与视觉识别目标的融合系统,包括毫米波雷达、摄像头和融合处理器。所述融合处理器同步接收所述毫米波雷达探测和所述摄像头探测到的目标物信息,并执行上述的毫米波雷达与视觉识别目标的融合方法,将所述毫米波雷达探测的目标物和所述摄像头探测的目标物进行关联。

82.尽管结合优选实施方案具体展示和介绍了本发明,但所属领域的技术人员应该明白,在不脱离所附权利要求书所限定的本发明的精神和范围内,在形式上和细节上可以对本发明做出各种变化,均为本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。