1.本发明属于车联网技术领域,涉及一种行人意图预测方法及系统,具体涉及到一种基于车辆间协同计算通信的行人意图预测方法及系统。

背景技术:

2.随着交通行业的高速发展,私家车已经成为了人们日常生活出行中必不可少的交通工具。但在交通行业迅猛发展的同时,交通事故与安全隐患的问题仍需要被重点关注。随着智能驾驶,智能网联汽车的提出,如何结合这些技术来有效降低交通事故的发生,提高司机,行人的交通安全迫在眉睫。

技术实现要素:

3.本发明融合车联网与深度学习技术,提出了一种基于车辆间协同计算通信的行人意图预测方法及系统。本发明针对深度学习的高算力需求,以车辆间协同计算的方式来充分利用车辆上空闲算力,弥补单辆车的算力不足。最后基于车辆间的通信,可以将行人意图信息与车辆决策信息快速的广播给后方车辆,避免碰撞追尾等交通事故的发生。

4.本发明的方法所采用的技术方案是:一种基于车辆间协同计算通信的行人意图预测方法,包括以下步骤:

5.步骤1:核心车辆向周边车辆广播请求报文,满足条件的周边车辆发送响应报文,以组建核心车辆为首的协同计算车队;

6.步骤2:核心车辆通过车辆前置摄像头,连续拍摄照片并保存;核心车辆根据协同计算车队中的车辆节点信息,将拍摄到的照片与行人bounding

‑

box检测、行人姿态特征提取与道路环境特征提取任务划分按照车辆算力进行分配;

7.其中,根据车辆算力进行排序,选出算力最大的三辆车,其中两辆车进行行人bounding

‑

box的检测与行人姿态特征的提取,剩余一辆进行道路环境特征提取;

8.步骤3:周边车辆接收到核心车辆传递的照片与指定任务后,通过神经网络模型处理指定任务,将处理后的结果返回给核心车辆;

9.步骤4:核心车辆接收到车队车辆的处理结果后,进行融合预测,判断道路中的行人意图,并判断自身是否需要进行减速决策;

10.步骤5:核心车辆将行人意图与自身决策信息返回周边车辆,便于周边车辆提前进行决策,避免事故发生。

11.本发明的系统所采用的技术方案是:一种基于车辆间协同计算通信的行人意图预测系统,包括以下模块:

12.模块1:核心车辆向周边车辆广播请求报文,满足条件的周边车辆发送响应报文,以组建核心车辆为首的协同计算车队;

13.模块2:核心车辆通过车辆前置摄像头,连续拍摄照片并保存;核心车辆根据协同计算车队中的车辆节点信息,将拍摄到的照片与行人bounding

‑

box检测、行人姿态特征提

取与道路环境特征提取任务划分按照车辆算力进行分配;

14.其中,根据车辆算力进行排序,选出算力最大的三辆车,其中两辆车进行行人bounding

‑

box的检测与行人姿态特征的提取,剩余一辆进行道路环境特征的提取;

15.模块3:周边车辆接收到核心车辆传递的照片与指定任务后,通过神经网络模型处理指定任务,将处理后的结果返回给核心车辆;

16.模块4:核心车辆接收到车队车辆的处理结果后,进行融合预测,判断道路中的行人意图,并判断自身是否需要进行减速决策;

17.模块5:核心车辆将行人意图与自身决策信息返回周边车辆,便于周边车辆提前进行决策,避免事故发生。

18.本发明对比现阶段已有技术相比,具有如下优点和效果:

19.1、本发明结合车联网的特性,不采用云计算的服务方式,充分使用道路上的车辆现有计算资源,以建立协同计算车队。不仅解决了数据传输云端会出现的高时延,信道拥堵等问题,同时也弥补了单辆车算力不足的问题。

20.2、本发明针对复杂的道路环境,采用深度学习技术,相比其他数学模型,在城市道路上有着很强的模型泛用性。将行人意图预测任务分割成三个独立的子任务,分配给闲置算力资源的车辆,不仅提高了预测的准确精度,同时减少了模型推理时间。

21.3、本发明通过结合车联网与深度学习技术,不仅针对复杂的城市道路有很强的适应性,同时基于车辆间的通信可以快速的传递行人信息与车辆决策信息,避免交通事故发生。

附图说明

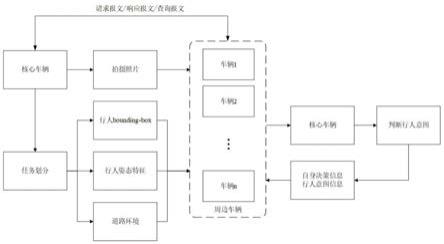

22.图1为本发明实施例的方法流程图;

23.图2为本发明实施例的车辆请求报文格式图;

24.图3为本发明实施例的车辆响应报文格式图;

25.图4为本发明实施例的车辆查询报文格式图;

26.图5为本发明实施例的车辆任务分配报文格式图;

27.图6为本发明实施例的车辆任务结果报文格式图。

具体实施方式

28.为了使本发明的目的、技术方案和优点更加清楚明白,现结合附图和实施例详细说明本发明技术方案。应当理解,此处所描述的具体实施案例仅用于解释本发明,并不用于限定本发明。

29.目前,不论是在学术界还是工业界,深度学习技术都被广泛的应用在各个方面。通过目标检测算法可以很好的确定检测图像中物体出现的位置;通过姿态检测算法,进一步的检测行人的姿态特征点;结合道路环境特征提取网络,对整个道路环境形成全局认知,作为辅助网络提高预测精度。通过联合上述网络,形成完整的道路行人意图预测方法,帮助车辆安全行驶。

30.云计算通常使用远程的服务器来帮助车辆处理复杂的计算任务,但是在车联网环境下,许多数据密集与时延敏感的任务,并不适合使用云计算解决。但是边缘计算非常适合

车联网这样数据在网络边缘产生的场景,通过核心车辆组成协同计算车队,将行人意图预测任务分成三个子任务,分散到不同车辆上执行。通过边缘计算的方式,不仅能避免数据传输到远端的高时延问题,同时可以最大限度的使用道路上车辆的闲置算力。

31.本发明的目标是实现完整的基于车辆间协同计算通信的行人意图预测方法,利用车辆与车辆间通信的低延迟特性,充分使用道路上车辆的闲置计算资源。结合目标检测,行人姿态特征与道路环境特征提取算法,达到最终的行人意图预测。再通过车辆间通信,传递行人意图与车辆决策信息,让后方车辆提前进行反应决策,避免追尾。

32.如图1所示,本实施例提供了一种基于车辆间协同计算通信的行人意图检测方法,该方法主要可以分为三个阶段:核心车辆在自身300m范围内广播请求报文,周边车辆根据自身信息判断是否符合标准并发送响应报文,以组建核心车辆为首的协同计算通信车队。然后基于车辆间的协同计算通信,将行人意图检测分成三个子任务并分配给周边车辆节点,避免核心车辆节点计算时间过长。核心车辆在收到周边车辆的计算结果后,再通过两层全连接层网络推理来判断行人意图,最后核心车辆将自身决策信息与行人意图信息传播给后方车辆。

33.本实施例所提供的技术方案是一种基于车辆间协同计算通信的行人意图检测方法,包括以下步骤,

34.步骤1:核心车辆向周边车辆广播请求报文,满足条件的周边车辆发送响应报文,以组建核心车辆为首的协同计算车队。

35.请见图2

‑

图6,分别为本实施的车辆请求报文格式图、车辆响应报文格式图、车辆查询报文格式图、车辆任务分配报文格式图和车辆任务结果报文格式图。

36.本实施例中,核心车辆向周边车辆广播请求报文,请求报文包含了标识符,核心车辆的经纬度,周边车辆的速度与行驶方向。周边车辆接收请求报文后,若自身与核心车辆的距离在300米的范围内,并且自身行驶方向与核心车辆的行驶车辆同向,则向核心车辆发送响应报文,其中响应报文包含了标识符,自身车辆的经纬度,速度与计算资源信息。核心车辆接收到周边车辆的响应报文,开始维护车辆节点信息表。车辆节点信息表中记录了周边车辆的经纬度,速度,计算资源信息。为了保持车队的稳定性与计算可靠性,核心车辆每间隔一秒的时间,就向车队内车辆发送查询报文,不断更新车队内车辆节点信息,用以后续的计算任务分配,其中查询报文包含了核心车辆的经纬度与行驶方向信息。若核心车辆在发送查询报文的5次内,未能收到车队内车辆的响应报文,则将该车辆从车辆节点信息表中移除。

37.步骤2:核心车辆通过车辆前置摄像头,连续拍摄照片并保存。核心车辆根据协同计算车队中的车辆节点信息,将拍摄到的照片与行人bounding

‑

box,行人姿态特征与道路环境特征提取任务划分按照车辆算力进行分配。

38.在步骤2中,核心车辆将拍摄的照片保存在智能终端上,获取车辆节点信息表,根据车辆算力进行排序。选出算力最大的三辆车,发送等间隔125ms的连续4帧图片用于子任务的预测,其中前两辆车进行行人bounding

‑

box的检测与行人姿态特征的提取,最后一辆进行行人所处的道路环境特征提取。

39.本实施例中,行人bounding

‑

box的检测使用网络yolov5m与目标追踪使用网络deepsort,在检测行人意图穿越意图的任务中,行人目标相较于其他目标检测任务较大,为

了满足检测的实时性,又不失准确性的条件下,使用yolov5m网络进行大目标的检测可以兼并速度与精度。基于yolov5m目标检测网络的结果,使用deepsort网络进行行人目标追踪,匹配目标检测结果。

40.因为车前摄像头拍摄的图片分辨率为1920*1080,为了符合yolov5m网络的输入格式,将图片转化为608*608大小。通过缩小图片,不仅可以减少大量的计算,同时也可以加快车辆间的信息传输。针对yolov5m的目标检测,只保留行人类别,将行人检测结果输入到deepsort网络中进行行人位置追踪,选择检测框最大的6个行人检测结果,,检测框越大,则表示行人越靠近车辆,对车辆决策的影响越大,所以该网络的输出为(4,6,8)。

41.本实施例中,针对行人姿态特征的提取,使用openpose姿态特征提取网络。同样返回最接近车辆的6位行人的姿态特征,其中行人姿态特征点一共包含25个,从上到下分别是:左右眼,左右耳,鼻子,脖子,左右肩膀,左右手肘,左右手腕,左中右臀部,左右膝盖,左右脚踝,左右大拇指,左右小拇指,左右脚跟。每个特征点都有(x,y)两个点来确定,所以openpose网络的输出为(4,6,50)。相比于常见的cpn网络的17个姿态特征点,openpose中使用的25个姿态特征不仅可以捕捉到行人的整体动作,还可以关注到行人的腿部移动特征,更好的预测行人穿越意图。

42.本实施例中,道路环境特征提取使用2层卷积层与2层池化层的堆叠,为了能够更好的提取高维环境特征,在每一层池化层后,添加注意力机制squeeze

‑

and

‑

excitation模块,对模型通道进行抑制或放大,最后加上2层全连接层,输出高维环境特征。因此道路环境特征提取网络的输出为(4,12)。上述两种方法均使用960*540大小的图片作为网络的输入数据。

43.步骤3:周边车辆接收到核心车辆传递的照片与指定任务后,通过神经网络模型处理指定任务,将处理后的结果返回给核心车辆。

44.步骤4:核心车辆接收到车队车辆的处理结果后,进行融合预测,判断道路中的行人意图,并判断自身是否需要进行减速决策。

45.在步骤3中,核心车辆将图像与任务标签发送给指定车辆,并等待任务分配车辆返回处理结果。其中行人bounding

‑

box检测结果为y

bbox

,其大小为(4,6,8);行人姿态特征提取结果为y

posture

,其大小为(4,6,50);道路环境特征提取结果为y

road

,其大小为(4,12)。针对上述获取到的三个序列数据,再分别通过三个单层单向的循环神经网络,其中每个循环神经网络都包含了5个lstm模块,用于提取序列数据之间的时序特征,处理后的特征大小分别为(6,8),(6,16),(6,8)。然后通过矩阵拼接函数concat(

·

),组成全局特征向量y

out

,其大小为(6,32),计算公式如下:

46.y

out

=concat(lstm(y

posture

),lstm(y

road

),lstm(y

bbox

));

47.将y

out

通过2层全连接层,第一层全连接层大小为16,第二层全连接大小为2。最后通过softmax层计算行人的穿越意图的概率。

48.步骤5:核心车辆将行人意图与自身决策信息返回周边车辆,便于周边车辆提前进行决策,避免事故发生。

49.本实施例在预测行人穿越道路意图的概率后,若存在行人的穿越概率大于50%,则核心车辆将进行减速决策。同时把减速决策信息与行人穿越意图信息广播给周边车辆,让周边车辆提前减速,避免追尾,发生交通事故。

50.应当理解的是,本说明书中未详细阐述的部分均属于现有技术。

51.本说明书中所描述的具体实施例仅仅是对本发明精神作举例说明。本发明所属技术领域的技术人员可以对所描述的具体实施例做各种各样的修改或补充或采用类似的方式替代,但并不会偏离本发明的精神或者超越所附权利要求书所定义的范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。