1.本发明涉及图像处理领域,特别涉及一种多角度人脸表情识别的方法及装置、设备及存储介质。

背景技术:

2.人脸作为人体重要组成部分之一,其表现的特征在交流过程中蕴含着大量的信息。其中人脸表情是人表达自身情绪的重要方法之一,心理学家mehrabiadu指出人脸表情在人们交流的过程中传达了55%的有用信息,而语言传达的有用信息仅占7%。通过人脸表情识别技术,能够进一步提升人机交互水平,在教育,心理诊断,公共安全等领域具有广泛应用前景。

3.当前自然环境下采集的人脸,会有侧脸,光照,遮挡等影响表情识别的不利因素,使得一张图片中用于表情识别的有效人脸范围各不相同。针对这一问题,目前的技术方案是先对人脸图片进行人脸检测、人脸矫正后,再利用卷积神经网络进行情感分类,但是该类方法需要对图像进行一系列预处理,操作较为繁琐。

技术实现要素:

4.基于此,本发明提供一种多角度人脸表情识别的方法及装置、设备及存储介质,通过在神经网络模型中引入可变换卷积模型以及注意力模型,能够对人脸图像的侧脸进行表情识别,实现了多角度的人脸表情识别,通过对神经网络模型进行若干次训练,提高了多角度的人脸表情识别的准确率,同时能够减少预处理操作,提高了人脸表情识别的效率。该技术方法如下:

5.第一方面,本技术实施例提供了一种多角度人脸表情识别的方法,包括以下步骤:

6.构建神经网络模型以及人脸表情图像训练库,其中,所述神经网络模型包括可变换卷积模块以及注意力模块;所述人脸表情图像训练库包括多角度人脸表情图像训练数据;

7.根据所述可变换卷积模块以及所述多角度人脸表情图像训练数据,获取多角度人脸表情图像训练数据的输出特征图;

8.根据所述注意力模块以及所述多角度人脸表情图像训练数据的输出特征图,对所述神经网络模型进行若干次训练,获得若干个训练后的神经网络模型;

9.根据预设的准确率计算算法,从所述若干个训练后的神经网络模型中获得准确率最高的神经网络模型,作为最佳神经网络模型;

10.获得用户的识别指令,所述识别指令包括预识别的人脸表情图像,根据所述预识别的人脸表情图像以及所述最佳神经网络模型,获得人脸表情识别结果。

11.第二方面,本技术实施例提供了一种多角度人脸表情识别的装置,包括:

12.构建单元,用于构建神经网络模型以及人脸表情图像训练库,其中,所述神经网络模型包括可变换卷积模块以及注意力模块;所述人脸表情图像训练库包括多角度人脸表情

图像训练数据;

13.特征提取单元,用于根据所述可变换卷积模块以及所述多角度人脸表情图像训练数据,获取多角度人脸表情图像训练数据的输出特征图;

14.训练单元,用于根据所述注意力模块以及所述多角度人脸表情图像训练数据的输出特征图,对所述神经网络模型进行若干次训练,获得若干个训练后的神经网络模型;

15.计算单元,用于根据预设的准确率计算算法,从所述若干个训练后的神经网络模型中获得准确率最高的神经网络模型,作为最佳神经网络模型;

16.识别单元,用于获得用户的识别指令,所述识别指令包括预识别的人脸表情图像,根据所述预识别的人脸表情图像以及所述最佳神经网络模型,获得人脸表情识别结果。

17.第三方面,本技术实施例提供了一种设备,包括:处理器、存储器以及存储在所述存储器上并可在所述处理器上运行的计算机程序;所述计算机程序被所述处理器执行时实现如第一方面所述的多角度人脸表情识别的方法的步骤。

18.第四方面,本技术实施例提供了一种存储介质,所述存储介质存储有计算机程序,所述计算机程序被处理器执行时实现如第一方面所述的多角度人脸表情识别的方法的步骤。

19.在本技术的实施例中,通过在神经网络模型中引入可变换卷积模型以及注意力模型,能够对人脸图像的侧脸进行表情识别,实现了多角度的人脸表情识别,通过对神经网络模型进行若干次训练,提高了多角度的人脸表情识别的准确率,同时能够减少预处理操作,提高了人脸表情识别的效率。

20.为了更好地理解和实施,下面结合附图详细说明本发明。

附图说明

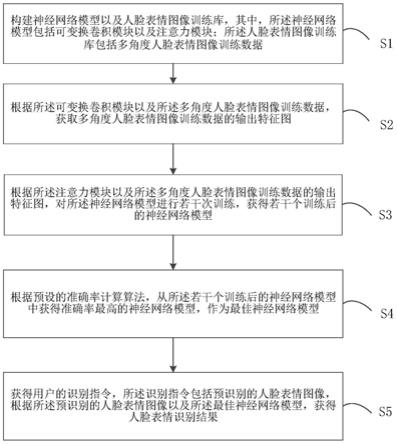

21.图1为本技术一个实施例提供的多角度人脸表情识别的方法的流程示意图;

22.图2为本技术一个实施例提供的多角度人脸表情识别的方法的resnet18神经网络结构的部分结构图;

23.图3为本技术一个实施例提供的多角度人脸表情识别的方法的注意力模块模块的结构示意图;

24.图4为本技术一个实施例提供的多角度人脸表情识别的方法中s1的流程示意图;

25.图5为本技术一个实施例提供的多角度人脸表情识别的方法中s2的流程示意图;

26.图6为本技术一个实施例提供的多角度人脸表情识别的方法中s3的流程示意图;

27.图7为本技术一个实施例提供的多角度人脸表情识别的方法中s301的流程示意图;

28.图8为本技术一个实施例提供的多角度人脸表情识别的方法中s4的流程示意图;

29.图9为本技术一个实施例提供的多角度人脸表情识别装置的结构示意图;

30.图10为本技术一个实施例提供的设备的结构示意图。

具体实施方式

31.这里将详细地对示例性实施例进行说明,其示例表示在附图中。下面的描述涉及附图时,除非另有表示,不同附图中的相同数字表示相同或相似的要素。以下示例性实施例

中所描述的实施方式并不代表与本技术相一致的所有实施方式。相反,它们仅是与如所附权利要求书中所详述的、本技术的一些方面相一致的装置和方法的例子。

32.在本技术使用的术语是仅仅出于描述特定实施例的目的,而非旨在限制本技术。在本技术和所附权利要求书中所使用的单数形式的“一种”、“所述”和“该”也旨在包括多数形式,除非上下文清楚地表示其他含义。还应当理解,本文中使用的术语“和/或”是指并包含一个或多个相关联的列出项目的任何或所有可能组合。

33.应当理解,尽管在本技术可能采用术语第一、第二、第三等来描述各种信息,但这些信息不应限于这些术语。这些术语仅用来将同一类型的信息彼此区分开。例如,在不脱离本技术范围的情况下,第一信息也可以被称为第二信息,类似地,第二信息也可以被称为第一信息。取决于语境,如在此所使用的词语“如果”/“若”可以被解释成为“在

……

时”或“当

……

时”或“响应于确定”。

34.请参阅图1,图1为本技术一个实施例提供的多角度人脸表情识别的方法的流程示意图,所述方法包括如下步骤:

35.s1:构建神经网络模型以及人脸表情图像训练库,其中,所述神经网络模型包括可变换卷积模块以及注意力模块;所述人脸表情图像训练库包括多角度人脸表情图像训练数据。

36.本技术的多角度人脸表情识别的方法的执行主体为多角度人脸表情识别的识别设备(以下简称识别设备)。

37.该识别设备可以是一台计算机设备,也可以是一台移动终端设备,例如智能手机、平板电脑等等。在一个可选的实施例中,该识别设备可以是与服务器建立数据连接的独立设备,也可以为该独立设备的组成部件,例如:该独立设备内部的处理器或微处理器等。

38.所述人脸表情图像训练数据包括了若干个不同种类的表情特征,例如开心,愤怒,伤心,惊喜,悲伤,厌恶以及中性等等,其中,每一种表情包括若干个不同的角度,例如是正面、左侧45度、右侧45度、左侧90度、右侧90度。

39.进一步地,所述人脸表情图像训练数据库选用raf

‑

db,fer

‑

plus两种数据集作为所述人脸表情图像训练数据,其中,所述raf

‑

db数据集包括12271张训练图片,所述fer

‑

plus数据集包括28709张训练图片。

40.神经网络模型是采用一个卷积神经网络结构进行表情识别分类,所述卷积神经网络包括resnet系列神经网络结构、vgg系列神经网络结构以及alexnet系列神经网络结构等等。

41.进一步地,所述神经网络模型的神经网络结构为resnet系列的resnet18。

42.请参阅图2,图2为本技术一个实施例提供的多角度人脸表情识别的方法的resnet18神经网络结构的部分结构图。

43.所述resnet18神经网络结构包括可变换卷积模块(dcov)、最大池化层(maxpool)、若干个注意力模块(attentionblock)、平均池化层(avgpool)以及全连接层(fc)。

44.其中,所述可变换卷积模块作为所述resnet18神经网络结构的输入卷积层。

45.请参阅图3,图3为本技术一个实施例提供的多角度人脸表情识别的方法的注意力模块模块的结构示意图。

46.所述注意力模块包括平均池化层(avgpool)、卷积层(conv2d)、训练层以及输出

层,其中,所述训练层包括加速神经网络训练算法(batchnorm)以及非线性回归算法(non

‑

linear),所述输出层包括sigmoid函数。

47.所述注意力模块在获取所述可变化卷积模块输出的输出特征图,可以通过所述平均池化层(avgpool)、卷积层、训练层以及输出层,对所述神经网络模型进行训练。

48.在本实施例中,识别设备构建神经网络模型以及人脸表情图像训练库,并保存于相应的存储空间内。

49.请参阅图4,图4为本技术一个实施例提供的多角度人脸表情识别的方法中s1的流程示意图,包括步骤s101:

50.s101:对所述多角度人脸表情图像训练数据进行预处理;其中,所述预处理步骤包括格式标准化步骤、角度旋转步骤以及亮度改变步骤的一种或多种。

51.在本实施例中,识别设备通过opencv库获取所述多角度人脸表情图像训练数据,将所述多角度人脸表情图像训练数据的图像格式转换成rgb图像格式,并对图像的尺寸转换成128*128个像素大小,实现了对所述多角度人脸表情图像训练数据的格式标准化。

52.在一个可选的实施例中,识别设备可以对所述格式标准化后的多角度人脸表情图像训练数据进行角度旋转,获得同一人脸表情图像训练数据的多个角度的人脸表情图像训练数据;在另一个可选的实施例中,识别设备可以对所述格式标准化后的多角度人脸表情图像训练数据进行亮度改变,达到图像增强的目的。

53.s2:根据所述可变换卷积模块以及所述多角度人脸表情图像训练数据,获取多角度人脸表情图像训练数据的输出特征图。

54.在本实施例中,识别设备获取经过预处理的所述多角度人脸表情图像训练数据,获取多角度人脸表情图像训练数据的输出特征图。

55.请参阅图5,图5为本技术一个实施例提供的多角度人脸表情识别的方法中s2的流程示意图,包括步骤s201~s202,具体如下:

56.s201:根据所述可变换卷积模块以及所述多角度人脸表情图像训练数据,获得所述多角度人脸表情图像训练数据的每个像素的偏移量。

57.所述可变换卷积模块的卷积层设置一卷积模板,其中,r为所述卷积模板中心的8邻域像素偏移坐标集合:

[0058][0059]

在本实施例中,识别设备获取经过预处理的所述多角度人脸表情图像训练数据,经过所述可变换卷积模块的卷积层,将所述卷积层的卷积模板和与模板中心对应的图像像素值对准,获得所述多角度人脸表情图像训练数据的中心像素及其8邻域像素值,将所述中心像素及其8邻域像素值和卷积模板进行卷积,获得所述多角度人脸表情图像训练数据的每个像素的偏移量。

[0060]

s202:根据所述每个像素的偏移量以及预设的特征提取算法,获取多角度人脸表情图像训练数据的输出特征图。

[0061]

在本实施例中,识别设备预先设置有特征提取算法,其中,所述特征提取算法为:

[0062][0063]

其中,y1(p

c

)为对应p

c

像素点下的可变形卷积输出,w(p

n

)为对应像素点的卷积模板值,δp

n

为偏移坐标量。

[0064]

识别设备获得所述多角度人脸表情图像训练数据的每个像素的偏移量后,根据所述每个像素的偏移量以及预设的特征提取算法,获取多角度人脸表情图像训练数据的特征,从而获得所述多角度人脸表情图像训练数据的输出特征图。

[0065]

s3:根据所述注意力模块以及所述多角度人脸表情图像训练数据的输出特征图,对所述神经网络模型进行若干次训练,获得若干个训练后的神经网络模型。

[0066]

在本实施例中,识别设备获得所述多角度人脸表情图像训练数据的输出特征图,根据所述注意力模块,对所述神经网络模型进行若干次训练,获得若干个训练后的神经网络模型。

[0067]

请参阅图6,图6为本技术一个实施例提供的多角度人脸表情识别的方法中s3的流程示意图,包括步骤s301~s302,具体如下:

[0068]

s301:根据所述注意力模块以及所述多角度人脸表情图像训练数据的输出特征图,获得所述多角度人脸表情图像训练数据的输出值。

[0069]

在本实施例中,识别设备解析所述获得的多角度人脸表情图像训练数据的输出特征图,获取所述多角度人脸表情图像训练数据的输出特征,根据所述注意力模块,获得所述多角度人脸表情图像训练数据的输出值。

[0070]

s302:根据所述输出值以及预设的学习率衰减策略,对所述神经网络模型进行若干次训练,获得若干个训练后的神经网络模型。

[0071]

在本实施例中,识别设备获取所述多角度人脸表情图像训练数据的输出值之后,根据预设的学习率衰减策略,对所述神经网络模型进行若干次训练,获得若干个训练后的神经网络模型。

[0072]

在一个可选的实施例中,识别设备采用adam优化器作为所述神经网络模型训练的优化器,所述adam优化器为一种对随机目标函数执行一阶梯度优化的算法,具有较高的计算效率以及较低的内存需求。

[0073]

所述学习率递减策略为指数衰减策略,初始学习率设置为0.001,训练轮数定为40次。识别设备通过输入设备设定所述指数衰减策略的参数后,根据所述输出值以及预设的指数衰减策略,对所述神经网络模型进行训练,获得若干个训练后的神经网络模型。

[0074]

请参阅图7,图7为本技术一个实施例提供的多角度人脸表情识别的方法中s301的流程示意图,包括步骤s3011~s3013,具体如下:

[0075]

s3011:根据所述注意力模块的平均化层、所述多角度人脸表情图像训练数据的输出特征图以及预设的权重计算算法,获得所述多角度人脸表情图像训练数据的输出特征图的水平方向上的第一权重值以及垂直方向上的第一权重值。

[0076]

在本实施例中,识别设备将所述多角度人脸表情图像训练数据的输出特征图输入至所述注意力模块的平均化层,对所述多角度人脸表情图像训练数据的输出特征图分别沿着水平方向和垂直方向进行通道编码,获得所述多角度人脸表情图像训练数据的水平方向

上权重值以及垂直方向上的权重值。

[0077]

其中,所述权重计算算法为:

[0078][0079][0080]

其中,h为所述输出特征图的高度,w为所述输出特征图的宽度,x

c

(h,i)为第通道上高度为h,宽度为i的对应图像像素值,z

c

(h)为高度为h的第通道的所述水平方向上的第一权重值的输出,z

c

(w)为宽度为w的第c通道的所述垂直方向上的第一权重值的输出,x

c

(h,i)为第通道上高度为h,宽度为i的对应图像像素值,x

c

*j,w)为第通道上高度为j,宽度为w的对应图像像素值;

[0081]

s3012:根据所述注意力模块的卷积层以及训练层,分别对所述水平方向上的第一权重值以及垂直方向上的第一权重值进行处理,获得所述水平方向上的第二权重值以及垂直方向上的第二权重值。

[0082]

在本实施例中,识别设备将所述水平方向上的权重值以及垂直方向上的权重值通过所述注意力模块中的卷积层进行拼接、卷积、归一化操作后,再分别按照水平和垂直两个方向进行卷积,通过所述注意力模块中的训练层进行处理,获得处理后的水平方向上的第二权重值g

h

以及垂直方向上的第二权重值g

w

。

[0083]

s3013:根据所述水平方向上的第二权重值、垂直方向上的第二权重值以及权重输出算法,获得所述多角度人脸表情图像训练数据的输出值。

[0084]

在本实施例中,识别设备根据所述水平方向上的第二权重值g

h

以及垂直方向上的第二权重值g

w

,根据预设的输出值算法,获得所述多角度人脸表情图像训练数据的输出值。

[0085]

其中,所述权重输出算法为:

[0086][0087]

其中y

c

(i,j)表示第通道输出特征图的第i行第j列的输出,x

c

(i,j)为第通道输出特征图上高度为i,宽度为j的像素值,为第通道输出特征图垂直方向上高度为i的位置的水平方向上的第二权重值的输出值,为第通道输出特征图水平方向上宽度为j的位置的垂直方向上的第二权重值的输出值。

[0088]

s4:根据预设的准确率计算算法,从所述若干个训练后的神经网络模型中获得准确率最高的神经网络模型,作为最佳神经网络模型。

[0089]

在本实施例中,识别设备获取若干个训练后的神经网络模型后,根据预设的准确率计算算法,计算每个所述训练后的神经网络模型经过验证后的准确率,获得准确率最高的神经网络模型,作为最佳神经网络模型。

[0090]

请参阅图8,图8为本技术一个实施例提供的多角度人脸表情识别的方法中s4的流程示意图,包括步骤s401~s403,具体如下:

[0091]

s401:构建人脸表情图像验证库,其中,所述人脸表情图像验证库包括多角度人脸表情图像验证数据。

[0092]

所述人脸表情图像验证数据包括了若干个不同种类的表情特征,例如开心,愤怒,伤心,惊喜,悲伤,厌恶以及中性等等,其中,每一种表情包括若干个不同的角度,例如是正面、左侧45度、右侧45度、左侧90度、右侧90度。

[0093]

进一步地,所述人脸表情图像验证数据库选用raf

‑

db,fer

‑

plus两种数据集作为所述人脸表情图像验证数据,其中,所述raf

‑

db数据集包括3068张验证测试图片,所述fer

‑

plus数据集包括3589张验证测试图片。

[0094]

在本实施例中,识别设备构建人脸表情图像验证库,并保存于相应的存储空间内。

[0095]

s402:将所述多角度人脸表情图像验证数据分别输入至所述若干个训练后的神经网络模型,获得所述训练后的神经网络模型的损失值以及准确值。

[0096]

在本实施例中,识别设备获取所述人脸表情图像验证库中的多角度人脸表情图像验证数据,输入至每个所述训练后的神经网络模型,获得每个所述训练后的神经网络模型的损失值以及准确值。

[0097]

s403:根据所述损失值、准确值以及预设的准确率计算算法,获得准确率最高的神经网络模型,作为最佳神经网络模型。

[0098]

在本实施例中,识别设备获取每个所述训练后的神经网络模型的损失值以及准确值后,根据预设的准确率计算算法,计算每个所述训练后的神经网络模型经过验证后的准确率,获得准确率最高的神经网络模型,作为最佳神经网络模型。

[0099]

请参考图9,图9为本技术一个实施例提供的多角度人脸表情识别装置的结构示意图,该装置可以通过软件、硬件或两者的结合实现多角度人脸表情识别的方法的全部或一部分,该装置9包括:

[0100]

构建单元91,用于构建神经网络模型以及人脸表情图像训练库,其中,所述神经网络模型包括可变换卷积模块以及注意力模块;所述人脸表情图像训练库包括多角度人脸表情图像训练数据;

[0101]

特征提取单元92,用于根据所述可变换卷积模块以及所述多角度人脸表情图像训练数据,获取多角度人脸表情图像训练数据的输出特征图;

[0102]

训练单元93,用于根据所述注意力模块以及所述多角度人脸表情图像训练数据的输出特征图,对所述神经网络模型进行若干次训练,获得若干个训练后的神经网络模型;

[0103]

计算单元94,用于根据预设的准确率计算算法,从所述若干个训练后的神经网络模型中获得准确率最高的神经网络模型,作为最佳神经网络模型;

[0104]

识别单元95,用于获得用户的识别指令,所述识别指令包括预识别的人脸表情图像,根据所述预识别的人脸表情图像以及所述最佳神经网络模型,获得人脸表情识别结果。

[0105]

在本技术的实施例中,通过构建单元,构建神经网络模型以及人脸表情图像训练库,其中,所述神经网络模型包括可变换卷积模块以及注意力模块;所述人脸表情图像训练库包括多角度人脸表情图像训练数据;通过特征提取单元,根据所述可变换卷积模块以及所述多角度人脸表情图像训练数据,获取多角度人脸表情图像训练数据的输出特征图;通过训练单元,根据所述注意力模块以及所述多角度人脸表情图像训练数据的输出特征图,对所述神经网络模型进行若干次训练,获得若干个训练后的神经网络模型;通过计算单元,

根据预设的准确率计算算法,从所述若干个训练后的神经网络模型中获得准确率最高的神经网络模型,作为最佳神经网络模型;通过识别单元,获得用户的识别指令,所述识别指令包括预识别的人脸表情图像,根据所述预识别的人脸表情图像以及所述最佳神经网络模型,获得人脸表情识别结果。通过在神经网络模型中引入可变换卷积模型以及注意力模型,能够对人脸图像的侧脸进行表情识别,实现了多角度的人脸表情识别,通过对神经网络模型进行若干次训练,提高了多角度的人脸表情识别的准确率,同时能够减少预处理操作,提高了人脸表情识别的效率。

[0106]

请参考图10,图10为本技术一个实施例提供的设备的结构示意图,设备10包括:处理器101、存储器102以及存储在存储器102上并可在处理器101上运行的计算机程序103;计算机设备可以存储有多条指令,指令适用于由处理器101加载并执行上述图1、图4至图8所示实施例的方法步骤,具体执行过程可以参见图1、图4至图8所示实施例的具体说明,在此不进行赘述。

[0107]

其中,处理器101可以包括一个或多个处理核心。处理器101利用各种接口和线路连接服务器内的各个部分,通过运行或执行存储在存储器102内的指令、程序、代码集或指令集,以及调用存储器102内的数据,执行多角度人脸表情识别装置9的各种功能和处理数据,可选的,处理器101可以采用数字信号处理(digital signal processing,dsp)、现场可编程门阵列(field

‑

programmable gate array,fpga)、可编程逻辑阵列(programble logic array,pla)中的至少一个硬件形式来实现。处理器101可集成中央处理器101(central processing unit,cpu)、图像处理器101(graphics processing unit,gpu)和调制解调器等中的一个或几种的组合。其中,cpu主要处理操作系统、用户界面和应用程序等;gpu用于负责触摸显示屏所需要显示的内容的渲染和绘制;调制解调器用于处理无线通信。可以理解的是,上述调制解调器也可以不集成到处理器101中,单独通过一块芯片进行实现。

[0108]

其中,存储器102可以包括随机存储器102(random access memory,ram),也可以包括只读存储器102(read

‑

only memory)。可选的,该存储器102包括非瞬时性计算机可读介质(non

‑

transitory computer

‑

readable storage medium)。存储器102可用于存储指令、程序、代码、代码集或指令集。存储器102可包括存储程序区和存储数据区,其中,存储程序区可存储用于实现操作系统的指令、用于至少一个功能的指令(比如触控指令等)、用于实现上述各个方法实施例的指令等;存储数据区可存储上面各个方法实施例中涉及到的数据等。存储器102可选的还可以是至少一个位于远离前述处理器101的存储装置。

[0109]

本技术实施例还提供了一种存储介质,所述存储介质可以存储有多条指令,所述指令适用于由处理器加载并执行上述图1、图4至图8所示实施例的方法步骤,具体执行过程可以参见图1、图4至图8所示实施例的具体说明,在此不进行赘述。

[0110]

所属领域的技术人员可以清楚地了解到,为了描述的方便和简洁,仅以上述各功能单元、模块的划分进行举例说明,实际应用中,可以根据需要而将上述功能分配由不同的功能单元、模块完成,即将所述装置的内部结构划分成不同的功能单元或模块,以完成以上描述的全部或者部分功能。实施例中的各功能单元、模块可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中,上述集成的单元既可以采用硬件的形式实现,也可以采用软件功能单元的形式实现。另外,各功能单

元、模块的具体名称也只是为了便于相互区分,并不用于限制本技术的保护范围。上述系统中单元、模块的具体工作过程,可以参考前述方法实施例中的对应过程,在此不再赘述。

[0111]

在上述实施例中,对各个实施例的描述都各有侧重,某个实施例中没有详述或记载的部分,可以参见其它实施例的相关描述。

[0112]

本领域普通技术人员可以意识到,结合本文中所公开的实施例描述的各示例的单元及算法步骤,能够以电子硬件、或者计算机软件和电子硬件的结合来实现。这些功能究竟以硬件还是软件方式来执行,取决于技术方案的特定应用和设计约束条件。专业技术人员可以对每个特定的应用来使用不同方法来实现所描述的功能,但是这种实现不应认为超出本发明的范围。

[0113]

在本发明所提供的实施例中,应该理解到,所揭露的装置/终端设备和方法,可以通过其它的方式实现。例如,以上所描述的装置/终端设备实施例仅是示意性的,例如,所述模块或单元的划分,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式,例如多个单元或组件可以结合或者可以集成到另一个系统,或一些特征可以忽略,或不执行。另一点,所显示或讨论的相互之间的耦合或直接耦合或通讯连接可以是通过一些接口,装置或单元的间接耦合或通讯连接,可以是电性,机械或其它的形式。

[0114]

所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部单元来实现本实施例方案的目的。

[0115]

另外,在本发明各个实施例中的各功能单元可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中。上述集成的单元既可以采用硬件的形式实现,也可以采用软件功能单元的形式实现。

[0116]

所述集成的模块/单元如果以软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本发明实现上述实施例方法中的全部或部分流程,也可以通过计算机程序来指令相关的硬件来完成,所述的计算机程序可存储于一计算机可读存储介质中,该计算机程序在被处理器执行时,可实现上述各个方法实施例的步骤。其中,所述计算机程序包括计算机程序代码,所述计算机程序代码可以为源代码形式、对象代码形式、可执行文件或某些中间形式等。

[0117]

本发明并不局限于上述实施方式,如果对本发明的各种改动或变形不脱离本发明的精神和范围,倘若这些改动和变形属于本发明的权利要求和等同技术范围之内,则本发明也意图包含这些改动和变形。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。