1.本技术涉及人工智能领域,尤其涉及一种神经网络搜索方法及相关设备。

背景技术:

2.人工智能(artificial intelligence,ai)是利用数字计算机或者数字计算机控制的机器模拟、延伸和扩展人的智能,感知环境、获取知识并使用知识获得最佳结果的理论、方法、技术及应用系统。换句话说,人工智能是计算机科学的一个分支,它企图了解智能的实质,并生产出一种新的能以人类智能相似的方式作出反应的智能机器。人工智能也就是研究各种智能机器的设计原理与实现方法,使机器具有感知、推理与决策的功能。

3.随着人工智能技术的不断发展,让人机之间能够通过自然语言进行交互的自然语言人机交互系统变的越来越重要。人机之间能够通过自然语言进行交互,就需要系统能够识别出人类自然语言的具体含义。通常,系统通过采用对自然语言的句子进行关键信息提取来识别句子的具体含义。

4.transformer结构具有强大的语义表达能力,能捕捉文本长依赖关系。自被提出以来在以翻译为代表的一系列自然语言处理的任务上显著超越了之前的模型,基于transformer结构的预训练语言模型在问答系统,语音助手等领域也取得了非常好的效果。

5.随着人工智能技术的快速发展,一个性能优良的神经网络往往拥有精妙的网络结构,而这需要具有高超技能和丰富经验的人类专家花费大量精力进行构建。为了更好地构建神经网络,人们提出了通过神经网络结构搜索(neuralarchitecture search,nas)的方法来搭建神经网络,通过自动化地搜索神经网络结构,从而得到性能优异的神经网络结构。

6.现有针对于transformer模型的神经网络搜索方法,对transformer模型的性能提升有限。

技术实现要素:

7.第一方面,本技术提供了一种神经网络搜索方法,该方法包括:

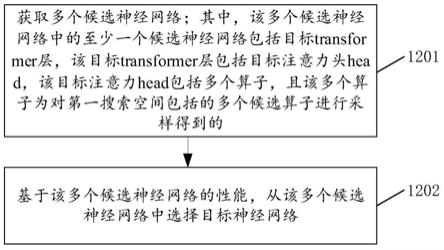

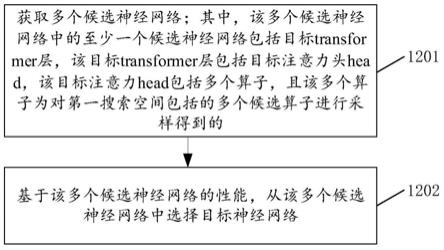

8.获取多个候选神经网络;其中,该多个候选神经网络中的至少一个候选神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;

9.其中,可以通过采样或者固定设置的方式,确定候选神经网络中的网络层的类型为transformer层(本技术实施例中可以称之为目标transformer层),并通过从第一搜索空间中进行算子采样的方式来确定目标transformer层中目标注意力头head的结构;

10.在一种可能的实现中,算子采样的来源可以为第一搜索空间,第一搜索空间可以包括多个候选算子,在构建注意力头head时,可以采样第一搜索空间中的多个候选算子,并对采样得到的候选算子进行组合,以得到一个transformer层中的注意力头head,经过多次采样,可以得到多个transformer层中的注意力头head;具体的,在一种可能的实现中,可以

采样第一搜索空间的候选算子来构建目标注意力head,具体的,可以从第一搜索空间中采样多个算子,以及采样多个算子之间的连接关系。也就是说,在构建目标注意力head时,目标注意力head中包括的各个算子的类型、数量以及连接关系都可以是基于采样的方式确定的,进而,可以基于采样得到的多个算子,以及采样多个算子之间的连接关系来构建目标注意力头head;

11.应理解,本技术实施例中的采样可以为随机采样或者是非随机采样,其中,随机采样可以指遵照随机化原则从总体中抽取样本的抽样方法,随机采样例如但不限于包括简单随机抽样、系统抽样、整群抽样和分层抽样等。非随机采样可以是基于一定概率分布或者其他指导采样过程的方式,使得不同被采样的信息在每次采样时被采样到的几率不完全相同。

12.本技术实施例中的采样可以包括网络层类型的采样(网络层类型具体包括transformer层以及目标网络层)、注意力头head中多个算子的采样(具体包括算子类型、算子数量以及连接关系的采样)、注意力头head中变换矩阵数量的采样、目标网络层中卷积层的卷积核的尺寸大小采样,上述采样过程可以部分基于随机采样实现,部分基于非随机采样实现,也可以全部基于随机采样实现,也可以全部基于非随机采样实现。

13.其中,网络层类型的采样是用于确定候选神经网络中串行连接的各个网络层的网络类型(网络类型可以为transformer层或者目标网络层,或者是其他网络类型)。

14.其中,注意力头head中多个算子的采样是用于确定注意力头head中包括的算子的算子类型、算子数量以及算子之间的连接关系,其中,算子类型是对第一搜索空间中的多个候选算子进行采样得到的,算子数量是从预设范围内采样得到的,例如针对于目标head采样确定5

‑

20之间的算子数量,算子之间的连接关系是基于采样得到的多个算子之间的数量流向进行采样得到的,例如采样得到的多个算子包括算子a和算子b,那么算子a是否和算子b连接可以是基于采样的方式确定的,以及在具备连接关系的情况下,是算子a的输出作为算子b的输入还是算子b的输出作为算子a的输入也可以是基于采样的方式确定的。

15.其中,注意力头head中变换矩阵数量的采样是用于确定注意力头head中包括多少个变换矩阵数量,采样的数量可以具有上限和/或下限,例如是在1

‑

4的数量区间内采样确定,或者是在2

‑

4的数量区间内采样确定,或者是在2

‑

3的数量区间内采样确定,这里并不限定。基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。

16.在得到多个候选神经网络之后,可以对多个神经网络进行训练,以得每个候选神经网络的性能,进而可以基于每个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络,其中目标神经网络的数量为至少一个,当目标神经网络的数量为一个时,该目标神经网络可以为多个候选神经网络中性能最好的模型,当目标神经网络的数量为多个时,该目标神经网络可以为多个候选神经网络中性能最好的多个模型。

17.通过上述方式,结合模型搜索,能生成相比原自注意力机制更强的新型注意力结构,在广泛的下游任务中取得明显效果提升。

18.在一种可能的实现中,该第一搜索空间包括多个候选算子,该候选算子为一元运算符或二元运算符。其中一元运算符(unary operation)是指只对一个数据执行操作,例如负数操作(neg)、开根号操作(sqrt)、转置操作(transpose)、softmax操作、logsigmoid操作、softsign操作等等,二元运算符(binary operation)是指对两个数据进行操作得到第

三个数据的一种规则,例如加和操作(add)、点乘操作(matmul)、cosine similarity操作以及euclidean distance操作。

19.其中,上述候选算子的类型相比现有的注意力头的算子类型更为丰富,大大增加了候选transformer层的结构类型,进而增加了搜索得到具有更优性能的transformer模型的可能。

20.在一种可能的实现中,该多个候选算子包括softmax算子以及点乘算子。

21.其中,在丰富了算子类型的前提下,保留了现有的注意力头head中的softmax算子以及点乘算子,由于softmax算子以及点乘算子作为注意力机制中很重要的算子类型,当进行针对于注意力头head的算子采样时,缺失这两种算子类型可能会导致搜索后的注意力头的head与现有的注意力头head的结构差异过大,一方面,很难采样到性能很优的注意力头head结构,另一方面,也增加了搜索过程的时间以及算力开销。

22.在一种可能的实现中,可以采样第一搜索空间的候选算子来构建目标注意力head,具体的,可以从第一搜索空间中采样多个算子,以及采样多个算子之间的连接关系。也就是说,在构建目标注意力head时,目标注意力head中包括的各个算子的类型、数量以及连接关系都可以是基于采样的方式确定的,进而,可以基于采样得到的多个算子,以及采样多个算子之间的连接关系来构建目标注意力头head。

23.其中,算子之间的连接关系,也是,上述候选算子的类型相比现有的注意力头的算子类型更为丰富,大大增加了候选transformer层的结构类型,进而增加了搜索得到具有更优性能的transformer模型的可能。

24.在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算。

25.在一种可能的实现中,该目标变换矩阵仅包括x个变换矩阵,该x为小于或等于4的正整数,且该x的数量为基于采样的方式确定的。

26.例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

27.例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

28.在一种可能的实现中,可以基于采样的方式,来确定该目标变换矩阵包括的变换矩阵的矩阵类型,该矩阵类型为q变换矩阵、k变换矩阵或者v变换矩阵,或者是预先设置该目标变换矩阵包括的变换矩阵的矩阵类型,这里并不限定。当通过采样的方式来确定目标变换矩阵包括的变换矩阵的矩阵类型时,可以增加目标注意力头head的结构的可能性,进而可以搜索得到性能更好的模型。

29.在一种可能的实现中,该目标注意力head还包括第二线性变换层,该第二线性变换层用于对该多个算子的数据处理结果进行线性变换,以得到该目标注意力head的输出向量。

30.在一种可能的实现中,该目标注意力head的输入向量和该目标注意力head的输出

向量的尺寸大小一致。

31.其中,在仅针对transformer层中的注意力头head进行搜索重新确定结构的情况下,为了保证transformer层的其他网络层的工作不受影响,可以保留现有技术中注意力头head的输入和输出之间的关系特性,也就是保证目标注意力head的输入向量和该目标注意力head的输出向量的尺寸大小一致,通过上述方式,降低了transformer层其他网络层需要适配性修改的成本,进而提高了网络的搜索效率。

32.在一种可能的实现中,该目标注意力head包括的算子的数量小于预设值,例如预设值可以为10、11、12、14、15、20、21等等。

33.其中,在对注意力头head进行搜索的过程中,设定了算子采样的数量上限,可以保证搜索出来的网络大小不会太大,进而可以搜索出在满足一定的模型大小约束的前提下性能较优的模型。

34.在一种可能的实现中,可以通过算子采样的方式来构建transformer模型中的目标transformer层,具体的,可以通过算子采样的方式来构建transformer模型中目标transformer层中的目标注意力头head,其中,目标transformer层可以包括多个注意力头head,目标注意力头head可以为多个注意力头head中的任意一个,可选的,多个注意力头head中的每个注意力头head的之间的结构相同。

35.在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层,该目标transformer层在该多个网络层中的位置为基于采样的方式确定的。

36.其中,和现有的transformer模型中各个串行的网络层的网络层类型都是transformer层相比,基于采样的方式确定网络层的网络类型(例如为目标transformer层或者是后续的目标网络层),可以大大增加了候选transformer层的结构类型,进而增加了搜索得到具有更优性能的transformer模型的可能。

37.在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层以及目标网络层,该目标网络层包括卷积层。其中,该卷积层中的卷积核可以为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

38.在一种可能的实现中,可以通过采样或者固定设置的方式,确定候选神经网络中的网络层的类型为包括卷积层的目标网络层,并通过从第二搜索空间中进行采样的方式来确定目标网络层中卷积层中卷积核的大小。

39.本技术实施例中,设计了多样化的搜索空间,同时包含局部(卷积层中的卷积核)和全局算子(transformer层中的算子)。其中,全局算子能够结合数学基础运算符构造新型注意力机制,局部算子包含多种不同大小的卷积核。通过全局算子与局部算子的结合,能够更有效的捕捉到词与词,句子与句子之间的关联关系,提高搜索得到的模型的性能。此外,本技术实施例中的神经网络模型可以作为预训练模型,且适配于多种下游任务。

40.在一种可能的实现中,由于轻量化卷积lightweight convolution在一系列自然语言理解任务上(如机器翻译)取得较好表现,卷积核可以使用lightweight convolution架构,来提升模型的性能。

41.在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层(feed forward net,ffn)、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层

的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。也就是说,可以将现有的transformer层中的加和与归一化层、ffn以及残差连接的架构保留,而将注意力头head替换为卷积层,进而可以得到本技术实施例中的目标网络层,其中替换的卷积层类型可以通过从第二搜索空间中进行卷积核采样的方式得到。

42.在一种可能的实现中,该多个候选神经网络包括目标候选神经网络;该获取多个候选神经网络,具体包括:构建该目标候选神经网络中的目标注意力head;

43.该构建该目标候选神经网络中的目标注意力head,包括:

44.获取第一神经网络,其中,该第一神经网络包括第一transformer层,该第一transformer层包括第一注意力head,该第一注意力head包括的多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;

45.根据该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响,从该m个候选算子中确定替换算子,并将该第一注意力head中的该目标算子替换为该替换算子,以得到该目标注意力head。

46.在一种可能的实现中,通过采样可以构建多个候选神经网络,为了能够选取性能较好的模型,候选神经网络的采样数量很多,可以通过训练来确定多个候选神经网络的性能,并基于多个候选神经网络的性能,从多个候选神经网络中初步选取一定数量的网络作为父网络,之后可以对父网络进行算子的替换(若是transformer层,则是进行注意力头head中的算子的替换,若是目标网络层,则可以进行卷积核的替换),得到多个子网络,并对多个子网络进行训练来确定多个子网络的性能,并基于多个子网络的性能,从多个子网络中确定目标神经网络,作为神经网络的搜索结果。

47.其中,上述初始构建的候选神经网络可以称之为第二神经网络,父网络可以称之为第一神经网络,子网络可以称之为候选神经网络。

48.本技术实施例中,可以通过采样的方式获取多个第二神经网络(具体可以参照上述实施例中采样得到候选神经网络的描述,这里不再赘述),并对该多个第二神经网络进行训练,以得到多个训练后的第二神经网络以及该多个训练后的第二神经网络的性能,具体的,可以对多个第二神经网络的进行随机参数初始化,并对多个第二神经网络进行快速搜索训练(例如通过4w步训练),以得到多个训练后的第二神经网络,并利用glue任务对多个训练后的第二神经网络进行测评,以得到多个第二神经网络的性能,选择最优的n个网络作为父网络,并将父网络的训练参数进行保存。其中,n个父网络可以包括第一神经网络。其中,该第一神经网络可以包括第一transformer层,该第一transformer层包括第一注意力head,且该第一注意力head包括目标算子,之后可以根据该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响,从该m个候选算子中确定替换算子,并将该第一注意力head中的该目标算子替换为该替换算子,以得到该目标注意力head。

49.在一种可能的实现中,该获取第一神经网络,包括:

50.获取多个第二神经网络,并对该多个第二神经网络进行训练,以得到多个训练后的第二神经网络以及该多个训练后的第二神经网络的性能;

51.根据该多个训练后的第二神经网络的性能,从该多个训练后的第二神经网络中选择性能满足预设要求的n个训练后的第二神经网络,该n个训练后的第二神经网络包括该第一神经网络。

52.以该目标算子为例,目标算子可以位于该第二神经网络的目标算子位置,其中,目标算子位置可以在一定程度上表示出距离head的输入的位置,目标算子位置可以与代码上表示网络算子之间的位置方式有关,在计算正向影响时,各个算子在第二神经网络的位置的计算方式与目标算子在第二神经网络的目标算子位置的计算方式一致,都可以表达出算子位于注意力头head的不同位置对于模型性能正向影响的程度。在计算正向影响时,可以根据每个该多个训练后的第二神经网络中位于该目标算子位置的算子以及该多个训练后的第二神经网络的性能,和/或,每个该训练后的第二神经网络中位于该目标算子位置的算子的出现频次,来确定该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响。

53.示例性的,正向影响可以通过置信区间上界ucb(upper confidence bound)来表示,具体的ucb分数计算方式可以为:

[0054][0055]

其中,μ

i

表示算子i在这个网络结构当前位置中获得的分数,n

i

表示算子i在历史上(采样第二神经网络时)被采样的次数,n表示所有算子被采样的次数。当某个算子很少被采样时,公式右半部分的会获得较大数值,以更大概率选择当前算子。应理解,在每个位置的每个算子的ucb分数计算完后,可以会对这些分数做softmax计算,获得一个概率分布。并将该概率设为在当前位置算子i被激活的概率。

[0056]

本技术实施例利用正向影响来进行算子替换,能够均衡算法的搜索精度和搜索广度,能够避免陷入局部最优,持续搜索到更优的网络架构。

[0057]

在一种可能的实现中,该方法还包括:

[0058]

根据该第一神经网络,对该目标候选神经网络进行参数初始化,以得到初始化后的该目标候选神经网络;其中,该初始化后的该目标候选神经网络中的可更新参数为对该第一神经网络中相同的位置的可更新参数进行参数共享得到的;

[0059]

对进行参数初始化的该目标候选神经网络进行训练,以得到该目标候选神经网络的性能。

[0060]

其中,在进行注意力头head的参数共享时,可更新参数为注意力头head中变换矩阵中的参数;在进行卷积层的参数共享时,可更新参数为卷积核;应理解,可以选择卷积核最中心位置的相应参数进行参数共享。

[0061]

本技术实施例中,通过参数共享的方式进行参数初始化,可以加快搜索速度,避免重复训练,极大加速搜索效率。

[0062]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0063]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0064]

第二方面,本技术提供了一种模型提供方法,该方法包括:

[0065]

接收端侧发送的性能要求,该性能要求用于指示神经网络的性能要求,该性能要

求可以包括如下的至少一种:数据处理精度、模型大小以及实现的任务类型;

[0066]

根据所述性能要求,从多个候选神经网络中获取满足所述性能要求的目标神经网络,其中,所述多个候选神经网络中的至少一个候选神经网络包括目标transformer层,所述目标transformer层包括目标注意力头head,所述目标注意力head包括多个算子,且所述多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;

[0067]

向该端侧发送该目标神经网络。

[0068]

在一种可能的实现中,该第一搜索空间包括多个候选算子,该候选算子为一元运算符或二元运算符;该目标注意力head为基于该多个算子以及该多个算子之间的排列关系构建的,该多个算子之间的排列关系为基于采样的方式确定的。

[0069]

在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算;其中,该目标变换矩阵仅包括x个变换矩阵,该x为小于或等于4的正整数,且该x的数量为基于采样的方式确定的。

[0070]

例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0071]

例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

[0072]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层,该目标transformer层在该多个网络层中的位置为基于采样的方式确定的。

[0073]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层以及目标网络层,该目标网络层包括卷积层。

[0074]

在一种可能的实现中,该目标网络层在该多个网络层中的位置为基于采样的方式确定的。

[0075]

在一种可能的实现中,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0076]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0077]

第三方面,本技术提供了一种神经网络搜索方法,该方法包括:

[0078]

获取多个候选神经网络;其中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括目标transformer层以及目标网络层,该目标网络层包括卷积层,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的;

[0079]

基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。

[0080]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0081]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积

层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0082]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0083]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0084]

第四方面,本技术提供了一种数据处理方法,该方法包括:

[0085]

获取目标神经网络,该目标神经网络包括串行的多个网络层,该多个网络层包括目标transformer层以及目标网络层,该目标网络层包括卷积层;

[0086]

获取待处理数据,通过该目标神经网络对该待处理数据进行处理,以得到数据处理结果。

[0087]

在一种可能的实现中,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,该多个算子为一元运算符或二元运算符。

[0088]

在一种可能的实现中,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的。

[0089]

在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算。

[0090]

在一种可能的实现中,该目标变换矩阵仅包括x个变换矩阵,该x为小于或等于4的正整数。

[0091]

例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0092]

例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

[0093]

在一种可能的实现中,该x的数量为基于采样的方式确定的。具体可以基于采样的方式,来确定该目标变换矩阵包括的变换矩阵的矩阵类型,该矩阵类型为q变换矩阵、k变换矩阵或者v变换矩阵,或者是预先设置该目标变换矩阵包括的变换矩阵的矩阵类型,这里并不限定。当通过采样的方式来确定目标变换矩阵包括的变换矩阵的矩阵类型时,可以增加目标注意力头head的结构的可能性,进而可以搜索得到性能更好的模型。

[0094]

在一种可能的实现中,该目标注意力head还包括第二线性变换层,该第二线性变换层用于对该多个算子的数据处理结果进行线性变换,以得到该目标注意力head的输出向量。

[0095]

在一种可能的实现中,该目标注意力head的输入向量和该目标注意力head的输出向量的尺寸大小一致。

[0096]

在一种可能的实现中,该目标注意力head包括的算子的数量小于预设值,例如预设值可以为10、11、12、14、15、20、21等等。

[0097]

在一种可能的实现中,目标transformer层可以包括多个注意力头head,目标注意力头head可以为多个注意力头head中的任意一个,可选的,多个注意力头head中的每个注

意力头head的之间的结构相同。

[0098]

在一种可能的实现中,该目标transformer层在该多个网络层中的位置为基于采样的方式确定的。

[0099]

在一种可能的实现中,该卷积层中的卷积核可以为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0100]

在一种可能的实现中,该卷积层包括于该多个网络层中的目标网络层,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0101]

在一种可能的实现中,该目标网络层在该多个网络层中的位置为基于采样的方式确定的。

[0102]

第五方面,本技术提供了一种模型提供方法,该方法包括:

[0103]

接收端侧发送的性能要求,该性能要求用于指示神经网络的性能要求,该性能要求可以包括如下的至少一种:数据处理精度、模型大小以及实现的任务类型;

[0104]

根据所述性能要求,从多个候选神经网络中获取满足所述性能要求的目标神经网络,其中,该目标神经网络包括目标transformer层以及目标网络层,该目标网络层包括卷积层,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的;

[0105]

向该端侧发送该目标神经网络。

[0106]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0107]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0108]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0109]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0110]

第六方面,一种神经网络搜索装置,其特征在于,该装置包括:

[0111]

获取模块,用于获取多个候选神经网络;其中,该多个候选神经网络中的至少一个候选神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;

[0112]

模型选择模块,用于基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。

[0113]

在一种可能的实现中,该第一搜索空间包括多个候选算子,该候选算子为一元运算符或二元运算符。其中一元运算符(unary operation)是指只对一个数据执行操作,例如负数操作(neg)、开根号操作(sqrt)、转置操作(transpose)、softmax操作、logsigmoid操

作、softsign操作等等,二元运算符(binary operation)是指对两个数据进行操作得到第三个数据的一种规则,例如加和操作(add)、点乘操作(matmul)、cosine similarity操作以及euclidean distance操作。

[0114]

在一种可能的实现中,该多个候选算子包括softmax算子以及点乘算子。

[0115]

在一种可能的实现中,可以采样第一搜索空间的候选算子来构建目标注意力head,具体的,可以从第一搜索空间中采样多个算子,以及采样多个算子之间的连接关系。也就是说,在构建目标注意力head时,目标注意力head中包括的各个算子的类型、数量以及连接关系都可以是基于采样的方式确定的,进而,可以基于采样得到的多个算子,以及采样多个算子之间的连接关系来构建目标注意力头head。

[0116]

在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算。

[0117]

在一种可能的实现中,该目标变换矩阵仅包括x个变换矩阵,该x为小于或等于4的正整数,且该x的数量为基于采样的方式确定的。

[0118]

例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0119]

例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

[0120]

在一种可能的实现中,该目标注意力head还包括第二线性变换层,该第二线性变换层用于对该多个算子的数据处理结果进行线性变换,以得到该目标注意力head的输出向量。

[0121]

在一种可能的实现中,该目标注意力head的输入向量和该目标注意力head的输出向量的尺寸大小一致。

[0122]

在一种可能的实现中,该目标注意力head包括的算子的数量小于预设值。

[0123]

在一种可能的实现中,可以通过算子采样的方式来构建transformer模型中的目标transformer层,具体的,可以通过算子采样的方式来构建transformer模型中目标transformer层中的目标注意力头head,其中,目标transformer层可以包括多个注意力头head,目标注意力头head可以为多个注意力头head中的任意一个,可选的,多个注意力头head中的每个注意力头head的之间的结构相同。

[0124]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层,该目标transformer层在该多个网络层中的位置为基于采样的方式确定的。

[0125]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层以及目标网络层,该目标网络层包括卷积层。其中,该卷积层中的卷积核可以为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0126]

在一种可能的实现中,可以通过采样或者固定设置的方式,确定候选神经网络中的网络层的类型为包括卷积层的目标网络层,并通过从第二搜索空间中进行采样的方式来

确定目标网络层中卷积层中卷积核的大小。

[0127]

本技术实施例中,设计了多样化的搜索空间,同时包含局部(卷积层中的卷积核)和全局算子(transformer层中的算子)。其中,全局算子能够结合数学基础运算符构造新型注意力机制,局部算子包含多种不同大小的卷积核。通过全局算子与局部算子的结合,能够更有效的捕捉到词与词,句子与句子之间的关联关系,提高搜索得到的模型的性能。此外,本技术实施例中的神经网络模型可以作为预训练模型,且适配于多种下游任务。

[0128]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0129]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。也就是说,可以将现有的transformer层中的加和与归一化层、ffn以及残差连接的架构保留,而将注意力头head替换为卷积层,进而可以得到本技术实施例中的目标网络层,其中替换的卷积层类型可以通过从第二搜索空间中进行卷积核采样的方式得到。

[0130]

在一种可能的实现中,该多个候选神经网络包括目标候选神经网络;该获取模块,具体用于:构建该目标候选神经网络中的目标注意力head;

[0131]

该构建该目标候选神经网络中的目标注意力head,包括:

[0132]

获取第一神经网络,其中,该第一神经网络包括第一transformer层,该第一transformer层包括第一注意力head,该第一注意力head包括的多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;

[0133]

根据该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响,从该m个候选算子中确定替换算子,并将该第一注意力head中的该目标算子替换为该替换算子,以得到该目标注意力head。

[0134]

在一种可能的实现中,该获取模块,具体用于:

[0135]

获取多个第二神经网络,并对该多个第二神经网络进行训练,以得到多个训练后的第二神经网络以及该多个训练后的第二神经网络的性能;

[0136]

根据该多个训练后的第二神经网络的性能,从该多个训练后的第二神经网络中选择性能满足预设要求的n个训练后的第二神经网络,该n个训练后的第二神经网络包括该第一神经网络。

[0137]

在一种可能的实现中,该目标算子位于该第二神经网络的目标算子位置;该装置还包括:

[0138]

确定模块,用于根据每个该多个训练后的第二神经网络中位于该目标算子位置的算子以及该多个训练后的第二神经网络的性能,和/或,每个该训练后的第二神经网络中位于该目标算子位置的算子的出现频次,确定该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响。

[0139]

在一种可能的实现中,该装置还包括:

[0140]

参数初始化模块,用于根据该第一神经网络,对该目标候选神经网络进行参数初始化,以得到初始化后的该目标候选神经网络;其中,该初始化后的该目标候选神经网络中

的可更新参数为对该第一神经网络中相同的位置的可更新参数进行参数共享得到的;

[0141]

模型训练模块,用于对进行参数初始化的该目标候选神经网络进行训练,以得到该目标候选神经网络的性能。

[0142]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0143]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0144]

第七方面,本技术提供了一种模型提供装置,该装置包括:

[0145]

接收模块,用于接收端侧发送的性能要求,该性能要求用于指示神经网络的性能要求,该性能要求可以包括如下的至少一种:数据处理精度、模型大小以及实现的任务类型;

[0146]

获取模块,用于根据所述性能要求,从多个候选神经网络中获取满足所述性能要求的目标神经网络,其中,该目标神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;

[0147]

发送模块,用于向该端侧发送该目标神经网络。

[0148]

在一种可能的实现中,该候选算子为一元运算符或二元运算符;该目标注意力head为基于该多个算子以及该多个算子之间的排列关系构建的,该多个算子之间的排列关系为基于采样的方式确定的。

[0149]

在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算;其中,该目标变换矩阵仅包括x个变换矩阵,该x为小于或等于4的正整数,且该x的数量为基于采样的方式确定的。

[0150]

例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0151]

例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

[0152]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层,该目标transformer层在该多个网络层中的位置为基于采样的方式确定的。

[0153]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层以及目标网络层,该目标网络层包括卷积层。

[0154]

在一种可能的实现中,该目标网络层在该多个网络层中的位置为基于采样的方式确定的。

[0155]

在一种可能的实现中,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0156]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0157]

第八方面,本技术提供了一种神经网络搜索装置,该装置包括:

[0158]

获取模块,用于获取多个候选神经网络;其中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括目标transformer层以及目标网络层,该目标网络层包括卷积层,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的;

[0159]

模型选择模块,用于基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。

[0160]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0161]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0162]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0163]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0164]

第九方面,本技术提供了一种数据处理装置,该装置包括:

[0165]

获取模块,用于获取目标神经网络,该目标神经网络包括串行的多个网络层,该多个网络层包括目标transformer层以及目标网络层,该目标网络层包括卷积层;该获取模块还用于获取待处理数据;

[0166]

数据处理模块,用于通过该目标神经网络对该待处理数据进行处理,以得到数据处理结果。

[0167]

在一种可能的实现中,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,该多个算子为一元运算符或二元运算符。

[0168]

在一种可能的实现中,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的。

[0169]

在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算。

[0170]

在一种可能的实现中,该目标变换矩阵仅包括x个变换矩阵,该x为小于或等于4的正整数。

[0171]

例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0172]

例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

[0173]

在一种可能的实现中,该x的数量为基于采样的方式确定的。具体可以基于采样的方式,来确定该目标变换矩阵包括的变换矩阵的矩阵类型,该矩阵类型为q变换矩阵、k变换

矩阵或者v变换矩阵,或者是预先设置该目标变换矩阵包括的变换矩阵的矩阵类型,这里并不限定。当通过采样的方式来确定目标变换矩阵包括的变换矩阵的矩阵类型时,可以增加目标注意力头head的结构的可能性,进而可以搜索得到性能更好的模型。

[0174]

在一种可能的实现中,该目标注意力head还包括第二线性变换层,该第二线性变换层用于对该多个算子的数据处理结果进行线性变换,以得到该目标注意力head的输出向量。

[0175]

在一种可能的实现中,该目标注意力head的输入向量和该目标注意力head的输出向量的尺寸大小一致。

[0176]

在一种可能的实现中,该目标注意力head包括的算子的数量小于预设值,例如预设值可以为10、11、12、14、15、20、21等等。

[0177]

在一种可能的实现中,目标transformer层可以包括多个注意力头head,目标注意力头head可以为多个注意力头head中的任意一个,可选的,多个注意力头head中的每个注意力头head的之间的结构相同。

[0178]

在一种可能的实现中,该目标transformer层在该多个网络层中的位置为基于采样的方式确定的。

[0179]

在一种可能的实现中,该卷积层中的卷积核可以为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0180]

在一种可能的实现中,该卷积层包括于该多个网络层中的目标网络层,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0181]

在一种可能的实现中,该目标网络层在该多个网络层中的位置为基于采样的方式确定的。

[0182]

第十方面,本技术提供了一种模型提供装置,该装置包括:

[0183]

接收模块,用于接收端侧发送的性能要求,该性能要求用于指示神经网络的性能要求,该性能要求可以包括如下的至少一种:数据处理精度、模型大小以及实现的任务类型;

[0184]

获取模块,用于根据所述性能要求,从多个候选神经网络中获取满足所述性能要求的目标神经网络,其中,该目标神经网络包括目标transformer层以及目标网络层,该目标网络层包括卷积层,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的;

[0185]

发送模块,用于向该端侧发送该目标神经网络。

[0186]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0187]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0188]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0189]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0190]

第十一方面,本技术实施例提供了一种神经网络搜索装置,可以包括存储器、处理器以及总线系统,其中,存储器用于存储程序,处理器用于执行存储器中的程序,以执行如上述第一方面及其任一可选的方法,以及上述第三方面及其任一可选的方法。

[0191]

第十二方面,本技术实施例提供了一种模型提供装置,可以包括存储器、处理器以及总线系统,其中,存储器用于存储程序,处理器用于执行存储器中的程序,以执行如上述第二方面及其任一可选的方法,以及上述第五方面及其任一可选的方法。

[0192]

第十三方面,本技术实施例提供了一种数据处理装置,可以包括存储器、处理器以及总线系统,其中,存储器用于存储程序,处理器用于执行存储器中的程序,以执行如上述第四方面及其任一可选的方法。

[0193]

第十四方面,本技术实施例提供了一种计算机可读存储介质,该计算机可读存储介质中存储有计算机程序,当其在计算机上运行时,使得计算机执行上述第一方面及其任一可选的方法、上述第二方面及其任一可选的方法、上述第三方面及其任一可选的方法、上述第四方面及其任一可选的方法以及上述第五方面及其任一可选的方法。

[0194]

第十五方面,本技术实施例提供了一种计算机程序,当其在计算机上运行时,使得计算机执行上述第一方面及其任一可选的方法、上述第二方面及其任一可选的方法、上述第三方面及其任一可选的方法、上述第四方面及其任一可选的方法以及上述第五方面及其任一可选的方法。

[0195]

第十六方面,本技术提供了一种芯片系统,该芯片系统包括处理器,用于支持执行设备或训练设备实现上述方面中所涉及的功能,例如,发送或处理上述方法中所涉及的数据;或,信息。在一种可能的设计中,该芯片系统还包括存储器,该存储器,用于保存执行设备或训练设备必要的程序指令和数据。该芯片系统,可以由芯片构成,也可以包括芯片和其他分立器件。

[0196]

本技术实施例提供了一种神经网络搜索方法,该方法包括:获取多个候选神经网络;其中,该多个候选神经网络中的至少一个候选神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。通过上述方式,结合模型搜索,能生成相比原自注意力机制更强的新型注意力结构,在广泛的下游任务中取得明显效果提升。

[0197]

应理解,上述各方面描述的方法以及装置之间在不存在技术矛盾的情况下,可以相互引用、组合、解释。

附图说明

[0198]

图1为人工智能主体框架的一种结构示意图;

[0199]

图2为一种神经网络搜索系统;

[0200]

图3为一种神经网络搜索系统;

[0201]

图4为一种神经网络搜索系统;

[0202]

图5为一种神经网络搜索系统;

[0203]

图6为一种自然语言处理系统;

[0204]

图7为一种自然语言处理系统;

[0205]

图8为本技术实施例提供的自然语言处理的相关设备的示意图;

[0206]

图9为卷积神经网络的示意图;

[0207]

图10为卷积神经网络的示意图;

[0208]

图11为本技术实施例提供的一种系统架构的结构示意;

[0209]

图12为本技术实施例提供的一种神经网络搜索方法的实施例示意;

[0210]

图13为一种transformer模型的结构示意;

[0211]

图14为一种transformer层的结构示意;

[0212]

图15为本技术实施例提供的一种目标注意力head的结构示意;

[0213]

图16至21为通过采样的方式得到的目标注意力头head的结构示意;

[0214]

图22为一个候选神经网络的结构示意;

[0215]

图23为本技术实施例提供的一种目标网络层的示意;

[0216]

图24为本技术实施例提供的一种参数共享示意;

[0217]

图25为本技术实施例提供的一种参数共享示意;

[0218]

图26为基于本技术实施例提供神经网络搜索算法得到的网络架构搜索结果;

[0219]

图27为本技术实施例提供的一种模型提供方法的实施例示意;

[0220]

图28为本技术实施例提供的一种神经网络搜索方法的实施例示意;

[0221]

图29为本技术实施例提供的一种模型提供方法的实施例示意;

[0222]

图30为本技术实施例提供的一种神经网络搜索装置的实施例示意;

[0223]

图31为本技术实施例提供的一种模型提供装置的实施例示意;

[0224]

图32为本技术实施例提供的一种神经网络搜索装置的实施例示意;

[0225]

图33为本技术实施例提供的一种模型提供装置的实施例示意;

[0226]

图34为本技术实施例提供的执行设备的一种结构示意图;

[0227]

图35是本技术实施例提供的训练设备一种结构示意图;

[0228]

图36为本技术实施例提供的芯片的一种结构示意图。

具体实施方式

[0229]

下面结合本发明实施例中的附图对本发明实施例进行描述。本发明的实施方式部分使用的术语仅用于对本发明的具体实施例进行解释,而非旨在限定本发明。

[0230]

下面结合附图,对本技术的实施例进行描述。本领域普通技术人员可知,随着技术的发展和新场景的出现,本技术实施例提供的技术方案对于类似的技术问题,同样适用。

[0231]

本技术的说明书和权利要求书及上述附图中的术语“第一”、“第二”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的术语在适当情况下可以互换,这仅仅是描述本技术的实施例中对相同属性的对象在描述时所采用的区分方式。此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,以便包含一系列单元的过程、方法、系统、产品或设备不必限于那些单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它单元。

[0232]

首先对人工智能系统总体工作流程进行描述,请参见图1,图1示出的为人工智能主体框架的一种结构示意图,下面从“智能信息链”(水平轴)和“it价值链”(垂直轴)两个维度对上述人工智能主题框架进行阐述。其中,“智能信息链”反映从数据的获取到处理的一列过程。举例来说,可以是智能信息感知、智能信息表示与形成、智能推理、智能决策、智能执行与输出的一般过程。在这个过程中,数据经历了“数据—信息—知识—智慧”的凝练过程。“it价值链”从人智能的底层基础设施、信息(提供和处理技术实现)到系统的产业生态过程,反映人工智能为信息技术产业带来的价值。

[0233]

(1)基础设施

[0234]

基础设施为人工智能系统提供计算能力支持,实现与外部世界的沟通,并通过基础平台实现支撑。通过传感器与外部沟通;计算能力由智能芯片(cpu、npu、gpu、asic、fpga等硬件加速芯片)提供;基础平台包括分布式计算框架及网络等相关的平台保障和支持,可以包括云存储和计算、互联互通网络等。举例来说,传感器和外部沟通获取数据,这些数据提供给基础平台提供的分布式计算系统中的智能芯片进行计算。

[0235]

(2)数据

[0236]

基础设施的上一层的数据用于表示人工智能领域的数据来源。数据涉及到图形、图像、语音、文本,还涉及到传统设备的物联网数据,包括已有系统的业务数据以及力、位移、液位、温度、湿度等感知数据。

[0237]

(3)数据处理

[0238]

数据处理通常包括数据训练,机器学习,深度学习,搜索,推理,决策等方式。

[0239]

其中,机器学习和深度学习可以对数据进行符号化和形式化的智能信息建模、抽取、预处理、训练等。

[0240]

推理是指在计算机或智能系统中,模拟人类的智能推理方式,依据推理控制策略,利用形式化的信息进行机器思维和求解问题的过程,典型的功能是搜索与匹配。

[0241]

决策是指智能信息经过推理后进行决策的过程,通常提供分类、排序、预测等功能。

[0242]

(4)通用能力

[0243]

对数据经过上面提到的数据处理后,进一步基于数据处理的结果可以形成一些通用的能力,比如可以是算法或者一个通用系统,例如,翻译,文本的分析,计算机视觉的处理,语音识别,图像的识别等等。

[0244]

(5)智能产品及行业应用

[0245]

智能产品及行业应用指人工智能系统在各领域的产品和应用,是对人工智能整体解决方案的封装,将智能信息决策产品化、实现落地应用,其应用领域主要包括:智能终端、智能交通、智能医疗、自动驾驶、智慧城市等。

[0246]

本技术可以但不限于应用于人工智能领域的自然语言处理领域中,具体可以应用于自然语言处理领域的神经网络搜索以及自然语言处理领域的神经网络推理等领域,下面将对多个落地到产品的多个应用场景进行介绍。

[0247]

为了更好地理解本技术实施例的方案,下面先结合图2至图8对本技术实施例可能的应用场景进行简单的介绍。

[0248]

场景1:神经网络搜索

[0249]

参照图2,本技术可以应用于神经网络搜索相关的服务中,具体可以为云侧服务器提供的神经网络架构搜索服务,其中,用户可以通过用户设备将与模型搜索相关的信息传递至云侧的神经网络搜索系统(例如云服务器),其中与模型搜索相关的信息可以为用户对于搜索的模型的性能要求等,进而云侧的服务器可以基于用户上传的性能要求,通过一定的神经网络搜索算法,得到搜索结果(例如本技术实施例中的目标神经网络),并将搜索结果下发至用户设备。

[0250]

图3示出了一种神经网络搜索系统100。该系统可以获取用于训练神经网络的训练数据102、用于评估神经网络的性能的验证数据104、以及性能要求103,并使用训练数据102和验证数据104以及性能要求103确定搜索结果160(例如本技术实施例中的目标神经网络),该搜索结果160配置为满足性能要求103,即,接收输入并生成符合性能要求103的输出。该搜索结果160可以为神经网络的架构信息,该架构信息可以定义神经网络的层数、每个层执行的操作以及神经网络中各层之间的连接,即,哪些层从神经网络中的其他层接收输入。

[0251]

系统100可以以各种方式中的任何一种来接收训练数据102、验证集104以及性能要求103。例如,系统100可以例如使用可用于系统100的应用编程接口(application programming interface,api),通过数据通信网络从系统的远程用户作为上传接收训练数据以及性能要求103,并且将上传的数据随机地划分为训练数据102和验证集104。作为另一个示例,系统100可以从用户接收输入,该输入指定系统100已经维护的哪些数据应当用于训练神经网络,并且然后将指定的数据划分为训练数据102和验证集104。

[0252]

通常,系统100可以通过搜索候选架构的空间以识别一个或多个性能最佳的架构来确定搜索结果160。例如,如图3所示的那样,系统100可以通过搜索候选架构的空间,并通过候选选择引擎130来构建多个候选的神经网络架构(例如本技术实施例中的候选神经网络),并通过训练引擎140对候选的神经网络架构进行模型训练等处理,质量评估引擎150可以对训练结果进行评估,以确定搜索结果160。

[0253]

图4示出了一种神经网络搜索系统,该神经网络搜索系统包括用户设备以及神经网络搜索设备。其中,用户设备包括手机、个人电脑或者信息处理中心等智能终端。用户设备为神经网络搜索的发起端,通常用户通过用户设备发起神经网络搜索请求。

[0254]

上述神经网络搜索设备可以是云服务器、网络服务器、应用服务器以及管理服务器等具有神经网络搜索功能的设备或服务器。神经网络搜索设备通过交互接口接收来自智能终端的神经网络搜索,再通过存储数据的存储器以及处理器环节进行机器学习,深度学习,搜索,推理,决策等方式的神经网络搜索,并将搜索结果(例如本技术实施例中的目标神经网络)反馈至用户设备。神经网络搜索设备中的存储器可以是一个统称,包括本地存储以及存储历史数据的数据库,数据库可以在数据处理设备上,也可以在其它网络服务器上。

[0255]

在图4所示的神经网络搜索系统中,用户设备可以接收用户的指令,例如用户设备可以接收用户输入的针对于神经网络搜索的模型性能要求,然后向神经网络搜索设备发起请求。

[0256]

在图4中,神经网络搜索设备可以执行本技术实施例的神经网络搜索方法。

[0257]

图5示出了另一种神经网络搜索系统,在图5中,用户设备直接作为神经网络搜索设备,该用户设备能够直接接收来自用户输入的针对于神经网络搜索的模型性能要求并直

接由用户设备本身的硬件进行神经网络搜索,具体过程与图4相似,可参考上面的描述,在此不再赘述。

[0258]

在图5中,用户设备自身就可以执行本技术实施例的神经网络搜索方法。

[0259]

场景2:自然语言处理

[0260]

图6示出了一种自然语言处理系统,该自然语言处理系统包括用户设备以及数据处理设备。其中,用户设备包括手机、个人电脑或者信息处理中心等智能终端。用户设备为自然语言数据处理的发起端,作为语言问答或者查询等请求的发起方,通常用户通过用户设备发起请求。

[0261]

上述数据处理设备可以是云服务器、网络服务器、应用服务器以及管理服务器等具有数据处理功能的设备或服务器。数据处理设备通过交互接口接收来自智能终端的查询语句/语音/文本等问句(例如本技术实施例中的待处理数据),再通过存储数据的存储器以及数据处理的处理器环节进行机器学习,深度学习,搜索,推理,决策等方式的语言数据处理(例如通过本技术实施例中的目标神经网络进行数据处理),并将处理结果(例如本技术实施例中的数据处理结果)反馈至用户设备。数据处理设备中的存储器可以是一个统称,包括本地存储以及存储历史数据的数据库,数据库可以在数据处理设备上,也可以在其它网络服务器上。

[0262]

在图6所示的自然语言处理系统中,用户设备可以接收用户的指令,例如用户设备可以接收用户输入的一段文本,然后向数据处理设备发起请求,使得数据处理设备针对用户设备得到的该一段文本执行自然语言处理应用(例如文本分类、文本推理、命名实体识别、翻译等),从而得到针对该一段文本的对应的自然语言处理应用的处理结果(例如分类结果、推理结果、命名实体识别结果、翻译结果等)。示例性的,用户设备可以接收用户输入的一段中文,然后向数据处理设备发起请求,使得数据处理设备对该一段中文进行实体分类,从而得到针对该一段中文的实体分类结果;示例性的,用户设备可以接收用户输入的一段中文,然后向数据处理设备发起请求,使得数据处理设备将该一段中文翻译成英文,从而得到针对该一段中文的英文译文。

[0263]

图7示出了另一种自然语言处理系统,在图7中,用户设备直接作为数据处理设备,该用户设备能够直接接收来自用户的输入(例如本技术实施例中的待处理数据)并直接由用户设备本身的硬件进行处理,具体过程与图6相似,可参考上面的描述,在此不再赘述。

[0264]

在图7所示的自然语言处理系统中,用户设备可以接收用户的指令,例如用户设备可以接收用户输入的一段文本,然后再由用户设备自身针对该一段文本执行自然语言处理应用(例如文本分类、文本推理、命名实体识别、翻译等),从而得到针对该一段文本的对应的自然语言处理应用的处理结果(例如分类结果、推理结果、命名实体识别结果、翻译结果等)。示例性的,用户设备可以接收用户输入的一段中文,并针对该一段中文进行实体分类,从而得到针对该一段中文的实体分类结果;示例性的,用户设备可以接收用户输入的一段中文,并将该一段中文翻译成英文,从而得到针对该一段中文的英文译文。

[0265]

在本技术实施例中,用户设备可以存储有目标神经网络,并在每次操作系统(operating system,os)或应用程序(application,app)调用该模型后,根据目标神经网络执行推理任务。

[0266]

图8是本技术实施例提供的自然语言处理的相关设备300的示意图。

[0267]

上述图6和图7中的用户设备具体可以是图8中的本地设备301或者本地设备302,图6中的数据处理设备具体可以是图8中的执行设备310,其中,数据存储系统350可以存储执行设备310的待处理数据,数据存储系统350可以集成在执行设备310上,也可以设置在云上或其它网络服务器上。

[0268]

图6和图7中的处理器可以通过神经网络模型或者其它模型进行数据训练/机器学习/深度学习,并利用训练得到的模型(例如本技术实施例中的目标神经网络)针对文本序列执行自然语言处理应用(例如文本分类、序列标注、阅读理解、文本生成、文本推理、翻译等),从而得到相应的处理结果。

[0269]

由于本技术实施例涉及大量神经网络的应用,为了便于理解,下面先对本技术实施例涉及的相关术语及神经网络等相关概念进行介绍。

[0270]

(1)神经网络

[0271]

神经网络可以是由神经单元组成的,神经单元可以是指以xs和截距1为输入的运算单元,该运算单元的输出可以为:

[0272]

其中,s=1、2、

……

n,n为大于1的自然数,ws为xs的权重,b为神经单元的偏置。f为神经单元的激活函数(activation functions),用于将非线性特性引入神经网络中,来将神经单元中的输入信号转换为输出信号。该激活函数的输出信号可以作为下一层卷积层的输入,激活函数可以是sigmoid函数。神经网络是将多个上述单一的神经单元联结在一起形成的网络,即一个神经单元的输出可以是另一个神经单元的输入。每个神经单元的输入可以与前一层的局部接受域相连,来提取局部接受域的特征,局部接受域可以是由若干个神经单元组成的区域。

[0273]

(2)transformer层

[0274]

神经网络可以包括嵌入层和至少一个transformer层,至少一个transformer层可以为n个transformer层(n大于0的整数),其中,每个transformer层包括依次相邻的注意力层、加和与归一化(add&norm)层、前馈(feed forward)层和加和与归一化层。在嵌入层,对当前输入进行嵌入处理,得到多个特征向量;在该注意力层,从该第一transformer层的上一层获取p个输入向量,以p个输入向量中的任意的第一输入向量为中心,基于预设的注意力窗口范围内的各个输入向量与该第一输入向量之间的关联度,得到该第一输入向量对应的中间向量,如此确定出p个输入向量对应的p个中间向量;在该池化层,将该p个中间向量合并为q个输出向量,其中transformer层中最后一个transformer层得到的多个输出向量用作该当前输入的特征表示。

[0275]

接下来,结合具体例子对上述各步骤进行具体介绍。

[0276]

首先,在该嵌入层,对当前输入进行嵌入处理,得到多个特征向量。

[0277]

嵌入层可以称为输入嵌入(input embedding)层。当前输入可以为文本输入,例如可以为一段文本,也可以为一个句子。文本可以为中文文本,也可以为英文文本,还可以为其他语言文本。嵌入层在获取当前输入后,可以对该当前输入中各个词进行嵌入处理,可得到各个词的特征向量。在一些实施例中,如图1所示,该嵌入层包括输入嵌入层和位置编码(positional encoding)层。在输入嵌入层,可以对当前输入中的各个词进行词嵌入处理,从而得到各个词的词嵌入向量。在位置编码层,可以获取各个词在该当前输入中的位置,进而对各个词的位置生成位置向量。在一些示例中,各个词的位置可以为各个词在该当前输

入中的绝对位置。以当前输入为“几号应还花呗”为例,其中的“几”的位置可以表示为第一位,“号”的位置可以表示为第二位,

……

。在一些示例中,各个词的位置可以为各个词之间的相对位置。仍以当前输入为“几号应还花呗”为例,其中的“几”的位置可以表示为“号”之前,“号”的位置可以表示为“几”之后、“应”之前,

……

。当得到当前输入中各个词的词嵌入向量和位置向量时,可以将各个词的位置向量和对应的词嵌入向量进行组合,得到各个词特征向量,即得到该当前输入对应的多个特征向量。多个特征向量可以表示为具有预设维度的嵌入矩阵。可以设定该多个特征向量中的特征向量个数为m,预设维度为h维,则该多个特征向量可以表示为m

×

h的嵌入矩阵。

[0278]

其次,可以从transformer层的上一层获取p个输入向量,以p个输入向量中的任意的输入向量为中心,基于预设的注意力窗口范围内的各个输入向量与该输入向量之间的关联度,得到该输入向量对应的中间向量,如此确定出p个输入向量对应的p个中间向量。注意力层也可以称为多头注意力(multi

‑

head attention)层。在一个例子中,注意力层可以为固定窗口多头注意力(fixed window multi

‑

head attention)层。

[0279]

本技术实施例中,基于神经网络搜索对transformer层进行了架构的重新设计。

[0280]

(3)注意力机制(attention mechanism)

[0281]

注意力机制模仿了生物观察行为的内部过程,即一种将内部经验和外部感觉对齐从而增加部分区域的观察精细度的机制,能够利用有限的注意力资源从大量信息中快速筛选出高价值信息。注意力机制可以快速提取稀疏数据的重要特征,因而被广泛用于自然语言处理任务,特别是机器翻译。而自注意力机制(self

‑

attention mechanism)是注意力机制的改进,其减少了对外部信息的依赖,更擅长捕捉数据或特征的内部相关性。注意力机制的本质思想可以改写为如下公式:

[0282]

其中,lx=||source||代表source的长度,公式含义即将source中的构成元素想象成是由一系列的数据对构成,此时给定目标target中的某个元素query,通过计算query和各个key的相似性或者相关性,得到每个key对应value的权重系数,然后对value进行加权求和,即得到了最终的attention数值。所以本质上attention机制是对source中元素的value值进行加权求和,而query和key用来计算对应value的权重系数。从概念上理解,把attention可以理解为从大量信息中有选择地筛选出少量重要信息并聚焦到这些重要信息上,忽略大多不重要的信息。聚焦的过程体现在权重系数的计算上,权重越大越聚焦于其对应的value值上,即权重代表了信息的重要性,而value是其对应的信息。自注意力机制可以理解为内部attention(intra attention),attention机制发生在target的元素query和source中的所有元素之间,自注意力机制指的是在source内部元素之间或者target内部元素之间发生的attention机制,也可以理解为target=source这种特殊情况下的注意力计算机制,其具体计算过程是一样的,只是计算对象发生了变化而已。

[0283]

(4)自然语言处理(natural language processing,nlp)

[0284]

自然语言(natural language)即人类语言,自然语言处理(nlp)就是对人类语言的处理。自然语言处理是以一种智能与高效的方式,对文本数据进行系统化分析、理解与信息提取的过程。通过使用nlp及其组件,我们可以管理非常大块的文本数据,或者执行大量的自动化任务,并且解决各式各样的问题,如自动摘要(automatic summarization),机器翻译(machine translation,mt),命名实体识别(named entity recognition,ner),关系

提取(relation extraction,re),信息抽取(information extraction,ie),情感分析,语音识别(speech recognition),问答系统(question answering)以及主题分割等等。

[0285]

示例性的,自然语言处理任务可以有以下几类。

[0286]

序列标注:句子中每一个单词要求模型根据上下文给出一个分类类别。如中文分词、词性标注、命名实体识别、语义角色标注。

[0287]

分类任务:整个句子输出一个分类值,如文本分类。

[0288]

句子关系推断:给定两个句子,判断这两个句子是否具备某种名义关系。例如entilment、qa、语义改写、自然语言推断。

[0289]

生成式任务:输出一段文本,生成另一段文本。如机器翻译、文本摘要、写诗造句、看图说话。

[0290]

下面示例性的列举一些自然语言处理案例。

[0291]

分词(word segmentation或word breaker,wb):将连续的自然语言文本,切分成具有语义合理性和完整性的词汇序列,可以解决交叉歧义问题。

[0292]

命名实体识别(named entity recognition,ner):识别自然语言文本中具有特定意义的实体(人、地、机构、时间、作品等)。

[0293]

词性标注(part

‑

speech tagging):为自然语言文本中的每个词汇赋予一个词性(名词、动词、形容词等);依存句法分析(dependency parsing):自动分析句子中的句法成分(主语、谓语、宾语、定语、状语和补语等成分),可以解决结构歧义问题。

[0294]

词向量与语义相似度(word embedding&semantic similarity):对词汇进行向量化表示,并据此实现词汇的语义相似度计算,可以解决词汇语言相似度。

[0295]

文本语义相似度(text semantic similarity):依托全网海量数据和深度神经网络技术,实现文本间的语义相似度计算的能力,可以解决文本语义相似度问题。

[0296]

(5)卷积神经网络(convolutional neuron network,cnn)是一种带有卷积结构的深度神经网络。卷积神经网络包含了一个由卷积层和子采样层构成的特征抽取器,该特征抽取器可以看作是滤波器。卷积层是指卷积神经网络中对输入信号进行卷积处理的神经元层。在卷积神经网络的卷积层中,一个神经元可以只与部分邻层神经元连接。一个卷积层中,通常包含若干个特征平面,每个特征平面可以由一些矩形排列的神经单元组成。同一特征平面的神经单元共享权重,这里共享的权重就是卷积核。共享权重可以理解为提取特征的方式与位置无关。卷积核可以以随机大小的矩阵的形式化,在卷积神经网络的训练过程中卷积核可以通过学习得到合理的权重。另外,共享权重带来的直接好处是减少卷积神经网络各层之间的连接,同时又降低了过拟合的风险。

[0297]

cnn是一种非常常见的神经网络,如前文的基础概念介绍该,卷积神经网络是一种带有卷积结构的深度神经网络,是一种深度学习(deep learning)架构,深度学习架构是指通过机器学习的算法,在不同的抽象层级上进行多个层次的学习。作为一种深度学习架构,cnn是一种前馈(feed

‑

forward)人工神经网络,该前馈人工神经网络中的各个神经元可以对输入作出响应。

[0298]

卷积神经网络(cnn)200可以包括输入层210,卷积层/池化层220(其中池化层为可选的),以及全连接层(fully connected layer)230。

[0299]

卷积层/池化层220:

[0300]

卷积层:

[0301]

如图9所示卷积层/池化层220可以包括如示例221

‑

226层,举例来说:在一种实现中,221层为卷积层,222层为池化层,223层为卷积层,224层为池化层,225为卷积层,226为池化层;在另一种实现方式中,221、222为卷积层,223为池化层,224、225为卷积层,226为池化层。即卷积层的输出可以作为随后的池化层的输入,也可以作为另一个卷积层的输入以继续进行卷积操作。

[0302]

下面将以卷积层221为例,介绍一层卷积层的内部工作原理。

[0303]

卷积层221可以包括很多个卷积算子,卷积算子也称为核,其在图像处理中的作用相当于一个从输入图像矩阵中提取特定信息的过滤器,卷积算子本质上可以是一个权重矩阵,这个权重矩阵通常被预先定义,以图像为例(其他数据类型类似),在对图像进行卷积操作的过程中,权重矩阵通常在输入图像上沿着水平方向一个像素接着一个像素(或两个像素接着两个像素

……

这取决于步长stride的取值)的进行处理,从而完成从图像中提取特定特征的工作。该权重矩阵的大小应该与图像的大小相关,需要注意的是,权重矩阵的纵深维度(depth dimension)和输入图像的纵深维度是相同的,在进行卷积运算的过程中,权重矩阵会延伸到输入图像的整个深度。因此,和一个单一的权重矩阵进行卷积会产生一个单一纵深维度的卷积化输出,但是大多数情况下不使用单一权重矩阵,而是应用多个尺寸(行

×

列)相同的权重矩阵,即多个同型矩阵。每个权重矩阵的输出被堆叠起来形成卷积图像的纵深维度,这里的维度可以理解为由上面该的“多个”来决定。不同的权重矩阵可以用来提取图像中不同的特征,例如一个权重矩阵用来提取图像边缘信息,另一个权重矩阵用来提取图像的特定颜色,又一个权重矩阵用来对图像中不需要的噪点进行模糊化等。该多个权重矩阵尺寸(行

×

列)相同,经过该多个尺寸相同的权重矩阵提取后的特征图的尺寸也相同,再将提取到的多个尺寸相同的特征图合并形成卷积运算的输出。

[0304]

这些权重矩阵中的权重值在实际应用中需要经过大量的训练得到,通过训练得到的权重值形成的各个权重矩阵可以用来从输入图像中提取信息,从而使得卷积神经网络200进行正确的预测。

[0305]

当卷积神经网络200有多个卷积层的时候,初始的卷积层(例如221)往往提取较多的一般特征,该一般特征也可以称之为低级别的特征;随着卷积神经网络200深度的加深,越往后的卷积层(例如226)提取到的特征越来越复杂,比如高级别的语义之类的特征,语义越高的特征越适用于待解决的问题。

[0306]

池化层:

[0307]

由于常常需要减少训练参数的数量,因此卷积层之后常常需要周期性的引入池化层,在如图9中220所示例的221

‑

226各层,可以是一层卷积层后面跟一层池化层,也可以是多层卷积层后面接一层或多层池化层。在图像处理过程中,池化层的唯一目的就是减少图像的空间大小。池化层可以包括平均池化算子和/或最大池化算子,以用于对输入图像进行采样得到较小尺寸的图像。平均池化算子可以在特定范围内对图像中的像素值进行计算产生平均值作为平均池化的结果。最大池化算子可以在特定范围内取该范围内值最大的像素作为最大池化的结果。另外,就像卷积层中用权重矩阵的大小应该与图像尺寸相关一样,池化层中的运算符也应该与图像的大小相关。通过池化层处理后输出的图像尺寸可以小于输入池化层的图像的尺寸,池化层输出的图像中每个像素点表示输入池化层的图像的对应子

区域的平均值或最大值。

[0308]

全连接层230:

[0309]

在经过卷积层/池化层220的处理后,卷积神经网络200还不足以输出所需要的输出信息。因为如前该,卷积层/池化层220只会提取特征,并减少输入图像带来的参数。然而为了生成最终的输出信息(所需要的类信息或其他相关信息),卷积神经网络200需要利用全连接层230来生成一个或者一组所需要的类的数量的输出。因此,在全连接层230中可以包括多层隐含层(如图9所示的231、232至23n),该多层隐含层中所包含的参数可以根据具体的任务类型的相关训练数据进行预先训练得到,例如该任务类型可以包括图像识别,图像分类,图像超分辨率重建等等

……

[0310]

在全连接层230中的多层隐含层之后,也就是整个卷积神经网络200的最后层为输出层240,该输出层240具有类似分类交叉熵的损失函数,具体用于计算预测误差,一旦整个卷积神经网络200的前向传播(如图9由210至240方向的传播为前向传播)完成,反向传播(如图9由240至210方向的传播为反向传播)就会开始更新前面提到的各层的权重值以及偏差,以减少卷积神经网络200的损失,及卷积神经网络200通过输出层输出的结果和理想结果之间的误差。

[0311]

需要说明的是,如图9所示的卷积神经网络200仅作为一种卷积神经网络的示例,在具体的应用中,卷积神经网络还可以以其他网络模型的形式存在,例如,仅包括图9中所示的网络结构的一部分,比如,本技术实施例中所采用的卷积神经网络可以仅包括输入层210、卷积层/池化层220和输出层240。

[0312]

需要说明的是,如图9所示的卷积神经网络100仅作为一种卷积神经网络的示例,在具体的应用中,卷积神经网络还可以以其他网络模型的形式存在,例如,如图10所示的多个卷积层/池化层并行,将分别提取的特征均输入给全连接层230进行处理。

[0313]

(6)损失函数

[0314]

在训练深度神经网络的过程中,因为希望深度神经网络的输出尽可能的接近真正想要预测的值,所以可以通过比较当前网络的预测值和真正想要的目标值,再根据两者之间的差异情况来更新每一层神经网络的权重向量(当然,在第一次更新之前通常会有初始化的过程,即为深度神经网络中的各层预先配置参数),比如,如果网络的预测值高了,就调整权重向量让它预测低一些,不断的调整,直到深度神经网络能够预测出真正想要的目标值或与真正想要的目标值非常接近的值。因此,就需要预先定义“如何比较预测值和目标值之间的差异”,这便是损失函数(loss function)或目标函数(objective function),它们是用于衡量预测值和目标值的差异的重要方程。其中,以损失函数举例,损失函数的输出值(loss)越高表示差异越大,那么深度神经网络的训练就变成了尽可能缩小这个loss的过程。

[0315]

(7)反向传播算法

[0316]

卷积神经网络可以采用误差反向传播(back propagation,bp)算法在训练过程中修正初始的超分辨率模型中参数的大小,使得超分辨率模型的重建误差损失越来越小。具体地,前向传递输入信号直至输出会产生误差损失,通过反向传播误差损失信息来更新初始的超分辨率模型中参数,从而使误差损失收敛。反向传播算法是以误差损失为主导的反向传播运动,旨在得到最优的超分辨率模型的参数,例如权重矩阵。

[0317]

接下来介绍本技术实施例中执行神经网络搜索方法的执行主体的更细节的架构。

[0318]

下面结合图11对本技术实施例提供的系统架构进行详细的介绍。图11为本技术实施例提供的系统架构示意图。如图11所示,系统架构500包括执行设备510、训练设备520、数据库530、客户设备540、数据存储系统550以及数据采集系统560。

[0319]

执行设备510包括计算模块511、i/o接口512、预处理模块513和预处理模块514。计算模块511中可以包括目标模型/规则501,预处理模块513和预处理模块514是可选的。

[0320]

数据采集设备560用于采集训练样本。训练样本可以为图像数据、文本数据、音频数据等等,在本技术实施例中,训练样本为对多个候选神经网络进行训练时所采用的数据。在采集到训练样本之后,数据采集设备560将这些训练样本存入数据库530。

[0321]

应理解,数据库530中还可以维护有搜索空间。

[0322]

训练设备520可以基于数据库530中维护的搜索空间构建多个候选神经网络,并基于训练样本对多个候选神经网络进行训练,以搜索得到目标模型/规则501。本技术实施例中,目标模型/规则501可以为目标神经网络。

[0323]

需要说明的是,在实际应用中,数据库530中维护的训练样本不一定都来自于数据采集设备560的采集,也有可能是从其他设备接收得到的。另外需要说明的是,训练设备520也不一定完全基于数据库530维护的训练样本进行目标模型/规则501的训练,也有可能从云端或其他地方获取训练样本进行模型训练,上述描述不应该作为对本技术实施例的限定。

[0324]

根据训练设备520训练得到的目标模型/规则501可以应用于不同的系统或设备中,如应用于图11所示的执行设备510,该执行设备510可以是终端,如手机终端,平板电脑,笔记本电脑,增强现实(augmented reality,ar)/虚拟现实(virtual reality,vr)设备,车载终端等,还可以是服务器或者云端等。

[0325]

具体的,训练设备520可以将目标神经网络传递至执行设备510。

[0326]

在图11中,执行设备510配置输入/输出(input/output,i/o)接口512,用于与外部设备进行数据交互,用户可以通过客户设备540向i/o接口512输入数据(例如本技术实施例中的待处理数据)。

[0327]

预处理模块513和预处理模块514用于根据i/o接口512接收到的输入数据进行预处理。应理解,可以没有预处理模块513和预处理模块514或者只有的一个预处理模块。当不存在预处理模块513和预处理模块514时,可以直接采用计算模块511对输入数据进行处理。

[0328]

在执行设备510对输入数据进行预处理,或者在执行设备510的计算模块511执行计算等相关的处理过程中,执行设备510可以调用数据存储系统550中的数据、代码等以用于相应的处理,也可以将相应处理得到的数据、指令等存入数据存储系统550中。

[0329]

最后,i/o接口512将处理结果(例如本技术实施例中的数据处理结果)呈现给客户设备540,从而提供给用户。

[0330]

在图11所示情况下,用户可以手动给定输入数据,该“手动给定输入数据”可以通过i/o接口512提供的界面进行操作。另一种情况下,客户设备540可以自动地向i/o接口512发送输入数据,如果要求客户设备540自动发送输入数据需要获得用户的授权,则用户可以在客户设备540中设置相应权限。用户可以在客户设备540查看执行设备510输出的结果,具体的呈现形式可以是显示、声音、动作等具体方式。客户设备540也可以作为数据采集端,采

集如图所示输入i/o接口512的输入数据及输出i/o接口512的输出结果作为新的样本数据,并存入数据库530。当然,也可以不经过客户设备540进行采集,而是由i/o接口512直接将如图所示输入i/o接口512的输入数据及输出i/o接口512的输出结果,作为新的样本数据存入数据库530。

[0331]

值得注意的是,图11仅是本技术实施例提供的一种系统架构的示意图,图中所示设备、器件、模块等之间的位置关系不构成任何限制,例如,在图11中,数据存储系统550相对执行设备510是外部存储器,在其它情况下,也可以将数据存储系统550置于执行设备510中。应理解,上述执行设备510可以部署于客户设备540中。

[0332]

从模型的推理侧来说:

[0333]

本技术实施例中,上述执行设备520的计算模块511可以获取到数据存储系统550中存储的代码来实现本技术实施例中的数据处理方法。

[0334]

本技术实施例中,执行设备520的计算模块511可以包括硬件电路(如专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field

‑

programmable gate array,fpga)、通用处理器、数字信号处理器(digital signal processing,dsp)、微处理器或微控制器等等)、或这些硬件电路的组合,例如,训练设备520可以为具有执行指令功能的硬件系统,如cpu、dsp等,或者为不具有执行指令功能的硬件系统,如asic、fpga等,或者为上述不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合。

[0335]

具体的,执行设备520的计算模块511可以为具有执行指令功能的硬件系统,本技术实施例提供的数据处理方法可以为存储在存储器中的软件代码,执行设备520的计算模块511可以从存储器中获取到软件代码,并执行获取到的软件代码来实现本技术实施例提供的数据处理方法。

[0336]

应理解,执行设备520的计算模块511可以为不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合,本技术实施例提供的数据处理方法的部分步骤还可以通过执行设备520的计算模块511中不具有执行指令功能的硬件系统来实现,这里并不限定。

[0337]

从模型的训练侧来说:

[0338]

本技术实施例中,上述训练设备520可以获取到存储器(图11中未示出,可以集成于训练设备520或者与训练设备520分离部署)中存储的代码来实现本技术实施例中的神经网络搜索方法。

[0339]

本技术实施例中,训练设备520可以包括硬件电路(如专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field

‑

programmable gate array,fpga)、通用处理器、数字信号处理器(digital signal processing,dsp)、微处理器或微控制器等等)、或这些硬件电路的组合,例如,训练设备520可以为具有执行指令功能的硬件系统,如cpu、dsp等,或者为不具有执行指令功能的硬件系统,如asic、fpga等,或者为上述不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合。

[0340]

具体的,训练设备520可以为具有执行指令功能的硬件系统,本技术实施例提供的数据处理方法可以为存储在存储器中的软件代码,训练设备520可以从存储器中获取到软件代码,并执行获取到的软件代码来实现本技术实施例提供的神经网络搜索方法。

[0341]

应理解,训练设备520可以为不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合,本技术实施例提供的神经网络搜索方法的部分步骤还可以通过训练设备520中不具有执行指令功能的硬件系统来实现,这里并不限定。

[0342]

参照图12,图12为本技术实施例提供的一种神经网络搜索方法的实施例示意,本技术实施例提供的一种神经网络搜索方法可以应用在训练设备中,训练设备可以为手机、平板、笔记本电脑、智能穿戴设备等终端设备,训练设备也可以为云侧服务器,如图12示出的那样,本技术实施例提供的神经网络搜索方法可以包括:

[0343]

1201、获取多个候选神经网络;其中,该多个候选神经网络中的至少一个候选神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的。

[0344]

本技术实施例中,可以通过搜索来构建多个候选神经网络,候选神经网络可以为包括transformer层的神经网络,在进行候选神经网络的构建时,可以基于采样的方式,确定候选神经网络中包括的各个网络层的类型(例如可以是transformer层或者是后续实施例中描述的包括卷积层的目标网络层),之后可以对网络层进行采样,以完成候选神经网络的构建。

[0345]

在一种可能的实现中,可以基于采样的方式,确定候选神经网络中包括的全部网络层的类型(例如可以是transformer层或者是后续实施例中描述的包括卷积层的目标网络层)。

[0346]

在一种可能的实现中,可以基于采样的方式,确定候选神经网络中包括的部分网络层的类型(例如可以是transformer层或者是后续实施例中描述的包括卷积层的目标网络层),而其余网络层的结构可以预设设置好。

[0347]

在一种可能的实现中,可以通过采样或者固定设置的方式,确定候选神经网络中的网络层的类型为transformer层(本技术实施例中可以称之为目标transformer层),并通过从第一搜索空间中进行算子采样的方式来确定目标transformer层中目标注意力头head的结构。

[0348]

参照图13,图13为一种transformer模型的结构示意,目标transformer层可以为候选神经网络中的任意一个transformer层,应理解,目标transformer层可以为和嵌入层相邻的神经网络层也可以为最靠近输出的神经网络层,这里并不限定。

[0349]

应理解,目标transformer层在候选神经网络中的位置也可以为基于采样的方式确定的。

[0350]

需要理解,图13的结构仅仅是一个示例,神经网络层的数目可以根据需要而设置。嵌入层可以对输入进行嵌入处理,得到多个特征向量。transformer模型的核心特点在于其采用的独特的注意力机制。在处理自然语言,例如一个句子时,transformer模型利用该注意力机制,为句子中各个词向量赋予不同的注意力系数,从而更全面地考虑句子中上下文对各个词的影响。嵌入层可以基于当前序列中各个节点的节点特征及其位置编码,得到n个嵌入向量x

l

。注意力层与嵌入层相连,从嵌入层获取n个嵌入向量作为输入向量,基于n个输入向量中各个输入向量之间的关联度,对各个输入向量进行综合,得到n个输出向量,输出给后续的transformer层(或者为本技术实施例中的目标网络层)。transformer层获取前一

层的输出作为输入向量,执行与前一级transformer层类似的操作。

[0351]

在一种可能的实现中,可以通过算子采样的方式来构建transformer模型中的目标transformer层,具体的,可以通过算子采样的方式来构建transformer模型中目标transformer层中的目标注意力头head,其中,目标transformer层可以包括多个注意力头head,目标注意力头head可以为多个注意力头head中的任意一个,可选的,多个注意力头head中的每个注意力头head的之间的结构相同。

[0352]

参照图14,图14为一种transformer层的结构示意,其中,transformer层可以包括依次相邻的多头注意力层(或者简称为注意力层)、加和与归一化(add&norm)层、前馈层(feed forward net,ffn)、加和与归一化层。

[0353]

其中,多头注意力层从其上一层获取n个输入向量x

l

,n个输入向量x

l

又可以表示为矩阵x,多头注意力层采用自注意力机制,基于向量间的关联度对各个向量进行变换,得到n个输出向量,n个输出向量又可以表示为矩阵y。可以理解,当该多头注意力层是与嵌入层直接相连的层,例如图14中与嵌入层直连的transformer层,其获取的输入向量即为嵌入层输出的嵌入向量;当该多头注意力层是后续的transformer层包括的多头注意力层,例如图14中与上一级transformer层直连的transformer层包括的多头注意力层,其获取的输入向量即为前一级transformer层的输出向量。多头注意力层可以包括多个注意力头head(如图14中示出的head 1、head 2、

…

、head n)。其中,目标注意力head可以为多个注意力头head中的任意一个。

[0354]

接下来描述,如何通过采样的方式构建目标head:

[0355]

在一种可能的实现中,参照图15,目标注意力head可以包括第一线性变换层、通过采样得到的多个算子、以及第二线性变换层。

[0356]

其中,目标注意力head的输入侧可以设置为第一线性变换层,其中,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算,其中该目标变换矩阵仅包括x个变换矩阵,该x为小于或等于4的正整数,且该x的数量为基于采样的方式确定的。

[0357]

例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0358]

例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

[0359]

在一种可能的实现中,可以基于采样的方式,来确定该目标变换矩阵包括的变换矩阵的矩阵类型,该矩阵类型为q变换矩阵、k变换矩阵或者v变换矩阵,或者是预先设置该目标变换矩阵包括的变换矩阵的矩阵类型,这里并不限定。当通过采样的方式来确定目标变换矩阵包括的变换矩阵的矩阵类型时,可以增加目标注意力头head的结构的可能性,进而可以搜索得到性能更好的模型。

[0360]

其中,当目标变换矩阵包括q变换矩阵时,目标注意力头head可以采用q变换矩阵对n个输入向量<x1,x2,

…

,xn>中各个输入向量xi进行变换,得到各个输入向量对应的第一中间向量(q向量),在操作上,可以用q变换矩阵对n个输入向量构成的输入矩阵x进行线性

变换,得到输入矩阵的q矩阵,再对q矩阵进行拆分,即可得到各个输入向量对应的q向量。

[0361]

其中,当目标变换矩阵包括k变换矩阵时,目标注意力头head可以采用k变换矩阵对n个输入向量<x1,x2,

…

,xn>中各个输入向量xi进行变换,得到各个输入向量对应的第一中间向量(k向量),在操作上,可以用k变换矩阵对n个输入向量构成的输入矩阵x进行线性变换,得到输入矩阵的k矩阵,再对k矩阵进行拆分,即可得到各个输入向量对应的k向量。

[0362]

其中,当目标变换矩阵包括v变换矩阵时,目标注意力头head可以采用v变换矩阵对n个输入向量<x1,x2,

…

,xn>中各个输入向量xi进行变换,得到各个输入向量对应的第一中间向量(v向量),在操作上,可以用v变换矩阵对n个输入向量构成的输入矩阵x进行线性变换,得到输入矩阵的v矩阵,再对v矩阵进行拆分,即可得到各个输入向量对应的v向量。

[0363]

其中,当目标变换矩阵包括p变换矩阵时,目标注意力头head可以采用p变换矩阵对n个输入向量<x1,x2,

…

,xn>中各个输入向量xi进行变换,得到各个输入向量对应的第一中间向量(p向量),在操作上,可以用p变换矩阵对n个输入向量构成的输入矩阵x进行线性变换,得到输入矩阵的p矩阵,再对p矩阵进行拆分,即可得到各个输入向量对应的p向量。

[0364]

在一种可能的实现中,该目标注意力head还可以包括第二线性变换层,该第二线性变换层用于对该多个算子的数据处理结果进行线性变换,以得到该目标注意力head的输出向量。

[0365]

在一种可能的实现中,该目标注意力head的输入向量和该目标注意力head的输出向量的尺寸大小一致。

[0366]

在一种可能的实现中,算子采样的来源可以为第一搜索空间,第一搜索空间可以包括多个候选算子,在构建注意力头head时,可以采样第一搜索空间中的多个候选算子,并对采样得到的候选算子进行组合(组合的方式也可以为采样),以得到一个候选神经网络,经过多次采样,可以得到多个候选神经网络。

[0367]

接下来介绍本技术实施例中的第一搜索空间:

[0368]

在一种可能的实现中,第一搜索空间中可以包括多个候选算子,该候选算子可以为一元运算符或二元运算符,其中一元运算符(unary operation)是指只对一个数据执行操作,例如负数操作(neg)、开根号操作(sqrt)、转置操作(transpose)、softmax操作、logsigmoid操作、softsign操作等等,二元运算符(binary operation)是指对两个数据进行操作得到第三个数据的一种规则,例如加和操作(add)、点乘操作(matmul)、cosine similarity操作以及euclidean distance操作。

[0369]

在一种可能的实现中,该多个候选算子可以包括transformer层中原生的softmax算子以及点乘算子。

[0370]

应理解,上述采样可以为随机采样,或者是采用了一些有倾向性/参考性的采样方式,并不是完全的随机,例如在采样时,可以倾向于采样和现有公知的transformer层中的head差异不大的结构。

[0371]

示例性的,第一搜索空间中包含的算子类型的示例可以见表一。

[0372]

表1

[0373][0374]

在一种可能的实现中,可以采样第一搜索空间的候选算子来构建目标注意力head,具体的,可以从第一搜索空间中采样多个算子,以及采样多个算子之间的连接关系。也就是说,在构建目标注意力head时,目标注意力head中包括的各个算子的类型、数量以及连接关系都可以是基于采样的方式确定的,进而,可以基于采样得到的多个算子,以及采样多个算子之间的连接关系来构建目标注意力头head。

[0375]

在一种可能的实现中,在一种可能的实现中,该目标注意力head包括的算子的数量小于预设值,例如预设值可以为10、11、12、14、15、20、21等等。

[0376]

在一种可能的实现中,可以通过上述方式构建目标transformer层中的目标head,且在一种可能的实现中的每个head都可以采用相同的结构,候选神经网络中的至少一个transformer层可以采用和上述构建目标transformer层相同的方式来构建。

[0377]

参照图16至图21,图16至21为通过采样的方式得到的目标注意力头head的结构示意。

[0378]

本技术实施例结合模型搜索,可以生成相比原自注意力机制更强的新型注意力结构,在广泛的下游任务中取得明显效果提升。

[0379]

在一种可能的实现中,可以通过采样或者固定设置的方式,确定候选神经网络中的网络层的类型为包括卷积层的目标网络层,并通过从第二搜索空间中进行采样的方式来确定目标网络层中卷积层中卷积核的大小。

[0380]

在一种可能的实现中,由于轻量化卷积lightweight convolution在一系列自然语言理解任务上(如机器翻译)取得较好表现,卷积核可以使用lightweight convolution架构,来提升模型的性能。

[0381]

其中,第二搜索空间可以包括多个尺寸的卷积核,卷积核的选择空间可以但不限于为[3,5,7,9,15,31,65]。

[0382]

参照图23,目标网络层可以包括卷积层,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。也就是说,可以将现有的transformer层中的加和与归一化层、ffn以及残差连接的架构保留,而将注意力头head替换为卷积层,进而可以得到本技术实施例中的目标网络层,其中替换的卷积层类型可以通过从第二搜索空间中进行卷积核采样的方式得到。

[0383]

示例性的,可以参照图22,图22为一个候选神经网络的结构示意,其中,候选神经网络可以包括12个网络层,12个网络层中transformer层和目标网络层依次交替并串联,参照图23,图23为本技术实施例中的一种目标网络层的结构示意,其中,目标网络层可以包括卷积层、两个加和与归一化层(即上述第一加和与归一化层和第二加和与归一化层)、前馈层ffn,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0384]

本技术实施例中,设计了多样化的搜索空间,同时包含局部(卷积层中的卷积核)和全局算子(transformer层中的算子)。其中,全局算子能够结合数学基础运算符构造新型注意力机制,局部算子包含多种不同大小的卷积核。通过全局算子与局部算子的结合,能够更有效的捕捉到词与词,句子与句子之间的关联关系,提高搜索得到的模型的性能。此外,本技术实施例中的神经网络模型可以作为预训练模型,且适配于多种下游任务。

[0385]

在一种可能的实现中,可以通过采样可以构建多个候选神经网络,为了能够选取性能较好的模型,候选神经网络的采样数量很多,可以通过训练来确定多个候选神经网络的性能,并基于多个候选神经网络的性能,从多个候选神经网络中初步选取一定数量的网络作为父网络,之后可以对父网络进行算子的替换(若是transformer层,则是进行注意力头head中的算子的替换,若是目标网络层,则可以进行卷积核的替换),得到多个子网络,并对多个子网络进行训练来确定多个子网络的性能,并基于多个子网络的性能,从多个子网络中确定目标神经网络,作为神经网络的搜索结果。

[0386]

其中,上述初始构建的候选神经网络可以称之为第二神经网络,父网络可以称之为第一神经网络,子网络可以称之为候选神经网络。

[0387]

本技术实施例中,该多个候选神经网络包括目标候选神经网络,接下来以确定目标候选神经网络为例进行说明:

[0388]

本技术实施例中,可以通过采样的方式获取多个第二神经网络(具体可以参照上述实施例中采样得到候选神经网络的描述,这里不再赘述),并对该多个第二神经网络进行训练,以得到多个训练后的第二神经网络以及该多个训练后的第二神经网络的性能,具体的,可以对多个第二神经网络的进行随机参数初始化,并对多个第二神经网络进行快速搜索训练(例如通过4w步训练),以得到多个训练后的第二神经网络,并利用glue任务对多个训练后的第二神经网络进行测评,以得到多个第二神经网络的性能,选择最优的n个网络作为父网络,并将父网络的训练参数进行保存。其中,n个父网络可以包括第一神经网络。其中,该第一神经网络可以包括第一transformer层,该第一transformer层包括第一注意力head,且该第一注意力head包括目标算子,之后可以根据该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响,从该m个候选算子中确定替换算子,并将该第一注意力head中的该目标算子替换为该替换算子,以得到该目标注意力head。

[0389]

以该目标算子为例,目标算子可以位于该第二神经网络的目标算子位置,其中,目标算子位置可以在一定程度上表示出距离head的输入的位置,目标算子位置可以与代码上表示网络算子之间的位置方式有关,在计算正向影响时,各个算子在第二神经网络的位置的计算方式与目标算子在第二神经网络的目标算子位置的计算方式一致,都可以表达出算

子位于注意力头head的不同位置对于模型性能正向影响的程度。在计算正向影响时,可以根据每个该多个训练后的第二神经网络中位于该目标算子位置的算子以及该多个训练后的第二神经网络的性能,和/或,每个该训练后的第二神经网络中位于该目标算子位置的算子的出现频次,来确定该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响。

[0390]

示例性的,正向影响可以通过置信区间上界ucb(upper confidence bound)来表示,具体的ucb分数计算方式可以为:

[0391][0392]

其中,μ

i

表示算子i在这个网络结构当前位置中获得的分数,n

i

表示算子i在历史上(采样第二神经网络时)被采样的次数,n表示所有算子被采样的次数。当某个算子很少被采样时,公式右半部分的会获得较大数值,以更大概率选择当前算子。应理解,在每个位置的每个算子的ucb分数计算完后,可以会对这些分数做softmax计算,获得一个概率分布。并将该概率设为在当前位置算子i被激活的概率。

[0393]

本技术实施例利用正向影响来进行算子替换,能够均衡算法的搜索精度和搜索广度,能够避免陷入局部最优,持续搜索到更优的网络架构。

[0394]

在对第一神经网路进行算子替换之后,可以得到目标候选神经网络,在对目标候选神经网络进行训练时,可以根据该第一神经网络,对该目标候选神经网络进行参数初始化,以得到初始化后的该目标候选神经网络;其中,该初始化后的该目标候选神经网络中的可更新参数为对该第一神经网络中相同的位置的可更新参数进行参数共享得到的,进而可以对进行参数初始化的该目标候选神经网络进行训练,以得到该目标候选神经网络的性能。

[0395]

其中,在进行注意力头head的参数共享时,可更新参数为注意力头head中变换矩阵中的参数,参照图24,可以对左侧的注意力头head的变换矩阵中的参数进行参数共享(或者称之为参数继承),来进行右侧的注意力头head的参数初始化。

[0396]

其中,在进行卷积层的参数共享时,可更新参数为卷积核,参照图25,可以对左侧的卷积核(65*1)进行参数共享,来进行右侧的卷积核(5*1)的参数初始化,类似的,可以对左侧的卷积核(65*1)进行参数共享,来进行右侧的卷积核(3*1)的参数初始化。应理解,可以选择卷积核最中心位置的相应参数进行参数共享。

[0397]

本技术实施例中,通过参数共享的方式进行参数初始化,可以加快搜索速度,避免重复训练,极大加速搜索效率。

[0398]

1202、基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。

[0399]

本技术实施例中,在得到多个候选神经网络之后,可以对多个神经网络进行训练,以得每个候选神经网络的性能,进而可以基于每个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络,其中目标神经网络的数量为至少一个,当目标神经网络的数量为一个时,该目标神经网络可以为多个候选神经网络中性能最好的模型,当目标神经网络的数量为多个时,该目标神经网络可以为多个候选神经网络中性能最好的多个模型。

[0400]

应理解,在训练之后还可以进行模型的测试,示例性的,可以对搜索出来的模型进

行全量训练fully

‑

train,并在自然语言理解数据集glue和自动问答数据集squad数据集上进行测试。

[0401]

本技术实施例提供神经网络搜索算法在极大程度上提升了搜索算法的表现,通过本技术实施例提出神经网络搜索算法搜索得到的结果相较random search(rs)和evolution algorithm(ea)有明显提升,具体可以如下表2所示:

[0402]

表2

[0403][0404]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0405]

图26示出了基于本技术实施例提供神经网络搜索算法得到的网络架构搜索结果。该网络架构为包括12个的子模块的transformer的结构,每个模块选取了各自适合的卷积和注意力机制的组合结构,其中第2、4、6、8、10、12层为新型注意力架构,由一系列基本算子构成,其中第1,3,5,7,9,11层为卷积模块(也就是本技术实施例中描述的目标网络层),卷积核的大小不同,由所在层数的需要的感受野决定。该注意力机制的复杂度从浅层到高层逐渐递增,而搜索出来的卷积核的核长也随着层数的变深呈增长趋势。该预训练网络架构在一系列下游任务中相较当前其余模型取得更优表现。

[0406]

接下来以在自然语言理解任务glue和自动问答任务squad上为例描述本技术实施例中的神经网络搜索方法的效果。

[0407]

其中,预训练数据可以包含通用语言理解评估(general language understanding evaluation,glue)任务集。mnli(multi

‑

genre natural language inference)任务集。qqp(quora question pairs)任务集。qnli(question natural language inference)。sst

‑

2(standford sentiment treebank)任务集。cola(corpus of linguistic acceptability)任务集。sts

‑

b(semantic textual similarity benchmark)任务集。mrpc(microsoft research paraphrase corpus)任务集。rte(recognizing textual entailment)任务集。

[0408]

在这个8个数据集上的结果可以看出,在公开数据集glue上,通过本技术实施例搜索得到的模型,在速度与检测精度上均大幅度优于目前已有的sota手工设计模型(bert

‑

base、t5

‑

base等)。相较依赖于巨大参数量teacher model的自动搜索算法adabert和dynabert,本方法不依赖于任何teacher model,且搜索到的模型架构在大部分任务上也取得更优结果,具体可以如表3所示。在自动问答数据集squad上,本本技术实施例搜索得到的模型表现也相较bert

‑

base有明显提升,具体可以如表4所示。

[0409]

表3

[0410][0411]

表4

[0412][0413]

本技术实施例提供了一种神经网络搜索方法,该方法包括:获取多个候选神经网络;其中,该多个候选神经网络中的至少一个候选神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。通过上述方式,结合模型搜索,能生成相比原自注意力机制更强的新型注意力结构,在广泛的下游任务中取得明显效果提升。

[0414]

参照图27,图27为本技术实施例提供的一种模型提供方法的实施例示意,本技术实施例提供的一种模型提供方法可以应用在云侧服务器上,如图27示出的那样,本技术实施例提供的一种模型提供方法包括:

[0415]

2701、接收端侧发送的性能要求,该性能要求用于指示神经网络的性能要求。

[0416]

在一种可能的实现中,该性能要求包括如下的至少一种:数据处理精度、模型大小以及实现的任务类型。

[0417]

本技术实施例中,终端设备可以向云侧服务器发送该终端设备的性能要求。

[0418]

具体的,终端设备可以向云侧服务器发送性能要求,其中,性能要求包括且不限于精度要求、时延要求以及实现的任务类型中的至少一种,进而云侧服务器可以获取到性能要求。

[0419]

2702、根据所述性能要求,从多个候选神经网络中获取满足所述性能要求的目标神经网络,目标神经网络包括目标transformer层,目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的。

[0420]

在一种可能的实现中,云侧服务器可以根据该性能要求,进行神经网络搜索,以搜索得到满足该性能要求的目标神经网络,关于步骤2702的具体描述可以参数上述实施例中图12对应的实施例中的描述,这里不再赘述。

[0421]

2703、向该端侧发送该目标神经网络。

[0422]

云侧服务器在得到目标神经网络之后,可以将目标神经网络传回用户设备,进而用户设备可以使用云侧返回的模型(目标神经网络)进行推理,在进行模型推理时,可以获取到待处理数据,并利用目标神经网络对待处理数据进行处理,以得到处理结果。

[0423]

在一种可能的实现中,可以获取多个候选神经网络;其中,该多个候选神经网络中

的至少一个候选神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为从第一搜索空间中采样得到的;根据该性能要求,从该多个候选神经网络中获取满足该性能要求的目标神经网络。

[0424]

在一种可能的实现中,该第一搜索空间包括多个候选算子,该候选算子为一元运算符或二元运算符;该目标注意力head为基于该多个算子以及该多个算子之间的排列关系构建的,该多个算子之间的排列关系为基于采样的方式确定的。

[0425]

在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算;其中,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0426]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层,该目标transformer层在该多个网络层中的位置为基于采样的方式确定的。

[0427]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层以及卷积层,该卷积层中的卷积核为从第二搜索空间中采样得到的,该第二搜索空间包括多个尺寸的卷积核。

[0428]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0429]

参照图28,图28为本技术实施例提供的一种神经网络搜索方法的实施例示意,本技术实施例提供的神经网络搜索方法可以应用在训练设备中,训练设备可以为手机、平板、笔记本电脑、智能穿戴设备等终端设备,训练设备也可以为云侧服务器,如图28示出的那样,本技术实施例提供的一种神经网络搜索方法可以包括:

[0430]

2801、获取多个候选神经网络;其中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括目标transformer层以及目标网络层,该目标网络层包括卷积层,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0431]

2802、基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。

[0432]

步骤2801以及步骤2802的描述可以参照上述实施例中关于目标网络层的描述,这里不再赘述。

[0433]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0434]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0435]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0436]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0437]

参照图29,图29为本技术实施例提供的一种模型提供方法的实施例示意,本技术实施例提供的模型提供方法可以应用在云侧服务器上,如图29示出的那样,本技术实施例提供的一种模型提供方法包括:

[0438]

2901、接收端侧发送的性能要求,该性能要求用于指示神经网络的性能要求。

[0439]

本技术实施例中,终端设备可以向云侧服务器发送该终端设备的性能要求。

[0440]

具体的,终端设备可以向云侧服务器发送性能要求,其中,性能要求包括且不限于精度要求、时延要求以及实现的任务类型中的至少一种,进而云侧服务器可以获取到性能要求。

[0441]

2902、根据所述性能要求,从多个候选神经网络中获取满足所述性能要求的目标神经网络,其中,该目标神经网络包括目标transformer层以及目标网络层,该目标网络层包括卷积层,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0442]

在一种可能的实现中,云侧服务器可以根据该性能要求,进行神经网络搜索,以搜索得到满足该性能要求的目标神经网络,关于步骤2702的具体描述可以参数上述实施例中图28对应的实施例中的描述,这里不再赘述。

[0443]

2903、向该端侧发送该目标神经网络。

[0444]

云侧服务器在得到目标神经网络之后,可以将目标神经网络传回用户设备,进而用户设备可以使用云侧返回的模型(目标神经网络)进行推理,在进行模型推理时,可以获取到待处理数据,并利用目标神经网络对待处理数据进行处理,以得到处理结果。

[0445]

在一种可能的实现中,可以获取多个候选神经网络;根据该性能要求,从该多个候选神经网络中获取满足该性能要求的目标神经网络。

[0446]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0447]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0448]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0449]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0450]

参照图30,图30为本技术实施例提供的一种神经网络搜索装置的实施例示意,如图30示出的那样,本技术实施例提供的神经网络搜索装置3000可以包括:

[0451]

获取模块3001,用于获取多个候选神经网络;其中,该多个候选神经网络中的至少一个候选神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的。

[0452]

关于获取模块3001的描述可以参照上述实施例中步骤1201的描述,这里不再赘述。

[0453]

模型选择模块3002,用于基于该多个候选神经网络的性能,从该多个候选神经网

络中选择目标神经网络。

[0454]

关于模型选择模块3002的描述可以参照上述实施例中步骤1202的描述,这里不再赘述。

[0455]

在一种可能的实现中,该第一搜索空间包括多个候选算子,该候选算子为一元运算符或二元运算符。其中一元运算符(unary operation)是指只对一个数据执行操作,例如负数操作(neg)、开根号操作(sqrt)、转置操作(transpose)、softmax操作、logsigmoid操作、softsign操作等等,二元运算符(binary operation)是指对两个数据进行操作得到第三个数据的一种规则,例如加和操作(add)、点乘操作(matmul)、cosine similarity操作以及euclidean distance操作。

[0456]

在一种可能的实现中,该多个候选算子包括softmax算子以及点乘算子。

[0457]

在一种可能的实现中,可以采样第一搜索空间的候选算子来构建目标注意力head,具体的,可以从第一搜索空间中采样多个算子,以及采样多个算子之间的连接关系。也就是说,在构建目标注意力head时,目标注意力head中包括的各个算子的类型、数量以及连接关系都可以是基于采样的方式确定的,进而,可以基于采样得到的多个算子,以及采样多个算子之间的连接关系来构建目标注意力头head。

[0458]

在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算。

[0459]

在一种可能的实现中,该目标变换矩阵仅包括x个变换矩阵,该x为小于或等于4的正整数,且该x的数量为基于采样的方式确定的。

[0460]

例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0461]

例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

[0462]

在一种可能的实现中,该目标注意力head还包括第二线性变换层,该第二线性变换层用于对该多个算子的数据处理结果进行线性变换,以得到该目标注意力head的输出向量。

[0463]

在一种可能的实现中,该目标注意力head的输入向量和该目标注意力head的输出向量的尺寸大小一致。

[0464]

在一种可能的实现中,该目标注意力head包括的算子的数量小于预设值。

[0465]

在一种可能的实现中,可以通过算子采样的方式来构建transformer模型中的目标transformer层,具体的,可以通过算子采样的方式来构建transformer模型中目标transformer层中的目标注意力头head,其中,目标transformer层可以包括多个注意力头head,目标注意力头head可以为多个注意力头head中的任意一个,可选的,多个注意力头head中的每个注意力头head的之间的结构相同。

[0466]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层,该目标transformer层在该多个网络层中的位置为

基于采样的方式确定的。

[0467]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层以及目标网络层,该目标网络层包括卷积层。其中,该卷积层中的卷积核可以为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0468]

在一种可能的实现中,可以通过采样或者固定设置的方式,确定候选神经网络中的网络层的类型为包括卷积层的目标网络层,并通过从第二搜索空间中进行采样的方式来确定目标网络层中卷积层中卷积核的大小。

[0469]

本技术实施例中,设计了多样化的搜索空间,同时包含局部(卷积层中的卷积核)和全局算子(transformer层中的算子)。其中,全局算子能够结合数学基础运算符构造新型注意力机制,局部算子包含多种不同大小的卷积核。通过全局算子与局部算子的结合,能够更有效的捕捉到词与词,句子与句子之间的关联关系,提高搜索得到的模型的性能。此外,本技术实施例中的神经网络模型可以作为预训练模型,且适配于多种下游任务。

[0470]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0471]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。也就是说,可以将现有的transformer层中的加和与归一化层、ffn以及残差连接的架构保留,而将注意力头head替换为卷积层,进而可以得到本技术实施例中的目标网络层,其中替换的卷积层类型可以通过从第二搜索空间中进行卷积核采样的方式得到。

[0472]

在一种可能的实现中,该多个候选神经网络包括目标候选神经网络;该获取模块3001,具体用于:构建该目标候选神经网络中的目标注意力head;

[0473]

该构建该目标候选神经网络中的目标注意力head,包括:

[0474]

获取第一神经网络,其中,该第一神经网络包括第一transformer层,该第一transformer层包括第一注意力head,该第一注意力head包括的多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;

[0475]

根据该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响,从该m个候选算子中确定替换算子,并将该第一注意力head中的该目标算子替换为该替换算子,以得到该目标注意力head。

[0476]

在一种可能的实现中,该获取模块3001,具体用于:

[0477]

获取多个第二神经网络,并对该多个第二神经网络进行训练,以得到多个训练后的第二神经网络以及该多个训练后的第二神经网络的性能;

[0478]

根据该多个训练后的第二神经网络的性能,从该多个训练后的第二神经网络中选择性能满足预设要求的n个训练后的第二神经网络,该n个训练后的第二神经网络包括该第一神经网络。

[0479]

在一种可能的实现中,该目标算子位于该第二神经网络的目标算子位置;该装置还包括:

[0480]

确定模块,用于根据每个该多个训练后的第二神经网络中位于该目标算子位置的

算子以及该多个训练后的第二神经网络的性能,和/或,每个该训练后的第二神经网络中位于该目标算子位置的算子的出现频次,确定该第一搜索空间中的m个候选算子替换该第一注意力head中的该目标算子时,对该第一神经网络性能的正向影响。

[0481]

在一种可能的实现中,该装置还包括:

[0482]

参数初始化模块,用于根据该第一神经网络,对该目标候选神经网络进行参数初始化,以得到初始化后的该目标候选神经网络;其中,该初始化后的该目标候选神经网络中的可更新参数为对该第一神经网络中相同的位置的可更新参数进行参数共享得到的;

[0483]

模型训练模块,用于对进行参数初始化的该目标候选神经网络进行训练,以得到该目标候选神经网络的性能。

[0484]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0485]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0486]

参照图31,图31为本技术实施例提供的一种模型提供装置的实施例示意,如图31示出的那样,本技术实施例提供的模型提供装置3100可以包括:

[0487]

接收模块3101,用于接收端侧发送的性能要求,该性能要求用于指示神经网络的性能要求;

[0488]

关于接收模块3101的描述可以参照上述实施例中步骤2701的描述,这里不再赘述。

[0489]

获取模块3102,用于根据所述性能要求,从多个候选神经网络中获取满足所述性能要求的目标神经网络,其中,该目标神经网络包括目标transformer层,该目标transformer层包括目标注意力头head,该目标注意力head包括多个算子,且该多个算子为对第一搜索空间包括的多个候选算子进行采样得到的;

[0490]

关于获取模块3102的描述可以参照上述实施例中步骤2702的描述,这里不再赘述。

[0491]

发送模块3103,用于向该端侧发送该目标神经网络。

[0492]

关于发送模块3103的描述可以参照上述实施例中步骤2703的描述,这里不再赘述。

[0493]

在一种可能的实现中,该性能要求可以包括如下的至少一种:数据处理精度、模型大小以及实现的任务类型。

[0494]

在一种可能的实现中,该获取模块3102,具体用于:

[0495]

获取多个候选神经网络;

[0496]

根据该性能要求,从该多个候选神经网络中获取满足该性能要求的目标神经网络。

[0497]

在一种可能的实现中,该第一搜索空间包括多个候选算子,该候选算子为一元运算符或二元运算符;该目标注意力head为基于该多个算子以及该多个算子之间的排列关系构建的,该多个算子之间的排列关系为基于采样的方式确定的。

[0498]

在一种可能的实现中,该目标注意力head还包括第一线性变换层,该第一线性变换层用于通过目标变换矩阵对该目标注意力head的输入向量进行处理,该多个算子用于对该第一线性变换层的数据处理结果进行运算;其中,该目标变换矩阵仅包括x个变换矩阵,

该x为小于或等于4的正整数,且该x的数量为基于采样的方式确定的。

[0499]

例如,目标变换矩阵可以仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的一种;或者,该目标变换矩阵仅包括q变换矩阵、v变换矩阵以及k变换矩阵中的两种;或者,该目标变换矩阵包括q变换矩阵、v变换矩阵以及k变换矩阵。

[0500]

例如,还可以再构建一个变换矩阵(例如称之为p变换矩阵),p变换矩阵和其他变换矩阵的结构相似或完全一致,进而,目标变换矩阵可以包括q变换矩阵、v变换矩阵、k变换矩阵以及p变换矩阵中的至少一种。

[0501]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层,该目标transformer层在该多个网络层中的位置为基于采样的方式确定的。

[0502]

在一种可能的实现中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括该目标transformer层以及目标网络层,该目标网络层包括卷积层。

[0503]

在一种可能的实现中,该目标网络层在该多个网络层中的位置为基于采样的方式确定的。

[0504]

在一种可能的实现中,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的。

[0505]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0506]

参照图32,图32为本技术实施例提供的一种神经网络搜索装置的实施例示意,如图32示出的那样,本技术实施例提供的神经网络搜索装置3200可以包括:

[0507]

获取模块3201,用于获取多个候选神经网络;其中,该至少一个候选神经网络包括串联连接的多个网络层,该多个网络层包括目标transformer层以及目标网络层,该目标网络层包括卷积层,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的;

[0508]

关于获取模块3201的描述可以参照上述实施例中步骤2801的描述,这里不再赘述。

[0509]

模型选择模块3202,用于基于该多个候选神经网络的性能,从该多个候选神经网络中选择目标神经网络。

[0510]

关于模型选择模块3202的描述可以参照上述实施例中步骤2802的描述,这里不再赘述。

[0511]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0512]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0513]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0514]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0515]

参照图33,图33为本技术实施例提供的一种模型提供装置的实施例示意,如图33示出的那样,本技术实施例提供的模型提供装置3300可以包括:

[0516]

接收模块3301,用于接收端侧发送的性能要求,该性能要求用于指示神经网络的性能要求,该性能要求包括如下的至少一种:数据处理精度、模型大小以及实现的任务类型;

[0517]

关于接收模块3301的描述可以参照上述实施例中步骤2901的描述,这里不再赘述。

[0518]

获取模块3302,用于根据所述性能要求,从多个候选神经网络中获取满足所述性能要求的目标神经网络,其中,该目标神经网络包括目标transformer层以及目标网络层,该目标网络层包括卷积层,该卷积层中的卷积核为对第二搜索空间中包括的多个尺寸的卷积核进行采样得到的;

[0519]

关于获取模块3302的描述可以参照上述实施例中步骤2902的描述,这里不再赘述。

[0520]

发送模块3303,用于向该端侧发送该目标神经网络。

[0521]

关于发送模块3303的描述可以参照上述实施例中步骤2903的描述,这里不再赘述。

[0522]

在一种可能的实现中,该获取模块3302,具体用于:

[0523]

获取多个候选神经网络;

[0524]

根据该性能要求,从该多个候选神经网络中获取满足该性能要求的目标神经网络。

[0525]

在一种可能的实现中,该卷积层中的卷积核的类型为轻量卷积(hightweight convolution)。

[0526]

在一种可能的实现中,该目标网络层还包括第一加和与归一化层、前馈层ffn、第二加和与归一化层,该第一加和与归一化层用于处理该目标网络层的输入向量以及该卷积层的输出向量,该前馈层ffn用于处理该第一加和与归一化层的输出向量,该第二加和与归一化层用于处理该第一加和与归一化层的输出向量以及该前馈层ffn的输出向量。

[0527]

在一种可能的实现中,该目标神经网络用于实现如下任务类型的至少一种:

[0528]

阅读理解、文本翻译、复述识别、命名实体识别、文本情感分析、自然语言推理、文本自动问答、文本意图识别、文本分类、文本简化或者文本故事生成。

[0529]

接下来介绍本技术实施例提供的一种执行设备,请参阅图34,图34为本技术实施例提供的执行设备的一种结构示意图,执行设备3400具体可以表现为虚拟现实vr设备、手机、平板、笔记本电脑、智能穿戴设备、监控数据处理设备或服务器等,此处不做限定。具体的,执行设备3400包括:接收器3401、发射器3402、处理器3403和存储器3404(其中执行设备3400中的处理器3403的数量可以一个或多个,图34中以一个处理器为例),其中,处理器3403可以包括应用处理器34031和通信处理器34032。在本技术的一些实施例中,接收器3401、发射器3402、处理器3403和存储器3404可通过总线或其它方式连接。

[0530]

存储器3404可以包括只读存储器和随机存取存储器,并向处理器3403提供指令和数据。存储器3404的一部分还可以包括非易失性随机存取存储器(non

‑

volatile random access memory,nvram)。存储器3404存储有处理器和操作指令、可执行模块或者数据结构,

或者它们的子集,或者它们的扩展集,其中,操作指令可包括各种操作指令,用于实现各种操作。

[0531]

处理器3403控制执行设备的操作。具体的应用中,执行设备的各个组件通过总线系统耦合在一起,其中总线系统除包括数据总线之外,还可以包括电源总线、控制总线和状态信号总线等。但是为了清楚说明起见,在图中将各种总线都称为总线系统。

[0532]

上述本技术实施例揭示的方法可以应用于处理器3403中,或者由处理器3403实现。处理器3403可以是一种集成电路芯片,具有信号的处理能力。在实现过程中,上述方法的各步骤可以通过处理器3403中的硬件的集成逻辑电路或者软件形式的指令完成。上述的处理器3403可以是通用处理器、数字信号处理器(digital signal processing,dsp)、微处理器或微控制器,还可进一步包括专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field

‑

programmable gate array,fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件。该处理器3403可以实现或者执行本技术实施例中的公开的各方法、步骤及逻辑框图。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。结合本技术实施例所公开的方法的步骤可以直接体现为硬件译码处理器执行完成,或者用译码处理器中的硬件及软件模块组合执行完成。软件模块可以位于随机存储器,闪存、只读存储器,可编程只读存储器或者电可擦写可编程存储器、寄存器等本领域成熟的存储介质中。该存储介质位于存储器3404,处理器3403读取存储器3404中的信息,结合其硬件完成上述方法的步骤。

[0533]

接收器3401可用于接收输入的数字或字符信息,以及产生与执行设备的相关设置以及功能控制有关的信号输入。发射器3402可用于输出数字或字符信息;发射器3402还可用于向磁盘组发送指令,以修改磁盘组中的数据。

[0534]

本技术实施例中,在一种情况下,处理器3403,用于执行上述实施例中执行设备执行的数据处理方法(例如通过目标神经网络的进行模型推理的步骤)。

[0535]

本技术实施例还提供了一种训练设备,请参阅图35,图35是本技术实施例提供的训练设备一种结构示意图,训练设备3500上可以部署有图30、图31、图32以及图33对应实施例中所描述的装置,具体的,训练设备3500由一个或多个服务器实现,训练设备3500可因配置或性能不同而产生比较大的差异,可以包括一个或一个以上中央处理器(central processing units,cpu)3535(例如,一个或一个以上处理器)和存储器3532,一个或一个以上存储应用程序3542或数据3544的存储介质3530(例如一个或一个以上海量存储设备)。其中,存储器3532和存储介质3530可以是短暂存储或持久存储。存储在存储介质3530的程序可以包括一个或一个以上模块(图示没标出),每个模块可以包括对训练设备中的一系列指令操作。更进一步地,中央处理器3535可以设置为与存储介质3530通信,在训练设备3500上执行存储介质3530中的一系列指令操作。

[0536]

训练设备3500还可以包括一个或一个以上电源3526,一个或一个以上有线或无线网络接口3550,一个或一个以上输入输出接口3558;或,一个或一个以上操作系统3541,例如windows servertm,mac os xtm,unixtm,linuxtm,freebsdtm等等。

[0537]

本技术实施例中,中央处理器3535,用于执行图12、图27、图28以及图29对应实施例中的方法。

[0538]

本技术实施例中还提供一种包括计算机程序产品,当其在计算机上运行时,使得

计算机执行如前述执行设备所执行的步骤,或者,使得计算机执行如前述训练设备所执行的步骤。

[0539]

本技术实施例中还提供一种计算机可读存储介质,该计算机可读存储介质中存储有用于进行信号处理的程序,当其在计算机上运行时,使得计算机执行如前述执行设备所执行的步骤,或者,使得计算机执行如前述训练设备所执行的步骤。

[0540]

本技术实施例提供的执行设备、训练设备或终端设备具体可以为芯片,芯片包括:处理单元和通信单元,该处理单元例如可以是处理器,该通信单元例如可以是输入/输出接口、管脚或电路等。该处理单元可执行存储单元存储的计算机执行指令,以使执行设备内的芯片执行上述实施例描述的数据处理方法,或者,以使训练设备内的芯片执行上述实施例描述的数据处理方法。可选地,该存储单元为该芯片内的存储单元,如寄存器、缓存等,该存储单元还可以是该无线接入设备端内的位于该芯片外部的存储单元,如只读存储器(read

‑

only memory,rom)或可存储静态信息和指令的其他类型的静态存储设备,随机存取存储器(random access memory,ram)等。

[0541]

具体的,请参阅图36,图36为本技术实施例提供的芯片的一种结构示意图,该芯片可以表现为神经网络处理器npu 3600,npu 3600作为协处理器挂载到主cpu(host cpu)上,由host cpu分配任务。npu的核心部分为运算电路3603,通过控制器3604控制运算电路3603提取存储器中的矩阵数据并进行乘法运算。

[0542]

在一些实现中,运算电路3603内部包括多个处理单元(process engine,pe)。在一些实现中,运算电路3603是二维脉动阵列。运算电路3603还可以是一维脉动阵列或者能够执行例如乘法和加法这样的数学运算的其它电子线路。在一些实现中,运算电路3603是通用的矩阵处理器。

[0543]

举例来说,假设有输入矩阵a,权重矩阵b,输出矩阵c。运算电路从权重存储器3602中取矩阵b相应的数据,并缓存在运算电路中每一个pe上。运算电路从输入存储器3601中取矩阵a数据与矩阵b进行矩阵运算,得到的矩阵的部分结果或最终结果,保存在累加器(accumulator)3608中。

[0544]

统一存储器3606用于存放输入数据以及输出数据。权重数据直接通过存储单元访问控制器(direct memory access controller,dmac)3605,dmac被搬运到权重存储器3602中。输入数据也通过dmac被搬运到统一存储器3606中。

[0545]

biu为bus interface unit即,总线接口单元3610,用于axi总线与dmac和取指存储器(instruction fetch buffer,ifb)3609的交互。

[0546]

总线接口单元3610(bus interface unit,简称biu),用于取指存储器3609从外部存储器获取指令,还用于存储单元访问控制器3605从外部存储器获取输入矩阵a或者权重矩阵b的原数据。

[0547]

dmac主要用于将外部存储器ddr中的输入数据搬运到统一存储器3606或将权重数据搬运到权重存储器3602中或将输入数据数据搬运到输入存储器3601中。

[0548]

向量计算单元3607包括多个运算处理单元,在需要的情况下,对运算电路的输出做进一步处理,如向量乘,向量加,指数运算,对数运算,大小比较等等。主要用于神经网络中非卷积/全连接层网络计算,如batch normalization(批归一化),像素级求和,对特征平面进行上采样等。

[0549]

在一些实现中,向量计算单元3607能将经处理的输出的向量存储到统一存储器3606。例如,向量计算单元3607可以将线性函数;或,非线性函数应用到运算电路3603的输出,例如对卷积层提取的特征平面进行线性插值,再例如累加值的向量,用以生成激活值。在一些实现中,向量计算单元3607生成归一化的值、像素级求和的值,或二者均有。在一些实现中,处理过的输出的向量能够用作到运算电路3603的激活输入,例如用于在神经网络中的后续层中的使用。

[0550]

控制器3604连接的取指存储器(instruction fetch buffer)3609,用于存储控制器3604使用的指令;

[0551]

统一存储器3606,输入存储器3601,权重存储器3602以及取指存储器3609均为on

‑

chip存储器。外部存储器私有于该npu硬件架构。

[0552]

其中,上述任一处提到的处理器,可以是一个通用中央处理器,微处理器,asic,或一个或多个用于控制上述程序执行的集成电路。

[0553]

另外需说明的是,以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。另外,本技术提供的装置实施例附图中,模块之间的连接关系表示它们之间具有通信连接,具体可以实现为一条或多条通信总线或信号线。

[0554]

通过以上的实施方式的描述,所属领域的技术人员可以清楚地了解到本技术可借助软件加必需的通用硬件的方式来实现,当然也可以通过专用硬件包括专用集成电路、专用cpu、专用存储器、专用元器件等来实现。一般情况下,凡由计算机程序完成的功能都可以很容易地用相应的硬件来实现,而且,用来实现同一功能的具体硬件结构也可以是多种多样的,例如模拟电路、数字电路或专用电路等。但是,对本技术而言更多情况下软件程序实现是更佳的实施方式。基于这样的理解,本技术的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品存储在可读取的存储介质中,如计算机的软盘、u盘、移动硬盘、rom、ram、磁碟或者光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,训练设备,或者网络设备等)执行本技术各个实施例所述的方法。

[0555]

在上述实施例中,可以全部或部分地通过软件、硬件、固件或者其任意组合来实现。当使用软件实现时,可以全部或部分地以计算机程序产品的形式实现。

[0556]

所述计算机程序产品包括一个或多个计算机指令。在计算机上加载和执行所述计算机程序指令时,全部或部分地产生按照本技术实施例所述的流程或功能。所述计算机可以是通用计算机、专用计算机、计算机网络、或者其他可编程装置。所述计算机指令可以存储在计算机可读存储介质中,或者从一个计算机可读存储介质向另一计算机可读存储介质传输,例如,所述计算机指令可以从一个网站站点、计算机、训练设备或数据中心通过有线(例如同轴电缆、光纤、数字用户线(dsl))或无线(例如红外、无线、微波等)方式向另一个网站站点、计算机、训练设备或数据中心进行传输。所述计算机可读存储介质可以是计算机能够存储的任何可用介质或者是包含一个或多个可用介质集成的训练设备、数据中心等数据存储设备。所述可用介质可以是磁性介质,(例如,软盘、硬盘、磁带)、光介质(例如,dvd)、或

者半导体介质(例如固态硬盘(solid state disk,ssd))等。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。