1.本发明涉及图像识别技术领域,并且更具体地涉及一种基于多个图像获取设备确定特征点的方法及系统、计算机可读存储介质以及电子设备。

背景技术:

2.目前,计算机视觉领域中的姿态评估技术已经在,诸如在体育运动赛事、临床外科模拟教学、脑功能开发以及康复训练等领域,取得了广泛的应用。然而,由于人体自身结构的对称性,以及开放场景的复杂性,导致现有的姿态评估方法在局部视野、人体特殊体位、人与人交互以及人与物交互等情况下会产生关键点或特征点识别失败的问题。

3.以康复训练为例,康复训练会进行局部关节的主动或被动锻炼,诸如肘关节屈伸、前臂旋前旋后等。视频采集往往采用近景局部视角。此时由于视野中采集的人体信息不完整而无法识别关键点或特征点。康复训练会进行不同体位的锻炼,诸如仰卧位、侧位站或坐等。比如在侧位站或坐时,由于人体自身的对称性结构,会产生自遮挡问题,使得靠近镜头的一侧会对远离侧产生遮挡,导致远离侧关键点或特征点识别失败。

4.此外,康复训练往往需要治疗师配合进行被动训练,此时因治疗师与患者紧密接触会产生互遮挡,从而导致关键点或特征点识别失败问题。比如治疗师协助康复患者进行前臂旋前旋后被动训练时,患者采取仰面平躺位,治疗师采用患者盘坐位。此时由于两者身体紧密接触,会导致上臂腕部关键点或特征点,以及部分下肢关键点或特征点识别失败。

5.康复训练往往会需要配合相关辅助器具来完成,诸如拉力绳、弹力球等。在使用过程中由于辅助器具对身体某些部位的遮挡也会导致关键点或特征点识别失败。

6.目前,现有技术中缺少对关键点或特征点识别失败问题的有效解决方案。本发明通过设计一种精准的分类框架,将康复医学、运动控制理论与计算机视觉、人工智能融合,解决姿态估计中人体自遮挡以及人与人、人与物互遮挡而导致的关键点估计失败的问题。

技术实现要素:

7.为了解决现有技术中的问题,本发明提供了一种基于多个图像获取设备确定特征点的方法,所述方法包括:

8.每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像,并根据所获取的动态图像生成每个图像获取设备各自的动态图像文件;

9.根据预先设置的配置文件为每个动态图像文件确定各自的神经网络,利用每个动态图像文件各自的神经网络进行数据处理,以获取与每个图像获取设备相关联的热图集;

10.对多个热图集进行数据融合以获得每个图像获取设备的经过数据融合的热图集,基于每个图像获取设备的经过数据融合的热图集获得包括主体对象的三维信息;以及

11.对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息,基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

12.在每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像之前还包括:

13.获取主体对象的位置属性和方向属性,基于位置属性和方向属性为多个图像获取设备中每个图像获取设备确定基准位置。

14.所述位置属性包括:主体对象的位置坐标和/或主题对象的位置区域。

15.所述方向属性包括:主体对象的单个朝向信息或主题对象的多个朝向信息。

16.所述获取主体对象的位置属性和方向属性包括:

17.接收输入数据并对输入数据进行解析以确定主体对象的位置属性和方向属性;或者

18.利用定位设备获取主体对象的定位信息,根据定位信息确定主体对象的位置属性和方向属性。

19.所述基于位置属性和方向属性为多个图像获取设备中每个图像获取设备确定基准位置包括:

20.基于位置属性和方向属性确定获取目标对象的动态图像的多个候选位置;

21.从多个候选位置中为每个图像获取设备确定基准位置;

22.其中每个图像获取设备的基准位置均不相同。

23.每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像包括:

24.每个图像获取设备在各自的基准位置处,以各自的预定拍摄角度分别获取主体对象的动态图像;或者

25.每个图像获取设备基于各自的基准位置形成移动路径,通过在各自的移动路径选择拍摄位置,并在拍摄位置处以所选择的拍摄角度分别获取主体对象的动态图像。

26.根据所获取的动态图像生成每个图像获取设备各自的动态图像文件包括:

27.根据每个图像获取设备各自所获取的动态图像,得到动态图像数据流;

28.利用动态图像数据流生成每个图像获取设备各自的动态图像文件。

29.所述预先设置的配置文件中包括神经网络的名称和神经网络的参数信息。

30.所述根据预先设置的配置文件为每个动态图像文件确定各自的神经网络包括:

31.根据预先设置的配置文件中的神经网络的名称确定所要使用的神经网络;

32.根据神经网络的参数信息对所要使用的神经网络进行参数配置;

33.将经过参数配置的神经网络确定为每个动态图像文件各自的神经网络;

34.其中每个动态图像文件的神经网络是相同的神经网络。

35.利用每个动态图像文件各自的神经网络进行数据处理,以获取与每个图像获取设备相关联的热图集包括:

36.利用每个动态图像文件各自的神经网络对每个图像获取设备所获取的动态图像文件进行数据处理,以获取与每个图像获取设备相关联的热图集。

37.所述对多个热图集进行数据融合以获得每个图像获取设备的经过数据融合的热图集包括:

38.将多个热图集中的每个热图集依次选择作为当前热图集以进行:

39.将多个热图集中除了当前热图集之外的每个热图集确定为融合热图集;

40.基于多个融合热图集对当前热图集进行数据融合,以获得每个图像获取设备的经

过数据融合的当前热图集。

41.所述基于每个图像获取设备的经过数据融合的热图集获得包括主体对象的三维信息包括:

42.基于每个图像获取设备的经过数据融合的热图集进行主体对象的特征点的识别,得到多幅同一时刻的二维特征点;

43.根据每个图像获取设备的世界坐标系的坐标和图像坐标对二维特征点标定内外参数,基于内外参数获取包括主体对象的三维信息。

44.所述对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息包括:

45.利用图像识别设备对对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息。

46.所述对象信息包括:客体对象的数量和客体对象的类型。

47.基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

48.对客体对象的对象信息进行解析以确定客体对象的数量为零时,确定特征点修复类型为不进行修复;

49.当特征点修复类型为不进行修复时,不根据特征点修复类型对所述三维信息进行特征点的修复,直接根据主题对象的三维信息确定与主体对象相关联的多个特征点。

50.基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

51.对客体对象的对象信息进行解析以确定客体对象的数量不为零并且客体对象的类型为辅助物体时,确定特征点修复类型为辅助物体修复;

52.利用主客体识别网络在三维信息中对主体对象进行整体标记,基于整体标记提取特征点,以及主体对象的空间特征和时间特征;

53.对客体对象进行特征点识别并进行特征点跟踪,所述特征点追踪包括对每一帧标记物理形状和位置信息,提取客体对象的空间特征和时间特征;

54.根据辅助物体修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

55.当辅助物体为跟随型辅助物体时,主体对象和客体对象在每一帧图像中的空间特征以及连续帧中的时间特征都进行变化;

56.当辅助物体为固定型辅助物体时,主体对象在每一帧图像中的空间特征以及连续帧的时间特征进行变化,而客体对象在每一帧图像中具有稳定的空间特征,且连续帧中的时间特征保持一致;

57.主题对象和客体对象的交互部分的空间特征存在波动。

58.根据辅助物体修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

59.利用主客体识别网络对经过数据融合的三维信息进行处理,其中主客体识别网络为融合自上而下的姿态识别网路与基于深度卷积的物体识别网络的识别网络;

60.对主体对象和客体对象进行标记,获得主体对象范围b

s

和客体对象范围b

o

;

61.在主体对象范围b

s

内,通过自下而上的姿态识别网络对主体对象的多个部分进行初始识别,以获得多个初始特征点s

parts

;

62.在客体对象范围b

o

内,将客体对象标记为o;

63.提取每一帧的空间特征f

space

,以及连续帧的时间特征f

time

;

64.对空间特征f

space

与时间特征f

time

进行融合以确定客体对象的对象类别,分别进行跟随型辅助物体和固定型辅助物体的子场景标记s

i

,其中i=1,2;其中s1为跟随型辅助物体并且s2为固定型辅助物体;其中空间特征f

space

包括:形状、体积、角度、纹理、颜色、梯度和位置;时间特征f

time

包括位移、速度、上下文信息和旋转;

65.对于s1子场景,随着时间推移,在主体对象范围的s1子场景和客体对象范围的s1子场景间存在动态交集其中t1为第一时间并且t2为第二时间;

66.提取主体对象和客体对象两者的时间特征与空间特征,分别记为主体对象空间特征主体对象时间特征客体对象空间特征和客体对象时间特征

67.在辅助物体的对象类别为跟随型辅助物体情况下,构建局部交互特征提取算子a

switho

,针对交集时间段[t1,t2],对多个遮挡部位的初始特征点进行重新识别,从而确定与主体对象相关联的多个特征点s

′

parts

;

[0068]

对于s2子场景,随着时间推移,在主体对象范围的s2子场景和客体对象范围的s2子场景间存在动态交集

[0069]

提取主体对象和客体对象两者的时间特征与空间特征,分别记为主体对象空间特征主体对象时间特征和客体对象空间特征其中在辅助物体的对象类别为固定型辅助物体的s2场景下,客体对象静止不动,因此不存在客体对象时间特征特征;

[0070]

在动态交集的时间段[t1,t2]内,由进入的范围而发生遮挡,对于每一个遮挡时刻t

j

,利用主体对象和客体对象的局部交互特征提取算子a

sbyo

,结合运动学先验知识k

prior

,,对遮挡下的每一帧f(t=t

j

)进行修补,从而确定与主体对象相关联的多个特征点s

″

parts

。

[0071]

基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

[0072]

对客体对象的对象信息进行解析以确定客体对象的数量不为零并且客体对象的类型为辅助对象时,确定特征点修复类型为辅助对象修复;

[0073]

利用主客体识别网络在三维信息中对主体对象进行整体标记,基于整体标记提取特征点,以及主体对象的空间特征和时间特征;

[0074]

对客体对象进行特征点识别并进行特征点跟踪,所述特征点追踪包括对每一帧标记物理形状和位置信息,提取客体对象的空间特征和时间特征;

[0075]

根据辅助对象修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

[0076]

主体对象和客体对象在每一帧图像中的空间特征以及连续帧中的时间特征都进行变化。

[0077]

根据辅助对象修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

[0078]

利用主客体识别网络对经过数据融合的三维信息进行处理,其中主客体识别网络为融合自上而下的姿态识别网路与基于深度卷积的物体识别网络的识别网络;

[0079]

获取主体对象和客体对象中每个的对象范围b

i

,其jn≥i≥1,n为主体对象和客体对象的总数量,i为自然数;

[0080]

针对每个b

i

,通过自下而上的姿态识别网络对主体对象和客体对象各自的多个部分进行识别,以获得多个初始的特征点其中n为主体对象和客体对象的总数量,m为主体对象或客体对象的所有初始特征点的总数量,其中包括主体对象的多个初始的特征点和客体对象的多个初始的特征点;

[0081]

通过b

i

和构造交互识别算子a

interactive

,基于交互识别算子a

interactive

对主体对象和客体对象的位于交互区域的部分中的特征点进行识别和修复;

[0082]

构造主客体识别算子a

sando

,(其中sando表示主体和物体)基于主客体识别算子a

sando

分别计算的时空特征时空特征对应于主体对象和客体对象中每个的对象范围b

i

;

[0083]

通过计算主体对象和客体对象中每个的支撑点随时间的轨迹其中t为时间范围上限,s为空间,下标s

‑

t是时空特征,s

‑

spatia为空间,t

‑

temporal为时间以及主体对象和客体对象中全部支撑点随时间的轨迹通过对比与co

t

确定客体对象以及主体对象s;

[0084]

按照主体对象和客体对象重新对b

i

进行初步分类,以获得主体对象范围b

s

和客体对象范围b

o

;对于时间维度,主体对象范围b

s

和客体对象范围b

o

存在动态交集其中t1为第一时间并且t2为第二时间

[0085]

提取主体对象和客体对象两者的时间特征与空间特征,在[t1,t2]的交互时间段内,分别记为主体对象空间特征主体对象时间特征客体对象空间特征和客体对象时间特征

[0086]

主客体识别算子a

sando

在利用了特征点位置信息和点对方向信息的基础上,进一步添加力学信息m≥j≥1;利用杠杆原理,分别计算动态交集内与的力矩与力臂;结合运动学先验知识r

prior

,对主体对象和客体对象的初始特征点进行重新标定以获得与主体对象相关联的多个特征点b

′

s

和与客体对象相关联的多个特征点b

′

o

。

[0087]

当客体对象的数量为1时,基于交互识别算子a

interactive

对主体对象和客体对象的位于交互区域的部分中的特征点进行识别和修复包括:

[0088]

利用自上而下的姿态识别网路与自下而上的姿态识别网路结合后对对主体对象和客体对象的位于交互区域的部分中的特征点进行识别以获得数据主体对象范围b1和客体对象范围b2,以及主体对象的多个初始的特征点和客体对象的多个初始的特征点

[0089]

通过交互识别算子a

interactive

,对b1和b2中淘汰的特征点进行互补范围的二次匹

配;

[0090]

更新以获取最新的特征点分别得到以及以及

[0091]

根据本发明的另一方面,提供一种基于多个图像获取设备确定特征点的系统,所述系统包括:

[0092]

多个图像获取设备,其中每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像,并根据所获取的动态图像生成每个图像获取设备各自的动态图像文件;

[0093]

数据处理设备,用于根据预先设置的配置文件为每个动态图像文件确定各自的神经网络,利用每个动态图像文件各自的神经网络进行数据处理,以获取与每个图像获取设备相关联的热图集;

[0094]

数据融合设备,用于对多个热图集进行数据融合以获得每个图像获取设备的经过数据融合的热图集,基于每个图像获取设备的经过数据融合的热图集获得包括主体对象的三维信息;以及

[0095]

图像识别设备,用于对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息,基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

[0096]

根据本发明的另一方面,一种计算机可读存储介质,其特征在于,所述存储介质存储有计算机程序,所述计算机程序用于执行上述任一所述的方法。

[0097]

根据本发明的另一方面,一种电子设备,其特征在于,所述电子设备包括:

[0098]

处理器;

[0099]

用于存储所述处理器可执行指令的存储器;

[0100]

所述处理器,用于从所述存储器中读取所述可执行指令,并执行所述指令以实现上述任一所述的方法。

[0101]

本发明通过将康复医学、运动控制等理论知识融入到计算机视觉的姿态估计中,很好的解决了康复训练过程中各种关键点估计失败的问题。通过融合康复方案先验知识,将动作局部特征增强于传统部位识别网络之上,实现非完整人体动作识别,从而解决因局部视野而导致的关键点估计失败问题。通过多机位数据采集,融合相交视野数据,实现物理空间数据增强,提高网络对因人体对称性而导致自遮挡的识别精度。通过主动标记主客体(即主体为康复患者,客体为辅助物、康复医生或康复治疗师),融合康复医学与运动控制理论知识,提取多维特征构建交互识别算子,对关键点识别网络结果进行再加工,对人与人交互过程中关联错误的部位进行重新匹配,以及对人与物交互过程中丢失的部位进行补全,从而解决人与人、人与物互遮挡的问题。

附图说明

[0102]

通过参考下面的附图,可以更为完整地理解本发明的示例性实施方式:

[0103]

图1为根据本发明实施方式的基于多个图像获取设备确定特征点的方法的流程图;

[0104]

图2为根据本发明实施方式的功能模块的结构示意图;

[0105]

图3为根据本发明实施方式的确定空间物体点的精确位置的示意图;

[0106]

图4为根据本发明实施方式的生成三维信息的示意图;

[0107]

图5为根据本发明实施方式的提取特征点的示意图;

[0108]

图6为根据本发明另一实施方式的提取特征点的示意图;

[0109]

图7为根据本发明又一实施方式的提取特征点的示意图;

[0110]

图8为根据本发明再一实施方式的提取特征点的示意图;

[0111]

图9为根据本发明实施方式的基于多个图像获取设备确定特征点的系统的结构示意图。

具体实施方式

[0112]

图1为根据本发明实施方式的基于多个图像获取设备确定特征点的方法100的流程图。方法100从步骤101处开始。

[0113]

在步骤101,每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像,并根据所获取的动态图像生成每个图像获取设备各自的动态图像文件。在每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像之前还包括:获取主体对象的位置属性和方向属性,基于位置属性和方向属性为多个图像获取设备中每个图像获取设备确定基准位置。

[0114]

所述位置属性包括:主体对象的位置坐标和/或主题对象的位置区域。方向属性包括:主体对象的单个朝向信息或主题对象的多个朝向信息。

[0115]

所述获取主体对象的位置属性和方向属性包括:接收输入数据并对输入数据进行解析以确定主体对象的位置属性和方向属性;或者利用定位设备获取主体对象的定位信息,根据定位信息确定主体对象的位置属性和方向属性。

[0116]

所述基于位置属性和方向属性为多个图像获取设备中每个图像获取设备确定基准位置包括:基于位置属性和方向属性确定获取目标对象的动态图像的多个候选位置;从多个候选位置中为每个图像获取设备确定基准位置;其中每个图像获取设备的基准位置均不相同。

[0117]

每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像包括:每个图像获取设备在各自的基准位置处,以各自的预定拍摄角度分别获取主体对象的动态图像;或者每个图像获取设备基于各自的基准位置形成移动路径,通过在各自的移动路径选择拍摄位置,并在拍摄位置处以所选择的拍摄角度分别获取主体对象的动态图像。

[0118]

根据所获取的动态图像生成每个图像获取设备各自的动态图像文件包括:根据每个图像获取设备各自所获取的动态图像,得到动态图像数据流;利用动态图像数据流生成每个图像获取设备各自的动态图像文件。

[0119]

在步骤102,根据预先设置的配置文件为每个动态图像文件确定各自的神经网络,利用每个动态图像文件各自的神经网络进行数据处理,以获取与每个图像获取设备相关联的热图集。

[0120]

所述预先设置的配置文件中包括神经网络的名称和神经网络的参数信息。所述根据预先设置的配置文件为每个动态图像文件确定各自的神经网络包括:根据预先设置的配置文件中的神经网络的名称确定所要使用的神经网络;根据神经网络的参数信息对所要使

用的神经网络进行参数配置;将经过参数配置的神经网络确定为每个动态图像文件各自的神经网络;其中每个动态图像文件的神经网络是相同的神经网络。

[0121]

利用每个动态图像文件各自的神经网络进行数据处理,以获取与每个图像获取设备相关联的热图集包括:利用每个动态图像文件各自的神经网络对每个图像获取设备所获取的动态图像文件进行数据处理,以获取与每个图像获取设备相关联的热图集。

[0122]

在步骤103,对多个热图集进行数据融合以获得每个图像获取设备的经过数据融合的热图集,基于每个图像获取设备的经过数据融合的热图集获得包括主体对象的三维信息。

[0123]

所述对多个热图集进行数据融合以获得每个图像获取设备的经过数据融合的热图集包括:将多个热图集中的每个热图集依次选择作为当前热图集以进行:将多个热图集中除了当前热图集之外的每个热图集确定为融合热图集;基于多个融合热图集对当前热图集进行数据融合,以获得每个图像获取设备的经过数据融合的当前热图集。

[0124]

所述基于每个图像获取设备的经过数据融合的热图集获得包括主体对象的三维信息包括:基于每个图像获取设备的经过数据融合的热图集进行主体对象的特征点的识别,得到多幅同一时刻的二维特征点;根据每个图像获取设备的世界坐标系的坐标和图像坐标对二维特征点标定内外参数,基于内外参数获取包括主体对象的三维信息。

[0125]

在步骤104,对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息,基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

[0126]

所述对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息包括:利用图像识别设备对对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息。所述对象信息包括:客体对象的数量和客体对象的类型。

[0127]

基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:对客体对象的对象信息进行解析以确定客体对象的数量为零时,确定特征点修复类型为不进行修复;当特征点修复类型为不进行修复时,不根据特征点修复类型对所述三维信息进行特征点的修复,直接根据主题对象的三维信息确定与主体对象相关联的多个特征点。

[0128]

基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:对客体对象的对象信息进行解析以确定客体对象的数量不为零并且客体对象的类型为辅助物体(辅助物体例如是手持设备等,或者是固定设备,例如大型器械)时,确定特征点修复类型为辅助物体修复;利用主客体识别网络在三维信息中对主体对象进行整体标记,基于整体标记提取特征点,以及主体对象的空间特征和时间特征;对客体对象进行特征点识别并进行特征点跟踪,所述特征点追踪包括对每一帧标记物理形状和位置信息,提取客体对象的空间特征和时间特征;根据辅助物体修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

[0129]

当辅助物体为跟随型辅助物体时,主体对象和客体对象在每一帧图像中的空间特征以及连续帧中的时间特征都进行变化;当辅助物体为固定型辅助物体时,主体对象在每一帧图像中的空间特征以及连续帧的时间特征进行变化,而客体对象在每一帧图像中具有

稳定的空间特征,且连续帧中的时间特征保持一致;主题对象和客体对象的交互部分的空间特征存在波动。

[0130]

根据辅助物体修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:利用主客体识别网络对经过数据融合的三维信息进行处理,其中主客体识别网络为融合自上而下的姿态识别网路与基于深度卷积的物体识别网络的识别网络;

[0131]

对主体对象(主体对象例如是要识别的目标对象或人)和客体对象进行标记,获得主体对象范围b

s

和客体对象范围b

o

;

[0132]

在主体对象范围b

s

内,通过自下而上的姿态识别网络对主体对象的多个部分进行初始识别,以获得多个初始特征点s

parts

;

[0133]

在客体对象范围b

o

内,将客体对象标记为o;

[0134]

提取每一帧的空间特征f

space

,以及连续帧的时间特征f

time

;

[0135]

对空间特征f

space

与时间特征f

time

进行融合以确定客体对象的对象类别,分别进行跟随型辅助物体(例如是,手持设备或移动设备)和固定型辅助物体(例如,固定设备或墙体)的子场景标记s

i

,其中i=1,2;其中s1为跟随型辅助物体并且s2为固定型辅助物体;其中空间特征f

space

包括:形状、体积、角度、纹理、颜色、梯度和位置;时间特征f

time

包括位移、速度、上下文信息和旋转;

[0136]

对于s1子场景,随着时间推移,在主体对象范围的s1子场景和客体对象范围的s1子场景间存在动态交集其中t1为第一时间并且t2为第二时间;

[0137]

提取主体对象和客体对象两者的时间特征与空间特征,分别记为主体对象空间特征主体对象时间特征客体对象空间特征和客体对象时间特征

[0138]

在辅助物体的对象类别为跟随型辅助物体情况下,构建局部交互特征提取算子a

switho

,针对交集时间段[t1,t2],对多个遮挡部位的初始特征点进行重新识别,从而确定与主体对象相关联的多个特征点s

′

parts

;

[0139]

对于s2子场景,随着时间推移,在主体对象范围的s2子场景和客体对象范围的s2子场景间存在动态交集

[0140]

提取主体对象和客体对象两者的时间特征与空间特征,分别记为主体对象空间特征主体对象时间特征和客体对象空间特征其中在辅助物体的对象类别为固定型辅助物体的s2场景下,客体对象静止不动,因此不存在客体对象时间特征特征;

[0141]

在动态交集的时间段[t1,t2]内,由进入的范围而发生遮挡,对于每一个遮挡时刻t

j

,利用主体对象和客体对象的局部交互特征提取算子a

sbyo

,结合运动学先验知识k

prior

,,对遮挡下的每一帧f(t=t

j

)进行修补,从而确定与主体对象相关联的多个特征点s

″

parts

。

[0142]

基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

[0143]

对客体对象的对象信息进行解析以确定客体对象的数量不为零并且客体对象的类型为辅助对象(例如,进行康复时的辅助人员等)时,确定特征点修复类型为辅助对象修

复;

[0144]

利用主客体识别网络在三维信息中对主体对象进行整体标记,基于整体标记提取特征点,以及主体对象的空间特征和时间特征;

[0145]

对客体对象进行特征点识别并进行特征点跟踪,所述特征点追踪包括对每一帧标记物理形状和位置信息,提取客体对象的空间特征和时间特征;

[0146]

根据辅助对象修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

[0147]

主体对象和客体对象在每一帧图像中的空间特征以及连续帧中的时间特征都进行变化。根据辅助对象修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

[0148]

利用主客体识别网络对经过数据融合的三维信息进行处理,其中主客体识别网络为融合自上而下的姿态识别网路与基于深度卷积的物体识别网络的识别网络;

[0149]

获取主体对象和客体对象中每个的对象范围b

i

,其中n≥i≥1,n为主体对象和客体对象的总数量,i为自然数;

[0150]

针对每个b

i

,通过自下而上的姿态识别网络对主体对象和客体对象各自的多个部分进行识别,以获得多个初始的特征点其中n为主体对象和客体对象的总数量,m为主体对象或客体对象的所有初始特征点的总数量,其中包括主体对象的多个初始的特征点和客体对象的多个初始的特征点;

[0151]

通过b

i

和构造交互识别算子a

interactive

,基于交互识别算子a

interactive

对主体对象和客体对象的位于交互区域的部分中的特征点进行识别和修复;

[0152]

构造主客体识别算子a

sando

,基于主客体识别算子a

sando

分别计算的时空特征时空特征对应于主体对象和客体对象中每个的对象范围b

i

;

[0153]

通过计算主体对象和客体对象中每个的支撑点随时间的轨迹其中t为时间范围上限,s为空间,下标s

‑

t是时空特征,s

‑

spatial为空间,t

‑

temporal为时间;以及主体对象和客体对象中全部支撑点随时间的轨迹通过对比与co

t

确定客体对象以及主体对象s;

[0154]

按照主体对象和客体对象重新对b

i

进行初步分类,以获得主体对象范围b

s

和客体对象范围b

o

;对于时间维度,主体对象范围b

s

和客体对象范围b

o

存在动态交集t2≥t≥t1;其中t1为第一时间并且t2为第二时间

[0155]

提取主体对象和客体对象两者的时间特征与空间特征,在[t1,t2]的交互时间段内,分别记为主体对象空间特征主体对象时间特征客体对象空间特征和客体对象时间特征

[0156]

主客体识别算子a

sando

在利用了特征点位置信息和点对方向信息的基础上,进一步添加力学信息利用杠杆原理,分别计算动态交集内与的力矩与力臂;结合运动学先验知识r

prior

,对主体对象和客体对象的初始特征点进行重新标定

以获得与主体对象相关联的多个特征点b

′

s

和与客体对象相关联的多个特征点b

′

o

。

[0157]

当客体对象的数量为1时,基于交互识别算子a

interactive

对主体对象和客体对象的位于交互区域的部分中的特征点进行识别和修复包括:

[0158]

利用自上而下的姿态识别网路与自下而上的姿态识别网路结合后对对主体对象和客体对象的位于交互区域的部分中的特征点进行识别以获得数据主体对象范围b1和客体对象范围b2,以及主体对象的多个初始的特征点和客体对象的多个初始的特征点

[0159]

通过交互识别算子a

interactive

,对b1和b2中淘汰的特征点进行互补范围的二次匹配;

[0160]

更新以获取最新的特征点分别得到以及以及

[0161]

图2为根据本发明实施方式的功能模块的结构示意图。从功能结构上来说,本发明涉及数据融合模块、场景分类模块、遮挡修复模块、量化分析模块和量表映射模块。如其中数据融合模块用于:

[0162]

姿态估计过程中,单机位模式对于遮挡等情况识别效果差,无法精确定位人体空间姿态位置信息。而多机位信息是解决该问题的一种可行且高效的方案,如图3所示,不同机位c

u

和c

v

同时拍摄空间物体任一点,分别得到平面像和从投影几何学计算可反推出空间物体点p的精确位置。

[0163]

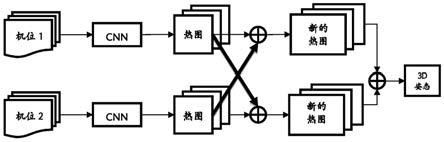

主流二维姿态识别利用heatmap来用于回归姿态各个关键点,本发明利用两路神经网络,分别获得不同机位的heatmap,然后通过融合两路heatmap图像,重新获取新的两路heatmap,从而获取空间三维姿态信息,具体流程图如图4所示。

[0164]

场景分类模块与遮挡修复模块用于:在体育运动赛事、临床外科模拟教学、脑功能开发以及康复训练等领域,都属于遵循行业相关标准规范、且有特定约束条件下的半开放场景,即对人体的位置、人与物的交互、人与人的交互都有一定的规则要求。

[0165]

所以本发明整体处理流程的首个环节是场景分类,通过人与物自动识别的分类网络等方式将场景分为单人、人与物、人与人三种场景。

[0166]

1)单人:单人场景指的是识别区域内只有一个主体作为跟踪目标,其余都作为干扰因素进行排除。

[0167]

2)人与物:通过场景分类自动识别出场景中的主体与客体,以康复训练为例,主体是康复患者,客体是康复辅具。通过识别网络对主体进行整体标记,然后提取关键点信息。对客体进行识别并进行跟踪,即每一帧标记物理的形状、位置信息等。通过提取客体的空间特征、时间特征再次将“人与物”交互场景分为“人用物”与“人靠物”两种子场景。

[0168]

2.1人用物

[0169]

该场景下,主体的人与客体的物,在每一帧图像中的空间特征以及连续帧中的时间特征都在变化。即主体的人与客体的物都是移动的。

[0170]

2.2人靠物

[0171]

该场景下,只有主体的人在每一帧图像中的空间特征以及连续帧的时间特征在变化,客体的物在每一帧图像中具有稳定的空间特征,且连续帧中的时间特征保持一致,仅在主客体交互部分的空间特征会有波动。即客体的物是不动的或者相对稳定的,主体的人是

移动的。

[0172]

具体的识别方案包括:融合数据结果直接进入主客体识别网络(即融合了自上而下的人体姿态识别网路与基于深度卷积的物体识别网络),首先从整体上对主体的人与客体的物进行标记,获得主客体的范围边框回归boundingbox,分别为b

s

,b

o

。在b

s

范围内,通过自下而上网络对人体各部分进行初始的精准识别,标记s

parts

。在b

o

范围内,对客体的物标记为o。与此同时提取每一帧的空间特征f

space

(比如形状、体积、角度、位置、纹理、颜色、梯度和位置)以及连续帧的时间特征f

time

(位移、速度、上下文信息、旋转等)。融合空间特征f

space

与时间特征f

time

确定客体物的状态,分别进行“人用物”与“人靠物”两类子场景标记s

i

,i=1,2。

[0173]

对于s1场景下,随着时间推进,在与范围间存在着动态交集此时同时提取主客体两者的时间与空间特征,分别记为构建人用物局部交互特征提取算子a

switho

,即subjectwithobject对交集时间段[t1,t2],重新精准识别各遮挡部位,获得完整关键点信息,标记为s

′

parts

。

[0174]

对于s2场景下,随着时间推进,在与范围间存在着动态交集此时同时提取主客体两者的时间与空间特征,分别记为(s2场景下客体的物不动,因此不存在特征,或者说)。在交集时间段[t1,t2],因为进入范围,而发生遮挡,对于每一个遮挡时刻t

i

,利用人靠物局部交互特征提取算子a

sbyo

,即subjectbyobject,结合康复训练的运动学先验知识k

prior

,,对遮挡下的每一帧f(t=t

i

)进行修补,从而得到新的关键部位识别结果s

′

parts

。

[0175]

3)人与人:

[0176]

融合数据结果直接进入自上而下的人体姿态识别网路,获取数据中每个人的boundingbox范围,标记为b

i

,n≥i≥1,n为总人数。针对每个b

i

,进入自下而上姿态识别网络,识别对应的人体各部分,分别标记为其中n同样为总人数,m为人体所有关键点总数(根据姿态模型不同,关键点个数略有不同,例如body_25、body_19、body_23、body_25b、body_135、coco_body、mpi_body等等)。

[0177]

3.1)通过b

i

和构造交互识别算子a

interactive

,对交互区域的人体各部分进行识别修补,具体流程如下,

[0178]

①

初始自上而下与自下而上网络结合后生成的数据b1和b2,以及和如图5所示。

[0179]

②

通过paf算子,对两个boundingbox中淘汰关键点进行互补boundingbox的二次匹配,如图6所示:

[0180]

③

重新更新最新的关节点分别得到以及以及修复效果如图7所示。

[0181]

3.2)通过构造主客体识别算子a

sando

,分别计算每个的时空特征对应每个人体区域b

i

。通过计算每个人体的支撑点随时间的轨迹以及整体全

局支撑点随时间的轨迹局支撑点随时间的轨迹通过对比与co

t

确定客体以及主体s。

[0182]

①

按照主客体重新对b

i

进行初步分类,分别标记为b

s

和b

o

,对于时间维度,主客体的boundingbox会发生动态交集此时同时提取主客体两者的时间与空间特征,分别记为征,分别记为在[t1,t2]交互时间段内,如图8所示。

[0183]

②

算子a

sando

在利用了关键点位置信息、点对方向信息基础上,进一步添加力学信息息m≥j≥1。因为人体骨骼属于刚性不变结构,利用杠杆原理,分别计算接触区域内与的力矩与力臂。并融合康复训练方案先验知识r

prior

,对主客体重新标定b

′

s

和b

′

o

。

[0184]

至此完成单人、人与物、人与人各个场景下的遮挡补全工作以及主客体识别工作。

[0185]

量化分析模块用于基于述场景分类与遮挡修复模块结果,能够获得主客体(单人情况下只有主体)精准的boundingbox数据b

i

,n≥i≥1,以及对应的完整的各个关键点数据s

′

parts

与在此基础上统计并计算各类定量特征,主要有静态特征、动态特征、统计特征,以及运动学特征等。

[0186]

量表映射模块用于对目标对象的多个特征点进行归一化处理,以获取多个通用特征点,并基于至少一个通用特征点的变化角度和/或移动数据确定目标对象的运动属性。根据预先定义的数据映射规则将目标对象的运行属性映射为预定格式的数据文件。

[0187]

图9为根据本发明实施方式的基于多个图像获取设备确定特征点的系统900的结构示意图。系统900包括:图像获取设备901、数据处理设备902、数据融合设备903以及图像识别设备904。

[0188]

多个图像获取设备901,其中每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像,并根据所获取的动态图像生成每个图像获取设备各自的动态图像文件。在每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像之前还包括:获取主体对象的位置属性和方向属性,基于位置属性和方向属性为多个图像获取设备中每个图像获取设备确定基准位置。

[0189]

所述位置属性包括:主体对象的位置坐标和/或主题对象的位置区域。方向属性包括:主体对象的单个朝向信息或主题对象的多个朝向信息。

[0190]

所述获取主体对象的位置属性和方向属性包括:接收输入数据并对输入数据进行解析以确定主体对象的位置属性和方向属性;或者利用定位设备获取主体对象的定位信息,根据定位信息确定主体对象的位置属性和方向属性。

[0191]

所述基于位置属性和方向属性为多个图像获取设备中每个图像获取设备确定基准位置包括:基于位置属性和方向属性确定获取目标对象的动态图像的多个候选位置;从多个候选位置中为每个图像获取设备确定基准位置;其中每个图像获取设备的基准位置均不相同。

[0192]

每个图像获取设备基于各自的基准位置分别获取主体对象的动态图像包括:每个图像获取设备在各自的基准位置处,以各自的预定拍摄角度分别获取主体对象的动态图

像;或者每个图像获取设备基于各自的基准位置形成移动路径,通过在各自的移动路径选择拍摄位置,并在拍摄位置处以所选择的拍摄角度分别获取主体对象的动态图像。

[0193]

根据所获取的动态图像生成每个图像获取设备各自的动态图像文件包括:根据每个图像获取设备各自所获取的动态图像,得到动态图像数据流;利用动态图像数据流生成每个图像获取设备各自的动态图像文件。

[0194]

数据处理设备902,用于根据预先设置的配置文件为每个动态图像文件确定各自的神经网络,利用每个动态图像文件各自的神经网络进行数据处理,以获取与每个图像获取设备相关联的热图集。

[0195]

所述预先设置的配置文件中包括神经网络的名称和神经网络的参数信息。所述根据预先设置的配置文件为每个动态图像文件确定各自的神经网络包括:根据预先设置的配置文件中的神经网络的名称确定所要使用的神经网络;根据神经网络的参数信息对所要使用的神经网络进行参数配置;将经过参数配置的神经网络确定为每个动态图像文件各自的神经网络;其中每个动态图像文件的神经网络是相同的神经网络。

[0196]

利用每个动态图像文件各自的神经网络进行数据处理,以获取与每个图像获取设备相关联的热图集包括:利用每个动态图像文件各自的神经网络对每个图像获取设备所获取的动态图像文件进行数据处理,以获取与每个图像获取设备相关联的热图集。

[0197]

数据融合设备903,用于对多个热图集进行数据融合以获得每个图像获取设备的经过数据融合的热图集,基于每个图像获取设备的经过数据融合的热图集获得包括主体对象的三维信息。

[0198]

所述对多个热图集进行数据融合以获得每个图像获取设备的经过数据融合的热图集包括:将多个热图集中的每个热图集依次选择作为当前热图集以进行:将多个热图集中除了当前热图集之外的每个热图集确定为融合热图集;基于多个融合热图集对当前热图集进行数据融合,以获得每个图像获取设备的经过数据融合的当前热图集。

[0199]

所述基于每个图像获取设备的经过数据融合的热图集获得包括主体对象的三维信息包括:基于每个图像获取设备的经过数据融合的热图集进行主体对象的特征点的识别,得到多幅同一时刻的二维特征点;根据每个图像获取设备的世界坐标系的坐标和图像坐标对二维特征点标定内外参数,基于内外参数获取包括主体对象的三维信息。

[0200]

图像识别设备904,用于对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息,基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

[0201]

所述对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息包括:利用图像识别设备对对每个动态图像文件进行图像识别以确定三维信息所涉及的客体对象的对象信息。所述对象信息包括:客体对象的数量和客体对象的类型。

[0202]

基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:对客体对象的对象信息进行解析以确定客体对象的数量为零时,确定特征点修复类型为不进行修复;当特征点修复类型为不进行修复时,不根据特征点修复类型对所述三维信息进行特征点的修复,直接根据主题对象的三维信息确定与主体对象相关联的多个特征点。

[0203]

基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维

信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:对客体对象的对象信息进行解析以确定客体对象的数量不为零并且客体对象的类型为辅助物体(辅助物体例如是手持设备等,或者是固定设备,例如大型器械)时,确定特征点修复类型为辅助物体修复;利用主客体识别网络在三维信息中对主体对象进行整体标记,基于整体标记提取特征点,以及主体对象的空间特征和时间特征;对客体对象进行特征点识别并进行特征点跟踪,所述特征点追踪包括对每一帧标记物理形状和位置信息,提取客体对象的空间特征和时间特征;根据辅助物体修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

[0204]

当辅助物体为跟随型辅助物体时,主体对象和客体对象在每一帧图像中的空间特征以及连续帧中的时间特征都进行变化;当辅助物体为固定型辅助物体时,主体对象在每一帧图像中的空间特征以及连续帧的时间特征进行变化,而客体对象在每一帧图像中具有稳定的空间特征,且连续帧中的时间特征保持一致;主题对象和客体对象的交互部分的空间特征存在波动。

[0205]

根据辅助物体修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:利用主客体识别网络对经过数据融合的三维信息进行处理,其中主客体识别网络为融合自上而下的姿态识别网路与基于深度卷积的物体识别网络的识别网络;

[0206]

对主体对象(主体对象例如是要识别的目标对象或人)和客体对象进行标记,获得主体对象范围b

s

和客体对象范围b

o

;

[0207]

在主体对象范围b

s

内,通过自下而上的姿态识别网络对主体对象的多个部分进行初始识别,以获得多个初始特征点s

parts

;

[0208]

在客体对象范围b

o

内,将客体对象标记为o;

[0209]

提取每一帧的空间特征f

space

,以及连续帧的时间特征f

time

;

[0210]

对空间特征f

space

与时间特征f

time

进行融合以确定客体对象的对象类别,分别进行跟随型辅助物体(例如是,手持设备或移动设备)和固定型辅助物体(例如,固定设备或墙体)的子场景标记s

i

,其中i=1,2;其中s1为跟随型辅助物体并且s2为固定型辅助物体;其中空间特征f

space

包括:形状、体积、角度、纹理、颜色、梯度和位置;时间特征f

time

包括位移、速度、上下文信息和旋转;

[0211]

对于s1子场景,随着时间推移,在主体对象范围的s1子场景和客体对象范围的s;子场景间存在动态交集其中t1为第一时间并且t2为第二时间;

[0212]

提取主体对象和客体对象两者的时间特征与空间特征,分别记为主体对象空间特征主体对象时间特征客体对象空间特征和客体对象时间特征

[0213]

在辅助物体的对象类别为跟随型辅助物体情况下,构建局部交互特征提取算子a

switho

,针对交集时间段[t1,t2],对多个遮挡部位的初始特征点进行重新识别,从而确定与主体对象相关联的多个特征点s

′

parts

;

[0214]

对于s2子场景,随着时间推移,在主体对象范围的s2子场景和客体对象范围的s2子场景间存在动态交集

[0215]

提取主体对象和客体对象两者的时间特征与空间特征,分别记为主体对象空间特

征主体对象时间特征和客体对象空间特征其中在辅助物体的对象类别为固定型辅助物体的s2场景下,客体对象静止不动,因此不存在客体对象时间特征特征;

[0216]

在动态交集的时间段[t1,t2]内,由进入的范围而发生遮挡,对于每一个遮挡时刻t

j

,利用主体对象和客体对象的局部交互特征提取算子a

sbyo

,结合运动学先验知识k

prior

,,对遮挡下的每一帧f(t=t

j

)进行修补,从而确定与主体对象相关联的多个特征点s

″

parts

。

[0217]

基于客体对象的对象信息确定特征点修复类型,根据特征点修复类型对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

[0218]

对客体对象的对象信息进行解析以确定客体对象的数量不为零并且客体对象的类型为辅助对象(例如,进行康复时的辅助人员等)时,确定特征点修复类型为辅助对象修复;

[0219]

利用主客体识别网络在三维信息中对主体对象进行整体标记,基于整体标记提取特征点,以及主体对象的空间特征和时间特征;

[0220]

对客体对象进行特征点识别并进行特征点跟踪,所述特征点追踪包括对每一帧标记物理形状和位置信息,提取客体对象的空间特征和时间特征;

[0221]

根据辅助对象修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点。

[0222]

主体对象和客体对象在每一帧图像中的空间特征以及连续帧中的时间特征都进行变化。根据辅助对象修复对所述三维信息进行特征点的修复,以确定与主体对象相关联的多个特征点包括:

[0223]

利用主客体识别网络对经过数据融合的三维信息进行处理,其中主客体识别网络为融合自上而下的姿态识别网路与基于深度卷积的物体识别网络的识别网络;

[0224]

获取主体对象和客体对象中每个的对象范围b

i

,其中n≥i≥1,n为主体对象和客体对象的总数量,i为自然数;

[0225]

针对每个b

i

,通过自下而上的姿态识别网络对主体对象和客体对象各自的多个部分进行识别,以获得多个初始的特征点其中n为主体对象和客体对象的总数量,m为主体对象或客体对象的所有初始特征点的总数量,其中包括主体对象的多个初始的特征点和客体对象的多个初始的特征点;

[0226]

通过b

i

和构造交互识别算子a

interactive

,基于交互识别算子a

interactive

对主体对象和客体对象的位于交互区域的部分中的特征点进行识别和修复;

[0227]

构造主客体识别算子a

sando

,基于主客体识别算子a

sando

分别计算的时空特征时空特征对应于主体对象和客体对象中每个的对象范围b

i

;

[0228]

通过计算主体对象和客体对象中每个的支撑点随时间的轨迹其中t为时间范围上限,s为空间,下标s

‑

t是时空特征,s

‑

spatial为空间,t

‑

temporal为时间;以及主体对象和客体对象中全部支撑点随时间的轨迹通过对

比与co

t

确定客体对象以及主体对象s;

[0229]

按照主体对象和客体对象重新对b

i

进行初步分类,以获得主体对象范围b

s

和客体对象范围b

o

;对于时间维度,主体对象范围b

s

和客体对象范围b

o

存在动态交集其中t1为第一时间并且t2为第二时间

[0230]

提取主体对象和客体对象两者的时间特征与空间特征,在[t1,t2]的交互时间段内,分别记为主体对象空间特征主体对象时间特征客体对象空间特征和客体对象时间特征

[0231]

主客体识别算子a

sando

在利用了特征点位置信息和点对方向信息的基础上,进一步添加力学信息利用杠杆原理,分别计算动态交集内与的力矩与力臂;结合运动学先验知识r

prior

,对主体对象和客体对象的初始特征点进行重新标定以获得与主体对象相关联的多个特征点b

′

s

和与客体对象相关联的多个特征点b

′

o

。

[0232]

当客体对象的数量为1时,基于交互识别算子a

interactive

对主体对象和客体对象的位于交互区域的部分中的特征点进行识别和修复包括:

[0233]

利用自上而下的姿态识别网路与自下而上的姿态识别网路结合后对对主体对象和客体对象的位于交互区域的部分中的特征点进行识别以获得数据主体对象范围b1和客体对象范围b2,以及主体对象的多个初始的特征点和客体对象的多个初始的特征点

[0234]

通过交互识别算子a

interactive

,对b1和b2中淘汰的特征点进行互补范围的二次匹配;

[0235]

更新以获取最新的特征点分别得到以及以及

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。