1.本发明涉及图像处理技术领域,特别涉及一种基于图像混合机制的鲁棒跨域姿态估计方法及系统。

背景技术:

2.本部分的陈述仅仅是提供了与本发明相关的背景技术,并不必然构成现有技术。

3.深度学习方法在姿态估计领域取得了很好的结果,但这种结果建立在以下两个前提的基础之上:首先模型训练要有足够的训练样本,其次测试样本与训练样本应遵循相同的分布。

4.但是在实际应用中上述两个条件往往难以满足。首先,数据的采集和标注会耗费大量的人力和物力成本;其次,在实际应用中,不同的场景采集到的数据不尽相同,诸如光照、摄像头移动等差距较大,这就导致训练与测试样本存在较大的分布差异。事实上,当某一表现良好的姿态估计模型应用于不同分布的数据集时,由于模型缺乏鲁棒性,性能会显著下降,这极大地限制了当前姿态估计模型的应用。

技术实现要素:

5.为了解决现有技术的不足,本发明提供了一种基于图像混合机制的鲁棒跨域姿态估计方法及系统,在模型输入层面上引入数据融合方法进行跨域姿态估计,通过加入噪声数据提高模型在目标域上的表现,提高了跨域姿态估计的精度。

6.为了实现上述目的,本发明采用如下技术方案:本发明第一方面提供了一种基于图像混合机制的鲁棒跨域姿态估计方法。

7.一种基于图像混合机制的鲁棒跨域姿态估计方法,包括以下过程:获取待处理的图像;根据获取的图像与openpose姿态估计模型,得到姿态估计结果;其中,openpose姿态估计模型采用融合数据集训练;将源域训练集中的某一帧图像的像素与目标域数据集中随机选取的某一帧图像的像素加权求和得到融合图像,将源域训练集中的各帧图像依次执行上述融合操作,得到融合数据集。

8.进一步的,源域训练集的每帧图像标注有关节热度图的真值和关节亲和域的真值。

9.进一步的,第一系数与源域训练集中的某一帧图像像素的乘积为第一变量,第二系数与目标域数据集中的某一帧图像像素的乘积为第二变量,根据第一变量与第二变量的加和得到融合图像;其中,第一系数与第二系数的加和为1。

10.更进一步的,第一系数为0.1,第二系数为0.9。

11.进一步的,融合数据的关节热力图与源域训练集的关节热度图相同,融合数据的关节亲和域与源域训练集的关节亲和域相同。

12.进一步的,openpose姿态估计模型的损失函数关节热度图损失函数与关节亲和域损失函数的加和。

13.进一步的,openpose姿态估计模型为二分支多级卷积神经网络架构,第一分支中的每个阶段预测关节热度图,第二分支中的每个阶段预测关节亲和域;每个分支均包括相同个数的阶段,两个分支同一阶段的网络结构相同,每个阶段之后,来自两个分支的预测结果与图像特征一起被连接用于下一阶段。

14.进一步的,采用反向传播算法进行openpose姿态估计模型的训练。

15.更进一步的,采用随机梯度下降法进行openpose姿态估计模型的训练.本发明第二方面提供了一种基于图像混合机制的鲁棒跨域姿态估计系统。

16.一种基于图像混合机制的鲁棒跨域姿态估计系统,包括:数据获取模块,被配置为:获取待处理的图像数据;姿态估计模块,被配置为:根据获取的图像与openpose姿态估计模型,得到姿态估计结果;其中,openpose姿态估计模型采用融合数据集训练,将源域训练集中的某一帧图像的像素与目标域数据集中随机选取的某一帧图像的像素加权求和得到融合图像,将源域训练集中的各帧图像依次执行上述融合操作,得到融合数据集。

17.与现有技术相比,本发明的有益效果是:1、本发明所述的基于图像混合机制的鲁棒跨域姿态估计方法及系统,在模型输入层面上引入数据融合方法进行跨域姿态估计,通过加入噪声数据提高了模型在目标域上的表现,提高了跨域姿态估计的精度。

18.2、本发明所述的基于图像混合机制的鲁棒跨域姿态估计方法及系统,具有泛化性好和跨域预测高精度的特点,经融合数据训练的姿态估计模型在现有数据集上跨域预测精度较高,在对跨域姿态估计上具有较高的预测精度,可应用到任意的跨域姿态估计任务中。

附图说明

19.构成本发明的一部分的说明书附图用来提供对本发明的进一步理解,本发明的示意性实施例及其说明用于解释本发明,并不构成对本发明的不当限定。

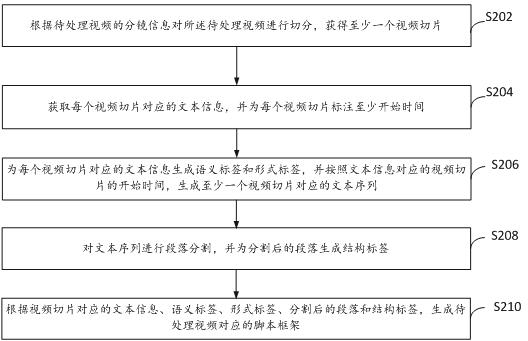

20.图1为本发明实施例1提供的基于图像混合机制的鲁棒跨域姿态估计方法的流程示意图。

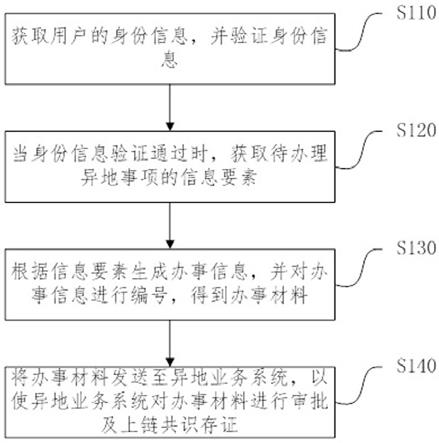

21.图2为本发明实施例1提供的图像混合机制示意图。

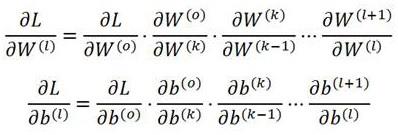

22.图3为本发明实施例1提供的姿态估计模型的训练流程示意图。

具体实施方式

23.下面结合附图与实施例对本发明作进一步说明。

24.应该指出,以下详细说明都是例示性的,旨在对本发明提供进一步的说明。除非另有指明,本文使用的所有技术和科学术语具有与本发明所属技术领域的普通技术人员通常理解的相同含义。

25.需要注意的是,这里所使用的术语仅是为了描述具体实施方式,而非意图限制根据本发明的示例性实施方式。如在这里所使用的,除非上下文另外明确指出,否则单数形式

也意图包括复数形式,此外,还应当理解的是,当在本说明书中使用术语“包含”和/或“包括”时,其指明存在特征、步骤、操作、器件、组件和/或它们的组合。

26.在不冲突的情况下,本发明中的实施例及实施例中的特征可以相互组合。

27.实施例1:如图1、图2和图3所示,本发明实施例1提供了一种基于图像混合机制的鲁棒跨域姿态估计方法,包括以下过程:获取待处理的图像数据;根据获取的图像数据与openpose姿态估计模型,得到姿态估计结果;其中,openpose姿态估计模型采用融合数据集训练;将源域训练集中的某一帧图像的像素与目标域数据集中随机选取的某一帧图像的像素加权求和得到融合图像,将源域训练集中的各帧图像依次执行上述融合操作,得到融合数据集。

28.具体的,所述姿态估计模型的训练,以跨域姿态估计数据集a

‑

b为例,以a作为源域,共5000帧图像数据,其中每帧图像带有标注关节热度图s={s1,s2,

…

,s

m

}的真值和关节亲和域l={l1,l2,

…

,l

n

}的真值,以b作为目标域,共2000帧图像数据,具体包括如下步骤:s0:选取源域中作为待融合数据(这里x

s

代表5000帧图像中的一帧,融合过程会重复若干次,直到源域中的数据依次全部融合完毕,f

s

为源域训练集中的图像)。

29.s1:随机选取目标域训练数据中的作为待融合数据(这里x

t

代表2000帧图像中的一帧,f

t

为目标域训练集中的图像)。

30.s2:将s0与s1得到的待融合数据按照以下公式进行融合,所有融合后得到的数据t记为:记为:其中,其中λ表示融合比例,即源域数据占比,s

mix

为融合数据的关节热力图,l

mix

为融合数据的关节亲和域,s和l分别表示源域待融合图像中标注的关节热度图的真值和关节亲和域真值,融合数据拥有与源域数据相同的关节热度图真值和关节亲和域真值。

31.具体的,依次选取源域训练集中的一帧图像x

s

,随机选取目标域训练集中的一帧图像x

t

,对上述两帧图像进行融合,融合过程为:选取0

‑

1之间的任意数最为融合比例系数,记为λ,由于每帧图像是由若干个像素点组成,每个点都具有像素值,因此将λ与x

s

中每个像素点的像素值相乘,然后加上1

‑

λ与x

t

中每个像素点的像素值相乘,即可得到一张新的图像,即融合比例为λ的融合图像。上述步骤重复若干次,即可得到融合比例为λ的若干张融合数据,即融合数据集。

32.关于最终生成的融合数据帧数的确定,依次选取源域图像,对每一帧x

s

会从给目

标域中随机抽取一张数据x

t

来进行上述像素值融合,即源域数据是依次全部选取,而目标域只是在融合时随机抽取。不管目标域中数据有几帧,融合数据的帧数只与源域数据帧数相等,因此融合数据的帧数也是5000帧。

33.s3:选取0.1作为融合比例系数,得到融合数据的融合数据记为mix0.1,即mix0.1表示选取融合比例λ等于0.1所得到的融合数据。

34.s4:利用s3得到的比例渐进的融合数据与源域训练数据共同作为姿态估计模型的训练数据。

35.本实施例中,姿态估计模型优选的采用openpose姿态估计模型,其网络架构为二分支多级卷积神经网络架构。第一分支中的每个阶段预测关节热度图,第二分支中的每个阶段预测关节亲和域。每个分支都有t个阶段,两个分支同一阶段的网络结构相同,随着阶段的递增,结构越来越复杂。比如在第一阶段,两分支的网络结构均由三层3*3的卷积和两层1*1卷积构成,第t阶段,两分支的网络结构由五层7*7的卷积和两层1*1卷积构成。在每个阶段之后,来自两个分支的预测结果与图像特征一起被连接用于下一阶段。最后,通过解析热度图和亲和域图,对图像中的所有人,生成2d关键点。

36.s5:构造损失函数l,见如下公式,其中p表示关节位置,w(p)为二进制掩码函数,图片在该关节有标注时w(p)=1,无标注时w(p)=0,和分别表示模型预测得到的关节热度图与关节亲和域值,和分别表示关节热度图和关节亲和域的真值数据,关节热度图损失为预测值与真值的偏差,利用二范数公式的平方计算,记为l1,关节亲和域损失同样为预测值与真值的偏差,利用二范数公式的平方计算,记为l2,l表示网络总体损失函数,记为l,通过损失函数可以测量真实结果与预测结果之间的误差大小,然后基于该误差对网络权值进行优化和修正。

37.其中,代表二范数的平方。

38.s6:采用反向传播算法和随机梯度下降法来减小误差,经过多次迭代训练得到姿态估计模型。

39.其中,反向传播是一种与最优化方法(如随机梯度下降法)结合使用的用来训练人工神经网络的常见方法。该方法对网络中所有权重计算损失函数的梯度。这个梯度会反馈给最优化方法,用来更新权值以最小化损失函数。反向传播利用一阶偏导来对网络中的参数计算损失函数的梯度,公式如下:

其中,和分别代表对网络中某层l的权重w

(l)

和偏置参数b

(l)

计算损失函数l的梯度,利用链式法则进行计算,其中o代表输出层,k代表隐藏层最后一层。

40.随机梯度下降法通过如下公式计算更新后的参数值,其中μ表示学习率,可理解为模型参数变化的速率:。

41.s7:利用s6得到的跨域姿态估计模型,对目标域测试数据进行跨域预测。

42.s8:目标域图像数据输入到vgg网络的前10层创建特征映射,利用步骤s4中的openpose二分支多阶段卷积神经网络结构,第一分支预测身体部位位置的关节热度图,第二分支预测关节亲和域,即其编码的关节之间的关联度,解析上述热度图和亲和域,得到图像中的所有人的2d关键点预测值。

43.在本实施例中,利用openpose作为基准模型,直接利用源域数据对openpose模型进行训练,训练后的模型对目标域数据进行姿态估计,测试精度map(mean average precision)为40%,而利用上述方法得到的融合数据对其进行训练,得到训练后的模型对目标域数据进行关节点预测,map(mean average precision)可达到65%。这是因为由于不同数据集在光照、视角、视野等方面差距较大,这就导致训练与测试样本存在较大的分布差异。通过所提方法得到的融合数据平衡了源域和目标域数据之间的风格差异,扩充了模型的训练数据,另外,利用融合数据训练模型,可使得模型兼容域之间的差异,使其在目标域上具有更好的泛化性,因此,该方法在现有跨域姿态估计任务中达到了较高的精度。

44.实施例2:本发明实施例2提供了一种基于图像混合机制的鲁棒跨域姿态估计系统,包括:数据获取模块,被配置为:获取待处理的图像数据;姿态估计模块,被配置为:根据获取的图像与openpose姿态估计模型,得到姿态估计结果;其中,openpose姿态估计模型采用融合数据集训练,将源域训练集中的某一帧图像的像素与目标域数据集中随机选取的某一帧图像的像素加权求和得到融合图像,将源域训练集中的各帧图像依次执行上述融合操作,得到融合数据集。

45.所述系统的工作方法与实施例1提供的基于图像混合机制的鲁棒跨域姿态估计方

法相同,这里不再赘述。

46.以上所述仅为本发明的优选实施例而已,并不用于限制本发明,对于本领域的技术人员来说,本发明可以有各种更改和变化。凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。