yolov5模型的性能。

12.所述se-yolov5模型为:在yolov5网络中的backbone层的最后加入se模块,以及把yolov5网络中csp层中的leakyrelu函数替换为acon激活函数。

13.通过带有瑕疵的布匹的rgb图像对se-yolov5模型进行训练。

14.所述acon激活函数为:

15.f

acon-c

(x)=(p

1-p2)x

·

σ[β(p

1-p2)x] p2x

[0016]

其中,x为输入值,p1和p2为可学习的参数,β为切换因子,σ为sigmoid函数。

[0017]

所述检测结果包括:瑕疵点锚框的中心位置的横坐标、纵坐标以及瑕疵点锚框的长度和宽度。

[0018]

一种改进yolov5的布匹瑕疵检测系统,包括:

[0019]

数据获取模块,用于从数据集中获取布匹的rgb图像;

[0020]

模型训练模块,用于训练se-yolov5模型;

[0021]

瑕疵点检测模块,用于将rgb图像导入训练好的se-yolov5模型进行瑕疵点检测,并输出检测结果。

[0022]

一种计算机可读存储介质,所述存储介质上存储有计算机程序,当所述计算机程序被处理器执行时,实现所述的一种改进yolov5的布匹瑕疵检测方法。

[0023]

一种改进yolov5的布匹瑕疵检测系统,包括存储器和处理器;所述存储器,用于存储计算机程序;所述处理器,用于当执行所述计算机程序时,实现所述的一种改进yolov5的布匹瑕疵检测方法。

[0024]

本发明具有以下有益效果及优点:

[0025]

1.模型可用于复杂的布匹瑕疵检测,便于布匹瑕疵检测模型在实际环境的部署。

[0026]

2.提升了布匹瑕疵检测模型的泛化能力,精度比原有模型要高。

附图说明

[0027]

图1为本发明方法整体流程图;

[0028]

图2为本发明方法的网络结构图;

[0029]

图3为本发明方法的acon-csp模块图;

[0030]

图4为本发明方法所使用数据集的示例图;

[0031]

图5为本发明方法检测布匹瑕疵的效果图;

[0032]

图6为本发明方法训练时的边界框回归损失曲线图。

具体实施方式

[0033]

下面结合附图及实施例对本发明做进一步的详细说明。

[0034]

本发明采用的技术方案是:一种改进的yolov5的布匹瑕疵检测方法,包括以下步骤:

[0035]

s1:输入布匹的rgb图像;

[0036]

s2:训练se-yolov5模型;

[0037]

s3:检测瑕疵点;

[0038]

s4:输出瑕疵点的位置。

[0039]

所述训练se-yolov5模型,具体为:在yolov5网络中的backbone中加入se模块(hu j,shen l,albanie s,et al.squeeze-and-excitation networks[j].ieee transactions on pattern analysis and machine intelligence,2020,42(8):2011-2023.),以及把yolov5 csp中的leakyrelu函数替换为acon激活函数。

[0040]

假设网络backbone中某一层的输出是其中,h为输出数据的高度,w为输出数据的宽度,c为输出数据的通道数。se模块就是一个计算单元,其可以通过一个卷积操作f来进行构建,f把输入映射到特征图其中,h

′

是特征图的高度,w

′

是特征图的宽度,c

′

是特征图的通道数。我们使用k=[k1,k2,

…

,kc′

]来表示卷积核的集合,其中kc′

是第c

′

个卷积。输出可以写成m=[m1,m2,

…

,mc′

],其中

[0041][0042]

式(1)中的*是卷积操作,x=[x1,x2,

…

,xc],],是空间核,其代表kc′

作用在x对应的通道上。为了简化,我们省略了偏置项。我们通过对所有通道进行加和来得到输出,通道依赖被隐式地嵌入到了kc′

,但被卷积核捕获的局部相关性所融合。

[0043]

如图3所示,其中,cbl表示由卷积、批量归一化和silu激活函数组合而成的操作,resunit表示残差单元,conv表示卷积操作,batchnorm表示批量归一化,我们替换yolov5 csp中的leaky relu函数为acon激活函数,这种新结构被称为acon-csp。acon-csp模块主要在特征图上进行特征提取,从图像中提取出丰富的信息。与大规模的卷积神经网络相比,acon-csp结构能够减少优化过程中的梯度信息重复。具体来说,我们使用acon-c来替代leakyrelu。acon-c仅使用超参数来缩放特征。acon-c的定义如下:

[0044]facon-c

(x)=(p

1-p2)x

·

σ[β(p

1-p2)x] p2x

ꢀꢀꢀꢀꢀꢀꢀ

(2)

[0045]

其中x是输入值,p1和p2是可学习的参数,β是切换因子,σ是sigmoid函数,并且我们初始化β=p1=p2=0。

[0046]

所述检测瑕疵点,具体为:我们将布匹的图像传送到已经训练好的se-yolov5。

[0047]

所述输出瑕疵点的位置,具体为:输出归一化的瑕疵点锚框的中心位置的横坐标、纵坐标以及长和宽。

[0048]

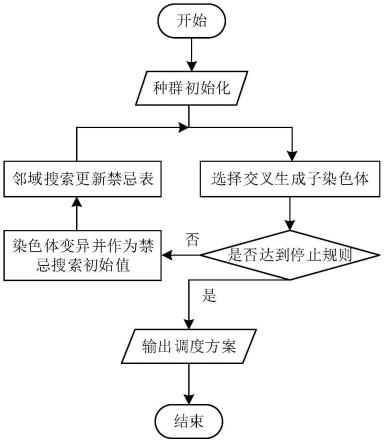

如图1所示,基于se-yolov5的布匹瑕疵检测方法包括以下步骤:

[0049]

1:输入布匹的rgb图像;

[0050]

2:训练如图2所示的目标检测网络se-yolov5模型;其中,input表示输入,output表示输出,focus表示切片操作,cbl表示由卷积、批量归一化和silu激活函数组合而成的操作,spp表示空间金字塔池化,upsample表示上采样,concat表示融合操作,conv表示卷积;

[0051]

3:检测瑕疵点;

[0052]

4:输出瑕疵点的位置。

[0053]

为了验证本发明方法的性能,我们在公开的布匹瑕疵数据集(天池布匹疵点智能识别比赛所提供的数据集)上进行了实验,我们称该数据集为天池布匹瑕疵数据集。该数据集的示例图片如图4所示。该数据集一共有3622张图片,2239张图片用于训练,1383张图片用于测试。

[0054]

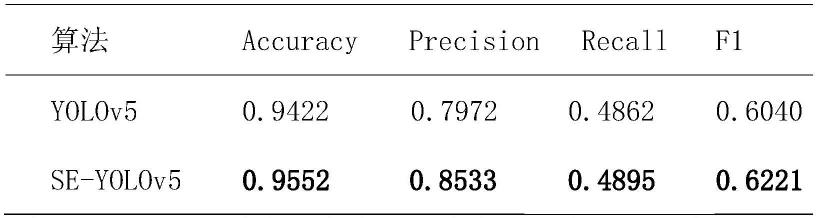

本发明方法使用accuracy(精度)、precision(查准率)、recall(召回率)、f1值来衡量模型的性能。

[0055][0056][0057][0058][0059]

其中,n

correct

是指测试集中瑕疵被正确检测出的图片的数量,b

total

是测试集中图片的数量,真正例(truepositive,tp)是指正确检测出了图片中的一个目标。假正例(falsepositive,fp)是指错误地检测了一个目标,即网络预测的目标不在图片中。假负例(falsenegative,fp)是指图片中存在一个目标,但没有被网络检测出来。在目标检测中,iou测量了预测的锚框和真正的锚框之间的重叠区域。检测结果会跟给定阈值的iou相比较,然后检测会被分成正确检测或者错误检测。

[0060]

我们在天池布匹瑕疵数据集验证了本发明方法的性能。本发明方法的accuracy为95.52%,超过了yolov5。实验结果如表1所示,结果显示本发明方法能够有效地判断图片是否有瑕疵,并且我们模型的性能超过了现有的yolov5布匹瑕疵检测模型。se-yolov5瑕疵检测的效果如图5所示。

[0061]

表1天池瑕疵数据集上的模型性能比较

[0062][0063]

我们使用天池布匹瑕疵数据集来训练本发明方法改进的模型。训练时的边界框回归函数曲线如图6所示,本实验的epoch(回合)数量设置为300,随着迭代次数的增加,边界框回归损失在不断地减少,并且模型在280个epoch后开始收敛,趋于稳定。结果显示se-yolov5收敛地很快,并且训练损失会收敛到一个稳定的值。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。