1.本发明属于目标检测、计算机视觉技术领域,尤其涉及一种基于自蒸馏和自注意力的目标检测方法。

背景技术:

2.在计算机视觉众多的技术领域中,目标检测也是一项非常基础的任务,图像分割、物体追踪、关键点检测等通常都要依赖于目标检测。在进行目标检测时,由于每张图像中物体的数量、大小及姿态各有不同,也就是非结构化的输出,这是与图像分类非常不同的一点,并且物体时常会有遮挡截断,所以物体检测技术也极富挑战性,从诞生以来始终是研究学者最为关注的焦点领域之一。因为目标检测具有广泛的应用领域与巨大的商业价值,学术界与工业界都在不断地探索新的目标检测算法,近些年来借助于深度学习与卷积神经网络和新出的transformer架构在计算机视觉领域取得了重大的突破,目标检测算法的准确率以及轻量化也在不断的被研究,有了许多的落地产品。

3.尽管目标检测技术已经取得了巨大的进步,但是在较复杂的环境下检测精度仍有待提高,对所提出来的目标检测算法也有了更高的要求

技术实现要素:

4.在计算机视觉众多的技术领域中,目标检测也是一项非常基础的任务,图像分割、物体追踪、关键点检测等通常都要依赖于目标检测。但是由于在现实场景中存在目标物体被遮挡、物体过小以及受环境因素影响,检测的精度还有待提高。

5.为了解决上述痛点,本发明提出一种基于自蒸馏和自注意力的目标检测方法,提出了基于自蒸馏和自注意力的目标检测方法,摒弃传统的知识蒸馏两阶段算法,利用混合图像采用一阶段的自蒸馏算法来提取检测目标的繁华特征,并引入transformer架构,将卷积神经网络的局部特征和transformer的全局特征结合起来,在faster-rcnn上直接采用三级阈值筛选出高级的候选框,最后进行精确的目标检测。

6.本发明解决其技术问题采用的技术方案是:

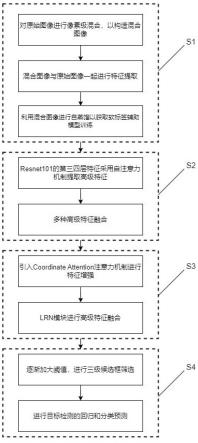

7.一种基于自蒸馏和自注意力的目标检测方法,其特征在于,包括以下步骤:

8.步骤s1:在目标检测通用数据集上引入自蒸馏机制训练特征提取网络;

9.步骤s2:提取出步骤s1训练获得的各层网络特征,利用transformer网络进行二次特征提取;

10.步骤s3:将步骤s1和步骤s2提取到的特征利用特征融合策略并引入注意力机制进行精细特征融合;

11.步骤s4:采用faster-rcnn目标检测模型对获取到的特征进行分类和回归,得到目标检测结果。

12.进一步地,步骤s1具体包括以下步骤:

13.步骤s11:从网络上获取公开的通用目标检测数据集,并获得训练数据的相关标

注;

14.步骤s12:在通用目标检测数据集的训练集中进行随机采样,选取两张图像分别为p1和p2,在p1和p2之间执行像素级图像混合,构造混合图像p

mixup

;混合图像p

mixup

的标签q

mixup

是在以相同混合比例用one-hot编码的真实标签q1和q2的之间的线性插值,q1和q2分别表示的是原始图像p1和p2的真实标签;

15.步骤s13:将混合图像p

mixup

和两张原始图像p1和p2一同放入resnet101模型训练,原始图像p1和p2推断出的概率分布为和并利用线性插值推断出混合图像的插值概率分布为混合图像p

mixup

推断出的概率分布为通过推断出的混合图像的插值概率分布对模型预测出来的混合图像的概率分布进行监督;混合图像的插值概率分布的计算公式如下:

[0016][0017]

其中,λ表示的是原始图像p1和p2的混合比例,混合图像的推测概率分布h,w,c分别表示的是图像推测出的特征概率分布的高度、宽度以及通道数,r表示实数集;

[0018]

步骤s14:利用平方l2范数实现混合图像的插值概率分布和混合图像的预测概率分布之间的相互对齐,计算公式如下:

[0019][0020]

其中,l

feature

表示的是混合图像的插值概率分布和预测概率分布之间相互对齐所采用的损失值;

[0021]

步骤s15:对同一阶段的特征映射引入鉴别器鉴别器是对从线性插值或混合图像中生成的特征映射进行分类,鉴别器的损失函数l

skd

采用的二元交叉熵损失,其计算公式如下:

[0022][0023]

其中,k表示的模型一次性输入的图片数量,k是对k从一开始的枚举。

[0024]

进一步地,步骤s2包括以下步骤:

[0025]

步骤s21:在步骤s13中将图像放入resnet101模型中进行特征提取,对提取出的resnet101模型的多层特征引入transformer架构,以提取更加高级的特征:定义resnet101模型输出的第三层特征为f

res3

,定义resnet101模型输出的第四层特征为f

res4

,定义transformer模型输出的第三层特征为s

res3

,定义transformer模型输出的第四层特征为s

res4

,引入自注意力机制,先对f

res3

和f

res4

进行下采样,然后将f

res3

和f

res4

分别用relattention注意力机制提取更加高级的特征,输出的新的高级特征图为f

′

res3

和f

′

res4

;

[0026]

步骤s22:为了巩固原有的信息,引入ffn网络,将得到的新的高级特征图f

′

res3

和f

′

res4

输入到里面,并在此基础上引入残差的机制,将f

res3

和f

res4

与得到的高级特征相加,最

后得到transformer架构输出的两层特征,分别为s

res3

和s

res4

,其计算如下:

[0027]sres3

=f

res3

ffn(relattention(downsample(f

res3

)))

[0028]sres4

=f

res4

ffn(relattention(downsample(f

res4

)))

[0029]

其中,ffn(

·

)表示的是前馈神经网络,downsample(

·

)表示的是一次下采样操作。

[0030]

进一步地,步骤s3具体包括以下步骤:

[0031]

步骤s31:对transformer模型中得到的高级特征s

res3

和s

res4

进行维度匹配,直接将s

res3

进行一次1

×

1的卷积得到维度为c的特征;

[0032]

步骤s32:对步骤s1和步骤s2得到的特征进行特征融合,首先将s

res3

和f

res3

进行特征融合,并且为了充分利用捕获到的位置信息,使感兴趣的区域能够被准确地捕获,引入coordinateattention注意力机制,对融合后的s

′

res3

进行特征增强;

[0033]

步骤s33:将s

res4

、f

res4

、s

′

res3

进行特征融合,先经过一个lrn模块将激活的神经元抑制周围的神经元,以增加特征的泛化能力,最后将三个特征沿着通道数维度拼接在一起,得到最终的高级特征s

final

。

[0034]

进一步地,步骤s4具体包括以下步骤:

[0035]

步骤s41:采用faster-rcnn,首先使用rpn结构生成候选框,将rpn生成的候选框投影到特征图上获得相应的特征矩阵;在生成候选框时加大筛选候选框的阈值,并且加大选取候选框的数量,以阈值为0.5、0.6、0.7分别对候选框进行逐次筛选,最后得到高质量的候选框;

[0036]

步骤s42:将每个特征矩阵通过roi pooling层缩放到7

×

7大小的特征图,接着将特征图展平通过一系列的全连接层得到目标检测的回归和分类的预测结果。

[0037]

与现有技术相比,本发明及其优选方案具有以下有益效果:

[0038]

1、与传统的知识蒸馏不同的是不用引入两阶段,直接自身网络生成软标签就能够对自身网络进行监督,大大减少了网络的复杂性以及避免了两阶段的模型训练。

[0039]

2、充分利用了混合图像的特征进行了自蒸馏,大大提高了模型的泛化能力。

[0040]

3、针对传统的卷积网络能够提取局部信息,而transformer网络能够提取全局信息的特点,将两者的优点结合起来,进行了特征的融合,能够过去更加高级的特征,并利用更加高级的达到更好的检测效果。

[0041]

4、为了适应多种大小的物体,对目标的位置进行更好的定位,引入了三级层层递进的候选框阈值进行筛选,能够得到更加高质量的候选框,提高了目标检测的回归任务的精度。

附图说明

[0042]

下面结合附图和具体实施方式对本发明进一步详细的说明:

[0043]

图1是本发明实施例的方法实现流程图。

具体实施方式

[0044]

为让本专利的特征和优点能更明显易懂,下文特举实施例,作详细说明如下:

[0045]

应该指出,以下详细说明都是例示性的,旨在对本技术提供进一步的说明。除非另

有指明,本说明书使用的所有技术和科学术语具有与本技术所属技术领域的普通技术人员通常理解的相同含义。

[0046]

需要注意的是,这里所使用的术语仅是为了描述具体实施方式,而非意图限制根据本技术的示例性实施方式。如在这里所使用的,除非上下文另外明确指出,否则单数形式也意图包括复数形式,此外,还应当理解的是,当在本说明书中使用术语“包含”和/或“包括”时,其指明存在特征、步骤、操作、器件、组件和/或它们的组合。

[0047]

如图1所示,本发明实施例提供了基于自蒸馏和自注意力的目标检测方法,包括以下步骤:

[0048]

步骤s1:在目标检测通用数据集上引入自蒸馏机制训练特征提取网络。具体包括以下步骤:

[0049]

步骤s11:从网络上获取公开的通用目标检测数据集,并获得训练数据的相关标注;

[0050]

步骤s12:在通用目标检测数据集的训练集中进行随机采样,选取两张图像分别为p1和p2,在p1和p2之间执行像素级图像混合,构造混合图像p

mixup

。混合图像p

mixup

的标签q

mixup

是在以相同混合比例用one-hot编码的真实标签q1和q2的之间的线性插值,q1和q2分别表示的是原始图像p1和p2的真实标签;

[0051]

步骤s13:将混合图像p

mixup

和两张原始图像p1和p2一同放入resnet101模型训练,原始图像p1和p2推断出的概率分布为和并利用线性插值推断出混合图像的插值概率分布为混合图像p

mixup

推断出的概率分布为可通过推断出的混合图像的插值概率分布来对模型预测出来的混合图像的概率分布进行监督。混合图像的插值概率分布的计算公式如下:

[0052][0053]

其中,λ表示的是原始图像p1和p2的混合比例,混合图像的推测概率分布h,w,c分别表示的是图像推测出的特征概率分布的高度、宽度以及通道数,r表示的是实数集;

[0054]

步骤s14:利用平方l2范数来实现混合图像的插值概率分布和混合图像的预测概率分布之间的相互对齐,计算公式如下:

[0055][0056]

其中,l

feature

表示的是混合图像的插值概率分布和预测概率分布之间相互对齐所采用的损失值;

[0057]

步骤s15:受对抗特征蒸馏的启发,进一步对同一阶段的特征映射引入鉴别器鉴别器是对从线性插值或混合图像中生成的特征映射进行分类,鉴别器的损失函数l

skd

采用的二元交叉熵损失,其计算公式如下:

[0058][0059]

其中,k表示的模型一次性输入的图片数量,k是对k从一开始的枚举。

[0060]

步骤s2:提取出步骤s1训练出来的各层网络特征,利用transformer网络进行二次特征提取。具体包括以下步骤:

[0061]

步骤s21:在步骤s13中将图像放入resnet101模型中进行特征提取,对提取出来的resnet101模型的多层特征引入transformer架构,提取更加高级的特征,定义resnet101模型出来的第三层特征为f

res3

,定义resnet101模型出来的第四层特征为f

res4

,定义transformer模型出来的第三层特征为s

res3

,定义transformer模型出来的第四层特征为s

res4

,引入自注意力机制,先对f

res3

和f

res4

进行下采样,然后将f

res3

和f

res4

分别用relattention注意力机制提取更加高级的特征,输出的新的高级特征图为f

′

res3

和f

′

res4

;

[0062]

步骤s22:为了巩固原有的信息,引入ffn网络,将得到的新的高级特征图f

′

res3

和f

′

res4

输入到里面,并在此基础上引入残差的机制,将之前的f

res3

和f

res4

与得到的高级特征相加,最后得到transformer架构出来的两层特征,分别为s

res3

和s

res4

,其计算如下:

[0063]sres3

=f

res3

ffn(relattention(downsample(f

res3

)))

[0064]sres4

=f

res4

ffn(relattention(downsample(f

res4

)))

[0065]

其中,ffn(

·

)表示的是前馈神经网络,downsample(

·

)表示的是一次下采样操作。

[0066]

步骤s3:将步骤s1和步骤s2提取到的特征利用特征融合策略并引入注意力机制进行精细特征融合。具体包括以下步骤:

[0067]

步骤s31:对transformer模型中得到的高级特征s

res3

和s

res4

进行维度匹配,直接将s

res3

进行一次1

×

1的卷积得到维度为c的特征;

[0068]

步骤s32:对步骤s1和步骤s2得到的特征进行特征融合,首先将s

res3

和f

res3

进行特征融合,并且为了充分利用捕获到的位置信息,使感兴趣的区域能够被准确地捕获,引入coordinateattention注意力机制,对融合后的s

′

res3

进行特征增强;

[0069]

步骤s33:将s

res4

、f

res4

、s

′

res3

进行特征融合,先经过一个lrn(local response normalization)模块,lrn模块借鉴了神经生物学中的侧抑制概念,即激活的神经元抑制周围的神经元,增加了特征的泛化能力,最后将三个特征沿着通道数维度拼接在一起,得到最终的高级特征s

final

。

[0070]

步骤s4:采用faster-rcnn目标检测模型对获取到的特征进行分类和回归,得到良好的目标检测结果。具体包括以下步骤:

[0071]

步骤s41:本实施例方法采用的是目标检测模型是faster-rcnn,它具有较高的检测精度,首先使用rpn结构生成候选框,将rpn生成的候选框投影到特征图上获得相应的特征矩阵,与传统不同的是,作为优选,在生成候选框上本实施例加大了筛选候选框的阈值,并且加大了选取候选框的数量,并以层层递进的思路,以阈值为0.5、0.6、0.7分别对候选框进行逐次筛选,最后得到高质量的候选框;

[0072]

步骤s42:将每个特征矩阵通过roi pooling层缩放到7

×

7大小的特征图,接着将特征图展平通过一系列的全连接层得到目标检测的回归和分类的预测结果。

[0073]

本领域内的技术人员应明白,本技术的实施例可提供为方法、系统、或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。

[0074]

本技术是参照根据本技术实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

[0075]

这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

[0076]

这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

[0077]

以上所述,仅是本发明的较佳实施例而已,并非是对本发明作其它形式的限制,任何熟悉本专业的技术人员可能利用上述揭示的技术内容加以变更或改型为等同变化的等效实施例。但是凡是未脱离本发明技术方案内容,依据本发明的技术实质对以上实施例所作的任何简单修改、等同变化与改型,仍属于本发明技术方案的保护范围。

[0078]

本专利不局限于上述最佳实施方式,任何人在本专利的启示下都可以得出其它各种形式的基于自蒸馏和自注意力的目标检测方法,凡依本发明申请专利范围所做的均等变化与修饰,皆应属本专利的涵盖范围。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。