1.本发明涉及集装箱码头集装箱起重机下的集卡车检测技术领域,尤其涉及一种基于视觉的集装箱码头集卡车检测方法。

背景技术:

2.在集装箱起重机自动化作业过程中,对集卡车来车作业场景的自动感知是整体自动化系统的关键环节,是自动化系统中其它子系统工作的关键信息来源,如集卡车对位子系统、集卡车车道侧自动着箱子系统、集卡车车牌和车顶号识别子系统、集装箱箱号识别子系统等。目前自动化系统采用的集卡车来车作业场景感知的技术方案主要有:

3.1)基于电子标签的集卡车检测方法;该方法主要在老旧设备自动化改造码头常见,主要原理为电子标签阅读器与标签之间进行非接触式的数据通讯;因此需要事先对所有起重机安装电子标签阅读器,对所有作业集卡车安装电子标签。该方法具有适应性高、简单易实施等优点;但也存在易被篡改、安全性不高、技术标准不统一等缺点,同时该方法只能解决有无集卡车的问题,是否载箱、进车方向等更多的场景信息无法感知获得。

4.2)基于地磁定位的集卡车检测方法;该方法主要在新型规划建设的自动化码头常见,作业的集卡车局限为昂贵的自动导引车(agv);其主要原理为在agv设备上安装磁导航传感器,在起重机作业场区地面内规划埋设磁钉,agv设备上的磁导航传感器通过检测地面铺设的磁钉来进行定位,并将定位信息发送给自动化系统,由自动化系统对实现起重机与agv设备的匹配,从而实现agv作业场景的感知;该方法适用性差、实施复杂、成本很高;同时该方法与基于电子标签的集卡车检测方法相同,只能解决有无agv来车的问题,对于更详细的场景信息无法感知获得。

5.3)基于激光扫描仪的集卡车检测方法;该方法主要原理为将激光扫描仪传感器安装在集装箱起重机设备上,位于集卡车作业车道的上方,通过对集卡车道进行实时扫描检测,并对激光扫描数据处理,实现集卡车作业场景信息的感知,可获取的信息包括:是否来车,集卡车朝向、是否载箱,载箱位置等。但该方法采用的激光扫描仪传感器较为昂贵,可感知范围较小,同时激光扫描仪极易受雨雪天气影响,导致无法正常工作。

6.基于以上情况,自动化码头现有的集卡车作业场景感知技术方案的缺点,已经在一定程度上严重制约自动化的发展进程。因此,如何低成本、高可靠性、全面感知集卡车作业场景的信息,已经成为自动化码头建设急迫解决的技术难题。

技术实现要素:

7.为了克服现有技术的上述缺点,本发明提出了一种基于视觉的集装箱码头集卡车检测方法。

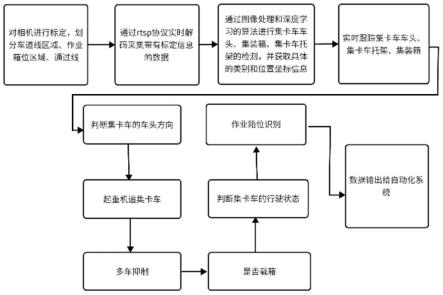

8.本发明解决其技术问题所采用的技术方案是:一种基于视觉的集装箱码头集卡车检测方法,包括如下步骤:

9.步骤s1:通过相机自身固有参数以及相机安装的机械参数,标定出具体的车道线

区域、作业箱位区域、通过线区域;

10.步骤s2:采集带有标定信息的图像数据,包括车道线区域信息、作业箱位区域信息和通过线区域信息;

11.步骤s3:通过图像处理和深度学习的方法对采集到的图像数据进行识别跟踪,获取集卡车车头、集装箱、集卡车托架的类别与位置坐标信息;

12.步骤s4:对识别跟踪到的集卡车车头、集装箱、集卡车托架信息进行业务流程处理,输出业务流程信息;

13.步骤s5:基于步骤s4中的业务流程信息,结合当前起重机作业的数据进行筛选集成,将目标车辆对应的作业信息输出到自动化系统。

14.与现有技术相比,本发明的积极效果是:

15.本发明提供了一种基于视觉的集装箱码头集卡车检测方法,实现了低成本、高可靠性、全面感知集卡车作业场景的信息,并将目标车辆对应的作业信息输出到自动化系统。本发明方法有效地解决了集装箱起重机自动化系统的输入问题,优化了集装箱码头船舶装卸流程,同时有效提高了自动化作业效率。

附图说明

16.本发明将通过例子并参照附图的方式说明,其中:

17.图1是本发明方法的总体流程示意图;

18.图2是本发明相机标定示意图。

具体实施方式

19.如图1所示,本发明提出了一种基于视觉的集装箱码头集卡车检测方法,包括以下步骤:

20.步骤s1:根据相机自身固有参数如水平视场角、垂直视场角、像素大小等,以及相机安装的机械参数如安装高度、安装俯仰角等,进行标定;通过计算得到车道线、作业箱位、通过线的范围,标定出具体的车道线区域(一、二、三车道)、作业箱位区域(作业箱位前、中、后)、通过线区域。

21.为了更好的实现本发明,所述步骤s1,具体还包括以下步骤:

22.步骤s1.1:相机标定实现一种将世界坐标系(目标物在真实世界里的位置)转换到像素坐标系(物体成像后在数字图像中的坐标)的映射,映射关系为:世界坐标(xw,yw,zw)

→

摄像机坐标(xc,yc,zc)

→

图像坐标(xy)

→

像素坐标(uv)。车道线的选择与标定:相机固定好安装高度和安装角度后,在相机拍摄的水平、垂直视场角范围内拍摄一张图片,对图像中车道线的特征区域进行标定;作业箱位的选择与标定:在标定好的某一作业车道内,拍摄当前作业车道中载有集装箱压前、压中、压后的三张图片,判断集装箱在托架中压前、压中、压后的中心点,利用相机已知的内参、外参矩阵,根据图2中的转换方式得到像素坐标系中作业箱位的特征坐标点,通过计算得到集装箱中心点到集装箱车头的距离,从而进行作业箱位的标定;通过线的选择与标定:拍摄一张图像中有集卡车的图片,在标定好的车道区域内,车头的中心点(x,y)到托架尾的垂直距离,利用相机已知的内参、外参矩阵,计算得到集卡车的长度范围,进行通过线的标定。

23.步骤s1.2:对标定后的相机作进一步的处理,带有标定信息的车道线区域,划分出不同的车道线区域位置信息,当集卡车驶入划分好的车道线内区域时即为此时集卡的作业车道。

24.步骤s2:通过rtsp协议实时对相机的数据进行解码,采集带有标定信息的图像数据,包括车道线区域信息、作业箱位区域信息和通过线区域信息。

25.步骤s3:通过图像处理和深度学习的方法对采集到的图像数据进行识别跟踪,输出相应的集卡车车头、集装箱、集卡车托架的类别与位置坐标信息。

26.为了更好的实现本发明,所述步骤s3,具体还包括以下步骤:

27.步骤s3.1:基于步骤s2采集到的数据,由于数据是集卡在运动中实时拍摄的,在数据采集过程中会有一些模糊重影数据,针对这一问题,采用了fgst(flow-guided sparse transformer for video deblurring用于视频去模糊的流引导稀疏变换器)在特征级别上利用时序信息,通过相邻的运动路径提高每帧的特征,进行视频的去模糊操作。基于卷积神经网络的方法,输入为模糊视频v,输出为清晰视频v

′

,采用u形结构,由编码器,解码器和瓶颈三部分组成,基本组成单位的光流引导注意力块。通过光流对注意力机制进行引导,实现线性复杂度和全局空间感受野,引入了re(recurrent embedding循环嵌入机制),将re(循环嵌入机制)嵌入到fgst的每一层中,通过将上一帧的输出连接到当前帧的输入,融合成query elements(查询要素),再输入fgab(flow-guided attentionblock光流引导注意力块),从而实现序列化地将信息从第一帧传递到最后一帧,循环嵌入机制实现方式为:

28.e=fw(y),q=fc([e,y]),k=∪y,y=fgab(q,k)

[0029]

其中y表示输出,e表示re(循环嵌入机制),q表示查询元素,k表示要素,fw表示对齐的空间信息,fc表示3*3的卷积聚合。扩大了fgst的时域感受野,从而有效去除视频数据模糊问题。

[0030]

步骤s3.2:基于步骤s3.1去模糊后的数据信息将每帧解码为一个矩阵,通过深度学习pp-picodet算法计算得到序列化的结果,识别集卡车车头、集装箱、集卡车托架的具体类别和位置坐标信息。

[0031]

步骤s3.3:基于步骤s3.2中识别到的集卡车车头、集装箱、集卡车托架信息,通过目标跟踪算法bytetrack对集卡车车头、集装箱、集卡车托架的运动轨迹进行跟踪。通过相似度(位置、外观、运动等信息)来关联目标集卡车车头、集装箱、集卡车托架得到跟踪轨迹。在保留高分检测结果的同时,从低分检测结果中去除不属于目标集卡车车头、集装箱、集卡车托架的背景,挖掘出真正的目标集卡车车头、集装箱、集卡车托架从而降低漏检并提高轨迹的连贯性。将每个检测框和其跟踪轨迹之间的相似性得分分成两类,高分框和低分框,进行两次匹配。第一次使用高分框和之前的跟踪轨迹进行匹配;第二次使用低分框和第一次没有匹配上高分框的跟踪轨迹(例如在当前帧受到严重遮挡导致得分下降的物体)进行匹配。对于没有匹配上跟踪轨迹,得分又足够高的检测框,对其新建一个跟踪轨迹。对于没有匹配上检测框的跟踪轨迹,会保留30帧,在其再次出现时再进行匹配跟踪。

[0032]

步骤s4:基于步骤s3中识别跟踪到的集卡车车头、集装箱、集卡车托架信息进行业务流程处理,输出业务流程信息。

[0033]

为了更好的实现本发明,所述步骤s4,具体还包括以下步骤:

[0034]

步骤s4.1:基于步骤s3中识别跟踪到的某一车道的集卡车车头、集卡车托架、集装

箱类别和位置坐标信息,进行集卡车车头方向识别,根据集卡车的车头与托架或车头与所载集装箱在图像中的相对位置坐标进行判断,比如:若车头区域的中心坐标在托架的下方,则集卡向右行驶车头方向为右。

[0035]

步骤s4.2:基于步骤s3识别跟踪到的某一车道的集卡车车头、集卡车托架、集装箱类别和位置坐标信息,进行起重机追集卡车的车头方向识别处理。集卡车在静止状态下,起重机向集卡移动时,集卡车出现在起重机下面的工况处理。针对图像第一帧仅出现集卡车托架或集装箱未出现集卡车车头的情况,计算集卡车托架或集装箱检测框纵轴中心的y值到图像纵轴最小值的距离和检测框纵轴中的y值到图像纵轴最大值的距离,距离小的方向则为默认的车头方向。

[0036]

步骤s4.3:基于步骤s3识别跟踪到的某一车道的集卡车车头、集卡车托架、集装箱类别和位置坐标信息,进行集卡多车抑制(即一条作业车道上有多个车的处理方式)。集卡车从车道驶入,车头检测框的中心点通过步骤s1中标定好的通过线时,检测到的车头与托架或车头与所载集装箱归为同一辆集卡车。

[0037]

步骤s4.4:基于步骤s3识别跟踪到的某一车道的集卡车车头、集卡车托架、集装箱类别和位置坐标信息,进行集卡是否载箱识别。若作业车道内有检测到集卡车头和集装箱信息,则判断为载箱,若检测到集卡车头和集卡托架信息则为无载箱。

[0038]

步骤s4.5:基于步骤s3识别跟踪到的某一车道的集卡车车头、集卡车托架、集装箱类别和位置坐标信息,进行集卡行驶状态识别。根据集卡当前帧与前几帧集卡车中心点之间的像素差来判断,如果在一个设定的阈值范围内则判断行驶状态为停止,否则为未停止的状态。

[0039]

步骤s4.6:基于步骤s3识别跟踪到的某一车道的集卡车车头、集卡车托架、集装箱类别和位置坐标信息,进行集卡作业箱位识别。当集卡的行驶状态为停止时,根据集卡车车头方向,得到集卡车尾部位置,定位集卡车尾部在相机标定的作业区域。

[0040]

步骤s5:基于步骤s4中的业务流程信息,结合当前起重机作业业务处理模块的数据进行筛选集成,将目标车辆对应的作业信息输出到自动化系统。有效解决自动化系统的输入问题,优化了集装箱码头船舶装卸流程,同时有效提高了自动化作业效率。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。