1.本发明涉及计算机视觉领域,特别涉及基于深度学习的遛狗违规行为检测方法、装置及设备。

背景技术:

2.宠物犬的主人都会定期遛狗,而遛狗不牵绳的不文明行为则会给社区带来严重的安全隐患。

3.目前随着相关制度的完善,有关部门对不规范养犬行为已加强约束及管控,新修订的《动物防疫法》明确规定,出户遛狗应当佩戴犬牌并采取系犬绳等措施;公共场合对于宠物犬的管理主要依靠人工监督;而人工监督时常出现疏忽遗漏并且也不能做到第一时间通知相关人员,因此,对于遛狗违规行为的管理方式有待提高。

技术实现要素:

4.本发明实施例提供了基于深度学习的遛狗违规行为检测方法、装置及设备,旨在解决当前人工监督遛狗违规行为效率低下的问题。

5.第一方面,本发明实施例提供了一种基于深度学习的遛狗违规行为检测方法,包括:

6.获取监控视频数据,并进行抽帧处理得到待检测图像;

7.根据第一目标检测算法对所述待检测图像进行犬只和行人检测,分别得到所述犬只的检测框和所述行人的检测框;

8.利用所述犬只的检测框和所述行人的检测框,计算得到所述犬只与所述行人之间的欧式距离;通过所述欧式距离计算得到所述犬只附近的感兴趣区域;

9.根据第二目标检测算法对所述感兴趣区域进行绳类连接物检测,得到所述感兴趣区域内的所述绳类连接物的信息;

10.根据所述绳类连接物的信息确认是否检测到绳类连接物,当检测到所述绳类连接物时,判断所述犬只是否存在历史追踪信息;若是,则更新所述犬只的牵绳状态历史数值;若否,则对所述犬只的牵绳状态进行初始化;

11.判断k帧区间内所述犬只的牵绳状态历史数值是否大于等于阈值;若是,则判断为正常遛狗;若否,则判断为违规遛狗;其中,当所述犬只周围未检测到所述行人时,则判断为流浪犬。

12.第二方面,本发明实施例提供了一种基于深度学习的遛狗违规行为检测装置,包括:

13.图像获取单元,用于获取监控视频数据,并进行抽帧处理得到待检测图像;

14.第一检测单元,用于根据第一目标检测算法对所述待检测图像进行犬只和行人检测,分别得到所述犬只的检测框和所述行人的检测框;

15.第二检测单元,用于利用所述犬只的检测框和所述行人的检测框,计算得到所述

犬只与所述行人之间的欧式距离;通过所述欧式距离计算得到所述犬只附近的感兴趣区域;

16.第三检测单元,用于根据第二目标检测算法对所述感兴趣区域进行绳类连接物检测,得到所述感兴趣区域内的所述绳类连接物的信息;

17.第一判断单元,用于根据所述绳类连接物的信息确认是否检测到绳类连接物,当检测到所述绳类连接物时,判断所述犬只是否存在历史追踪信息;若是,则更新所述犬只的牵绳状态历史数值;若否,则对所述犬只的牵绳状态进行初始化;

18.第二判断单元,用于判断k帧区间内所述犬只的牵绳状态历史数值是否大于等于阈值;若是,则判断为正常遛狗;若否,则判断为违规遛狗;其中,当所述犬只周围未检测到所述行人时,则判断为流浪犬。

19.第三方面,本发明实施例提供了一种计算机设备,包括存储器、处理器及存储在所述存储器上并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现所述第一方面的基于深度学习的遛狗违规行为检测方法。

20.本发明实施例提供一种基于深度学习的遛狗违规行为检测方法,获取监控视频数据并抽帧得到待检测图像;对所述待检测图像进行犬只和行人检测,分别得到对应的检测框;计算得到所述犬只与所述行人之间的欧式距离;通过所述欧式距离计算得到所述犬只附近的感兴趣区域;对所述感兴趣区域进行绳类连接物检测,得到所述感兴趣区域内的所述绳类连接物的信息;当检测到所述绳类连接物时,判断所述犬只是否存在历史追踪信息并做出对应修改;根据k 帧区间内所述犬只的牵绳状态历史数值是否大于等于阈值来判断是否违规遛狗。本发明采用检测k帧区间内犬只与行人之间的牵绳状态历史数值来判断是否违规遛狗,提高了公共场合管理人员管理犬只的效率。

21.本发明实施例还提供一种基于深度学习的遛狗违规行为检测装置和计算机设备,同样具有上述有益效果。

附图说明

22.为了更清楚地说明本发明实施例技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

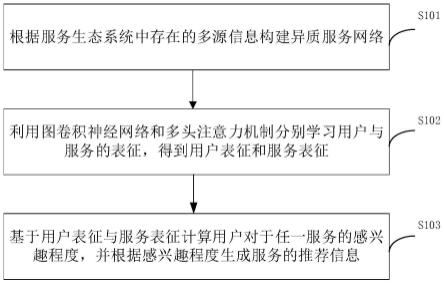

23.图1为本发明实施例提供的一种基于深度学习的遛狗违规行为检测方法的流程示意图;

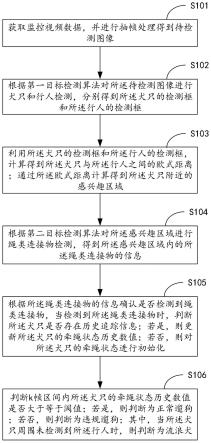

24.图2为本发明实施例提供的一种基于深度学习的遛狗违规行为检测方法的另一流程示意图;

25.图3为本发明实施例提供的一种基于深度学习的遛狗违规行为检测方法的感兴趣区域选取示意图;

26.图4为本发明实施例提供的一种基于深度学习的遛狗违规行为检测方法的违规遛狗结果图;

27.图5为本发明实施例提供的一种基于深度学习的遛狗违规行为检测方法的匈牙利算法流程图;

28.图6为本发明实施例提供的一种基于深度学习的遛狗违规行为检测装置的示意性

框图。

具体实施方式

29.下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

30.应当理解,当在本说明书和所附权利要求书中使用时,术语“包括”和“包含”指示所描述特征、整体、步骤、操作、元素和/或组件的存在,但并不排除一个或多个其它特征、整体、步骤、操作、元素、组件和/或其集合的存在或添加。

31.还应当理解,在此本发明说明书中所使用的术语仅仅是出于描述特定实施例的目的而并不意在限制本发明。如在本发明说明书和所附权利要求书中所使用的那样,除非上下文清楚地指明其它情况,否则单数形式的“一”、“一个”及“该”意在包括复数形式。

32.还应当进一步理解,在本发明说明书和所附权利要求书中使用的术语“和/ 或”是指相关联列出的项中的一个或多个的任何组合以及所有可能组合,并且包括这些组合。

33.下面请参见图1,图1为本发明实施例提供的一种基于深度学习的遛狗违规行为检测方法的流程示意图,具体包括:步骤s101~s106。

34.s101、获取监控视频数据,并进行抽帧处理得到待检测图像;

35.s102、根据第一目标检测算法对所述待检测图像进行犬只和行人检测,分别得到所述犬只的检测框和所述行人的检测框;

36.s103、利用所述犬只的检测框和所述行人的检测框,计算得到所述犬只与所述行人之间的欧式距离;通过所述欧式距离计算得到所述犬只附近的感兴趣区域;

37.s104、根据第二目标检测算法对所述感兴趣区域进行绳类连接物检测,得到所述感兴趣区域内的所述绳类连接物的信息;

38.s105、根据所述绳类连接物的信息确认是否检测到绳类连接物,当检测到所述绳类连接物时,判断所述犬只是否存在历史追踪信息;若是,则更新所述犬只的牵绳状态历史数值;若否,则对所述犬只的牵绳状态进行初始化;

39.s106、判断k帧区间内所述犬只的牵绳状态历史数值是否大于等于阈值;若是,则判断为正常遛狗;若否,则判断为违规遛狗;其中,当所述犬只周围未检测到所述行人时,则判断为流浪犬。

40.结合图1和图2所示,在步骤s101中,首先获取小区公共区域摄像头中的视频数据,并对视频数据进行抽帧处理得到待检测图像,这里进行抽帧处理是为了方便对图像帧中的犬只以及行人进行检测;本发明实施例可以仅对一个摄像头中的视频数据进行抽帧处理;当然,如果有需要则可以同时对多个摄像头的视频数据进行抽帧处理,这样可以同时检测多个场景中的违规遛狗行为;比如对五个摄像头的视频数据进行抽帧,则可以得到五个不同场景的待检测图像,提高了检测违规遛狗行为的效率,另外也可以由多个摄像头从不同角度对同一场景进行摄像,同时获取这些摄像头的监控视频数据,并进行抽帧处理,结合这些不同摄像头的监控视频数据来综合判断该场景下是否有违规遛狗行为;步骤s101中主要是将获取到的视频数据作抽帧处理,为下一步骤的处理做准备。

41.在一实施例中,所述步骤s101,包括:

42.获取监控视频数据,并进行抽帧处理得到获得原始图像;

43.对所述原始图像的色彩及空间域调整,完成所述原始图像的色差校正并按如下公式计算得到空域重构图像:

[0044][0045]

其中,i(g)代表所述原始图像中g点的像素值;i(h)代表所述原始图像中 h点的像素值;(i(g)-i(h))代表g,h两点的像素差;||g-h||代表距离度量;ω代表所述原始图像中所有像素点集合;s

α

(t)代表坡度函数;r(g)代表所述空域重构图像;

[0046]

对校正后的所述空域重构图像进行动态扩展,并按如下公式将所述空域重构图像归一化到[0,1]之间,得到所述待检测图像:

[0047][0048]

其中,l(g)代表所述待检测图像;max r代表r(g)的最大值;min r代表r(g) 的最小值。

[0049]

在本实施例中,在场景中安装的摄像头可能受光线等环境因素影响,抽帧处理后的待检测图像可能出现亮度过暗、过度曝光等现象,本发明实施例采用自动色彩均衡算法对抽帧图像进行增强处理,从而防止待检测图像出现亮度过暗、过度曝光等现象;首先获取视频数据,并进行抽帧处理得到获得原始图像,对所述原始图像的色彩及空间域调整,完成所述原始图像的色差校正后得到空域重构图像;在得到所述空域重构图像还需要对所述空域重构图像进行动态扩展,将所述空域重构图像归一化到[0,1]之间,最终得到全局白平衡后的图像,即所述待检测图像;需要注意的是,若有其他可以替代的图像改善算法,同样适应本发明,如优化图像的清晰度,使得系统更方便捕获目标等。

[0050]

在步骤s102中,根据第一目标检测算法对所述待检测图像进行犬只和行人检测,在本发明实施例中,所述第一目标检测算法为yolov5模型,所述yolov5 模型主要由骨干网络、neck层和预测层组成;骨干网络采用了focus结构,csp 结构(cspnet的跨阶段局部融合网络),增强了cnn的学习能力,能够在轻量化的同时保持准确性;neck层采用pfn pan模块,融合不同维度的特征,从而提高网络对不同大小目标物体特征和位置信息的提取能力;预测层输出目标物体的类别信息和坐标信息;需要注意的是若有其他可替代的目标检测算法,能够实现对犬只以及行人的检测即可;最后经所述第一目标检测算法检测后,分别得到所述待检测图像中的所述犬只的检测框和所述行人的检测框。

[0051]

在一实施例中,所述步骤s102之前,包括:

[0052]

对所述第一目标检测算法进行训练,并按如下损失函数进行优化:

[0053]

l

loss

=λ1l

conf

λ2l

cla

λ3l

loc

[0054]

其中,l

conf

代表是否为目标的置信度损失,l

cla

代表类别损失,l

loc

代表定位损失,λ1、λ2和λ3均代表对应的平衡系数;l

loss

代表总损失。

[0055]

在本实施例中,在使用所述第一目标检测算法对所述待检测图像进行犬只和行人检测之前,需要对所选用的所述第一目标检测算法进行训练;首先,使用标注软件,如

labelimg等,对行人与犬只的图片数据集进行标注,再将已标注的图片输入至初始化的网络模型(所述第一目标检测算法,下同)中进行训练并利用损失函数进行优化。

[0056]

具体的,在推理阶段中,直接将所述待检测图像输入至已训练完成的所述网络模型中,即可获得所述犬只的检测框参数和所述行人的检测框参数其中i表示第i个犬只,j表示第j个行人,d、p分别表示所述犬只和所述行人;另外的,和的检测框参数格式均统一为(x1,y1,x2,y2),x1和y1分别代表检测框左上角的横坐标和纵坐标,x2和y2分别代表检测框右下角的横坐标和纵坐标。

[0057]

在上述步骤s102中,最常见的情况是,在一帧待检测图像中,检测到一个犬只的检测框和多个行人的检测框,一般来说,离该犬只最近的行人是该犬只的主人,如果该犬只主人为正常遛狗,则该犬只主人与该犬只之间应具有一绳类连接物,所以本实施例可以通过检测犬只与其最近的行人之间是否具有绳类连接物来确定是否存在未违规遛狗行为。结合图3所示,在步骤s103中,先利用所述犬只的检测框和多个所述行人的检测框,计算得到所述犬只与多个所述行人之间的欧式距离(欧式距离是一个距离定义,指在m维空间中两个点之间的真实距离,或者向量的自然长度);再通过所述欧式距离计算得到所述犬只附近的感兴趣区域,图3中all矩形框即为所述犬只附近的感兴趣区域,dog矩形框为所述犬只的检测框,person矩形框为所述行人的检测框。

[0058]

在一实施例中,所述步骤s103,包括:

[0059]

按如下公式计算得到所述犬只与所述行人之间的欧式距离:

[0060][0061]

其中,d

ij

代表第i个犬只与第j个行人的欧式距离;和分别代表第i个犬只的中心点横坐标和第i个犬只的中心点纵坐标;和分别代表第j个行人的中心点横坐标和第j个行人的中心点纵坐标。

[0062]

进一步的,通过所述欧式距离计算得到距离所述犬只最近的行人,作为目标行人;按如下公式计算得到所述犬只附近的感兴趣区域:

[0063]

ir=[min(x1,m1),min(y1,n1),max(x2,m2),max(y2,n2)]

[0064]

其中,ir代表所述犬只附近的感兴趣区域;min(x1,m1)代表取所述犬只的检测框左上角横坐标与所述目标行人的检测框左上角横坐标之间的最小值; min(y1,n1)代表取所述犬只的检测框左上角纵坐标与所述目标行人的检测框左上角纵坐标之间的最小值;max(x2,m2)代表取所述犬只的检测框右下角横坐标与所述目标行人的检测框右下角横坐标之间的最大值;max(y2,n2)代表取所述犬只的检测框右下角纵坐标与所述目标行人的检测框右下角纵坐标之间的最大值。

[0065]

在本实施例中,根据欧式距离可以计算得到所述待检测图像中所有行人与所述犬只之间的真实距离,欧式距离公式中的和分别代表第i个犬只的中心点横坐标和第i个犬只的中心点纵坐标;和分别代表第j个行人的中心点横坐标和第j个行人的中心

点纵坐标;其中,所述犬只以及所述行人的中心点横坐标均可以根据所述犬只以及所述行人的检测框对应的左上角点和右下角点的横坐标的平均值计算得到;所述犬只以及所述行人的中心点纵坐标均可以根据所述犬只以及所述行人的检测框对应的左上角点和右下角点的纵坐标的平均值计算得到;如需要计算所述犬只的中心点横坐标,则点的纵坐标的平均值计算得到;如需要计算所述犬只的中心点横坐标,则代表所述犬只的检测框左上角横坐标,代表所述犬只的检测框右下角横坐标。

[0066]

进一步的,通过计算所述待检测图像中的每个行人与所述犬只的欧式距离后,可以得到距离所述犬只最近的目标行人其中,m代表最小值,距离第 i个犬只最近的行人可记为需要注意的是,为了方便进行区分将的检测框参数表示为(m1,n1,m2,n2),结合所述犬只附近的感兴趣区域的计算公式可以得到所述犬只附近的感兴趣区域的矩形框参数,以便后续步骤的判断。

[0067]

在步骤s104中,根据第二目标检测算法对所述感兴趣区域进行绳类连接物 (图3中的leash矩形框)检测,得到所述感兴趣区域内的所述绳类连接物的信息;同理,这里的所述第二目标检测算法也不作限定,本发明实施例同样可以采用yolov5模型来检测所述绳类连接物是否存在;需要注意的是,在使用所述 yolov5模型之前需要先进行训练,首先将图片数据集中的绳类连接物进行标注,并根据损失函数(损失函数可以利用所述第一目标检测算法中训练用的损失函数)对所述yolov5模型进行优化训练;在推理阶段,将所述犬只的感兴趣区域输入至已训练完成的所述yolov5模型中,若感兴趣区域检测出绳类连接物,则可将所述绳类连接物的检测框参数记为以方便后续步骤使用。

[0068]

在步骤s105中,根据所述绳类连接物的信息确认是否检测到绳类连接物(即确认所述目标行人与所述犬只之间是否存在所述绳类连接物),当检测到所述绳类连接物时,判断所述犬只是否存在历史追踪信息(每一所述待检测图像为一帧,所述历史追踪信息为当前帧之前的区间帧数的所述绳类连接物的信息);若是,则更新所述犬只的牵绳状态历史数值;若否,则对所述犬只的牵绳状态进行初始化;如所述犬只的牵绳状态历史数值为4,当更新所述犬只的牵绳状态历史数值时,可以在4的基础上加1,具体可以结合实际应用情况进行设置;而将所述犬只的牵绳状态进行初始化,则可以设置为0,并在下次检测到所述绳类连接物存在时,可以对应的更新所述犬只的牵绳状态历史数值。

[0069]

结合图4所示,在步骤s106中,判断k帧区间内所述犬只的牵绳状态历史数值是否大于等于阈值;若是,则判断为正常遛狗;若否,则判断为违规遛狗;这里的k帧区间是指连续的多帧待检测图像,比如可以设定如1-10帧作为k帧区间,也可以设定5-14帧作为k帧区间等等。如1-10帧作为k帧区间,第1,2,4帧均检测到存在所述绳类连接物,其他帧均检测到不存在所述绳类连接物,即所述牵绳状态历史数值为3,若此时阈值取3时,则所述犬只的牵绳状态历史数值等于阈值,判断为正常遛狗;若此时阈值取4时,则所述犬只的牵绳状态历史数值小于阈值,判断为违规遛狗;另外的,当所述犬只周围未检测到所述行人时,即不存在所述行人的检测框参数时,则判断为流浪犬;当检测到出现流浪犬或违规遛狗时,系统将触发语音提醒模块发出警告,并将数据实时传送至相关管理人员电脑端进行提醒,以便相关管理人员进行后续的管理,大大提高公共场合相关管理人员管理犬只的效率。

[0070]

在一实施例中,所述基于深度学习的遛狗违规行为检测方法,还包括:

[0071]

根据卡尔曼滤波算法对所述犬只进行追踪预测,计算得到所述犬只的追踪框;利用匈牙利算法将所述犬只的检测框与所述犬只的追踪框进行匹配,得到所述犬只的追踪信息。

[0072]

进一步的,所述根据卡尔曼滤波算法对所述犬只进行追踪预测,计算得到所述犬只的追踪框,包括:

[0073]

将所述犬只的状态向量表示为:

[0074][0075]

其中,s代表检测框的面积;r代表横纵比;均代表相应的变化速率; x代表所述犬只的状态向量;t代表第t时刻;

[0076]

按如下公式将所述卡尔曼滤波算法的预测值与观测值进行数据融合,得到融合值;

[0077][0078]

其中,代表第k帧的融合值;代表根据所述犬只的运动状态计算出的第k帧的预测值;kk代表卡尔曼增益;zk代表所述犬只的检测框测量值;h代表所述犬只的状态向量到测量值的转换矩阵;代表残差。

[0079]

进一步的,所述利用匈牙利算法将所述犬只的检测框与所述犬只的追踪框进行匹配,得到所述犬只的追踪信息,包括:

[0080]

将所述犬只的检测框与所述犬只的追踪框进行最大化匹配,所述最大化匹配的过程中存在以下三种结果:

[0081]

当所述犬只的检测框与所述犬只的追踪框互相匹配成功时,使用所述犬只的检测框对追踪结果进行卡尔曼滤波权重及参数更新,同时记录所匹配的追踪框的计数次数;

[0082]

当所述犬只的检测框匹配失败时,将所述犬只的检测框进行卡尔曼滤波初始化后加入追踪列表中;

[0083]

当所述犬只的追踪框匹配失败时,判断所述犬只的追踪框失去关联的计数次数是否大于最大阈值;若是,则将所述犬只的追踪框从追踪列表中删除;否则,则将失去关联的计数次数加一;

[0084]

根据所述最大化匹配过程中存在的三种结果判断所述犬只的区间帧数是否小于所述犬只的最小击中帧数;若是,则返回显示;若否,则判断所述犬只的连续命中帧数是否大于或等于所述犬只的最小击中帧数,若大于或等于所述犬只的最小击中帧数则返回显示。

[0085]

结合图5所示,在本实施例中,为了降低单帧图像的误检,本发明采用多帧检测的方式提升检测效果的准确性与鲁棒性,但需考虑的是,当所述待检测图像中存在多个犬只时,所述第一目标检测算法无法判断多个犬只的id,无法根据历史检测结果进行多帧判断,因此采用sort多目标跟踪算法,对所述待检测图像中的每一犬只进行跟踪;所述sort多目标跟踪算法包括:卡尔曼滤波算法和匈牙利算法。

[0086]

具体的,在所述卡尔曼滤波算法中,将所述犬只的状态向量表示为x,并代入公式计算可以得到所述卡尔曼滤波算法的预测值与观测值进行融合后的融合值,即所述犬只的追踪框;公式中的代表残差,所述残差即预测值与测量值间的差距;而所述卡尔曼增益kk按如下公式计算得到:

[0087][0088]

其中,p代表噪声协方差矩阵;h代表观测矩阵;k代表卡尔曼增益(系数); r代表观测噪声协方差矩阵。

[0089]

进一步的,在根据所述卡尔曼滤波算法计算出所述犬只的追踪框后,利用所述匈牙利算法(匈牙利算法是一种数据关联算法,其依据是“损失最小”,损失以损失矩阵来表示,所述损失矩阵的每个c

u,v

元素由前一帧第u个经所述卡尔曼滤波算法预测的追踪框与当前帧的第v个所述犬只的检测框的交并比决定)将所述犬只的检测框与所述犬只的追踪框进行最大化匹配,所述最大化匹配的过程中三种结果分别代表:互相匹配成功的检测框与追踪框(犬只追踪成功)、匹配失败的检测框(新犬只出现)、匹配失败的追踪框(犬只消失);最后根据所述最大化匹配过程中存在的三种结果判断所述犬只的区间帧数是否小于所述犬只的最小击中帧数;若是,则返回显示;若否,则判断所述犬只的连续命中帧数是否大于或等于所述犬只的最小击中帧数,若大于或等于所述犬只的最小击中帧数则返回显示;返回显示成功则代表所述sort多目标跟踪算法成功追踪到所述待检测图像中的每一犬只,以便后续根据所述犬只的牵绳状态判断是否违规遛狗。

[0090]

结合图6所示,图6为本发明实施例提供的一种基于深度学习的遛狗违规行为检测装置的示意性框图,基于深度学习的遛狗违规行为检测装置600包括:

[0091]

图像获取单元601,用于获取监控视频数据,并进行抽帧处理得到待检测图像;

[0092]

第一检测单元602,用于根据第一目标检测算法对所述待检测图像进行犬只和行人检测,分别得到所述犬只的检测框和所述行人的检测框;

[0093]

第二检测单元603,用于利用所述犬只的检测框和所述行人的检测框,计算得到所述犬只与所述行人之间的欧式距离;通过所述欧式距离计算得到所述犬只附近的感兴趣区域;

[0094]

第三检测单元604,用于根据第二目标检测算法对所述感兴趣区域进行绳类连接物检测,得到所述感兴趣区域内的所述绳类连接物的信息;

[0095]

第一判断单元605,用于根据所述绳类连接物的信息确认是否检测到绳类连接物,当检测到所述绳类连接物时,判断所述犬只是否存在历史追踪信息;若是,则更新所述犬只的牵绳状态历史数值;若否,则对所述犬只的牵绳状态进行初始化;

[0096]

第二判断单元606,用于判断k帧区间内所述犬只的牵绳状态历史数值是否大于等于阈值;若是,则判断为正常遛狗;若否,则判断为违规遛狗;其中,当所述犬只周围未检测到所述行人时,则判断为流浪犬。

[0097]

在本实施例中,图像获取单元601首先获取监控视频数据,并进行抽帧处理得到待检测图像;第一检测单元602检测得到所述犬只的检测框和所述行人的检测框;第二检测单元603检测得到所述犬只附近的感兴趣区域;第三检测单元604检测得到所述感兴趣区域内的所述绳类连接物的信息;第一判断单元 605判断是否检测到绳类连接物并执行相应的操

作;最后第二判断单元606判断 k帧区间内所述犬只的牵绳状态历史数值是否大于等于阈值,来判断是否违规遛狗。

[0098]

在一实施例中,所述图像获取单元601,包括:

[0099]

获取单元,用于获取监控视频数据,并进行抽帧处理得到获得原始图像;

[0100]

重构单元,用于对所述原始图像的色彩及空间域调整,完成所述原始图像的色差校正并按如下公式计算得到空域重构图像:

[0101][0102]

其中,i(g)代表所述原始图像中g点的像素值;i(h)代表所述原始图像中 h点的像素值;(i(g)-i(h))代表g,h两点的像素差;||g-h||代表距离度量;ω代表所述原始图像中所有像素点集合;s

α

(t)代表坡度函数;r(g)代表所述空域重构图像;

[0103]

输出单元,用于对校正后的所述空域重构图像进行动态扩展,并按如下公式将所述空域重构图像归一化到[0,1]之间,得到所述待检测图像:

[0104][0105]

其中,l(g)代表所述待检测图像;max r代表r(g)的最大值;min r代表r(g 的最小值。

[0106]

在一实施例中,所述第一检测单元602之前,包括:

[0107]

训练单元,用于对所述第一目标检测算法进行训练,并按如下损失函数进行优化:

[0108]

l

loss

=λ1l

conf

λ2l

cla

λ3l

loc

[0109]

其中,l

conf

代表是否为目标的置信度损失,l

cla

代表类别损失,l

loc

代表定位损失,λ1、λ2和λ3均代表对应的平衡系数;l

loss

代表总损失。

[0110]

在一实施例中,所述第二检测单元603,用于:

[0111]

按如下公式计算得到所述犬只与所述行人之间的欧式距离:

[0112][0113]

其中,d

ij

代表第i个犬只与第j个行人的欧式距离;和分别代表第i个犬只的中心点横坐标和第i个犬只的中心点纵坐标;和分别代表第j个行人的中心点横坐标和第j个行人的中心点纵坐标。

[0114]

进一步的,通过所述欧式距离计算得到距离所述犬只最近的行人,作为目标行人;

[0115]

按如下公式计算得到所述犬只附近的感兴趣区域:

[0116]

ir=[min(x1,m1),min(y1,n1),max(x2,m2),max(y2,n2)]

[0117]

其中,ir代表所述犬只附近的感兴趣区域;min(x1,m1)代表取所述犬只的检测框左上角横坐标与所述目标行人的检测框左上角横坐标之间的最小值; min(y1,n1)代表取所述犬只的检测框左上角纵坐标与所述目标行人的检测框左上角纵坐标之间的最小值;max(x2,m2)代表取所述犬只的检测框右下角横坐标与所述目标行人的检测框右下角横坐标之

间的最大值;max(y2,n2)代表取所述犬只的检测框右下角纵坐标与所述目标行人的检测框右下角纵坐标之间的最大值。

[0118]

在一实施例中,所述基于深度学习的遛狗违规行为检测装置600,还包括:

[0119]

追踪单元,用于根据卡尔曼滤波算法对所述犬只进行追踪预测,计算得到所述犬只的追踪框;利用匈牙利算法将所述犬只的检测框与所述犬只的追踪框进行匹配,得到所述犬只的追踪信息。

[0120]

在一实施例中,所述追踪单元,用于:

[0121]

将所述犬只的状态向量表示为:

[0122][0123]

其中,s代表检测框的面积;r代表横纵比;均代表相应的变化速率; x代表所述犬只的状态向量;t代表第t时刻;

[0124]

进一步的,按如下公式将所述卡尔曼滤波算法的预测值与观测值进行数据融合,得到融合值;

[0125][0126]

其中,代表第k帧的融合值;代表根据所述犬只的运动状态计算出的第k帧的预测值;kk代表卡尔曼增益;zk代表所述犬只的检测框测量值;h代表所述犬只的状态向量到测量值的转换矩阵;代表残差。

[0127]

在一实施例中,所述追踪单元,还用于:

[0128]

将所述犬只的检测框与所述犬只的追踪框进行最大化匹配,所述最大化匹配的过程中存在以下三种结果:

[0129]

当所述犬只的检测框与所述犬只的追踪框互相匹配成功时,使用所述犬只的检测框对追踪结果进行卡尔曼滤波权重及参数更新,同时记录所匹配的追踪框的计数次数;

[0130]

当所述犬只的检测框匹配失败时,将所述犬只的检测框进行卡尔曼滤波初始化后加入追踪列表中;

[0131]

当所述犬只的追踪框匹配失败时,判断所述犬只的追踪框失去关联的计数次数是否大于最大阈值;若是,则将所述犬只的追踪框从追踪列表中删除;否则,则将失去关联的计数次数加一;

[0132]

根据所述最大化匹配过程中存在的三种结果判断所述犬只的区间帧数是否小于所述犬只的最小击中帧数;若是,则返回显示;若否,则判断所述犬只的连续命中帧数是否大于或等于所述犬只的最小击中帧数,若大于或等于所述犬只的最小击中帧数则返回显示。

[0133]

由于装置部分的实施例与方法部分的实施例相互对应,因此装置部分的实施例请参见方法部分的实施例的描述,这里暂不赘述。

[0134]

本发明实施例还提供了一种计算机设备,可以包括存储器和处理器,存储器中存有计算机程序,处理器调用存储器中的计算机程序时,可以实现上述实施例所提供的步骤。当然计算机设备还可以包括各种网络接口,电源等组件。

[0135]

说明书中各个实施例采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似部分互相参见即可。对于实施例公开的系统而言,由于其与实施例公开的方法相对应,所以描述的比较简单,相关之处参见方法部分说明即可。应当指出,对于本技术领域的普通技术人员来说,在不脱离本技术原理的前提下,还可以对本技术进行若干改进和修饰,这些改进和修饰也落入本技术权利要求的保护范围内。

[0136]

还需要说明的是,在本说明书中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的状况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。