1.本发明涉及迁移学习与对抗网络技术,具体涉及一种基于图像风格迁移的雨雾天气交通流数据集扩增方法。

背景技术:

2.数量充足、标注完善的数据集是推进计算机视觉研究的基础,但是,创建这种数据集需要耗费大量人力物力。在交通领域,ngsim(next generation simulation)是应用最为广泛的基于图像的车辆数据集,然而许多研究表明ngsim数据存在无法修补的错误,与之体量相当的真实数据集近年来并未推出;因此,合成数据集成为图像领域关注的焦点;然而,例如3d渲染、三维建模等单纯基于合成数据的数据集通常不适用于真实图像,这种情况的解决方法是使用风格迁移将真实数据集中的某种场景的目标与特征迁移到另一个场景中,即将已标记数据的源域学习到的知识转移到未标记数据的目标域;

3.雨雾天气影响可见光图像的成像质量,并进一步影响到图像中目标的清晰度与可辨识度。用于正常天气条件下的交通目标检测识别算法在雨雾天气下往往效果较差,因此有必要制作雨雾天气下交通流数据集,用于训练针对该环境下的检测、跟踪等交通信息感知算法。

4.基于风格迁移的数据集扩增是一种可行有效的图像处理技术。已有研究中,中国专利cn202011517955.6公开了一种基于风格迁移的丝绸文物图像扩增方法,中国专利cn202111005177.7公开了一种小样本场景数据扩增方法,采用wct算法进行风格迁移计算,但现有方法训练迭代过程不稳定,针对某一场景生成合适模型花费时间较长,且迁移后图像边缘质量下降明显,图像中目标结构与轮廓与源图像中差异较大,无法用于后续交通信息感知处理。

5.雨雾天气下的交通信息感知是一种可行有效的智能交通系统算法。已有研究中,中国专利cn202010191052.7提出一种雨雾天气下使用红外图像进行车辆检测的方法,中国专利cn201410387383.2公开了一种基于多特征融合的全天候交通环境车辆检测方法,其中采用虚拟线圈数据捕获车辆信息。总体来说,大部分研究考虑更换可见光数据源解决雨雾天气下的交通目标感知问题,但可见光数据成像直观,语义特征丰富,布设成本低,是智能交通系统中最理想的感知数据类型,有必要考虑充分利用现有的正常天气交通数据集,为雨雾天气交通目标感知提供支持。

6.有鉴于此,需要提供一种新的方法,以期解决上述至少部分问题。

技术实现要素:

7.为了克服现有技术的不足,本发明提出了一种基于图像风格迁移的雨雾天气交通流数据集扩增方法,该技术首先获取正常与雨雾天气交通流数据集以及目标路段图像序列,接下来构造生成式对抗网络将正常天气数据集场景转化为雨雾天气,其中先分割数据集中背景域与目标域,之后将目标域样本与整幅图像样本分别送入对抗网络中进行风格迁

移学习,接着将背景域图像送入分类器获取特定场景标签,完成雨雾天气场景数据集扩增,最后将训练好的网络模型带入目标路段图像序列中,获取目标路段场景雨雾天气扩增后的数据集;本发明提升了现有风格迁移图像的成像质量,增加迁移图像中目标的清晰度与可辨识度,算法训练过程稳定,可移植性强,适用于各种不同交通场景的雨雾天气数据及扩增;

8.技术方案:为解决上述技术问题,本发明采用以下技术方案:

9.一种基于图像风格迁移的雨雾天气交通流数据集扩增方法,包括:

10.s1:获取正常天气条件下的交通流图片数据集dn与标签ln,获取雨雾天气条件下的交通流图片数据集da与标签la,获取一段目标路段的交通流视频图像序列d

t

;

11.s2:根据正常天气条件下的交通流图片的标签ln从正常天气条件下的交通流图片数据集dn中分割目标域图像样本和背景域图像样本,根据雨雾天气条件下的交通流图片的标签la从雨雾天气条件下的交通流图片数据集da中分割目标域图像样本和背景域图像样本,所述背景域图像样本为交通流图片数据集中剥离目标域图像样本的图像样本;

12.s3:构造无监督生成式对抗网络,将目标域图像样本与完整图像样本分别送入无监督生成式对抗网络中进行风格迁移学习,获取迁移后的目标域d

t,f

与迁移后的完整图像d

t,p

;

13.s4:将正常天气条件下的交通流图片数据集dn与雨雾天气条件下的交通流图片数据集da的背景域图像样本送入无监督生成式对抗网络中的分类器t

bg

,获取特定场景标签基于迁移后的目标域d

tf

、迁移后的完整图像d

t

和特定场景标签形成交通流图片数据集从正常天气条件至雨雾天气条件的风格迁移模型;

14.s5:将目标路段的交通流视频图像序列d

t

输入风格迁移模型中的分类器t

bg

,获取目标路段的交通流背景标签并生成对应的背景,将随机的迁移后的目标域d

t,f

映射至前述背景中,得到目标路段在雨雾天气条件下的交通流数据集d

ft

与标签l

ft

。

15.进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述步骤s1中正常天气条件下的交通流图片数据集dn中含标签图片的采集视角与目标路段的交通流视频图像序列d

t

的采集视角相同或相近,雨雾天气条件下的交通流图片数据集da中含标签图片包括目标路段的交通流视频图像序列d

t

的采集视角的场景。

16.进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述步骤s1中正常天气条件下的交通流图片的标签ln、雨雾天气条件下的交通流图片的标签标签la、目标路段在雨雾天气条件下的交通流标签l

ft

的类型为外接框或目标掩模,且三者类型一致。

17.进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述步骤s1中正常天气条件下的交通流图片数据集dn中含标签ln的图片总量大于5000张,雨雾天气条件下的交通流图片数据集da中含标签图片总量大于100张。

18.进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述步骤s3中进行风格迁移学习的生成式对抗网络结构包括生成器g、判别器d、分类器t

bg

与稳定器st,其中:

19.生成器g的输入包括正常天气条件下的交通流图片数据集dn与随机噪声,生成器g

的输出为雨雾迁移图像d

t

;

20.判别器d的输入为雨雾迁移图像d

t

与雨雾天气条件下的交通流图片数据集da,判别器d的输出为雨雾迁移图像d

t

与雨雾天气条件下的交通流图片数据集da的判别结果以及生成器g的调整策略;

21.分类器t

bg

的输入为正常天气条件下的交通流图片数据集dn与雨雾天气条件下的交通流图片数据集da中剥离目标域样本的背景图像,分类器t

bg

的输出为特定场景标签

22.稳定器st的输入为迁移后的目标域结果d

t,f

与雨雾天气条件下的交通流图片的标签la对应的迁移后的整幅图像结果d

t,p

,稳定器st的输出为调整后的完整雨雾天气数据集d

tj

与对应标签l

tj

。

23.进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述生成器g的结构为包含残差模块的卷积神经网络,其中,随机噪声通过全连接层特化特征,并与正常天气条件下的交通流图片数据集dn的图像合并,再通过步长为1、维数为64的卷积层与激活函数relu进行下采样,然后通过5层残差模块提取残差特征,并采用步长为1、维数为3的反卷积层进行上采样,最后经过激活函数tanh输出雨雾迁移图像d

t

。

24.进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述判别器d采用四层卷积层提取特征,并通过批标准化bn与激活函数lrelu归一特征,最后通过激活函数tanh输出对应图像为真的概率。

25.进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述分类器t

bg

包括两层4*4下采样层,经过两层下采样层后的背景图像在压缩尺寸的基础上仍保留道路范围、光线条件、采集视角等关键场景信息。

26.进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述步骤s3的风格迁移对抗网络中,生成器g的损失函数如下:

[0027][0028]

其中,表示生成器对抗损失,由对抗网络中判别器给出,l

con

为内容损失,用于描述生成图像与源图像的底层信息差异,l

t

为分类器损失,用于区分由分类器给出的特定场景中生成图像的差异,λ1、λ2与λ3为调节三种损失重要性的权重系数;

[0029]

对抗损失取判别器d对伪融合图像判别结果的交叉熵,即:

[0030][0031]

其中,d(g(v,i))表示判别器d对生成图像的判真概率;

[0032]

内容损失l

con

定义如下:

[0033][0034]

其中,l

ssim

表示由结构相似性指标ssim计算得到的结构损失,用于约束生成图像结构相似性,l

pmse

表示像素对均方误差mse的损失,用于约束生成图像边缘相似性,δ1与δ2为调节l

ssim

和l

pmse

重要性的权重参数。

[0035]

进一步的,本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法,所述步骤s3的风格迁移对抗网络中,判别器d的损失函数如下:

[0036]

ld=p1e

cross

[-logd(dn)] p2e

cross

[-log(1-d(g(dn,z)))

[0037]

其中,p1、p2为反映源图像与生成图像信息量的权重系数,计算方式与生成器ssim损失函数中权重计算方式相同。

[0038]

本发明采用以上技术方案与现有技术相比,具有以下技术效果:

[0039]

1、本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法采用图像风格迁移的生成式对抗网络处理雨雾天气下交通流数据集扩增问题,首先根据已有数据集划分场景背景域与目标域,接下来将大量正常天气数据集与少量雨雾天气数据集送入对抗网络,将雨雾天气合成入正常天气场景中,之后将背景域送入分类器,获取特定场景背景标签信息,最后将训练好的对抗网络模型引入目标图像序列,完成目标场景下雨雾天气数据集扩增。本发明提升了现有风格迁移图像的成像质量,增加迁移图像中目标的清晰度与可辨识度,算法训练过程稳定,可移植性强,适用于各种不同交通场景的雨雾天气数据及扩增,为雨雾天气下监控数据采集、车辆安全驾驶等交通场景应用提供了质量优秀的数据源。

[0040]

2、本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法设计了一种包含内容损失的雨雾天气数据集扩增对抗网络生成器损失函数,将内容损失定义为ssim结构损失与pmse像素损失的加权和,在迁移图像中保留了源图像的结构信息与纹理信息,兼顾风格迁移算法内容的一致性与风格的可变性,有效提升迁移图像的成像质量与图像中目标清晰度。

[0041]

3、本发明的基于图像风格迁移的雨雾天气交通流数据集扩增方法设计了一种分类器训练模型的背景表示能力,将源图像下采样后的特征图作为特定场景背景标签输出,在压缩背景图像尺寸的基础上仍能保留道路范围,光线条件,采集视角等关键场景信息,有利于提取数据场景信息,使算法能根据背景标签生成相近场景的训练集图像,扩充目标场景适用范围,增强模型泛用性与扩增数据集的可移植性。

附图说明

[0042]

附图用来提供对本发明的进一步理解,与说明描述一起用于解释本发明的实施例,并不构成对本发明的限制。在附图中:

[0043]

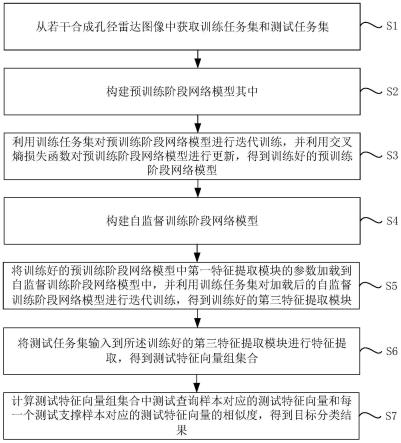

图1为本发明提出的一种基于图像风格迁移的雨雾天气交通流数据集扩增方法的技术流程图。

[0044]

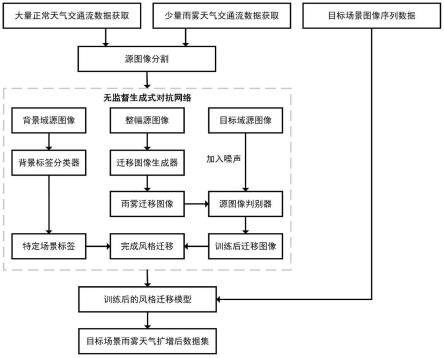

图2为本发明提出的一种基于图像风格迁移的雨雾天气交通流数据集扩增方法的整体网络结构示意图。

具体实施方式

[0045]

为了进一步理解本发明,下面结合实施例对本发明优选实施方案进行描述,但是应当理解,这些描述只是为进一步说明本发明的特征和优点,而不是对本发明权利要求的限制。

[0046]

该部分的描述只针对典型的实施例,本发明并不仅局限于实施例描述的范围。不同实施例的组合、不同实施例中的一些技术特征进行相互替换,相同或相近的现有技术手段与实施例中的一些技术特征进行相互替换也在本发明描述和保护的范围内。

[0047]

如图1所示,为一种基于视频图片风格迁移的雨雾天气交通流数据集扩增方法的流程图,具体步骤如下:

[0048]

步骤1:获取大量正常天气条件下交通流图片数据集dn与标签ln,获取少量雨雾天气条件下交通流图片数据集da与标签la,获取一段目标路段交通流视频图像序列d

t

。其中,正常天气条件下交通流图片数据集dn中含标签图片总量在5000张以上,采集视角与目标路段交通流视频图像序列d

t

的采集视角相近,标签ln可以为外接框或目标掩模,但正常天气条件下交通流标签ln、雨雾天气条件下交通流标签la与目标路段在雨雾天气条件下的交通流标签l

ft

的类型一致,雨雾天气条件下交通流图片数据集da中含标签图片总量在100张以上,并包括目标路段交通流视频图像序列d

t

采集视角的场景。

[0049]

步骤2:根据正常天气条件下交通流标签ln和雨雾天气条件下交通流标签la从其对应的数据集中分割出目标域源图像和背景域源图像。

[0050]

步骤3:构造无监督生成式对抗网络将正常天气条件下交通流图片数据集dn的场景转化为雨雾天气条件。

[0051]

将目标域源图像与完整源图像分别送入对抗网络中进行风格迁移学习,获取迁移后的目标域结果d

t,f

与完整图像结果d

t,p

。所述风格迁移的对抗网络结构如下:

[0052]

1)对抗网络的整体结构如图2所示,包括生成器g、判别器d、分类器t

bg

与稳定器st。其中生成器输入包括dn与随机噪声,生成器输出为雨雾迁移图像d

t

;判别器输入为雨雾迁移图像d

t

与雨雾天气条件下交通流图片数据集da,输出为雨雾迁移图像d

t

与雨雾天气条件下交通流图片数据集da真假的判别结果以及生成器g的调整策略;分类器t

bg

输入为正常天气条件下交通流图片数据集dn与雨雾天气条件下交通流图片数据集da中剥离目标域样本的背景图像,输出为特定场景样本标签稳定器st输入为迁移后的目标域d

t,f

与雨雾天气条件下交通流图片标签la对应的背景d

t,p

,输出为调整后的完整雨雾天气数据集d

tj

与对应标签l

tj

。

[0053]

2)对抗网络生成器g的结构为包含残差连接的卷积神经网络,其中噪声先通过全连接层特化特征,并与图像合并通过步长为1、维数为64的卷积层与relu激活函数进行下采样,之后通过5层残差块提取残差特征,并采用步长为1、维数为3的反卷积层进行上采样,最后经过tanh函数输出雨雾生成图像d

t

。

[0054]

3)对抗网络判别器d采用四层卷积层提取特征,并通过bn(batch normolization)与lrelu(leaky relu)归一特征,缓解网络梯度消失问题,最后通过tanh激活函数输出对应图象为真的概率。

[0055]

4)分类器t

bg

结构为两层4*4下采样层,经过两层下采样层后的特征图在压缩背景图像尺寸的基础上仍能保留道路范围、光线条件、采集视角等关键场景信息,有利于提取数据场景信息,使算法能根据背景标签生成相近场景的训练集图像,扩充目标场景适用范围,增强训练集泛用性。

[0056]

在风格迁移对抗网络中,各网络损失函数计算方式如下:

[0057]

5)生成器损失函数表示如下:

[0058][0059]

其中,表示生成器对抗损失,由对抗网络中判别器d给出;l

con

为内容损失,用于描述生成图像与源图像的底层信息差异;l

t

为分类器损失,用于区分由分类器给出的特定场景中生成图像的差异;λ1、λ2与λ3为调节三种损失重要性的权重系数。

[0060]

对抗损失是生成器g与判别器d交互的方式之一,也是对抗网络实现“对抗”操作的渠道,优化对抗损失可以提升生成器g生成融合效果更好的图片的能力,也可以增加融合图像中的源图像信息,本发明中对抗损失取判别器d对伪融合图像判别结果的交叉熵,即:

[0061][0062]

其中,d(g(v,i))表示判别器对生成图像的判真概率。

[0063]

内容损失定义了生成器g生成的伪融合图像与输入的源图像之间的相关性,并决定了融合图像中将保留何种源图像特征,需要同时兼顾内容的一致性与风格的可变性,对图像来源与光线变化均具有不变性的结构特征是组成内容损失函数的关键部分,与此同时,为了加强目标域内容轮廓的清晰度,应额外加入边缘低层特征提升融合图像中感知目标的清晰度与形位准确度,综合上述考虑,本发明对抗网络的内容损失定义如下:

[0064][0065]

其中,l

ssim

表示ssim(structure similarity index measure)结构性损失,用于约束生成图像结构相似性,l

pmse

表示像素对mse(pairwise mean squared error)损失,用于约束生成图像边缘相似性,δ1与δ2为调节两种损失重要性的权重参数。

[0066]

具体而言,在ssim网络中,输入图像可以用结构、亮度与对比度三种特征表示:

[0067][0068]

其中,||.||表示l2范数计算,代表ik的像素均值,代表原图像与均值像素的差值,k∈{i,v},表示原图像类型为可见光或红外。对比度ck一定程度上反映了图像质量的好坏,因此采用取最大的方式获得预期对比度

[0069][0070]

结构特征sk是ssim损失函数中关键特征,综合考虑双源图像影响,采用加权方式计算预期结构特征

[0071][0072][0073]

对于权重参数w(ik),当图像特征sk差异较大时,很可能是某源信息量较少,图像质量较差,此时给予对比度ck较高的源图像结构特征以较高的权重,使融合图像从质量较好的源图像中获得更多细节;当图像特征sk接近时,说明双源图像信息量相当,此时在不增加网络参数,加快网络收敛速度的考虑下,赋予双源结构特征相等的权重。

[0074]

对于亮度特征lk,由于其在源图像中变化较大,不能很好表示稳定的图像特征,因

此在计算损失函数时不予考虑。

[0075]

根据上述讨论,预期融合图像可以表示为:

[0076][0077]

对于伪融合图像if,像素p点的ssim损失可以表示为:

[0078][0079]

其中表示预期图像方差,表示预期图像与伪融合图像协方差。

[0080]

总ssim损失函数l

ssim

可以表示为:

[0081][0082]

像素对mse损失用于生成图像对间对应像素的相似度而非整幅图像相似度,采用这种损失可以使模型在关注细节较多的目标域区域同时,不花费额外算力在区分颜色与像素强度等无关细节上,l

pmse

的计算方式如下:

[0083][0084]

其中,dn为数据集源图像,g(dn,z)为生成图像,k代表源图像中像素点个数,||.||2代表二范数,为哈达玛积运算,m为目标域掩模。

[0085]

6)在对抗网络中,判别器d需要判别源图像与生成图像的真伪,同时由于在判别器中没有真值参考图像作为输入,因此判别器d的损失函数应仅由生成图像判别结果与源图像判别结果共同组成。对抗网络判别器d的损失表示如下:

[0086]

ld=p1e

cross

[-logd(dn)] p2e

cross

[-log(1-d(g(dn,z)))

[0087]

其中,p1、p2为反映源图像与生成图像信息量的权重系数,计算方式与生成器ssim损失函数中权重计算方式相同。

[0088]

7)分类器t

bg

的作用是提取数据场景信息,使算法能根据背景标签生成相近场景的训练集图像,扩充目标场景适用范围,增强训练集泛用性,因此在损失中应更多体现背景间的纹理相似度,故采用tv范数作为分类器t

bg

的损失函数:

[0089]

l

t

=e

cross

[|||g(dn,z)-dn||

tv

]

[0090]

步骤4:将大量正常天气条件下交通流图片数据集dn与少量雨雾天气条件下交通流图片数据集da中剥离目标域样本的背景图像送入分类器t

bg

,获取包含特定背景信息的标签即完成交通流数据集从正常天气条件至雨雾天气条件的迁移。

[0091]

步骤5:带入目标路段交通流视频图像序列d

t

至分类器t

bg

中,获取目标路段交通流背景标签将随机d

t,f

映射至由标签生成的背景d

t,p

中,获取目标路段雨雾天气条件下交通流数据集d

ft

与标签l

ft

。

[0092]

这里本发明的描述和应用是说明性的,并非想将本发明的范围限制在上述实施例中。说明书中所涉及的效果或优点等相关描述可因具体条件参数的不确定或其它因素影响而可能在实际实验例中不能体现,效果或优点等相关描述不用于对发明范围进行限制。这

里所披露的实施例的变形和改变是可能的,对于那些本领域的普通技术人员来说实施例的替换和等效的各种部件是公知的。本领域技术人员应该清楚的是,在不脱离本发明的精神或本质特征的情况下,本发明可以以其它形式、结构、布置、比例,以及用其它组件、材料和部件来实现。在不脱离本发明范围和精神的情况下,可以对这里所披露的实施例进行其它变形和改变。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。