1.本发明涉及基于深度学习的计算机视觉技术领域,具体涉及一种应用于计算机视觉的软阈值注意力机制。

背景技术:

2.深度学习领域中,数据集中样本的质量直接影响着模型的训练效果,但是采集的样本中不可避免的会存在一些噪声或者冗余信息,广义上讲,样本中与当前分类任务无关的信息也可以理解为噪声或冗余信息,这些噪声或冗余信息会对最终的结果产生干扰,因此降低样本中含有的噪声或冗余信息在一定程度上可以提高模型预测的准确率。

3.软阈值化是很多降噪方法的核心步骤,应用它的关键就是要确定一个阈值,根据这个阈值将输入数据中有用的信息转换为接近0的正或负值,将噪声信息转换为0特征,这样就可以达到降低噪声的目的,可以考虑将软阈值化引入深度学习领域,来降低噪声或冗余信息的干扰。阈值是否合适对于软阈值化的效果有直接的影响,但是软阈值化往往需要根据大量的先验知识来确定合适的阈值,而在深度学习领域,每个样本都含有不同的噪声,因此要将软阈值化方法引入到深度学习领域,就需要一种自适应于不同样本的确定阈值的方法,这是一个挑战性的问题。

4.注意力机制是最近几年的一大研究热点,已被广泛应用在深度学习各领域中,比如自然语言处理,语音识别和计算机视觉等,尤其是自然语言处理,注意力机制已然成为自然语言处理算法的基本结构之一。注意力机制实际上就是让机器通过模仿人类的感知方式来判断数据中需要注意的地方,模型通过不断地训练迭代之后,对于大量的输入数据中不同部分赋予相应的权重,从而能够提取到模型认为的输入数据中对于当前任务来说重要和不重要的信息,针对重要的数据信息进行处理,使模型可以快速计算出更加准确的结果,并且不会带来很大的计算量,因此注意力机制有着较为广泛的研究价值和应用前景。

5.经过不断地训练迭代之后,注意力机制可以准确的注意到不同的输入数据中重要和不重要的特征,每个样本都可以计算得到自己独特的一组权重。利用注意力机制,根据各样本的情况,就可以自动的为每个样本设置合适的阈值,从而可以将软阈值化引入到深度学习领域中,通过软阈值化,将不重要的信息置零,保留重要的信息,来提高模型预测的准确率。

6.目前,深度残差收缩网络通过使用senet注意力机制来为每个特征图通道设置自适应的阈值,现有技术中(论文:zhao m,zhong s,fu x,et al.deep residual shrinkage networks for fault diagnosis[j].ieee transactions on industrial informatics,2019,16(7):4681-4690.)将软阈值化方法引入到深度学习领域中,取得了不错的效果。深度残差收缩网络是针对“基于振动信号的机械传动系统故障诊断”任务中的噪声问题提出的,使用的senet注意力机制只关注了通道信息,没有关注位置信息;对于一般的视觉任务来说,图像中含有的噪声较少,模型使用软阈值化和注意力机制结合的方式意义不大,对于一些多噪声的视觉任务来说,可以使用软阈值化来减少噪声的影响,并且位置信息是图像

数据中非常重要的信息,因此我们需要一种同时考虑通道和位置信息的注意力机制来代替senet与软阈值化方法结合,设计一种新的软阈值注意力模块来进一步减少噪声或冗余信息的影响。深度残差收缩网络将设计的模块集成在了resnet残差块里面,不能方便的应用到其它的地方,因此设计的软阈值注意力模块还需要满足即插即用的要求,能够方便的集成到现有的神经网络架构中。

技术实现要素:

[0007]

本发明针对上述问题,提供了一种应用于计算机视觉的软阈值注意力机制,借鉴深度残差收缩网络的思想,融合了同时考虑通道和位置信息的coordinateattention注意力机制和软阈值函数,提出了一种即插即用的软阈值注意力模块,能够更好地适用于计算机视觉领域的检测任务,可以方便的集成到现有的神经网络架构中,通过将不重要的特征置为零,保留重要的特征,来降低噪声或冗余信息的干扰,加强神经网络提取重要特征的能力,达到提升网络预测精度的目的。

[0008]

本发明解决技术问题的技术方案为:

[0009]

一种应用于计算机视觉的软阈值注意力机制,包括以下步骤:

[0010]

(1)、求得输入的特征图中所有特征的绝对值,并将其作为下一步骤的输入,表示为:

[0011]

x

abs

=|x|

ꢀꢀ

(3)

[0012]

其中,x为输入的特征图,x

abs

为输入的特征图取绝对值后的特征图;

[0013]

(2)、使用两个空间尺寸的池化核(1,w)和(h,1)分别沿着垂直方向和水平方向对特征图x

abs

进行池化,得到垂直方向和水平方向上池化之后的两个特征图zh和zw,高度为h的第c个通道的输出和宽度为w的第c个通道的输出分别表示为:

[0014][0015][0016]

其中,h表示对特征图在垂直方向上进行处理,代表了特征图的所有行;w表示对特征图在水平方向上进行处理,代表了特征图的所有列;

[0017]

为高度为h的第c个通道的输出,w为特征图的宽,xc(h,i)为特征图第c个通道第i列的特征;

[0018]

为宽度为w的第c个通道的输出,h为特征图的高,xc(j,w)为特征图第c个通道第j行的特征;

[0019]

各个组成了特征图zh,各个组成了特征图zw,得到的两个特征图zh和zw,形状分别为(b,c,h,1),(b,c,1,w),b为batch_size,c为通道数,h为特征图的高,w为特征图的宽;

[0020]

对特征图各通道沿着垂直方向和水平方向两个方向分别进行全局平均池化得到

的特征图,能够很好的保存位置信息,使得提取的特征更加准确。

[0021]

(3)、将步骤(2)得到的zw翻转为(b,c,w,1),然后再与zh沿着第3维进行拼接融合得到融合特征图,形状为(b,c,w h,1),融合之后使用一个共享的1

×

1卷积操作f1和h_swish激活函数δ来处理融合特征图,得到f∈r

c/r

×

(h w)

,具体形状为(b,c/r,w h,1),r为下采样参数,用来控制参数量,f的求取公式为:

[0022]

f=δ(f1([zh,zw]))

ꢀꢀꢀ

(6)

[0023]

(4)、将f沿着第3维切分为两个张量fh∈r

c/r

×h和fw∈r

c/r

×w,并将fw翻转为(b,c/r,1,w),再利用两个卷积核大小为1

×

1的卷积fh和fw分别将fh与fw变换为原来的输入通道数c得到输出,并使用sigmoid函数σ将得到的输出归一化为0和1之间,得到归一化的输出gh和gw,形状分别为(b,c,h,1)和(b,c,1,w):

[0024]gh

=σ(fh(fh))

ꢀꢀꢀ

(7)

[0025]gw

=σ(fw(fw))

ꢀꢀꢀ

(8)

[0026]

(5)、将步骤(2)得到的两个垂直和水平方向的特征图zh和zw,分别与步骤(4)中归一化的输出gh和gw相乘,得到两组阈值τh和τw,分别表示为:

[0027]

τh=zh·gh

ꢀꢀꢀ

(9)

[0028]

τw=zw·gw

ꢀꢀꢀ

(10)

[0029]

其中,τh为垂直方向上的阈值,τw为水平方向上的阈值;

[0030]

使用取绝对值操作并且全局平均池化后的输出乘以一组0到1之间的输出来计算阈值,这种方式保证了阈值为正,并且不会太大。

[0031]

(6)、利用步骤(5)得到的两个方向上的阈值τh和τw,分别对输入的特征图x进行软阈值化处理,得到垂直和水平两个方向上的软阈值化输出yh和yw,具体的软阈值化过程如下:

[0032]

yh=sign(x)*max((|x|-τh),0)

ꢀꢀꢀ

(11)

[0033]yw

=sign(x)*max((|x|-τw),0)

ꢀꢀꢀ

(12)

[0034]

其中,x为输入此模块的特征图,max为最大值函数,sign为符号函数。

[0035]

(7)、将步骤(6)得到的垂直和水平两个方向上的软阈值化输出yh和yw依次与输入的特征图x相加,得到这个模块的最终输出y:

[0036]

y=x yh ywꢀꢀꢀ

(13)

[0037]

发明内容中提供的效果仅仅是实施例的效果,而不是发明所有的全部效果,上述技术方案中的一个技术方案具有如下优点或有益效果:

[0038]

本发明设计的这个软阈值注意力模块,融合了coordinate attention注意力机制和软阈值化函数:步骤1~5利用ca注意力机制可以自动的注意到重要和不重要特征信息的功能,为特征图的每个通道在垂直和水平方向上自动的确定两组阈值;步骤6利用软阈值化降噪的原理,根据确定的两组阈值在特征图的垂直和水平方向上分别进行了软阈值化处理,减少特征图中的噪声和冗余信息;步骤7将两个方向上的结果依次附加到输入的特征图中,完成整个模块的处理。相比于senet与软阈值化的结合方式只考虑了通道信息,此模块还考虑了位置信息,对于噪声的定位更准确,能更精确的减少噪声或冗余信息,从而能够提升模型在多噪声视觉任务上的检测精度。

附图说明

[0039]

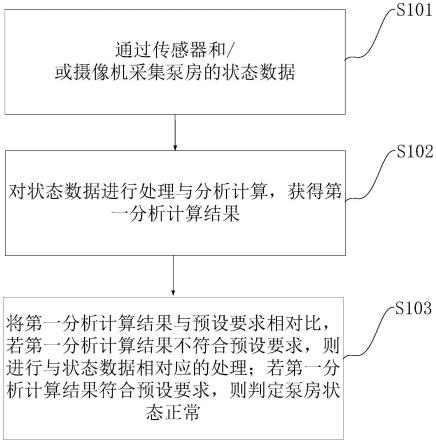

图1为ca注意力机制的结构示意图;

[0040]

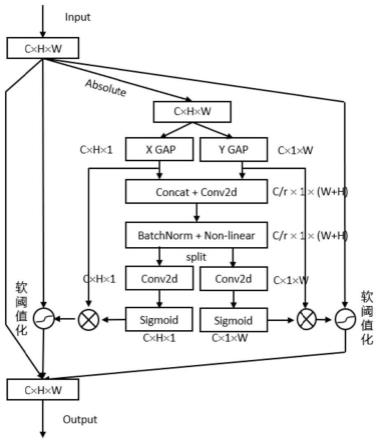

图2为本发明的软阈值注意力模块的结构示意图;

具体实施方式

[0041]

为了能清楚说明本方案的技术特点,下面通过具体实施方式,并结合其附图,对本发明进行详细阐述。下文的公开提供了许多不同的实施例或例子用来实现本发明的不同结构。为了简化本发明的公开,下文中对特定例子的部件和设置进行描述。此外,本发明可以在不同例子中重复参考数字和/或字母。这种重复是为了简化和清楚的目的,其本身不指示所讨论各种实施例和/或设置之间的关系。应当注意,在附图中所图示的部件不一定按比例绘制。本发明省略了对公知组件和处理技术及工艺的描述以避免不必要地限制本发明。

[0042]

现有技术名词解释:

[0043]

软阈值化函数的表达式如下:

[0044][0045]

其中,x为输入,y为输出,τ为阈值,将绝对值低于阈值τ的输入x置为0,将绝对值大于阈值τ的输入x朝着0收缩。阈值τ是预先设置的参数,阈值τ是否合适对于软阈值化的效果有直接的影响,一般需要满足以下条件:

[0046]

(1)必须为正数

[0047]

(2)输入数据绝对值的最大值必须要大于阈值,否则输出全为0

[0048]

可以看出,软阈值化能把取值范围为[-τ,τ]内的特征置为零,而阈值τ的值在神经网络中是自适应调整的,因此软阈值化是一种更灵活的、删除冗余信息的方式。

[0049]

软阈值化输出y对输入x的导数如下:

[0050][0051]

由式(1)和式(2)可知,软阈值化是一种非线性变换,并且输出y对输入x的导数为0或1,类似于relu激活函数,在一定程度上能够减小梯度爆炸和梯度消失的风险,利于模型训练时的反向传播。将软阈值函数引入到深度学习领域,降低样本中的噪声,是一个值得研究的方向。

[0052]

coordinate attention注意力机制:

[0053]

ca(coordinate attention)注意力机制将位置信息嵌入到通道注意力中,可提取长依赖的空间位置信息,并且不会有很大的计算量,轻量且高效。ca注意力机制如下图,在计算通道注意力时,不是简单的采用全局平均池化,而是在水平和垂直两个方向同时进行聚合特征,在计算通道注意力的同时保留了整个空间的长依赖信息,最后得到两个方向的注意力图,可以准确定位出感兴趣区域的位置,这样就在通道注意力中嵌入了位置信息。相比于senet注意力机制使用全局平均池化只考虑了通道间的信息,ca注意力机制同时还考虑了位置信息,能够更准确的提取出重要的特征信息。

[0054]

本发明借鉴深度残差收缩网络的思想,使用同时考虑通道和位置信息的ca注意力机制(coordinate attention)来代替senet与软阈值化方法结合,提出一种新的软阈值注意力模块:融合传统信号降噪算法中的软阈值化函数与ca注意力机制,利用ca注意力机制确定垂直和水平两个方向上的两组软阈值化函数所需的阈值,再分别进行软阈值化处理并对输入的特征图进行加权,是一种通过减小输入数据中噪声或冗余信息的影响来提升模型精度的机制;能够更好的适用于计算机视觉领域的检测任务,并且可以方便的集成到现有的神经网络架构中,通过将不重要的特征置为零,保留重要的特征,来降低噪声或冗余信息的干扰,加强神经网络提取重要特征的能力,达到提升网络预测精度的目的,结构如图2所示。

[0055]

所述的软阈值注意力模块为:先通过ca注意力机制为输入数据生成水平和垂直两个方向上的权重,并利用生成的权重来自动的为输入数据在水平和垂直两个方向上分别设置合适的阈值,再根据两组阈值来对输入数据分别进行两个方向上的软阈值化处理,最后将软阈值化处理得到的水平和垂直两个方向上的结果依次附加到原输入数据中,得到最终的输出。

[0056]

在所述的软阈值注意力模块中,对于输入的特征图x=[x1,x2,

…

,xc]∈rc×h×w,计算得到一个抑制不重要特征之后的同尺寸的输出特征图y=[y1,y2,

…

,yc]∈rc×h×w,其中,c,h和w分别为特征图的通道数,高,宽。

[0057]

本发明解决技术问题的技术方案为:

[0058]

一种应用于计算机视觉的软阈值注意力机制,包括以下步骤:

[0059]

(1)、求得输入的特征图中所有特征的绝对值,并将其作为下一步骤的输入,表示为:

[0060]

x

abs

=|x|

ꢀꢀꢀ

(3)

[0061]

其中,x为输入的特征图,x

abs

为输入的特征图取绝对值后的特征图;

[0062]

(2)、使用两个空间尺寸的池化核(1,w)和(h,1)分别沿着垂直方向和水平方向对特征图x

abs

进行池化,得到垂直方向和水平方向上池化之后的两个特征图zh和zw,分别对应图2中的xgap和ygap,高度为h的第c个通道的输出和宽度为w的第c个通道的输出分别表示为:

[0063][0064][0065]

其中,h表示对特征图在垂直方向上进行处理,代表了特征图的所有行;w表示对特征图在水平方向上进行处理,代表了特征图的所有列;

[0066]

为高度为h的第c个通道的输出,w为特征图的宽,xc(h,i)为特征图第c个通道第i列的特征;

[0067]

为宽度为w的第c个通道的输出,h为特征图的高,xc(j,w)为特征图第c个通

道第j行的特征;

[0068]

各个组成了特征图zh,各个组成了特征图zw,得到的两个特征图zh和zw,形状分别为(b,c,h,1),(b,c,1,w),b为batch_size,c为通道数,h为特征图的高,w为特征图的宽;

[0069]

对特征图各通道沿着垂直方向和水平方向两个方向分别进行全局平均池化得到的特征图,能够很好的保存位置信息,使得提取的特征更加准确。

[0070]

(3)、将步骤(2)得到的zw翻转为(b,c,w,1),然后再与zh沿着第3维进行拼接融合得到融合特征图,形状为(b,c,w h,1),融合之后使用一个共享的1

×

1卷积操作f1和h_swish激活函数δ来处理融合特征图,得到f∈r

c/r

×

(h w)

,具体形状为(b,c/r,w h,1),r为下采样参数,用来控制参数量,f的求取公式为:

[0071]

f=δ(f1([zh,zw]))

ꢀꢀꢀ

(6)

[0072]

(4)、将f沿着第3维切分为两个张量fh∈r

c/r

×h和fw∈r

c/r

×w,并将fw翻转为(b,c/r,1,w),再利用两个卷积核大小为1

×

1的卷积fh和fw分别将fh与fw变换为原来的输入通道数c得到输出,并使用sigmoid函数σ将得到的输出归一化为0和1之间,得到归一化的输出gh和gw,形状分别为(b,c,h,1)和(b,c,1,w):

[0073]gh

=σ(fh(fh))

ꢀꢀꢀ

(7)

[0074]gw

=σ(fw(fw))

ꢀꢀꢀ

(8)

[0075]

(5)、将步骤(2)得到的两个垂直和水平方向的特征图zh和zw,分别与步骤(4)中归一化的输出gh和gw相乘,得到两组阈值τh和τw,分别表示为:

[0076]

τh=zh·gh

ꢀꢀꢀ

(9)

[0077]

τw=zw·gw

ꢀꢀꢀ

(10)

[0078]

其中,τh为垂直方向上的阈值,τ3为水平方向上的阈值;

[0079]

使用取绝对值操作并且全局平均池化后的输出乘以一组0到1之间的输出来计算阈值,这种方式保证了阈值为正,并且不会太大。

[0080]

(6)、利用步骤(5)得到的两个方向上的阈值τh和τw,分别对输入的特征图x进行软阈值化处理,得到垂直和水平两个方向上的软阈值化输出yh和yw,具体的软阈值化过程如下:

[0081]

yh=sign(x)*max((|x|-τh),0)

ꢀꢀꢀ

(11)

[0082]yw

=sign(x)*max((|x|-τw),0)

ꢀꢀꢀ

(12)

[0083]

其中,x为输入此模块的特征图,max为最大值函数,sign为符号函数。

[0084]

(7)、将步骤(6)得到的垂直和水平两个方向上的软阈值化输出yh和yw依次与输入的特征图x相加,得到这个模块的最终输出y:

[0085]

y=x yh ywꢀꢀꢀ

(13)

[0086]

实施例:

[0087]

使用resnet50 fpn作为faster rcnn的特征提取网络,将本发明提出的软阈值注意力机制分别加入到resnet50的两端,使用pascal voc 2012数据集来进行模型的训练与效果评估。pascal voc2012是计算机视觉领域的基准数据之一,广泛应用于目标检测,图像分割等任务的实验与模型效果评估,一共有20个类别,训练集有5717张图片,测试集有5823

张图片。使用resnet50 fpn的预训练权重进行迁移学习,并将模型在训练集迭代42870次,得到收敛的目标检测模型,再利用测试集进行效果评估。加入ca注意力机制的模型在测试集的map达到了74.9%,加入本发明提出的注意力机制的模型在测试集的map达到了75.6%。由实验可知,使用本发明提出的软阈值注意力机制在计算机视觉领域的检测任务中会提高模型预测的准确率。

[0088]

上述虽然结合附图对发明的具体实施方式进行了描述,但并非对本发明保护范围的限制,在本发明的技术方案的基础上,本领域技术人员不需要付出创造性劳动即可做出的各种修改或变形仍在本发明的保护范围以内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。